📄 WaveSpikeNet: A Wavelet-Spiking Fusion Architecture for Audio Classification on Edge Devices

#音频分类 #脉冲神经网络 #边缘计算 #生物启发计算 #时频分析

✅ 7.5/10 | 前25% | #音频分类 | #脉冲神经网络 | #边缘计算 #生物启发计算

学术质量 5.5/7 | 选题价值 2.0/2 | 复现加成 0.0 | 置信度 中

👥 作者与机构

- 第一作者:Bin Liu(上海科技大学信息科学与技术学院,中国科学院自动化研究所多模态人工智能系统国家重点实验室)

- 通讯作者:Wenjuan Li(中国科学院自动化研究所多模态人工智能系统国家重点实验室,邮箱:wenjuan.li@ia.ac.cn)

- 作者列表:Bin Liu(上海科技大学信息科学与技术学院,中国科学院自动化研究所多模态人工智能系统国家重点实验室)、Wenjuan Li(中国科学院自动化研究所多模态人工智能系统国家重点实验室)、Bing Li(中国科学院自动化研究所多模态人工智能系统国家重点实验室)、Chunfeng Yuan(中国科学院自动化研究所多模态人工智能系统国家重点实验室)、Kun Shang(广东省无创脑机接口多模态重点实验室)、Shaobing Gao(四川大学计算机科学与技术学院)、Weiming Hu(上海科技大学信息科学与技术学院,中国科学院自动化研究所多模态人工智能系统国家重点实验室)

💡 毒舌点评

这篇论文的亮点在于其高度原创的“生物启发式”架构设计,将小波变换、脉冲神经网络与双通路处理有机结合,为解决音频分类在边缘设备上的部署难题提供了新颖且有效的思路,参数效率指标(1.9M参数达95.91%准确率)极具吸引力。但其短板也很明显:一是实验仅在多个中小型数据集上验证,缺乏对更大规模、更复杂真实场景的测试,且所有模型均为“从头训练”,未能与当前主流的预训练范式进行公平对比,削弱了其结论的普适性;二是虽然声称面向边缘部署,但未提供在实际嵌入式设备(如STM32、RISC-V)上的功耗与延迟实测数据,效率分析仍停留在FLOPs和模拟器层面。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:使用了公开基准数据集(US8K, ESC-50, SCV2, GTZAN, AudioSet),但论文未说明其具体获取方式。

- Demo:未提及。

- 复现材料:论文提供了详细的训练设置(数据预处理、增强、优化器、学习率策略、损失权重)、模型变体规格(参数量、尺寸)和硬件环境(4x RTX 2080 Ti),但这些信息分散在正文和表格中,未提供统一的配置文件或检查点。附录未提供额外细节。

- 论文中引用的开源项目:未明确提及。

- 总结:论文中未提及开源计划。尽管给出了较多训练细节,但由于核心代码和权重未公开,其可复现性较低。

📌 核心摘要

- 要解决的问题:在IoT和边缘计算背景下,音频分类模型面临高性能(大参数)与低资源(有限算力/内存)之间的根本矛盾。现有模型要么参数冗余无法部署,要么压缩后精度下降显著。

- 方法核心:提出WaveSpikeNet,一种受人类听觉系统启发的轻量级架构。其核心包括:(1) 可学习离散小波变换(LDWT)进行任务自适应的频率分解;(2) 模仿听觉皮层“腹侧-背侧”通路的双通路异构处理架构,分别使用传统的残差块处理低频稳态特征,使用简化的Leaky Integrate-and-Fire(LIF)脉冲神经网络处理高频瞬态特征;(3) 多级注意力融合模块进行有效整合。

- 与已有方法相比新在哪里:首次成功地将可学习小波变换、脉冲神经网络和多级注意力机制融合用于音频分类。与传统的同质化(如全卷积)或均匀压缩方法不同,它通过生物启发的异构处理(低频CNN,高频SNN)来提升参数效率,而非简单地减少参数量。

- 主要实验结果:在UrbanSound8K数据集上,Base模型(1.9M参数)达到95.91%准确率,超越参数量为其4倍多的ResNetSE(7.8M参数,95.07%),参数效率(准确率/参数量)显著提升。在ESC-50、GTZAN等数据集上也从头训练取得有竞争力的结果。在AudioSet上,以约35倍少于CNN14的参数量,取得了更高的mAP(0.234 vs 0.221)。消融实验验证了双通路设计、可学习小波和脉冲机制的有效性。

- 实际意义:为在资源受限的边缘设备(如树莓派)上部署高性能音频分类模型提供了一种有前景的新架构,可能推动智能传感在智能家居、工业监测等领域的应用。

- 主要局限性:(1) 缺乏在真实物理边缘设备上的功耗、延迟等硬件指标实测;(2) 所有实验均为从头训练,未能与当前主流的预训练-微调范式进行对比,其性能上限和泛化能力有待进一步验证;(3) 论文未提供代码、模型权重等开源材料,可复现性存疑。

🏗️ 模型架构

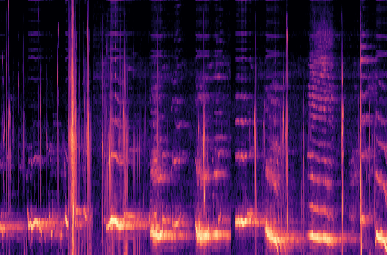

WaveSpikeNet的整体架构(如图2所示)是一个端到端的音频分类模型,输入为梅尔频谱图,输出为类别预测。其流程和组件如下:

- 输入与预处理:输入音频被重采样至16kHz,并提取80-bin的Fbank特征,归一化为梅尔频谱图。

- 频率解耦(核心模块1):梅尔频谱图首先输入可学习离散小波变换(LDWT) 模块。该模块基于提升方案,首先在时间维度进行分解,然后对得到的近似系数和细节系数在频率维度再次分解,最终产生四个子带:LL(低频近似)、LH(低频细节)、HL(高频细节)和HH(高频细节)。LDWT的预测和更新算子由可学习的1x1卷积实现,使分解能适应特定任务。

- 双通路异构处理(核心模块2):

- 低频通路(LF Pathway):接收LL子带。它由一系列深度可分离残差块堆叠而成,每个块包含深度卷积、点wise卷积、批归一化、ReLU激活和残差连接。此通路旨在高效处理音频中的稳态特征,如音调和共振峰。

- 高频通路(HF Pathway):接收由LH、HL、HH子带拼接而成的特征。此通路采用简化的离散时间LIF脉冲神经元模型构建的模块处理。LIF神经元模拟生物神经元的“积分-发放”特性,其膜电位按衰减因子β泄漏,输入电流累加,当超过阈值时发放脉冲并重置。此通路利用SNN的事件驱动特性,适合处理高频瞬态事件(如起音、冲击)中的稀疏信息,以降低计算冗余。

- 多级注意力融合(核心模块3):

- 中间跨通路融合:在双通路处理过程中,通过交叉注意力机制让两个通路交换信息。例如,低频通路使用其特征作为查询(Q),高频通路的特征作为键(K)和值(V),计算注意力后,将结果通过一个可学习的门控参数γ加权后叠加回低频通路特征,实现增强。高频通路也对称地使用类似操作。

- 最终特征融合:双通路处理完成后的最终特征图(F_final_LF, F_final_HF)被拼接,然后通过一个1x1卷积、批归一化和LIF神经元层进行自适应加权融合,生成最终的分类特征。

- 分类输出:融合后的特征送入分类器(论文中未详细说明分类头结构,通常为全局平均池化后接全连接层)进行分类预测。

架构图说明:

图2展示了从梅尔频谱图输入到分类输出的生物启发式双通路设计。频率解耦模块将频谱图分解为LL、LH、HL、HH子带,分别送入低频通路和高频通路,最后通过注意力和融合模块整合。

图2展示了从梅尔频谱图输入到分类输出的生物启发式双通路设计。频率解耦模块将频谱图分解为LL、LH、HL、HH子带,分别送入低频通路和高频通路,最后通过注意力和融合模块整合。

图3展示了两个核心组件:(a) 基于提升方案的可学习小波变换模块,展示了如何通过可学习的预测(P)和更新(U)操作分解输入;(b) 用于高频通路的状态化LIF神经元模型,显示了膜电位(mem)随输入积累、泄漏、发放脉冲(spikes)和重置的过程。

图3展示了两个核心组件:(a) 基于提升方案的可学习小波变换模块,展示了如何通过可学习的预测(P)和更新(U)操作分解输入;(b) 用于高频通路的状态化LIF神经元模型,显示了膜电位(mem)随输入积累、泄漏、发放脉冲(spikes)和重置的过程。

💡 核心创新点

生物启发的频率解耦框架(LDWT):

- 是什么:一个基于提升方案的可学习离散小波变换模块。

- 之前方法的局限:传统DWT使用固定的基函数(如Haar),无法适应特定任务;而标准卷积网络对整个频谱图进行同质化处理,未利用不同频率成分的固有差异。

- 如何起作用:通过可学习的预测和更新算子(由1x1卷积实现),LDWT能根据任务数据自适应地将频谱图分解为不同频率子带,模仿耳蜗的物理频率分析。

- 收益:实现了任务自适应的频率分解,为后续的异构处理提供了更优的特征表示,消除了参数冗余。消融实验显示,使用固定Haar小波会使准确率下降1.79%,移除LDWT则下降1.56%。

双通路异构处理架构:

- 是什么:模仿听觉皮层“腹侧-背侧”双流假说的架构,低频通路使用传统CNN(残差块),高频通路使用SNN(LIF神经元)。

- 之前方法的局限:现有模型大多使用单一类型神经网络(全CNN或全Transformer)处理所有频率信息,未能针对稳态与瞬态特征的不同特性进行优化。

- 如何起作用:低频通路用高效的CNN处理长期稳态特征(如音高),高频通路用事件驱动的SNN处理稀疏瞬态特征(如起音)。这种功能特化处理更符合音频信号的自然特性。

- 收益:这是提升参数效率的关键。消融实验表明,移除双通路设计导致准确率下降2.23%,是最大降幅。

多级注意力融合与联合优化损失:

- 是什么:结合了中间交叉注意力和最终拼接融合的融合机制,以及包含重建、稀疏性、平衡性的联合损失函数。

- 之前方法的局限:简单的特征拼接或相加无法有效整合来自不同通路、具有不同统计特性的信息。

- 如何起作用:中间融合允许通路间信息交换,最终融合自适应加权组合。联合损失中的重建损失(Lrecon)保持LDWT的可逆性,稀疏损失(Lsparse)约束脉冲发放率以节能,平衡损失(Lbalance)防止某一通路主导,确保双通路协同工作。

- 收益:提升了特征融合的质量和模型训练的稳定性。消融实验显示移除中间融合使准确率下降1.13%。

卓越的参数效率:

- 是什么:在显著低于现有高性能模型的参数量下,达到可比甚至更高的分类精度。

- 之前方法的局限:高性能模型(如ResNetSE, HTS-AT)参数量巨大;轻量级模型(如MobileNetV3, EfficientAT)以牺牲较多精度为代价。

- 如何起作用:通过上述生物启发的架构设计,在源头(而非后处理压缩)提升参数利用效率。

- 收益:以1.9M参数在UrbanSound8K上达到95.91%准确率,超越7.8M参数的ResNetSE。图1直观展示了其在准确率-参数量曲线上开辟了新的前沿。

🔬 细节详述

训练数据:

- 数据集:UrbanSound8K (US8K), ESC-50, Speech Commands v2 (SCV2), GTZAN, AudioSet (Balanced 20k)。

- 规模:论文未明确给出各数据集的具体训练集/验证集划分,但通常这些是公开基准。AudioSet使用平衡子集。

- 预处理:所有音频重采样至16kHz,归一化为3秒时长(填充或截断)。提取80-bin Fbank特征(1024点FFT,512点hop),进行dB归一化至-20dB目标电平。

- 数据增强:速度扰动、加性噪声(15-30dB SNR,20%概率)、SpecAugment(频率遮罩最多30 bins,时间遮罩最多40帧)、随机时间平移(±10%)。

损失函数:

- 名称:总损失 $L_{total} = L_{cls} + \lambda_1 L_{recon} + \lambda_2 L_{sparse} + \lambda_3 L_{balance}$。

- 作用与权重:

- $L_{cls}$:标准交叉熵损失,用于分类。

- $L_{recon}$:重建损失,确保LDWT的可逆性,防止信息丢失。权重 $\lambda_1 = 0.005$。

- $L_{sparse}$:稀疏性损失,对脉冲发放率施加L1正则化,鼓励能量高效。权重 $\lambda_2 = 0.0005$。

- $L_{balance}$:平衡损失,最小化低频和高频通路分类器输出方差的差异,防止通路坍塌。权重 $\lambda_3 = 0.02$。

- 详细解释:这些权重通过网格搜索验证确定。联合优化确保模型在提升效率的同时不损失信息表示能力和多通路协同。

训练策略:

- 优化器:AdamW,权重衰减1e-4。

- 学习率:使用warmup余弦退火策略,前8个epoch从0热身至峰值8e-4,然后在80个epoch内衰减至5e-6。

- 批大小:16。

- 训练轮数:80个epoch。

- 其他技巧:标签平滑(0.1)。

关键超参数:

- 模型大小:提供了四个变体:Nano (0.8M), Tiny (1.2M), Base (1.9M), Large (3.4M)。Base为默认配置。

- LDWT中的可学习参数:预测和更新算子中的卷积层参数,以及缩放因子α和β。

- LIF神经元参数:泄漏因子β(例如0.9),可学习的发放阈值 $V_{th}$。

- 融合模块参数:门控参数γ。

训练硬件:4块NVIDIA RTX 2080 Ti GPU。

推理细节:论文未提供关于解码策略、温度、beam size等的详细信息,因为这不是生成模型。推理速度在Raspberry Pi 4B上测试,Base模型约为95 it/s。

正则化:除了数据增强和标签平滑,损失函数中的 $L_{sparse}$ 和 $L_{balance}$ 也起到了正则化作用。

📊 实验结果

主要性能对比 (Table 1)

| 模型 | SCV2 (%) | US8K (%) | 参数量 (M) | 参数效率 (Acc./Param.) |

|---|---|---|---|---|

| 高性能模型 | ||||

| ResNetSE [1] | 96.57 | 95.07 | 7.8 | 12.1 |

| ERes2Net [2] | 96.17 | 95.00 | 6.6 | 14.4 |

| AST [3] | 98.10 | 95.60 | 87.0 | 1.1 |

| HTS-AT [4] | 97.80 | 95.80 | 31.0 | 3.1 |

| 轻量级模型 | ||||

| EfficientAT [8] | 95.10 | 93.91 | 1.4 | 67.1 |

| ShuffleNetV2 [7] | 93.20 | 90.11 | 3.7 | 20.35 |

| MobileNetV3 [6] | 91.50 | 85.39 | 2.8 | 30.49 |

| 我们的模型 | ||||

| WaveSpikeNet-Tiny | 94.85 | 94.68 | 1.2 | 78.9 |

| WaveSpikeNet (Base) | 96.35 | 95.91 | 1.9 | 50.5 |

关键结论:WaveSpikeNet (Base) 在US8K上以1.9M参数达到了95.91%的准确率,超越了参数量为其4.1倍的ResNetSE(7.8M, 95.07%)。其参数效率(准确率/参数量)显著高于MobileNetV3和ShuffleNetV2等传统轻量级模型。

扩展数据集评估 (Table 2)

| 模型 | 参数量 (M) | ESC-50 (%) | GTZAN (%) |

|---|---|---|---|

| ResNetSE | 7.8 | 63.94 | 58.48 |

| ERes2Net | 6.6 | 62.98 | 49.55 |

| ShuffleNetV2 | 3.7 | 43.51 | 50.00 |

| MobileNetV3 | 2.8 | 31.73 | 45.98 |

| WaveSpikeNet | 1.9 | 70.00 | 60.58 |

关键结论:在ESC-50和GTZAN上,WaveSpikeNet以更少的参数和从头训练的方式,取得了比所列基线模型更好的性能,显示了较强的泛化能力。

AudioSet (Balanced 20k) 性能 (Table 3)

| 模型 | 参数量 (M) | mAP | 核心机制 |

|---|---|---|---|

| CNN14 (PANNs) [27] | 81.0 | 0.221 | VGG-style CNN |

| AST (ViT-Base) [3] | 86.0 | 0.148 | Self-Attention |

| Spikformer (SNN) [28] | 65.9 | 0.137 | Spiking Attention |

| WaveSpikeNet | 1.9 | 0.234 | Wavelet-Spiking |

关键结论:在大规模的AudioSet上,WaveSpikeNet以约35倍少于CNN14的参数量,取得了更高的mAP,且远超同为SNN的Spikformer,验证了其在大规模、复杂场景下的优越性。

效率与可扩展性分析 (Table 4)

| 模型 | 参数量 (M) | FLOPs (G) | 模型大小 (MB) | 速度 (it/s) | 准确率 (%) |

|---|---|---|---|---|---|

| 基线 | |||||

| ResNetSE | 7.8 | 1.85 | 30.1 | 79.6 | 95.07 |

| MobileNetV3 | 2.8 | 0.30 | 7.9 | 94.5 | 85.39 |

| 我们的模型变体 | |||||

| Nano (超轻量) | 0.8 | - | 3.1 | - | 93.12 |

| Tiny (移动端) | 1.2 | - | 4.6 | - | 94.68 |

| Base (标准) | 1.9 | 0.23 | 7.3 | 95.0 | 95.91 |

| Large (高性能) | 3.4 | - | 12.8 | - | 96.34 |

关键结论:WaveSpikeNet-Base在树莓派4B上实现了与MobileNetV3相近的推理速度(~95 it/s),但模型尺寸更小(7.3MB vs 7.9MB),同时准确率远高于后者。相比ResNetSE,其FLOPs降低87.6%,模型大小减小75.7%,准确率更高。Base变体在参数与精度间取得了最佳平衡。

消融研究 (Table 5)

| 配置 | 参数量 (M) | US8K 准确率 (%) | 准确率变化 | 参数量变化 |

|---|---|---|---|---|

| WaveSpikeNet | 1.9 | 95.91 | - | - |

| 去除双通路设计 | 1.8 | 93.68 | -2.23 | -0.1M |

| 去除可学习小波 | 1.8 | 94.35 | -1.56 | -0.1M |

| 去除脉冲机制 | 1.9 | 94.89 | -1.02 | 0.0M |

| 去除中间融合 | 1.9 | 94.78 | -1.13 | 0.0M |

| 使用固定小波 (Haar) | 1.8 | 94.12 | -1.79 | -0.1M |

| 模型缩放 | ||||

| Tiny变体 | 1.2 | 94.68 | -2.40 | -0.7M |

| Large变体 | 3.4 | 96.34 | +0.21 | +1.5M |

关键结论:双通路设计(-2.23%)和可学习小波变换(-1.79% vs 固定Haar, -1.56% vs 无LDWT)是性能贡献最大的组件。脉冲机制和中间融合也带来了超过1%的提升。模型缩放显示,Base变体效率最高,Tiny精度损失明显,Large则收益递减。

效率对比图:

图1在参数量(对数尺度)与准确率的平面上,展示了各模型的分布。WaveSpikeNet(尤其是Base)位于左上方,表明其以极少的参数实现了高精度,定义了新的参数效率前沿。

图1在参数量(对数尺度)与准确率的平面上,展示了各模型的分布。WaveSpikeNet(尤其是Base)位于左上方,表明其以极少的参数实现了高精度,定义了新的参数效率前沿。

⚖️ 评分理由

学术质量:5.5/7

- 创新性:很高。将可学习小波变换、异构双通路(CNN+SNN)和生物启发设计融合,是一个非常新颖且完整的架构思路。

- 技术正确性:高。公式推导清晰,架构设计有明确的生物理论依据,损失函数各部分作用明确。实验设计合理,消融研究充分。

- 实验充分性:中等。在5个数据集上进行了测试,并提供了消融和效率分析。但所有实验均为从头训练,未与当前主流的预训练-微调模型(如使用大量无监督数据预训练的AST变体)进行公平对比,这削弱了其宣称的“性能优越性”的普遍意义。此外,缺乏在真实物理边缘设备上的功耗和延迟测量,使得“面向边缘”的论点不完全扎实。

- 证据可信度:中等。结果表格完整,数字具体。但模型未开源,复现依赖作者公布细节,目前无法独立验证。

选题价值:2.0/2

- 前沿性:高。边缘AI和高效神经网络(尤其是SNN)是当前的研究热点。

- 潜在影响:高。若架构有效,能显著降低音频智能应用在IoT设备上的部署门槛。

- 实际应用空间:高。智能家居声控、工业设备声学监测、环境声音感知等场景均有直接需求。

- 读者相关性:对于研究音频处理、边缘计算、神经形态计算或轻量级模型的读者,相关性很强。

开源与复现加成:0.0/1

- 论文中未提及任何代码、模型权重、复现脚本或详细配置的公开链接。训练细节虽详尽,但无实际可执行材料,复现门槛高。因此无加分。