📄 Wave-Trainer-Fit: Neural Vocoder With Trainable Prior And Fixed-Point Iteration Towards High-Quality Speech Generation From SSL Features

#语音合成 #生成模型 #自监督学习 #扩散模型 #鲁棒性

✅ 7.0/10 | 前25% | #语音合成 | #生成模型 | #自监督学习 #扩散模型

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Hien Ohnaka(Nara Institute of Science and Technology)

- 通讯作者:未说明

- 作者列表:

- Hien Ohnaka(Nara Institute of Science and Technology)

- Yuma Shirahata(LY Corporation, Tokyo, Japan)

- Masaya Kawamura(LY Corporation, Tokyo, Japan)

💡 毒舌点评

亮点:该工作敏锐地抓住了将基于梅尔谱设计的声码器(WaveFit)迁移到SSL特征时遇到的两个核心痛点(初始噪声和增益调整),并提出了优雅的解决方案。在说话人相似度指标(S-MOS)上取得了显著且一致的提升,尤其是使用Whisper特征时,这证明了方法的有效性。短板:方法在自然度(N-MOS)上的表现并不稳定,甚至在使用某些SSL特征时被基线反超,这暗示了“可训练先验”可能引入了新的不稳定性或对超参数过于敏感,论文对此的讨论和验证尚不充分。

🔗 开源详情

- 代码:论文明确提供了代码仓库链接:

https://github.com/line/WaveTrainerFit。 - 模型权重:论文提到提供了“pre-trained models”,即预训练模型权重包含在上述代码仓库中。

- 数据集:使用的是公开的LibriTTS-R语料库,但论文未提及是否提供数据预处理脚本或具体获取方式。

- Demo:论文提供了一个在线演示页面链接:

https://i17oonaka-h.github.io/projects/research_topics/wave_trainer_fit/。 - 复现材料:论文提供了主要超参数(如λGuide, λPM, 训练步数),但未提供完整的训练配置(如优化器、学习率策略)。部分实现细节(如编码器结构修改)在正文有说明,但完整配置可能需参考其代码仓库及所基于的WaveFit开源实现。

- 论文中引用的开源项目:WaveFit, RestoreGrad, DCUnet, SpeechBERTScore, Harvest F0估计器, ECAPA-TDNN, SpeechBrain。

📌 核心摘要

要解决什么问题:现有神经声码器(如WaveFit)在直接利用数据驱动的SSL特征生成波形时,由于缺乏信号处理先验知识,存在初始噪声采样不合理(远离目标)和增益调整依赖隐式学习两大局限。

方法核心是什么:提出WaveTrainerFit,其核心是引入一个基于变分自编码器(VAE)的“可训练先验”模块。该模块在训练时从目标波形和SSL特征中学习,在推理时仅需SSL特征即可生成接近目标波形的初始噪声。同时,通过约束先验分布学习语音能量,实现“参考感知增益调整”。

与已有方法相比新在哪里:新在将RestoreGrad中提出的可训练先验思想成功应用于语音波形生成任务,并创新性地将其应用于“时频域”以降低建模复杂度。同时,设计了一个新的引导损失(L_guide)和增益调整算子(G_ssl),使模型能更直接地利用先验中的能量信息。

主要实验结果如何:实验表明,在T=5次迭代时,WaveTrainerFit在多个SSL特征(WavLM, XLS-R, Whisper)上的参考相关指标(SpeechBERTScore, MCD, Speaker Similarity)均优于WaveFit和HiFi-GAN基线。特别是在说话人相似度(S-MOS)上提升显著(例如,使用Whisper特征时,S-MOS从3.56提升至4.19)。在使用信息较少的深层SSL特征时,该方法的鲁棒性更强。

表1:在LibriTTS-R测试集(8层SSL特征,T=5)上的评估结果

方法 SSL特征 SpeechBERTScore (↑, %) MCD (↓) Log-F0-RMSE (↓) Speaker Similarity (↑, %) N-MOS (↑) S-MOS (↑) WavLM HiFi-GAN V1 90.71 4.510 0.1972 49.09 2.39±0.12 2.81±0.12 WaveFit 94.28 4.109 0.1956 54.67 3.76±0.11 3.02±0.12 WaveTrainerFit 95.28 3.672 0.1810 62.61 3.50±0.11 3.38±0.11 XLS-R HiFi-GAN V1 91.09 4.424 0.1887 51.96 2.54±0.12 2.99±0.12 WaveFit 94.11 4.196 0.1934 52.78 3.79±0.11 3.04±0.12 WaveTrainerFit 94.39 4.089 0.1762 55.54 3.21±0.12 3.13±0.12 Whisper HiFi-GAN V1 88.90 4.446 0.1843 54.98 2.41±0.12 2.96±0.12 WaveFit 93.30 3.715 0.1695 59.64 3.23±0.12 3.56±0.11 WaveTrainerFit 94.60 3.208 0.1690 75.02 3.87±0.10 4.19±0.09 表1关键结论:WaveTrainerFit在所有SSL特征的Speaker Similarity (S-MOS) 上均取得最佳,证明了其提升说话人特征建模的有效性。但其自然度(N-MOS)在使用WavLM和XLS-R时略低于WaveFit。

实际意义是什么:为从任意数据驱动特征(尤其是SSL特征)生成高质量、高保真度的语音波形提供了一种更高效、更鲁棒的解决方案。这有助于推动语音合成、语音修复等下游任务,使其能更充分地受益于大规模SSL模型的表征能力。

主要局限性是什么:方法的有效性可能依赖于对引导损失权重(λGuide, λPM)的精细调节,论文承认其可能存在超参数敏感性。在部分实验设置下,生成的波形自然度(N-MOS)不及基线,说明模型在优化说话人相似度与自然度之间可能需要更好的平衡。

🏗️ 模型架构

WaveTrainerFit的整体架构是在WaveFit声码器的基础上,增加了用于可训练先验的先验编码器和后验编码器。

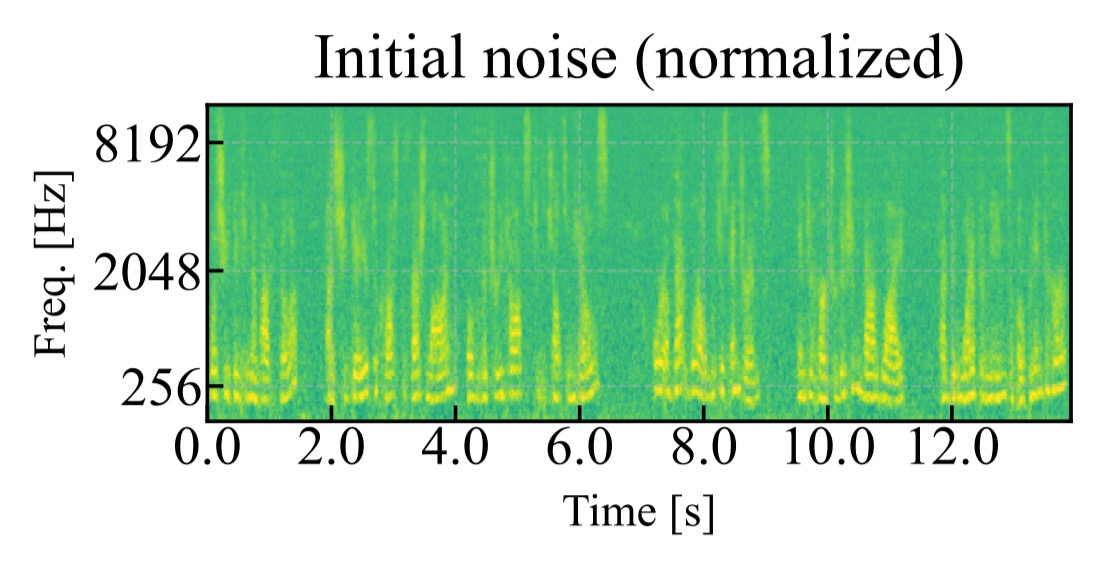

图1:展示了WaveFit(a)与WaveTrainerFit(b)的概念对比。左图显示WaveFit从标准高斯噪声N(0,I)开始迭代,DNN需隐式预测信号能量。右图显示WaveTrainerFit从“接近目标波形”的可训练先验N(0, Σ)开始迭代,并通过“参考感知增益调整”显式处理能量。底部图示了初始噪声的梅尔谱对比。

图1:展示了WaveFit(a)与WaveTrainerFit(b)的概念对比。左图显示WaveFit从标准高斯噪声N(0,I)开始迭代,DNN需隐式预测信号能量。右图显示WaveTrainerFit从“接近目标波形”的可训练先验N(0, Σ)开始迭代,并通过“参考感知增益调整”显式处理能量。底部图示了初始噪声的梅尔谱对比。

图2:WaveTrainerFit的模型概览图。训练时(虚线),目标波形和SSL特征输入后验编码器得到Σpost,用于采样初始噪声yT并计算增益调整。推理时(实线),仅SSL特征输入先验编码器得到Σprior,用于采样初始噪声和增益调整。Σpost和Σprior同时送入KL散度损失LPM进行约束。

图2:WaveTrainerFit的模型概览图。训练时(虚线),目标波形和SSL特征输入后验编码器得到Σpost,用于采样初始噪声yT并计算增益调整。推理时(实线),仅SSL特征输入先验编码器得到Σprior,用于采样初始噪声和增益调整。Σpost和Σprior同时送入KL散度损失LPM进行约束。

- 输入输出:输入为SSL特征(经2倍上采样)和(仅在训练时)目标波形。输出为生成的波形。

- 主要组件:

- 先验/后验编码器 (Vprior/ Vpost):基于DCUnet-10架构。后验编码器接收SSL特征和目标波形的功率谱图,输出先验分布的协方差Σpost。先验编码器仅接收SSL特征,输出协方差Σprior。

- 可训练噪声采样模块 (S(·)):核心创新。它在时频域操作,通过iSTFT将标准高斯噪声的STFT表示与编码器输出的方差Σ(在实部和虚部分别相乘)结合,生成初始噪声yT。这等效于在复数值VAE的潜在空间中采样。

- WaveFit DNN:基础的去噪扩散模型骨干网络,接收当前波形yt、SSL特征和时间步t,预测噪声成分。

- 自增益调整 (Gssl):利用先验/后验输出Σ的能量信息,对WaveFit DNN的中间输出zt进行缩放,使能量与目标对齐。

- 数据流与交互:训练时,目标波形x0与SSL特征c输入后验编码器得到Σpost,采样yT,经T次迭代生成波形。推理时,仅c输入先验编码器得到Σprior,采样yT,再迭代生成。LPM损失迫使先验分布学习后验分布的信息。

- 关键设计选择及动机:在时频域建模Σ(而非时域),是为了缩短序列长度,降低学习复杂度。引入L_guide损失是为了引导先验编码器学习到与语音能量相关的表征,从而实现参考感知的增益调整。

💡 核心创新点

引入可训练先验进行初始噪声采样:

- 局限:当输入为SSL特征时,WaveFit等方法无法使用基于信号处理的先验(如SpecGrad),只能采样标准高斯噪声,该噪声与目标语音差异大。

- 创新:借鉴RestoreGrad,使用VAE学习一个从SSL特征到“接近目标波形”分布的映射(先验分布)。推理时从此分布采样。

- 收益:使扩散模型的迭代过程起点更优,理论上能以更少步数获得更好质量的波形。实验显示在T=1时就有显著提升。

实现参考感知增益调整:

- 局限:WaveFit使用自增益调整(公式2),隐式学习能量,增加了建模负担。

- 创新:通过新增引导损失L_guide,约束先验/后验分布Σ匹配目标语音的能量。进而定义了基于Σ的增益调整算子Gssl(公式10)。

- 收益:将能量建模部分解耦出来,使主DNN能更专注于波形细节建模。这是说话人相似度提升的关键。

将可训练先验建模于时频域:

- 局限:原RestoreGrad在波形域建模,序列过长。

- 创新:在短时傅里叶变换(STFT)域对先验分布的协方差Σ建模,并通过iSTFT采样回时域。

- 收益:显著降低了先验模型的建模复杂度,使其更易于训练。

🔬 细节详述

- 训练数据:使用LibriTTS-R语料库,包含24kHz、585小时、2456位说话人。划分:train-clean-360(训练)、dev-clean(验证)、test-clean(测试)。

- 损失函数:总损失LTrainerFit = LWF + λPM * LPM + LGuide。

- LWF:与WaveFit相同的扩散+GAN损失(公式3)。

- LPM:KL散度损失(扩展至时频域),最小化先验与后验分布差异(公式4, 8)。权重λPM=10。

- LGuide:引导损失(公式9),第一项约束Σpost能量匹配目标语音能量,第二项引导Σpost学习目标功率谱图的分布。权重λGuide=0.1。

- 训练策略:

- 优化器、调度器、判别器等设置与WaveFit开源实现相同。论文中未具体说明。

- 批量大小:8。

- 训练步数:400k步。

- 关键超参数:

- 模型参数量:先验编码器2.59M,后验编码器2.61M。

- 编码器通道数:先验45,后验32。

- 上采样倍数:总共480倍。其中2D转置卷积2倍,WaveFit DNN内部240倍(上采样层比例{5,4,3,2,2})。

- 推理迭代次数:T(实验中主要评估T=5)。

- 训练硬件:未说明。

- 推理细节:无特殊温度或beam search。RTF在Intel Xeon Silver 4316 CPU @2.30GHz上测量。

- 正则化或稳定训练技巧:LGuide中的第二项(公式9第二项)起到正则化作用,防止后验编码器输出数值膨胀。

📊 实验结果

主要对比实验(基于表1): 在固定使用8层SSL特征、T=5次迭代的条件下,WaveTrainerFit在所有三种SSL特征(WavLM, XLS-R, Whisper)上,在SpeechBERTScore、MCD、Log-F0-RMSE和Speaker Similarity这四项客观指标上均优于基线(HiFi-GAN和WaveFit)。尤其是在说话人相似度上,使用Whisper特征时达到了75.02%,比WaveFit的59.64%高出约15个百分点。主观S-MOS也呈现同样趋势。但其自然度(N-MOS)在使用WavLM和XLS-R时略低于WaveFit。

SSL特征深度鲁棒性实验(基于表2): 使用WavLM特征,对比不同层(2层、8层、24层)的性能。结果表明,随着层数加深(语义信息增强,声学信息减弱),所有模型性能下降,但WaveTrainerFit的下降幅度更小。特别是在最难的24层,WaveTrainerFit在参考相关指标上(如SpeechBERTScore 92.19 vs 89.08)显著领先WaveFit,且无参考的UTMOS分数接近,证明了其对特征变化的鲁棒性。

表2:WavLM特征各层的评估结果(T=5)

| 模型-层 | SpeechBERTScore | MCD | Log-F0 RMSE | Speaker Similarity | UTMOS (↑) |

|---|---|---|---|---|---|

| WaveFit-2 | 95.95 | 2.852 | 0.1660 | 78.99 | 4.230 |

| WaveTrainerFit-2 | 96.13 | 2.860 | 0.1662 | 79.65 | 4.203 |

| WaveFit-8 | 94.28 | 4.109 | 0.1956 | 54.67 | 4.194 |

| WaveTrainerFit-8 | 95.28 | 3.672 | 0.1810 | 62.61 | 4.160 |

| WaveFit-24 | 89.08 | 5.501 | 0.3623 | 35.09 | 3.681 |

| WaveTrainerFit-24 | 92.19 | 5.066 | 0.2301 | 40.76 | 4.198 |

表2关键结论:WaveTrainerFit对SSL特征层的深度变化表现出更强的鲁棒性,尤其在深层特征上优势明显。

迭代次数与速度: 论文提供了图3(未在提供的URL列表中),描述显示其在不同迭代次数下的各项指标均优于WaveFit。RTF因先验编码器和采样过程略有增加。

⚖️ 评分理由

- 学术质量:5.5/7:问题定义准确,解决方案有创新且与问题紧密匹配。技术实现基于成熟框架,逻辑自洽。实验全面,有多个基线、多种SSL特征、主客观评估、消融实验(深度分析)。扣分点:1)承认超参数敏感性;2)部分结果(N-MOS)不理想,暴露了方法可能存在的权衡问题;3)训练和实现的部分细节未公开,影响可复现性。

- 选题价值:1.5/2:课题是语音生成领域的前沿且实际的问题。如何利用强大的SSL表征进行高质量波形合成,是构建下一代统一语音模型的关键一环。本文提供了有效的工程化改进,具有明确的应用价值和参考意义。

- 开源与复现加成:0.0/1:论文在“Conclusion”后明确提供了代码和预训练模型的GitHub链接,这是一个重大加分项。然而,论文正文对训练细节(如优化器、学习率、warmup、硬件)的描述不够完整,完全复现可能需要参考其他基线(WaveFit)的开源代码。因此,加成取中值。