📄 Vocalnet-M2: Advancing Low-Latency Spoken Language Modeling via Integrated Multi-Codebook Tokenization and Multi-Token Prediction

#语音对话系统 #多令牌预测 #多码本分词 #语音大模型

✅ 7.5/10 | 前25% | #语音对话系统 | #多令牌预测 | #多码本分词 #语音大模型

学术质量 6.0/7 | 选题价值 2.0/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Yuhao Wang (上海交通大学,蚂蚁集团)

- 通讯作者:Yu Wang (上海交通大学)

- 作者列表:Yuhao Wang (上海交通大学,蚂蚁集团)、Ziyang Cheng (上海交通大学)、Heyang Liu (上海交通大学,蚂蚁集团)、Ronghua Wu (蚂蚁集团)、Qunshan Gu (蚂蚁集团)、Yanfeng Wang (上海交通大学)、Yu Wang (上海交通大学)

💡 毒舌点评

论文直击当前语音大模型在实时交互中的“阿喀琉斯之踵”——延迟,并通过多码本直出和MTP策略给出了有效缓解方案,工程实用性值得肯定。然而,多码本学习的“高门槛”特性意味着它严重依赖高质量、大规规模的训练数据,这可能成为其在资源受限场景下落地的“新瓶颈”。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:提到了使用Emilia、VoiceAssistant、Ultrachat等数据集以及自己合成的v1/v2数据,但未说明是否公开或如何获取合成部分。

- Demo:未提及。

- 复现材料:提供了部分训练细节(如数据来源、模型初始化、三阶段训练策略),但关键超参数(如学习率、batch size、优化器、训练步数)和硬件信息缺失,不足以支撑完整复现。

- 论文中引用的开源项目:引用了Whisper、Qwen3-8B、CosyVoice2、Emilia等开源模型/数据集。

📌 核心摘要

本文旨在解决当前端到端语音语言模型因自回归生成和依赖流匹配模型导致的响应延迟过高问题。方法核心是提出VocalNet-M2,一个采用“思考者-说话者”架构的低延迟模态对齐SLM。其创新在于:1)集成多码本分词器,直接生成包含丰富声学信息的8码本语音令牌,从而省去了高延迟的流匹配声学重建模型;2)设计了针对多码本生成的多令牌预测策略,在单次推理步骤中预测多个未来令牌,进一步提升效率并改善性能。主要实验结果表明,VocalNet-M2在保持与主流SLM竞争性的文本与语音质量(如AlpacaEval 7.29, WER 6.07)的同时,将首音频块延迟从基线系统的约725毫秒大幅降低至约349毫秒,实现了约2倍的推理加速。该工作的实际意义在于为构建低延迟、高响应的实时语音交互系统提供了有价值的架构设计和对比分析。主要局限性在于,学习多码本语音令牌比单码本令牌更困难,对训练数据的质量和数量要求更高。

🏗️ 模型架构

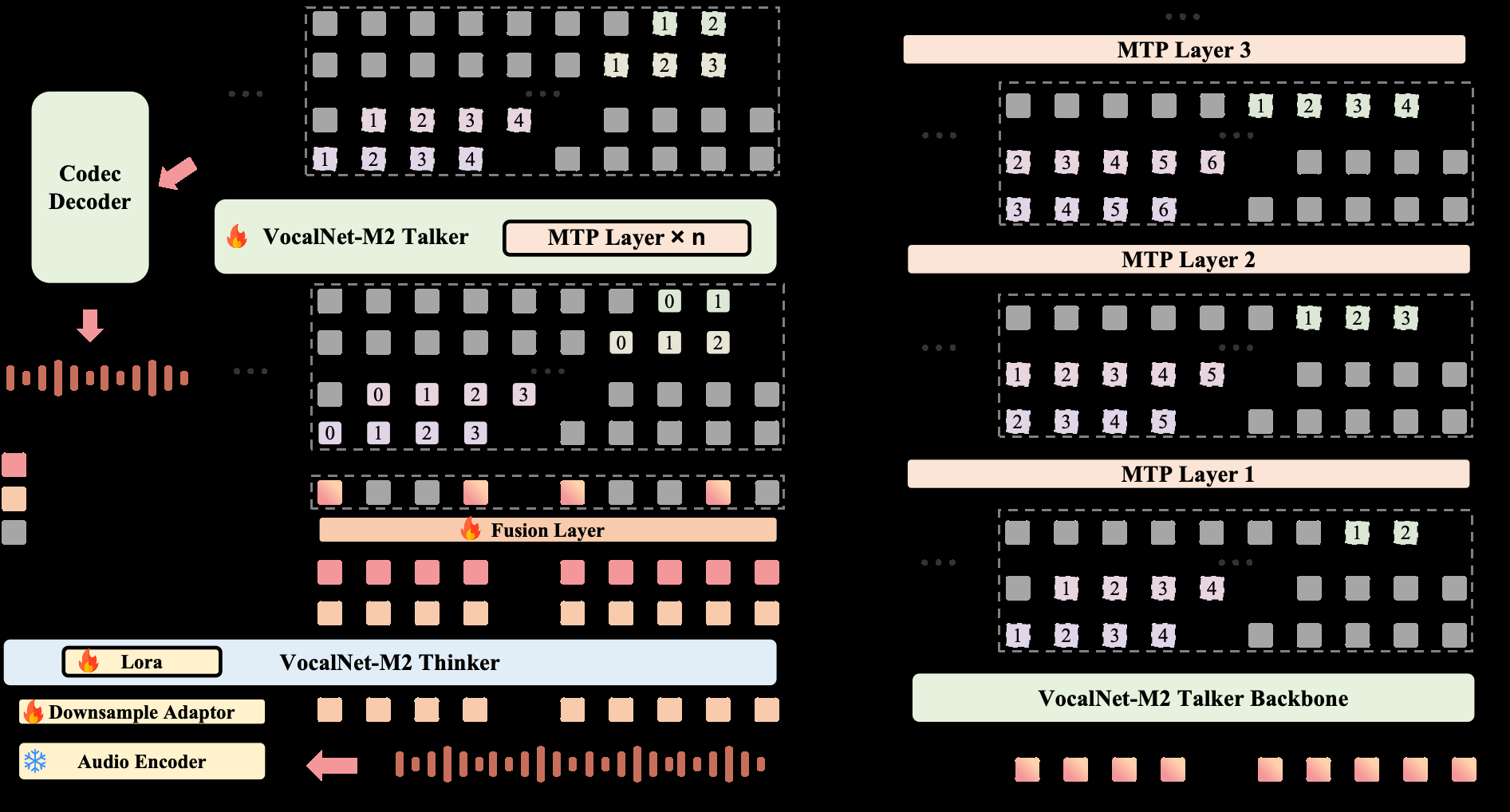

VocalNet-M2采用“Thinker-Talker”(思考者-说话者)架构,如图1所示。

- 输入处理:原始音频输入

xa首先经过一个基于Whisper-large-v3的音频编码器和一个下采样适配器,转换为连续的语音表示ra_1:T。 - Thinker模块:初始化自Qwen3-8B。它接收语音表示,自回归地生成文本响应令牌

ttext_1:N及其对应的隐藏状态htext_1:N。该模块主要利用LLM的语义理解和生成能力。 - 融合层:由两层线性层组成,将文本令牌的嵌入

Emb(ttext_1:N)与Thinker输出的隐藏状态htext_1:N拼接并融合,生成统一的语义表示hfused_1:N,以弥合文本与语音模态的差异。 - 上采样:将语义表示

hfused_1:N在时间维度上上采样3倍,得到hup_1:t,以促进语义信息与后续语音令牌的时间对齐。 - Talker模块:一个多轨自回归Transformer解码器。在每个时间步

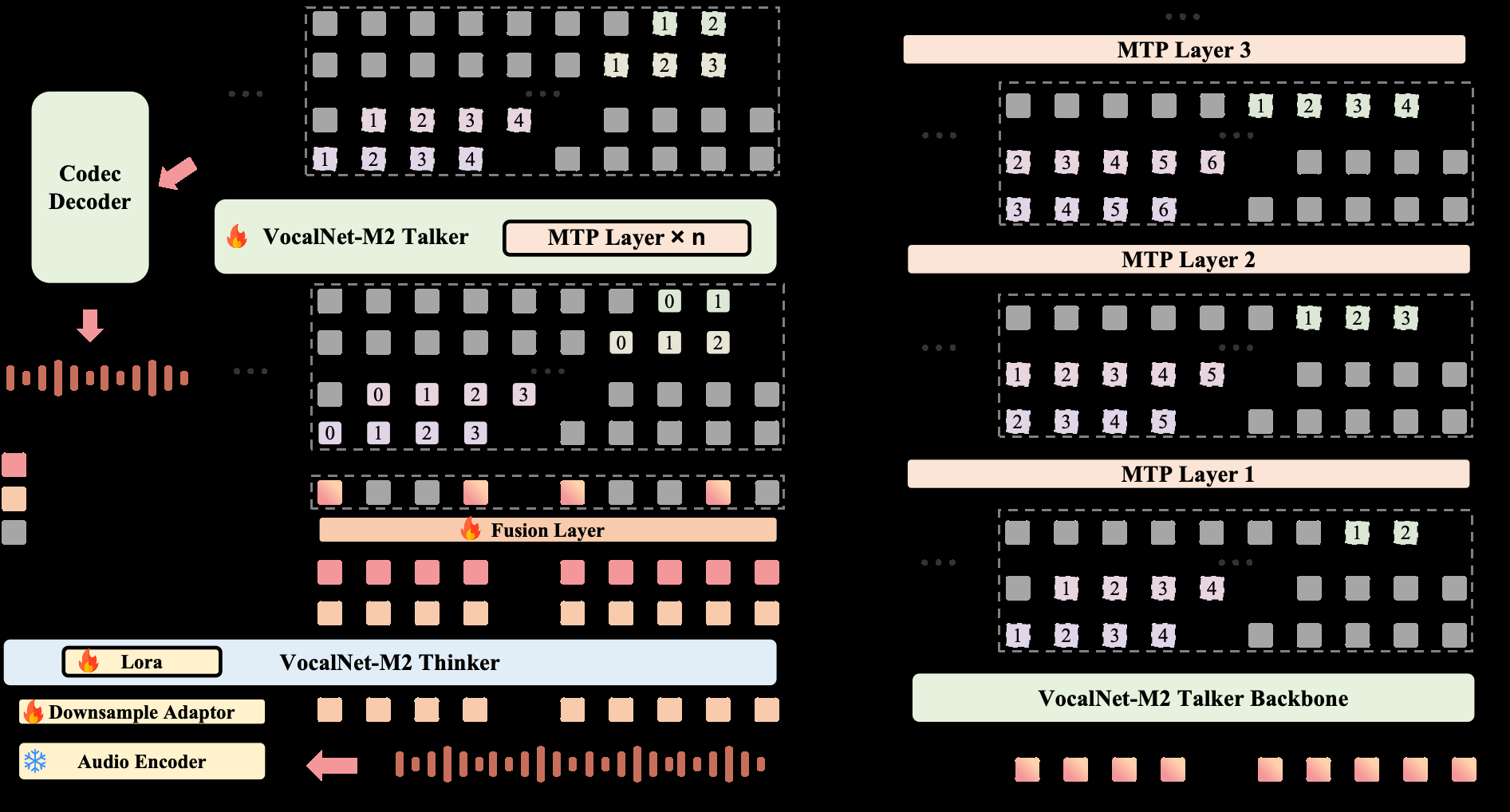

t,它接收上采样的语义序列hup_1:t和所有8个码本之前生成的语音令牌嵌入之和Σ Emb(acb_i^1:t)作为输入,通过8个独立的线性层头,一次性输出时间步t+1的全部8个码本的语音令牌{acb_j^{t+1}}_{j=1}^8。这种多轨设计允许模型直接生成包含丰富声学细节的多码本令牌。 - MTP层:在Talker骨干网络之后,堆叠了

N_mtp个(本文最优为4个)多令牌预测层。每个MTP层是一个Transformer层加一个线性层,它接收来自Talker的隐藏状态,用于预测未来n+1步的语音令牌。训练时,这些层提供额外的监督信号;推理时,它们不参与生成,因此不增加延迟。 - 输出:Talker的输出即为8个码本的语音令牌,可直接通过一个轻量级声码器(如图2所示的Vocoder)转换为波形,无需经过流匹配模型。

💡 核心创新点

- 集成多码本分词器实现直接语音生成:传统SLM生成单码本语义令牌后,需依赖计算密集且引入延迟的流匹配模型重建波形。VocalNet-M2通过让Talker直接生成8个码本的语音令牌,这些令牌本身已编码了足够的声学信息,从而消除了对独立流匹配模型的依赖。实验证明,这使得Vocoder阶段的延迟大幅降低。

- 为多码本生成定制的多令牌预测策略:将MTP思想从文本领域引入多码本语音生成。训练时,通过MTP层提供对未来多个时间步令牌的预测监督,帮助模型更好地建模局部依赖并更高效利用训练数据,在不增加推理成本的前提下显著提升了WER和UTMOS。

- 系统性的单码本与多码本策略对比分析:通过精心设计的消融实验,揭示了两种策略的本质区别:单码本模型性能严重依赖后端的流匹配模型,对原始训练数据质量不敏感;而多码本模型性能直接取决于训练数据质量,需要更高质量的训练数据以达到可比性能。这为未来模型设计提供了明确的技术选型依据。

🔬 细节详述

- 训练数据:

- TTS预训练:使用约10k小时来自Emilia数据集的随机采样音频。

- 语音对话训练:约800K样本(约7k小时音频),包括400K来自VoiceAssistant,300K来自Ultrachat,100K由tulu-3-sft-mixture通过Cosyvoice2合成的英语多轮对话。

- 数据消融:构造了v1(原始数据)和v2(通过WER过滤和重新合成的高质量数据)两个版本。

- 损失函数:标准交叉熵损失。Talker损失(公式5)在每个时间步对每个码本计算。引入MTP后,总损失为标准Talker损失与所有MTP层损失之和(公式7),即

L_mtp = - Σ_{n=0}^{N_mtp} Σ_{t=0}^{M-1} Σ_{j=1}^8 log P(acb_j^{t+n+1} | hup_{1:t}, {acb_i^{1:t}}_{i=1}^8)。 - 训练策略:三阶段训练。1)TTS预训练:用TTS数据训练Talker。2)Thinker训练:使用LoRA微调下采样适配器和Thinker,使其能处理音频输入并生成文本响应。3)端到端微调:在语音对话数据上联合微调Thinker和Talker。

- 关键超参数:

- 模型:Thinker初始化自Qwen3-8B;Talker架构与之类似但层数更少,从头训练。

- 分词器:XY-Tokenizer(8码本)或S3 tokenizer(单码本)。

- MTP:消融实验对比了0-5层MTP,最终选择4层。

- 训练硬件:论文中未说明训练所用的GPU型号、数量及总训练时长。

- 推理细节:推理时不使用MTP层。测量延迟时,在单块L20 GPU上,使用固定0.8秒的首块音频时长进行测试(MiniCPM-o为0.533秒)。未提及是否使用vLLM等加速框架。

📊 实验结果

论文主要在OpenAudioBench的英文子集上进行评估,对比了多款主流SLM。

表1. VocalNet-M2与主流SLM对比

| 模型 | AlpacaEval | Llama Questions | TriviaQA | Web Questions | WER ↓ | UTMOS ↑ | 首块延迟 (ms) ↓ |

|---|---|---|---|---|---|---|---|

| SLAM-Omni [5] | 3.50 | 2.94 | 0.39 | 0.84 | 5.78 | 4.46 | 702.41 ± 30.30 |

| VocalNet-8B [9] | 7.12 | 7.95 | 6.24 | 6.48 | 3.64 | 4.49 | 556.00 ± 8.29 |

| GLM-4-Voice [4] | 5.86 | 7.74 | 4.95 | 5.56 | 11.90 | 4.23 | 1060.36 ± 2.36 |

| MiniCPM-o [15] | 6.13 | 7.72 | 6.43 | 7.16 | 9.52 | 4.14 | 893.82 ± 81.80 |

| kimi-audio [16] | 6.49 | 8.10 | 6.15 | 7.10 | 14.71 | 2.87 | 1744.80 ± 139.99 |

| Qwen2.5-Omni [1] | 6.01 | 7.90 | 5.89 | 6.88 | 2.31 | 4.34 | \ |

| VocalNet-M2 | 7.29 | 8.33 | 6.13 | 6.65 | 6.07 | 4.31 | 348.86 ± 2.86 |

结论:VocalNet-M2在文本质量(AlpacaEval, Llama Questions)上取得最优,在其他文本基准和语音质量(WER, UTMOS)上保持竞争力。最大亮点是首块延迟从其他模型的数百至上千毫秒降低至约349毫秒。

表2. 分词器类型与训练数据质量影响消融

| 分词器 | 训练数据 | WER ↓ | UTMOS ↑ | 首块延迟 (ms) ↓ |

|---|---|---|---|---|

| S3 (单码本) | v1 | 10.66 | 4.34 | - |

| S3 (单码本) | emilia + v1 | 3.73 | 4.35 | 725.90 ± 9.17 |

| S3 (单码本) | emilia + v2 | 3.68 | 4.37 | - |

| XY (多码本) | v1 | 20.49 | 3.89 | - |

| XY (多码本) | emilia + v1 | 10.43 | 4.08 | 405.23 ± 6.29 |

| XY (多码本) | emilia + v2 | 8.56 | 4.24 | - |

结论:多码本(XY)学习难度更高,无预训练时WER极高;其性能对数据质量更敏感(v2数据提升显著)。单码本(S3)模型因依赖流匹配模型,性能对数据质量不敏感,但引入了更高延迟。

表3. MTP层数消融(使用XY-tokenizer和emilia+v2数据)

| 指标 | 无MTP | 1层 | 2层 | 3层 | 4层 | 5层 |

|---|---|---|---|---|---|---|

| WER ↓ | 8.56 | 7.64 | 6.53 | 6.64 | 6.07 | 6.33 |

| UTMOS ↑ | 4.24 | 4.28 | 4.29 | 4.28 | 4.31 | 4.29 |

结论:引入MTP层能显著提升性能(WER从8.56降至6.07),4层时达到最佳平衡。

图2. 首块延迟分解

结论:延迟主要由Thinker、Talker和Vocoder三部分构成。采用多码本(XY-Tokenizer)和MTP后,Talker和Vocoder阶段的延迟被显著压缩,最终总延迟从725ms降至349ms。

⚖️ 评分理由

- 学术质量:6.0/7:论文工作扎实,逻辑清晰。创新在于将多码本生成和MTP策略有效整合到一个SLM架构中,并进行了全面的实验验证(性能对比、消融研究)。技术正确性高,实验证据充分。扣分点在于核心技术创新(如多码本分词、MTP)并非本文首次提出,更偏向于系统的集成与验证,原创性中等。

- 选题价值:2.0/2:选择“低延迟语音交互”这一工业界和学术界共同关注的关键问题作为切入点,具有很高的前沿性和实际应用价值。对延迟的量化分析和优化方案对相关领域从业者有直接参考意义。

- 开源与复现加成:0.0/1:论文未提供任何代码、模型权重、训练日志、详细配置文件(如优化器、学习率调度)、硬件信息或数据集获取方式。复现该工作需要相当大的投入,且存在不确定性。