📄 V2A-DPO: Omni-Preference Optimization for Video-To-Audio Generation

#音视频 #直接偏好优化 #流匹配 #模型评估

✅ 7.5/10 | 前25% | #视频到音频生成 | #直接偏好优化 | #音视频 #流匹配

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Nolan Chan(The Chinese University of Hong Kong, Hong Kong SAR, China)

- 通讯作者:Dingdong Wang(The Chinese University of Hong Kong, Hong Kong SAR, China)(论文脚注中对应邮箱 yjchen@se.cuhk.edu.hk)

- 作者列表:Nolan Chan(The Chinese University of Hong Kong, Hong Kong SAR, China),Timmy Gang(National Research Council Canada, Canada),Yongqian Wang(The University of Warwick, UK),Yuzhe Liang(Shanghai Jiao Tong University, China),Dingdong Wang(The Chinese University of Hong Kong, Hong Kong SAR, China)

💡 毒舌点评

这篇论文堪称“模范工程论文”:它没有声称发明了全新的生成范式,而是精准地识别了当前视频音频生成模型在“对齐人类审美与同步偏好”上的短板,并系统性地设计了一套包含自动评估、数据生成、课程训练的完整解决方案,实验结果也验证了其有效性。不过,其核心创新更偏向于应用层面的“术”而非基础理论层面的“道”,AudioScore本身是现有工具的集成而非原理创新,课程学习DPO的引入也较为直接。

🔗 开源详情

- 代码:论文中明确提供了代码仓库链接:

https://nolanchan23.github.io/V2A-DPO/。 - 模型权重:论文中未提及是否公开优化后的V2A模型权重(如V2A-DPO优化的MMAudio或Frieren)。仅提及使用了公开的预训练基础模型。

- 数据集:论文构建的偏好对数据集(约48K对)的获取方式未在提供的文本中详细说明。基础数据集VGGSound是公开的。

- Demo:论文中明确提供了演示链接:

https://nolanchan23.github.io/V2A-DPO/。 - 复现材料:论文提供了详细的训练细节(优化器、学习率、批大小、步数、硬件)、关键超参数(β, score_Δ, N, γ)以及数据集构建流程,复现信息较为充分。

- 引用的开源项目:论文依赖或对比了多个开源项目,包括:ImageBind, CLAP, Synchformer, PANNs (用于IS), PESQ, MMAudio, Frieren, V2A-Mapper, FoleyCrafter, Seeing&Hearing, V-AURA, ThinkSound等。

📌 核心摘要

本文针对基于流匹配的视频到音频(V2A)生成模型难以与人类偏好对齐的问题,提出了V2A-DPO优化框架。核心方法包括:1)设计了一个综合评分系统AudioScore,整合现有模型评估视频与生成音频的语义一致性、时间同步性和感知质量,并通过少量人类标注进行校准;2)基于AudioScore自动化地生成大规模偏好对数据;3)引入课程学习策略优化DPO训练过程,从易到难使用偏好对。与直接使用DDPO或未优化的基线模型相比,经V2A-DPO优化的Frieren和MMAudio模型在VGGSound测试集上的IS(感知质量)最高提升1.81(10.4%相对提升),IB-score(语义一致性)提升0.86(2.6%相对提升),DeSync(时间失同步)降低0.09(20.5%相对降低),其中优化后的MMAudio在多项指标上达到SOTA。该工作的实际意义在于提升了V2A模型的实用性和用户体验,局限性在于其优化框架高度依赖特定的预训练基础模型和基于现有指标构建的AudioScore,而后者对音频“审美吸引力”的评估仍不完善。

🏗️ 模型架构

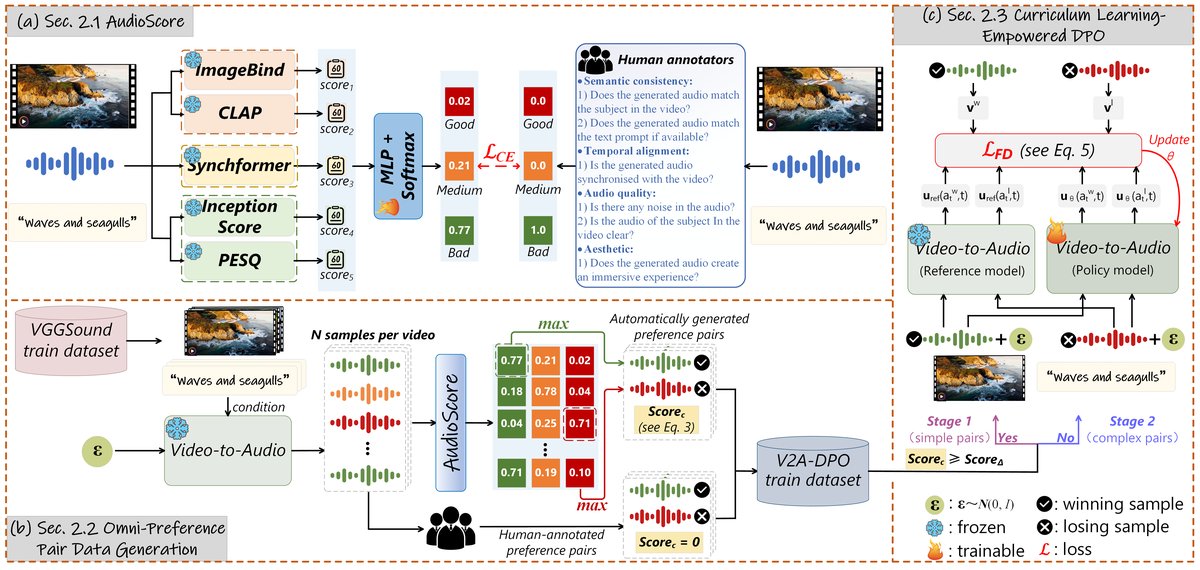

本文的核心并非提出一个新的生成模型架构,而是提出一个用于优化现有基于流匹配的V2A模型的框架。其整体架构如图1所示,包含三个主要组件:

AudioScore评分系统:

- 输入:生成的音频、对应的视频,以及可选的文本提示。

- 功能:自动预测音频在人类偏好中的分类概率(“好”、“中”、“差”)。

- 内部结构:

- 使用多个预训练的冻结模型提取特征:ImageBind计算视频-音频余弦相似度(IB-score,语义一致性),CLAP计算音频-文本相似度(若使用文本提示),Synchformer预测时间失同步(DeSync,以秒为单位),PANNs计算感知质量分数(IS),以及PESQ评估语音质量(针对语音类音频)。

- 将上述5个分数拼接成一个5维向量。

- 经过一个由两个线性层(中间接ReLU)和Softmax层组成的轻量级MLP,输出三分类概率。该MLP通过交叉熵损失(L_CE)在少量(2K)人类标注样本上训练,以对齐自动评分与人类判断。

- 设计动机:解决单一指标无法全面评估V2A生成质量,以及人工评估成本高昂的问题。

自动化偏好对数据生成流程:

- 输入:大规模视频(及文本提示)数据集。

- 过程:对于每个视频提示,使用待优化的预训练V2A模型生成N个音频样本(论文中N=5)。用AudioScore为每个样本打分,获得概率向量。

- 选择策略:选择“好”类概��最高的样本作为获胜样本(aw),选择“差”类概率最高的样本作为失败样本(al),构成一个偏好对(aw, al)。

- 输出:构建一个大规模的偏好对数据集。论文中结合了46K个自动生成的对和2K个人类标注的对,总计约48K个偏好对。

课程学习赋能的DPO优化策略:

- 问题:传统DPO随机使用偏好对,难以区分细微差异的困难样本对。

- 方法:根据偏好对的“复杂度分数”将其分为简单和困难两类,分两阶段训练。

- 复杂度分数计算:基于偏好对中获胜和失败样本的“好”类和“差”类概率差进行计算(公式3)。分数越高,表示两个样本差异越明显,越“简单”。

- 分阶段训练:

- 第一阶段:使用复杂度分数高于预设阈值(score_Δ)的简单偏好对进行训练。

- 第二阶段:使用剩余的困难偏好对以及所有2K个人类标注对(论文中将其复杂度分数设为0)进行训练。这使得模型在后期能更专注于提升对齐效果,特别是人类看重的“审美吸引力”等难以自动量化的方面。

- 核心优化目标:Flow-DPO损失函数(公式5)。该损失旨在引导模型的预测向量场(u_θ)更接近获胜样本的目标向量场(v_w),同时远离失败样本的目标向量场(v_l)。

💡 核心创新点

- 首个面向流匹配V2A模型的DPO框架:将直接偏好优化技术成功适配到基于流匹配的视频到音频生成任务中,并针对性地提出了Flow-DPO的损失形式(公式5),填补了该领域偏好对齐方法的空白。

- 综合自动化评估系统AudioScore:创新性地整合了IB-score、CLAP、DeSync、IS、PESQ等多个现有指标,并通过轻量级MLP与少量人类标注对齐,构建了一个可自动、低成本评估生成音频综合质量(语义、同步、感知)的系统,为大规模偏好数据生成提供了基础。

- 课程学习优化DPO训练:将课程学习理念引入V2A-DPO,根据偏好对的难度(复杂度分数)设计渐进式训练策略。实验表明(表2),该策略相比标准DPO能带来更稳定的性能提升,尤其在处理细微差异样本时更有效。

🔬 细节详述

- 训练数据:

- 来源:VGGSound数据集(包含310个类别)。

- 规模与预处理:从训练集中随机采样50K个带文本提示的视频。经过AudioScore打分和“最佳vs最差”筛选后,得到约46K个自动偏好对。与2K个新采集的人类标注偏好对(标注为“好/中/差”三类)合并,总计约48K对。

- 数据增强:未提及。

- 损失函数:

- 主损失:Flow-DPO损失函数(公式5),形式为带有KL散度约束(β)的对比损失。

- 辅助损失:AudioScore训练时使用的交叉熵损失L_CE。

- 训练策略:

- 优化器:AdamW。

- 学习率:5e-6,带1K步的线性预热。

- 批大小:全局批大小8。

- 训练步数:12K步。

- 调度策略:线性预热后恒定学习率。

- 关键超参数:

- KL约束参数β:600(消融实验探索了200-1000)。

- 课程学习阈值score_Δ:0.7(消融实验探索了0.6-1.0)。

- 每提示生成样本数N:5。

- 推理时引导尺度γ:4.5(用于分类器自由引导CFG)。

- 基础模型:MMAudio-L-44.1kHz(1.03B参数),Frieren(159M参数)。

- 训练硬件:8块NVIDIA A100 GPU。

- 推理细节:未提及特殊的解码策略或温度设置,沿用基础模型的推理设置。

- 正则化/稳定技巧:使用固定权重的预训练基础模型构建AudioScore;在DPO中使用常数β(而非随时间变化的β_t)以简化并获得更好性能;采用课程学习策略以稳定训练。

📊 实验结果

主要在VGGSound测试集上进行评估,与多个基线模型对比。关键结果如下表所示:

表1. VGGSound测试集上的视频到音频生成结果对比

| 系统 | 方法 | 参数量 | 分布匹配 (↓) | 音频质量 (↑) | 语义对齐 (↑) | 时间对齐 (↓) | ||

|---|---|---|---|---|---|---|---|---|

| FDPaSST | KLPANNs | KLPaSST | IS | IB-score | DeSync | |||

| 1 | Seeing&Hearing | 415M | 219.01 | 2.26 | 2.30 | 8.58 | 33.99 | 1.20 |

| 2 | V-AURA | 695M | 218.50 | 2.42 | 2.07 | 10.08 | 27.64 | 0.65 |

| 3 | FoleyCrafter | 1.22B | 140.09 | 2.30 | 2.23 | 15.68 | 25.68 | 1.23 |

| 4 | V2A-Mapper | 229M | 84.57 | 2.69 | 2.56 | 12.47 | 22.58 | 1.23 |

| 5 | ThinkSound | 1.30B | 54.92 | 1.32 | 1.52 | 16.03 | 34.13 | 0.46 |

| 6 | Frieren (基线) | 159M | 106.10 | 2.73 | 2.86 | 12.25 | 22.78 | 0.85 |

| 7 | Frieren-DDPO | 159M | 75.41 | 2.58 | 2.61 | 13.12 | 23.19 | 0.65 |

| 8 | Frieren-DPO | 159M | 69.98 | 2.55 | 2.63 | 13.98 | 24.11 | 0.62 |

| 9 | MMAudio (基线) | 1.03B | 60.60 | 1.65 | 1.40 | 17.40 | 33.22 | 0.44 |

| 10 | MMAudio-DDPO | 1.03B | 54.81 | 1.42 | 1.36 | 18.34 | 33.89 | 0.39 |

| 11 | MMAudio-DPO | 1.03B | 51.38 | 1.38 | 1.34 | 19.21 | 34.08 | 0.35 |

- 与自身基线和DDPO对比:V2A-DPO显著优于DDPO和未优化的基线。例如,优化后的MMAudio-DPO(系统11)相比MMAudio基线(系统9),IS从17.40提升至19.21(+10.4%相对),IB-score从33.22提升至34.08,DeSync从0.44降低至0.35(-20.5%相对)。

- 与SOTA对比:优化后的MMAudio-DPO在分布匹配(FDPaSST等)、音频质量(IS)和时间对齐(DeSync)上均优于表中其他所有已发表的模型,达到SOTA水平。在语义对齐(IB-score)上与ThinkSound接近但略低。

- 消融实验(表2):探索了关键超参数β和阈值score_Δ的影响。当β=600,score_Δ=0.7时性能最优。当score_Δ=1.0时(即不进行课程学习,所有数据用于第二阶段),性能相比最优设置有所下降,证明了课程学习的有效性。

表2. 关键超参数消融实验(针对优化后的MMAudio)

| β | score_Δ (简单对比例) | FDPaSST (↓) | IS (↑) | IB-score (↑) | DeSync (↓) |

|---|---|---|---|---|---|

| 600 | 0.7 (81%) | 51.38 | 19.21 | 34.08 | 0.35 |

| 1000 | 0.7 (81%) | 82.36 | 11.15 | 24.88 | 0.43 |

| 800 | - | 64.85 | 17.33 | 29.91 | 0.38 |

| 400 | - | 53.46 | 19.46 | 33.92 | 0.35 |

| 200 | - | 55.81 | 18.79 | 33.93 | 0.36 |

| 600 | 1.0 (0%) | 52.66 | 18.83 | 33.79 | 0.36 |

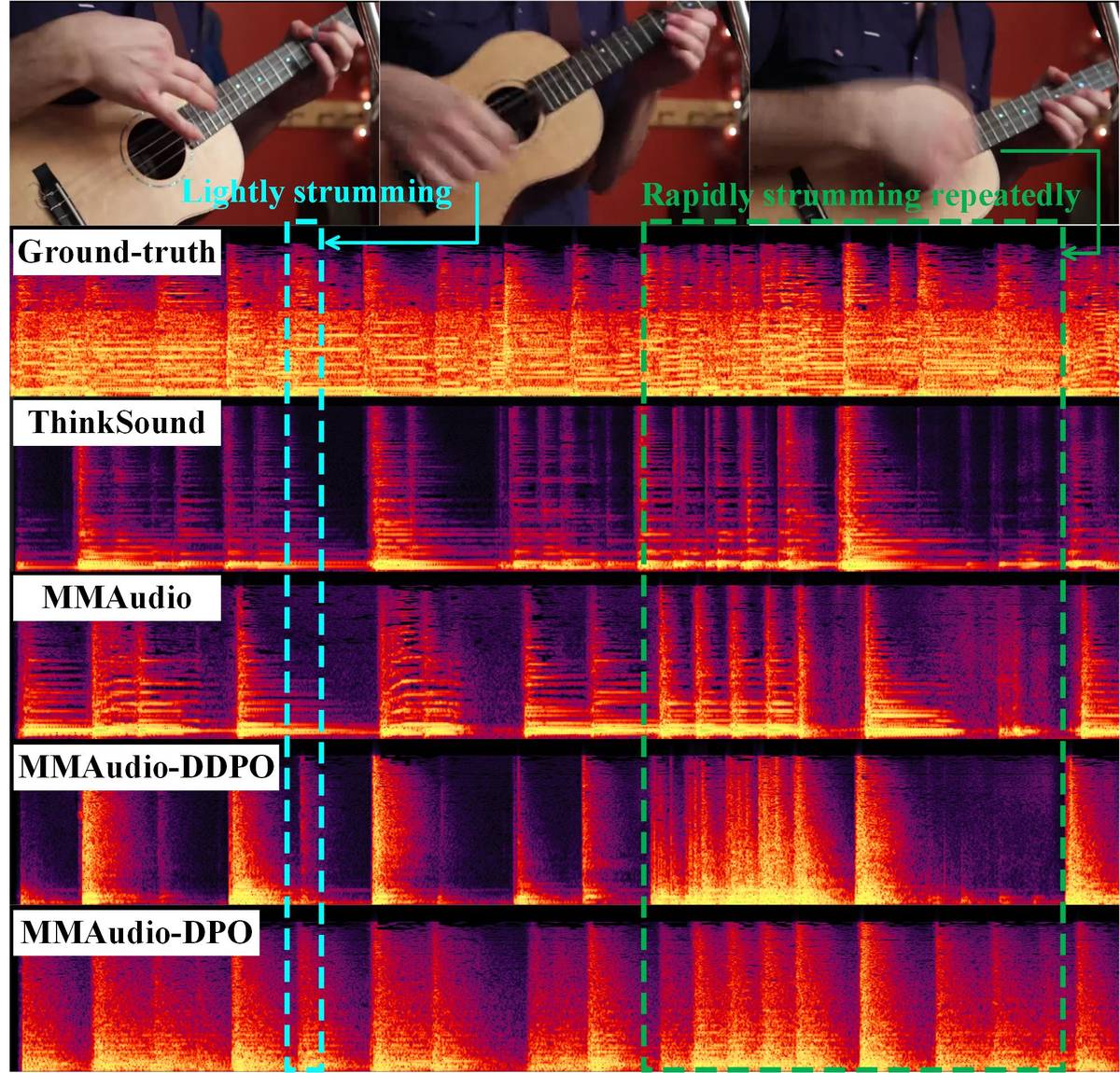

论文图2(pdf-image-page4-idx1)展示了生成音频的可视化对比,DPO优化后的MMAudio能够更好地对齐视频中不同幅度的手部动作(轻扫与快速扫弦),而DDPO和基线模型则难以做到。

⚖️ 评分理由

- 学术质量:5.5/7:论文技术路线清晰正确,方法设计合理,实验设置公平且充分(有基线对比、消融研究),数据可靠支撑了结论。创新主要在于将DPO、课程学习与一套自动化评估流程进行有效整合,应用于V2A这一特定任务,并取得了可验证的性能提升。这是一项扎实、完整的系统优化工作,但非颠覆性创新。

- 选题价值:1.5/2:视频到音频生成是当前多模态生成领域的热点之一,直接关系到虚拟现实、影视创作等应用的用户体验。本文聚焦于提升生成音频的“人类偏好”对齐,解决了该领域一个关键且实际的痛点,具有明确的应用价值和研究意义。

- 开源与复现加成:+0.5/1:论文提供了代码和演示的在线链接(https://nolanchan23.github.io/V2A-DPO/),在正文中给出了详细的训练超参数、硬件配置和数据集构建方法,极大地便利了其他研究者复现和跟进。扣分点在于未提及是否公开预训练的优化后模型权重,以及AudioScore中使用的MLP具体结构(虽然描述简单)和标注数据。