📄 UNMIXX: Untangling Highly Correlated Singing Voices Mixtures

#语音分离 #时频分析 #歌唱语音合成 #数据增强 #低资源

🔥 8.5/10 | 前25% | #语音分离 | #时频分析 | #歌唱语音合成 #数据增强

学术质量 6.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Jihoo Jung(韩国科学技术院, Korea Advanced Institute of Science and Technology, South Korea)

- 通讯作者:未说明(论文中未明确标注)

- 作者列表:Jihoo Jung(韩国科学技术院)、Ji-Hoon Kim(韩国科学技术院)、Doyeop Kwak(韩国科学技术院)、Junwon Lee(韩国科学技术院)、Juhan Nam(韩国科学技术院)、Joon Son Chung(韩国科学技术院)

💡 毒舌点评

亮点: 论文对问题(高相关、数据稀缺)的洞察和解决方案设计(MIM生成相关数据、CS Attention解耦表示)非常系统且直击要害,实验验证也堪称范本,尤其是提出了HSSNR这个更合理的评估指标来应对同歌手场景。短板: 依赖合成数据(MIM)来解决数据问题,与真实多轨录音的差距未充分探讨;且所有对比实验均在单一的MedleyVox数据集上进行,未见其他公开数据集上的验证,说服力略打折扣。

🔗 开源详情

- 代码:论文中未提及代码仓库链接。

- 模型权重:未提及。

- 数据集:论文中使用了多个公开歌唱语音数据集(见参考文献[17-25]),但未提及UNMIXX合成的训练集是否开源。

- Demo:提供音频演示链接:https://unmixx.github.io/

- 复现材料:提供了详细的训练参数(学习率、优化器、批大小、损失函数权重、阈值、训练步数等),但未提供完整的配置文件或训练日志。

- 论文中引用的开源项目:引用了TIGER [14] 作为架构基础,以及Beat Tracking模型 [16] 用于MIM。

📌 核心摘要

- 问题: 本文旨在解决多人歌唱语音分离(MSVS)任务,该任务面临两大独特挑战:可用的训练数据极度稀缺,且混合的歌唱语音本身具有高度相关性(如共享歌词、和声、时间对齐),这使得现有语音分离方法效果不佳。

- 方法核心: 提出UNMIXX框架,包含三个关键组件:(1)音乐信息混合(MIM)策略,通过选择时间节奏和音高和谐的歌曲进行配对,合成高度相关且逼真的训练数据,以缓解数据稀缺;(2)跨源注意力(CS Attention),通过“反向注意力”机制主动抑制两个歌手表示中的相似区域,强制表示分离;(3)幅度惩罚损失(Magnitude Penalty Loss),在训练后期显式惩罚目标频谱图中残留的干扰能量。

- 创新点: 1)首次提出针对MSVS任务的、模拟真实音乐相关性的数据合成方法(MIM)。2)在架构(CS Attention)和损失(LPenalty)两个层面引入跨源互斥约束,专门针对“高相关性”这一难点。3)为同演唱者场景提出了更合理的评估指标HSSNR。

- 实验结果: 在MedleyVox评估集上,UNMIXX相对于此前最优方法(MedleyVox基线)取得了显著提升,在duet子集上SDRi提升2.42 dB,在unison子集上提升2.26 dB。消融实验证明了每个组件的有效性。

- 主实验对比(关键数据):

方法 #参数 Duet SDRi (↑) Unison SDRi (↑) MedleyVox 5M 15.10 4.90 TIGER* 947k 16.58 5.96 UNMIXX 951k 17.52 7.16 - 消融实验(部分关键结果):

方法 Duet SDRi Unison SDRi TIGER* (基线) 16.58 5.96 + MIM (m=8) 16.79 7.31 + CS attention 18.01 6.17 + Mag, Penalty loss 16.68 6.44 UNMIXX (全组件) 17.52 7.16

- 主实验对比(关键数据):

- 实际意义: 为处理真实音乐中常见的多轨人声混合提供了有效工具,可应用于音乐制作(人声轨道分离)、卡拉OK(伴奏与任意人声分离)、以及后续的单人歌唱信息检索任务。

- 主要局限性: 1)模型性能高度依赖于MIM合成的数据与真实数据的匹配度;2)实验仅在一个评估数据集上进行,泛化能力有待进一步验证;3)模型为离线处理,未讨论实时性。

🏗️ 模型架构

UNMIXX的整体架构基于轻量级语音分离模型TIGER进行改造,其核心流程如下:

- 输入预处理:输入混合音频波形经过短时傅里叶变换(STFT)转换为时频表示。

- 子带处理:频率轴被划分为非均匀的子带,每个子带通过线性层映射到固定维度空间。

- 核心模块循环:处理后的特征进入一个由“多尺度选择性注意力”和“全频帧注意力(F3A)”交替组成的模块,该模块沿频率维度和时间维度交替操作,并重复8次。F3A模块是UNMIXX改造的关键,它不仅包含标准的自注意力,还集成了跨源注意力(CS Attention)。

- 跨源注意力(CS Attention)机制:

- 将F3A模块的输入表示 \(\bar{Z} \in \mathbb{R}^{N \times K \times T}\) 沿通道维(N)拆分为两半,分别对应两个歌手。

- 构建反转输入:将两半通道交换顺序得到 \(\bar{Z}^{\text{reverse}}\)。

- 计算注意力:从 \(\bar{Z}^{\text{reverse}}\) 得到查询Qreverse,从原始 \(\bar{Z}\) 得到查询Q、键K和值V。注意力权重计算为 \(A_{cs} = \text{Softmax}\left( - \frac{Q_{\text{reverse}} K^\top}{\sqrt{E \times T}} \right)\)。负号是关键,它使得注意力机制抑制(down-weight) 两个表示中高相似度的区域。

- 输出融合:最终输出是标准自注意力 \(A_{self}\) 和跨源注意力 \(A_{cs}\) 作用于值V后的平均值 \(O = \frac{1}{2}(A_{self}V + A_{cs}V)\)。自注意力保持每个歌手表示的内部一致性,跨源注意力则驱动两个表示彼此分离。

- 输出生成:经过多轮循环后,恢复全频带表示,为每个歌手生成一个掩码(mask),将掩码应用于输入混合波形的频谱,再通过逆STFT得到分离后的各人声波形。

图2展示了跨源注意力机制的细节,清晰地描绘了输入拆分、反转、Q/K/V的生成以及带有负号的注意力权重计算过程,直观地解释了如何抑制两个表示间的相似性。

图2展示了跨源注意力机制的细节,清晰地描绘了输入拆分、反转、Q/K/V的生成以及带有负号的注意力权重计算过程,直观地解释了如何抑制两个表示间的相似性。

💡 核心创新点

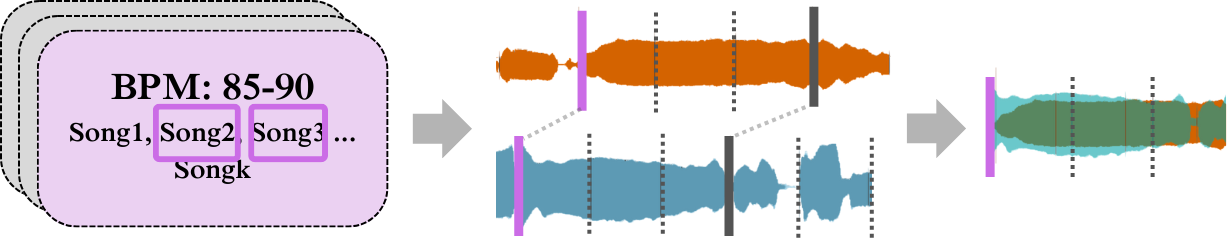

音乐信息混合(MIM)数据合成策略:

- 是什么:一种模拟真实多轨录音中强相关性的训练数据生成方法,包含时间对齐(全局)和和谐对齐(局部)。

- 之前局限:此前方法(如MedleyVox)简单随机混合单声道人声,无法模拟真实的音符对齐、和声关系等复杂相关性,导致模型在真实数据上泛化差。

- 如何起作用:通过BPM分组和节拍对齐确保节奏同步,通过谐波重叠分数筛选音高和谐的配对,生成“音乐化”的、高度相关的混合样本。

- 收益:显著缓解了MSVS领域训练数据稀缺的问题,并使模型能更有效地学习处理高相关性混合。

跨源(CS)注意力机制:

- 是什么:一种在模型架构内部,通过注意力机制主动促使两个源(歌手)的特征表示变得互异的模块。

- 之前局限:传统U-Net或基于自注意力的分离网络缺乏显式的、针对“两个源需彼此区分”的建模,容易在高度相关的混合中产生干扰。

- 如何起作用:利用“反向注意力”,计算一个源相对于另一个源的查询-键相似度,并在softmax前取负,从而抑制相似区域,迫使网络为两个歌手学习互补的、排他的特征。

- 收益:从模型表示学习的根本层面促进分离,是解决高相关性问题的关键架构创新。

幅度惩罚损失(LPenalty):

- 是什么:一种在训练后期引入的辅助损失,显式惩罚预测频谱图中不应出现干扰的时频区域。

- 之前局限:仅使用SNR或幅度损失(LMag)无法精细控制局部干扰的消除,容易残留能量。

- 如何起作用:通过比较预测频谱、目标源真值谱和干扰源真值谱,构建一个二元“干扰掩膜”,标记出干扰源能量高而目标源能量低的区域。损失函数计算预测谱在这些区域的能量并予以惩罚。

- 收益:作为一种显式的监督信号,有效清理分离结果中的残余干扰,在更难的unison子集上提升显著。

🔬 细节详述

- 训练数据:

- 数据集:使用9个单人声歌唱数据集,总计约400小时音频。具体名称见参考文献[17-25]。

- 预处理:所有音频重采样至24 kHz。STFT参数:窗长960样本(40ms),跳长240样本(10ms),FFT点数960。对幅度谱应用幂律压缩以减少动态范围。

- 损失函数:

- 总损失:\(L_{Total} = L_{SNR} + \lambda_{mag} \cdot L_{Mag} + \lambda_{penalty} \cdot L_{Penalty}\)。

- LSNR:信号噪声比损失。

- LMag:地面真值与估计幅度谱的L2距离。

- LPenalty:如公式所示,针对每个目标源i,构建干扰掩膜 \(I_i\),然后计算估计谱 \(\hat{M}^{(i)}\) 在该掩膜下的归一化L2能量作为惩罚。

- 权重与调度:\(\lambda_{mag} = 0.1\),\(\lambda_{penalty} = 0.02\)。干扰掩膜阈值 \(\tau_{max} = 1.0\),\(\tau_{min} = 0.5\)。幅度惩罚损失在训练进行到一半后才开始应用。

- 训练策略:

- 优化器:Adam,初始学习率0.001。

- 批大小:8。

- 训练步数:最多500k步,采用基于验证集性能的早停策略(60k步无提升则停止)。

- 学习率衰减:根据验证性能衰减,具体策略未说明。

- 关键超参数:

- 模型参数量:951k(UNMIXX)。

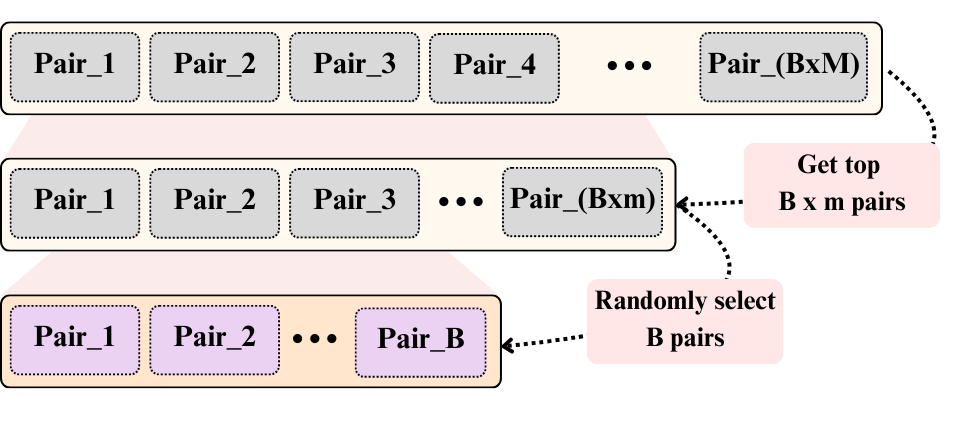

- MIM中谐波对齐参数:\(M=16\),\(m=8\)(最终选择)。

- 注意力头数(A)、嵌入维度(E)等:未明确说明。

- 训练硬件:论文中未说明。

- 推理细节:论文中未说明。

📊 实验结果

主要对比实验(表3):

| 方法 | #参数 | Duet子集 | Unison子集 | ||||

|---|---|---|---|---|---|---|---|

| SDRi (dB) | SI-SDRi (dB) | HSSNR (dB) | SDRi (dB) | SI-SDRi (dB) | HSSNR (dB) | ||

| MedleyVox | 5M | 15.10 | 14.20 | 13.33 | 4.90 | 4.40 | 7.65 |

| TIGER* | 947k | 16.58 | 15.52 | 15.14 | 5.96 | 5.31 | 9.86 |

| UNMIXX | 951k | 17.52 | 16.47 | 15.96 | 7.16 | 6.58 | 10.50 |

消融实验(表4关键行):

| 方法 | Duet SDRi | Unison SDRi | 说明 |

|---|---|---|---|

| (1) TIGER* | 16.58 | 5.96 | 基线 |

| (2) - Speech dataset | 16.57 | 6.54 | 去掉语音数据 |

| + MIM (m=12) | 17.11 | 7.03 | 弱谐波对齐 |

| + MIM (m=8) | 16.79 | 7.31 | 中等谐波对齐(最终选择) |

| (3) + CS attention | 18.01 | 6.17 | 仅加跨源注意力 |

| (4) + Mag loss | 16.66 | 6.26 | 仅加幅度损失 |

| + Mag, Penalty loss | 16.68 | 6.44 | 加幅度+惩罚损失 |

分析:

- UNMIXX在所有指标上大幅超越前作(MedleyVox),并在HSSNR上超越更强的TIGER基线,证明其分离质量真实提升,而非仅仅是排列优化。

- 消融实验证实:(1)MIM(尤其m=8)对提升unison性能至关重要,但对duet效果不一(m过小可能降低多样性);(2)CS Attention对duet子集提升巨大(+1.43 dB SDRi),说明其在解决中等相关性混合上的有效性;(3)幅度惩罚损失在更难的unison子集上带来0.18 dB SDRi和0.51 dB HSSNR的提升,且可视化结果(图3)显示其生成的频谱图更干净。

- 论文提出的PSSNR和HSSNR指标(表2验证)能更公平地评估同演唱者分离场景,解决了传统指标在该场景下失效的问题。

图3展示了仅使用幅度损失与同时使用幅度及惩罚损失的输出频谱图对比。后者明显更干净,更接近真实频谱,直观证明了惩罚损失对抑制干扰的有效性。

图3展示了仅使用幅度损失与同时使用幅度及惩罚损失的输出频谱图对比。后者明显更干净,更接近真实频谱,直观证明了惩罚损失对抑制干扰的有效性。

⚖️ 评分理由

- 学术质量:6.5/7:论文工作完整、扎实。针对明确问题(高相关、数据少)提出了从数据到模型到损失的全套解决方案,且每个部分都有充分动机。实验设计严谨,消融实验和指标分析深入。技术细节描述清晰,可复现性强。创新点属于针对特定问题的有效改进,而非基础理论突破。

- 选题价值:1.5/2:多人歌唱语音分离是一个有价值的垂直研究方向,与音乐制作、娱乐应用紧密相关。研究相对小众,但对于音频分离领域的研究者而言,其解决高相关源分离的思路具有启发性和参考价值。

- 开源与复现加成:0.5/1:论文提供了演示页面链接和关键训练超参数,具备基本的复现指引。但未承诺开源代码、模型权重或训练脚本,这限制了社区快速验证和扩展研究的可能性,因此加成有限。