📄 Tri-Attention Fusion: Joint Temporal-Spectral and Bidirectional Modeling for Speech Spoofing Detection

#语音伪造检测 #注意力机制 #状态空间模型 #端到端 #预训练

✅ 7.0/10 | 前25% | #语音伪造检测 | #注意力机制 | #状态空间模型 #端到端

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Minjiao Yang(北京邮电大学网络空间安全学院)

- 通讯作者:Kangfeng Zheng(北京邮电大学网络空间安全学院,姓名后带星号*)

- 作者列表:Minjiao Yang(北京邮电大学网络空间安全学院)、Kangfeng Zheng(北京邮电大学网络空间安全学院)、Jujie Wang(北京邮电大学网络空间安全学院)、Xiaoyu Zhang(北京邮电大学网络空间安全学院)、Yaru Zhao(国际关系学院)

💡 毒舌点评

这篇论文在Mamba日益火热的语音防伪赛道上,为BiMamba-ST模型量身打造了一个结构精巧、消融实验扎实的融合模块,实验结果在多个公开基准上取得了稳定的提升,尤其是端到端方案在In-the-Wild数据集上的相对EER下降31%,显示了不错的泛化能力。然而,核心创新主要集中在对已有骨干网络输出端的信息整合方式,而非提出全新的检测范式或发现更本质的伪造痕迹,且缺乏代码和模型开源,限制了其在社区内被快速验证和应用的可能性。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及公开权重。

- 数据集:使用了公开的ASVspoof 2019/2021系列数据集和In-the-Wild数据集,但论文本身未公开额外数据集。

- Demo:未提供在线演示。

- 复现材料:论文给出了较为详细的训练细节、超参数设置(学习率、批大小、优化器、训练轮数)、损失函数权重、数据增强算法选择以及硬件信息(单卡A800)。部分超参数(如Sinc卷积的具体参数、SE-Res2Net的内部结构)引用了先前工作[17, 19],但未在附录中完整复述。

- 论文中引用的开源项目:论文引用了多个开源项目或其官方实现作为基线进行对比,如RawBMamba [19], BiCrossMamba-ST [14], AASIST [6], SE-Rawformer [9], XLSR-Mamba [10]等。

- 总体开源情况:论文中未提及开源计划(代码、模型)。

📌 核心摘要

这篇论文针对语音伪造检测任务中,需要同时建模时频域、短时与长时依赖关系的挑战,提出了一种名为“三重注意力融合”(Tri-Attention Fusion)的模块。该方法以BiMamba-ST(一种双向Mamba的时频双分支骨干网络)的输出为基础,通过三个子模块逐步整合信息:局部域注意力(LDA)在通道维度自适应融合前向和反向扫描得到的特征;跨域注意力(CDA)通过通道Gram矩阵在共享通道空间内实现时域与频域特征的交互;全局表示池化(GRP)将序列特征聚合为固定维度的嵌入。该模块被集成到端到端和预训练(XLSR)两种前端中进行评估。实验结果在ASVspoof 2019 LA、2021 LA、2021 DF以及In-the-Wild四个数据集上,均取得了与现有最佳方法持平或超越的性能。例如,在端到端前端下,其在In-the-Wild数据集上的EER为33.48%,相比基线RawBMamba(48.53%)有31%的相对下降。该工作的核心意义在于证明了一个设计良好的渐进式融合模块能显著提升Mamba类模型在复杂伪造检测任务中的特征建模能力。主要局限性在于其创新是模块级的,且未开源代码与模型,复现依赖论文中的细节描述。

🏗️ 模型架构

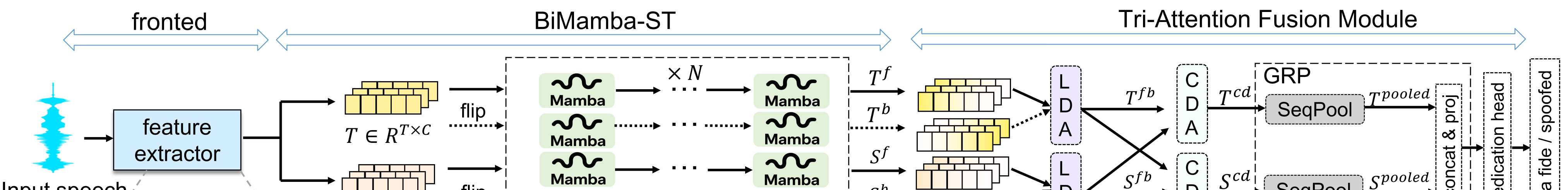

模型整体架构为“特征提取前端 -> BiMamba-ST骨干 -> Tri-Attention Fusion模块 -> 分类器”。

- 特征提取前端:处理原始音频(4秒,64,600样本),支持两种输入:

- 端到端(E2E)前端:使用可学习的Sinc卷积层(70个滤波器,核大小129,步长1)直接从波形中提取特征。

- 预训练前端:使用在大规模外部数据上预训练的XLSR (0.3B)模型,生成通用声学表示,随后通过线性层将维度降至128,并在SSD任务上进行微调。

- 短时特征提取:两种前端的输出(添加通道维度后)都经过3×3最大池化下采样,然后通过一个由四个2D残差卷积层组成的模块(通道数:32, 32, 64, 64),其中后三个为SE-Res2Net块以扩大感受野,最终得到短时特征图 M ∈ ℝ^{C×S×T}(C=64)。

- 时频解耦:利用自注意力聚合层,对特征图M在时间和频率维度进行加权聚合,分别得到频谱特征 S ∈ ℝ^{S×C} 和时域特征 T ∈ ℝ^{T×C}。

- BiMamba-ST骨干:一个双分支(频谱分支和时域分支)的时间-频率主干。每个分支使用双向Mamba块(N=1层)对相应的短时特征(S或T)进行建模,捕获长距离依赖关系。每个标准Mamba块包含投影层、因果1D卷积、SiLU激活和选择性状态空间模型(SSM)。BiMamba-ST最终输出前向和后向的频谱序列(S_f, S_b)以及时域序列(T_f, T_b)。

- Tri-Attention Fusion模块:本文核心,对BiMamba-ST的输出进行渐进式融合:

- 局部域注意力(LDA)块:首先沿序列维度对S_f和S_b进行平均池化,拼接后通过序列交织(shuffle)操作,再经分组卷积和Sigmoid生成跨方向注意力权重。将权重解交织后,分别对前向和后向特征进行加权,得到融合后的频谱特征 S_fb 和时域特征 T_fb。LDA通过通道注意力自适应地融合了双向扫描的互补信息。

- 跨域注意力(CDA)块:针对S_fb和T_fb长度不匹配的问题,该块在共享通道空间进行交互。例如,对频谱分支,首先通过时域特征计算一个通道亲和矩阵 T̃ = softmax(T_fb · T_fb^T),该矩阵表征了由时域动态引起的通道间依赖。然后,用这个矩阵对频谱通道进行重混合,并通过一个可学习的门控参数γ(初始化为0)和残差连接得到跨域频谱特征 S_cd。时域特征T_cd的计算方式类似。CDA避免了序列维度的显式对齐,通过通道Gram矩阵实现了有效的时频交互。

- 全局表示池化(GRP)块:使用序列池化(SeqPool)将变长的S_cd和T_cd序列分别聚合成固定长度的向量(S_pooled, T_pooled)。具体方法是通过一个线性层计算序列位置的注意力权重,然后加权求和。最后将两者拼接,通过线性层映射到分类空间,进行真/伪判别。

图1展示了完整的模型架构。左下角是音频输入,经过前端处理后进入BiMamba-ST的两个分支。中间是BiMamba-ST内部结构,显示了Mamba块如何分别处理时域和频域特征。右上角是本文提出的Tri-Attention Fusion模块,清晰地展示了LDA、CDA和GRP三个子模块如何逐步整合来自双向、双分支的特征,最终输出用于分类的嵌入向量。

💡 核心创新点

- 提出Tri-Attention Fusion模块:这是一个针对双向双分支骨干网络(如BiMamba-ST)设计的渐进式融合框架。它包含三个功能明确的子模块(LDA, CDA, GRP),共同解决了现有Mamba类方法中融合策略简单、无法充分联合建模复杂伪造痕迹的问题。

- 局部域注意力(LDA)设计:不同于简单的加法或序列级融合,LDA通过通道维度的注意力机制自适应地融合前向与反向扫描的信息。通过序列交织和分组卷积,它显式建模了不同扫描方向对应通道间的依赖,更有效地利用了双向建模的互补性。

- 跨域注意力(CDA)设计:该模块创新性地使用通道Gram矩阵在共享通道空间内实现时域与频域的交互。这种方法巧妙地避免了时域和频域序列长度不匹配带来的对齐问题,同时通过另一个域的通道依赖来调制当前域的特征,增强了对细微伪造痕迹的捕捉能力。

- 架构的通用性与有效性验证:论文不仅将模块应用于端到端系统,还验证了其在基于预训练XLSR的系统上的有效性,表明该融合策略具有一定的通用性。消融实验系统性地证明了LDA、CDA和GRP各组件的有效性,以及CDA中关键设计(如可学习参数γ和残差连接)的作用。

🔬 细节详述

- 训练数据:

- 数据集:主要使用ASVspoof 2019 LA(19LA)的训练集进行训练,验证集用于调优。评估在19LA, 21LA, 21DF, 和In-the-Wild数据集上进行。

- 规模:每条输入音频长度为4秒(64,600个样本)。

- 数据增强:仅对预训练前端使用RawBoost数据增强。具体地,在19/21LA和In-the-Wild数据集上使用algo=5(卷积与脉冲噪声),在21DF数据集上使用algo=3(具有随机着色的平稳噪声)。

- 损失函数:使用加权交叉熵损失,权重比为0.9(正类): 0.1(负类)。

- 训练策略:

- 优化器:Adam,权重衰减为10⁻⁴。

- 学习率:端到端前端初始学习率为10⁻⁵;预训练前端为10⁻⁶以缓解过拟合。

- 批大小:端到端前端为32;预训练前端为24。

- 训练轮数:100个epochs。

- 调度策略:未说明(可能为固定学习率)。

- 关键超参数:

- BiMamba-ST骨干网络层数N=1。

- 特征维度C=64。

- 端到端前端下,模型参数量为474K。

- 预训练前端下,模型总参数量为318M(XLSR 0.3B为319M)。

- 训练硬件:所有实验均在单个NVIDIA A800 GPU上进行。

- 推理细节:

- 端到端前端:报告最佳种子结果(括号内为三个种子的平均值)。

- 预训练前端:平均前五个验证检查点的结果以保证稳定性。

- 正则化或稳定训练技巧:使用RawBoost作为数据增强;预训练前端通过降低学习率和批大小来抑制过拟合。

📊 实验结果

主要对比实验结果:

| 前端类型 | 系统 | 参数量 | 19LA (min t-DCF / EER%) | 21LA (min t-DCF / EER%) | 21DF (EER%) | In-the-Wild (EER%) |

|---|---|---|---|---|---|---|

| 端到端 | RawBMamba | 719K | 0.036 / 1.19 | 0.271 / 3.28 | 15.85 | 48.53† |

| BiCrossMamba-ST | 516K | 0.031 / 1.08 | 0.264 / 3.39 | 14.77 | - | |

| Proposed | 474K | 0.028 / 0.98 | 0.251 / 2.72 | 13.92 | 33.48 | |

| 预训练 | XLSR-Mamba | 319M | 0.013† / 0.44† | 0.208 / 0.93 | 1.88 | 6.71 |

| Proposed | 318M | 0.008 / 0.26 | 0.201 / 0.81 | 1.73 | 7.04 |

关键结论:

- 端到端前端:所提系统在所有指标和数据集上均优于基线RawBMamba和BiCrossMamba-ST。与架构类似的BiCrossMamba-ST相比,在21LA上EER实现了19.8%的相对下降(2.72% vs. 3.39%)。在更具挑战性的In-the-Wild数据集上,EER相对下降31%(33.48% vs. 48.53%),展现了强大的泛化能力。同时,模型参数量(474K)少于两个基线。

- 预训练前端:所提系统在19LA和21LA上优于XLSR-Mamba,尤其在21LA上EER相对下降12.9%(0.81% vs. 0.93%)。在21DF和In-the-Wild数据集上性能与XLSR-Mamba接近(1.73% vs. 1.88%, 7.04% vs. 6.71%)。

消融实验结果(端到端前端):

| 变体 | 21LA (min t-DCF / EER%) | 21DF (EER%) |

|---|---|---|

| Proposed (完整) | 0.251 / 2.72 | 13.92 |

| LDA (across seq) | 0.271 / 3.07 | 14.03 |

| LDA→add & proj | 0.266 / 2.94 | 14.38 |

| CDA w/o γ | 0.269 / 3.13 | 14.54 |

| CDA w/o shortcut | 0.265 / 3.08 | 14.46 |

| CDA→MCA | 0.270 / 3.19 | 14.61 |

| GRP: SeqPool→GAP | 0.259 / 2.88 | 14.24 |

关键消融结论:

- LDA有效性:将LDA替换为跨序列的简单平均(Row2)或加法与投影(Row3)均导致性能下降,证明了自适应通道注意力融合双向特征的重要性。

- CDA有效性:将CDA替换为MCA机制(Row6)导致性能显著下降,表明CDA在共享通道空间处理时频交互更有效。移除CDA中的可学习参数γ(Row4)或残差连接(Row5)也损害性能。

- GRP有效性:将自适应的SeqPool替换为全局平均池化(GAP, Row7)导致性能下降,证明了自适应加权池化的优势。

与SOTA系统对比: 论文在表3中详细对比了多种最新SOTA方法。结果表明,所提系统在端到端前端下全面超越AASIST、SE-Rawformer、RawMamba、RawBMamba、BiCrossMamba-ST等方法。在预训练前端下,与XLSR+AASIST、XLSR+MOE fusion、XLSR+TCM-Conformer、XLSR+SLS、XLSR+AASIST+LSR以及XLSR-Mamba相比,取得了有竞争力的结果,在多个数据集上达到最佳或接近最佳水平。

⚖️ 评分理由

- 学术质量:5.5/7 - 创新性体现在针对特定骨干网络的融合模块设计,LDA、CDA、GRP三个子模块各有明确功能且相互配合,技术细节清晰,消融实验充分,证明了各组件的有效性。实验涵盖四个广泛使用的基准,并与多种SOTA方法进行了对比,证据可信。扣分点在于核心贡献是模块级的改进,而非提出全新的检测模型或发现更本质的伪造特征。

- 选题价值:1.5/2 - 语音伪造检测是音频安全领域的核心挑战,随着生成式AI发展,其重要性与日俱增。论文工作紧跟前沿(使用Mamba),且在多个公开基准上展示了竞争力,对从事该领域研究的读者有较高参考价值。扣分点在于该方向已相对拥挤,本文改进的突破性有限。

- 开源与复现加成:0.0/1 - 论文提供了较为详细的实现细节(如前端处理、损失函数、训练超参数、数据增强算法选择等),但未提供代码仓库链接、模型权重或在线Demo。这降低了结果的可验证性和社区复现效率,因此开源加成分为0。