📄 Timbre-Based Pretraining with Pseudo-Labels for Multi-Instrument Automatic Music Transcription

#音乐信息检索 #自监督学习 #生成模型 #预训练 #音频分类

✅ 7.0/10 | 前25% | #音乐信息检索 | #预训练 | #自监督学习 #生成模型

学术质量 6.5/7 | 选题价值 1.5/2 | 复现加成 0.8 | 置信度 高

👥 作者与机构

- 第一作者:Rin Sato(Waseda University, Tokyo, Japan)

- 通讯作者:未说明

- 作者列表:Rin Sato(Waseda University, Tokyo, Japan)、Keitaro Tanaka(Waseda Research Institute for Science and Engineering, Tokyo, Japan)、Shigeo Morishima(Waseda Research Institute for Science and Engineering, Tokyo, Japan)

💡 毒舌点评

这篇论文巧妙地将“音色”从具体的“乐器标签”中解放出来,通过伪标签预训练来教模型听懂声音的本质区别,是缓解多乐器转录数据不平衡问题的一剂良方;然而,方法严重依赖DDSP合成音频,而合成音频的音色多样性与真实世界录音之间的鸿沟(domain gap)可能成为其性能天花板,特别是在对音色敏感的吉他等单乐器任务上出现了性能反降,说明“学音色”在特定场景下可能“学了个寂寞”。

🔗 开源详情

- 代码:是,提供了GitHub仓库链接:https://github.com/stearicacid/timbre-based-pretraining。

- 模型权重:未提及公开预训练的VAE或AMT模型权重。

- 数据集:合成音频数据集未提及公开下载,需用户根据论文方法自行生成。使用了公开的NSynth、Lakh MIDI以及多个评估数据集。

- Demo:未提及。

- 复现材料:提供了详细的训练策略、超参数配置、评估指标计算方法和数据集划分协议。

- 引用的开源项目:DDSP, Jointist (Onsets and Frames), NSynth, Lakh MIDI Dataset, mir_eval。

📌 核心摘要

- 问题:多乐器自动音乐转录(AMT)面临严峻挑战,主要原因在于训练数据稀缺且乐器间严重不平衡,导致模型容易偏向主要乐器,难以均衡地转录不同乐器。

- 方法核心:提出了一种基于音色的预训练框架。首先,使用变分自编码器(VAE)学习一个与乐器标签无关的潜在音色空间,捕捉乐器的谐波特性。然后,通过在该空间中进行聚类并采样,生成带有“伪音色标签”(而非乐器标签)的合成音频用于预训练。最后,在目标数据集上进行微调。

- 创新性:不同于以往依赖乐器标签或进行简单数据增强的方法,该框架首次将音色表示解耦,使模型学习泛化的音色辨别能力,从而在预训练阶段就建立了对音色相似性/差异性的内在理解。

- 主要实验结果:在多个多乐器数据集(Slakh2100, MusicNet, URMP)上,所提方法(尤其是k=39或k=90的聚类)在“分段F1”和“乐器F1”等均衡性指标上显著优于从头训练和基于乐器标签预训练的基线。例如,在URMP数据集上,乐器F1从基线的最高70.16提升至75.13(k=39)。但在单乐器数据集GuitarSet上,性能反而可能下降。

- 实际意义:为解决音乐信息检索中普遍存在的数据不平衡问题提供了一种新思路,通过学习更本质的声学特征来提升模型的泛化能力和公平性,有助于构建更鲁棒、实用的音乐转录系统。

- 局限性:合成音频的音色多样性受限于DDSP和预训练的VAE,可能无法完全代表真实世界的乐器音色分布。方法在纯单乐器场景下收益有限甚至有害。

该框架整体分为三个阶段(见图2):

阶段一:基于VAE的音色表示学习:

- 输入:NSynth数据集中的单声道one-shot音频。

- 过程:使用DDSP从音频中提取45维谐波分布特征。将整个片段的特征取时间平均,得到一个静态向量

h。VAE的编码器将h映射为24维潜在向量z。VAE使用重建损失、KL散度损失和三元组损失(利用乐器族标签作为弱监督)进行训练,旨在学习一个能反映音色相似性/差异性的连续潜在空间。 - 输出:训练好的VAE编码器(用于提取音色向量)和解码器(用于从潜在向量重建谐波分布)。

阶段二:基于伪标签的音频合成:

- 输入:Lakh MIDI数据集中的MIDI乐谱。

- 过程:对阶段一得到的所有训练音频的潜在向量

z进行k-means聚类,得到k个簇。对于每个MIDI片段中的每个音轨,随机分配一个音色簇,从该簇的分布(均值为簇中心,协方差受控)中采样一个潜在向量z。将z输入VAE解码器重建谐波分布,连同MIDI的音高、时长等信息一起输入DDSP,生成带有指定音色的合成音频。噪声和混响水平也随机变化。合成音频被切分为10秒的片段,其“标签”被替换为对应的音色簇索引(即伪标签)。 - 输出:带有伪音色标签的合成音频数据集。

阶段三:AMT模型的预训练与微调:

- 预训练:使用阶段二生成的伪标签音频数据,训练一个多乐器AMT模型(如Jointist)。模型的目标是根据音频预测每个音符事件对应的伪音色标签。损失函数为交叉熵损失。

- 微调:将预训练好的AMT模型在目标数据集(如Slakh2100)上进行微调。此时,模型最后一层被替换为预测真实乐器标签,并重新初始化。所有层的权重均可更新(未冻结),以适应目标数据集的音色分布。最终模型输出对每个音符的起始时间、偏移和音高的预测。

音色表示解耦与预训练:是什么:提出使用音色聚类作为伪标签进行预训练,而非传统的乐器标签。局限:之前的方法(如在Slakh2100上预训练)直接使用乐器标签,导致模型过拟合特定标签,对罕见乐器泛化差。如何起作用:伪标签迫使模型学习更本质的声学特征(谐波结构),而非记忆“钢琴音色=钢琴标签”这种关联,从而获得泛化的音色辨别能力。收益:在多个多乐器数据集上提升了转录的均衡性(分段F1、乐器F1显著提高)。

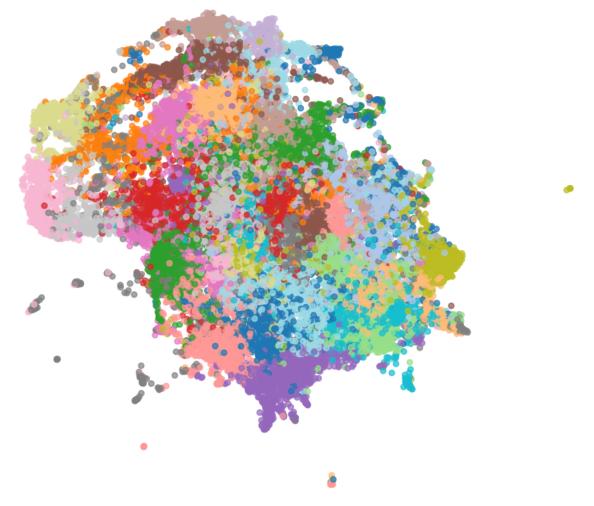

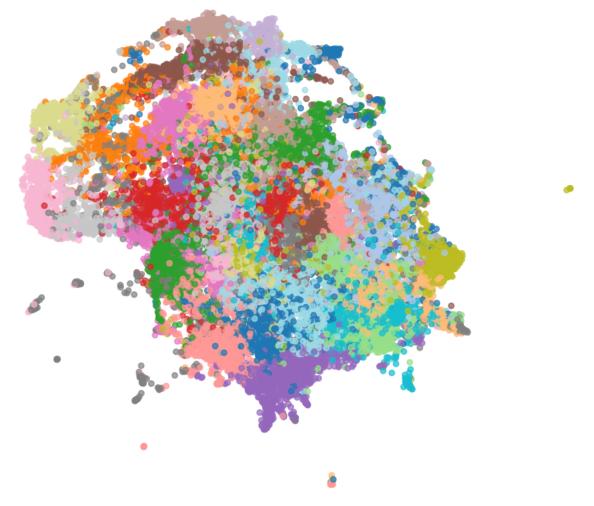

可控的音色相似性学习:是什么:通过在潜在空间中进行k-means聚类,并控制聚类数

k和采样温度τ。局限:以往的数据增强(如音高偏移)无法在乐器维度上创造新的、可控的多样性。如何起作用:调整k可以控制音色分组的精细度(k越大,音色区分越细),模型因此学习到不同粒度的音色差异。这在UMAP可视化(图3)和实验中得到了验证(k=39/90效果优于k=10)。收益:提供了调节预训练模型音色认知粒度的有效手段。缓解数据不平衡的生成式框架:是什么:结合MIDI乐谱与基于VAE的音色采样,生成大规模、带注释的训练数据。局限:传统合成数据方法(如Slakh2100)受限于有限的虚拟乐器音色库,无法覆盖音色连续体。如何起作用:可以从学习到的连续音色空间中无限采样,理论上能生成更多样化的音色组合,尤其有利于稀有乐器。收益:在预训练阶段就为模型提供了更平衡、更多样的音色样本。

- 训练数据:

- VAE训练:NSynth数据集,305,979条单声道4秒one-shot音频,涵盖11个乐器族。随机按80%-10%-10%划分。

- 预训练音频合成:Lakh MIDI Dataset,176,581首MIDI曲目。合成音频总时长限制在145小时,以匹配Slakh2100的规模。

- 下游评估数据集:多乐器:Slakh2100, MusicNet, URMP;单乐器:MAESTRO(钢琴), GuitarSet(吉他)。论文中给出了各数据集的具体划分协议。

- 损失函数:

- VAE训练:

L_total = λ_recon L_recon + β L_KL + λ_triplet * L_triplet。L_recon为输入与重建特征的MSE;L_KL为KL散度,使用了free bits技术(阈值0.1)防止后验坍塌;L_triplet为三元组损失,边际(margin)为0.5,权重λ_triplet=1.0。 - 预训练:交叉熵损失,针对预测的伪音色标签。

- VAE训练:

- 训练策略:

- VAE:Adam优化器,学习率1e-4,权重衰减1e-4,批量大小1024。β调度:前10个epoch β=0(冻结),接下来25个epoch从0线性预热至0.001,之后保持不变。总训练轮数未明确说明,但调度暗示至少35个epoch。

- AMT模型:音频重采样至16kHz,提取229个频带的Log-Mel频谱图(窗长2048,帧移160)。训练时随机裁剪10秒片段。使用Adam优化器,学习率1e-3,批量大小8。

- 关键超参数:

- VAE潜在维度:24。

- 聚类数k:实验对比了k=10, 39, 90三种设置。

- 采样温度τ:k=10时为0.198, k=39时为0.185, k=90时为0.180, 根据簇内方差设定。

- 训练硬件:论文中未说明。

- 推理细节:论文中未说明具体的解码策略或beam search等细节。

- 正则化技巧:VAE中使用free bits技术和β调度;AMT微调时不冻结任何层。

主要结果(多乐器数据集):

| 预训练方法 | 数据集 | Flat F1 | Piece-wise F1 | Instrument-wise F1 | ||||||

|---|---|---|---|---|---|---|---|---|---|---|

| Frame | Note | N/O | Frame | Note | N/O | Frame | Note | N/O | ||

| Scratch | Slakh | 72.36 | 54.88 | 22.09 | 49.38 | 55.60 | 23.54 | 40.45 | 45.07 | 20.05 |

| Slakh预训练 | Slakh | - | - | - | - | - | - | - | - | - |

| Sato-10 | Slakh | 78.02 | 59.20 | 27.89 | 56.52 | 61.99 | 29.60 | 49.49 | 51.58 | 27.13 |

| Sato-90 | Slakh | 76.41 | 57.59 | 25.56 | 53.13 | 59.01 | 26.87 | 44.11 | 47.73 | 23.11 |

| Ours (k=10) | Slakh | 76.69 | 58.41 | 26.37 | 55.55 | 61.10 | 28.67 | 48.01 | 50.81 | 26.47 |

| Ours (k=39) | Slakh | 77.27 | 58.21 | 26.37 | 56.16 | 61.66 | 29.07 | 48.98 | 51.76 | 26.63 |

| Ours (k=90) | Slakh | 77.43 | 59.04 | 27.79 | 56.51 | 62.19 | 29.93 | 48.62 | 52.24 | 27.13 |

| Scratch | MusicNet | 75.08 | 72.06 | 42.77 | 64.17 | 64.64 | 36.98 | 52.45 | 52.65 | 28.56 |

| Slakh预训练 | MusicNet | 76.51 | 73.78 | 41.29 | 66.21 | 67.59 | 36.51 | 55.23 | 57.00 | 30.27 |

| Sato-10 | MusicNet | 76.56 | 74.94 | 40.33 | 66.95 | 67.41 | 35.61 | 55.28 | 59.50 | 27.61 |

| Sato-90 | MusicNet | 78.28 | 73.16 | 45.14 | 68.64 | 67.63 | 40.38 | 57.28 | 57.95 | 32.93 |

| Ours (k=10) | MusicNet | 73.94 | 73.00 | 37.71 | 64.79 | 67.21 | 34.45 | 54.39 | 57.30 | 29.90 |

| Ours (k=39) | MusicNet | 77.54 | 74.19 | 43.38 | 67.80 | 68.73 | 38.21 | 56.39 | 58.63 | 30.86 |

| Ours (k=90) | MusicNet | 78.16 | 73.55 | 45.38 | 68.64 | 67.75 | 39.66 | 58.64 | 58.96 | 32.15 |

关键结论:

- 均衡性提升:在多乐器数据集上,所提方法(k=39, k=90)在Piece-wise F1和Instrument-wise F1上常常取得最佳或次佳成绩。这表明该方法能更公平地处理不同乐器和不同乐段,减轻了对主要乐器的偏向。

- k值影响:聚类数k=39和90的效果普遍优于k=10,与图3的UMAP可视化一致,即更细粒度的音色划分能带来更好的预训练效果。

- 单乐器场景:在MAESTRO(钢琴)上,方法表现与基线持平或略优。但在GuitarSet(吉他)上,方法有时甚至低于从头训练,表明在缺乏音色多样性的单乐器任务中,该预训练策略可能引入不必要的方差。

图3展示了不同聚类粒度下的音色空间。原始乐器标签存在重叠(如不同乐器族共享谐波结构),而基于音色的聚类(k=39, k=90)能更精细地区分音色相似和差异的样本,这解释了模型在均衡性指标上的提升。

图3展示了不同聚类粒度下的音色空间。原始乐器标签存在重叠(如不同乐器族共享谐波结构),而基于音色的聚类(k=39, k=90)能更精细地区分音色相似和差异的样本,这解释了模型在均衡性指标上的提升。

- 学术质量:6.5/7。创新性明确,将音色表示与乐器标签解耦用于AMT预训练是一个新颖且合理的思路。技术路线清晰,VAE、伪标签生成、预训练-微调的各环节实现正确。实验设计全面,对比了多个强基线(包括Sato等人的最新工作),使用了多种评估指标和聚合方案来突出“均衡性”这一核心贡献,并通过消融实验(不同k值)验证了关键设计选择。结果令人信服。主要扣分点在于合成音频的真实性质疑(domain gap)未在实验中被充分探讨和解决。

- 选题价值:1.5/2。多乐器AMT是音乐AI的核心难题之一,其数据不平衡问题具有普遍性。该工作提出的框架为解决这一问题提供了新范式,潜在影响可扩展到其他需要处理长尾或多源分类的音频任务。对音频/音乐处理领域的研究者和开发者有明确价值。

- 开源与复现加成:0.8/1。论文提供了清晰的代码仓库链接(https://github.com/stearicacid/timbre-based-pretraining),并详尽列出了VAE训练、数据合成和AMT模型训练的所有超参数、优化器设置和评估细节,可复现性高。主要的遗憾是未提供预训练好的VAE模型或生成的伪标签数据集,这会让其他研究者省去大量前期工作。

开源详情

- 代码:是,提供了GitHub仓库链接:https://github.com/stearicacid/timbre-based-pretraining。

- 模型权重:未提及公开预训练的VAE或AMT模型权重。

- 数据集:合成音频数据集未提及公开下载,需用户根据论文方法自行生成。使用了公开的NSynth、Lakh MIDI以及多个评估数据集。

- Demo:未提及。

- 复现材料:提供了详细的训练策略、超参数配置、评估指标计算方法和数据集划分协议。

- 引用的开源项目:DDSP, Jointist (Onsets and Frames), NSynth, Lakh MIDI Dataset, mir_eval。

🏗️ 模型架构

该框架整体分为三个阶段(见图2):

阶段一:基于VAE的音色表示学习:

- 输入:NSynth数据集中的单声道one-shot音频。

- 过程:使用DDSP从音频中提取45维谐波分布特征。将整个片段的特征取时间平均,得到一个静态向量

h。VAE的编码器将h映射为24维潜在向量z。VAE使用重建损失、KL散度损失和三元组损失(利用乐器族标签作为弱监督)进行训练,旨在学习一个能反映音色相似性/差异性的连续潜在空间。 - 输出:训练好的VAE编码器(用于提取音色向量)和解码器(用于从潜在向量重建谐波分布)。

阶段二:基于伪标签的音频合成:

- 输入:Lakh MIDI数据集中的MIDI乐谱。

- 过程:对阶段一得到的所有训练音频的潜在向量

z进行k-means聚类,得到k个簇。对于每个MIDI片段中的每个音轨,随机分配一个音色簇,从该簇的分布(均值为簇中心,协方差受控)中采样一个潜在向量z。将z输入VAE解码器重建谐波分布,连同MIDI的音高、时长等信息一起输入DDSP,生成带有指定音色的合成音频。噪声和混响水平也随机变化。合成音频被切分为10秒的片段,其“标签”被替换为对应的音色簇索引(即伪标签)。 - 输出:带有伪音色标签的合成音频数据集。

阶段三:AMT模型的预训练与微调:

- 预训练:使用阶段二生成的伪标签音频数据,训练一个多乐器AMT模型(如Jointist)。模型的目标是根据音频预测每个音符事件对应的伪音色标签。损失函数为交叉熵损失。

- 微调:将预训练好的AMT模型在目标数据集(如Slakh2100)上进行微调。此时,模型最后一层被替换为预测真实乐器标签,并重新初始化。所有层的权重均可更新(未冻结),以适应目标数据集的音色分布。最终模型输出对每个音符的起始时间、偏移和音高的预测。

💡 核心创新点

- 音色表示解耦与预训练:是什么:提出使用音色聚类作为伪标签进行预训练,而非传统的乐器标签。局限:之前的方法(如在Slakh2100上预训练)直接使用乐器标签,导致模型过拟合特定标签,对罕见乐器泛化差。如何起作用:伪标签迫使模型学习更本质的声学特征(谐波结构),而非记忆“钢琴音色=钢琴标签”这种关联,从而获得泛化的音色辨别能力。收益:在多个多乐器数据集上提升了转录的均衡性(分段F1、乐器F1显著提高)。

- 可控的音色相似性学习:是什么:通过在潜在空间中进行k-means聚类,并控制聚类数

k和采样温度τ。局限:以往的数据增强(如音高偏移)无法在乐器维度上创造新的、可控的多样性。如何起作用:调整k可以控制音色分组的精细度(k越大,音色区分越细),模型因此学习到不同粒度的音色差异。这在UMAP可视化(图3)和实验中得到了验证(k=39/90效果优于k=10)。收益:提供了调节预训练模型音色认知粒度的有效手段。 - 缓解数据不平衡的生成式框架:是什么:结合MIDI乐谱与基于VAE的音色采样,生成大规模、带注释的训练数据。局限:传统合成数据方法(如Slakh2100)受限于有限的虚拟乐器音色库,无法覆盖音色连续体。如何起作用:可以从学习到的连续音色空间中无限采样,理论上能生成更多样化的音色组合,尤其有利于稀有乐器。收益:在预训练阶段就为模型提供了更平衡、更多样的音色样本。

🔬 细节详述

- 训练数据:

- VAE训练:NSynth数据集,305,979条单声道4秒one-shot音频,涵盖11个乐器族。随机按80%-10%-10%划分。

- 预训练音频合成:Lakh MIDI Dataset,176,581首MIDI曲目。合成音频总时长限制在145小时,以匹配Slakh2100的规模。

- 下游评估数据集:多乐器:Slakh2100, MusicNet, URMP;单乐器:MAESTRO(钢琴), GuitarSet(吉他)。论文中给出了各数据集的具体划分协议。

- 损失函数:

- VAE训练:

L_total = λ_recon L_recon + β L_KL + λ_triplet * L_triplet。L_recon为输入与重建特征的MSE;L_KL为KL散度,使用了free bits技术(阈值0.1)防止后验坍塌;L_triplet为三元组损失,边际(margin)为0.5,权重λ_triplet=1.0。 - 预训练:交叉熵损失,针对预测的伪音色标签。

- VAE训练:

- 训练策略:

- VAE:Adam优化器,学习率1e-4,权重衰减1e-4,批量大小1024。β调度:前10个epoch β=0(冻结),接下来25个epoch从0线性预热至0.001,之后保持不变。总训练轮数未明确说明,但调度暗示至少35个epoch。

- AMT模型:音频重采样至16kHz,提取229个频带的Log-Mel频谱图(窗长2048,帧移160)。训练时随机裁剪10秒片段。使用Adam优化器,学习率1e-3,批量大小8。

- 关键超参数:

- VAE潜在维度:24。

- 聚类数k:实验对比了k=10, 39, 90三种设置。

- 采样温度τ:k=10时为0.198, k=39时为0.185, k=90时为0.180, 根据簇内方差设定。

- 训练硬件:论文中未说明。

- 推理细节:论文中未说明具体的解码策略或beam search等细节。

- 正则化技巧:VAE中使用free bits技术和β调度;AMT微调时不冻结任何层。

📊 实验结果

主要结果(多乐器数据集):

| 预训练方法 | 数据集 | Flat F1 | Piece-wise F1 | Instrument-wise F1 | ||||||

|---|---|---|---|---|---|---|---|---|---|---|

| Frame | Note | N/O | Frame | Note | N/O | Frame | Note | N/O | ||

| Scratch | Slakh | 72.36 | 54.88 | 22.09 | 49.38 | 55.60 | 23.54 | 40.45 | 45.07 | 20.05 |

| Slakh预训练 | Slakh | - | - | - | - | - | - | - | - | - |

| Sato-10 | Slakh | 78.02 | 59.20 | 27.89 | 56.52 | 61.99 | 29.60 | 49.49 | 51.58 | 27.13 |

| Sato-90 | Slakh | 76.41 | 57.59 | 25.56 | 53.13 | 59.01 | 26.87 | 44.11 | 47.73 | 23.11 |

| Ours (k=10) | Slakh | 76.69 | 58.41 | 26.37 | 55.55 | 61.10 | 28.67 | 48.01 | 50.81 | 26.47 |

| Ours (k=39) | Slakh | 77.27 | 58.21 | 26.37 | 56.16 | 61.66 | 29.07 | 48.98 | 51.76 | 26.63 |

| Ours (k=90) | Slakh | 77.43 | 59.04 | 27.79 | 56.51 | 62.19 | 29.93 | 48.62 | 52.24 | 27.13 |

| Scratch | MusicNet | 75.08 | 72.06 | 42.77 | 64.17 | 64.64 | 36.98 | 52.45 | 52.65 | 28.56 |

| Slakh预训练 | MusicNet | 76.51 | 73.78 | 41.29 | 66.21 | 67.59 | 36.51 | 55.23 | 57.00 | 30.27 |

| Sato-10 | MusicNet | 76.56 | 74.94 | 40.33 | 66.95 | 67.41 | 35.61 | 55.28 | 59.50 | 27.61 |

| Sato-90 | MusicNet | 78.28 | 73.16 | 45.14 | 68.64 | 67.63 | 40.38 | 57.28 | 57.95 | 32.93 |

| Ours (k=10) | MusicNet | 73.94 | 73.00 | 37.71 | 64.79 | 67.21 | 34.45 | 54.39 | 57.30 | 29.90 |

| Ours (k=39) | MusicNet | 77.54 | 74.19 | 43.38 | 67.80 | 68.73 | 38.21 | 56.39 | 58.63 | 30.86 |

| Ours (k=90) | MusicNet | 78.16 | 73.55 | 45.38 | 68.64 | 67.75 | 39.66 | 58.64 | 58.96 | 32.15 |

关键结论:

- 均衡性提升:在多乐器数据集上,所提方法(k=39, k=90)在Piece-wise F1和Instrument-wise F1上常常取得最佳或次佳成绩。这表明该方法能更公平地处理不同乐器和不同乐段,减轻了对主要乐器的偏向。

- k值影响:聚类数k=39和90的效果普遍优于k=10,与图3的UMAP可视化一致,即更细粒度的音色划分能带来更好的预训练效果。

- 单乐器场景:在MAESTRO(钢琴)上,方法表现与基线持平或略优。但在GuitarSet(吉他)上,方法有时甚至低于从头训练,表明在缺乏音色多样性的单乐器任务中,该预训练策略可能引入不必要的方差。

图3展示了不同聚类粒度下的音色空间。原始乐器标签存在重叠(如不同乐器族共享谐波结构),而基于音色的聚类(k=39, k=90)能更精细地区分音色相似和差异的样本,这解释了模型在均衡性指标上的提升。

图3展示了不同聚类粒度下的音色空间。原始乐器标签存在重叠(如不同乐器族共享谐波结构),而基于音色的聚类(k=39, k=90)能更精细地区分音色相似和差异的样本,这解释了模型在均衡性指标上的提升。

⚖️ 评分理由

- 学术质量:6.5/7。创新性明确,将音色表示与乐器标签解耦用于AMT预训练是一个新颖且合理的思路。技术路线清晰,VAE、伪标签生成、预训练-微调的各环节实现正确。实验设计全面,对比了多个强基线(包括Sato等人的最新工作),使用了多种评估指标和聚合方案来突出“均衡性”这一核心贡献,并通过消融实验(不同k值)验证了关键设计选择。结果令人信服。主要扣分点在于合成音频的真实性质疑(domain gap)未在实验中被充分探讨和解决。

- 选题价值:1.5/2。多乐器AMT是音乐AI的核心难题之一,其数据不平衡问题具有普遍性。该工作提出的框架为解决这一问题提供了新范式,潜在影响可扩展到其他需要处理长尾或多源分类的音频任务。对音频/音乐处理领域的研究者和开发者有明确价值。

- 开源与复现加成:0.8/1。论文提供了清晰的代码仓库链接(https://github.com/stearicacid/timbre-based-pretraining),并详尽列出了VAE训练、数据合成和AMT模型训练的所有超参数、优化器设置和评估细节,可复现性高。主要的遗憾是未提供预训练好的VAE模型或生成的伪标签数据集,这会让其他研究者省去大量前期工作。