📄 Subsequence SDTW: Differentiable Alignment with Flexible Boundary Conditions

#音乐信息检索 #信号处理 #弱监督学习 #音频生成

🔥 8.0/10 | 前25% | #音乐信息检索 | #信号处理 | #弱监督学习 #音频生成

学术质量 6.5/7 | 选题价值 1.0/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Johannes Zeitler (International Audio Laboratories Erlangen)

- 通讯作者:未说明

- 作者列表:Johannes Zeitler (International Audio Laboratories Erlangen), Meinard Müller (International Audio Laboratories Erlangen, 联合了弗里德里希-亚历山大-埃尔朗根-纽伦堡大学 (FAU) 和弗劳恩霍夫集成电路研究所 (IIS))

💡 毒舌点评

这篇论文漂亮地解决了弱监督训练中一个被长期忽视但极为实际的问题——边界不准。其数学推导清晰严谨,将子序列对齐的灵活性完美地融入了可微分框架。亮点是其问题定义的精准性和解决方案的完备性。短板在于,实验验证仅限于单一的钢琴多音高估计任务,缺乏在语音识别等更主流任务上的直接对比,这削弱了其宣称的普适性说服力。

🔗 开源详情

- 代码:论文明确提供了代码仓库链接:https://github.com/groupmm/subsequenceSDTW。实现了CUDA兼容的subSDTW损失函数,并包含复现实验的代码。

- 模型权重:未提及公开的预训练模型权重。

- 数据集:使用了公开数据集MAESTRO和BPSD。论文未提供新的数据集。

- Demo:未提及在线演示。

- 复现材料:论文提供了超参数设置(如γ, 步权重),并指出完整代码已开源,包含了训练细节。

- 引用的开源项目:模型架构基于“Onsets and Frames” [17]的Python实现。使用了Adam优化器 [20]。

📌 核心摘要

- 解决的问题:在使用弱监督数据(如只知道大致起止点)训练深度神经网络时,现有的CTC和SDTW损失函数都假设序列边界必须精确对齐。然而在真实场景中,数据常存在边界偏移,这一刚性假设会损害模型性能。

- 方法核心:提出了子序列软动态时间规整(subsequence SDTW, subSDTW)损失函数。它允许对齐路径的起点和终点不固定,而是在一个预定义的边界区域集合中灵活选择,并通过引入与路径长度成比例的边界权重来避免退化对齐(如坍缩到最短路径)。

- 与已有方法相比新在哪里:subSDTW是经典子序列DTW的可微分版本。与标准SDTW相比,它放松了边界严格对齐的约束;与CTC相比,它支持任意代价矩阵和多标签任务,更适合音乐转录等复杂任务。

- 主要实验结果:在基于Beethoven钢琴奏鸣曲数据集的弱监督多音高估计任务中,当引入±2.0秒的边界偏移时,标准SDTW的F值从0.67降至0.63,无权重subSDTW因路径坍缩暴跌至0.41,而加权subSDTW(subSDTW-W)仍能保持0.66的F值,接近使用强对齐数据训练的基准(0.67)。关键结果见下表:

配置 边界偏移 (∆) 精度 召回率 F值 Strong (强对齐基准) - 0.70 0.65 0.67 SDTW 0.0 s 0.70 0.65 0.67 2.0 s 0.72 0.57 0.63 subSDTW (无权重) 2.0 s 0.77 0.28 0.41 subSDTW-W (加权) 2.0 s 0.70 0.63 0.66 - 实际意义:为众多依赖弱监督序列对齐的深度学习任务(如语音识别、音乐转录)提供了一个即插即用的、能容忍边界噪声的损失函数,提升了模型在现实不完美数据上的训练稳定性和最终性能。

- 主要局限性:方法的有效性在一定程度上依赖于任务特定的边界权重参数化;实验验证集中在音乐领域,其在语音识别等任务上的泛化能力有待进一步证明。

🏗️ 模型架构

本论文的核心贡献不是提出一个新的神经网络模型,而是提出一个新的、可微分的损失函数(subSDTW),它可以与任何现有的序列预测模型(如论文中用于多音高估计的卷积网络)结合使用。

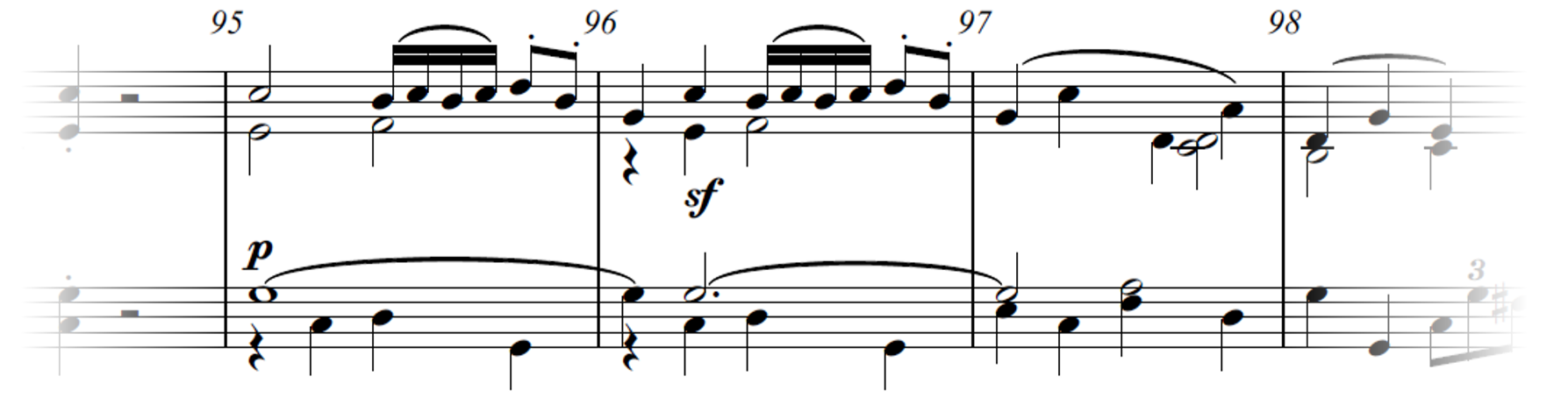

(图1: 展示了边界不匹配的问题场景。a) 乐谱作为弱对齐目标。b) DNN的预测帧。c) 带有边界不确定性±∆的输入音频。d) subSDTW的代价矩阵,显示了具有灵活边界条件的对齐路径。)

(图1: 展示了边界不匹配的问题场景。a) 乐谱作为弱对齐目标。b) DNN的预测帧。c) 带有边界不确定性±∆的输入音频。d) subSDTW的代价矩阵,显示了具有灵活边界条件的对齐路径。)

其核心计算架构体现在前向和后向传播的动态规划递归中:

(图2: subSDTW前向与后向传播示意图。前向过程(蓝色)从起始边界条件(紫色)开始累积代价;后向过程(绿色)计算梯度,并考虑结束边界条件(橙色)的直接贡献。除边界更新外,算法与标准SDTW一致。)

(图2: subSDTW前向与后向传播示意图。前向过程(蓝色)从起始边界条件(紫色)开始累积代价;后向过程(绿色)计算梯度,并考虑结束边界条件(橙色)的直接贡献。除边界更新外,算法与标准SDTW一致。)

完整流程:

- 输入:两个序列,通常是模型预测序列 X(长度N)和弱对齐的目标序列 Y(长度M)。

- 代价矩阵计算:计算一个N×M的矩阵C,其中元素C(n,m)是本地代价(如二元交叉熵),衡量预测x_n与目标y_m的不匹配程度。

- 前向递归 (累积代价矩阵 D):

- 定义一组起始边界单元集合

B_start和结束边界单元集合B_end。 - 对于每个单元(n,m),其累积代价D(n,m)通过软最小值函数(softmin)计算,该函数考虑了从所有可能前驱单元通过“步”到达的成本,以及直接从起始边界开始的成本。后者即为subSDTW引入的灵活性。

- 前向过程中会记录回溯张量B,用于后续反向传播。

- 定义一组起始边界单元集合

- 总损失计算:最终损失不是取D(N,M),而是对结束边界集合

B_end中所有单元的累积代价进行软最小值计算,得到SDTW(C)。 - 后向递归 (梯度计算 H):

- 目标是计算损失SDTW(C)对原始代价矩阵C中每个元素的梯度H(n,m)。

- 通过链式法则分解为两部分:E(n,m)(损失对累积代价D(n,m)的梯度)和G(n,m)(累积代价D(n,m)对本地代价C(n,m)的梯度)。

E(n,m)的计算特别考虑了当前单元可能同时作为“后续单元的来源”和“结束边界单元的直接贡献者”这两个角色。G(n,m)则利用前向过程中保存的回溯张量B来聚合来自各个前驱步和起始边界贡献的梯度。

- 输出:一个与输入代价矩阵C同尺寸的梯度矩阵H,可用于反向传播更新模型参数。

关键设计选择:

- 边界权重 (

w_start,w_end):这是防止路径坍缩的关键。论文指出,无权重的subSDTW会使对齐路径坍缩到允许范围内的最短路径(如图3b)。通过为边界单元分配与预期路径长度成比例的权重(如图3c),可以惩罚过短的路径,从而鼓励更合理的对齐。 - 步权重 (

w_step):继承自先前工作,用于平衡不同对齐步(水平、垂直、对角线)的代价,提升训练稳定性。 - 软最小值参数

γ:控制近似硬最小值的平滑程度,影响对齐路径的“软硬”。

💡 核心创新点

- 可微分子序列对齐框架:首次将经典DTW中的子序列匹配思想扩展到可微分的SDTW框架中。这是最核心的贡献,解决了SDTW在实际应用中的刚性边界约束问题。

- 灵活的边界条件建模:明确将边界条件定义为代价矩阵中的单元集合

B_start和B_end,而非固定的起点(1,1)和终点(N,M),并通过引入边界权重来补偿路径长度差异,提供了建模边界不确定性的完整工具。 - 完整的梯度推导与实现:为subSDTW损失函数推导了高效的前后向动态规划递归公式(公式2-16),实现了端到端可训练,并提供了开源代码,极大降低了使用门槛。

- 针对边界权重的参数化方案:提出了一个基于预期路径长度和步权重的实用边界权重参数化方法(公式18-19),并在实验中证明了其有效性,使该方法能够真正用于训练。

🔬 细节详述

- 训练数据:

- 预训练:MAESTRO数据集(钢琴录音与强对齐MIDI)。

- 微调/实验:Beethoven钢琴奏鸣曲数据集 (BPSD)。通过匹配乐谱的四小节片段与音频创建弱对齐对。数据增强:通过在区间[-∆, ∆]内随机平移音频片段的起止点来模拟边界不匹配。

- 损失函数:subSDTW损失。本地代价函数为二元交叉熵 (BCE)。关键超参数:软最小值温度

γ = 0.1。 - 训练策略:

- 批大小:8。

- 优化器:Adam。

- 训练步数:5000步。

- 学习率、warmup等未具体说明,但提到了使用[17, 14]中的设置。

- 关键超参数:

- 步大小集合

S = {(1,0), (0,1), (1,1)},对应水平、垂直、对角步。 - 步权重

W_step = {0.1, 1.0, 1.0},为水平步赋予较低权重以提升稳定性。 - 模型:基于Onsets and Frames的单卷积堆栈架构,处理梅尔频谱图。具体层参数未说明。

- 步大小集合

- 训练硬件:论文中未具体说明GPU型号和数量,但提到了提供了“CUDA-compatible implementation”。

- 推理细节:论文聚焦于训练损失函数,未详细讨论推理时的解码策略。多音高估计通常基于阈值化模型输出帧进行。

- 正则化技巧:通过调整步权重(如降低水平步权重)来稳定训练,这继承自先前工作[14]。

📊 实验结果

论文核心实验在BPSD数据集上进行多音高估计任务。主要对比不同损失函数配置在不同边界偏移量∆下的性能。 关键对比表格(完整复现):

| 配置 | 边界偏移 (∆) | 精度 (Precision) | 召回率 (Recall) | F值 (F-measure) |

|---|---|---|---|---|

| Pretrained (基线) | - | 0.60 | 0.61 | 0.58 |

| Strong (强对齐基准) | - | 0.70 | 0.65 | 0.67 |

| SDTW | 0.0 s | 0.70 | 0.65 | 0.67 |

| 0.5 s | 0.70 | 0.64 | 0.66 | |

| 1.0 s | 0.70 | 0.61 | 0.65 | |

| 2.0 s | 0.72 | 0.57 | 0.63 | |

| subSDTW (无权重) | 0.5 s | 0.69 | 0.63 | 0.65 |

| 1.0 s | 0.73 | 0.53 | 0.61 | |

| 2.0 s | 0.77 | 0.28 | 0.41 | |

| subSDTW-W (加权) | 0.5 s | 0.69 | 0.66 | 0.67 |

| 1.0 s | 0.69 | 0.66 | 0.67 | |

| 2.0 s | 0.70 | 0.63 | 0.66 |

关键结论:

- 无权重subSDTW的失败:当允许灵活边界但不加边界权重时(subSDTW),随着偏移量增大,模型倾向于选择最短的对齐路径,导致召回率急剧下降(在∆=2.0s时降至0.28),F值崩溃。这验证了边界权重的必要性。

- 加权subSDTW的鲁棒性:通过精心设计的边界权重(subSDTW-W),即使在∆=±2.0秒的大偏移下,模型仍能维持0.66的F值,仅略低于使用完美强对齐数据训练的基准(0.67)。这证明了该方法能有效抵御边界噪声。

- 标准SDTW的相对稳定性:标准SDTW在偏移下性能下降较慢,论文解释为随机偏移的平均效应使其“错误假设”仍能给出尚可结果,但其性能天花板明显低于加权subSDTW。

(图3: 不同配置下的边界条件与权重设置示意图。a) 标准SDTW:固定起点终点。b) 无权重subSDTW:允许灵活边界,权重均匀。c) 加权subSDTW (subSDTW-W):灵活边界,并根据预期路径长度设置递增/递减的权重,以惩罚过短路径。)

(图3: 不同配置下的边界条件与权重设置示意图。a) 标准SDTW:固定起点终点。b) 无权重subSDTW:允许灵活边界,权重均匀。c) 加权subSDTW (subSDTW-W):灵活边界,并根据预期路径长度设置递增/递减的权重,以惩罚过短路径。)

⚖️ 评分理由

- 学术质量:6.5/7:创新点清晰且解决真实问题,数学推导严谨,实验设计充分且说服力强。扣分点在于实验任务相对单一(仅多音高估计),缺乏跨任务(如语音识别)的广泛验证,使得“通用损失函数”的普适性未得到最充分证明。

- 选题价值:1.0/2:选题切中弱监督学习中的实际痛点,方法具有较好的可迁移性和应用潜力。但由于聚焦于一个相对垂直的MIR子任务,其在更大范围的影响力和关注度可能受限。

- 开源与复现加成:+0.5/1:提供了包含所有实验代码的GitHub仓库,极大便利了后续研究者使用和验证该方法,这是重要的加分项。