📄 Speaking Clearly: A Simplified Whisper-Based Codec for Low-Bitrate Speech Coding

#语音编码 #语音增强 #预训练 #Whisper模型

✅ 7.5/10 | 前25% | #语音编码 | #预训练 | #语音增强 #Whisper模型

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Xin Zhang(武汉理工大学计算机与人工智能学院)

- 通讯作者:Lin Li(武汉理工大学计算机与人工智能学院)

- 作者列表:Xin Zhang(武汉理工大学计算机与人工智能学院)、Lin Li(武汉理工大学计算机与人工智能学院)、Xiangni Lu(武汉理工大学计算机与人工智能学院)、Jianquan Liu(NEC Corporation)、Kong Aik Lee(香港理工大学电机及电子工程学系)

💡 毒舌点评

亮点是思路清奇,反其道而行之,没有在声学编解码器上叠加语义监督,而是把一个现成的ASR模型(Whisper)“改造”成编解码器,通过简单的架构简化(去掉GELU和位置编码)就解锁了其声学建模能力,实验结果也相当能打。短板在于,这种“简化”本质上是针对特定任务(编解码)的工程化调整,其理论解释(位置编码影响注意模式、GELU抑制频谱细节)略显粗浅,且论文声称的“State-of-the-art”结论仅在英语数据集(LibriSpeech)上得到验证,对于多语言、噪声环境等更复杂场景的泛化能力未做探讨。

🔗 开源详情

- 代码:是,提供GitHub仓库链接:https://github.com/ZhangXinWhut/SimWhisper-Codec。

- 模型权重:论文中未明确提及是否公开简化后的Whisper编码器或完整编解码器的预训练权重。

- 数据集:使用的是公开的LibriSpeech和LJSpeech数据集,但未提供处理后的数据或特定数据集的链接。

- Demo:论文中未提及在线演示。

- 复现材料:论文详细说明了模型架构、训练数据、损失函数、训练策略(优化器、学习率、步数)和关键超参数(模型大小、FSQ配置)。这些信息对于复现是充足的,但未提供具体的配置文件或检查点下载链接。

- 论文中引用的开源项目:提到了依赖或对比的开源项目,包括:HiFiGAN、Vocos、FSQ(来自“Low frame-rate speech codec”),以及基线模型EnCodec, DAC-RVQ3, SpeechTokenizer, Mimi-RVQ8, BigCodec, XCodec2.0, XY-Tokenizer等。

📌 核心摘要

问题:当前语音编解码器面临语义内容保留和声学保真度之间的固有冲突,尤其在低比特率下更为突出。主流方法通过复杂的外部语义监督(如HuBERT蒸馏、多任务学习)来缓解此冲突。

方法核心:本文提出相反的思路:从一个已经具备语义能力的模型(Whisper ASR模型)出发,通过目标明确的架构简化(移除卷积前端的GELU激活函数和Transformer中的绝对位置编码),使其适配高保真声学重建任务。基于此发现,提出了SimWhisper-Codec。

与已有方法相比新在哪里:新在思路(“语义优先”而非“声学增强”)。无需额外的语义监督信号,直接利用冻结的、简化后的Whisper编码器作为强大的特征提取器,结合FSQ量化和对称解码器,实现单阶段训练。

主要实验结果:在LibriSpeech test-clean上,SimWhisper-Codec以1.1 kbps的极低比特率实现了优秀的性能。关键指标对比见下表:

模型 比特率 (BPS) WER ↓ SIM ↑ STOI ↑ PESQ-NB ↑ PESQ-WB ↑ 语义监督 Mimi-RVQ8 1.1k 3.24 0.73 0.90 2.79 2.24 是 XCodec2.0 0.8k 2.61 0.82 0.92 3.04 2.43 是 XY-Tokenizer 1.0k 2.46 0.85 0.92 3.10 2.50 是 SimWhisper-Codec 1.1k 2.75 0.83 0.93 3.29 2.72 否 该模型在声学质量(PESQ)上超越了所有对比的基线模型,在语义保留(WER)上也与需要复杂监督的基线模型相当。

实际意义:为构建低比特率、高质量的语音编解码器提供了一种更简洁、高效的新范式,有望简化语音大模型前端的设计。

主要局限性:1) 极低比特率(1.1 kbps)可能限制了在高保真音乐或超宽带语音场景的应用;2) 实验仅在干净的英语语音上验证,对多语言、噪声环境等鲁棒性未做充分评估;3) 简化机制的理论解释仍需更深入的分析。

🏗️ 模型架构

SimWhisper-Codec是一个端到端的神经语音编解码器,其整体架构如图1所示。模型主要由五个模块组成:简化的Whisper编码器、下采样器、量化器、上采样器和对称解码器,最后通过Vocos声码器生成波形。

图1:SimWhisper-Codec 架构概览。

图1:SimWhisper-Codec 架构概览。

编码器 (Encoder):初始化自预训练的Whisper-small模型(12层Transformer,768维隐藏状态,12头注意力)。进行了两处关键修改:

- 移除卷积前端GELU激活:将前两个卷积层中的GELU激活函数移除,使其变为纯线性变换,以更好地保留输入信号的声学细节。

- 移除绝对位置编码:完全移除Transformer块中的绝对位置编码,使注意力机制更灵活,能够捕捉内容驱动的交互,而非位置固定的模式。 编码器在训练过程中被冻结,仅作为特征提取器。它接收16kHz音频(通过25ms窗和10ms步长提取50Hz特征序列),输出高维特征序列。

下采样器 (Downsampler):负责压缩编码器输出。首先通过堆叠连续帧将时间分辨率从50Hz降低到12.5Hz(4倍下采样)。然后,使用带有膨胀卷积(膨胀率为1, 3, 9)和Snake激活函数的残差块,将特征维度从768逐步压缩到32。

量化器 (Quantizer):采用有限标量量化(FSQ)模块。FSQ避免了传统VQ的码本坍塌问题,无需复杂的训练机制(如EMA、承诺损失)。根据配置(8个码本,每个码本4个维度,水平设为[8,7,6,6]),实现了1.1 kbps的比特率。

上采样器 (Upsampler):与下采样器结构对称。先通过膨胀卷积和Snake激活的残差块处理特征,然后通过反堆叠将特征维度扩展回768,时间分辨率恢复到50Hz。

解码器 (Decoder):与编码器结构对称,但将卷积层替换为转置卷积层。它从上采样器的输出重建梅尔频谱图。最后,一个24层的Vocos模型将梅尔频谱图转换为16kHz的音频波形。

数据流:原始音频 -> Whisper编码器(冻结)-> 下采样器 -> FSQ量化(信息瓶颈)-> 上采样器 -> 对称解码器 -> Vocos声码器 -> 重建音频。

💡 核心创新点

- “语义优先”的编解码器设计哲学:与传统方法(先构建声学编解码器,再通过外部模型注入语义信息)相反,本文直接从一个强大的语义模型(Whisper)出发,通过简化使其适应声学重建任务,从而天然地平衡了语义与声学信息。这为解决语义-声学冲突提供了新思路。

- 针对声学重建的Whisper架构简化:通过严谨的实验分析(见表1和图2),发现并移除了对声学重建有害的两个组件:卷积前端的GELU激活和Transformer的绝对位置编码。这一简化不仅提升了声学质量,也验证了ASR模型中为追求不变性而设计的结构可能损害声学保真度。

- 无需外部语义监督的单阶段训练:利用简化后Whisper编码器的内在语义能力,结合FSQ量化和对称的生成对抗训练(LSGAN),实现了端到端的单阶段训练。这避免了依赖HuBERT、WavLM等外部语义模型进行蒸馏或多任务学习的复杂流程,简化了训练范式。

🔬 细节详述

- 训练数据:使用LibriSpeech完整训练集(960小时英文语音),数据重采样至16kHz,并随机裁剪为2秒片段。

- 损失函数:采用GAN训练目标,总损失为

L_G = λ_recon L_recon + λ_adv L_adv + λ_feat * L_feat。L_recon:多尺度重构损失,在7个不同的STFT尺度(FFT size 2^k, k=5…11)上计算原始与重建音频梅尔频谱图的L1损失。L_adv:对抗损失,采用LSGAN目标,判别器包含多周期判别器(MPD)和多尺度STFT判别器(MS-STFTD)。Lfeat:特征匹配损失,计算判别器中间层特征图的L1损失。 论文未明确给出λ_recon,λ_adv,λ_feat的具体权重值。

- 训练策略:

- 优化器:AdamW,β1=0.8,β2=0.99,权重衰减0.01。

- 学习率:使用余弦退火调度,从1e-4降至0,包含10k步的预热。

- 批量大小:64(单卡,梯度累积为1)。

- 训练步数:1,000,000步。

- 关键超参数:

- 编码器/解码器:基于Whisper-small,12层Transformer,768维,12头。

- 下采样率:4倍(50Hz -> 12.5Hz)。

- FSQ配置:8个码本,每个4维,水平为[8,7,6,6],实现1.1 kbps比特率。

- 声码器:Vocos,24层,hop size 160。

- 训练硬件:单块NVIDIA H100 GPU。

- 推理细节:论文未提及特殊的解码策略(如温度、beam size),推理流程即为前向传播。流式设置未说明。

- 正则化技巧:论文未明确提及除GAN训练本身外的其他正则化方法。

📊 实验结果

论文在LibriSpeech test-clean(2620条语音)上进行了全面评估,对比了多个主流低比特率编解码器基线。关键对比结果见下表:

| 模型 | 比特率 (BPS) | 帧率 | 语义监督 | WER ↓ | SIM ↑ | STOI ↑ | PESQ-NB ↑ | PESQ-WB ↑ |

|---|---|---|---|---|---|---|---|---|

| Ground Truth | - | - | - | 2.16 | 1.00 | 1.00 | 4.55 | 4.64 |

| EnCodec | 1.5k | 75 Hz | No | 5.62 | 0.60 | 0.85 | 1.94 | 1.56 |

| DAC-RVQ3 | 1.5k | 75 Hz | No | 7.80 | 0.45 | 0.76 | 1.82 | 1.43 |

| SpeechTokenizer | 1.0k | 50 Hz | Yes | 4.21 | 0.37 | 0.70 | 1.42 | 1.15 |

| BigCodec | 1.04k | 80 Hz | No | 2.92 | 0.84 | 0.93 | 3.26 | 2.68 |

| Mimi-RVQ8 | 1.1k | 12.5 Hz | Yes | 3.24 | 0.73 | 0.90 | 2.79 | 2.24 |

| XCodec2.0 | 0.8k | 50 Hz | Yes | 2.61 | 0.82 | 0.92 | 3.04 | 2.43 |

| XY-Tokenizer | 1.0k | 12.5 Hz | Yes | 2.46 | 0.85 | 0.92 | 3.10 | 2.50 |

| SimWhisper-Codec | 1.1k | 12.5 Hz | No | 2.75 | 0.83 | 0.93 | 3.29 | 2.72 |

关键结论:

- 声学质量领先:SimWhisper-Codec在PESQ-NB(3.29)和PESQ-WB(2.72)上取得了最佳成绩,超过了声学质量很强的BigCodec(3.26, 2.68),且STOI(0.93)与之持平。

- 语义保留有竞争力:WER为2.75,与依赖复杂语义监督的XY-Tokenizer(2.46)和XCodec2.0(2.61)处于同一水平,显著优于无监督的EnCodec和DAC。

- 无需外部监督:以更低的复杂度和无需外部语义模型,实现了与需要监督的SOTA模型可比甚至更优的性能。

架构消融实验:如表3所示,移除GELU和位置编码的组合带来了全方位的性能提升,验证了设计选择的有效性。

| 变体 | WER ↓ | SIM ↑ | STOI ↑ | PESQ-NB ↑ | PESQ-WB ↑ |

|---|---|---|---|---|---|

| Whisper encoder (baseline) | 5.95 | 0.78 | 0.85 | 1.95 | 1.68 |

| – 仅移除绝对PE | 5.42 | 0.80 | 0.87 | 2.34 | 1.96 |

| – 仅移除stem GELUs | 3.74 | 0.81 | 0.89 | 2.51 | 2.10 |

| Ours: 移除两者 | 2.75 | 0.83 | 0.93 | 3.29 | 2.72 |

声学属性保留分析:如图3所示,通过在THCHS-30数据集上的音高(F0)追踪实验,简化后的Whisper编码器在所有层都保持了稳定的皮尔逊相关系数(PCC ≈0.76),而标准Whisper编码器在6层后性能显著下降。这证明简化操作更好地保留了对高质量合成至关重要的韵律信息。

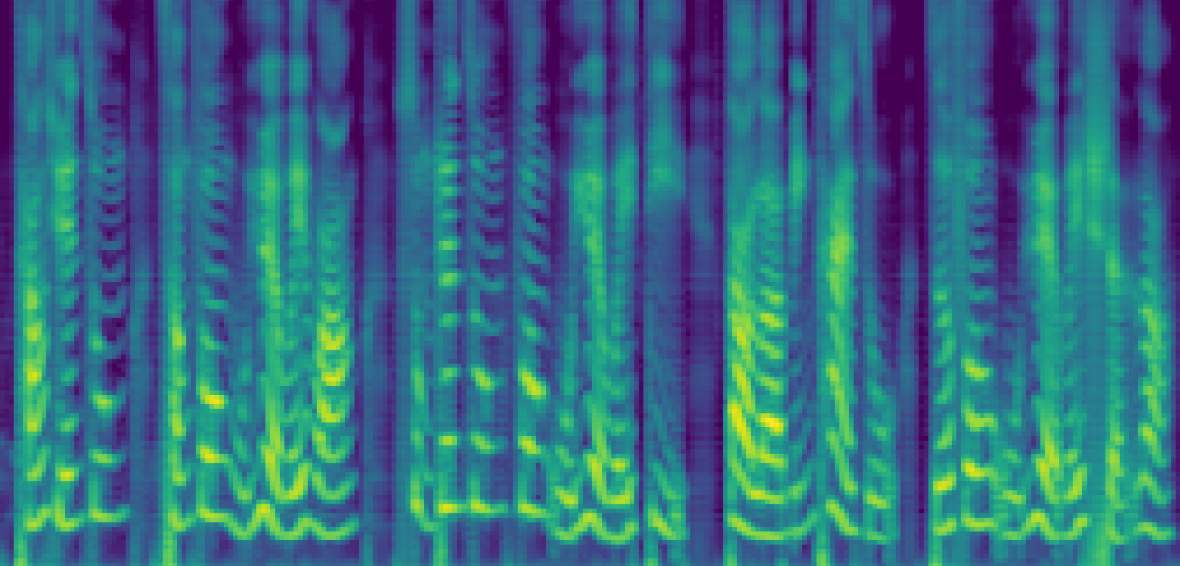

图2:自注意力图可视化。展示了有无位置编码时,模型对重复结构“one, two, three, four, four, three, two, one”的注意力模式差异。移除位置编码后,对角线主导性降低,注意力更灵活。

图2:自注意力图可视化。展示了有无位置编码时,模型对重复结构“one, two, three, four, four, three, two, one”的注意力模式差异。移除位置编码后,对角线主导性降低,注意力更灵活。

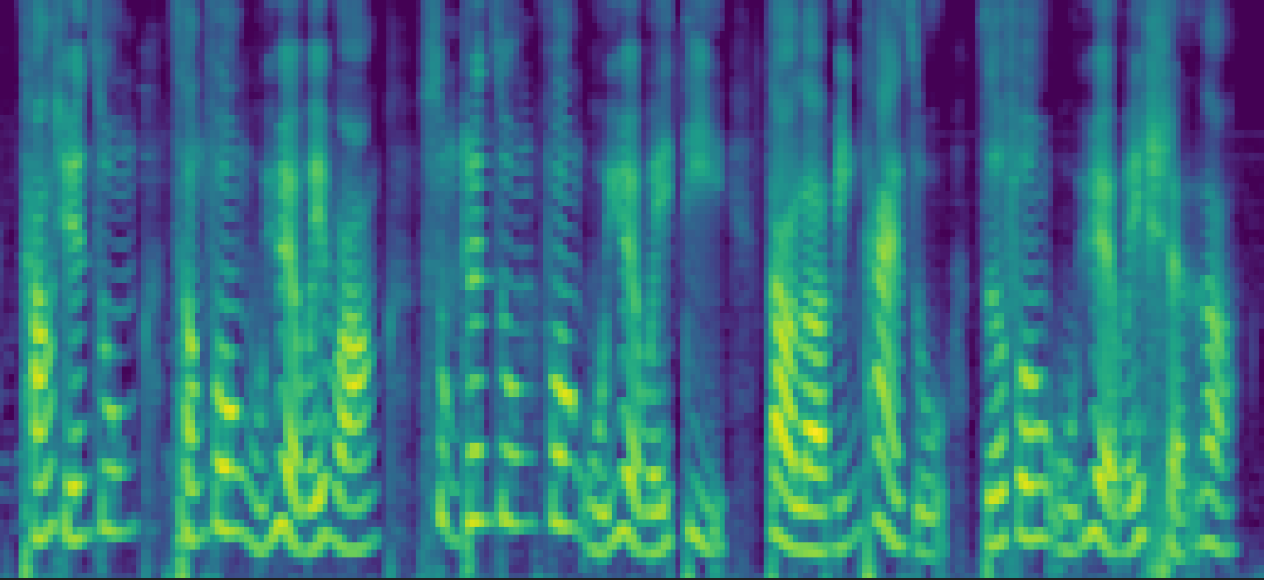

图3:音高追踪性能。简化Whisper编码器(蓝线)在各层均保持稳定且较高的F0预测相关性,而标准Whisper编码器(红线)性能随层深入而下降。

图3:音高追踪性能。简化Whisper编码器(蓝线)在各层均保持稳定且较高的F0预测相关性,而标准Whisper编码器(红线)性能随层深入而下降。

⚖️ 评分理由

- 学术质量(5.5/7):论文提出的“语义优先”思路具有创新性,通过实验证明了其有效性。架构简化基于系统的实验分析,技术路线正确。实验设计合理,与多个代表性基线进行了公平对比,结果具有说服力。但创新更多体现在思路上的转换和针对现有模型的“修剪”,而非提出全新的架构或算法,技术深度中等。

- 选题价值(1.5/2):研究方向是当前语音AI的热点��低比特率语音编解码),对Speech LLM、实时通信等领域有直接的应用价值。提出的简化思路为社区提供了新的视角,具有较好的启发性和潜在影响力。

- 开源与复现加成(0.5/1):论文提供了代码仓库链接,这是一个明确的加分项,有助于研究者复现和验证其工作。然而,论文未明确提及是否开源简化的预训练Whisper模型权重,以及完整的训练脚本和超参数配置,这会给完全复现带来一定障碍。