📄 Spatial-CLAP: Learning Spatially-Aware Audio–Text Embeddings for Multi-Source Conditions

#空间音频 #声源定位 #对比学习 #跨模态

🔥 8.5/10 | 前25% | #空间音频 | #对比学习 | #声源定位 #跨模态

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.8 | 置信度 高

👥 作者与机构

- 第一作者:Kentaro Seki(The University of Tokyo, Keio University)

- 通讯作者:未明确说明

- 作者列表:Kentaro Seki(The University of Tokyo, Keio University)、Yuki Okamoto(未说明具体单位,根据作者顺序推测与第一作者同组)、Kouei Yamaoka(未说明具体单位)、Yuki Saito(未说明具体单位)、Shinnosuke Takamichi(The University of Tokyo, Keio University)、Hiroshi Saruwatari(The University of Tokyo, Keio University)

💡 毒舌点评

亮点在于其设计巧妙且动机清晰:通过内容感知空间编码器将空间信息与内容信息耦合,再用空间对比学习(SCL)这一“硬负例”策略显式强迫模型学习正确的空间对应关系,直击多声源建模的核心痛点。短板则在于其实验环境的“温室化”:所有音频均由模拟房间脉冲响应和AudioCaps数据集构建,DoA仅限于5个离散类别,且未与更多真实的多声源数据集或更复杂的空间编码方法(如高阶Ambisonics)进行比较,其真实世界泛化能力仍存疑。

🔗 开源详情

- 代码:论文提供了公开的代码仓库链接:https://github.com/sarulab-speech/SpatialCLAP。

- 模型权重:论文中提到“we release our code and pretrained models”,即会公开预训练模型。

- 数据集:使用了公开的AudioCaps 2.0数据集,空间增强部分的模拟代码和RIR配置应在开源仓库中提供。

- Demo:论文中未提及在线演示。

- 复现材料:论文提供了详细的训练设置(学习率、batch size、epoch)、模型架构描述(HTSAT, SELDNet, RoBERTa)和数据集构建方法,复现信息较为充分。

- 论文中引用的开源项目:

- pyroomacoustics:用于模拟房间和RIR。

- HTS-AT:作为内容编码器的基础模型。

- CLAP预训练模型:用于初始化内容编码器。

- SELDNet:作为空间编码器的基础模型并进行预训练。

- RoBERTa:作为文本编码器。

- GPT-2:用于下游任务(空间音频描述)的解码器。

📌 核心摘要

- 解决的问题:现有的音频-文本嵌入模型(如CLAP)主要针对单声道/单声源,无法有效捕捉和利用音频中的空间信息,尤其在多声源条件下,无法正确建立“什么声音在哪里”的对应关系(排列问题)。

- 方法核心:提出Spatial-CLAP模型。其音频编码器包含一个内容编码器(CE) 和一个内容感知空间编码器(CA-SE)。CE从单声道音频(左右声道平均)提取内容特征;CA-SE则从立体声音频中提取与内容信息耦合的空间特征。二者输出拼接后通过MLP得到最终音频嵌入,与文本嵌入在共享空间中对齐。训练策略上引入了空间对比学习(SCL),通过构造交换空间位置的音频-文本对作为困难负样本,显式监督模型学习正确的内容-空间对应关系。

- 新颖之处:1) 架构创新:引入内容感知的空间编码器(CA-SE),解决了先前方法中内容与空间编码分离导致的排列问题。2) 训练范式创新:首次明确提出在多声源条件下训练空间感知的音频-文本嵌入模型,并设计了SCL策略来实现这一目标。

- 主要实验结果:在自建的多声源评估集上,Spatial-CLAP在检索(R@1)、空间分类和内容-空间分配准确率上均显著优于基线。例如,在2-声源条件下的内容-空间分配准确率,本文方法(Ours)达到81.69%,而传统方法(Conventional)仅为48.77%。下游任务“空间音频描述”的评估(见下表)也表明,本文方法在BLEU、CIDEr等常规指标和专门设计的空间指标(DW-SBERT, Spatial desc. accuracy)上均取得最佳成绩。在未见过的3-声源混合评估中,本文方法在内容-空间分配准确率上(Ours: 41.77%)远超传统单声源训练方法(Conventional: 16.31%,接近随机猜测)。

表2:空间音频描述任务评估结果

方法 BLEU ROUGE-L METEOR CIDEr SPICE SPIDEr BERTScore SBERT DW-SBERT Spatial desc. Monaural 0.0735 0.2823 0.1789 0.1986 0.1757 0.1871 0.3769 0.5520 0.2196 0.1770 Conventional 0.1329 0.3497 0.1984 0.2075 0.2416 0.2246 0.3898 0.5026 0.3620 0.6955 Structured 0.1323 0.3487 0.1997 0.2154 0.2418 0.2286 0.3899 0.5137 0.3630 0.6461 Ours 0.1463 0.3709 0.2135 0.2553 0.2658 0.2606 0.4152 0.5564 0.4144 0.7942 Ours (w/o SCL) 0.1455 0.3685 0.2121 0.2482 0.2589 0.2536 0.4118 0.5456 0.4071 0.7922 - 实际意义:为构建能同时理解“什么声音”和“在哪里”的通用音频-文本表示模型奠定了基础,推动了空间音频理解、检索与生成(如空间音频描述)等下游任务的发展。

- 主要局限性:1) 数据局限:实验基于AudioCaps和模拟的房间脉冲响应(RIR)构建,数据集规模和场景复杂性有限。2) 空间建模简化:仅考虑了静态的、有限类别(5类)的DoA,未涉及声源移动、复杂声学环境或更高阶的空间表示(如B格式)。3) 评估局限:评估主要集中在检索和自定义的描述任务,缺乏在更通用的、公认的空间音频基准测试上的比较。

🏗️ 模型架构

Spatial-CLAP的整体架构是一个双塔模型,由音频编码器和文本编码器组成,最终输出对齐的嵌入向量。

图1展示了传统方法与本文方法在音频编码器设计上的核心区别。(a)传统方法将内容编码器和空间编码器独立输出,导致多声源下的排列问题;(b) Spatial-CLAP的内容感知空间编码器(CA-SE)使空间编码与内容信息耦合。

图1展示了传统方法与本文方法在音频编码器设计上的核心区别。(a)传统方法将内容编码器和空间编码器独立输出,导致多声源下的排列问题;(b) Spatial-CLAP的内容感知空间编码器(CA-SE)使空间编码与内容信息耦合。

音频编码器:

- 输入:立体声音频信号。

- 内容编码器(CE):首先将立体声的左右声道取平均,得到单声道信号。然后将其输入到预训练的单声道CLAP音频编码器(采用HTS-AT架构)中,输出一个768维的内容嵌入向量。此设计旨在复用大规模单声道数据上预训练的丰富内容知识。

- 内容感知空间编码器(CA-SE):直接以立体声音频为输入,其架构改编自一个为声源定位与检测(SELD)任务预训练的网络(SELDNet)。该编码器经过预训练,能够生成与声源内容(事件活动)和空间信息(DoA)都耦合的空间嵌入。本文中,将其替换输出层为时间平均池化,输出一个512维的空间嵌入向量。

- 特征融合:将CE输出的768维向量和CA-SE输出的512维向量进行拼接。拼接后的向量通过一个两层的多层感知机(MLP,隐藏层512维,ReLU激活),最终输出一个512维的、统一的音频嵌入向量。

文本编码器:采用在大规模文本语料上预训练的RoBERTa-base模型,经过微调以输出固定维度的文本嵌入,并与音频嵌入在共享空间中对齐。

关键设计选择:CA-SE是核心创新点。它被“内容感知”地预训练,意味着其学习的空间特征本身就与声音事件相关,从而在架构上保证了内容与空间信息的耦合,从源头缓解了排列问题。

💡 核心创新点

- 内容感知空间编码器(CA-SE):针对传统方法中内容与空间编码分离导致多声源下信息错配的局限,本文设计了CA-SE。它通过在一个能感知内容的声源定位任务(SELD)上进行预训练,确保其输出的空间嵌入与具体的声音事件绑定,从而实现了内容与空间信息的内在耦合。

- 空间对比学习(SCL):这是一个创新的训练策略。它通过在训练批次中主动构造“排列错误”的音频-文本对作为困难负样本(例如,交换两个声源的位置信息),显式地监督模型去学习并强化正确的“声音-位置”对应关系。这迫使模型超越简单的特征匹配,去理解更深层次的空间语义一致性。

- 针对多声源条件的训练与评估范式:不同于以往大多在单声源数据上训练和评估空间音频模型,本文明确将训练和评估重点放在多声源场景。这不仅解决了实际应用中的核心难题,其对比实验也揭示了单声源训练范式在多声源任务上的根本性缺陷。

🔬 细节详述

- 训练数据:

- 数据集:基于AudioCaps 2.0数据集(单声道音频-文本对)构建。训练集91,256个样本,验证集2,475个,测试集975个。

- 空间增强:使用pyroomacoustics库模拟440个不同的房间环境(混响时间130-260ms,16kHz采样率),生成房间脉冲响应(RIR)。将单声道音频与不同位置的RIR卷积,生成立体声音频,并在描述文本中添加对应的位置描述(“front-left”, “front”, “front-right”, “left”, “right”五类)。

- 多声源构建:将两个或多个已添加空间信息的立体声音频信号混合,并将它们对应的文本描述拼接,构成多声源训练样本。

- 损失函数:采用标准的In-batch InfoNCE对比损失。在SCL策略中,一个批次包含正常的单/双声源样本和通过SCL构造的排列错误的双声源样本,所有样本共同参与InfoNCE损失的计算。

- 训练策略:

- 优化器:Adam。

- 学习率:1e-5。

- 批次大小:128(包含64个单声源样本和64个由32对双声源样本经SCL变换得到的样本)。

- 训练轮数:50个epoch。

- 模型微调:音频编码器的所有参数(包括预训练的CE和CA-SE)以及文本编码器(RoBERTa)全部参与微调。

- 关键超参数:最终音频嵌入维度512;CE嵌入维度768;CA-SE嵌入维度512;融合MLP隐藏层维度512。

- 训练硬件:论文中未提供具体GPU型号和训练时长信息。

- 推理细节:论文中未提供。

- 正则化:论文中未明确提及使用Dropout等正则化技巧。

📊 实验结果

论文在三个维度进行了评估:嵌入质量、下游任务和泛化能力。

- 嵌入质量评估 (表1)

表1:基于嵌入的评估结果

方法 R@1 (fixed-RIR) R@1 (1-src) R@1 (2-src) Spatial classification (1-src) Spatial classification (2-src) Content-space assignment A2T T2A A2T T2A A2T T2A Monaural 22.02% 21.60% 4.81% 5.33% 1.66% 2.07% Conventional 16.87% 16.67% 16.60% 17.10% 4.16% 4.98% Structured 17.28% 17.90% 17.12% 18.89% 4.22% 4.85% Ours 23.25% 19.24% 20.78% 18.46% 20.79% 21.34% Ours (w/o SCL) 20.47% 19.44% 20.33% 18.85% 18.26% 18.43% Ours (w/o CLAP) 6.48% 5.25% 6.36% 5.84% 6.06% 6.16% Ours (w/o SELD) 17.59% 17.80% 18.19% 17.08% 15.04% 16.42%

- 结论:在仅含内容的检索(fixed-RIR)上,Ours略优于Monaural。在涉及空间的检索(1-src)和多声源检索(2-src)上,Ours均取得最佳。Content-space assignment 指标(在2-声源混合中正确配对“声音-位置”的比例)是核心,Ours达到81.69%,远超Conventional的48.77%,证明了其解决排列问题的有效性。消融实验显示,去除SCL、CLAP预训练或SELD预训练均会导致性能下降。

- 下游任务:空间音频描述 (表2)

- 结论:Ours在所有常规指标(BLEU, CIDEr等)和空间指标(DW-SBERT, Spatial desc.)上均达到最佳。特别是在空间描述正确率(Spatial desc.)上,Ours达到79.42%,比Conventional(69.55%)和Monaural(17.70%)有显著提升。这证明其学习的嵌入能有效支撑需要空间感知的生成任务。

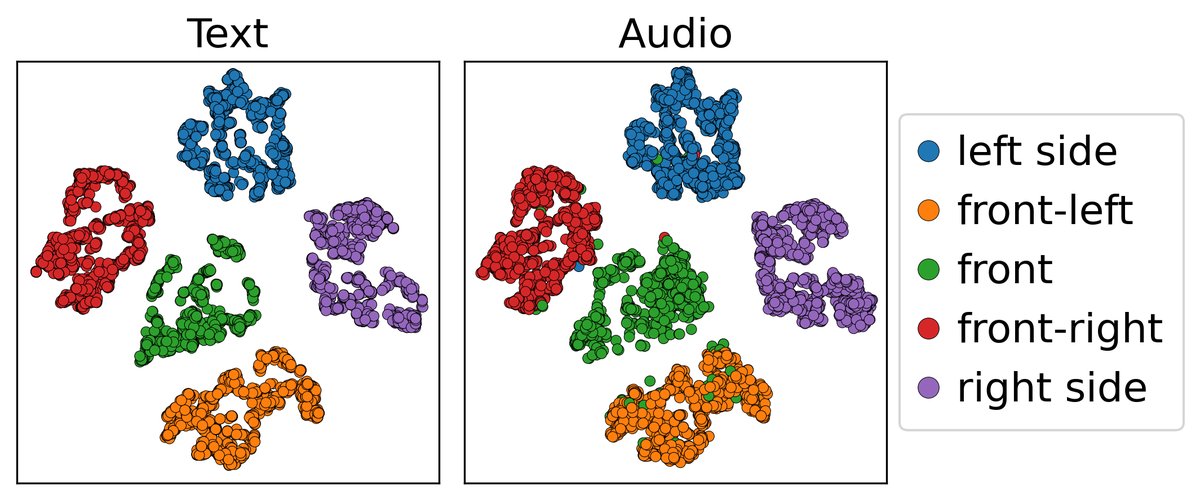

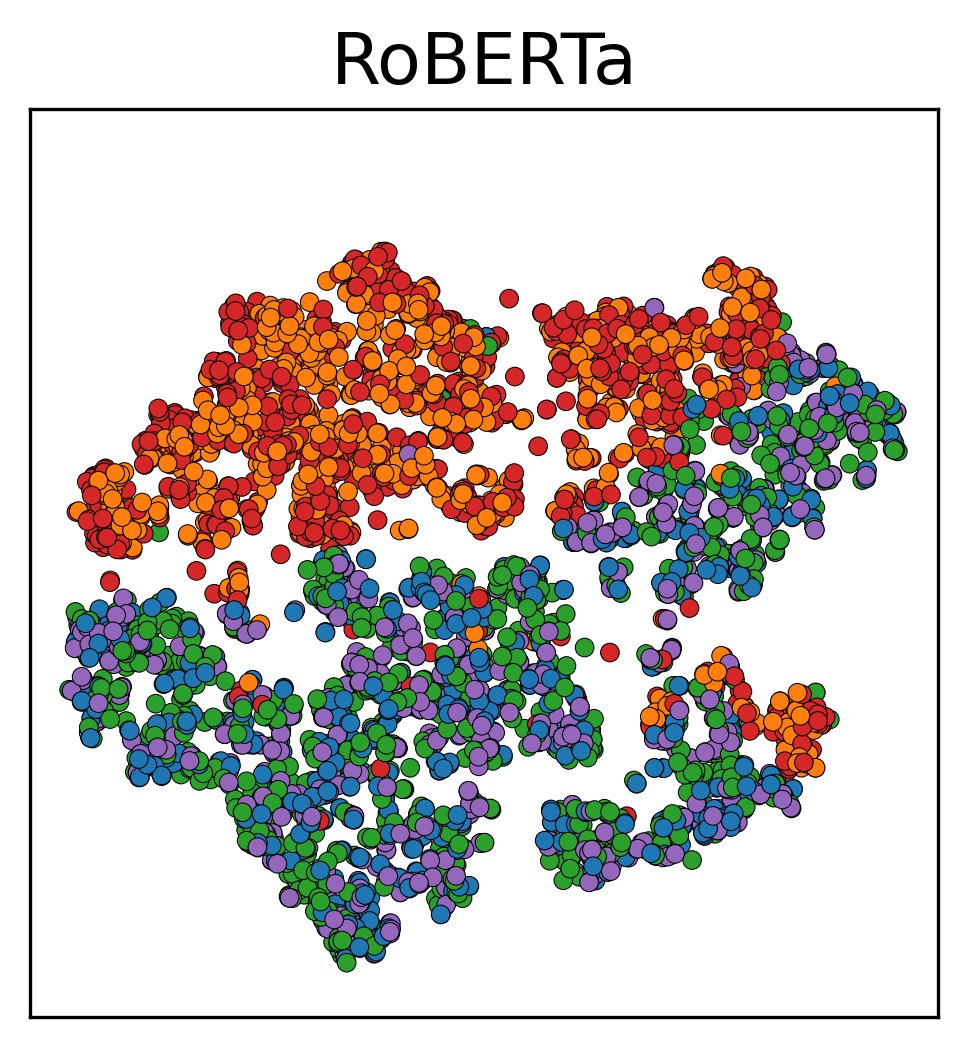

- 嵌入可视化 (图3)

图3展示了在单声源条件下,原始文本编码器(RoBERTa)与本文模型(Ours)生成的音频和文本嵌入的t-SNE可视化。

图3展示了在单声源条件下,原始文本编码器(RoBERTa)与本文模型(Ours)生成的音频和文本嵌入的t-SNE可视化。

- 结论:RoBERTa的嵌入在空间类别上混合、无序;而Ours的嵌入形成了按空间类别清晰分离的聚类,表明对比学习过程成功地在音频-文本共享空间中凸显并组织了空间信息。

- 泛化至三声源

- 内容-空间分配准确率(从6种可能排列中找出唯一正确的一种):Conventional方法表现接近随机(16.31%,随机基线为16.67%);Ours (w/o SCL) 为34.31%;完整的Ours达到41.77%。这表明在多声源数据上训练的模型能更好地泛化到更复杂的多声源场景。

⚖️ 评分理由

- 学术质量:6.0/7。论文动机明确,创新点(CA-SE, SCL, 多声源训练范式)扎实且环环相扣。技术实现正确,消融实验设计严谨,能够有力支撑各组件的有效性。主要扣分点在于实验环境的简化(模拟数据、有限DoA类别)限制了结论的普适性和说服力上限。

- 选题价值:1.5/2。研究方向(多声源空间音频-文本嵌入)非常前沿且重要,是音频理解和交互领域尚未充分解决的难题。本工作提出了首个系统的解决方案,具有明确的学术价值和潜在应用前景。但当前实现相对初步,距离真实世界的复杂场景应用尚有距离。

- 开源与复现加成:0.8/1。论文提供了开源代码和模型链接,训练细节(超参数、数据集构建方法)公开,具备良好的可复现性。代码仓库的具体质量、文档完整性和社区维护情况需额外考察,但论文中提供的信息已足够支撑基础复现。