📄 Sparse-View Visual-Acoustic Latent Learning for Novel-View Audio Synthesis

#空间音频 #多模态模型 #自监督学习 #音视频

✅ 7.5/10 | 前25% | #空间音频 | #多模态模型 | #自监督学习 #音视频

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Yimu Pan (†Dolby Laboratories, ⋆宾夕法尼亚州立大学)

- 通讯作者:未说明

- 作者列表:Yimu Pan (†Dolby Laboratories, ⋆宾夕法尼亚州立大学), James Z. Wang (†宾夕法尼亚州立大学), Lie Lu (⋆Dolby Laboratories)

💡 毒舌点评

本文巧妙地将视觉几何表示(Plücker rays)引入声学特征学习,通过Transformer的潜空间注意力机制实现了“看声辨源”,在无需显式标注的情况下提升了稀疏视角合成的空间准确性。然而,其核心音频合成模块直接“拿来主义”ViGAS,虽然保证了公平对比,但也让人怀疑如果换成更强的端到端合成器,论文的创新性是否会被进一步稀释。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及是否公开。

- 数据集:使用了公开的数据集(Replay-NVAS, SoundSpaces-NVAS),但论文中未提供获取链接。

- Demo:未提及。

- 复现材料:论文仅提供了高层模型架构、损失函数公式和部分实验设置(如基于LVSM预训练),但缺失大量训练细节(优化器、学习率、具体超参数值、训练时长等),不足以支持完全复现。

- 论文中引用的开源项目:LVSM [9], ViGAS [7], SoundSpaces 2.0 [24], Gibson [25], LibriSpeech [26], VGGT [10], Parallel WaveGAN [23]等。

- 总体评估:论文中未提及具体的开源计划,复现信息不充分。

📌 核心摘要

- 问题:现有新视角音频合成(NVAS)方法大多依赖密集场景表示(如全景图)或需要显式的声源位置信息,这些条件在实际应用中难以获取且成本高昂。

- 方法核心:提出一个名为NVA-Former的视觉-声学Transformer。它以稀疏多视角的图像、相机位姿和音频作为输入,通过视觉分词器(利用Plücker射线嵌入)和声学分词器提取特征,并在Transformer的潜空间中联合处理。模型同时输出目标视角的视觉特征和声学特征,分别用于重建新视角图像和合成双耳音频。

- 创新点:与依赖声源位置的稀疏方法(如ViGAS)或需要密集输入的稠密方法(如AV-Cloud)不同,本文的方法在潜空间中通过共享的相机位姿信息,隐式地建立跨视角、跨模态的3D关联,从而无需声源位置信息。

- 实验结果:在真实世界数据集Replay-NVAS和合成数据集SoundSpaces-NVAS上,使用两个输入视角时,NVA-Former在衡量空间准确性的LRE指标(Replay-NVAS:0.671 vs ViGAS 0.800/1.112)和感知质量CDPAM指标(0.132 vs ViGAS 0.383/0.352)上均显著优于最强基线ViGAS,同时保持有竞争力的MAG和RTE性能。消融实验表明,视觉监督和深度监督对性能至关重要。

- 实际意义:显著降低了现实世界数据采集的门槛,使得仅用少量同步相机-麦克风对即可学习3D声学场景表示,为AR/XR等应用提供了一种更实用的NVAS解决方案。

- 局限性:模型依赖于预训练的视觉Transformer(LVSM)权重以获得良好的3D视觉理解能力。其核心创新点在于声学特征的学习,而最终的音频合成模块直接复用了先前工作(ViGAS),这可能限制了对其所学声学特征上限的完整评估。

🏗️ 模型架构

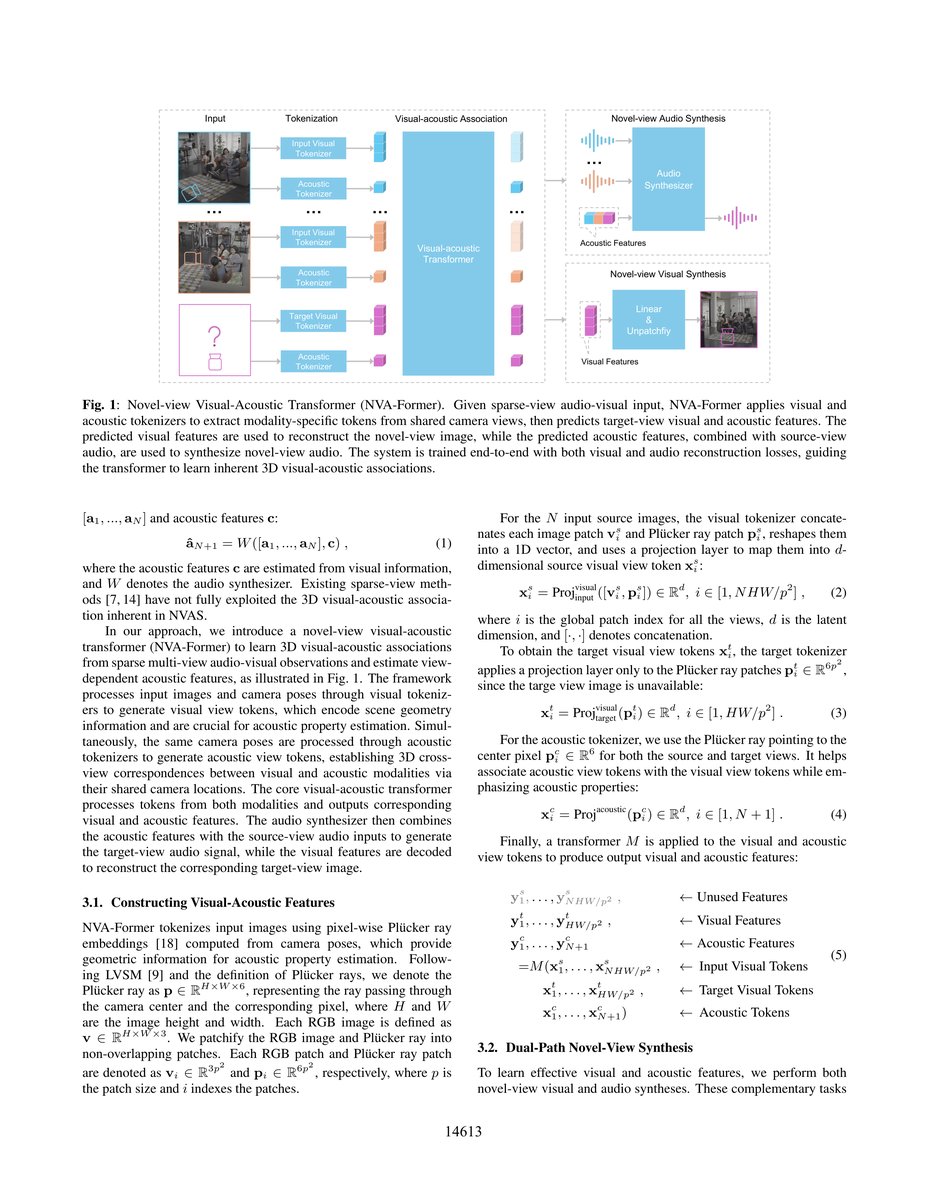

论文提出的模型称为Novel-view Visual-Acoustic Transformer (NVA-Former)。其整体流程如图1所示:

输入:稀疏多视角的RGB图像

v_1,...,v_N、对应的相机位姿、以及每个视角对应的双耳音频a_1,...,a_N。任务是为目标视角(第N+1个视角)合成双耳音频a_{N+1}。特征分词(Tokenization):

- 视觉分词器:

- 对于源视角图像,将每个图像块

v_i^s与由其相机位姿计算出的Plücker射线嵌入p_i^s(一个6维向量,编码了射线方向和原点)拼接,通过一个投影层映射为d维的源视觉视角令牌x_i^s。Plücker射线提供了每个像素的3D几何信息。 - 对于目标视角,由于没有目标图像,仅使用目标视角的Plücker射线嵌入

p_i^t,通过另一个投影层映射为目标视觉视角令牌x_i^t。

- 对于源视角图像,将每个图像块

- 声学分词器:

- 对于所有视角(源和目标),使用指向该视角图像中心像素的Plücker射线

p_i^c,通过一个投影层映射为d维的声学视角令牌x_i^c。这个设计使得声学令牌与对应的视觉令牌共享相同的相机位置信息,为跨模态关联提供了锚点。

- 对于所有视角(源和目标),使用指向该视角图像中心像素的Plücker射线

- 视觉-声学Transformer (M):

- 将所有源视觉令牌、目标视觉令牌和所有声学令牌拼接后,输入到一个标准的Transformer编码器-解码器架构中(论文中使用一个24层的解码器,基于LVSM预训练权重初始化)。

- Transformer通过自注意力机制处理这些令牌,学习不同视角、不同模态(视觉和声学)之间的依赖关系。

- 输出是处理后的视觉特征

y^s(源),y^t(目标) 和声学特征y^c(所有视角)。

- 双路径输出与损失:

- 新视角视觉合成:对目标视觉特征

y^t进行“反分块”和投影,通过Sigmoid激活重建RGB图像v̂_t。同时,预测深度图d̂_t。视觉损失L_visual包括像素级MSE损失、感知损失、深度尺度不变损失和梯度损失。 - 新视角音频合成:将所有视角的声学特征

y^c通过MLP融合成一个条件向量c。音频合成器W(复用ViGAS的结构)以c和源视角音频[a_1,...,a_N]为输入,合成目标视角音频â_{N+1}。音频损失L_audio使用多分辨率STFT幅度谱损失。

设计动机:关键在于通过共享的Plücker射线(视觉几何)为视觉和声学令牌建立联系,并通过Transformer在统一的潜空间中融合信息。视觉合成任务作为一个辅助监督信号,迫使Transformer学习更丰富的3D场景表示,这反过来有助于估计更准确的声学特征,从而在不依赖声源位置的情况下实现高质量的音频合成。

💡 核心创新点

提出稀疏视角视觉-声学Transformer (NVA-Former):

- 局限:之前的稀疏方法(如ViGAS)通常需要显式声源位置来关联视觉和声学信息;或者使用简单的融合策略,无法充分学习3D关联。

- 如何工作:设计了一个端到端的Transformer架构,直接处理稀疏多视角的视觉和声学令牌。通过共享的相机位姿(Plücker射线)作为桥梁,在Transformer内部通过自注意力机制隐式地建立跨视角、跨模态的3D关联。

- 收益:首次实现了在不需要声源位置信息、也不需要密集场景输入的情况下,从稀疏视角数据中学习有效的声学场景表示并进行新视角音频合成。

在潜空间中建立隐式3D视觉-声学关联:

- 局限:早期方法要么依赖外部模型估计RIR(需要源-接收器位置),要么在特征层面进行简单拼接或相加,难以建模复杂的场景几何与声学传播的对应关系。

- 如何工作:将视觉和声学特征都映射到同一个潜空间(通过统一的投影层和Transformer处理)。声学特征

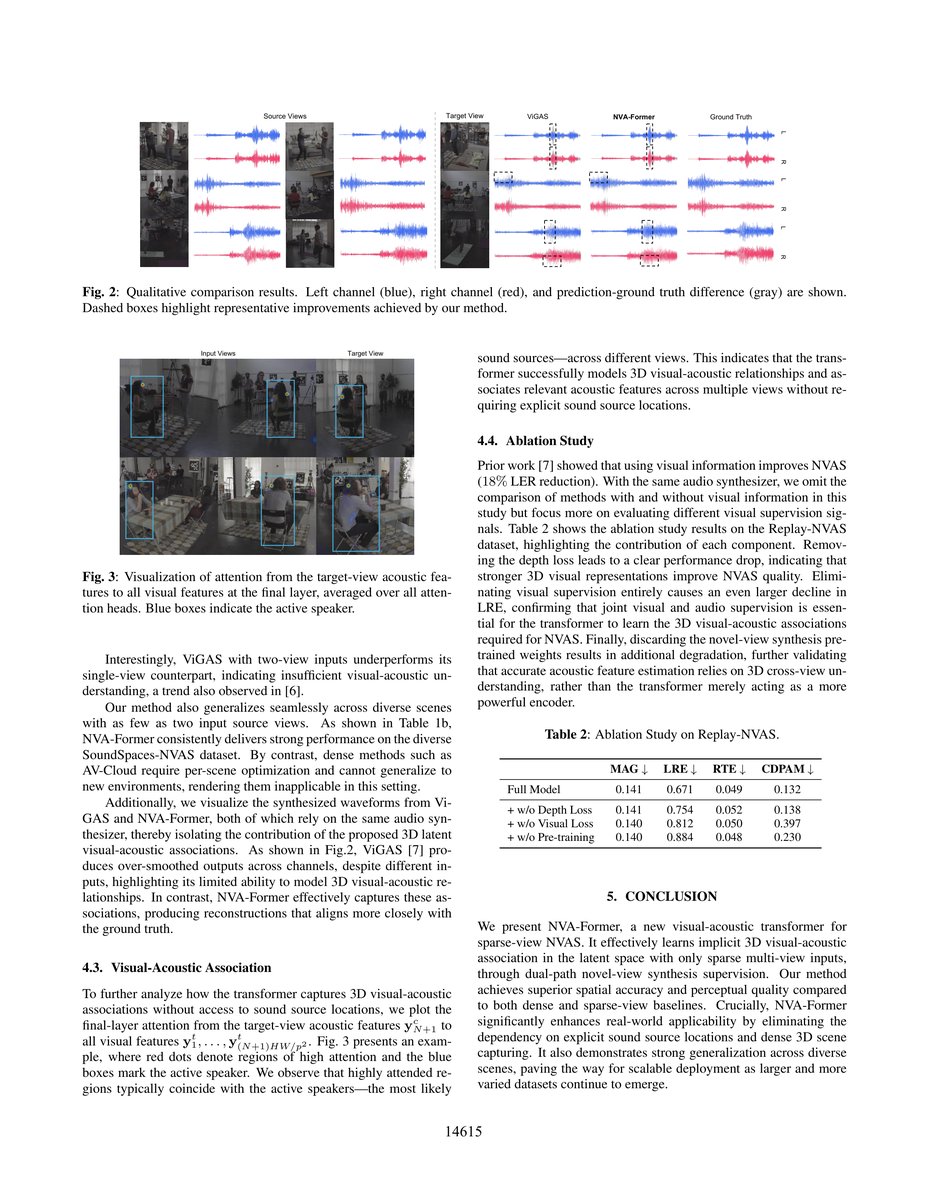

y^c直接作用于音频合成,而视觉特征y^t用于图像重建。论文通过注意力可视化(图3)证明,目标视角的声学特征会自动关注到视觉场景中“活跃说话人”(潜在声源)所在的区域。 - 收益:无需声源标注,模型自主学会了“哪里有声音”的视觉-声学映射,这是本方法能成功的核心机制。

通过双路径新视角合成任务进行联合监督:

- 局限:单独监督音频合成可能使模型过于关注频谱匹配,而忽视更本质的3D场景结构。纯视觉模型则无法建立与声音的联系。

- 如何工作:同时优化视觉重建损失(含深度)和音频合成损失。这两个任务共享同一个Transformer,梯度联合回传。

- 收益:视觉任务(特别是深度预测)提供了强大的几何先验,引导Transformer学习更准确的3D视觉表示;音频任务则将这种表示与声学特性绑定。消融实验(表2)显示,移除视觉监督(

w/o Visual Loss)或深度监督(w/o Depth Loss)都会导致性能显著下降,证明了这种联合监督的有效性。

🔬 细节详述

- 训练数据:

- Replay-NVAS (单场景):真实世界数据集,包含46个场景,共37小时同步音视频,8个DSLR相机配双耳麦克风。训练/验证/测试集规模:77K/12K/2K个片段。

- SoundSpaces-NVAS (多场景):合成数据集,基于SoundSpaces 2.0平台,使用Gibson场景和LibriSpeech音频,包含120个3D场景,20万视角,共1300小时数据。

- 预处理:未说明具体图像归一化、音频采样率等预处理细节。

- 数据增强:未说明。

- 损失函数:

- 视觉损失

L_visual:MSE(图像) + λ_p Perceptual(图像) + λ_s SiLog(深度) + λ_g * Grad(深度)。论文未给出λ_p, λ_s, λ_g的具体值。 - 音频损失

L_audio:λ_a * mSTFT(音频)。多分辨率STFT幅度谱损失。未给出λ_a的具体值。 - 总损失:视觉损失和音频损失的加权和(未说明具体权重)。

- 视觉损失

- 训练策略:

- 模型初始化:基于LVSM(一个24层解码器-only的多视角Transformer)的预训练权重进行微调。这是继承其3D视觉理解能力的关键。

- 优化器、学习率、Batch Size、训练步数/轮数:论文中均未提及。

- 调度策略:未提及。

- 关键超参数:

- 模型大小:核心Transformer为24层。隐藏维度

d、注意力头数、MLP内部维度等未说明。 - Patch大小:

p用于图像分块,未说明具体值。 - Plücker射线嵌入:6维向量,表示为

p ∈ R^{H×W×6}。

- 模型大小:核心Transformer为24层。隐藏维度

- 训练硬件:未说明。

- 推理细节:推理流程与训练一致,输入稀疏视角数据,输出目标视角图像和音频。未提及解码策略、温度、beam size等。

- 正则化或稳定训练技巧:未提及。

📊 实验结果

主要对比实验:在Replay-NVAS和SoundSpaces-NVAS两个数据集上,与多种基线方法进行比较。使用1或2个输入视角(V.)。

| 方法 | 输入视角数 | MAG ↓ | LRE ↓ | RTE ↓ | CDPAM ↓ |

|---|---|---|---|---|---|

| (a) Replay-NVAS | |||||

| Nearest GT | 1 | 0.152 | 1.413 | 0.045 | 0.135 |

| Interpolation GT | 2 | 0.139 | 1.257 | 0.049 | 0.171 |

| ViGAS (w/ sound source location) | 1 | 0.139 | 0.756 | 0.047 | 0.144 |

| AV-Cloud (w/o sound source location) | All | 0.158 | 0.769 | 0.051 | 0.166 |

| ViGAS (w/o sound source location) | 1 | 0.141 | 0.800 | 0.049 | 0.383 |

| ViGAS (w/o sound source location) | 2 | 0.141 | 1.112 | 0.051 | 0.352 |

| NVA-Former (Ours) | 2 | 0.141 | 0.671 | 0.049 | 0.132 |

| (b) Soundspaces-NVAS | |||||

| Nearest GT | 1 | 0.178 | 1.300 | 0.028 | 0.110 |

| Interpolation GT | 2 | 0.155 | 0.905 | 0.025 | 0.100 |

| ViGAS (w/ sound source location) | 1 | 0.156 | 0.781 | 0.028 | 0.096 |

| ViGAS (w/o sound source location) | 2 | 0.154 | 0.830 | 0.026 | 0.096 |

| NVA-Former (Ours) | 2 | 0.149 | 0.749 | 0.025 | 0.097 |

关键结论:

- 空间准确性 (LRE) 和 感知质量 (CDPAM):NVA-Former在两个数据集上均显著优于最强基线ViGAS(不使用声源位置版本)。例如在Replay-NVAS上,LRE从1.112(ViGAS 2视角)降至0.671,CDPAM从0.352降至0.132。

- 频谱距离 (MAG) 和 混响特性 (RTE):NVA-Former表现与ViGAS相当或略优,论文解释这些指标对视角变化相对不敏感。

- ViGAS的悖论:ViGAS在Replay-NVAS上使用2个视角输入反而比1个视角性能更差(LRE从0.800升至1.112),表明其未能有效利用多视角信息。NVA-Former则随视角增加而提升性能。

- 泛化性:NVA-Former在多样化的多场景合成数据集SoundSpaces-NVAS上同样表现优异,而密集方法AV-Cloud在此设置下无法直接应用。

消融研究 (Replay-NVAS):

| 模型变体 | MAG ↓ | LRE ↓ | RTE ↓ | CDPAM ↓ |

|---|---|---|---|---|

| Full Model | 0.141 | 0.671 | 0.049 | 0.132 |

| + w/o Depth Loss | 0.141 | 0.754 | 0.052 | 0.138 |

| + w/o Visual Loss | 0.140 | 0.812 | 0.050 | 0.397 |

| + w/o Pre-training | 0.140 | 0.884 | 0.048 | 0.230 |

消融结论:移除深度损失、视觉损失或不使用预训练权重,都会导致性能下降,尤其是LRE和CDPAM指标,证明了所提组件的重要性。

图表分析:

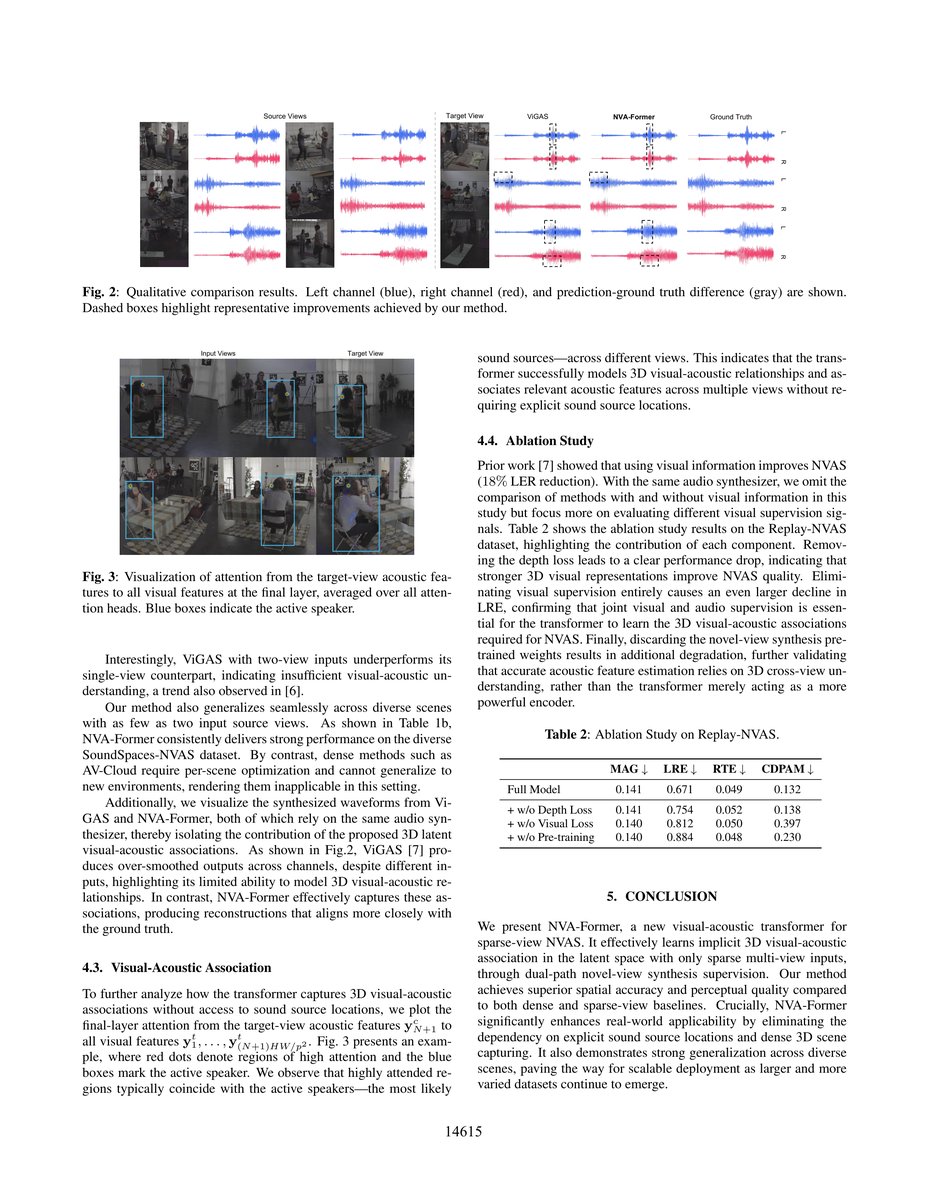

- 图2(波形对比):直观展示了ViGAS生成的波形在左右声道过于平滑,与真实值差异大;而NVA-Former的预测波形在峰值和节奏上更接近真实值,说明其更好地捕捉了空间动态特性。

- 图3(注意力可视化):展示了目标视角声学特征对所有视觉特征的注意力分布。高注意力区域(红点)与说话人位置(蓝框)高度重合,直观证明了模型确实学到了视觉-声学的对应关系,无需显式标注。

⚖️ 评分理由

学术质量:6.0/7

- 创新性 (2.0/2):提出了一个新的框架(NVA-Former)来解决NVAS中的稀疏视角和无源位置难题,技术路线(利用Plücker射线和Transformer潜空间融合)具有创新性。

- 技术正确性 (1.5/2):方法设计合理,实验验证了各组件的必要性。但核心音频合成器复用他人工作,对所学声学特征“天花板”的评估不够完整。

- 实验充分性 (1.5/2):在两个不同性质的数据集(真实/合成)上进行了对比,并包含了详尽的消融研究,证据较为有力。但缺少对超参数敏感性、更复杂场景(如多声源、移动声源)的进一步分析。

- 证据可信度 (1.0/1):实验对比公平(与不使用声源位置的基线比),指标选择恰当,图表辅助说明有力。

选题价值:1.5/2

- 前沿性 (0.8/1):解决的是多模态感知与生成的前沿问题,是AR/XR技术栈中的关键一环。

- 潜在影响 (0.7/1):能显著降低数据采集成本,提升实用性,对学术界和工业界(如虚拟会议、游戏、影视制作)都有价值。但研究问题本身在广义AI领域中相对垂直。

开源与复现加成:0.0/1

- 论文中未提供代码、模型权重、详细的训练超参数(如学习率、batch size)以及音频合成器

W的具体配置,使得独立复现存在很大困难。

- 论文中未提供代码、模型权重、详细的训练超参数(如学习率、batch size)以及音频合成器