📄 Sing2Song: An Accompaniment Generation System Based on Solo Singing

#音乐生成 #音乐信息检索 #歌唱语音合成 #规则与模板

✅ 7.5/10 | 前25% | #音乐生成 | #规则与模板 | #音乐信息检索 #歌唱语音合成

学术质量 6.5/7 | 选题价值 2.0/2 | 复现加成 -0.5 | 置信度 高

👥 作者与机构

- 第一作者:Sen Ho Choi(华为中央媒体技术研究院)

- 通讯作者:Yaolong Ju(大湾区大学)

- 作者列表:Sen Ho Choi, Isaac Fung Chap, Huicheng Zhang, Yulun Wu, Yueqiao Zhang(华为中央媒体技术研究院),Hao Shen, Huu Quyen Dang, Zhili Tan, Simon Lui(华为中央媒体技术研究院),Qiuqiang Kong(香港中文大学),Yaolong Ju(大湾区大学)

💡 毒舌点评

亮点: 这是一个非常扎实的工程化系统,针对“清唱生成伴奏”这一具体场景,将数据驱动的MIR模型与基于规则的音乐生成、音频合成紧密结合,在解决“长音频”和“可定制化”这两个实际痛点上表现出色,效果显著优于端到端基线。 短板: 核心的伴奏生成模块严重依赖规则和预设模板库(MIDI片段),在音乐创作的灵活性和创新性上存在天花板,更像是一个“智能乐手跟随”系统,而非具备真正创造力的“作曲AI”。其创新更多体现在系统集成和工程优化,而非音乐生成算法本身的突破。

🔗 开源详情

- 代码:论文中未提及代码仓库链接。

- 模型权重:未提及公开模型权重。

- 数据集:MIR训练数据集为自建商业音乐集,未公开。MIDI模板库来源为“大规模免版税材料”,未公开具体获取方式。

- Demo:提供了在线演示页面(https://sing2song-band.github.io/),可以试听输出样本。

- 复现材料:论文中未提供完整的训练细节、配置文件、检查点或附录说明。

- 论文中引用的开源项目:

- FluidSynth [25]:用于MIDI到音频的渲染。

- Pedalboard [26]:用于音频效果处理。

- pyloudnorm [27]:用于响度测量。

- Matchering [28]:灵感来源,用于自适应音频特征匹配。

- 其他MIR模型(如ROSVOT, SingNet等)作为基线被引用。

📌 核心摘要

- 问题:现有清唱伴奏生成系统(如SingSong、FastSAG)难以处理长音频输入(通常<30秒),且在音乐流派、前奏长度等参数上用户控制能力有限。

- 方法核心:提出Sing2Song,一个混合系统。其核心分为三步:(1) 使用专门在清唱数据上训练的MIR模型提取关键信息(音高、节拍、结构);(2) 基于规则和音乐理论,生成多轨MIDI伴奏;(3) 基于规则,将MIDI渲染为音频并进行自适应混音。

- 新意:与现有端到端生成音频的方法不同,Sing2Song生成符号化的MIDI,从而支持用户定制和无限长度生成。同时,其MIR模块专门针对“无伴奏”场景训练,克服了现有模型在清唱输入上性能下降的问题。

- 主要结果:在MIR任务上,其模型在清唱场景下的F1分数显著优于现有SOTA(例如,音高转录F1达88.32%,节拍追踪F1达90.59%)。在整体伴奏质量上,其MOS(音乐性3.923, 旋律对齐3.940)远高于SingSong(2.971, 3.063)和FastSAG(1.831, 1.811)。

- 实际意义:该系统为用户提供了一种能处理任意长度清唱、并生成可定制、专业音质伴奏的实用工具,推动了个性化AI音乐创作。

- 主要局限:伴奏生成的核心依赖规则和有限的模板库,在音乐复杂性和创新性上受限。系统流程固定,对规则和模板的质量要求高,可能难以泛化到模板库之外的复杂音乐风格。

🏗️ 模型架构

Sing2Song是一个混合系统,其架构如图1所示,主要包含三个模块,数据流从输入的清唱音频开始,经过分析、生成、合成,最终输出立体声音乐。

音乐信息检索 (MIR) 模块:

- 输入:单声道清唱音频。

- 功能:从清唱中提取关键音乐信息,作为后续生成的指导。

- 子模块:

- 歌声转录 (SVT):基于Wu et al. [21]的工作,采用一种利用谐波卷积的新标记方案,从CQT频谱图中提取音高轮廓。流程是:(1) 生成包含谐波信息的特征令牌

S;(2) 聚合频率-谐波-时间特征S';(3) 通过全局平均池化预测起始、结束和音高。 - 动态节拍与强拍跟踪:遵循Foscarin et al. [17]的方法,构建一个交替使用卷积和Transformer变体的前端,以整合频率和时间维度的信息。论文强调了在无伴奏清唱上训练和评估的挑战性。

- 音乐结构分割:在Wang et al. [22]的框架上进行改进,使用谐波CNN分析频谱图,并结合自注意力机制建模长时依赖。将段落标签精细化为[静音, 主歌, 副歌, 预副歌, 桥段]。

- 歌声转录 (SVT):基于Wu et al. [21]的工作,采用一种利用谐波卷积的新标记方案,从CQT频谱图中提取音高轮廓。流程是:(1) 生成包含谐波信息的特征令牌

- 输出:量化后的旋律序列、节拍/强拍时间戳、歌曲结构分段(如主歌、副歌)。

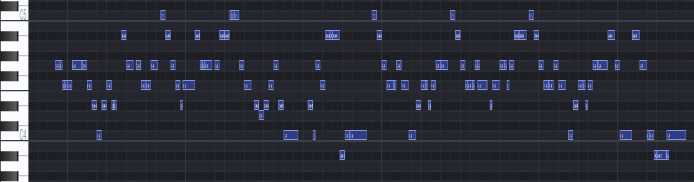

基于规则的MIDI伴奏生成模块:

- 输入:MIR模块提取的音乐信息,以及用户选择的风格(如Livehouse, 抒情等)。

- 功能:根据音乐理论规则,生成与清唱旋律匹配的多轨MIDI伴奏。

- 子模块:

- 和弦进行生成:不使用马尔可夫链,而是采用递归动态匹配策略。基于旋律的调性(通过Krumhansl-Kessler方法确定),从预定义的和弦进行词典中搜索最佳匹配序列,确保全局和声一致性。支持和弦替换、经过和弦等变体以增加多样性。

- 基于和弦进行的素材重组:由于和弦进行无限而素材有限,提出一种拼接算法。通过波束搜索(宽度B=50),在最大化和弦匹配数、声部兼容性、避免过短片段等约束下,从同一风格库中选取MIDI片段

{mj}进行裁剪和合并,逼近目标和弦进行Ci。对于不匹配的和弦,通过音程映射进行重组。

- 输出:多轨MIDI文件(例如,鼓、贝斯、键盘、吉他等轨道)。

基于规则的自适应音频合成模块:

- 输入:多轨MIDI文件和原始清唱音频。

- 功能:将MIDI渲染为音频,并与清唱音频混合,达到专业录音室音质。

- 子模块:

- 音频渲染与单轨效果:使用FluidSynth和自研的SoundFont 2音色库将MIDI渲染为音频。每条轨道经过一个效果链处理,包括均衡器(EQ)、动态压缩(DRC)、增益、噪声门、限制器、声像(Panning),以及与卷积混响混合。

- 自适应多轨混音与母带处理:

- 将处理后的轨道按乐器类型(如鼓、音调乐器、人声)分组为“声部”(Stems)。

- 自适应平衡:计算各结构段落(主歌/副歌)的人声集成响度,并进行小幅增益调整,以补偿业余演唱中常见的段落间响度差异。

- 自适应效果匹配:这是一个关键创新。它模仿商业混音中的“参考曲目匹配”技术。根据风格、编曲、结构和人声音质,选择一个目标参考音频特征模板。然后通过音频特征匹配模块,调整最终输出

O的效果,使其音质接近商业音乐。

💡 核心创新点

- 针对清唱的专用MIR模型:首次系统性地将SVT、节拍追踪、结构分割模型在清唱数据上专门训练和评估。这解决了现有MIR模型因依赖伴奏提供节奏和和声线索而在清唱输入上性能下降的核心问题,为后续生成提供了更准确的“音乐指南”。

- 符号化(MIDI)生成以实现可定制化与长时生成:与SingSong/FastSAG直接生成音频波形不同,Sing2Song选择生成MIDI。这一设计决策带来了两大优势:(1) MIDI易于编辑,允许用户控制流派、前奏长度等参数;(2) 摆脱了神经网络直接建模长时音频序列的计算限制,理论上支持任意长度的伴奏生成。

- “数据驱动MIR + 规则生成 + 规则合成”的混合架构:该架构巧妙结合了两者优点。数据驱动的MIR模型确保了从清唱中提取音乐特征的准确性;而规则化的伴奏生成(基于音乐理论和模板库)和音频合成(基于专业音频处理流程)则保证了生成结果的音乐性、可控性和最终音质,避免了端到端模型可能出现的“幻觉”或不自然。

- 自适应音频合成与母带处理:该模块并非简单的MIDI转音频。它包含了模仿专业音乐制作流程的多步处理:多轨渲染、单轨效果处理、自适应段落响度平衡、以及基于参考曲目的自适应效果匹配。这使得最终输出达到了可比拟商业音乐的音质,显著提升了用户体验。

🔬 细节详述

- 训练数据:

- MIR模型训练:使用了一个包含数千首商业音乐录音的数据集,按8:1:1划分训练/验证/测试集。对于节拍追踪,论文详细描述了数据增强过程:从歌曲中提取人声轨道,切成5秒片段,并进行速度变换(±20%等)和移调(最多±6半音),再重新组合,重复20次以上,以模拟真实世界中节奏多变的清唱。

- MIDI伴奏模板库:使用了大规模、免版税的多轨MIDI材料库,并按流派(如Livehouse, 抒情,华语流行)和乐器类型进行分类。

- 损失函数:论文中未详细说明MIR模型的具体损失函数设计。

- 训练策略:论文中未提供学习率、优化器、训练步数等具体细节。

- 关键超参数:在MIDI重组中,波束搜索的宽度B=50。SVT模型中,谐波特征维度H是一个关键参数,但具体数值未说明。

- 训练硬件:论文中未提及训练所使用的GPU型号、数量或训练时长。

- 推理细节:

- 系统设计支持无限长度输入,暗示MIR和规则生成模块可流式或分段处理。

- 音频合成模块中,效果链的参数(如混响权重w)是预设或基于规则的。

- 自适应效果匹配模块根据输入音频特征动态选择参考模板和调整参数。

- 正则化或稳定训练技巧:在MIR训练中,特别是节拍追踪,采用了大规模的数据增强作为关键的正则化和泛化手段。

📊 实验结果

论文在清唱场景下的MIR准确性和整体伴奏质量两个方面进行了评估。

表1. Sing2Song MIR模块与现有系统在清唱场景下的结果对比

| 任务 | 模型 | 指标 | 数值 (%) |

|---|---|---|---|

| 歌声转录 | Melodyne [32] | OnPOff F1 | 12.18 |

| MusicYolo [33] | 57.21 | ||

| ROSVOT [34] | 67.77 | ||

| Ours | 70.13 | ||

| OnP F1 | 84.46 | ||

| On F1 | 88.32 | ||

| 节拍追踪 | SingNet [35] | Beat F1 | 82.55 |

| TCN [36] | 79.12 | ||

| Ours | 90.59 | ||

| Downbeat F1 | 84.72 | ||

| 结构分割 | SpecTNT [22] | Chorus F1 | 82.72 |

| Verse F1 | 81.29 | ||

| HR.5F | 41.66 | ||

| Ours | 90.02 | ||

| 91.48 | |||

| 52.57 |

关键结论:Sing2Song的MIR模型在所有清唱评估任务上均取得了最优性能,证明了专门训练的重要性。

表2. Sing2Song输出质量对比、基线对比及消融实验

| 方法 / 数据集 | SongEval [30] (Coh↑ Mem↑ NVBP↑ CSS↑ OM↑ avg.↑) | MOS (MOSm↑ MOSa↑ MOSs↑) |

|---|---|---|

| Ours | 3.911 3.644 3.808 3.615 3.591 3.714 | 3.923 3.940 3.789 |

| SingSong [1] | 3.557 3.326 3.400 3.299 3.250 3.366 | 2.971 3.063 2.414 |

| FastSAG [2] | 2.887 2.749 2.847 2.707 2.641 2.766 | 1.831 1.811 1.517 |

| MUSDB18-HQ | 3.842 3.576 3.762 3.541 3.568 3.658 | n/a |

| MUSDB18-XL (GT) | 3.906 3.648 3.850 3.620 3.672 3.739 | 4.714 4.619 4.667 |

| 消融实验 | ||

| Ours w/o AdapMix | 3.855 3.612 3.745 3.578 3.519 3.662 | 3.767 3.786 3.693 |

| Ours with replaced Beat | 3.745 3.436 3.630 3.447 3.438 3.539 | 3.788 3.385 3.756 |

| Ours with replaced SVT | 3.902 3.625 3.792 3.578 3.579 3.695 | 3.510 3.479 3.585 |

| Ours with replaced Structure | 3.897 3.630 3.776 3.573 3.561 3.687 | 3.790 3.665 3.417 |

关键结论:

- 整体性能:Sing2Song在客观(SongEval)和主观(MOS)评价上均显著优于SingSong和FastSAG基线。其平均SongEval分数(3.714)甚至超过了高质量音乐分离数据集MUSDB18-HQ(3.658),接近原始商业音乐的GT分数(3.739)。

- 消融研究:

- 去除自适应混音(w/o AdapMix)导致所有指标下降,证明了该模块对提升音质的关键作用。

- 替换节拍(Beat)和结构(Structure)模型对整体质量影响最大,尤其是替换节拍模型导致旋律对齐度(MOSa)大幅下降,这印证了准确的节拍信息对生成协调伴奏至关重要。

⚖️ 评分理由

- 学术质量:6.5/7

- 创新性:将清唱专用的MIR模型与基于规则的生成/合成流水线相结合,形成一个解决实际问题的完整系统,设计思路清晰且有效。混合架构是其主要创新点。

- 技术正确性:各模块的实现均有文献依据或合理设计(如和弦匹配算法、自适应混音)。MIR部分的实验对比充分,结果令人信服。

- 实验充分性:实验设计全面,涵盖了MIR准确性、整体生成质量的多维评估(客观/主观),并进行了详尽的消融实验,分析了各模块贡献。

- 证据可信度:对比基线(SingSong, FastSAG)选择合理,评估指标(SongEval, MOS)是领域标准,消融实验逻辑严密,结果支持论文主张。

- 选题价值:2.0/2

- 前沿性:解决的是AI音乐生成中实际且重要的“人机协作伴奏”问题,是音乐AI应用落地的重要方向。

- 潜在影响与应用空间:该系统可直接应用于K歌应用、个人音乐创作工具、在线音乐教育等领域,为用户提供即时、专业的伴奏,具有广阔的商业和创意应用前景。

- 与音频/语音读者相关性:涉及歌唱语音理解(MIR)、音乐生成、音频信号处理(渲染、混音),对关��音频技术综合应用的读者有很高参考价值。

- 开源与复现加成:-0.5/1

- 论文提供了Demo页面,增强了结果的可感知性。

- 然而,论文未提及代码、模型权重、训练数据集的开源计划。对于MIR模型和规则生成模块的许多实现细节(如具体超参数、模板库内容与获取方式)说明不足,限制了完全复现的可能性。因此给予负分加成。