📄 Scaling Ambiguity: Augmenting Human Annotation in Speech Emotion Recognition with Audio-Language Models

#语音情感识别 #数据增强 #音频大模型 #多模态模型 #低资源

✅ 6.5/10 | 前50% | #语音情感识别 | #数据增强 | #音频大模型 #多模态模型

学术质量 5.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Wenda Zhang (University of Melbourne, Melbourne, Australia)

- 通讯作者:Hongyu Jin (University of Melbourne, Melbourne, Australia) (论文中标注为*Equal contribution)

- 作者列表:

- Wenda Zhang (University of Melbourne)

- Hongyu Jin (University of Melbourne)

- Siyi Wang (University of Melbourne)

- Zhiqiang Wei (Xi’an Jiaotong University, Xi’an, China)

- Ting Dang (University of Melbourne)

💡 毒舌点评

这篇论文的核心亮点在于它首次系统性地将音频语言模型(ALM)生成的合成标注引入到情感分布估计任务中,并设计了一套包含数据增强(DiME-Aug)与评估的完整流程,为解决情感标注稀疏问题提供了新颖且可扩展的思路。然而,其短板也很明显:ALM生成的“合成感知代理”在面对人类本身就存在高度分歧的模糊情感时效果甚微,这恰恰是AER任务最具挑战性的部分,使得该方法目前更像是对低模糊区域的“锦上添花”,而非解决核心矛盾的“雪中送炭”。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及公开模型权重。

- 数据集:使用的是公开数据集IEMOCAP和MSP-Podcast,但论文生成的合成标注数据集未提及是否公开。

- Demo:未提供在线演示。

- 复现材料:提供了关键的训练超参数(如LoRA设置、学习率、batch size等)和提示词示例(表1),但缺少生成所有合成标注的完整代码和配置。

- 论文中引用的开源项目:提到了使用的公开模型/工具:Qwen2-Audio(骨干模型)、LoRA(训练方法)、Gemini 2.5-Pro(合成标注生成,但非开源)。

📌 核心摘要

- 解决的问题:传统语音情感识别使用单一标签,忽略了情感的模糊性。新兴的模糊情感识别(AER)将情感建模为概率分布,但其发展受限于人工标注稀疏(每句话仅3-5人标注),导致估计出的真实分布不可靠。

- 方法核心:提出一个三模块框架:(1) 合成感知代理,利用ALM(如Gemini)为每条语音生成大量合成标注,与少量人工标注合并,形成更丰富的“增强分布”;(2) DiME-Aug,一种分布感知的多模态数据增强策略,通过音频特征插值和文本继承来平衡少数类别;(3) ALM微调,使用Qwen2-Audio作为骨干模型,预测并优化情感分布。

- 与已有方法相比新在哪里:首次尝试用ALM生成标注来直接丰富情感分布,而非仅预测单一标签;提出了专门的多模态分布感知增强方法DiME-Aug;通过统计分析(JS散度与标注数量关系)和在不同模糊度子集上的细粒度评估,系统性地验证了合成标注的有效性与局限性。

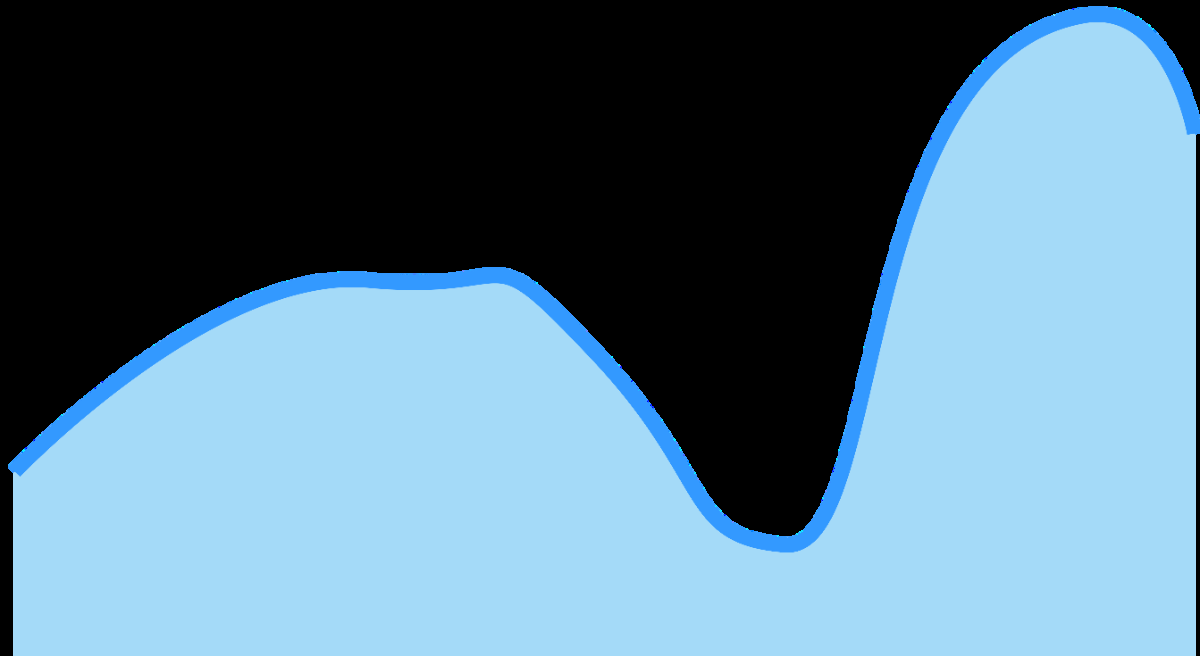

- 主要实验结果:在IEMOCAP和MSP-Podcast数据集上:(1) 合成标注数量增加能使其分布逼近人工分布(图2,IEMOCAP约6个、MSP-Podcast约10个饱和);(2) 在MSP-Podcast上,组合标注(人工+合成) 在使用DiME-Aug后取得了最佳效果(JS散度0.274,优于人工的0.307);(3) 分析表明,合成标注的收益主要体现在低、中模糊区域,在高模糊区域(人类分歧大)效果下降甚至不如人工标注(图3,表3)。

- 实际意义:为缓解AER中昂贵的人工标注依赖提供了一种可扩展的解决方案,若结合未来更强的生成模型,有望降低情感计算应用的数据门槛。

- 主要局限性:合成标注的效果存在“饱和点”,且对高度模糊的情感样本无效甚至有害;研究依赖于特定的闭源ALM(Gemini 2.5-Pro)和开源ALM(Qwen2-Audio),结论可能受模型能力限制;在IEMOCAP数据集上,组合标注并未全面超越人工标注。

🏗️ 模型架构

本论文的整体框架(图1)是一个数据生成-增强-训练的管线,而非单一端到端模型。其核心是利用一个ALM(图中标为Qwen2-Audio骨干)来完成合成标注生成和最终的情感分布预测两个任务。

(图1:框架概览。包含三个模块:(1) 合成感知代理;(2) DiME-Aug;(3) ALM微调。)

(图1:框架概览。包含三个模块:(1) 合成感知代理;(2) DiME-Aug;(3) ALM微调。)

详细流程如下:

- 输入:语音音频及其转录文本。

- 合成标注生成(Synthetic Perceptual Proxies):

- 该模块不涉及模型训练,而是使用一个冻结的、强大的ALM(如Gemini 2.5-Pro) 作为标注器。

- 对每���语音,通过精心设计的提示词(见表1),引导ALM分析音频和文本,从预设情绪类别中选择一个主导情绪。

- 为了模拟人类标注者的多样性,通过调整采样温度和变换提示词中的“标注者人设”,为每条语音生成数十甚至数百个合成标注。

- 将所有合成标注与原始的3-5个人工标注视为来自同一分布的独立样本,合并后计算每个情绪类别的频率,从而得到一条语音的增强情感分布。

- 数据增强(DiME-Aug):

- 这是训练前的数据预处理步骤,目标是解决情感类别不平衡问题。

- 针对少数类样本,在特征空间中寻找其k-最近邻(音频特征可能来自某个预训练模型,论文未明确说明)。

- 对音频信号进行线性插值(公式1),生成新的音频。

- 新样本的文本转录不进行插值,而是直接继承混合系数λ较大一侧的原始文本。

- 新样本的情感分布由两个人工标注分布线性插值(公式2)生成。

- 这个过程生成了新的(音频,文本,分布)三元组,用于补充训练集。

- 模型微调(Distributional Head & ALM Fine-tuning):

- 以Qwen2-Audio-7B-Instruct作为骨干模型,并冻结其主体参数,使用LoRA进行参数高效微调。

- 在骨干模型的第一个token表示之后,接入一个自定义的分布预测头。该头结构为:多头自注意力 → 残差MLP块 → 线性投影层 → 线性层 + Softmax,最终输出每个情绪类别的概率值,形成预测分布。

- 模型输入为原始样本与DiME-Aug生成的增强样本的混合。

- 训练损失为预测分布与目标分布(增强分布)之间的Jensen-Shannon Divergence。

- 输出:对于给定的语音,模型预测其属于每个情绪类别的概率分布。

💡 核心创新点

- 首次将ALM生成的合成标注用于构建情感概率分布:此前工作多用LLM生成单一标签,本研究创新性地利用ALM的音频理解能力,通过生成大量多样化的合成标注来丰富情感分布,直接服务于模糊情感识别这一前沿任务。

- 提出DiME-Aug分布感知多模态数据增强策略:现有增强方法多针对单一模态。DiME-Aug同时处理音频和文本,通过插值生成新的训练样本,并特别设计为生成合理的分布标签,有效缓解了AER任务中的类别不平衡问题,提升了训练的稳定性和评估的公平性。

- 对合成标注质量进行多维度的统计验证:研究不仅评估下游任务性能,还通过分析JS散度随合成标注数量的变化(图2)以及在不同模糊度层级上的表现(图3),深入揭示了合成标注的能力边界(在低模糊区有效,高模糊区受限),为后续研究提供了重要实证依据。

🔬 细节详述

- 训练数据:

- 数据集:IEMOCAP(约4370条,每条3人标注)、MSP-Podcast(约4114条,每条5-21人标注),聚焦于Angry, Happy, Sad, Neutral四类。

- 数据增强:DiME-Aug是主要的数据增强方法,用于平衡类别。合成标注本身也是一种数据增强,但作用于标签而非样本。

- 损失函数:Jensen-Shannon Divergence (JS Divergence)。这是一个对称的、有界的分布距离度量,适合衡量预测分布与目标分布之间的差异。

- 训练策略:

- 优化器:未明确说明,但提到了使用LoRA。

- 学习率:2.5e-6。

- 调度策略:余弦学习率调度。

- 训练轮数:最多50个epoch,采用早停(耐心值为8)。

- 批大小:有效批大小为64。

- 训练细节:使用混合精度训练。音频采样率为16kHz。

- 关键超参数:

- 骨干模型:Qwen2-Audio-7B-Instruct。

- LoRA配置:秩r=8,缩放因子α=16,丢弃率0.2,应用于查询、键、值和输出投影层。

- DiME-Aug中合成样本添加比例:通过网格搜索在10%到50%之间优化。

- 合成标注生成:ALM为Gemini 2.5-Pro,温度参数在0.1到1.0之间变化。

- 训练硬件:论文中未提及。

- 推理细节:论文主要评估训练后的分布预测能力,解码策略等未详细说明。生成合成标注时使用了随机采样(调整温度)。

- 正则化技巧:使用了LoRA中的dropout(0.2)和早停策略。

📊 实验结果

论文的核心实验围绕三个问题展开,关键结果如下:

合成标注与人工标注的相似性(图2)

(图2:合成标注数量与JS散度的关系。随合成标注增多,JS散度下降并趋于饱和。IEMOCAP饱和点约6,MSP-Podcast约10。)

(图2:合成标注数量与JS散度的关系。随合成标注增多,JS散度下降并趋于饱和。IEMOCAP饱和点约6,MSP-Podcast约10。)不同标注源对AER模型性能的影响(表2)

| 数据集 | 注释源 | 有无DiME-Aug | JS↓ | BC↑ |

|---|---|---|---|---|

| IEMOCAP | 人工 (H) | 有 (w/ Aug.) | 0.302 | 0.724 |

| 合成 (S) | 有 | 0.431 | 0.607 | |

| 组合 (C) | 有 | 0.325 | 0.715 | |

| 人工 (H) | 无 (w/o Aug.) | 0.351 | 0.679 | |

| 合成 (S) | 无 | 0.480 | 0.568 | |

| 组合 (C) | 无 | 0.409 | 0.642 | |

| MSP-Podcast | 人工 (H) | 有 | 0.307 | 0.719 |

| 合成 (S) | 有 | 0.373 | 0.660 | |

| 组合 (C) | 有 | 0.274 | 0.757 | |

| 人工 (H) | 无 | 0.371 | 0.663 | |

| 合成 (S) | 无 | 0.321 | 0.711 | |

| 组合 (C) | 无 | 0.383 | 0.665 |

- 结论:在MSP-Podcast上,组合标注+DiME-Aug取得了最佳性能。在IEMOCAP上,人工标注+DiME-Aug性能最优,组合标注略逊。仅使用合成标注的效果始终最差。

不同模糊度层级的性能分析(图3)

(图3:在不同模糊度(低/中/高)水平下,人工标注与组合标注训练的模型的JS散度对比。在低、中模糊区,组合标注优于或接近人工标注;在高模糊区,组合标注效果下降,甚至不如人工标注。)

(图3:在不同模糊度(低/中/高)水平下,人工标注与组合标注训练的模型的JS散度对比。在低、中模糊区,组合标注优于或接近人工标注;在高模糊区,组合标注效果下降,甚至不如人工标注。)标注统计分析(表3)

| 指标 | IEMOCAP | MSP-Podcast | ||||

|---|---|---|---|---|---|---|

| H | S | C | H | S | C | |

| F-Kappa | 0.542 | 0.803 | 0.563 | 0.704 | 0.778 | 0.520 |

| Entropy | 0.431 | 0.255 | 0.633 | 0.309 | 0.228 | 0.552 |

- 结论:合成标注(S)的Fleiss‘ Kappa更高(一致性更高),熵更低(模糊性更低),说明合成标注倾向于给出更“确定”的标签,可能过于简化了高模糊样本的情感复杂性。组合标注(C)的熵显著升高,是因为加入了大量多样的合成标签。

⚖️ 评分理由

- 学术质量:5.0/7 - 论文针对一个明确的痛点提出了系统性的解决方案,实验设计全面且包含了有深度的消融分析。然而,核心方法(ALM生成标注)的效果存在理论上限和实证局限(高模糊区失效),并且在部分实验设置中(如IEMOCAP组合标注)未展现出优势,这削弱了其贡献的普适性和强度。技术方案有一定新意,但更多是巧妙的组合与验证,而非底层算法的突破。

- 选题价值:1.5/2 - 聚焦于情感计算中的基础难题(标注稀疏、情感模糊),利用当前热门的ALM技术尝试解决,方向正确且具有应用前景。研究对音频与语言建模社区有参考价值,但情感识别本身并非当前最前沿或最有影响力的领域。

- 开源与复现加成:0.0/1 - 论文详细报告了实验设置和超参数,但未提供任何代码、合成数据集或预训练模型。读者无法仅凭论文复现其“合成感知代理”的生成过程和整个框架,这是一个重大缺陷。