📄 Relative Time Intervals Representation For Word-Level Timestamping With Masked Training

#语音识别 #大语言模型 #相对时间表示 #参数高效微调 #语音大模型

🔥 8.0/10 | 前25% | #语音识别 | #大语言模型 | #相对时间表示 #参数高效微调

学术质量 8.0/7 | 选题价值 7.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Quanwei Tang(苏州大学)

- 通讯作者:Dong Zhang(苏州大学;江苏语言计算重点实验室)

- 作者列表:Quanwei Tang(苏州大学),Zhiyu Tang(昆士兰大学),Xu Li(AISpeech Ltd),Dong Zhang(苏州大学;江苏语言计算重点实验室),Shoushan Li(苏州大学),Guodong Zhou(苏州大学)

💡 毒舌点评

亮点在于用“相对时间间隔”替代“绝对时间戳”这一简单却有效的表示革新,直击现有方法词汇爆炸与误差累积的痛点,设计巧妙且实验收益显著。短板是创新主要停留在表示层面和训练技巧(如掩码概率固定为10%),对于时间建模本身(如动态间隔学习)的探索深度略显不足,更像是一个为特定任务设计的实用工程改进。

🔗 开源详情

- 代码:论文中提供了代码仓库链接:

https://github.com/tangquanwei/Timestamp-Aware-Speech-LLM。 - 模型权重:未提及是否公开。

- 数据集:使用了公开数据集(AISHELL-2, Common Voice),但未说明具体获取和预处理方式。

- Demo:未提及。

- 复现材料:提供了较详细的训练数据(AISHELL-2, Common Voice英文子集)、训练硬件(24x Ascend 910B NPU)、关键超参数(学习率

5×10^-6, 批次时长500秒,时间戳掩码概率10%, λ动态策略)、优化器(AdamW)和调度器(WarmupCosineLR)。这些信息对复现至关重要。 - 论文中引用的开源项目:引用了 LoRA(用于参数高效微调)和 FireRedASR-LLM(作为基础架构)。

📌 核心摘要

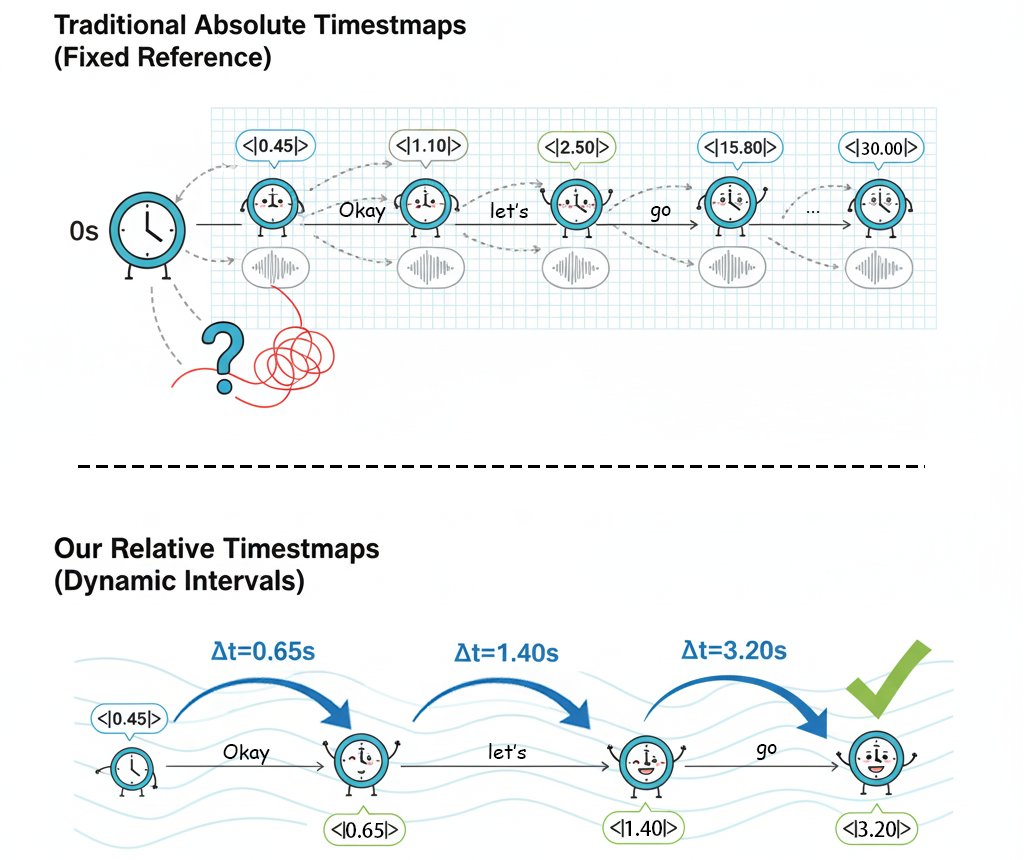

- 问题:现有语音大模型在生成带时间戳的转录时,主要使用绝对时间戳,这会导致词汇表膨胀、误差累积传播,并且对超出训练时长范围音频的泛化能力差。

- 方法核心:提出用相对时间间隔(即相邻词之间的时间差)表示时间戳,替代绝对时间戳。同时,采用混合微调策略(对新增模块全参数微调,对骨干解码层使用LoRA)和时间戳掩码训练目标,以高效注入时间预测能力并提升鲁棒性。

- 创新点:首次在语音大模型中系统性地提出并验证了基于相对时间间隔的时间戳表示方法;引入时间戳掩码训练以防止模型过拟合于完美标注;设计了角色感知的混合参数高效微调策略。

- 主要实验结果:在LibriSpeech和Wenet-Meeting两个数据集上,本文方法(Relative Timestamp)在时间戳预测的精确率、召回率和平均时间差指标上均显著优于Qwen2-Audio、WhisperTimestamped、SenseVoiceSmall、Canary等基线模型以及论文内对比的绝对时间戳方法。例如,在Wenet-Meeting数据集上,240ms容差下,本文方法的精确率和召回率分别达到91.13%和86.88%,平均时间差仅30.34ms。消融实验表明,移除时间戳损失或时间戳掩码均会导致性能明显下降。

- 实际意义:使语音大模型从“内容理解机器”升级为“时间感知的内容理解机器”,为需要精确时序对齐的应用(如字幕生成、语音编辑、会议记录)提供了更优解决方案。

- 主要局限性:掩码训练策略相对简单(固定10%概率),未探讨更复杂的掩码或课程学习策略;相对时间间隔的范围(0-5秒)是否普适于所有语音场景有待验证;论文未详细分析模型在不同语速、不同噪声条件下的鲁棒性。

🏗️ 模型架构

论文中的架构对比图如下:

模型整体基于预训练的语音大模型(FireRedASR-LLM)架构,该架构由音频编码器、投影层、文本嵌入层、解码器层和语言模型头组成。主要创新在于时间戳生成部分的设计。

- 完整输入输出流程:

- 输入:语音音频特征 + 文本提示(如“Speech to text with timestamp.”)。

- 输出:带有时间戳标记的转录文本序列,例如

Hello <|0.60|> World <|0.32|> <|1.20|>。

- 主要组件与数据流:

- 音频编码器(Audio Encoder):使用Conformer架构,从原始语音中提取高层声学特征。

- 投影层(Proj):将音频特征映射到与语言模型兼容的维度。

- 文本嵌入层(Text Embedding):将输入的文本提示和生成的文本、时间戳令牌嵌入为向量。对于时间戳,模型引入了一个相对时间戳词汇表,例如

<|0.00|>到<|5.00|>的令牌,代表0到5秒的时间间隔。 - 解码器层(Decoder Layers):基于Qwen2-7B-Instruct的自回归解码器。在生成每个令牌时,会结合之前的上下文(包括文本和已生成的时间戳令牌)。

- 语言模型头(LM Head):将解码器的输出映射到整个词汇表(包含文本令牌和相对时间戳令牌)的概率分布,以自回归方式预测下一个令牌(文本或时间戳)。

- 关键设计选择:

- 相对时间戳表示:这是架构的核心变化。每个时间戳令牌

<|Δt|>表示从前一个词结束到当前词开始的时间间隔。这避免了为绝对时间点创建大量令牌,且与自回归生成的模式天然契合(预测下一段持续时间)。 - 混合微调策略:为高效适配新任务,对新增的时间戳嵌入层和语言模型头进行全参数微调,因为它们初始权重随机,需要全面更新。对骨干解码器层使用LoRA(Low-Rank Adaptation) 进行微调,冻结原始权重,仅插入少量可训练的低秩矩阵,在保留预训练语言知识的同时高效学习插入时间戳标记。

- 时间戳掩码训练:训练时,随机将部分时间戳令牌替换为

[MASK],迫使模型不能依赖前一个时间戳的真值,而必须根据语音内容和历史上下文来预测当前时间间隔,从而提升对噪声标注的鲁棒性,防止过拟合。

- 相对时间戳表示:这是架构的核心变化。每个时间戳令牌

💡 核心创新点

相对时间间隔表示法

- 是什么:用连续词之间的时间差(如0.65秒)作为一个离散令牌来建模时间,取代记录绝对起止时间(如0.45秒,1.10秒)。

- 之前方法的局限:绝对时间戳需要为每个可能的时间点创建令牌(如0.01秒分辨率需3000个令牌对应30秒音频),导致词汇表爆炸。同时,预测绝对时间会累积误差,且对未见过的长时间音频泛化能力差。

- 如何起作用:模型只需学习预测一个有限范围内(如0-5秒)的相对间隔。通过累积这些间隔,可以表示任意长度的音频时间线。这大幅压缩了时间相关词汇量,并减少了误差传播。

- 收益:在多个数据集上实现了更优的时间戳预测精度(精确率、召回率更高)和更小的平均时间差,同时词汇量显著减小。

时间戳掩码训练

- 是什么:在训练过程中,随机遮蔽(替换为

<mask>)序列中的一部分时间戳令牌。 - 之前方法的局限:模型容易过度依赖训练数据中的完美时间戳真值,对真实世界中可能存在噪声或模糊边界的时间标注泛化能力弱。

- 如何起作用:在预测被遮蔽的时间戳时,模型无法看到其前一个时间戳的真值,必须依赖语音声学特征和上下文文本信息来推断该段时长,这类似于BERT的掩码语言模型思想,增强了模型对时间信息的独立判断能力和鲁棒性。

- 收益:消融实验(Table 2)显示,移除该模块后,在AISHELL-2和Common Voice数据集上,WER上升,时间戳预测的精确率和召回率均显著下降。

- 是什么:在训练过程中,随机遮蔽(替换为

角色感知的混合参数高效微调

- 是什么:对模型中不同功能的模块采用差异化的微调策略。

- 之前方法的局限:全参数微调计算开销大,且可能损害预训练模型原有的语言和声学知识。

- 如何起作用:识别出时间戳嵌入和输出头是全新模块,需要全量更新参数以从头学习;而解码器骨干主要负责语言建模和序列生成,只需通过LoRA进行轻量、适应性的调整,以学会在适当时机插入时间戳。

- 收益:在保证模型性能(如WER和时间戳精度)的同时,大幅降低了训练的计算成本和内存占用,实现了高效的任务适配。

🔬 细节详述

- 训练数据:论文中明确提及的训练数据集为 AISHELL-2(约1000小时普通话)和 Common Voice的英文子集。未说明具体预处理和数据增强方法。

- 损失函数:联合时间对齐损失

Ltotal = Ltext + λLtimestamp。Ltext是文本令牌的交叉熵损失,Ltimestamp是时间戳令牌的交叉熵损失。λ是一个动态权重,在训练初期设为1(优先学习文本),随着训练epoch增加而线性增加(每个epoch加1)。 - 训练策略:

- 学习率:使用AdamW优化器,学习率为

5 × 10^-6。 - Warmup与调度:使用WarmupCosineLR调度器。

- Batch Size:在24个Ascend 910B (64G) NPU上训练,每个NPU处理的batch音频总时长为500秒。

- 训练步数/轮数:训练7k步。

- 时间戳掩码概率:从第二个epoch开始,掩码概率固定为10%。

- 学习率:使用AdamW优化器,学习率为

- 关键超参数:

- 模型骨架:基于Conformer音频编码器和Qwen2-7B-Instruct骨干LLM。

- 时间戳词汇量:绝对时间戳模式需添加

<|0.00|>到<|30.00|>的令牌(3001个);相对时间戳模式仅需<|0.00|>到<|5.00|>的令牌(501个)。

- 训练硬件:24 × Ascend 910B (64G) NPU。训练时长未说明。

- 推理细节:论文未提及解码策略(如beam size、温度)、流式设置等具体信息。

- 正则化技巧:时间戳掩码技术(如上所述)是主要的正则化手段,用于防止对真值过拟合。

📊 实验结果

论文在多个数据集上评估了时间戳预测性能和语音识别性能。

表1:不同模型在时间戳预测上的性能比较

| 模型 | 容差 (ms) | Librispeech | Wenet-Meeting | ||||

|---|---|---|---|---|---|---|---|

| P (%) | R (%) | Avg. Diff (ms) | P (%) | R (%) | Avg. Diff (ms) | ||

| Qwen2-Audio | 80 | 0.00 | 0.00 | 1031.23 | 60.81 | 56.06 | 59.03 |

| 160 | 0.01 | 0.00 | 1031.18 | 76.07 | 70.13 | 49.11 | |

| 240 | 0.16 | 0.05 | 1030.42 | 82.30 | 75.87 | 43.07 | |

| WhisperTimestamed | 80 | 2.70 | 2.36 | 131.92 | 3.54 | 1.51 | 164.09 |

| 160 | 10.09 | 8.83 | 120.52 | 24.30 | 10.38 | 134.03 | |

| 240 | 19.90 | 17.42 | 101.14 | 43.97 | 18.79 | 102.48 | |

| SenseVoiceSmall | 80 | 1.10 | 1.10 | 176.38 | 28.52 | 27.96 | 80.80 |

| 160 | 5.20 | 5.19 | 166.71 | 71.40 | 69.99 | 45.26 | |

| 240 | 12.88 | 12.86 | 148.59 | 82.82 | 81.19 | 32.47 | |

| Canary | 80 | 35.51 | 35.27 | 444.30 | - | - | - |

| 160 | 71.23 | 70.74 | 268.18 | - | - | - | |

| 240 | 84.57 | 83.99 | 200.47 | - | - | - | |

| Absolute Timestamp | 80 | 12.30 | 5.51 | 159.05 | 45.14 | 42.52 | 186.73 |

| 160 | 17.03 | 7.63 | 156.58 | 62.99 | 59.34 | 168.29 | |

| 240 | 21.44 | 9.61 | 152.51 | 72.41 | 68.22 | 152.17 | |

| Relative Timestamp (Ours) | 80 | 40.49 | 38.44 | 145.72 | 61.07 | 60.62 | 55.80 |

| 160 | 77.74 | 75.24 | 139.21 | 78.04 | 75.46 | 42.45 | |

| 240 | 83.65 | 82.64 | 127.91 | 91.13 | 86.88 | 30.34 |

关键结论:本文的相对时间戳方法在两个数据集的所有容差级别上,在精确率(P)和召回率(R)上均取得了最佳成绩,且平均时间差(Avg. Diff)最小,尤其在Wenet-Meeting数据集上优势明显。绝对时间戳方法在LibriSpeech上的表现较差。

表2:不同模型配置在240ms容差下的消融研究(WER %,精确率/召回率)

| 配置 | AISHELL-2 iOS (中文) | Common Voice (英文) | ||||

|---|---|---|---|---|---|---|

| WER (%) | Precision | Recall | WER (%) | Precision | Recall | |

| Absolute Timestamp | 2.87 | 0.9544 | 0.9546 | 16.41 | 0.7861 | 0.7838 |

| - TS Loss | 2.96 | 0.9506 | 0.9447 | 18.63 | 0.7428 | 0.7407 |

| Relative Timestamp | 2.15 | 0.9763 | 0.9634 | 11.63 | 0.8770 | 0.8546 |

| - TS Loss | 2.31 | 0.9715 | 0.9548 | 12.66 | 0.8712 | 0.8463 |

| - Timestamp Masking | 2.56 | 0.9658 | 0.9578 | 14.47 | 0.8067 | 0.7853 |

关键结论:相对时间戳模型在WER和时间戳精度上均优于绝对时间戳模型。移除时间戳损失(- TS Loss)或时间戳掩码(- Timestamp Masking)都会导致性能下降,验证了各组件的有效性。其中,时间戳掩码对Common Voice(可能标注噪声更大或数据更多样)的影响更为显著。

表3:WER (%) 比较(↓表示越低越好)

| 方法 | AS-1 (CN) | AS-2 (CN) | Wenet (CN) | Libri (EN) | CV (EN) |

|---|---|---|---|---|---|

| Qwen2 Audio | 1.62 | 3.38 | 21.99 | 43.32 | 74.37 |

| SenseVoiceSmall | 3.10 | 3.87 | 7.54 | 3.80 | 15.97 |

| WhisperTimestamped | 12.46 | 8.08 | 56.66 | 20.50 | 38.09 |

| Absolute Timestamp | 1.38 | 2.87 | 11.30 | 9.11 | 16.41 |

| Ours (Relative Timestamp) | 1.26 | 2.15 | 5.56 | 2.78 | 11.63 |

关键结论:本文的相对时间戳模型在所有五个数据集(涵盖中英文)上都取得了最低的WER,表明引入相对时间戳预测能力并没有损害,反而可能增强了模型的语音识别主任务性能。

⚖️ 评分理由

- 学术质量:6.0/7 - 创新点清晰(相对时间表示、掩码训练),技术方案合理且工程化完整。实验设计充分,包含多个数据集、不同基线对比和细致的消融研究,结果令人信服。主要扣分项在于创新属于针对特定问题的“表示”和“训练技巧”层面的优化,而非底层模型架构或学习范式的突破。

- 选题价值:1.5/2 - 时间戳预测是语音大模型实用化的关键技术之一,本研究直接针对此痛点,提出的相对时间表示方法具有实用价值和启发意义。对从事语音识别、语音大模型、时序对齐研究的读者有较高参考价值。

- 开源与复现加成:0.5/1 - 论文提供了代码仓库链接(

https://github.com/tangquanwei/Timestamp-Aware-Speech-LLM),并给出了详细的训练数据、硬件、大部分超参数和训练策略,复现基础较好。但未提及模型权重是否公开,部分细节(如推理参数)缺失。