📄 Recovering Performance in Speech Emotion Recognition from Discrete Tokens Via Multi-Layer Fusion and Paralinguistic Feature Integration

#语音情感识别 #特征融合 #自监督学习 #预训练

✅ 6.5/10 | 前50% | #语音情感识别 | #特征融合 | #自监督学习 #预训练

学术质量 5.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 中

👥 作者与机构

- 第一作者:Esther Sun(卡内基梅隆大学,语言技术研究所)

- 通讯作者:未说明(三位作者邮箱均来自同一单位)

- 作者列表:Esther Sun(卡内基梅隆大学语言技术研究所)、Abinay Reddy Naini(卡内基梅隆大学语言技术研究所)、Carlos Busso(卡内基梅隆大学语言技术研究所)

💡 毒舌点评

这篇论文像一份非常详尽的“诊断与修复报告”,对离散token用于语音情感识别的“病症”(性能下降)诊断得非常清楚,并给出了“多层融合”和“特征补充”两剂对症药,实验证明药效不错。但美中不足的是,它没有给出自己这剂药的完整“配方”(关键训练细节缺失),让人想按方抓药时会遇到困难。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及是否公开微调后的WavLM或下游分类器权重。

- 数据集:使用MSP-Podcast v1.12,论文提供了引用信息([27, 28]),这是一个公开可获取的数据集。

- Demo:未提供在线演示。

- 复现材料:提供了部分实验设置(层配置、K值、特征列表),但缺少核心的训练超参数(如优化器、学习率、batch size)、模型初始化细节和完整的代码,复现难度较高。

- 论文中引用的开源项目:明确提及使用了WavLM(预训练模型)、OpenSMILE(特征提取工具)、以及对比实验中使用的SpeechTokenizer、DAC、EnCodec等模型。

- 开源计划:论文中未提及开源计划。

📌 核心摘要

- 问题:离散语音token因其存储效率和与大语言模型的兼容性而备受关注,但其在语音情感识别(SER)任务中的应用受限于量化过程中副语言信息的丢失。

- 方法核心:本文提出一种基于微调WavLM-Large的离散SER框架,并采用两种策略恢复信息:(1) 使用温度缩放的注意力机制动态融合来自不同Transformer层的离散token;(2) 将传统的OpenSMILE副语言特征(7类74维)离散化后,与语音token在特征层进行分层融合。

- 创新性:与多数仅分析最后一层或有限层的工作相比,本文系统评估了不同层配置和码本大小(K=256-4000)对性能的影响;创新性地将离散副语言特征引入融合框架,以显式补偿离散化损失。

- 主要实验结果:

- 在MSP-Podcast数据集的8类SER任务上,离散WavLM token相比连续特征性能下降6-14%。

- 多层融合能恢复约62%的性能损失(最佳Macro F1从0.3248提升至0.3479)。

- 结合OpenSMILE特征(特别是共振峰特征)后,最佳配置(L0-23层+共振峰)的Macro F1达到0.3534,恢复了约75%的离散-连续性能差距(连续基准为0.3624)。

- 主流神经编解码器(SpeechTokenizer, DAC, EnCodec)性能显著低于离散WavLM(最高仅0.1758)。

- 实际意义:研究证明,通过精心的特征层与架构层补偿,离散token在SER任务上可以接近连续表示的性能,这为构建兼容LLM的统一语音理解模型提供了可能性。

- 主要局限性:(1) 论文未报告与同领域其他先进离散token SER方法的直接定量对比;(2) 缺少关键的模型训练细节;(3) 提出的融合方法在概念上较为直接(注意力加权、特征拼接),未展示其在更复杂任务上的泛化性。

🏗️ 模型架构

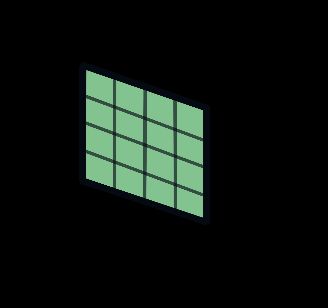

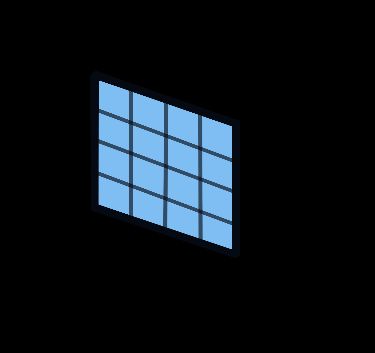

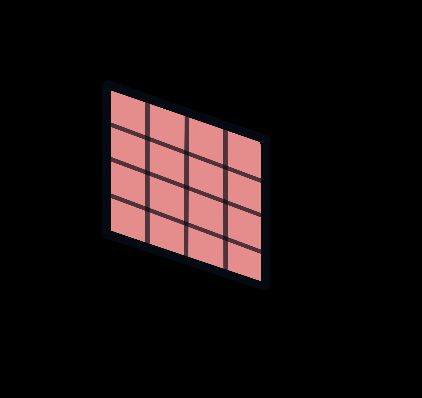

本文提出了三种核心架构,均共享下游的注意力池化与分类头(见图1)。

图1: 论文提出的离散SER框架。(a) 多层离散单元来自微调的WavLM,使用层级特定的码本。(b) 通过EnCodec, DAC和SpeechTokenizer进行神经编解码器tokenization。(c) 分层融合,通过量化后的OpenSMILE副语言特征增强离散语音表示。所有模型使用相同的下游架构(层注意力、池化、分类器)。

图1: 论文提出的离散SER框架。(a) 多层离散单元来自微调的WavLM,使用层级特定的码本。(b) 通过EnCodec, DAC和SpeechTokenizer进行神经编解码器tokenization。(c) 分层融合,通过量化后的OpenSMILE副语言特征增强离散语音表示。所有模型使用相同的下游架构(层注意力、池化、分类器)。

基础SSL离散架构 (图1(a)):

- 输入:原始波形。

- 流程:

- 特征提取:使用一个冻结且经过微调的WavLM-Large模型,从指定的Transformer层(如L0-L23)提取隐藏状态

H(ℓ) ∈ R^{T×D}。 - 量化:为每个选定的层

ℓ创建一个独立的K-Means码本C(ℓ) ∈ R^{K×D}。将每帧特征映射到最近的聚类中心索引z(ℓ)_t,并通过查表重建离散表示˜H(ℓ)_t = C(ℓ)_{z(ℓ)_t}。 - 融合:使用温度缩放的注意力机制融合多层离散表示。该机制通过掩码平均池化和可学习温度

τ的softmax计算动态权重α_l,并对输入进行层归一化以消除尺度差异。融合表示为H_fused = Σ α_l · ˆH_l。 - 分类:

H_fused经过注意力统计池化层,然后输入一个多层感知器(MLP)分类头进行情感预测。

- 特征提取:使用一个冻结且经过微调的WavLM-Large模型,从指定的Transformer层(如L0-L23)提取隐藏状态

- 关键设计:码本按层独立生成;融合时,注意力权重自适应地加权不同层的信息,理论上可以结合低层声学特征和高层语义特征。

神经编解码器架构 (图1(b)):

- 使用预训练且冻结的SpeechTokenizer、DAC或EnCodec作为特征提取器。

- 从其编码路径的多个残差向量量化(RVQ)层提取离散token(例如,SpeechTokenizer使用第2、4、8层)。

- 下游处理与上述SSL架构完全相同(层注意力、池化、分类),从而进行公平比较。

分层特征增强架构 (图1(c)):

- 在上述任何一种离散token(来自SSL或神经编解码器)的基础上进行增强。

- 增强特征:从音频中提取OpenSMILE的7类74维低级描述符(LLD),并为每类特征(如韵律、谱特征)使用单独的K-Means算法进行离散化,得到

H_OpenSMILE。 - 融合:将多层离散语音token融合后的表示

H_fused与离散化后的OpenSMILE特征H_OpenSMILE进行拼接。在拼接前,使用一个可学习的模态归一化器(包含LayerNorm和缩放参数γ_fused,γ_OpenSMILE)平衡两个模态的贡献。 - 动机:显式地将已知重要的副语言特征(通过传统信号处理方法提取)以离散形式重新注入模型,补偿编码器量化过程中的信息丢失。

💡 核心创新点

- 系统性的层与粒度分析:不同于先前工作通常只分析最后一层或有限几种配置,本文对WavLM全部24层在5种不同码本大小(K=256-4000)下的SER性能进行了详尽的对照实验。这提供了关于离散化影响的全面量化分析(如图2所示),揭示了单层离散化的局限性。

- 证据:图2显示,使用所有层的离散token(K=4000)Macro F1为0.3479,显著高于单层L23的0.3248。

- 注意力驱动的多层融合:提出使用温度缩放的注意力机制来自适应地融合来自不同Transformer层的离散表示。该机制学习为每层分配权重,以捕捉对情感识别最有用的多粒度信息。

- 收益:该策略成功恢复了约62%的离散化性能损失。图3的注意力权重分析显示,模型主要依赖最后两层(L22, L23, 占比约57%),但也利用了早期层的信息,验证了多层融合的有效性。

- 离散副语言特征集成:创新性地将传统的OpenSMILE副语言特征集进行离散化处理,并与离散语音token在特征层进行分层融合。这提供了一种不依赖于神经网络隐含学习,而是通过外部知识显式补充信息的方法。

- 收益:图4和表2显示,这种融合能进一步提升性能,特别是对于信息较少的稀疏层配置(如Sparse 6层提升最高)。最佳配置(L0-23 + 共振峰特征)Macro F1达到0.3534,恢复了约75%的性能差距。

- 多tokenizers对比研究:系统比较了基于SSL的离散token与主流神经编解码器(SpeechTokenizer, DAC, EnCodec)在相同SER任务下的表现,为任务选型提供了重要参考。

- 发现:神经编解码器性能远低于离散WavLM(最高0.1758 vs 最低0.3133),且多层融合和特征增强策略对其效果不佳,表明它们为音频重建优化的目标与情感识别需求不匹配。

🔬 细节详述

- 训练数据:使用MSP-Podcast语料库 v1.12版本。这是一个大规模自然主义情感语音数据库,包含207, 136个话语。实验任务为8类情感识别(愤怒、悲伤、快乐、惊讶、恐惧、厌恶、轻蔑、中性)。

- 损失函数:未明确说明具体公式,仅提及使用“加权交叉熵损失”进行训练。

- 训练策略:

- SSL特征提取器:WavLM-Large模型在MSP-Podcast数据集上进行了微调,但在本文实验中是冻结的。

- 下游训练:仅训练下游模块(层注意力、池化、MLP分类器)。“每个实验运行三次并报告平均结果”。

- 优化器、学习率、Batch Size、训练轮数/步数等关键细节均未说明。

- 关键超参数:

- 模型骨干:WavLM-Large。

- 码本大小K:尝试了{256, 512, 1000, 2000, 4000}。

- 层配置:测试了6种:All Layers (L0-L23), All but Last (L0-L22), Last Only (L23), Sparse (L1,3,7,12,18,23), Last 8 (L16-L23), 10-Layer set (L0,1,2,4,6,9,12,16,20,23)。

- 神经编解码器配置:SpeechTokenizer (16kHz), DAC (24kHz), EnCodec (bw 3.0/6.0/24.0 kbps)。

- OpenSMILE特征:74维,分7类,每类离散化时使用不同的码本大小(由肘部法则确定,见表1)。

- 训练硬件:未说明。

- 推理细节:未说明。

- 正则化技巧:未明确说明,但提及使用了层归一化(LayerNorm)来防止尺度变化影响注意力权重。

📊 实验结果

主要评估指标为Macro F1 Score,用于处理类别不平衡问题。

表2:综合SER性能(Macro F1 Score)对比

| 模型 | 无增强 | 韵律 | 声音质量 | MFCC | 谱特征 | 共振峰 | 听觉频带 | 其他 | 全特征 (基线) |

|---|---|---|---|---|---|---|---|---|---|

| Speech Tokenizer (ST-2) | 0.1486 | 0.1299 | 0.1313 | 0.1416 | 0.1567 | 0.1384 | 0.1344 | 0.1366 | 0.1510 |

| Speech Tokenizer (ST-4) | 0.1619 | 0.1214 | 0.1616 | 0.1447 | 0.1598 | 0.1432 | 0.1295 | 0.1485 | 0.1413 |

| Speech Tokenizer (ST-8) | 0.1758 | 0.1437 | 0.1681 | 0.1403 | 0.1533 | 0.1550 | 0.1397 | 0.1667 | 0.1675 |

| DAC (0,1) | 0.1011 | 0.1172 | 0.1129 | 0.1243 | 0.1147 | 0.1421 | 0.1149 | 0.1083 | 0.1432 |

| DAC (0,1,2,3) | 0.1187 | 0.1476 | 0.1144 | 0.1520 | 0.1141 | 0.1476 | 0.1412 | 0.1413 | 0.1423 |

| DAC [0-8] | 0.1159 | 0.1438 | 0.1166 | 0.1253 | 0.1066 | 0.1089 | 0.1244 | 0.1071 | 0.1376 |

| EnCodec (3.0kbps 4层) | 0.1575 | 0.1669 | 0.1702 | 0.1690 | 0.1720 | 0.1677 | 0.1743 | 0.1557 | 0.1755 |

| EnCodec (6.0kbps 8层) | 0.1599 | 0.1855 | 0.1531 | 0.1857 | 0.1624 | 0.1638 | 0.1662 | 0.1549 | 0.1728 |

| EnCodec (24.0kbps 32层) | 0.1550 | 0.1893 | 0.1323 | 0.1909 | 0.1541 | 0.1827 | 0.1363 | 0.1723 | 0.2005 |

| Discrete WavLM (L1,3,7,12,18,23) | 0.3371 | 0.3482 | 0.3436 | 0.3401 | 0.3501 | 0.3493 | 0.3447 | 0.3411 | 0.3498 |

| Discrete WavLM (L16-23) | 0.3420 | 0.3463 | 0.3439 | 0.3478 | 0.3497 | 0.3440 | 0.3440 | 0.3431 | 0.3505 |

| Discrete WavLM (L0-23) | 0.3441 | 0.3452 | 0.3467 | 0.3479 | 0.3493 | 0.3534 | 0.3483 | 0.3442 | 0.3461 |

| Discrete WavLM (L23) | 0.3120 | 0.3123 | 0.3126 | 0.3145 | 0.3183 | 0.3131 | 0.3101 | 0.3114 | 0.3126 |

(注:表格数据直接取自论文表2,为保持一致性,未做格式转换)

图2:离散化影响与多层融合效果

图2:不同WavLM层配置和码本大小(K)下的性能(Macro F1 Score)。红色线表示连续特征模型作为参考基线。

图2:不同WavLM层配置和码本大小(K)下的性能(Macro F1 Score)。红色线表示连续特征模型作为参考基线。

- 关键结论:连续特征性能稳定(~0.36)。离散token性能随配置变化波动,但多层融合(如All_layers)显著优于单层(Last_layer)。最佳离散性能(K=4000)仍低于连续基准。

图3:注意力权重分析

图3:所有24层WavLM注意力权重分析(K=1000, Macro F1=0.3441)。分布呈双峰:最后两层(L22�� L23)至关重要,同时一些早期层也有贡献。

图3:所有24层WavLM注意力权重分析(K=1000, Macro F1=0.3441)。分布呈双峰:最后两层(L22�� L23)至关重要,同时一些早期层也有贡献。

- 关键结论:模型学到了合理的层权重,主要依赖高层语义(最后两层占57%),但也整合了必要的低层声学信息。

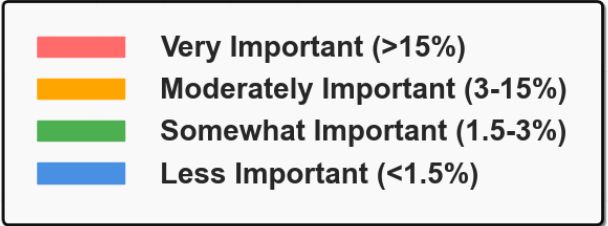

图4:OpenSMILE特征增强效果

图4:为离散WavLM模型(K=1000)添加副语言特征的性能提升(%)。结果显示出明显的逆关系:稀疏层配置(左)从显式副语言线索中获益最多,而密集配置(右)由于信息已较丰富,增益递减。

图4:为离散WavLM模型(K=1000)添加副语言特征的性能提升(%)。结果显示出明显的逆关系:稀疏层配置(左)从显式副语言线索中获益最多,而密集配置(右)由于信息已较丰富,增益递减。

- 关键结论:特征增强对信息不足的模型(如Sparse层)提升效果最显著(最高~4%)。共振峰和谱特征是提升最大的单类特征。

与最强基线差距:论文未直接与其它针对离散token的SER工作进行定量对比,因此无法给出具体差距数字。但从结果看,其提出的方法(离散WavLM+融合+增强)是有效的。

⚖️ 评分理由

- 学术质量:5.0/7:实验设计系统、全面,能够支撑其关于信息损失与恢复的论点。提出的融合策略虽然技术上并非全新,但针对问题的应用是合理的,且消融实验(如图4)清晰展示了各部分的贡献。主要不足在于模型核心创新性有限,以及训练关键细节缺失,降低了论文的深度和完全可复现性。

- 选题价值:1.5/2:直面语音AI领域中一个重要趋势(离散化)的痛点,研究如何保持下游任务性能。选题具有明确的实用价值和前沿性,对构建兼容大模型的统一语音理解框架有启发意义。

- 开源与复现加成:0.0/1:论文未提供代码、模型或训练脚本。虽然公开了数据集和特征工具,但缺失复现所需的超参数和训练流程细节,使得他人难以复现其全部结果。