📄 Purification Before Fusion: Toward Mask-Free Speech Enhancement for Robust Audio-Visual Speech Recognition

#音视频 #语音识别 #语音增强 #多任务学习 #端到端

✅ 7.5/10 | 前25% | #语音识别 | #多任务学习 | #音视频 #语音增强

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 中

👥 作者与机构

- 第一作者:Linzhi Wu (University of Electronic Science and Technology of China, Chengdu, China)

- 通讯作者:Xingyu Zhang (Defense Innovation Institute, Academy of Military Sciences, Beijing, China)

- 作者列表:

- Linzhi Wu (电子科技大学)

- Xingyu Zhang* (军事科学院国防创新研究院)

- Hao Yuan (北京大学)

- Yakun Zhang (军事科学院国防创新研究院)

- Changyan Zheng (High-tech Institute, Weifang, China)

- Liang Xie (军事科学院国防创新研究院)

- Tiejun Liu (电子科技大学)

- Erwei Yin (军事科学院国防创新研究院)

💡 毒舌点评

这篇论文提出了一个清晰的“先净化再融合”新范式,用端到端学习替代了脆弱的显式掩码生成,想法简洁有效,在LRS3数据集上也取得了不错的性能提升。然而,其最大的短板在于完全的“闭源”状态,没有提供代码、模型或训练细节,对于希望跟进或复现的读者来说,这意味着需要从零开始摸索架构细节和训练策略,极大增加了实践门槛。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:使用公开的LRS3数据集和NOISEX-92噪声库,但论文未提供具体获取方式。

- Demo:未提供。

- 复现材料:论文提供了一些超参数设置(层数、维度、学习率等)和课程学习策略,但缺少训练硬件信息、精确的代码库、配置文件及预训练模型链接,复现需较大努力。

- 论文中引用的开源项目:依赖预训练的ResNet18视觉前端(在LRW数据集上训练),以及在消融实验中使用了预训练的Whisper模型。

- 论文中未提及开源计划。

📌 核心摘要

- 问题:音频-视觉语音识别(AVSR)在高噪声环境下,直接的跨模态注意力机制容易受到噪声音频的干扰,导致融合效果差。现有的掩码去噪方法在抑制噪声时可能丢失语音语义信息。

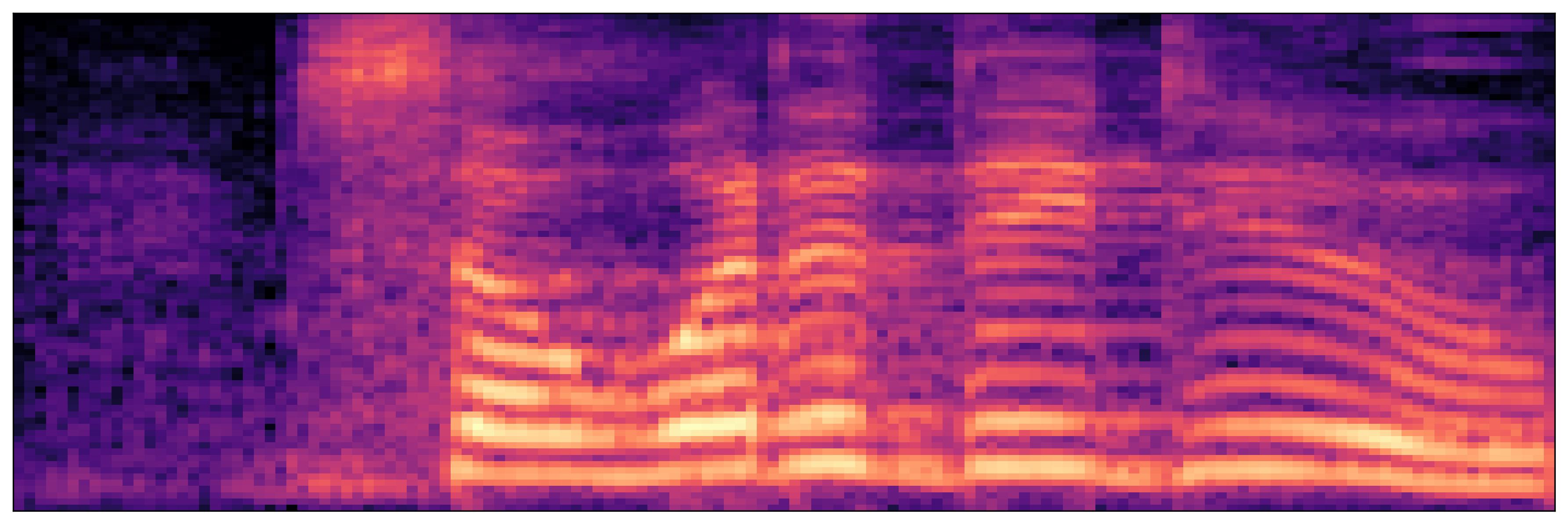

- 核心方法:本文提出一种“先净化,后融合”的无掩码框架。在特征融合前,引入一个基于“音频-视觉瓶颈Conformer”的辅助语音增强模块,利用少量可学习的瓶颈token在模态间传递精炼信息,并结合音频频谱重建目标,隐式地净化噪声音频特征。

- 创新点:首次将多模态瓶颈Conformer用于AVSR中的隐式去噪和跨模态交互。与显式掩码方法不同,该模型通过重建损失和感知损失联合优化,旨在让增强后的音频特征对后续的语音识别任务更友好,而非单纯的频谱保真。

- 实验结果:在LRS3基准测试的多种噪声条件下(SNR从-5dB到15dB),本文方法在平均WER(词错误率)上优于AV-RelScore、Joint AVSE-AVSR等先进的掩码基线方法。例如,在平均WER上达到3.9%,比不使用增强模块的版本(5.6%)和最强基线AV-RelScore(4.3%)均有提升。消融实验证明了瓶颈token数量(最佳为4个)和组合损失函数的有效性。

- 实际意义:为噪声鲁棒的AVSR系统提供了一种新的、无需显式噪声掩码的设计思路,通过联合优化语音增强和识别目标,可能更有效地保留语义信息,提升系统在复杂声学环境中的可靠性。

- 局限性:方法引入了额外的语音增强模块,可能增加模型计算开销。瓶颈token的最优数量可能随任务变化。论文未提供代码和模型,限制了可复现性和快速验证。实验仅在英语数据集LRS3上进行,其对其他语言的泛化能力未验证。

🏗️ 模型架构

论文提出的噪声鲁棒AVSR框架整体架构如图1所示。它以视频(唇部RoI序列)和噪声音频(梅尔频谱)为输入,输出文本转录,无需生成显式的噪声掩码。模型主要分为四个阶段:

- 前端特征提取:

- 视觉前端:使用3D卷积(5x7x7核)+ ResNet18提取时空特征,再通过一个3层Conformer编码器,输出视觉特征

hv ∈ R^(Nv×d)。 - 音频前端:噪声音频梅尔频谱先经过两层1D子采样卷积降低时间维度,再通过一个3层Conformer编码器,输出音频特征

ha ∈ R^(Na×d)。

- 视觉前端:使用3D卷积(5x7x7核)+ ResNet18提取时空特征,再通过一个3层Conformer编码器,输出视觉特征

- 音频-视觉瓶颈Conformer(AVBC):这是核心的净化与交互模块,包含L层。它引入一组数量远小于模态序列长度(K « Na, Nv)的可学习瓶颈token

b0。在每一层l,视觉Conformer和音频Conformer分别处理各自特征与瓶颈token的拼接(hl_v∥bl,hl_a∥bl),得到更新后的模态特征和瓶颈token。然后,瓶颈token取两种模态处理结果的平均值:bl+1 = (bl+1_v + bl+1_a)/2。如此迭代,最终得到净化后的视觉特征zv和音频特征za。此设计强制所有跨模态信息流都必须经过少量的瓶颈token,促使模型压缩冗余、共享本质内容,从而利用视觉信息引导音频去噪,并降低了注意力计算复杂度。 - 语音特征增强:利用净化后的音频特征

za,通过一个1D亚像素卷积层上采样,重建出干净梅尔频谱ˆxa。此过程由L1重建损失(Lrecon)和感知损失(Lpercep,使用自定义音频前端提取特征)联合监督(Lenhance)。 - 融合与识别:将净化后的特征

za和zv沿时间维度拼接,输入到一个多模态Conformer编码器(θf)进行深度融合,得到融合特征fa和fv。这些特征随后被送入CTC投影层和Transformer解码器,通过混合CTC/注意力损失(LAVSR)进行文本预测。整个框架的总损失为识别损失与增强损失之和:Ltotal = LAVSR + Lenhance。

💡 核心创新点

- 提出“先净化后融合”的无掩码范式:与现有依赖显式掩码网络抑制噪声的方法不同,本文主张在深度融合前先对音频特征进行净化。该范式避免了掩码生成过程中的信息丢失风险,旨在为后续融合提供更干净、语义完整的特征。

- 设计音频-视觉瓶颈Conformer(AVBC)用于隐式去噪:将多模态瓶颈注意力机制创新性地应用于AVSR的特征净化阶段。通过少量瓶颈token作为信息交换的“门户”,高效地实现跨模态交互,使视觉模态能够引导音频特征的净化,同时压缩了注意力计算量。

- 引入基于重建和感知损失的语音增强目标:框架中集成了一个辅助的语音增强模块,并通过

Lrecon和Lpercep进行优化。关键创新在于,该增强模块与AVSR主任务联合训练,其损失会反向传播,迫使生成的音频特征不仅追求频谱保真度,更要对下游识别任务有利。

🔬 细节详述

- 训练数据:在LRS3数据集上评估,包含约439小时TED演讲视频。训练时使用NOISEX-92数据库的白噪声、粉噪、工厂噪声、人群噪声等,并从训练集中提取人声重叠噪声,在{-7.5, -2.5, 2.5, 7.5, 12.5, 17.5} dB的SNR范围内与干净音频混合。采用课程学习策略:前20个epoch仅用高SNR(7.5-17.5dB)数据训练主AVSR目标,之后使用全SNR范围数据并加入增强目标联合训练。

- 损失函数:

Lenhance = α1Lrecon + α2Lpercep,其中α1=α2=0.1。Lrecon是重建频谱与干净频谱的L1距离;Lpercep是重建频谱与干净频谱经音频前端提取的高维特征之间的L2距离。LAVSR = λLctc + (1-λ)Latt,其中λ=0.1。- 总损失

Ltotal = LAVSR + Lenhance。

- 训练策略:使用AdamW优化器,批大小为16,训练70个epoch。初始学习率为0.001,采用余弦退火调度并带线性预热。

- 关键超参数:每个模态的Conformer编码器均为3层,隐藏维度512,前馈维度2048,注意力头数4,卷积核大小31。Transformer解码器为6层,隐藏维度512。瓶颈token数量K=4。瓶颈token用均值为0、标准差为0.02的高斯分布初始化。

- 训练硬件:论文中未说明GPU/TPU型号、数量及训练时长。

- 推理细节:对最后10个checkpoint进行模型平均。解码采用宽度为40的束搜索,并使用预训练的GPT-2语言模型进行束重评分。

- 正则化与稳定技巧:采用课程学习(先高SNR,后全SNR)以稳定训练;使用预训练的视觉前端(在LRW上训练);瓶颈token数量远小于序列长度以控制复杂度。

📊 实验结果

所有实验在LRS3测试集上进行,主要评估指标为词错误率(WER),数值越低越好。

表2:不同噪声水平下与竞争方法的WER(%)比较

| 方法 | SNR (dB) | 平均 | |||||

|---|---|---|---|---|---|---|---|

| clean | 15 | 10 | 5 | 0 | -5 | ||

| EG-Seq2Seq [29] | 6.8 | 3.3 | 3.9 | 5.8 | 12.2 | 27.3 | 9.9 |

| Conformer [2] | 3.2 | 3.6 | 5.4 | 8.3 | 14.6 | 22.3 | 9.6 |

| V-CAFE [4] | 2.9 | 3.0 | 4.0 | 8.4 | 12.5 | 19.3 | 8.4 |

| Joint AVSE-AVSR [11] | 2.0 | 2.4 | 2.9 | 4.1 | 8.0 | 19.4 | 6.5 |

| AV-RelScore [12] | 2.8 | 2.9 | 2.9 | 3.3 | 4.8 | 9.0 | 4.3 |

| Ours (w/o enh) | 2.3 | 3.1 | 3.8 | 4.6 | 6.7 | 12.8 | 5.6 |

| Ours | 2.1 | 2.4 | 2.6 | 3.2 | 4.5 | 8.5 | 3.9 |

结论:本文提出的完整模型(Ours)在所有噪声条件下均取得了最低的平均WER(3.9%),优于所有对比的先进方法,包括最新的掩码基线AV-RelScore(4.3%)。随着SNR降低(噪声增强),优势更为明显。

表1:不同损失函数组合对WER的影响(-5dB人声噪声下)

| 基线 | Lrecon | Lpercep (音频前端) | WER (%) |

|---|---|---|---|

| ✓ | – | – | 12.8 |

| ✓ | ✓ | – | 11.2 |

| ✓ | – | ✓ | 10.8 |

| ✓ | ✓ | ✓ | 8.5 |

| 基线 | Lrecon | Lpercep (Whisper) | WER (%) |

|---|---|---|---|

| ✓ | – | – | 12.8 |

| ✓ | ✓ | – | 11.2 |

| ✓ | – | ✓ | 9.5 |

| ✓ | ✓ | ✓ | 7.9 |

结论:结合Lrecon和Lpercep能带来最佳性能。使用预训练Whisper作为Lpercep的特征提取器效果更好(7.9% vs 8.5%),但考虑到计算开销,论文最终选择了音频前端。

图2:不同瓶颈token数量对性能的影响(-5dB人声噪声)

结论:瓶颈token数量为4时模型性能最好(WER最低)。token太少信息交换不足,太多则可能引入冗余,降低模型聚焦关键信息的能力。

结论:瓶颈token数量为4时模型性能最好(WER最低)。token太少信息交换不足,太多则可能引入冗余,降低模型聚焦关键信息的能力。

表3:不同输入条件下的WER(%)比较

| 输入条件 | 清洁音频 | 重叠语音 (SNR=-5dB) | ||

|---|---|---|---|---|

| w/ vid | w/o vid | w/ vid | w/o vid | |

| Unified-Attention [9] | 2.4 | 2.7 | 11.3 | 27.4 |

| Ours (w/o enh) | 2.3 | 2.5 | 10.7 | 25.9 |

| Ours | 2.1 | 2.2 | 9.6 | 24.6 |

结论:在清洁音频下,有无视频影响不大。在重叠语音(强噪声)下,视频模态至关重要,能帮助“选择”目标语音。本文方法(即使无增强模块)也优于基线Unified-Attention,表明瓶颈token设计本身有助于鲁棒性。

⚖️ 评分理由

- 学术质量:6.0/7:论文提出了有创意的“无掩码净化”范式,并设计了有效的瓶颈Conformer模块。技术方案合理,实验设计全面,包括了噪声鲁棒性对比、充分的消融研究(损失函数、token数量)以及不同输入条件的泛化测试,数据清晰,结论可信。主要扣分点在于,未能与更多同领域最新工作(如2024年后的SOTA)进行直接对比,且部分实现细节(硬件、部分超参数如卷积核具体步长)未完全公开,略显遗憾。

- 选题价值:1.5/2:噪声鲁棒的语音识别是长期且关键的挑战。本文从多模态融合的角度切入,提出的联合学习框架具有理论意义和应用潜力,对相关领域的研究者有明确的参考价值。

- 开源与复现加成:0.0/1:论文未提供代码仓库、模型权重、训练日志或详细的环境配置。虽然列出了部分依赖的开源项目,但核心模型的实现细节需要读者自行从论文中复现,这大大降低了其即时可用性和验证效率。