📄 Prompt-Guided Mixture-of-Experts for Robust Multimodal Sentiment Analysis with Missing Modalities

#语音情感识别 #多模态模型 #混合专家模型 #低资源 #知识蒸馏 #鲁棒性

🔥 8.5/10 | 前25% | #语音情感识别 | #混合专家模型 | #多模态模型 #低资源

学术质量 6.5/7 | 选题价值 1.8/2 | 复现加成 0.2 | 置信度 中

👥 作者与机构

- 第一作者:Ziqi Shu (厦门大学电影学院)

- 通讯作者:Qingfeng Wu (厦门大学电影学院)

- 作者列表:Ziqi Shu† (厦门大学电影学院), Rongzhou Zhou† (厦门大学电影学院), Xiaodong Wang (厦门大学电影学院), Qingfeng Wu⋆ (厦门大学电影学院), Lu Cao (厦门大学)

💡 毒舌点评

亮点在于将MoE架构与Prompt生成、置信度加权相结合,为缺失模态问题提供了一个模块化且有理论深度的解决方案,且跨数据集、跨骨干网络的泛化性验证比较扎实。短板是论文对“生成式Prompt如何有效补偿缺失信号”这一核心假设的论证略显薄弱,更像一个工程组合而非原理上的突破,且完全未开源代码,对于声称解决实际问题的工作来说,可复现性大打折扣。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:使用了CMU-MOSI, MOSEI, IEMOCAP, CH-SIMS四个公开数据集。

- Demo:未提及。

- 复现材料:提供了方法的核心公式、训练流程(如使用Adam、随机丢弃率70%、LoRA)和部分消融实验设置,但缺少具体超参数(如学习率、batch size、专家数量、损失权重)和硬件信息。

- 论文中引用的开源项目:提到了MulT [21]作为骨干网络,其代码应为公开。论文本身未声明开源计划。

📌 核心摘要

本文针对多模态情感识别中普遍存在的模态缺失问题,提出了一个名为PMoE(Prompt-guided Mixture-of-Experts)的鲁棒识别框架。该方法的核心在于,在冻结的预训练Transformer主干网络基础上,引入三个关键组件:1)一个基于生成式Prompt和置信度加权融合的缺失模态补偿方案,用于生成并动态融合缺失模态的可靠表示;2)一个具有两阶段动态路由机制的MoE层,通过模态特定专家和共享专家池实现灵活的跨模态特征融合;3)一个自蒸馏策略,利用历史模型输出作为软目标来稳定训练和提升泛化能力。与已有方法(如MCTN、MMIN、MPLMM等)相比,PMoE首次将Prompt引导的生成、置信度评估、MoE的动态专家选择以及知识蒸馏有机结合,更系统地应对信息补偿、融合不稳定和训练泛化三大挑战。实验在CMU-MOSI、MOSEI、IEMOCAP和CH-SIMS四个基准数据集上进行,结果表明PMoE在各种模态缺失场景下(尤其是严重缺失时)均取得最优的准确率和F1分数。例如,在MOSEI数据集上,其平均准确率比最强基线MPLMM高出1.34%。该工作的实际意义在于为真实世界中因设备、隐私等原因导致的模态不完整场景提供了一个高效、鲁棒的情感分析解决方案。主要局限性在于:缺失模态生成器的性能高度依赖跨模态映射和注意力机制的有效性,可能在模态差异巨大时失效;论文未提供代码,限制了复现和验证。

🏗️ 模型架构

图1展示了PMoE的整体框架。其数据处理流程如下:

图1展示了PMoE的整体框架。其数据处理流程如下:

- 输入映射与缺失模态生成:对于每个模态(文本T, 音频A, 视频V),首先通过模态特定的连接器将其映射到共享语义空间。当某个模态缺失时(例如音频缺失),通过一个跨模态注意力机制,利用存在的模态(视频和文本)生成缺失模态的表示(公式1-7)。生成过程中引入了“生成式Prompt”(P_Ga)。

- 统一表示构建与Prompt注入:结合观察到的特征、生成的缺失特征(通过置信度分数c_a进行加权融合,公式11-12),以及两层Prompt(局部信号Prompt和全局类型Prompt融合而成的统一Prompt P_Unified, 公式8-12),形成统一的输入表示z‘。

- 双分支处理:z‘被送入两个并行分支:

- 冻结的Transformer主干:提供稳定的跨模态特征,作为类似“教师”的辅助特征来源,其参数不更新。

- 可训练的MoE层:这是核心的“学生”分支。原始Transformer中的前馈网络(FFN)被MoE模块替代。

- 两阶段动态路由与MoE融合:MoE层内进行两级路由。第一级:根据模态指示符将令牌路由到对应的模态特定专家组(E_m)和共享专家池(S)。第二级:在每个组内,路由器(公式14)计算亲和度分数,选择Top-k个专家。最终输出由模态特定专家和共享专家的加权和得到(公式15, 平衡系数α, β)。

- 分类与自蒸馏:MoE输出的最终特征y(x)送入分类器得到预测。训练时,采用自蒸馏策略:将历史模型的输出(z_prev)作为软目标,通过KL散度损失(L_KD, 公式17)约束当前模型(z_S)的输出,以稳定训练。

整个框架在微调阶段只更新Prompt参数、模态连接器、MoE专家和路由器的参数,而保持预训练Transformer主干冻结。

💡 核心创新点

- Prompt引导的缺失模态生成与置信度加权融合:不同于简单的填充或翻译重建,该工作设计了一个包含跨模态注意力、生成式Prompt和局部自注意力的生成器来补偿缺失模态。更重要的是,引入置信度分数c_a动态权衡生成特征与观察特征,避免了不可靠的生成信息污染整体表示。

- 两阶段动态路由的MoE架构:将MoE应用于多模态融合,并设计了独特的两级路由:先按模态分组路由,再在组内按亲和度选择Top-k专家。这使得模型能灵活地为不同模态缺失情况选择合适的专家组合(模态特定专家捕捉细粒度特征,共享专家编码跨模态共性),提升了在模态不完整数据上的适应性。

- 用于鲁棒训练的自蒸馏策略:针对在小型情感数据集上微调可能不稳定的问题,引入自蒸馏。利用自身的历史输出作为软监督信号,平滑优化过程,并帮助新模块(Prompt, MoE)在迁移预训练知识时保持稳定,增强泛化能力。

🔬 细节详述

- 训练数据:使用了四个公开多模态情感数据集:CMU-MOSI (2199 clips), CMU-MOSEI (>23500 utterances), IEMOCAP (302 videos), CH-SIMS (2281 segments)。预处理策略遵循文献[13]。数据增强策略为:在训练时以η = 70%的概率随机丢弃模态,模拟缺失情况。

- 损失函数:总损失函数为

L_total = L_task + λ L_aux + λ_KD L_KD。L_task:标准的交叉熵分类损失,用于情感识别任务。L_aux:路由平衡正则化损失,鼓励专家使用多样性,防止路由坍缩。具体形式未在文中给出。L_KD:基于KL散度的自蒸馏损失(公式17),使用温度τ对历史输出和当前输出进行软化。- λ 和 λ_KD 为损失权重,具体值未说明。

- 训练策略:

- 优化器:Adam。

- 微调范围:仅更新Prompt参数、模态连接器(Connectors)、MoE层中的专家参数和路由参数。对专家和路由参数应用了LoRA(低秩适配)进行高效微调。

- 骨干网络:使用了在CMU-MOSEI上预训练的MulT [21]作为冻结的Transformer主干。

- 训练轮数、学习率、warmup策略等未具体说明。

- 关键超参数:

- 模态随机丢弃率:η = 70%。

- MoE中Top-k选择的具体k值未说明。

- 平衡超参数α, β 未说明具体值。

- 自蒸馏温度τ未说明具体值。

- 模态专家数量N_m和共享专家数量N_S未说明。

- 训练硬件:论文中未提及GPU/TPU型号、数量或训练时长。

- 推理细节:论文中未提及推理时的特殊设置(如解码策略、beam search等),推测使用分类头进行直接预测。

- 正则化或稳定训练技巧:自蒸馏策略本身即为一种稳定训练的技巧。路由平衡损失(L_aux)用于防止专家坍缩。

📊 实验结果

论文在四个数据集上,针对6种模态缺失组合(单模态:{a}, {v}, {t};双模态:{a,v}, {a,t}, {v,t})以及全模态(论文中未直接列出,但“Avg.”应包含)进行了实验,主要指标为准确率(ACC)和F1分数。

表1: 多种方法在四个数据集上的性能比较

| 数据集 | 方法 | {a} ACC | {a} F1 | {v} ACC | {v} F1 | {t} ACC | {t} F1 | {a,v} ACC | {a,v} F1 | {a,t} ACC | {a,t} F1 | {v,t} ACC | {v,t} F1 | Avg. ACC | Avg. F1 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| MOSI | MCTN(19’) | 51.32 | 56.12 | 54.27 | 56.33 | 79.63 | 79.78 | 56.79 | 57.84 | 78.96 | 79.17 | 80.45 | 80.65 | 66.90 | 68.32 |

| MMIN(21’) | 59.16 | 60.12 | 61.01 | 61.98 | 80.10 | 80.16 | 63.79 | 64.08 | 80.50 | 80.33 | 80.46 | 80.63 | 70.84 | 71.22 | |

| MPMM(23’) | 57.26 | 59.35 | 58.63 | 59.12 | 79.81 | 80.10 | 60.54 | 61.33 | 79.89 | 79.84 | 80.74 | 80.93 | 69.48 | 70.11 | |

| MPLMM(24’) | 62.71 | 63.65 | 63.12 | 63.74 | 80.12 | 80.31 | 65.02 | 65.41 | 80.76 | 81.09 | 81.12 | 81.19 | 72.14 | 72.57 | |

| PMoE(ours) | 63.12 | 63.61 | 63.22 | 63.83 | 80.97 | 80.78 | 66.91 | 67.53 | 82.43 | 82.88 | 81.62 | 81.91 | 73.05 | 73.42 | |

| MOSEI | MCTN(19’) | 66.19 | 68.58 | 66.70 | 69.01 | 78.32 | 78.41 | 68.10 | 69.34 | 79.11 | 79.14 | 78.65 | 78.64 | 72.85 | 73.94 |

| MMIN(21’) | 67.11 | 68.67 | 67.01 | 69.31 | 78.67 | 78.71 | 68.17 | 69.74 | 79.94 | 79.96 | 79.32 | 79.29 | 73.37 | 74.39 | |

| MPMM(23’) | 66.94 | 68.74 | 67.21 | 69.27 | 78.21 | 78.30 | 68.11 | 69.79 | 79.41 | 79.47 | 79.63 | 79.71 | 73.25 | 74.17 | |

| MPLMM(24’) | 67.33 | 68.71 | 67.29 | 69.40 | 79.12 | 79.17 | 68.21 | 69.91 | 80.45 | 80.43 | 80.11 | 80.13 | 73.75 | 74.68 | |

| PMoE(ours) | 68.72 | 69.09 | 67.31 | 70.01 | 79.91 | 79.84 | 70.76 | 71.82 | 81.98 | 81.59 | 81.83 | 81.77 | 75.09 | 75.69 | |

| IEMOCAP | MCTN(19’) | 51.62† | - | 45.73† | - | 63.78† | - | 55.84† | - | 69.46† | - | 68.34† | - | 59.19† | - |

| MMIN(21’) | 59.00† | - | 51.60† | - | 68.02† | - | 65.43† | - | 75.14† | - | 73.61† | - | 65.47† | - | |

| MPMM(23’) | 58.69 | 57.66 | 55.18 | 55.36 | 68.39 | 68.08 | 63.68 | 63.47 | 74.90 | 74.98 | 73.80 | 72.67 | 65.77 | 65.37 | |

| MPLMM(24’) | 59.77 | 59.71 | 57.61 | 56.98 | 69.23 | 69.28 | 67.26 | 67.37 | 75.98 | 75.44 | 74.68 | 74.51 | 67.42 | 67.22 | |

| PMoE(ours) | 60.08 | 60.13 | 58.35 | 58.19 | 70.12 | 70.01 | 68.91 | 69.24 | 76.59 | 76.34 | 75.99 | 75.79 | 68.34 | 68.28 | |

| CH-SIMS | MCTN(19’) | 64.39 | 76.48 | 64.12 | 76.34 | 77.78 | 77.92 | 63.47 | 73.11 | 76.68 | 76.71 | 77.21 | 77.36 | 70.61 | 76.32 |

| MMIN(21’) | 65.21 | 77.09 | 65.32 | 77.41 | 78.91 | 78.67 | 64.28 | 73.36 | 77.32 | 77.33 | 77.40 | 77.48 | 71.41 | 76.89 | |

| MPMM(23’) | 64.98 | 76.41 | 65.40 | 77.92 | 78.56 | 78.65 | 64.01 | 73.47 | 77.11 | 77.20 | 77.51 | 77.47 | 71.26 | 76.85 | |

| MPLMM(24’) | 65.93 | 77.10 | 66.02 | 78.86 | 79.75 | 78.74 | 65.28 | 74.02 | 77.45 | 77.84 | 77.97 | 77.95 | 72.07 | 77.42 | |

| PMoE(ours) | 66.47 | 77.59 | 67.13 | 79.77 | 80.14 | 79.52 | 67.12 | 75.83 | 77.90 | 78.18 | 78.82 | 78.99 | 72.93 | 78.31 |

关键结论:PMoE在所有数据集、几乎所有缺失模态设置下均取得最佳性能。优势在严重缺失(如只有文本{t}或只有视频{v})时尤为明显。例如,在MOSEI上,PMoE的平均ACC(75.09%)比最强的基线MPLMM(73.75%)高出1.34%。

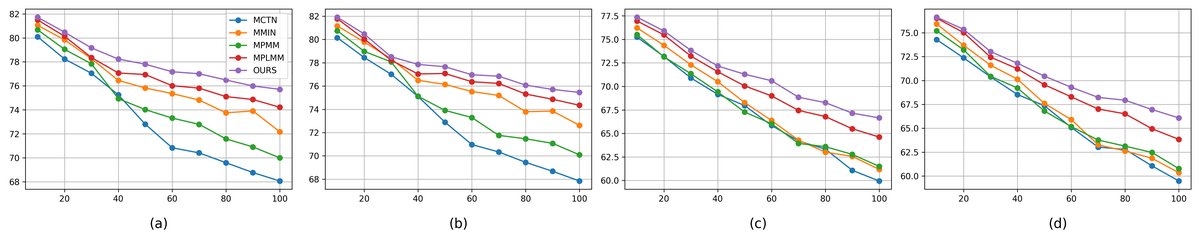

图2展示了在CMU-MOSI和IEMOCAP数据集上,随着模态缺失率从0%增加到100%,不同方法准确率和F1分数的变化曲线。关键结论是:PMoE(红色曲线)在高缺失率(>60%)下,性能下降的斜率最缓,展现出最强的鲁棒性。

图2展示了在CMU-MOSI和IEMOCAP数据集上,随着模态缺失率从0%增加到100%,不同方法准确率和F1分数的变化曲线。关键结论是:PMoE(红色曲线)在高缺失率(>60%)下,性能下降的斜率最缓,展现出最强的鲁棒性。

表2: 在CMU-MOSI数据集上集成PMoE前后的性能对比

| 设置 | 骨干模型 | 原始性能 | +PMoE后���能 | 提升 (ACC/F1) |

|---|---|---|---|---|

| 完整模态 | MMIM | 84.82/84.13 | 85.02/85.13 | +0.20/+1.00 |

| UniMSE | 86.73/86.95 | 87.12/87.25 | +0.39/+0.30 | |

| Acformer | 86.35/86.67 | 86.88/86.98 | +0.53/+0.31 | |

| 缺失模态 | MMIM | 68.49/67.35 | 73.62/72.80 | +5.13/+5.45 |

| UniMSE | 70.08/69.93 | 75.26/74.82 | +5.18/+4.89 | |

| Acformer | 71.32/71.21 | 75.14/75.01 | +3.82/+3.80 |

关键结论:将PMoE框架应用于三个不同的骨干网络(MMIM, UniMSE, Acformer),无论是在完整模态还是缺失模态下,性能均有提升,且在缺失模态下提升幅度(3.82%-5.45%)远大于完整模态下的提升(0.20%-0.53%),证明了PMoE作为即插即用模块的有效性和泛化能力。

表3: 消融实验(CMU-MOSI数据集,缺失率50%)

| 模型配置 | 准确率 (%) | F1 (%) |

|---|---|---|

| 完整模型 | 77.81 | 77.66 |

| - 去掉MoE层 | 75.95 | 76.08 |

| - 去掉生成与Prompt机制 | 76.73 | 76.89 |

| - 去掉自蒸馏策略 | 76.91 | 76.88 |

| - 去掉MoE层 + 生成与Prompt | 75.24 | 75.32 |

| - 去掉MoE层 + 自蒸馏策略 | 75.66 | 75.73 |

| - 去掉生成与Prompt + 自蒸馏策略 | 76.01 | 75.95 |

| - 去掉所有增强模块(基础模型) | 74.92 | 74.71 |

关键结论:每个模块的移除都会导致性能下降,证明了各组件的有效性。移除MoE层和生成与Prompt机制的组合(-1.86% ACC)造成的下降最大,说明这两个模块是核心且具有协同作用。

⚖️ 评分理由

- 学术质量:6.5/7:论文提出了一个结构完整、设计合理的多组件框架来解决一个明确的工程问题。技术细节(如两级路由、置信度加权)描述清晰。实验覆盖全面,包括多数据集、多缺失场景、模型泛化性和详尽的消融实验,结果具有说服力。主要不足在于部分关键超参数和训练细节未公开,影响透明度;且生成模态的有效性假设较强,缺乏更深入的分析或验证。

- 选题价值:1.8/2:多模态情感分析是活跃的研究领域,处理“缺失模态”这一现实挑战对技术的落地应用至关重要。该工作具有明确的应用导向和实用价值。选题聚焦且具有针对性。

- 开源与复现加成:0.2/1:论文未提供代码、预训练模型或详细的配置信息,仅描述了方法和部分实验设置。这使得其他研究者难以直接复现和验证其结果,是显著的短板。微小的正分基于其引用的公开数据集和骨干网络。