📄 Proficiency-Aware Adaptation and Data Augmentation for Robust L2 ASR

#语音识别 #多任务学习 #数据增强 #领域适应 #语音大模型

✅ 6.5/10 | 前25% | #语音识别 | #多任务学习 | #数据增强 #领域适应

学术质量 5.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 中

👥 作者与机构

- 第一作者:Ling Sun(印第安纳大学布卢明顿分校语言学系)

- 通讯作者:Shuju Shi(印第安纳大学布卢明顿分校语言学系,邮箱:shi16@iu.edu)

- 作者列表:Ling Sun(印第安纳大学布卢明顿分校语言学系),Charlotte Zhu(印第安纳大学布卢明顿分校语言学系),Shuju Shi(印第安纳大学布卢明顿分校语言学系)

💡 毒舌点评

本文最大的亮点在于首次系统性地揭示了通用ASR模型在面对不同语言能力等级(CEFR)的L2学习者时存在的性能不公平问题,并通过实验证明简单的微调反而会加剧这种不公平,这为公平AI在语音领域的应用敲响了警钟。然而,其提出的解决方案(多任务学习与SpecAug)相对常规,且所有实验都依赖于一个未公开的、内部使用的Speak & Improve语料库,这使得其结论的普适性和可复现性大打折扣,更像是一份针对特定产品的内部改进报告。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:使用了Speak & Improve (S&I)语料库,论文中未提供公开获取该数据集的途径或说明其是否公开。

- Demo:未提及。

- 复现材料:未提供详细的训练配置、超参数搜索过程、检查点信息或附录中的补充实验细节。

- 论文中引用的开源项目:

- Whisper模型(OpenAI)

- LoRA技术(Microsoft Research)

- SpecAugment技术(Google Research)

- 总结:论文中未提及任何开源计划,可复现性低。

📌 核心摘要

问题:通用自动语音识别(ASR)模型在非典型说话者,特别是第二语言(L2)学习者上表现不佳,且现有的适应性微调方法可能会进一步加剧不同语言能力水平学习者之间的性能差距,带来不公平性。

方法核心:论文提出两种策略:(1) 能力等级感知的多任务学习,在训练ASR主任务的同时,加入一个辅助分类任务来预测说话者的CEFR能力等级;(2) 针对性数据增强,仅对数据量稀缺的低能力(A2级)语音应用频谱图掩蔽(SpecAug),以平衡数据分布。

创新性:与主要关注口音(音段偏差)的现有工作不同,本文首次系统地将能力等级(包含音段和超音段/时序偏差) 作为关键潜在变量进行建模,并揭示了能力等级无关适应的风险。

实验结果:在Speak & Improve语料库上,所提出的组合策略(Multi+Data)将平均词错误率(WER)从基线的10.2%降至7.2%(相对降低29.4%),并显著降低了对低能力学习者伤害最大的插入/删除错误(相对降低达58.6%)。关键结果如下表所示:

模型 整体WER(评估集) 基线 (Whisper-small) 10.2% LoRA 9.2% 多任务学习 8.1% 数据增强 7.4% 多任务学习 + 数据增强 7.2% 实际意义:该研究推动了更公平、更鲁棒的ASR系统开发,有助于改善语言学习平台、辅助技术等场景中对不同水平用户的支持,具有教育和社会包容性价值。

主要局限性:(1) 实验完全依赖于一个未公开的Speak & Improve语料库;(2) 数据集本身存在严重的类别不平衡(A2级仅占2.7%),虽然方法旨在缓解,但仍是主要限制;(3) 仅在Whisper-small模型上进行验证,未探索更大规模模型的潜力。

🏗️ 模型架构

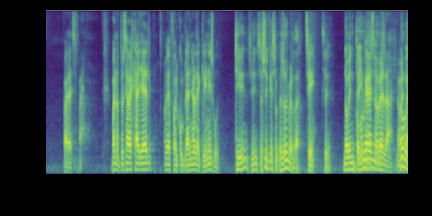

论文的模型架构演进清晰,如图2所示。

- 基线 (Baseline):标准的Whisper-small模型。输入是音频的log-mel频谱图,经过Whisper的编码器和解码器,输出文本转录(ASR损失)。

- LoRA:在Whisper的注意力(Attention)和前馈网络(FFN)的投影矩阵中插入低秩适配(LoRA)模块。仅训练这些小模块,冻结模型主体参数。数据流与基线相同,但部分参数被LoRA适配器替代。

- 多任务LoRA (Multitask LoRA):在LoRA架构基础上,于编码器末端添加一个轻量级多层感知机(MLP)分类器。编码器的最终状态经过均值池化后,同时输入给解码器(用于ASR)和MLP分类器(用于能力等级分类)。训练时,ASR损失(L_ASR)和分类损失(L_CLS)按权重(λ1=0.9, λ2=0.1)相加,共同更新编码器和LoRA适配器;解码器仅由L_ASR更新。

- 多任务 + 数据增强 (Multi+Data LoRA):在架构上与多任务LoRA相同,但在训练数据流中,对来自低能力等级(A2)的语音样本应用频谱图掩蔽(SpecAug) 数据增强。具体做法是在log-mel特征图上随机遮蔽连续的时间片和频率条。在推理时,增强被禁用。

关键设计选择:

- LoRA:采用参数高效微调,旨在最小化对预训练模型知识的遗忘,让性能提升主要归因于对L2语音的暴露。

- 多任务学习:动机是显式地让模型感知能力等级这一关键变量,从而学习到更条件化的声学表征,而非将其视为噪声。

- 针对性SpecAug:动机有二:(1) 解决A2数据稀缺问题;(2) SpecAug只改变局部声学特征,不改变全局的能力等级标签(如语速、停顿模式),因此可以安全地用于数据扩充。

💡 核心创新点

- 系统性地揭示ASR性能随能力等级(CEFR)变化:通过在分级数据集上分析,首次证明WER不仅与数据量相关,更与说话者的语言能力等级(包含时序和音段特征)有强相关性,指出能力等级是L2 ASR中的关键潜在变量。

- 揭示“朴素”微调的风险:通过实验证明,在不平衡数据集上直接微调(LoRA)会降低平均WER,但会显著恶化对低能力(A2)说话者的识别性能(主要表现为插入错误激增),加剧不公平。这为社区在进行领域适应时敲响了警钟。

- 提出两个协同的能力等级感知策略:(1) 多任务学习将能力等级作为显式监督信号;(2) 针对性数据增强平衡数据分布并增加低能力数据的变体。两者结合,在降低整体错误率的同时,有效缩小了不同能力组之间的性能差距。

🔬 细节详述

- 训练数据:

- 数据集:Speak & Improve (S&I)语料库。由剑桥大学等机构开发。

- 规模:约315小时L2英语语音,其中手动转录并标注(含错误和不流利)的数据为73.8小时。训练集28.2小时,开发集22.9小时,评估集22.7小时。

- 标注:所有录音按CEFR等级(A2-C1)标注,同时提供音频质量评级(Q3-Q5)和任务类型元数据。

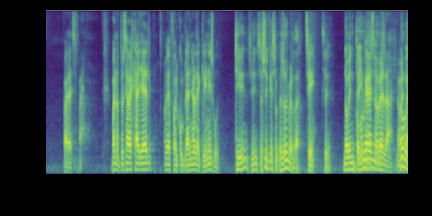

- 数据分布:存在严重不平衡(见图1)。转录数据中,A2仅占2.8%,B2占51.1%;高质量音频(Q4-Q5)占97.2%。 损失函数:总损失 L = λ1 L_ASR + λ2 * L_CLS。L_ASR为标准的Whisper序列损失。L_CLS为用于能力等级分类的交叉熵损失。权重 λ1=0.9, λ2=0.1。

- 训练策略:未详细说明具体学习率、batch size、优化器、训练步数等。仅提到所有实验都使用Whisper-small作为基座模型,并采用LoRA进行参数高效微调。统计显著性检验采用基于话语的配对bootstrap重采样(B=10^4次)。

- 关键超参数:模型为Whisper-small。LoRA适配器的具体秩(rank)和其他超参数未说明。MLP分类器的结构未说明。

- 训练硬件:未说明。

- 推理细节:未说明解码策略(如beam search宽度)、温度设置等。仅提到在推理时禁用数据增强。

- 正则化/稳定训练技巧:未提及。采用LoRA本身可视为一种防止过拟合的参数高效方法。

📊 实验结果

- 主要结果:在S&I语料库评估集上的整体WER如上述核心摘要中的表格所示。最佳模型(Multi+Data)相比基线实现了29.4%的相对WER降低。

- 能力等级分层结果:图3详细展示了在开发集和评估集上,五个系统在A2、B1、B2、C1四个能力等级上的WER及错误类型(替换、插入、删除)分解。关键发现:

- 性能与等级正相关:在所有系统中,WER从A2到C1单调递减。例如,基线模型在A2上WER为16.7%,在C1上为7.4%。

- 朴素微调损害低能力组:LoRA模型在A2上的WER相比基线显著上升(评估集:16.7% → 21.0%),而高能力组(B2, C1)则下降。插入错误是A2性能恶化的主要原因(从基线的9.87%升至10.1%的插入WER)。

- 能力等级感知策略有效:多任务学习和针对性增强显著降低了A2和B1组的WER和插入/删除错误。组合模型(Multi+Data)在所有组别上均表现最佳,A2的WER降至11.7%,插入错误降至2.06%,实现了更公平的结果。

- 与最强基线对比:论文最强基线是Whisper-small。与近期其他多口音ASR工作(如引用[12])相比,由于任务(关注能力等级 vs 口音)和数据集不同,论文未进行直接对比。

- 消融实验:论文通过设置“仅LoRA”、“仅多任务”、“仅数据增强”和“多任务+数据增强”四个实验点,构成了一个完整的消融分析,验证了每个组件的贡献以及它们的互补性。多任务学习对A2组改善显著(p<0.01),数据增强对整体WER降低贡献更大(从8.1%降至7.4%),两者结合效果最优。

⚖️ 评分理由

- 学术质量:5.0/7。论文提出了一个重要的研究问题,方法设计合理,实验分析深入,并包含了必要的统计检验。扣分项主要在于:(1) 核心贡献在于发现问题和应用现有技术(多任务学习、SpecAug)进行解决,模型架构本身创新性有限;(2) 所有实验在一个未公开的数据集上进行,限制了结论的广泛验证和影响力。

- 选题价值:1.5/2。选题直接针对AI公平性和教育技术应用,具有重要的社会意义和前沿性。对于从事语音识别、人机交互、教育科技的研究者和开发者有明确参考价值。扣0.5分是因为任务相对垂直(L2英语ASR)。

- 开源与复现加成:0.0/1。论文未提供代码仓库、模型权重、数据集获取链接,也未给出足够的训练超参数和配置细节以供他人复现,这是重大缺陷。