📄 Probing the Hidden Talent of ASR foundation models for L2 English Oral Assessment

#预训练 #迁移学习 #零样本 #语音评估

✅ 7.5/10 | 前25% | #预训练 | #迁移学习 | #零样本 #语音评估

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Fu-An Chao(台湾师范大学, 台北)

- 通讯作者:Berlin Chen(台湾师范大学, 台北)

- 作者列表:Fu-An Chao(台湾师范大学, 台北), Bi-Cheng Yan(台湾师范大学, 台北), Berlin Chen(台湾师范大学, 台北)

💡 毒舌点评

这篇论文巧妙地将一个“过时”的30秒窗口限制通过分块策略转化为优势,并展示了如何从冻结的Whisper中“榨取”出超越其ASR本职工作的评估能力,方法设计颇具巧思。然而,其核心创新在于“如何用”而非“提出新模型”,在方法的原创性深度上稍显不足,更像是对现有强大基础模型的一次成功的工程化应用和特性挖掘。

🔗 开源详情

- 代码:论文中未提及代码链接,但明确说明“The source code will be made publicly available in the camera-ready version.”(源代码将在相机版本后公开)���

- 模型权重:论文使用了预训练的

whisper-medium、distil-large-v3.5、multi-qa-mpnet-base-dot-v1和blip-itm-large-flickr模型。未提及是否会公开自己训练的分类器权重。 - 数据集:使用GEPT图片描述数据集。论文中未说明该数据集是否公开或如何获取。

- Demo:论文中未提及在线演示。

- 复现材料:论文给出了详细的超参数设置(如学习率、批量大小、训练步数)、使用的模型版本、分块参数等关键训练细节,为复现提供了良好基础。

- 论文中引用的开源项目:Whisper, Distil-Whisper, SBERT, BLIP2。

- 开源计划:代码计划开源,其他资源(数据、模型权重)情况未明确说明。

📌 核心摘要

- 要解决什么问题:传统语音口语评估(SLA)方法通常只利用ASR模型的转录文本,忽略了丰富的声学信息,且受模型输入长度限制,难以处理长语音。本文旨在挖掘Whisper基础模型在L2英语口语评估中的“隐藏潜力”,利用其内部隐藏表征进行更全面的评估。

- 方法核心是什么:将Whisper视为冻结的特征提取器,通过“分块-分层池化”策略处理长音频,分别从编码器和解码器提取声学和语言学特征。创新性地提出“伪教师强制”方法,利用外部ASR模型的转录高效获取解码器特征。最终训练一个轻量级分类器,并可融合图像-文本相关性分数作为辅助特征。

- 与已有方法相比新在哪里:与先前仅利用Whisper转录文本进行错误分析或建模的方法不同,本文直接探索其内部表征。与单模态基线(BERT, wav2vec 2.0)相比,统一利用Whisper的声学和语言学特征效果更优。通过融合图像和文本提示的辅助信息,进一步提升了多模态评估的准确性。

- 主要实验结果如何:在GEPT图片描述数据集上,所提方法(融合所有特征)在未见测试集上取得加权F1 0.762, 准确率0.760, 二分类准确率0.837, 显著优于所有单模态和多模态基线(例如, SAMAD的加权F1为0.684, Lu et al.的准确率为0.717)。消融实验证明了分块策略、伪教师强制以及辅助特征的有效性。可视化分析表明Whisper的表征内在地编码了能力等级和语义信息。

关键实验结果表格(表3):

方法 年份 模态 未见测试集 Weighted-F1 未见测试集 Acc. 未见测试集 Bin. Acc. wav2vec2.0+BERT 2023 A+T 0.650 0.667 N/A SAMAD 2024 A+T 0.684 0.697 N/A Lu et al. 2025 A+V+T N/A 0.717 0.797 Ours 2025 A+V+T 0.762 0.760 0.837 (注:A:音频, V:视觉, T:文本) - 实际意义是什么:证明了通用语音基础模型(如Whisper)通过适当的特征提取和辅助信息融合,可以成为口语评估的强大工具,无需进行任务特定的微调。这为开发更全面、准确的自动口语测评系统提供了新思路,尤其是在教育资源和评分标准化方面具有应用潜力。

- 主要局限性是什么:方法高度依赖Whisper本身的表征质量及其固有的30秒输入限制(尽管通过分块缓解)。分块策略可能割裂了跨分块的长期依赖和语义连贯性。辅助特征依赖于外部预训练模型(SBERT, BLIP2),其性能会影响最终结果。论文未探讨该方法在其他语言或更复杂口语任务上的泛化能力。

🏗️ 模型架构

本文提出的框架如图1所示,主要分为特征提取和分类器训练两个阶段。

特征提取阶段:

- 分块(Segmentation):输入长音频首先被切分为固定长度(30秒)、有重叠(5秒)的音频块,以克服Whisper的输入长度限制。

- 声学特征提取(Encoder):每个音频块经STFT转换为梅尔频谱图后,输入Whisper的编码器。编码器输出的最后隐藏状态经过时序平均池化,得到每个音频块的声学向量。所有音频块的声学向量再次进行平均池化,得到全局声学表征

v_enc。 - 语言学特征提取(Decoder):为避免自回归解码的开销,采用“伪教师强制”策略:将每个音频块对应的转录文本(由教师模型Distil-Whisper生成)与固定前缀拼接,作为解码器的输入。解码器结合编码器的输出,生成最后隐藏状态,同样经过两级平均池化,得到全局语言学表征

v_dec。 - 辅助特征提取:如图2所示,计算文本提示与转录文本的语义文本相似性(STS)分数,以及图像与转录文本的图像-文本对比性(ITC)分数。

分类器训练阶段:

- 特征融合:将

v_enc和v_dec拼接后,通过一个投影层映射到瓶颈特征空间,得到v_bnf。 - 预测:可选地将STS和ITC分数拼接到

v_bnf上,形成最终特征向量u。最后通过一个预测层(线性层+softmax)输出能力等级的概率分布。

- 特征融合:将

关键设计选择:

- 冻结Whisper:将Whisper作为特征提取器,避免了昂贵的全参数微调。

- 分层池化:第一级池化将变长的音频块特征压缩为定长向量,第二级池化将多个块向量聚合为全局表征,高效处理长音频。

- 伪教师强制:这是一种创新性的推理时技巧,它借鉴了训练时Teacher Forcing的思想,但使用外部强ASR模型的转录作为“伪真实标签”来直接构造解码器输入,从而高效提取解码器特征,无需修改模型或进行自回归生成。

💡 核心创新点

- 系统性挖掘Whisper在SLA中的隐藏能力:区别于以往仅利用Whisper转录文本的工作,本文首次深入探索了其编码器和解码器的中间表征在口语评估任务中的价值,证明了这些表征内在地包含了声学流利度、语言准确性和内容相关性等多维度信息。

- 高效的长音频表征提取策略(分块+分层池化):提出了一个简单有效的方法来突破Whisper 30秒输入限制,使其能够处理平均85秒的口语响应,同时保留全局长时信息。

- “伪教师强制”提取解码器特征:提出了一种创新的推理技巧,利用外部ASR模型的输出,高效地获取了本需要自回归解码才能得到的解码器侧语言学特征,极大提升了特征提取效率。

- 多模态辅助特征融合:除了核心的声学和语言学特征,创新性地融合了基于预训练模型计算的文本提示相关性(STS)和图像相关性(ITC)分数,模拟了人类评估中对“内容相关性”维度的考量,进一步提升了评估性能。

- 全面的分析与验证:通过详尽的消融实验证明了每个组件的有效性,并通过t-SNE可视化分析揭示了Whisper表征相对于专用单模态模型(wav2vec 2.0, BERT)在编码能力等级和语义信息方面的优势。

🔬 细节详述

- 训练数据:使用GEPT图片描述数据集。包含约85秒的口语回答,对应中级英语水平测试。训练集719条,开发集90条,已见测试集90条(已见图片提示),未见测试集300条(未见图片提示)。分数离散化为1-5级。

- 损失函数:使用交叉熵损失进行分类训练。

- 训练策略:分类器训练1000步,学习率7.5e-4,批量大小4,梯度累积步数2。投影层隐藏维度为512。所有实验使用固定随机种子。

- 关键超参数:Whisper backbone为

whisper-medium。分块长度L=30秒,步长S=5秒,重叠O=25秒。教师模型使用distil-large-v3.5。STS分数使用multi-qa-mpnet-base-dot-v1计算。ITC分数使用blip-itm-large-flickr计算。 - 训练硬件:论文中未说明。

- 推理细节:使用分块策略处理长音频,通过两级池化得到全局表征,然后输入训练好的轻量级分类器进行预测。

- 正则化:论文中未提及额外的正则化技巧。

📊 实验结果

主要基准是GEPT图片描述数据集,评估指标包括加权F1分数、准确率(Acc.)和二分类准确率(Bin. Acc., 即通过/失败)。

- 核心性能对比(表3): (已在“核心摘要”中列出)

图3关键结论:(a) Whisper的声学嵌入比wav2vec 2.0表现出更清晰的等级排列,说明其更好地保留了与评估相关的韵律和流畅度线索。(b) Whisper的语言学嵌入不仅保持了BERT的语义聚类,还显示出与分数相关的梯度,这可能得益于其以音频为条件的特性。

图3关键结论:(a) Whisper的声学嵌入比wav2vec 2.0表现出更清晰的等级排列,说明其更好地保留了与评估相关的韵律和流畅度线索。(b) Whisper的语言学嵌入不仅保持了BERT的语义聚类,还显示出与分数相关的梯度,这可能得益于其以音频为条件的特性。

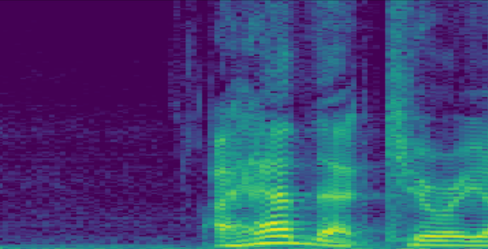

图4关键结论:STS分数与整体质量(分数)和提示连贯性(相关性分数)的相关性更强;ITC分数则对识别离题或低质量样本(分数=1)非常有效。

图4关键结论:STS分数与整体质量(分数)和提示连贯性(相关性分数)的相关性更强;ITC分数则对识别离题或低质量样本(分数=1)非常有效。

- 消融实验与分析(表1, 表2):

| Methods | Seen test Weighted-F1 | Seen test Acc. | Unseen test Weighted-F1 | Unseen test Acc. |

|---|---|---|---|---|

| 表1: 分块策略影响 | ||||

| WhisperEncoder [1] | 0.648 | 0.678 | 0.689 | 0.710 |

| Ours (acoustic) | 0.683 | 0.722 | 0.709 | 0.723 |

| 表2: 特征消融 | ||||

| wav2vec 2.0 [22] | 0.557 | 0.567 | 0.602 | 0.617 |

| Ours (acoustic) | 0.683 | 0.722 | 0.709 | 0.723 |

| BERT [21] | 0.559 | 0.578 | 0.659 | 0.680 |

| Ours (linguistic) | 0.660 | 0.678 | 0.726 | 0.740 |

| w/o PTF | 0.633 | 0.655 | 0.715 | 0.720 |

| Ours (acou.+ling.) | 0.709 | 0.733 | 0.751 | 0.757 |

| Ours (ALL) | 0.742 | 0.767 | 0.762 | 0.760 |

| w/o ITC Score | 0.720 | 0.744 | 0.756 | 0.759 |

| w/o STS Score | 0.729 | 0.744 | 0.715 | 0.710 |

关键结论:

- 分块有效性:分块策略(利用全音频)相比仅用前30秒,在两个测试集上均提升了性能(表1)。

- 声学/语言学特征优越性:Whisper提取的声学特征显著优于wav2vec 2.0;语言学特征优于BERT。伪教师强制(PTF)策略能进一步提升语言学特征性能(表2)。

- 特征互补性:声学特征(

v_enc)在已见测试集上表现更好,语言学特征(v_dec)在未见测试集上表现更好,二者结合(v_bnf)实现互补,性能进一步提升。 - 辅助特征贡献:融合STS和ITC分数(ALL)带来了最佳性能。移除ITC主要影响整体鲁棒性,而移除STS在未见测试集上导致性能显著下降(特别是准确率),说明STS对泛化能力至关重要。

⚖️ 评分理由

- 学术质量:5.5/7:方法系统、实验充分(包括消融和可视化)、论证有力。创新性主要体现在对现有强大模型的高效利用和组合上,而非提出全新的模型架构或理论,属于扎实的工程创新和应用研究。

- 选题价值:1.5/2:将语音基础模型应用于口语评估这一垂直但重要的场景,具有明确的应用前景和实际意义,对教育技术领域的研究者有参考价值。

- 开源与复现加成:0.5/1:论文承诺后续开源代码,这是一个重要的加分项。但当前版本缺乏代码链接、详细超参数配置文件等,因此给予中等正向加成。