📄 Position-Invariant Fine-Tuning Of Speech Enhancement Models With Self-Supervised Speech Representations

#语音增强 #自监督学习 #鲁棒性 #语音识别

✅ 6.5/10 | 前50% | #语音增强 | #自监督学习 | #鲁棒性 #语音识别

学术质量 5.0/7 | 选题价值 1.0/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Amit Meghanani(谢菲尔德大学计算机学院语音与听力研究组)

- 通讯作者:Thomas Hain(谢菲尔德大学计算机学院语音与听力研究组)

- 作者列表:Amit Meghanani(谢菲尔德大学计算机学院语音与听力研究组)、Thomas Hain(谢菲尔德大学计算机学院语音与听力研究组)

💡 毒舌点评

亮点:精准识别了SSL-MSE微调中“位置坍缩”这一具体痛点,并巧妙地将已知的零填充方法迁移至微调场景进行验证,同时创新性地提出用Soft-DTW损失进行时间对齐,思路清晰且实用。 短板:实验说服力略显不足——改进幅度微乎其微(例如ASR的WER在户外噪声下仅从9.19降至9.06),且只用了最基础的HuBERT-BASE和单一SE模型进行验证,未能证明该方法在更强大的SSL模型(如WavLM)或更复杂噪声环境下的普适性,使得贡献显得“有用但非关键”。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及是否公开微调后的SE模型或SSL模型权重。

- 数据集:使用了公开的LibriSpeech和DEMAND数据集,并描述了数据准备过程,但未提供处理后的数据集。

- Demo:未提及在线演示。

- 复现材料:提供了详细的训练细节、配置(如优化器、学习率、批大小)、算法伪代码和实验设置,这构成了充分的复现材料。

- 论文中引用的开源项目:

- Facebook Research的Denoiser工具包(用于master64模型):https://github.com/facebookresearch/denoiser

- S3PRL工具包(用于下游任务评估):https://github.com/s3prl/s3prl

- Torchaudio库(用于速度扰动)。

- 总结:论文本身未提供开源计划,但其详细描述和对现有开源工具的引用,为复现提供了明确路径。

📌 核心摘要

本文研究了利用自监督学习(SSL)模型(如HuBERT)的表征来微调语音增强(SE)前端时,所使用的均方误差(MSE)损失函数会不当地依赖模型的绝对位置嵌入,而非内容信息,从而损害泛化能力。为解决此问题,文章提出了两种策略:1)SSL-MSE-PAD,借鉴SPIRAL工作,在微调时对干净语音添加随机零填充以破坏位置对齐;2)SSL-SoftDTW,对干净语音进行速度扰动,并使用可微分的动态时间规整(soft-DTW)损失进行内容对齐。实验在噪声增强的LibriSpeech数据集上,以HuBERT和master64 SE模型为基础进行。结果表明,SSL-SoftDTW方法在下游语音识别(ASR)和音素识别(PR)任务上,尤其是在未见过的噪声条件下,性能略优于基线SSL-MSE(例如,ASR的WER在户外噪声下从9.19降至9.06),且收敛速度显著更快(约60k步 vs. 200k步)。SSL-MSE-PAD仅有微弱改进。该研究的实际意义在于提供了一种轻量级的微调优化思路,无需修改昂贵的SSL预训练过程。主要局限在于改进幅度有限,且实验场景和模型选择较为单一,未验证在更复杂条件下的有效性。

🏗️ 模型架构

本文的核心研究对象并非一个完整的端到端模型,而是一个两阶段的流水线系统:前端语音增强模型(SE) + 冻结的自监督语音表征模型(SSL)。其架构如图1所示。

图1:SSL-MSE微调流水线示意图。噪音语音输入可训练的SE模型(M_ϕ),得到增强语音。同时,原始干净语音和增强语音分别输入冻结的SSL模型(F_θ),提取表征X和X‘。损失函数计算X和X‘之间的MSE。

图1:SSL-MSE微调流水线示意图。噪音语音输入可训练的SE模型(M_ϕ),得到增强语音。同时,原始干净语音和增强语音分别输入冻结的SSL模型(F_θ),提取表征X和X‘。损失函数计算X和X‘之间的MSE。

具体流程如下:

- 输入:一对(干净语音,噪音语音)样本。

- 语音增强:噪音语音(s_noisy)通过一个预训练的、可训练的语音增强模型(master64,基于修改的Demucs网络),输出增强语音(s_enhanced)。master64模型包含卷积编码器-解码器、跳跃连接和LSTM瓶颈。

- 特征提取:分别将干净语音(或其扰动/填充版本)和增强语音输入到一个冻结的、预训练的SSL模型(HuBERT-BASE)的最后一层,提取768维的帧级表征(X 和 X‘)。

- 损失计算:在标准SSL-MSE基线中,直接计算X和X‘的均方误差(MSE)。在提出的两种策略中,会对干净语音的表征(X)进行操作(填充或速度扰动+DTW对齐)后再计算损失。

- 训练:通过计算出的损失,反向传播更新SE模型(M_ϕ)的参数,而SSL模型(F_θ)的参数保持冻结。

关键设计选择:SE模型和SSL模型解耦。SSL模型仅作为“特征提取器”和“损失空间的定义者”,其参数不更新。这使得微调仅针对SE前端,更具通用性和可复用性。

💡 核心创新点

- 问题识别与形式化:明确将SSL-MSE微调中的性能瓶颈归因于SSL模型中位置嵌入的过度利用,即“位置坍缩”现象。这将其定义为一个超越语音增强的、更广泛的SSL表征微调问题。

- 策略迁移验证(SSL-MSE-PAD):将SPIRAL框架中用于解决SSL预训练“位置坍缩”的随机零填充策略,成功迁移到并验证于SSL引导的微调场景。虽然效果有限,但完成了方法在新上下文中的实证考察。

- 内容对齐损失引入(SSL-SoftDTW):创造性地将Soft-DTW损失与速度扰动结合,用于SE微调。这通过引入局部时间失真和基于内容的非线性对齐,从根本上减少了模型对绝对位置信息的依赖,同时模拟了更真实的语音变异,带来了收敛速度和性能的双重提升。

- 轻量级优化方案:所有改进仅作用于微调阶段,无需重新进行昂贵的SSL预训练,为提升SSL下游任务性能提供了一条高效的优化路径。

🔬 细节详述

- 训练数据:

- SE微调数据集:LibriSpeech train-clean-100子集。

- 噪音数据:DEMAND数据集中的室内噪音(Domestic, Office, Public, Transportation)。

- 数据增强:随机选择噪音片段,以{0, 5, 10, 20} dB的信噪比(SNR)添加到干净语音上。

- 下游任务数据集:SUPERB基准中的LibriSpeech train-clean-100, dev-clean, test-clean子集,同样进行噪音增强。训练和验证使用室内噪音(seen noise),测试使用室内和室外噪音(unseen noise)。

- 损失函数:

基线 SSL-MSE (公式1):

L = (1/m) Σ ||x_i - x‘_i||_2^2,直接帧对齐MSE。- SSL-MSE-PAD (公式2):对干净波形两端随机添加零填充(填充比例p在[0.02, 0.05]内随机采样,填充长度对齐到帧大小320样本),然后截取中间部分与增强表征计算MSE。

- SSL-SoftDTW (公式3):对干净波形进行随机速度扰动(因子α),然后计算其表征与增强表征之间的Soft-DTW距离,并除以(m+n)进行长度归一化。平滑因子γ=0.1。

- 训练策略:

- 优化器:Adam。

- 学习率:1.0 × 10⁻⁴(用于SE微调)。

- 批大小:有效批大小为16(通过梯度累积实现)。

- 训练时长:1个epoch。

- 正则化:梯度裁剪(max-norm = 1.0);所有表征在损失计算前进行L2归一化。

- 关键超参数:

- SSL模型:HuBERT-BASE(约95M参数),使用最后一层输出(768维)。

- SE模型:Facebook Research Denoiser工具包中的master64模型(33.5M参数)。

- 训练硬件:未说明。

- 推理细节:未说明具体的推理优化。

- 下游任务微调:使用S3PRL工具包。ASR任务使用2层双向LSTM头(1024单元/层),字符级CTC损失。PR任务使用线性帧分类头,CTC损失。均使用Adam优化器,学习率分别为1e-4和5e-4。

📊 实验结果

实验主要评估SE前端微调后,HuBERT在下游ASR和PR任务上的鲁棒性。

表1:ASR任务性能(WER,%)

| SSL Fine-tuning of SE Model | Enhancement | test-clean | test-clean + indoor noise | test-clean + outdoor noise |

|---|---|---|---|---|

| ✗ | ✗ | 12.47 ± 0.07 | 13.09 ± 0.07 | 6.29 ± 0.04 |

| ✗ | ✓ | 9.93 ± 0.08 | 9.96 ± 0.04 | 6.22 ± 0.05 |

| SSL-MSE | ✓ | 9.19 ± 0.05 | 8.89 ± 0.07 | 6.21 ± 0.08 |

| SSL-MSE-PAD | ✓ | 9.11 ± 0.05 | 8.86 ± 0.03 | 6.21 ± 0.04 |

| SSL-SoftDTW | ✓ | 9.06 ± 0.09 | 8.88 ± 0.08 | 6.21 ± 0.11 |

关键结论:

- 无论是否微调,使用SE前端都能显著降低WER(对比第一行和第二行)。

- 在“未见噪音”(outdoor noise)条件下,SSL-SoftDTW取得了最佳的WER(9.06%),略优于SSL-MSE(9.19%)和SSL-MSE-PAD(9.11%)。

- SSL-MSE-PAD相比基线改善微小。

表2:PR任务性能(PER,%)

| SSL Fine-tuning of SE Model | Enhancement | test-clean | test-clean + indoor noise | test-clean + outdoor noise |

|---|---|---|---|---|

| ✗ | ✗ | 9.82 ± 0.03 | 10.36 ± 0.02 | 5.55 ± 0.04 |

| ✗ | ✓ | 7.48 ± 0.03 | 7.55 ± 0.03 | 5.28 ± 0.02 |

| SSL-MSE | ✓ | 6.78 ± 0.01 | 6.63 ± 0.02 | 5.17 ± 0.02 |

| SSL-MSE-PAD | ✓ | 6.85 ± 0.03 | 6.64 ± 0.07 | 5.18 ± 0.03 |

| SSL-SoftDTW | ✓ | 6.70 ± 0.00 | 6.61 ± 0.02 | 5.11 ± 0.00 |

关键结论:

- SSL-SoftDTW在“未见噪音”(outdoor noise)条件下同样取得了最佳的PER(5.11%),优于SSL-MSE(5.17%)和SSL-MSE-PAD(5.18%)。

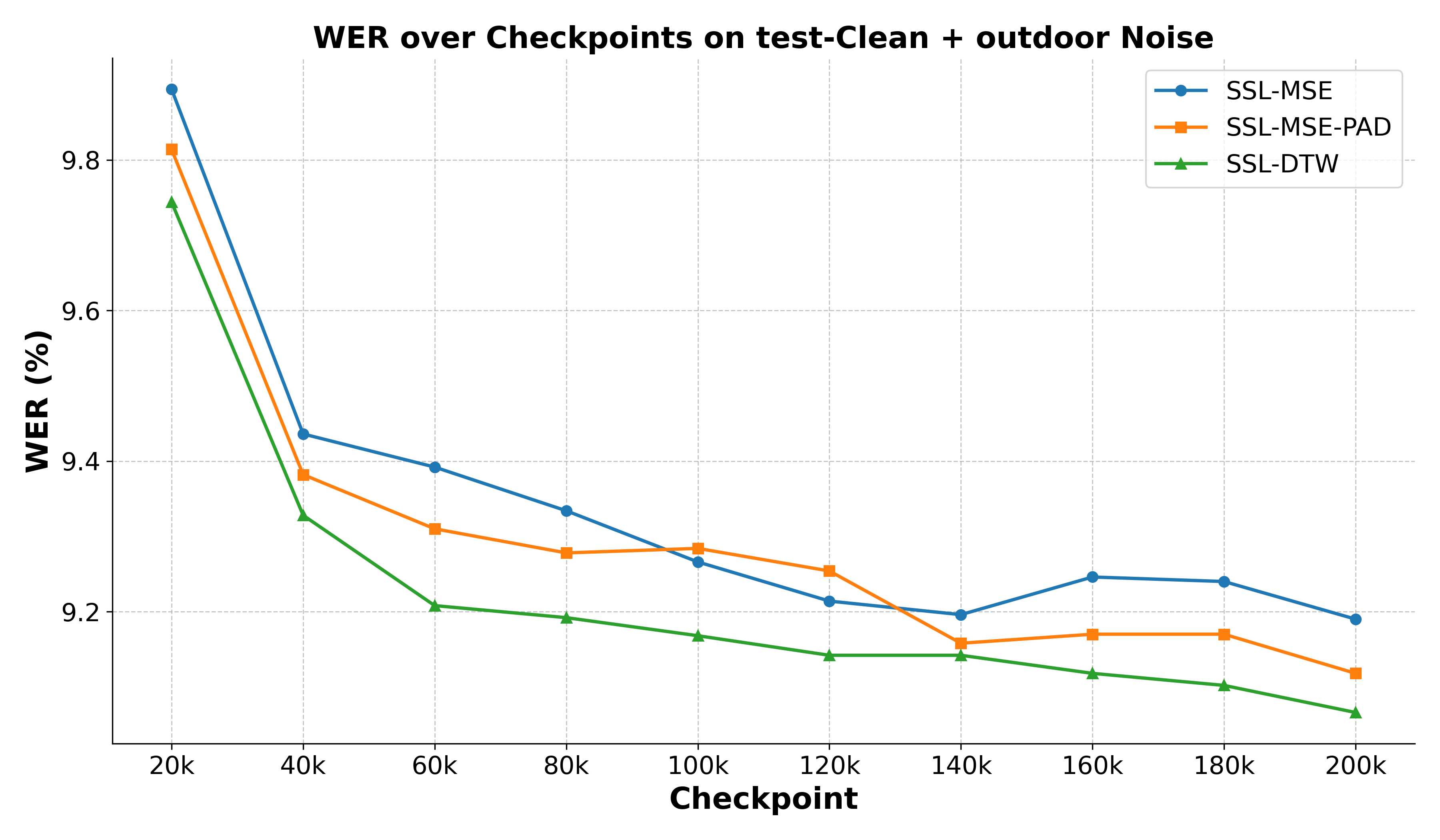

收敛速度: 论文中提到图2(未提供图片URL)展示了ASR任务在test-clean + outdoor noise上的WER随训练步数变化的曲线。结论是:SSL-SoftDTW收敛速度显著快于SSL-MSE(约60k步达到SSL-MSE的最终性能 vs. SSL-MSE需要约200k步),SSL-MSE-PAD的收敛速度也快于SSL-MSE。

消融实验:论文未进行独立的消融实验,但通过比较SSL-MSE、SSL-MSE-PAD和SSL-SoftDTW三种微调策略,构成了主要的方法对比实验。

⚖️ 评分理由

- 学术质量:5.0/7:论文准确指出了SSL-MSE微调中的一个具体问题,并提出了两种解决方案。技术思路正确,实验设计合理(控制变量,多任务评估)。然而,创新深度有限,改进幅度非常小(通常<0.2% WER/PER),且实验范围狭窄(仅基于HuBERT-BASE和master64),未能充分证明所提方法的鲁棒性和普适性,说服力中等。

- 选题价值:1.0/2:研究SSL模型微调的稳定性问题,对于提升语音前端在真实噪声环境下的性能有实际意义。问题本身具有一定的技术深度和关注度,但属于SSL应用层的一个具体优化点,潜在影响和应用空间相对局限。

- 开源与复现加成:0.5/1:论文提供了非常详细的实验设置,包括模型架构、数据集处理、损失函数公式、算法伪代码(Algorithm 1 & 2)和关键超参数。这使得复现工作相对容易。然而,论文未提及是否提供开源代码、预训练模型权重或处理后的数据集链接,因此无法给予更高加分。