📄 Noise-to-Notes: Diffusion-Based Generation and Refinement for Automatic Drum Transcription

#音乐信息检索 #扩散模型 #生成模型 #鲁棒性

🔥 8.0/10 | 前10% | #音乐信息检索 | #扩散模型 | #生成模型 #鲁棒性

学术质量 6.5/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:未说明(论文未明确标注)

- 通讯作者:未说明(论文未明确标注)

- 作者列表:Michael Yeung(Sony Group Corporation, Tokyo, Japan)、Keisuke Toyama(Sony Group Corporation, Tokyo, Japan)、Toya Teramoto(Sony Group Corporation, Tokyo, Japan)、Shusuke Takahashi(Sony Group Corporation, Tokyo, Japan)、Tamaki Kojima(Sony Group Corporation, Tokyo, Japan)

💡 毒舌点评

亮点:首次将扩散模型作为生成范式应用于自动鼓转录(ADT),不仅在多个基准测试上超越了所有判别模型,还展示了在音频部分缺失情况下的“修复”能力,这在ADT乃至更广的音乐转录领域都是新颖的。 短板:论文的核心卖点是“生成模型超越判别模型”,但作为生成模型的代价是推理速度显著慢于同等性能的判别模型(例如,单步推理0.163s vs. 0.086s),这使得其在实时或低延迟应用场景中的实用性大打折扣。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及是否公开N2N的模型权重。

- 数据集:明确使用了公开数据集E-GMD(训练),以及公开的评估集IDMT和MDB。

- Demo:未提供在线演示。

- 复现材料:提供了相当详细的训练细节(GPU、时间、学习率、batch size等)、数据集配置、评估协议和超参数(部分遵循已发表工作[20])。这为研究者在自己的环境中复现提供了较好的基础。

- 论文中引用的开源项目:

- 音频编码器:MERT(预训练模型)。

- 扩散模型框架:基于论文[20](Elucidating the Design Space of Diffusion-Based Generative Models)的设计。

- 评估工具:mir_eval。

- 训练框架:EDGE(引用[21],但未明确使用其代码)。

- 数据集:E-GMD, ADTOF (用于对比), IDMT, MDB。

- 总结:论文在数据、评估、训练配置等复现信息上比较公开透明,但缺少代码实现这一关键复现材料。因此,对于希望直接使用或修改模型的研究者来说,复现门槛中等偏高。

📌 核心摘要

这篇论文旨在解决自动鼓转录(ADT)任务中判别模型泛化能力不足和性能瓶颈的问题。其核心方法是将ADT重新定义为一个条件生成任务,并提出了一个名为Noise-to-Notes (N2N) 的扩散模型框架。N2N从音频条件的高斯噪声开始,通过迭代去噪过程生成鼓的起始时间(onset)和力度(velocity)信息。与已有方法相比,其创新点在于:1)首次使用生成式扩散模型处理ADT;2)提出Annealed Pseudo-Huber (APH) 损失函数,解决了标准MSE损失无法有效联合优化二值起始和连续力度值的难题;3)创新性地融合了梅尔频谱图和来自音乐基础模型(MFM) 的高级语义特征,显著提升了模型对域外(out-of-domain)音频的鲁棒性。实验表明,N2N在E-GMD、IDMT和MDB等多个主流基准测试上均取得了新的最先进(SOTA)性能。例如,在E-GMD测试集上,使用10步采样时,其起始F1分数达到89.68,力度F1分数达到82.80,超过了所有对比的判别模型。论文的主要意义在于证明了生成模型在音乐转录任务上的优越性潜力,并带来了如音频修复等新能力。主要局限是其推理速度相较于判别模型较慢,且模型参数量更大(50M vs. 5.5M)。

🏗️ 模型架构

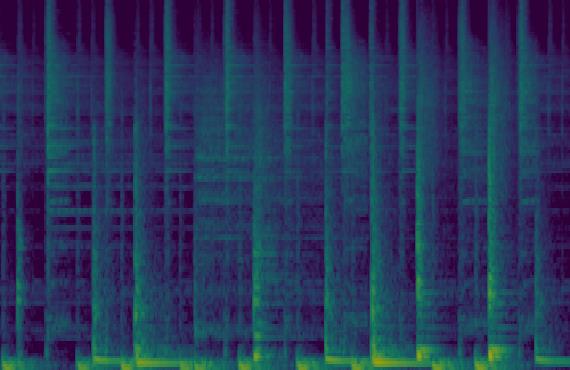

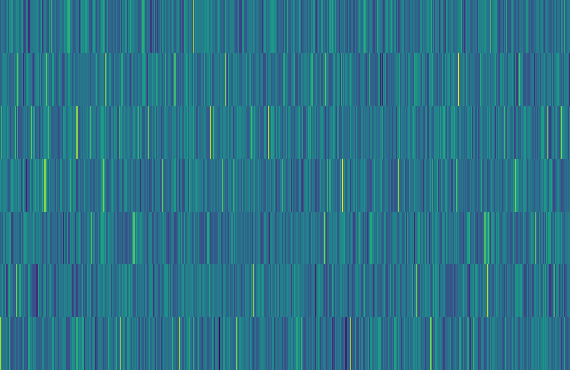

N2N是一个基于Transformer的音频条件扩散模型,其整体架构和数据流如图1(pdf-image-page1-idx0)和图2(pdf-image-page1-idx1)所示。

图1:Noise-to-Notes框架概览。展示了N2N作为扩散模型的三种能力:条件生成(基于完整音频转录)、修复(基于部分音频转录)和无条件生成(无音频输入)。核心流程是学习从加噪的转录

图1:Noise-to-Notes框架概览。展示了N2N作为扩散模型的三种能力:条件生成(基于完整音频转录)、修复(基于部分音频转录)和无条件生成(无音频输入)。核心流程是学习从加噪的转录x_t和音频条件ϕ_audio中去噪恢复干净转录x_0。

图2:Noise-to-Notes架构。这是一个基于Transformer的解码器架构,详细展示了各组件。

图2:Noise-to-Notes架构。这是一个基于Transformer的解码器架构,详细展示了各组件。

输入与条件编码:

- 转录目标:模型的目标输出是

x ∈ R^{F×D×2},其中F是帧数,D是鼓组件数(实验中为7),每个位置包含起始值(0/1)和力度值(0-127,被缩放至[-1,1])。 - 音频条件(

ϕ_audio):模型同时使用两种音频特征:- 梅尔频谱图:标准低级声学特征(128维)。

- MFM特征:使用预训练的MERT模型提取的中间层(第10层)特征,包含高级语义信息。

- 这两种特征分别通过独立的Transformer编码器处理。为实现修复和无条件生成,论文在训练时对这两种特征应用了两种Dropout策略:部分Dropout(随机丢弃连续片段,用于修复)和完全Dropout(整体丢弃,用学习到的空嵌入替代,用于无条件生成)。梅尔频谱图的Dropout率(0.3)高于MFM特征(0.15),以防止过拟合。

- 时间步条件(

ϕ_time):扩散过程的时间步t(对应噪声水平σ_t)通过一个线性层和MLP编码。

- 转录目标:模型的目标输出是

去噪网络(Transformer解码器):

- 输入为当前带噪的转录

x_σt(同样经过嵌入和投影)。 - 解码器由多个Transformer层组成。其核心机制是特征级线性调制(FiLM)和交叉注意力。

- 音频条件

ϕ_audio(来自两个编码器)和时间步条件ϕ_time被串联,首先通过交叉注意力层与当前转录表示交互,使模型能“关注”音频的特定部分。 - 然后,这些条件信息通过FiLM层对转录表示进行仿射变换(调制),实现对特征的精细控制。

- 这种设计使得模型能有效地将条件信息注入到生成过程中。

- 输入为当前带噪的转录

输出与迭代:

- 解码器的最终输出经过线性层和Tanh激活,生成预测的干净转录

x̂0。 - 在推理时,可以通过引入方差更小的新高斯噪声进行细化(refinement):

x_t ∼ q(x_t'|x_t),然后在更小的时间步上再次去噪,以迭代提升生成质量。

- 解码器的最终输出经过线性层和Tanh激活,生成预测的干净转录

💡 核心创新点

将ADT重新定义为生成任务:

- 局限:传统判别式方法直接从频谱预测离散标签,可能无法充分建模数据分布,且难以实现修复等生成任务。

- 创新:将ADT建模为一个以音频为条件的去噪扩散过程,从高斯噪声逐步生成鼓事件。这不仅提供了灵活的速度-精度权衡(通过调节采样步数),还赋予了模型音频修复(从部分音频生成完整转录)和无条件生成的新能力。

- 收益:首次在ADT任务上实现了生成模型超越判别模型的性能。

Annealed Pseudo-Huber (APH) 损失:

- 局限:标准扩散模型使用MSE损失,但ADT的输出是混合类型的(二值起始和连续力度)。MSE损失会使起始预测的误差(尤其是假阳性/阴性)在损失中占主导,从而损害力度预测的学习。

- 创新:提出APH损失,它在训练过程中从MSE(对起始误差敏感)逐渐退火到MAE(对离群值更鲁棒)。公式为

LAPH(x, x̂) = sqrt(||x-x̂||²_2 + c(t)²) - c(t),其中c(t)线性衰减。 - 收益:有效平衡了起始和力度两个目标的联合优化,消融实验证明其显著提升了性能(见图4相关实验)。

集成音乐基础模型(MFM)特征以增强鲁棒性:

- 局限:仅依赖梅尔频谱图的模型在不同录音风格、鼓音色(域外数据)的泛化能力差,因为频谱特征重叠且可变性大。

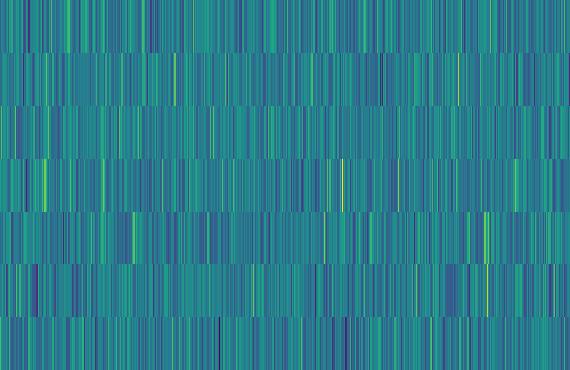

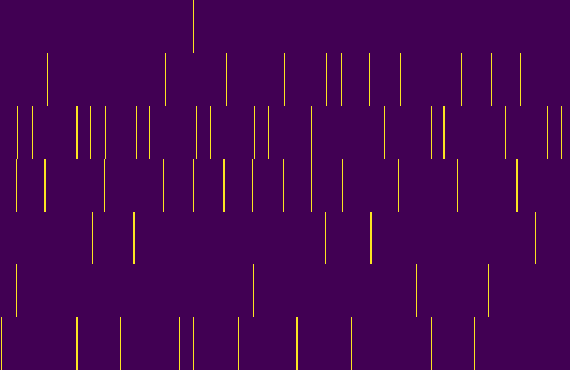

- 创新:引入预训练MERT模型的高级语义特征,作为梅尔频谱图的补充。这种特征更关注音乐内容而非具体音色,因此在不同数据集间更具判别性(如图5的t-SNE可视化所示)。

- 收益:在外部数据集(IDMT, MDB)上带来了巨大的性能提升,消融研究显示MFM特征是模型鲁棒性的关键(见表2)。

为扩散模型设计的Dropout策略:

- 创新:在音频条件输入上应用两种Dropout(部分和完全),以支持修复和无条件生成任务的训练。

- 收益:使单一模型具备多种能力,如图1和图6所示的修复示例。

🔬 细节详述

- 训练数据:使用E-GMD数据集的训练划分,包含440小时的人类鼓表演,43套鼓组,是唯一公开包含起始和力度MIDI标注的数据集。鼓组件设置为7种:Kick, Snare, Tom, Hi-hat, Crash, Ride, Bell。

- 损失函数:采用Annealed Pseudo-Huber (APH) 损失。超参数设置为:

c_max=1,c_min=10^{-4},α_t从0线性退火到1。 - 训练策略:

- 优化器:未明确说明,但遵循参考文献[20]的默认设置。

- 学习率:

3 × 10^{-4}。 - Batch Size:64。

- 训练轮数:100 epochs。

- 学习率调度:未说明。

- 损失权重:未说明。

- 关键超参数:

- 模型大小:50M参数(对比基线hFT-Transformer为5.5M)。

- 鼓组件数D:7。

- 帧长:10 ms(基于44.1 kHz采样率,hop length 441)。

- 梅尔频谱图维数:128。

- MFM:使用MERT 330M模型,提取第10层特征。

- Dropout率:完全Dropout p=0.15 (MERT), p=0.30 (Spectrogram);部分Dropout p=0.5。

- 训练硬件:4块NVIDIA A100 GPU,训练约1天。

- 推理细节:

- 采样:使用DDPM框架,噪声调度采用对数正态分布

ln σ ∼ N(P_mean, P_std^2)(具体P值未说明,遵循[20]默认值)。 - 采样步数:实验评估了1,5,10步(见图4)。10步是报告主要结果的设置。

- 评估指标:使用

mir_eval库计算注释级(note-wise)的起始和力度F1分数。预测音符持续时间为100ms,容忍度为50ms。 - 基线对比设置:为公平比较,hFT-Transformer基线按照OaF Drums的设置进行适配。

- 采样:使用DDPM框架,噪声调度采用对数正态分布

- 正则化技巧:除Dropout外,论文未提及其它正则化方法。

📊 实验结果

论文在三个主要基准数据集上进行了评估:E-GMD(域内),MDB和IDMT(域外)。主要指标是起始(Onset)和力度(Velocity)的F1分数。

主要对比结果(表1):

| 模型 | 训练数据 | 类型 | 架构 | 预测速度 | E-GMD (F1) | E-GMD vel (F1) | MDB (F1) | IDMT (F1) |

|---|---|---|---|---|---|---|---|---|

| OaF Drums [1] | E-GMD | D | CRNN | 是 | 83.40 | 61.70 | 75.19 | 85.72 |

| hFT-Transformer [11] | E-GMD | D | T | 是 | 86.31 | 80.16 | 70.81 | 70.61 |

| N2N (1-step) | E-GMD | G | T | 是 | 88.00 | 79.10 | 82.26 | 91.22 |

| N2N (5-step) | E-GMD | G | T | 是 | 89.24 | 82.56 | 86.66 | 93.74 |

| N2N (10-step) | E-GMD | G | T | 是 | 89.68 | 82.80 | 87.86 | 94.90 |

注:D=判别式,G=生成式,T=Transformer。最佳性能加粗。

图3:各鼓组件的起始F1分数对比。在E-GMD上训练,在E-GMD、MDB、IDMT上评估。显示N2N在困难组件(如镲片)上相比OaF Drums有显著提升,且在域外数据(IDMT, MDB)上保持了稳定高性能。

图3:各鼓组件的起始F1分数对比。在E-GMD上训练,在E-GMD、MDB、IDMT上评估。显示N2N在困难组件(如镲片)上相比OaF Drums有显著提升,且在域外数据(IDMT, MDB)上保持了稳定高性能。

图4:速度-精度权衡。展示了N2N在不同采样步数(1-25)下的性能与推理时间。关键结论:从1步到5-10步有显著提升,之后趋于饱和。

图4:速度-精度权衡。展示了N2N在不同采样步数(1-25)下的性能与推理时间。关键结论:从1步到5-10步有显著提升,之后趋于饱和。

消融研究(表2): 该研究验证了APH损失和MFM特征的有效性。

| 特征 | 损失 | E-GMD | E-GMD (vel) | MDB | IDMT |

|---|---|---|---|---|---|

| S (频谱图) | MSE | 85.55 | 66.14 | 69.20 | 80.00 |

| S | PH | 80.11 | 68.60 | 55.07 | 77.83 |

| S | APH | 86.77 | 76.17 | 71.15 | 80.89 |

| M (MFM) | APH | 87.16 | 77.62 | 82.16 | 90.36 |

| S+M | APH | 88.00 | 79.10 | 82.26 | 91.22 |

注:所有结果为1步采样。最佳性能加粗。

- 关键发现1(损失函数):标准MSE损失严重损害力度预测。Pseudo-Huber(PH)损失改善了力度但损害了起始。APH损失同时提升了起始和力度性能。

- 关键发现2(特征):在域内数据(E-GMD)上,仅用MFM特征与用梅尔频谱图性能相近。但在域外数据(MDB, IDMT)上,MFM特征带来了巨大的性能跃升(MDB: 71.15->82.16, IDMT: 80.89->90.36)。两者结合性能最佳。

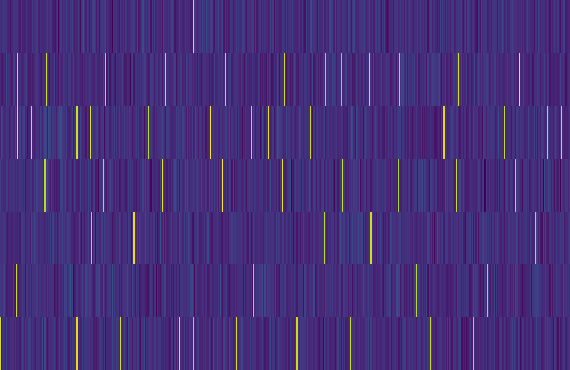

特征可视化与修复示例:

图5:t-SNE可视化。左图(梅尔频谱图特征)显示不同数据集的特征重叠较多。右图(MFM特征)显示特征更具可分性,解释了其提升泛化能力的原因。

图5:t-SNE可视化。左图(梅尔频谱图特征)显示不同数据集的特征重叠较多。右图(MFM特征)显示特征更具可分性,解释了其提升泛化能力的原因。

图6:音频修复示例。给定5秒音频,后3秒被屏蔽(替换为null嵌入),N2N利用前2秒的上下文生成了连贯的完整转录,展示了其生成能力。

图6:音频修复示例。给定5秒音频,后3秒被屏蔽(替换为null嵌入),N2N利用前2秒的上下文生成了连贯的完整转录,展示了其生成能力。

⚖️ 评分理由

- 学术质量:6.5/7

- 创新性:高。将ADT重新定义为生成任务,并结合新型损失函数和MFM特征,取得了显著效果。在ADT领域是首创,且方法具有启发性。

- 技术正确性:高。模型设计合理,损失函数推导清晰,实验设计严谨(有详细的消融研究)。

- 实验充分性:高。在多个数据集上进行了全面的基准测试和消融研究,提供了充分的数字证据。

- 证据可信度:高。实验设置清晰,对比了可复现的基线(如自行训练hFT-Transformer),结果支持结论。

- 选题价值:1.5/2

- 前沿性:中高。扩散模型应用于音频转录是前沿方向。

- 潜在影响:中。为ADT和更广的音乐转录任务提供了新思路,证明了生成模型的潜力。

- 实际应用空间:中。ADT是音乐制作、分析、游戏节奏同步的基础技术,但市场相对垂直。修复能力可能开拓新应用。

- 与音频/语音读者相关性:中。对关注音乐信息检索、生成式音频模型、鲁棒音频分析的读者有直接价值。

- 开源与复现加成:0.0/1

- 论文详细提供了训练数据集(E-GMD)、预训练MFM模型(MERT)、评估数据集(IDMT, MDB)和评估工具(mir_eval)的信息。

- 训练超参数(学习率、batch size等)和模型架构描述比较详细。

- 但是,论文未提供代码仓库、模型权重或详细的复现脚本链接。对于50M参数模型的具体实现,缺乏代码将给完全复现带来障碍。