📄 Neural Network-Based Time-Frequency-Bin-Wise Linear Combination of Beamformers for Underdetermined Target Source Extraction

#语音分离 #波束成形 #神经网络 #多通道

✅ 7.0/10 | 前25% | #语音分离 | #波束成形 | #神经网络 #多通道

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Changda Chen(早稻田大学)

- 通讯作者:未说明(根据论文署名顺序和常见惯例,Shoji Makino可能是通讯作者,但论文未明确标注)

- 作者列表:

- Changda Chen(早稻田大学)

- Yichen Yang(西北工业大学、早稻田大学)

- Wei Liu(早稻田大学、武汉大学电子信息学院)

- Shoji Makino(早稻田大学)

💡 毒舌点评

亮点:该工作巧妙地利用神经网络的上下文建模能力,解决了传统逐时频点波束成形选择/组合策略导致的频谱不连续和目标自抑制问题,实现了更平滑、更一致的干扰抑制。短板:方法的有效性验证高度依赖于双麦克风这一特定且受限的设置,其在更通用的多麦克风阵列(M>2)下的可扩展性和性能优势有待进一步证明。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:未提及。

- Demo:未提及。

- 复现材料:论文提供了详细的模型架构描述、训练策略、超参数设置和基线方法的实现细节(如迭代次数、噪声协方差估计方式),这些信息对复现有重要帮助。

- 论文中引用的开源项目:使用了LibriSpeech数据集[25],并引用了房间冲激响应生成[26]和扩散噪声生成[27]的方法。

- 总体而言,论文中未提及开源计划。

📌 核心摘要

- 要解决什么问题:在麦克风数量少于同时活跃声源数量的欠定场景下,传统波束成形(如MPDR)无法有效抑制所有干扰。现有的时频单元选择(TFS)或线性组合(TFLC)策略虽利用了信号的稀疏性,但其独立的逐点决策会破坏时频相关性,导致目标信号失真。

- 方法核心:提出NN-TFLC-MPDR框架。该框架使用神经网络编码混合信号和多个候选波束成形器的输出,通过一个基于交叉注意力的“注意力门”,预测出具有时频上下文一致性的线性组合权重。利用这些权重,首先更新一组MPDR波束成形器(无需显式噪声协方差估计),然后再次通过注意力门得到最终权重,组合更新后的波束以提取目标。

- 与已有方法相比新在哪里:

- 决策方式:将传统方法中基于最小输出功率的逐时频点最优(硬/软)选择,替换为由神经网络预测的、上下文感知的组合权重。

- 波束成形器构建:在更新MPDR波束成形器时,避免了需要干扰源先验信息的噪声协方差估计,仅利用加权混合信号的协方差。

- 框架灵活性:设计支持可变数量的输入波束成形器,并通过分阶段训练提升了对多干扰源的泛化能力。

- 主要实验结果:在双麦克风、2-4个干扰源的模拟混响环境中,NN-TFLC-MPDR在SI-SDR指标上一致性地超越了传统的TFS/TFLC-MPDR基线。例如,在2个干扰源下,NN-TFLC-MPDR(w/o Full)的SI-SDR为4.80±1.55 dB,高于TFLC-MPDR的2.86±1.55 dB。其性能甚至能与需要干扰源先验信息的TFS/TFLC-MVDR方法竞争(2I下4.52±1.43 dB),且在3I场景下SI-SIR显著提升(9.82±2.55 dB vs 7.87±1.61 dB)。

- 实际意义:该方法为麦克风数量受限的消费电子产品(如智能音箱、耳机)提供了一种更鲁棒的目标语音提取方案,能够在复杂声学环境中(如多人说话)减少对目标语音的损伤,同时有效抑制干扰。

- 主要局限性:实验验证仅限于双麦克风阵列的特定设置,未探索其在更多麦克风(M>2)这一波束成形更常见场景下的表现;此外,训练和测试均基于模拟数据,缺乏真实世界场景的验证。

🏗️ 模型架构

NN-TFLC-MPDR的整体架构如图1(a)所示。其工作流程为一个两阶段的循环结构,旨在精细化波束组合权重。

- 输入处理:

- 双通道时域信号经STFT变换为时频表示。

- 利用目标源的方向信息(RTF)计算预期的通道间相位差(EIPD),其正弦和余弦作为目标相位线索,与混合信号的实部虚部拼接。

- 准备J个初始零点波束成形器(每个波束指向目标DOA,并在一个随机干扰方向设置零点),这些波束的输出信号同样被编码。

- 编码器(图1(b)):

- 混合编码器与波束编码器共享相同的结构。编码器由4个Inplace CGLU (ICGLU)块组成,步长为1以保持时频分辨率。每个ICGLU块后接组归一化(GN)和ELU激活。

- 随后是一个双层的频率独立Bi-LSTM,用于在时间维度上建模上下文,且各频率共享权重。

- 最后通过线性层将通道维减半,并reshape回原始时频结构。波束编码器在J个波束输出上共享权重,支持可变数量的输入。

- 注意力门(图1(c)):

- 接收混合编码器和波束编码器的输出作为Query (Q) 和Key (K)。

- 通过缩放点积注意力机制(公式4)计算softmax权重,得到每个波束在每个时频单元的线性组合系数α。

- MPDR波束更新与第二次组合:

- 第一次权重应用:利用注意力门预测的α作为掩模,计算加权协方差矩阵,并据此更新J个MPDR波束成形器(公式3)。此更新使用包含目标的全混合信号,因此是MPDR而非MVDR。

- 第二次权重预测:将更新后的波束信号重新送入共享的波束编码器和注意力门,得到最终的组合权重。

- 输出:使用最终权重按公式2组合更新后的波束信号,经iSTFT得到估计的目标源信号。

💡 核心创新点

- 神经网络驱动的上下文感知时频单元线性组合:

- 局限:传统TFS/TFLC在每个时频点独立进行最小功率选择,导致权重图碎片化,破坏了信号的时频连续性,可能引入相位不一致和目标失真。

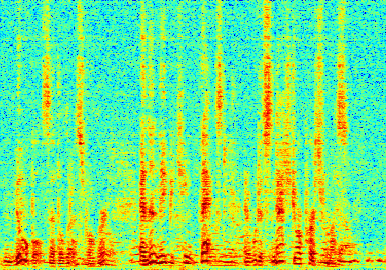

- 创新与收益:通过引入神经网络和交叉注意力机制,权重的预测综合了混合信号和波束信号的时频上下文特征。这使得预测的权重在时频平面上更平滑、更连贯(如图2所示),从而在抑制干扰的同时更好地保留了目标成分,提升了SI-SDR等指标。

- 无需显式噪声协方差估计的MPDR波束构建:

- 局限:MPDR波束成形器的更新通常需要估计噪声协方差,但在实际中这很难准确获取;而MVDR需要干扰源先验信息。传统TFS/TFLC-MPDR在更新时虽能隐式处理,但受限于独立的权重选择。

- 创新与收益:NN-TFLC-MPDR通过神经网络预测的权重,形成加权协方差来更新MPDR波束。由于权重是上下文感知的,能更稳定地形成对干扰的统计,使得MPDR更新更可靠,避免了显式噪声估计,且性能可媲美需要先验的MVDR方法。

- 支持可变数量输入波束的灵活框架:

- 局限:许多波束组合方法需要固定数量的预设波束。

- 创新与收益:模型设计(如波束编码器的批处理共享权重)允许输入不同数量的波束。实验中通过“w/o Full”(2波束训练)和“w/ Full”(4波束训练)的变体,证明了该框架可以扩展到更多干扰源的场景,表现出良好的可扩展性。

🔬 细节详述

- 训练数据:

- 数据集:使用LibriSpeech清洁语音合成的模拟混响混合信号。

- 规模:25,000个训练样本(6秒),3,000个验证集,3,000个测试集。

- 生成方式:在模拟房间(尺寸、混响时间T60在一定范围内随机)中,使用图像法生成房间冲激响应。双麦克风线阵(间距2cm)随机放置。目标DOA固定在[80°, 100°],干扰DOA分布在[0°, 65°]和[115°, 180°],每个区间最多2个干扰。输入SIR在[0, 5] dB,整体SNR在[10, 25] dB。

- 数据分布:训练集包含15000个2干扰样本,5000个3干扰样本,5000个4干扰样本。验证和测试集按比例混合。

- 损失函数:

- 主要损失:尺度不变的信号失真比损失(SI-SDR,公式5),用于提升估计信号与目标参考信号的一致性。

- 正则化损失:熵正则化项(LEnt,公式6)。在训练初期,模型预测的权重趋向于均匀分布(α ≈ 1/J),导致训练停滞。最小化熵能鼓励权重更“尖锐”(即决策更果断),加速收敛,并增强不同候选波束之间的互补性。

- 总损失:L = L_SI-SDR + λ * L_Ent,其中λ=0.05。

- 训练策略:

- 优化器:Adam。

- 调度器:StepLR,每10个epoch学习率衰减为原来的0.8倍。

- 训练流程:分为两阶段。第一阶段(NN-TFLC-MPDR w/o Full):仅在2干扰子集上训练,输入2个波束,初始学习率6e-4,训练100epoch,以2干扰验证集的平均SI-SDR选最佳模型。第二阶段(NN-TFLC-MPDR w/ Full):在第一阶段模型基础上,继续在3/4干扰子集上训练,输入4个波束,初始学习率2e-4,再训练100epoch,以整个验证集的平均SI-SDR选最佳模型。

- 关键超参数:

- 模型:编码器通道数C=32。ICGLU块核大小为(5×1)。

- 音频:采样率16kHz,STFT窗长1024点(Hanning窗),帧移256点。

- 训练:批大小B=4。熵正则化权重λ=0.05。

- 波束成形器:在验证/测试阶段,零点波束的初始角度固定(例如2I时为32.5°和147.5°)。基线TFS/TFLC方法运行5次迭代。

- 训练硬件:论文未说明GPU型号、数量及训练时长。

- 推理细节:推理流程与训练第二阶段的前向传播一致:输入经STFT处理的混合信号和J个初始波束信号,经过编码、第一次注意力预测、MPDR更新、重新编码、第二次注意力预测,最后组合并iSTFT输出。

- 正则化技巧:使用组归一化(GN)替代批归一化(BN),因为不同波束的信号分布可能差异较大,GN对此更鲁棒。

📊 实验结果

表1. 有2/3/4个干扰源的处理信号平均SI-SDR (dB), SI-SIR (dB) 和 PESQ 得分 (mean±std)。

| 方法 | 2I (2 波束成形器) | 3I (4 波束成形器) | 4I (4 波束成形器) | ||||||

|---|---|---|---|---|---|---|---|---|---|

| SI-SDR | SI-SIR | PESQ | SI-SDR | SI-SIR | PESQ | SI-SDR | SI-SIR | PESQ | |

| 未处理 | -0.81±1.00 | -0.69±1.04 | 1.13±0.07 | -2.48±0.82 | -2.40±0.83 | 1.09±0.07 | -3.88±0.77 | -3.81±0.78 | 1.09±0.09 |

| MVDR | 0.93±1.07 | 2.61±1.40 | 1.16±0.08 | -0.95±0.90 | 0.33±1.09 | 1.11±0.08 | -2.46±0.81 | -1.35±0.95 | 1.09±0.06 |

| TFS-MVDR | 4.16±1.38 | 8.35±2.16 | 1.24±0.12 | 3.98±1.29 | 8.62±1.81 | 1.22±0.13 | 2.84±1.09 | 6.88±1.59 | 1.16±0.08 |

| TFLC-MVDR | 4.52±1.43 | 8.04±2.02 | 1.25±0.13 | 4.54±1.32 | 7.87±1.61 | 1.23±0.14 | 3.37±1.13 | 6.16±1.40 | 1.17±0.08 |

| TFS-MPDR | 2.45±1.51 | 6.06±2.36 | 1.20±0.10 | 0.03±1.55 | 4.04±2.21 | 1.13±0.08 | -0.51±1.42 | 3.09±1.98 | 1.10±0.05 |

| TFLC-MPDR | 2.86±1.55 | 5.56±2.12 | 1.21±0.10 | 1.31±1.58 | 3.82±1.97 | 1.14±0.09 | 0.32±1.39 | 2.53±1.72 | 1.11±0.05 |

| NN-TFLC-MPDR (w/o Full) | 4.80±1.55 | 7.70±2.19 | 1.28±0.12 | 3.19±1.44 | 5.85±1.93 | 1.20±0.11 | 1.27±1.31 | 3.67±1.73 | 1.14±0.06 |

| NN-TFLC-MPDR (w/ Full) | 4.51±1.52 | 7.00±2.06 | 1.26±0.12 | 4.71±1.54 | 9.82±2.55 | 1.26±0.13 | 2.65±1.52 | 7.08±2.42 | 1.17±0.07 |

关键结论:

- 优于传统MPDR方法:在所有2I/3I/4I场景下,两种NN-TFLC-MPDR变体的SI-SDR均显著优于TFS-MPDR和TFLC-MPDR。例如,在2I时,NN-TFLC-MPDR (w/o Full)的SI-SDR比TFLC-MPDR高近2 dB。

- 媲美甚至超越需要先验的MVDR方法:NN-TFLC-MPDR (w/ Full)在2I和3I场景下的SI-SDR与TFLC-MVDR相当(2I: 4.51 vs 4.52; 3I: 4.71 vs 4.54),且在3I场景下SI-SIR大幅领先(9.82 vs 7.87)。在4I场景下,其SI-SDR (2.65) 与TFLC-MVDR (3.37) 的差距小于1 dB,展现了在不使用干扰先验情况下的强大竞争力。

- 可扩展性:仅在2I数据上训练的“w/o Full”模型,在3I和4I测试集上仍能取得比传统MPDR基线更好的性能,证明了框架的泛化能力。

图2分析:该图直观对比了TFLC-MPDR和NN-TFLC-MPDR。上方的频谱图显示,TFLC-MPDR的估计信号(中间)相比参考(左)有能量缺失(红色框内),而NN-TFLC-MPDR的估计信号(右)与参考更吻合。下方的组合权重图显示,TFLC-MPDR的权重(中)在时频上高度碎片化,而NN-TFLC-MPDR的权重(右)在时频上平滑连续,在目标主导区域(红框)倾向于混合波束,在干扰主导区域(蓝框)则做出更果断的选择,这解释了其性能提升的原因。

图2分析:该图直观对比了TFLC-MPDR和NN-TFLC-MPDR。上方的频谱图显示,TFLC-MPDR的估计信号(中间)相比参考(左)有能量缺失(红色框内),而NN-TFLC-MPDR的估计信号(右)与参考更吻合。下方的组合权重图显示,TFLC-MPDR的权重(中)在时频上高度碎片化,而NN-TFLC-MPDR的权重(右)在时频上平滑连续,在目标主导区域(红框)倾向于混合波束,在干扰主导区域(蓝框)则做出更果断的选择,这解释了其性能提升的原因。

⚖️ 评分理由

- 学术质量:5.5/7:创新性(将神经网络上下文预测与经典MPDR框架结合解决欠定问题)和技术正确性较强。实验在设定的双麦克风场景下充分,有定量对比和定性可视化。不足在于实验场景单一(仅双麦克风),未讨论更一般的情况,也缺乏真实数据验证。

- 选题价值:1.5/2:针对了语音处理中一个具体且棘手的痛点(麦克风数不足时的分离),有明确的应用场景。方向属于经典信号处理与深度学习的结合,是当前研究热点之一。

- 开源与复现加成:0.0/1:论文提供了详尽的模型描述和训练细节,理论上可以复现。但未提供代码、预训练模型或数据集链接,降低了快速验证和实际应用的可能性。