📄 Multimodal Room Impulse Response Generation Through Latent Rectified Flow Matching

#音频生成 #流匹配 #空间音频

✅ 7.5/10 | 前25% | #音频生成 | #流匹配 | #空间音频

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Ali Vosoughi(University of Rochester)

- 通讯作者:未说明(根据贡献标注†,Qihui Yang和Nathan Paek可能为通讯作者,但论文未明确标注)

- 作者列表:Ali Vosoughi(University of Rochester)、Yongyi Zang(Smule Labs)、Qihui Yang(University of California, San Diego)、Nathan Paek(Stanford University)、Randal Leistikow(Smule Labs)、Chenliang Xu(University of Rochester)。所有作者贡献均等标注为‡。

💡 毒舌点评

这篇工作巧妙地用“两阶段法”绕开了RIR领域的两大痛点:先让VAE学会了“脑补”高频,再用流匹配模型学会了“听懂人话”。其核心创新(文本条件生成全频带RIR)和扎实的实验(RT60误差从-37%跃升至8.8%)令人印象深刻,是近期RIR生成领域的一个亮点。但“caption-then-rewrite”流程依赖一堆闭源模型(VLM, LLM)来生成训练数据,这种“用魔法打败魔法”的做法虽然有效,却可能成为复现和分析的黑箱,且最终模型效果的上限恐怕被合成数据的质量牢牢锁死。

🔗 开源详情

- 代码:论文中未提及代码链接。主页链接

https://ali-vosoughi.github.io/PromptReverb/仅提供音频样例演示。 - 模型权重:未提及公开权重。

- 数据集:论文使用了多个公开数据集,并声称数据集将公开,但未提供当前获取链接或说明。

- Demo:提供了在线音频样例演示(通过上述主页链接)。

- 复现材料:论文给出了较为详细的模型架构描述、损失函数、部分训练超参数(如β值、CFG强度、模型尺寸),但未提供完整的训练脚本、配置文件或预训练检查点。

- 引用的开源项目/模型:论文明确依赖或借鉴了以下开源项目/模型:Moondream2, Qwen2-VL, Microsoft Phi-4 (用于文本生成),WavTokenizer, HiFi-GAN, PyRoomAcoustics等。

- 总结:论文未提及完整的开源计划,仅提供了演示页面和部分技术细节。

📌 核心摘要

- 问题:现有房间脉冲响应(RIR)生成方法面临两大核心挑战:一是缺乏高质量的全频带(如48kHz)RIR训练数据集;二是现有模型无法从多样化的输入(尤其是自然语言)中生成声学准确的RIR,限制了其在创意和实际应用中的使用。

- 方法核心:本文提出了一个名为PromptReverb的两阶段生成框架。第一阶段:训练一个β-变分自编码器(VAE),能将带限RIR上采样至全频带48kHz质量。第二阶段:构建一个基于rectified flow matching的条件扩散Transformer(DiT),它以VAE编码器的潜在表示为目标,根据文本描述生成相应的RIR。

- 与已有方法相比新在哪里:这是首个能够从自由形式的自然语言文本描述合成完整48kHz RIR的方法。它无需360°全景图像、深度估计、三维几何模型或专业声学参数。通过“caption-then-rewrite”流程,利用视觉语言模型和大语言模型自动生成大规模、多样化的文本-RIR训练对。

- 主要实验结果:在包含1957个测试样本的评估中,PromptReverb的XL模型在长文本条件下实现了8.8%的平均RT60误差,而基线方法Image2Reverb的误差为-37%(严重低估混响时间)。在主观听感评估中,PromptReverb在混响质量和文本匹配度两个维度上均优于基线。

- 关键结果对比表(来自论文表1):

| Error Type | Baseline [7] | XL, Long | XL, Short | L, Long | L, Short | B, Long | B, Short | S, Long | S, Short |

|---|---|---|---|---|---|---|---|---|---|

| Mean Error (%) | -37.0 | 8.8 | 4.8 | 24.6 | 26.0 | 30.2 | 27.7 | 43.4 | 21.9 |

- 实际意义:为虚拟现实(VR)、增强现实(AR)、游戏音频、建筑声学模拟和音频制作等领域提供了一种灵活、高质量的RIR合成工具,用户可通过直观的文本描述定制所需混响效果,降低了专业门槛。

- 主要局限性:(1) 模型性能的上限可能受限于训练数据的质量和多样性,其中大量数据来自合成(PyRoomAcoustics)或历史录音,未必完全覆盖真实世界的复杂声学场景。(2) “caption-then-rewrite”流程本身依赖于多个外部模型,其质量直接影响最终生成效果。(3) 论文未提供代码、模型权重或数据集,复现依赖较大。

🏗️ 模型架构

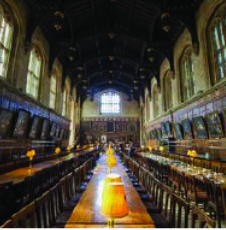

PromptReverb的架构分为三个核心部分(如图1所示):

整体流程:输入为自然语言文本描述,最终输出为一段全频带(48kHz)的房间脉冲响应音频波形。

变分自编码器(VAE):

- 功能:学习将全频带RIR压缩到一个紧凑的潜在空间,并能够从该潜在表示解码出高质量的48kHz RIR。其核心价值在于让后续的生成模型可以在潜在空间操作,同时通过解码器实现从带限数据到全频带的“上采样”。

- 内部结构:

- 编码器:采用ResBlocks处理输入的复数谱图(投影到128个mel频带),通过时间轴上的下采样步长

[1, 2, 3],生成维度为16、时间分辨率约23.6Hz的潜在表示。 - 解码器:采用混合架构,结合了1D ConvNeXt块和一个Transformer预处理阶段(参考WavTokenizer),负责从潜在表示重建出完整的48kHz RIR波形。

- 编码器:采用ResBlocks处理输入的复数谱图(投影到128个mel频带),通过时间轴上的下采样步长

- 训练:遵循β-VAE框架(β=10⁻⁴),并引入HiFi-GAN判别器进行对抗训练。损失函数包含三部分:基于mel频谱和RT60均值的重建损失、Hinge GAN对抗损失、以及特征匹配损失。训练时随机降低输入音频采样率,但要求解码器仍输出全频带信号,从而赋予其天然的上采样能力。

文本描述管道(Caption-Then-Rewrite Pipeline):

- 功能:从场景图像生成多样化、自然的文本提示,用于训练条件生成模型。

- 流程:

- 第一步(Captioning):使用两个视觉语言模型(Moondream2和Qwen2-VL)为图像生成描述。其中Qwen2-VL的提示要求提取声学相关字段(如空间类型、尺寸、主要材料等)。

- 第二步(Rewriting):使用大语言模型(Microsoft Phi-4)将第一步生成的描述性文本转化为约55条风格多样(50+种写作风格)、角色各异(40+种用户角色)的自然用户请求(如“I need a reverb that sounds like a grand university hall…”)。通过随机化温度、top-p等参数确保多样性。

条件Rectified Flow Matching生成模型:

- 功能:这是系统的核心生成器,负责根据文本描述生成RIR的潜在表示。

- 内部结构:采用一个条件扩散Transformer(DiT)。模型学习一个速度场

vθ(xt, t, c),将高斯噪声x0沿着最优直线路径传输到目标RIR潜在表示x1。 - 训练目标:采用伪Huber惩罚的流匹配损失(公式2)。通过dropout-based的条件增强实现无分类器引导(CFG),在推理时使用引导强度6.0以增强文本条件的遵循度。

- 推理:使用自适应中点求解器(RK2)积分学到的ODE,结合余弦时间重参数化以改善收敛。

- 多模态条件:条件

c包括文本嵌入、音频特征和恒定参数。

数据流:文本描述 → 文本编码器 → 条件c;随机噪声x0 → DiT(在t时刻,以c为条件)→ 估计速度场 → 通过ODE求解逐步去噪得到潜在表示x1 → 冻结的VAE解码器 → 48kHz RIR波形。

💡 核心创新点

- 两阶段解耦架构:将“从低质量数据生成高质量全频带RIR”和“从文本生成RIR特征”这两个难题解耦。VAE专注于学习全频带重建和上采样能力,生成模型专注于从文本到声学特征的映射,降低了单个模型的学习难度。

- 首个基于自然语言的完整RIR生成:不同于以往需要360°图像、深度图或精确声学参数的方法,PromptReverb首次实现了从自由、开放的自然语言描述生成完整的48kHz RIR,提供了更直观、灵活的人机交互接口。

- 利用LLM构建大规模多样训练数据:创新性地设计了“caption-then-rewrite”流水线,利用预训练的VLM和LLM自动从少量带图像的RIR数据中衍生出大规模、风格多样的文本-音频对训练数据,有效缓解了高质量配对数据稀缺的问题。

- 在RIR生成中应用Rectified Flow Matching:将rectified flow matching这一高效的生成范式应用于RIR的潜在空间生成。相比传统扩散模型,其直线传输路径可能带来更稳定的训练和更少的采样步数。

🔬 细节详述

- 训练数据:

- 规模:训练集145,976个,验证集7,964个,测试集1,957个样本,均标准化为5秒时长。

- 来源:整合了多个公开RIR数据集:C4DM, RIRS_NOISES, Image2Reverb, PyRoomAcoustics合成数据, SoundSpaces 2.0, OpenAIR,并补充了从在线论坛收集的自由许可RIR(包括非常规环境)。

- 预处理:多通道RIR在训练时随机选择一个通道。输入VAE编码器的是复数谱图。

- 数据增强:在VAE训练时,通过随机降低输入采样率来增强上采样能力。文本描述通过“rewrite”过程实现数据增强。

- 损失函数:

- VAE损失:由重建损失(mel频谱域 + RT60均值MAE)、Hinge GAN对抗损失、特征匹配损失三部分组成。

- 生成模型损失:伪Huber惩罚的流匹配损失

L_FM(公式2),δ=1.0。

- 训练策略:未说明学习率、warmup、优化器、具体训练步数/轮数。

- 关键超参数:

- VAE:β=10⁻⁴;编码器下采样步长

[1, 2, 3];潜在维度16;时间分辨率23.6Hz。 - 生成模型(DiT):论文提供了四个规模的模型参数(表1脚注):S (213M), B (329M), L (616M), XL (1.5B),分别对应不同的深度、隐藏维度和注意力头数。

- CFG:推理时引导强度6.0,训练时条件dropout概率0.2。

- VAE:β=10⁻⁴;编码器下采样步长

- 训练硬件:未说明。

- 推理细节:

- ODE求解:自适应中点求解器(RK2),最大50次函数评估,容差

rtol= atol= 10⁻⁵。 - 时间参数化:余弦时间重参数化

τ(t) = (1 - cos(πt))/2。 - 解码:生成模型输出潜在表示后,通过冻结的VAE解码器直接得到48kHz波形。

- ODE求解:自适应中点求解器(RK2),最大50次函数评估,容差

- 正则化或稳定训练技巧:VAE采用β-VAE框架(小β值)和对抗训练。生成模型使用条件dropout实现CFG。

📊 实验结果

主要对比与结果:

与基线方法(Image2Reverb)在RT60误差上的对比(n=1957):

- PromptReverb的XL模型(长提示)平均RT60误差为8.8%,而Image2Reverb为-37.0%,表明基线严重低估混响时间,而本文方法接近真实值。

- 关键数据见上述核心摘要中的表格(论文表1)。

VAE重建质量对比(n=1957):

| 方法 | SNR (dB) ↑ | MSE (10⁻⁴) ↓ | RT60 (%) �� | 时间 (ms) ↓ |

|---|---|---|---|---|

| VAE (Ours) | -0.75 | 2.83 | 6.51 | 9.8 |

| GL–Mel | -5.26 | 7.49 | 58.18 | 610.7 |

| GL–STFT | -5.30 | 7.62 | 0.19 | 604.9 |

- 结论:本文VAE在时域重建保真度(SNR、MSE)上显著优于Griffin-Lim基线,且推理速度快约62倍,适合实时应用。

- 不同模型规模下的RT60预测统计(n=1957):

| 方法 | 平均值 (s) | 中位数 (s) | 最大值 (s) |

|---|---|---|---|

| 真实值 | 3.299 | 3.106 | 5.819 |

| Image2Reverb | 1.295 | 1.211 | 2.685 |

| PromptReverb XL, long | 2.189 | 2.042 | 5.619 |

| PromptReverb XL, short | 2.044 | 1.793 | 5.261 |

- 结论:PromptReverb所有变体产生的RT60值在动态范围和方差上都比Image2Reverb更接近真实分布,表明其能更真实地建模多样声学环境。

- 图2说明:主观评估结果显示,PromptReverb在“混响质量”和“文本匹配度”两个维度上的平均得分(3.79和3.50)均高于Image2Reverb(3.51和3.26)。其质量得分甚至略高于真实录音(3.32),尽管作者对“优于真实录音”的结论持谨慎态度。

关键消融实验:

- 模型规模影响:更大的模型(如XL)在长提示下性能更好(误差8.8%),而较小的模型在短提示下可能表现更佳,说明模型容量与提示复杂度之间存在交互。

- 文本编码器评估:论文评估了15+种配置。如表2所示,在语义分离度指标上,T5-Large + First(0.095)和T5-Base + First(0.079)表现最佳,但整体差异不大,表明文本编码并非决定性瓶颈。

- 图3说明:此图展示了PromptReverb在不同提示长度下,随模型规模增大,其预测的RT60均值、中位数和最大值都逐渐向真实值靠近,而Image2Reverb的预测值则显著偏低。

⚖️ 评分理由

- 学术质量:6.0/7

- 创新性:提出了首个文本到全频带RIR的生成框架,两阶段解耦设计和利用LLM构建数据管道是有效创新。

- 技术正确性:架构设计合理,技术细节描述清晰,方法应用得当。

- 实验充分性:实验设计较为全面,涵盖了客观、主观评估,与强基线对比,并进行了模型规模和文本编码器的消融研究。数据集规模较大。

- 证据可信度:主要指标(RT60误差)提升显著,实验结果表格清晰,证据链完整。

- 选题价值:1.5/2

- 前沿性:推动了RIR生成从“视觉条件”向“语言条件”的转变,是多模态音频生成的一个重要进展。

- 潜在影响:有望降低VR/AR、游戏、音频制作中空间音频设计的门槛,具有明确的应用前景。

- 应用空间:空间音频、游戏引擎、音频后期处理、建筑声学模拟。

- 读者相关性:对从事音频生成、声学建模、多模态学习的读者有较高价值。

- 开源与复现加成:0.0/1

- 论文未提供代码、模型或数据集的公开链接。虽然描述了训练细节,但复现仍需大量额外工作,因此未给予加成。