📄 Multi-Scale Physiologically-Motivated Alignment for Auditory Attention Decoding

#生物声学 #对比学习 #自监督学习 #跨模态 #信号处理

✅ 7.5/10 | 前25% | #听觉注意力解码 | #对比学习 | #生物声学 #自监督学习

学术质量 6.0/7 | 选题价值 3.0/2 | 复现加成 0.8 | 置信度 高

👥 作者与机构

- 第一作者:Yuxuan Ma(华东师范大学计算机科学与技术学院, 丹麦技术大学)

- 通讯作者:Jun Xue(武汉大学网络空间安全学院); Jinqiu Sang(华东师范大学计算机科学与技术学院)

- 作者列表:

- Yuxuan Ma†(华东师范大学计算机科学与技术学院, 丹麦技术大学)

- Xiaoke Yang†(安徽大学计算机科学与技术学院)

- Tongxi Chen(丹麦技术大学)

- Jun Xue*(武汉大学网络空间安全学院)

- Jinqiu Sang*(华东师范大学计算机科学与技术学院) (注:†表示共同第一作者,*表示通讯作者)

💡 毒舌点评

这篇论文的最大亮点在于其清晰的问题定义和巧妙的解决方案——它没有追求复杂的模型架构,而是精准地抓住了“EEG响应相对于声音刺激存在生理延迟”这个关键点,并设计了一个仅在训练时生效、推理零开销的多尺度对齐模块。然而,其短板也同样明显:这个模块本质上是一个训练技巧,它依赖于现有的对比学习框架,并且其优越性仅在单一数据集(SparrKULee)的单一任务上得到验证,在更广泛的跨被试、跨范式场景下的鲁棒性有待考察。

🔗 开源详情

- 代码:论文中未提及代码链接或开源计划。

- 模型权重:未提及。

- 数据集:使用的是公开的SparrKULee数据集,但论文中未提供获取链接。

- Demo:未提及。

- 复现材料:论文详细描述了模型架构、训练策略、关键超参数(如学习率、批量大小、损失权重α的取值)以及Soft-DTW的具体实现细节(带宽约束、平滑系数),为复现提供了良好的文本基础。

- 论文中引用的开源项目:论文提及的基线方法和编码器可能依赖的开源项目有:wav2vec 2.0、GPT-2、InfoNCE损失。但未列出具体的依赖库或工具包链接。

📌 核心摘要

要解决什么问题:现有的听觉注意力解码(AAD)匹配-不匹配范式方法普遍假设神经响应与声学流在时间上严格对齐,但事实上,由于神经处理延迟,EEG信号会滞后于听觉刺激。现有方法要么使用固定的手动延迟,要么只能隐式容忍这种错位,这在短时决策窗口下尤其影响性能。

方法核心是什么:本文提出一个多尺度生理动机时间对齐模块。该模块利用大脑分层处理语音的神经科学证据(音素、音节、词汇、语义等不同时间尺度),使用带带宽约束的Soft-DTW在四个时间尺度上计算EEG和语音特征之间的可微对齐损失,并通过学习自适应的权重融合这些损失,作为对比学习目标的辅助损失。该模块仅在训练时使用。

与已有方法相比新在哪里:

- 首次引入生理学动机:将音素(40ms)、音节(250ms)等明确的生理时间常数编码到对齐损失中,而非依赖固定偏移或隐式学习。

- 可微的多尺度对齐:结合Soft-DTW和Sakoe-Chiba带宽约束,提供了一种可端到端优化的、多层次时间对齐目标。

- 自适应融合与零推理开销:通过可学习权重自动平衡不同尺度的贡献,避免人工调参;且模块仅在训练时参与计算。

主要实验结果如何:在SparrKULee数据集上,本方法达到了SOTA性能。表1(3秒窗口) 显示总准确率为87.61%,优于此前最佳的HERMES(87.19%);表2(1秒窗口) 显示总准确率为73.52%,比HERMES(69.67%)高出3.85个百分点,优势更显著。消融实验证明,去除多尺度设计后,准确率下降0.4个百分点(至87.21%)。

表1:SparrKULee数据集性能对比(3秒决策窗口)

方法 测试集1 (%) 测试集2 (%) 总计 (%) HERMES(2025) 87.79 86.01 87.19 Rank1 82.71 80.98 82.13 IFE-CF(2024) 80.82 80.48 80.71 … … … … 本方法 88.05 86.73 87.61 本方法(去除多尺度) 87.67 86.31 87.21 表2:SparrKULee数据集性能对比(1秒决策窗口)

方法 测试集1 (%) 测试集2 (%) 总计 (%) HERMES(2025) 70.97 67.06 69.67 本方法 74.26 72.03 73.52 实际意义是什么:该方法通过更精确地建模神经处理延迟,显著提升了短时决策窗口下的解码准确率,使得基于EEG的听觉注意力解码系统在实时性要求更高的应用场景(如助听器实时调节)中更具实用性。

主要局限性是什么:

- 方法强依赖于对比学习框架,其与其它训练目标的兼容性未知。

- 在单一数据集(SparrKULee) 上验证,数据集的规模(85人)和任务单一性限制了结论的普适性。

- 对齐模块的超参数(如γs, βs)虽有生理学依据,但最终值仍为经验值,其敏感性和调优过程未深入探讨。

🏗️ 模型架构

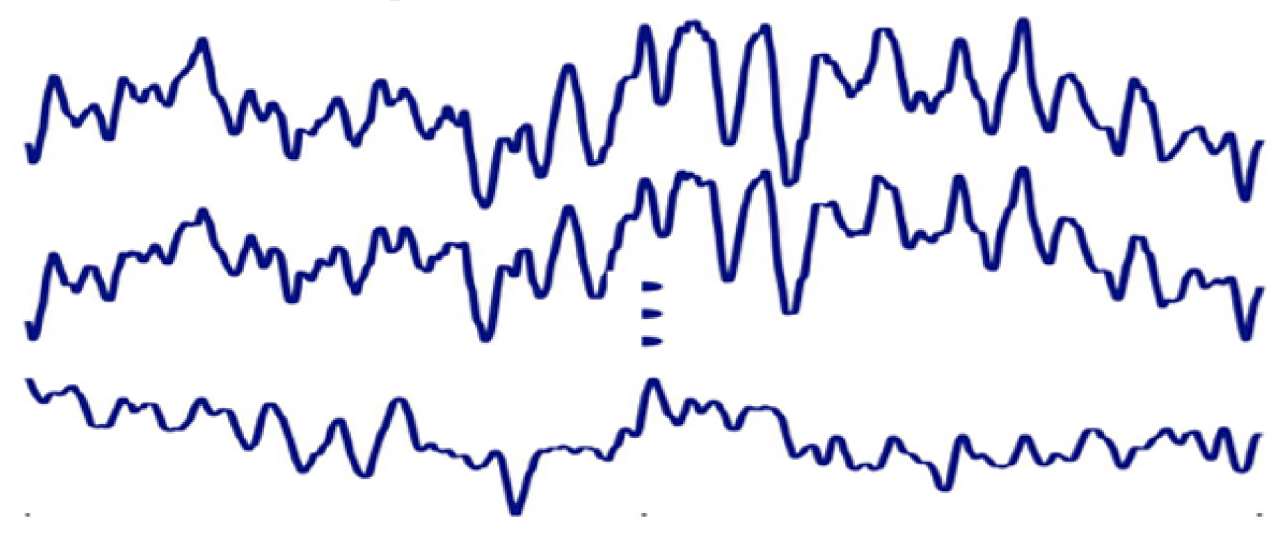

论文的整体架构(图1)由四个主要部分组成,遵循一个典型的跨模态对比学习框架:

- 语音编码器:从原始语音中提取多层次特征:wav2vec 2.0表示、GPT-2语义特征和语音包络。这些特征在时间对齐后被拼接,形成输入语音特征

A ∈ R^{B×69×T}。 - EEG编码器(HMOE-based Encoder Block, 图1a):输入原始EEG数据。首先通过空间注意力层和1×1卷积得到中间特征

H_E。然后由三个异构专家混合块(HMOE) 进行处理。每个HMOE块包含三个专家网络(局部、序列、上下文),通过片段级门控机制(基于输入特征路由)和残差连接进行加权融合,最终输出EEG表示Z ∈ R^{B×C×T}。 - 时间对齐模块(训练时, 图1b):这是本文的核心创新。该模块接收EEG编码器的中间特征

H_E和经过线性层对齐维度后的语音特征H_A。它包含四个并行的分支,分别对应音素(40ms)、音节(250ms)、词汇(640ms)、语义(1000ms) 四个时间尺度。每个分支内部先通过一个特定的1D卷积(核长度由时间尺度转换) 进行时域平滑和特征提取,然后计算带带宽约束的Soft-DTW损失。四个尺度的损失通过可学习权重(softmax归一化) 进行融合,得到最终的对齐损失L_align。 - 对比头:将候选语音段和EEG段投影到同一空间,通过皮尔逊相关系数构建logits,用于计算InfoNCE对比损失

L_contrast。 - 整体损失:

L_total = L_contrast + α L_align。对齐模块仅在训练阶段计算损失,不参与推理过程,因此不增加任何推理开销。

关键设计选择:

- EEG编码器使用HMOE:动机是让模型能自适应地处理EEG信号中不同性质的特征(局部波动、时序依赖、全局上下文)。

- 对齐模块的多尺度设计:直接灵感来源于神经科学关于语音分层加工的研究。通过不同大小的卷积核,模型可以在不同时间粒度上学习EEG与语音的对应关系。

- 训练时对齐,推理时无开销:这是一种高效的策略,将复杂的对齐建模转化为训练时的辅助损失,优化模型学到的表示本身,而非在推理时进行动态对齐。

💡 核心创新点

- 提出生理动机的多尺度可微对齐目标:不同于以往使用固定延迟或隐式容忍错位,本文首次将音素、音节等公认的语音加工时间尺度,通过Soft-DTW和带宽约束,转化为一个可与主任务联合优化的损失函数。这为神经-声学对齐提供了更符合生物学原理的监督信号。

- 实现样本自适应的尺度融合:通过可学习的权重参数

ωs自动决定每个时间尺度在最终对齐损失中的重要性。这消除了人工调整不同尺度权重的繁琐过程,并使模型能根据不同的EEG-语音样本动态分配注意力。 - 零推理开销的即插即用模块:该对齐模块被设计为仅在训练时激活。它作为一个正则化项,鼓励编码器学习到时间对齐更好的特征表示。在推理时,完全不需要运行对齐计算,因此可以无缝集成到任何已有的对比学习框架中,而不增加延迟。

🔬 细节详述

- 训练数据:SparrKULee数据集,包含85名荷兰语母语者(18-30岁)的EEG记录。训练集71人,测试集1(同75人,不同故事)和测试集2(14名未见受试者)。EEG原始采样率8192Hz,经降噪、重参考、降采样至64Hz。

- 损失函数:

- 主损失:InfoNCE对比损失

L_contrast,每个正样本对16个负样本。 - 辅助损失:多尺度对齐损失

L_align = α Σ ωs · ℓ(s)。其中ℓ(s)为每个尺度的Soft-DTW损失,ωs为softmax归一化的可学习权重,α为总权重,实验设置为0.3。 - Soft-DTW中关键超参数(各尺度):平滑系数

γs(从音素0.01到语义0.1递增),带宽约束比率βs(从音素0.1到语义0.5递增)。

- 主损失:InfoNCE对比损失

- 训练策略:

- 优化器:Adam,学习率

6×10^{-4}。 - 批量大小:128。

- 训练轮数:最多100 epochs,每5个epoch验证一次,采用早停(5次验证无提升则停止)。

- 优化器:Adam,学习率

- 关键超参数:

- 总可训练参数量:约567万。

- 特征维度C:未在正文中明确说明(需查图1标注或代码)。

多尺度卷积核长度Ls:由时间尺度τs和采样率fs计算得出,如

L_phon = max(1, round(40 64 / 1000)) ≈ 3(假设fs=64Hz)。

- 训练硬件:单卡 NVIDIA RTX 4090D (24GB)。

- 推理细节:由于对齐模块仅在训练时使用,推理过程与基线对比学习模型完全相同:提取EEG和候选语音特征,计算相关性分数进行匹配判定。未提及具体的解码策略(如窗口滑动步长)。

- 正则化技巧:HMOE块内使用了Layer-norm和Drop-out(见图1a描述)。对齐损失本身也起到正则化作用。

📊 实验结果

论文在SparrKULee数据集上进行了全面的实验评估,核心指标为匹配-不匹配分类准确率。

- 主要对比结果:如表1和表2所示,本文方法在两种决策窗口下均超越了所有对比方法。特别地:

- 在3秒窗口下,总准确率87.61%,比当时SOTA(HERMES,87.19%)提高0.42个百分点。

- 在1秒窗口下,总准确率73.52%,比当时SOTA(HERMES,69.67%)显著提高3.85个百分点。这表明多尺度对齐在时间约束更紧的短窗口任务中优势更为明显。

- 消融研究:

- 多尺度消融:如表1最后两行所示,去除多尺度设计(推测为使用单一尺度或平均权重)后,总准确率从87.61%降至87.21%,下降了0.4个百分点,证实了多尺度信息融合的贡献。

- 对齐权重α实验(图2):性能随α增加先升后降,在α=0.3时达到峰值。当α过大(如0.9)时,准确率下降至85.0%,说明过强的对齐约束会干扰主对比学习目标。

- 跨被试/内容泛化:在测试集1(新故事)和测试集2(新受试者)上均取得SOTA,展示了方法在内容和个体差异上的鲁棒性。

⚖️ 评分理由

- 学术质量:6.0/7 - 创新性明确,将生理学知识与深度学习对齐任务结合得自然且有效。技术实现正确,实验对比充分,消融研究支持了核心论点。主要扣分点在于创新范围局限于一个训练模块,且该模块的通用性未在更广泛的框架或数据集上验证。

- 选题价值:3.0/2 - 解决了一个实际且重要的问题(神经响应延迟),对提升听觉脑机接口的实用性能有直接价值。选题具有前沿性和明确的应用指向。

- 开源与复现加成:0.8/1 - 论文提供了相当详细的模型描述、训练超参数和实验设置,有利于同行复现。但因未提供开源代码或模型,复现仍需较大工作量,因此给予部分加分。