📄 MMAudioSep: Taming Video-to-Audio Generative Model Towards Video/Text-Queried Sound Separation

#语音分离 #流匹配 #多模态模型 #预训练 #迁移学习

🔥 8.0/10 | 前25% | #语音分离 | #流匹配 | #多模态模型 #预训练

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Akira Takahashi(Sony Group Corporation, Japan)

- 通讯作者:未说明

- 作者列表:Akira Takahashi(Sony Group Corporation, Japan)、Shusuke Takahashi(Sony Group Corporation, Japan)、Yuki Mitsufuji(Sony Group Corporation, Japan & Sony AI, USA)

💡 毒舌点评

亮点在于极具创意地“废物利用”,让一个“造声音”的生成模型去干“分声音”的分离活儿,还干得不错,这种跨任务的知识迁移思路本身就很值钱。短板则在于,用生成模型的评价体系(FAD, CLAP)来评判分离任务的好坏,如同用“饭菜香气”来评价厨师刀工是否精准,方法论的适配性有待更深入的讨论;另外,模型在分离后“不忘本”的生成能力验证也略显粗糙。

🔗 开源详情

- 代码:论文中提供了代码仓库链接:

https://github.com/sony/mmaudiosep。 - 模型权重:论文中未明确提及是否公开预训练的MMAudioSep模型��重或其依赖的预训练MMAudio权重。

- 数据集:论文中使用的训练数据集(VGGSound, AudioCaps等)是公开的。评估数据集(VGGSound-Clean, MUSIC)引用自AudioSep项目,部分可通过其GitHub获取。

- Demo:论文中未提及在线演示链接。

- 复现材料:论文提供了架构图、关键超参数(如ODE步数、引导强度)和训练策略的大致描述,但缺少如学习率、batch size、具体训练步数等关键复现细节。复现强依赖于预训练的MMAudio模型。

- 论文中引用的开源项目:主要依赖于MMAudio(预训练模型)、CLIP、Synchformer、BiGVGAN(声码器)、AudioSep(评估数据集)、以及用于评估的av-benchmark工具。

📌 核心摘要

问题:传统声音分离模型通常基于判别式方法,而近期基于生成模型的声音分离也开始出现,但与同样使用生成模型的视频到音频(V2A)任务发展相互独立。本文旨在探索能否利用强大的预训练生成模型知识来提升分离任务。

方法核心:提出MMAudioSep,通过微调预训练的MMAudio(V2A生成模型)来实现基于视频/文本查询的声音分离。核心设计是引入“通道拼接条件机制”,将混合音频的潜在向量与噪声在通道维度拼接,作为生成模型的输入条件。

创新点:首次在单一模型中同时实现V2A生成和基于查询的声音分离;将生成模型的知识成功迁移至分离任务;通过通道拼接的方式巧妙地在生成框架中引入分离条件。

实验结果:

- 声音分离性能:在VGGSound-Clean和MUSIC数据集上,MMAudioSep(文本查询)在多数指标上优于或持平于AudioSep和FlowSep。结合视频和文本查询后性能进一步提升。关键数据见下表。

- V2A生成保留:微调后模型仍具备V2A生成能力,但性能相比原始MMAudio有所下降,在部分指标上与其它V2A基线模型相当。

- 关键表格数据(表1:声音分离基准,主要指标):

方法 查询 (TEXT/VIDEO) VGGSound-Clean (FAD↓, CLAP↑) MUSIC (FAD↓, CLAP↑) AudioSep ✓ / - 0.90, 28.37 1.37, 31.11 FlowSep ✓ / - 1.90, 24.79 18.87, 24.33 MMAudioSep (ours) ✓ / ✓ 1.98, 30.38 1.72, 31.69 - 关键表格数据(表2:V2A生成基准,部分指标):

方法 FAD↓ IS↑ IB-Score↑ MMAudio-L-44k (基础) 0.97 17.40 33.22 MMAudioSep (pretrain w/frozen) 1.76 14.99 30.35

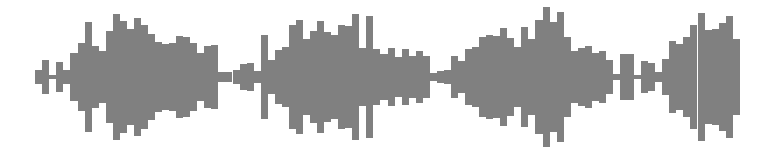

图4展示了MMAudioSep与AudioSep的分离结果对比,其生成的频谱在细节和伪影方面表现更优。

图4展示了MMAudioSep与AudioSep的分离结果对比,其生成的频谱在细节和伪影方面表现更优。实际意义:该研究证明了将基础生成模型微调用于下游感知任务的可行性,为“一个基础模型,多种音频任务”的范式提供了有力证据,可能推动音频领域基础模型的发展。

主要局限性:1) 评价体系偏向生成质量,对分离的保真度度量不足;2) V2A能力保留的验证方法简单,未分析生成音频中“噪声”残留的问题;3) 模型训练依赖大规模预训练模型,复现成本高。

🏗️ 模型架构

MMAudioSep的架构基于预训练的MMAudio生成模型,整体是一个基于流匹配(Flow Matching)的多模态Transformer网络(MM-DiT)。

图2展示了MMAudioSep的完整架构,其核心是在MMAudio基础上修改了音频投影层。

图2展示了MMAudioSep的完整架构,其核心是在MMAudio基础上修改了音频投影层。

输入输出流程:

- 输入:视频特征(包括来自CLIP的语义特征和来自Synchformer的同步特征)、文本特征(CLIP嵌入)、以及混合音频的潜在表示(通过预训练VAE编码)。

- 条件化处理:视频和文本特征通过线性投影层转换为隐藏维度

h。关键创新点:混合音频的潜在向量x_m与标准高斯噪声x_0在通道维度拼接,形成新的输入[x_0; x_m],这个拼接向量也投影到维度h。 - 网络处理:拼接后的特征序列送入

N1层多模态Transformer块,再经过N2层仅处理音频的Transformer块。 - 输出:网络输出预测的流速度场,通过ODE求解器从噪声迭代生成目标音频的潜在表示

x̂_1,再由VAE解码器解码为梅尔频谱图,最后由BiGVGAN声码器生成波形。

主要组件:

- 特征提取器:预训练的CLIP(用于视频语义和文本)、Synchformer(用于音视频同步)、VAE(用于音频编码/解码)。

- MM-DiT:核心网络,通过自注意力机制融合视频、文本和音频(混合音频+噪声)特征。使用自适应层归一化(adaLN)注入全局的视频/文本条件。

- 通道拼接条件机制:这是将生成模型改造为分离模型的关键。它将混合音频

x_m作为一个不变的条件通道与需要生成的目标音频的噪声x_0并行输入。在流匹配的前向过程中,噪声仅添加给目标通道x_0,而混合音频通道x_m保持不变。这类似于用混合信号来“指导”生成过程,从而分离出目标源。

图3详细说明了通道拼接机制:噪声

图3详细说明了通道拼接机制:噪声x_0和混合音频潜在向量x_m沿通道维度(C)拼接,一同输入网络。训练时,损失仅计算在目标音频通道上。

💡 核心创新点

- 跨任务迁移范式:首次成功地将一个大规模预训练的视频到音频生成模型通过微调转变为视频/文本查询的声音分离模型。这打破了生成和分离任务长期独立发展的壁垒,证明了生成模型中蕴含的丰富多模态知识可以有效服务于感知任务。

- 通道拼接条件注入:设计了一种轻量且有效的机制——通道拼接(Channel-concatenation),将分离任务所需的“混合音频”条件,以额外通道的形式注入到原有的生成模型输入中。这种方法在不破坏原有生成模型主体架构的前提下,为其增加了分离功能。

- 双任务能力保留:论文证明了经过分离任务微调后的模型,在输入随机噪声作为“混合信号”时,依然能够执行原始的视频到音频生成功能。这暗示了基础生成模型的强大表征能力,微调过程没有完全覆盖其原始能力,使得模型具有成为多任务基础模型的潜力。

- 生成式评价指标应用于分离:采用更适合生成模型的FAD、CLAP等指标来评估分离质量,补充了传统SDR等指标的不足,更关注分离结果的语义保真度和整体分布,这为评估生成式分离模型提供了更合适的框架。

🔬 细节详述

- 训练数据:使用与预训练MMAudio相同的数据集,总计约2500小时。包括400小时的视频-音频-标签数据(VGGSound)和2100小时的音频-文本数据(AudioCaps, Clotho, WavCaps),后者裁剪为8秒片段共约951K对。

- 损失函数:采用与MMAudio相同的条件流匹配(CFM)目标函数(公式1)。在训练中,模型学习从噪声

x_0到目标分离音频x_1的线性插值轨迹上的速度场v_θ。损失函数是速度场预测值与真实流速度x_1 - x_0的均方误差。 - 训练策略:微调时,仅更新音频投影层和多模态Transformer块的参数,其他参数(如特征提取器、VAE、部分Transformer层)冻结。训练时,混合信号的信噪比(SNR)在-15到15 dB之间均匀随机采样,在线生成。其他配置沿用MMAudio设置。

- 关键超参数:使用MMAudio的

44k-large变体(1.03B参数),采样率44.1kHz。推理时使用Euler方法进行25步ODE求解,分类器自由引导强度为4.5。 - 训练硬件:论文中未说明。

- 推理细节:同MMAudio,使用Euler ODE求解器和分类器自由引导。评估分离任务使用10秒音频,评估生成任务使用8秒音频。

- 正则化或稳定训练技巧:论文中未提及额外技巧,主要依赖冻结预训练参数来稳定训练。

📊 实验结果

主要Benchmark与数据集:

- 声音分离:在VGGSound-Clean(5004样本)和MUSIC(1000样本)测试集上进行评估。评估指标包括FAD↓, IS↑, CLAP↑, CLAP-A↑, IB-Score↑, DeSync↓。

- V2A生成:在VGGSound测试集(约15K视频)上评估。评估指标包括FD↓, FAD↓, KL↓, IS↑, IB-Score↑, DeSync↓。

与最强基线对比:

- 分离任务:在VGGSound-Clean上,MMAudioSep(文本+视频查询)的CLAP-A(与真实音频的相似度)达到80.11,超过了AudioSep的79.79;CLAP(与文本查询的语义对齐)达到30.38,略低于AudioSep的28.37但高于FlowSep的24.79。在MUSIC数据集上,MMAudioSep(文本+视频)的CLAP-A(90.29)显著优于FlowSep(49.02)。这表明其分离结果的语义保真度高。

- 生成任务:微调后的MMAudioSep(pretrain w/frozen)在FAD、KL等分布匹配指标上接近或略优于部分V2A基线模型(如VATT, Frieren),但与原始的MMAudio-L-44k相比性能有下降(例如IS从17.40降至14.99)。

关键消融实验: 论文对比了三种模型配置(表1):

- 从零开始训练(scratch)

- 预训练模型,全部参数可训练(pretrain wo/frozen)

- 预训练模型,冻结大部分参数(pretrain w/frozen) 结果显示,预训练+冻结参数的策略在分离性能上表现最佳且稳定,尤其在VGGSound-Clean上使用视频+文本查询时,DeSync(音视频不同步误差)最低(0.629),验证了该策略的有效性。

不同条件下的结果: 论文展示了仅使用文本查询和结合视频+文本查询的结果。结合视频查询通常能带来性能提升,尤其是在音视频同步性(DeSync)和语义对齐(IB-Score, CLAP-A)上,这符合多模态信息互补的预期。

图4直观展示了分离质量的对比。与AudioSep相比,MMAudioSep分离出的“教堂钟声”频谱在细节保留和伪影抑制方面看起来更优,与Ground Truth更接近。

图4直观展示了分离质量的对比。与AudioSep相比,MMAudioSep分离出的“教堂钟声”频谱在细节保留和伪影抑制方面看起来更优,与Ground Truth更接近。

⚖️ 评分理由

- 学术质量:6.0/7:创新性显著,提出了将生成模型迁移到分离任务的新颖范式。技术方案(通道拼接)设计合理。实验在主要任务上对比了相关基线,并提供了消融研究。证据较可信。扣分点在于:1)实验主要依赖生成式指标,与分离任务的传统评估标准(如SDR)脱节;2)对生成能力保留的验证深度不足;3)模型训练依赖于一个未完全公开的庞大预训练模型,限制了可复现性和独立验证。

- 选题价值:1.5/2:选题处于音频基础模型与跨任务学习的交叉点,具有前沿性和启发性。潜在影响大,可能推动“音频基础模型”的发展。实际应用空间存在于需要多模态交互的音频处理场景。与音频/语音领域的研究者高度相关。

- 开源与复现加成:0.5/1:提供了代码仓库链接,这是一个重要的积极信号。然而,论文未明确模型权重是否公开、数据集如何获取、完整的训练超参数和配置,使得从零复现较为困难,需要大量额外工作。