📄 Melos: Sentence-To-Section Training with Multi-Task Learning for LLM-Driven Song Generation

#音乐生成 #多任务学习 #自回归模型 #歌唱语音合成

✅ 6.5/10 | 前50% | #音乐生成 | #多任务学习 | #自回归模型 #歌唱语音合成

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 -0.5 | 置信度 高

👥 作者与机构

- 第一作者:Dapeng Wu(清华大学深圳国际研究生院)

- 通讯作者:Zhiyong Wu(清华大学深圳国际研究生院)

- 作者列表:Dapeng Wu†(清华大学深圳国际研究生院),Jinhong Lu†(Wonderai, Beijing, China),Bin Su(Wonderai, Beijing, China),Shun Lei(清华大学深圳国际研究生院),Xiong Cai(Wonderai, Beijing, China),Zhiyong Wu*(清华大学深圳国际研究生院) †:共同第一作者;*:通讯作者。

💡 毒舌点评

亮点:论文提出的“句子到段落”两阶段训练策略非常务实,有效缓解了长序列建模和数据稀缺问题,让一个0.5B的模型在0.5M数据上就能生成结构相对完整的歌曲,证明了该分治思路的有效性。 短板:在音乐性(MUS)、记忆性(MEM)等主观评价维度上明显落后于Suno、Mureka等工业系统,且未开源代码和模型,其“高质量”结论难以被社区直接复现和验证,削弱了论文的说服力和实用价值。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:训练数据集为专有数据集,未提及公开。

- Demo:提供了音频样本演示页面(https://thuhcsi.github.io/Melos/)。

- 复现材料:论文给出了部分训练细节(如优化器、学习率、batch size、硬件),但缺乏完整的代码、配置、数据预处理脚本和模型检查点,复现难度大。

- 论文中引用的开源项目:

- MuCodec:音频编解码器(引用[12])。

- CAM++:说话人编码器(引用[13])。

- Qwen2:作为骨干LLM(引用[14])。

- WavLM:用于评估SECS指标(引用[16])。

- FireRedASR:用于评估PER指标(引用[17])。

- CLAP:用于评估文本-音频对齐(引用[18])。

- Audiobox Aesthetics & SongEval:用于美学评估(引用[19], [20])。

- All-in-One:用于歌曲段落切分(脚注1)。

- 总体开源情况:论文中未提及开源计划。

📌 核心摘要

- 问题:当前基于大语言模型(LLM)的端到端歌曲生成面临长音频序列建模难、训练数据有限以及歌词与歌声对齐挑战等问题。

- 方法核心:提出Melos框架,采用两阶段训练策略:首先在句子级别训练模型掌握基本的演唱能力;然后在段落(如主歌、副歌)级别训练以增强整体音乐性。同时,引入多任务学习,将歌词和声带(人声)信息作为辅助训练目标(放在序列末尾),以增强音色可控性和歌词准确性,且不增加推理开销。

- 与已有方法相比新在哪里:不同于直接在段落级别训练(如YuE),本文的渐进式学习范式使模型先易后难。不同于生成思维链(CoT)会增加推理成本,本文将辅助信息作为后置的监督信号,实现了“训练时多任务,推理时单目标”。

- 主要实验结果:在0.5M歌曲(约3万小时)上训练。在客观评估中,模型在音色相似性(SECS)和文本控制(CLAP)上表现优异(SECS 0.584, CLAP 0.270),但在FAD和PER上不及最佳基线。主观评估(MOS)显示,其整体质量(OQ 3.54)和歌词准确性(LA 4.21)与LeVo、Mureka等系统相当。消融实验证实了两阶段训练和辅助任务的有效性。

- 实际意义:为资源受限场景下的高质量歌曲生成提供了一种高效、可扩展的训练范式,证明了通过精细的训练策略可以在小数据集上获得有竞争力的生成效果。

- 主要局限性:1)未开源,限制了其影响力和可复现性;2)在音乐性、制作复杂度等核心主观指标上仍与领先的工业系统有差距;3)性能高度依赖音乐分离和说话人编码器的质量。

🏗️ 模型架构

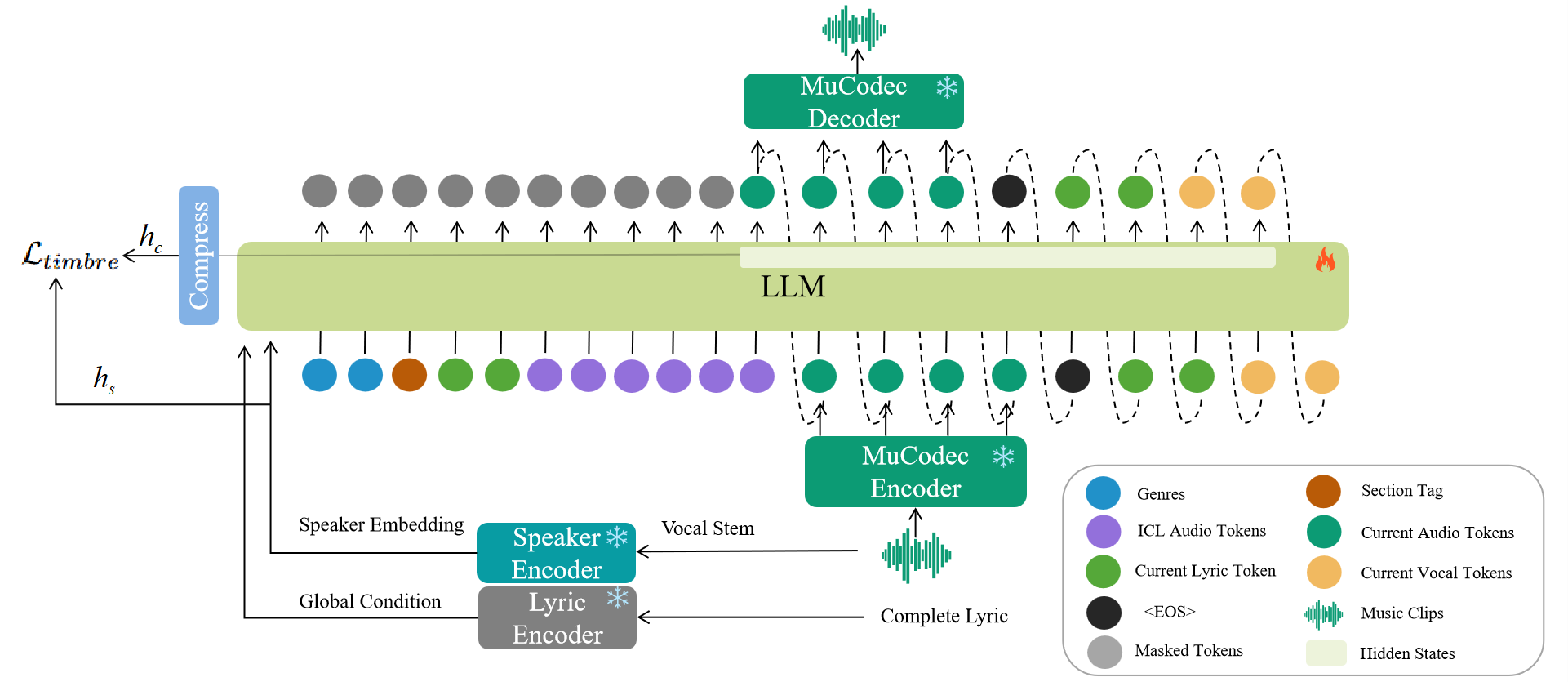

Melos采用基于LLM的自回归生成范式,整体架构如图1所示。

完整输入输出流程:

- 输入:

- 条件输入 (I):包含完整歌词文本、目标音色的人声参考音频(用于提取音色嵌入)、以及用于保持局部连贯性的上下文音频片段(ICL audio tokens)。

- 歌词编码:完整歌词通过另一个冻结的LLM(Qwen2)编码成固定长度的向量,提供全局音乐语义条件。

- 音色编码:参考人声通过CAM++说话人编码器提取192维的说话人嵌入(

h_s),再通过线性层映射到LLM的隐藏空间。 - 音频离散化:歌曲音频通过冻结的MuCodec编码器转换为离散token序列

S_T。

- 生成核心(LLM):采用0.5B参数的Qwen2作为骨干网络。模型接收文本token(包括BPE编码的提示和歌词向量)、音色嵌入、上下文音频token,并以next-token prediction的方式自回归生成音频token序列

S_T。 - 输出:生成的音频token序列通过MuCodec解码器还原为最终的音频波形。

主要组件及交互:

- LLM骨干 (Qwen2):核心生成模型,负责学习条件输入到音频token序列的映射概率

p(S_T | I; θ)。 - 音频编码器/解码器 (MuCodec):将原始音频波形与离散token空间相互转换,是连接波形与LLM的桥梁。

- 歌词编码器:为LLM提供全局、稠密的歌词语义表示,而非逐字token,以保证生成的整体连贯性。

- 说话人编码器 (CAM++):从参考人声中提取音色特征,实现音色控制。

- 辅助目标设计:在训练时,音频token序列

S_T后会连接歌词token和声带(人声)token,这些附加token也参与LLM的自回归损失计算,作为辅助监督信号。

💡 核心创新点

- 句子到段落(Sentence-to-Section)两阶段渐进式训练策略:

- 局限:直接训练整首歌(长序列)对模型容量和数据量要求极高;直接在段落级训练则忽略了发音等基础能力。

- 如何起作用:第一阶段在句子级短序列上训练,让模型先掌握演唱发音和局部连贯性。第二阶段切换到段落级(主歌、副歌、桥段、前奏、间奏、尾奏等)长序列,让模型学习跨句的音乐结构和整体和谐性。

- 收益:有效利用有限数据,提升训练效率;在0.5M数据上即可生成结构完整的歌曲,消融实验(w/o Stage1, w/o Stage2)证明了两阶段设计的必要性。

- 后置辅助任务的多任务学习框架:

- 局限:常规的音色或歌词控制往往需要在生成时引入额外的条件或模块,增加推理复杂度。

- 如何起作用:受思维链(CoT)启发,但反其道而行。将歌词token和人声token放在音频token之后(EOS之后),在训练时一同计算损失(

L_lyric,L_vocal)。推理时在EOS处停止,不生成这些辅助token。 - 收益:增强了模型对歌词和音色的跟随能力(SECS和PER指标提升),且不增加任何额外的推理成本,是一种优雅的训练时增强手段。

- 基于段落的结构化训练数据利用:

- 局限:传统方法通常将歌曲视为一个整体或随机片段,忽略了歌曲内在的曲式结构(verse, chorus等)。

- 如何起作用:利用All-in-One工具自动切分歌曲的段落,使训练数据按音乐结构组织。模型可以专门针对“纯伴奏”段落(如前奏、间奏、尾奏)进行训练。

- 收益:使模型更好地理解不同音乐结构的功能,显著提升了生成歌曲中器乐独奏部分的丰富度和表现力。

🔬 细节详述

- 训练数据:专有数据集,包含0.5百万首歌曲,约30万小时。音乐风格多样(流行、摇滚、放克等),语言分布为英:中:其他 = 5:3:2。预处理:使用音乐分离模型提取人声和伴奏音轨。

- 损失函数:

- 主损失:音频token的自回归交叉熵损失

L(θ)。 - 辅助损失:

L_lyric(歌词token的交叉熵损失),L_vocal(人声token的交叉熵损失),L_timbre(音色对齐的余弦相似度损失,公式4)。 - 总损失:

L = L(θ) + λ1L_lyric + λ2L_vocal + λ3*L_timbre。权重设置:λ1=1, λ2=1, λ3=4。

- 主损失:音频token的自回归交叉熵损失

- 训练策略:

- 优化器:AdamW。

- 学习率:

5e-5,使用线性调度器(Linear Scheduler)。 - 批次大小:8张NVIDIA H100 GPU,Stage 1每设备batch size=4,Stage 2每设备batch size=2。

- 训练轮次/步数:论文中未明确说明。

- 阶段转换:先进行Stage 1训练,完成后切换到Stage 2继续训练。

- 关键超参数:

- 模型大小:骨干LLM为0.5B参数的Qwen2。

- 音频编码:MuCodec,帧率25 Hz。

- 音色嵌入维度:CAM++输出192维,映射到LLM隐藏层。

- 训练硬件:8 NVIDIA H100 GPUs。

- 推理细节:论文未详细说明解码策略(如温度、beam search等),仅提到在EOS处停止,不生成辅助token。

- 正则化或稳定训练技巧:论文未提及,仅说明使用了线性学习率调度。

📊 实验结果

论文在0.5M歌曲数据集上进行训练和评估,与多个基线系统(包括工业系统Suno v4.5, Mureka O1和学术系统ACE-Step, LeVo, YuE, DiffRhythm v1.2)进行了对比。评估包括客观指标和主观MOS测试。

表1. 主要客观与美学评估指标对比

| 模型 | FAD↓ | SECS↑ | PER↓ | CLAP↑ | Audiobox Aesthetics ↑ | SongEval ↑ |

|---|---|---|---|---|---|---|

| CE | CU | |||||

| Suno v4.5 | 2.928 | 0.537 | 18.05 | 0.277 | 7.63 | 7.86 |

| Mureka O1 | 3.401 | 0.640 | 9.54 | 0.251 | 7.58 | 7.77 |

| ACE-Step | 4.650 | — | 35.75 | 0.273 | 7.14 | 7.46 |

| LeVo | 4.886 | 0.589 | 12.67 | 0.199 | 7.62 | 7.77 |

| YuE | 4.480 | 0.489 | 47.57 | 0.222 | 7.25 | 7.68 |

| DiffRhythm v1.2 | 3.181 | 0.442 | 11.31 | 0.232 | 7.58 | 7.79 |

| Ours (Stage1 + Stage2) | 3.926 | 0.584 | 25.11 | 0.270 | 7.66 | 8.00 |

| w/o Lyric | 4.233 | 0.567 | 29.50 | 0.246 | 7.49 | 7.91 |

| w/o Vocal | 4.440 | 0.544 | 27.22 | 0.235 | 7.60 | 7.98 |

| w/o Stage1 | 4.110 | 0.568 | 33.16 | 0.241 | 7.43 | 7.91 |

| w/o Stage2 | 5.124 | 0.581 | 20.53 | 0.261 | 7.43 | 7.70 |

注:加粗为最佳结果,下划线为次佳。 关键结论:

- 在音色相似性(SECS: 0.584)和文本控制(CLAP: 0.270)上,Melos达到了与最强工业/学术系统可比甚至更优的水平。

- 在内容享受度(CE)和内容有用度(CU)上超越了Suno v4.5。

- 但在音频保真度(FAD)和音素错误率(PER)上并非最佳,尤其PER较高(25.11),作者解释与ASR模型在歌唱识别上的困难有关。

- 在SongEval的多个维度(COH, MUS, MEM, CLA, NAT)上,Melos全面超越了开源基线,显示出段落级训练对音乐性的提升。

表2. 主观平均意见得分(MOS)

| 模型 | OQ↑ | TS↑ | LA↑ |

|---|---|---|---|

| Suno v4.5 | 4.04 ± 0.10 | 3.49 ± 0.11 | 4.26 ± 0.12 |

| Mureka O1 | 3.55 ± 0.08 | 3.31 ± 0.09 | 4.52 ± 0.08 |

| ACE-Step | 3.48 ± 0.10 | — | 4.09 ± 0.12 |

| LeVo | 3.53 ± 0.11 | 3.30 ± 0.11 | 4.44 ± 0.09 |

| YuE | 2.64 ± 0.10 | 2.61 ± 0.13 | 3.52 ± 0.13 |

| DiffRhythm v1.2 | 3.15 ± 0.09 | 2.61 ± 0.12 | 4.16 ± 0.11 |

| Melos (ours) | 3.54 ± 0.10 | 3.29 ± 0.10 | 4.21 ± 0.10 |

关键结论:Melos在整体质量(OQ)和音色相似度(TS)上与LeVo、Mureka表现相当,但在歌词准确性(LA)上略低于最优的Mureka和LeVo。

消融实验(见表1最后四行):

- 移除歌词(w/o Lyric)或人声(w/o Vocal)辅助目标,会导致SECS、PER等指标下降,证实了多任务学习的有效性。

- 仅进行段落级训练(w/o Stage1)会导致PER恶化(33.16)和美学指标下降,说明缺乏句子级基础训练。

- 仅进行句子级训练(w/o Stage2)会导致FAD大幅恶化(5.124)和音乐性(MUS)严重下降,说明缺乏段落级结构学习。

⚖️ 评分理由

- 学术质量:5.5/7:论文提出了清晰���“句子到段落”训练范式和创新的“后置辅助任务”多任务学习方法,技术方案合理且有设计巧思。实验全面,包含了多个先进基线对比、多维度评估指标和详尽的消融实验。主要不足在于创新属于策略层面的优化,而非底层模型架构的突破,且部分核心主观音乐性指标与顶尖工业系统仍有可见差距。

- 选题价值:1.5/2:歌曲生成是生成式AI在创意领域的重要应用,具有很高的前沿性和商业潜力。论文针对的数据效率和可控性问题具有普遍意义。但该任务相对于通用语音生成更为垂直。

- 开源与复现加成:-0.5/1:这是本篇论文最大的短板。尽管论文描述了训练细节,但未提供代码、预训练模型权重或训练数据集链接,极大地限制了研究的可复现性和社区的直接利用价值。仅提供了演示样本链接(https://thuhcsi.github.io/Melos/)。