📄 Lightweight and Perceptually-Guided Voice Conversion for Electro-Laryngeal Speech

#语音转换 #语音增强 #自监督学习 #低资源 #领域适应

✅ 7.5/10 | 前25% | #语音转换 | #自监督学习 | #语音增强 #低资源

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Benedikt Mayrhofer(格拉茨理工大学 信号处理与语音通信实验室;维也纳医科大学 综合人工智能医学中心)

- 通讯作者:未说明(论文提供了多位作者的邮箱,未明确指定通讯作者)

- 作者列表:Benedikt Mayrhofer(格拉茨理工大学 信号处理与语音通信实验室;维也纳医科大学 综合人工智能医学中心)、Franz Pernkopf(格拉茨理工大学 信号处理与语音通信实验室)、Philipp Aichinger(维也纳医科大学 耳鼻喉科,语音学与语言治疗科;维也纳医科大学 综合人工智能医学中心)、Martin Hagmüller(格拉茨理工大学 信号处理与语音通信实验室;维也纳医科大学 综合人工智能医学中心)

💡 毒舌点评

这篇论文的亮点在于精准的“临床需求驱动工程适配”,它没有空谈大模型,而是针对电子喉语音的具体缺陷(无F0、机械噪声),对现有流式架构StreamVC进行了务实而有效的“减法”改造(移除音高/能量模块)和“加法”增强(感知引导损失),实验设计严谨且消融分析充分。短板在于创新更多是“组合”与“调优”,缺乏一个能引发范式思考的核心算法突破,且模型在韵律生成和极端噪声下的可懂度方面仍有明显差距。

🔗 开源详情

- 代码:论文中提供了项目主页链接

https://spsc-tugraz.github.io/lw-elvc-icassp26/,其中可能包含代码。论文正文提到模型代码基于一个非官方StreamVC实现2(https://github.com/yuval-reshef/StreamVC),但未明确说明本文所有组件的代码是否完全开源。 - 模型权重:未提及是否公开预训练或微调后的模型权重。

- 数据集:使用了公开的德语语料(Common Voice, HUI, MLS)和公开的EL-HE平行数据库[20]。论文未提及自建新数据集。

- Demo:未提及在线演示。

- 复现材料:论文给出了详细的超参数设置(学习率、批大小、训练步数、优化器参数、模型大小等)、数据预处理流程(对齐、增强)和损失函数组合,复现信息较为充分。

- 论文中引用的开源项目:StreamVC非官方实现、mHuBERT-147、Whisper、FCPE音高估计器、FastSpeech2(未直接使用,但在相关工作提及)。

📌 核心摘要

这篇论文针对喉切除患者使用的电子喉(EL)语音存在音高单调、韵律缺失和机械噪声的问题,提出了一种轻量级且感知引导的语音转换(VC)方法。其核心方法是在现有的流式Voice Conversion架构StreamVC基础上进行针对性适配:1)移除了不适用于EL语音的音高(F0)和能量估计模块以简化模型;2)设计了一种利用Whisper编码器特征和DTW对EL-HE(健康语音)平行数据进行时间对齐的预处理流程;3)在训练中引入了包括WavLM感知损失、人类反馈(HF)损失、可懂度损失等多种感知引导损失函数。与已有方法相比,本文的新意在于为EL语音转换这一特殊场景提供了端到端的轻量级流式解决方案,并系统评估了不同感知损失组合的影响。实验结果表明,最佳模型配置(+WavLM+HF)将EL语音的字符错误率(CER)从88.2%大幅降低至41.9%,将自然度评分(nMOS)从1.1提升至3.3,显著缩小了与健康语音的差距。其实际意义在于为语音康复提供了一种低延迟、轻量化的潜在工具。主要局限性是韵律生成和极端条件下的可懂度仍是瓶颈。

🏗️ 模型架构

该模型架构(如图1所示)是对StreamVC的轻量级自适应改造,整体是一个全卷积、因果(支持流式处理)的编码器-解码器结构,用于执行从EL语音到HE语音的转换。

完整流程:输入EL语音波形,经过内容编码器提取语言内容特征(与说话人无关),同时通过说话人编码器提取目标HE说话人的声纹嵌入。内容特征与说话人嵌入通过FiLM条件层调制后,送入解码器重构出目标HE语音波形。整个模型在GAN框架下训练,包含一个判别器(遵循HiFi-GAN的MPD和MSD设计)。

主要组件:

- 内容编码器 (Content Encoder):由多个卷积块(Encoder-Block)堆叠而成,每个块包含两个Conv1D层。其核心任务是从EL语音中提取“内容单位”。与StreamVC不同,这里使用mHuBERT-147作为教师模型,通过k-means聚类生成离散单元,学生编码器通过预测这些单元来学习内容表示。这种自监督预训练有助于学习对噪声鲁棒的内容特征。

- 说话人编码器 (Speaker Encoder):结构与内容编码器类似,但末端连接了一个可学习池化层 (Learnable Pooling),将变长的语音特征序列聚合为一个固定维度的全局说话人嵌入向量。

- 解码器 (Decoder):由解码块(Decoder-Block)和残差单元(ResidualUnit)构成。其关键设计是采用了FiLM(Feature-wise Linear Modulation)条件层。说话人嵌入通过FiLM层对解码器中间层的特征进行逐特征的仿射变换(缩放和平移),从而将说话人特征“注入”到由内容编码器生成的内容特征中,指导解码器合成具有目标说话人音色的语音。

- 感知引导损失 (Guided Losses):虽然不是模型组件,但这是训练时的核心创新。它包括:

- 重建损失:Mel频谱重构损失。

- 对抗与特征匹配损失:来自GAN判别器的损失。

- 感知损失 (WavLM):在预训练的WavLM特征空间计算生成语音与真实HE语音的MSE,鼓励生成语义和声学上更真实的表示。

- 人类反馈损失 (HF):基于UTMOS分数(不包含PESQ)的负均值,直接优化模型输出的感知自然度。

- 可懂度损失 (BNF/WEO):分别在Conformer-CTC瓶颈特征和Whisper编码器特征空间计算MSE,引导模型生成更清晰、易于理解的语音。

- F0轮廓损失:预测并约束生成语音的基频轨迹。

关键设计选择及动机:移除StreamVC中的F0和能量模块是本文最重要的架构调整。原因在于EL语音本身缺乏自然的F0变化,保留这些模块不仅无益,还会增加模型复杂度。替换为多语言mHuBERT-147教师模型是为了更好地适配德语(及奥地利德语)数据。这些改动使模型更轻量(总参数约30M,大小123MB),更专注于解决EL语音转换的核心问题。

💡 核心创新点

- 面向EL语音的架构简化与适配:针对EL语音无F0变化的核心特性,主动移除StreamVC中负责音高和能量建模的模块。这不仅降低了模型复杂度,更避免了模型试图从EL语音中预测不存在的F0信息可能导致的错误。

- 基于Whisper特征的鲁棒时间对齐技术:EL与HE语音声学特性差异巨大,传统的基于Mel/MFCC的对齐方法效果不佳。本文提出先微调Whisper-small模型在EL-HE数据集上,利用其编码器输出(WEO)特征作为内容表征,再通过动态时间规整(DTW)和PSOLA时长调整,实现高质量的帧级对齐,为有监督微调提供可靠的平行训练对。

- 多目标感知引导损失组合:系统性地探索和比较了多种辅助损失(WavLM感知损失、HF自然度损失、BNF/WEO可懂度损失、F0损失)及其组合对转换性能的影响。发现“WavLM+HF”或“WEO+HF”是最佳组合,证明了在EL语音转换任务中,同时优化感知质量和可懂度至关重要。

🔬 细节详述

训练数据:

- 预训练数据:542小时的健康德语语音,来自Common Voice(v22.0, 精选前10%共192h)、HUI-Audio-Corpus-German(180h)和Multilingual LibriSpeech德语部分(170h)。对HUI和MLS数据限制了每说话人最多10小时以避免说话人不平衡。

- 微调与评估数据:奥地利-德语平行EL-HE数据库[20]。包含8个伪EL说话人、8个真实EL患者、8个健康说话人。每人约2.75小时EL和HE语音(共5.5h),按80%-10%-10%划分为训练、开发、验证集。通过Whisper对齐技术,将1对1的3,298个样本扩展至19,592个EL-HE组合对。

- 数据增强:在微调阶段,对30%的训练样本注入来自噪声数据库[30]的随机噪声,信噪比(SNR)在3到30 dB之间随机选择。

损失函数:

- 重建损失:Mel频谱重构损失。

- 对抗损失与特征匹配损失:用于GAN训练,稳定训练并提升频谱细节。

- 感知损失(WavLM):计算生成语音与真实HE语音在预训练WavLM模型中间层特征的MSE。

- 人类反馈损失(HF):计算生成语音的UTMOS分数(不含PESQ)的负均值,鼓励提升感知自然度。

- 可懂度损失(BNF):计算生成语音与真实HE语音在微调后的Conformer-CTC模型瓶颈特征(预softmax)的MSE。

- 可懂度损失(WEO):计算生成语音与真实HE语音在微调后的Whisper-small编码器特征的MSE。

- F0轮廓损失:使用快速上下文基音估计器(FCPE)预测F0轮廓,计算生成语音与真实HE语音的对数F0均方误差(MSE)。

- 权重:引导损失权重被调整以与重建损失匹配。特征匹配损失被额外加权以强调频谱细节。

训练策略:

- 预训练:两阶段。第一阶段(150k步)冻结解码器,训练内容编码器预测mHuBERT的k-means离散单元(交叉熵损失)。第二阶段(400k步)冻结编码器,训练解码器和说话人编码器,先使用Mel重建损失训练150k步,再加入对抗和特征匹配损失训练400k步。

- 微调:解码器、说话人编码器和内容编码器同时解冻进行训练。训练150-250k步。

- 优化器与学习率:均使用Adam优化器。

- 预训练:生成器lr=1.0e-4,判别器lr=2.0e-4,最小lr分别为2.5e-5和1.25e-5,β1=0.5, β2=0.9,余弦衰减调度。

- 微调:生成器lr=1.0e-4,判别器lr=1.25e-4,最小lr分别为2.5e-5和1.25e-5,β1=0.8, β2=0.99,余弦衰减调度。

- 批大小:16。

关键超参数:

- 模型总参数量:约30M(内容编码器18M,说话人编码器4M,解码器8M)。

- 模型文件大小:123MB。

- 预训练语音段长:48k样本(3秒 @16kHz)。

- 判别器语音段长:6400样本(400ms @16kHz)。

- k-means聚类单元数:100。

训练硬件:论文中未说明。

推理细节:模型为全因果卷积网络,设计支持低延迟实时流式处理。推理时,内容编码器提取EL语音内容,与任意目标说话人编码器的嵌入结合,由解码器合成语音。具体延迟未在本文中复测,但StreamVC报告在Pixel 7上为70.8ms。

📊 实验结果

论文在160句未修改的EL语音上进行了评估,并与健康语音真值(GT)、EL原声以及两个强基线模型(FreeVC, XVC)进行了对比。

客观评估结果(Table 1):

| 方法 | CER (%) ↓ (Whisper) | wvMOS ↑ | SIG ↑ | BAK ↑ | OVRL ↑ | SIM ↑ | Log-F0 RMSE ↓ |

|---|---|---|---|---|---|---|---|

| GT | 2.9 ±1.1 | 4.00 | 3.48 | 4.11 | 3.20 | 0.89 | - |

| EL | 88.2 ±51.2 | -0.28 | 3.14 | 3.12 | 2.41 | 0.55 | 0.62 |

| FreeVC | 140.3 ±30.2 | 3.52 | 3.27 | 3.99 | 2.91 | 0.71 | 0.40 |

| XVC | 61.2 ±8.3 | 3.59 | 3.32 | 4.02▲ | 3.00 | 0.63 | 0.37 |

| Ours: w/o guided loss | 53.7 ±6.0 | 3.17 | 3.29 | 3.88 | 2.90 | 0.86 | 0.35 |

| +WavLM | 40.9▼ ±1.8 | 3.26 | 3.32 | 3.93 | 2.94 | 0.84 | 0.34▼ |

| +WavLM+HF | 41.9▼ ±1.8 | 3.76 | 3.43▲ | 4.00▲ | 3.09▲ | 0.87 | 0.34▼ |

| +WavLM+HF+F0 | 46.7 ±3.9 | 3.70 | 3.42 | 3.97 | 3.06 | 0.87 | 0.35 |

| +WEO+HF | 44.9 ±1.7 | 3.69 | 3.39 | 4.02▲ | 3.05 | 0.86 | 0.34▼ |

| +WEO+WavLM+HF | 47.1 ±7.1 | 3.70 | 3.38 | 3.98 | 3.02 | 0.87 | 0.34▼ |

| +BNF+HF | 55.41 ±1.8 | 3.82▲ | 3.42 | 3.98 | 3.07 | 0.88▲ | 0.35 |

(▲/▼表示相比“w/o guided loss”有统计学显著性差异)

关键结论:

- +WavLM+HF 是最佳配置,在CER、wvMOS和DNSMOS的所有指标上均显著优于无引导损失基线和EL原声。

- 相比EL原声,最佳模型将CER从88.2%降至41.9%,wvMOS从-0.28升至3.76,说话人相似度(SIM)从0.55升至0.87。

- 该模型在所有指标上均超越了FreeVC和XVC基线,并且在多数指标上接近健康语音真值(GT)。

- 添加超过两个辅助损失(如+WavLM+HF+F0)通常无益甚至有害,表明损失之间可能存在冲突。

- BNF损失 虽然提升了wvMOS和SIM,但CER明显恶化(55.41%),表明其可能过于关注内容对齐,导致生成语音不自然或“含糊”。

主观评估结果(Table 2):

| 方法 | WER (%) ↓ | CER (%) ↓ | nMOS (1–5) ↑ | SIM (0–1) ↑ |

|---|---|---|---|---|

| EL | 49.4 ± 19 | 33.6 ± 16 | 1.1 ± 0.2 | — |

| +WavLM+HF | 36.4▼ ± 17 | 19.9 ± 10 | 3.3▲ ± 0.4 | 0.77▲ ± 0.09 |

| +WEO+HF | 36.4▼ ± 16 | 18.4▼ ± 9 | 3.1 ± 0.3 | 0.68 ± 0.09 |

| +BNF+HF | 68.4 ± 14 | 35.2 ± 11 | 3.0 ± 0.5 | 0.71 ± 0.07 |

关键结论:

- 主观听测验证了客观趋势:+WavLM+HF和+WEO+HF都显著提升了自然度(nMOS)和可懂度(降低WER/CER)。

- +WavLM+HF 获得了最高的自然度评分(3.3 vs. 1.1)和最高的说话人相似度(0.77)。

- +BNF+HF 虽然提升了nMOS和SIM,但可懂度(WER/CER)甚至比EL原声更差,证实了其副作用。

可视化分析:

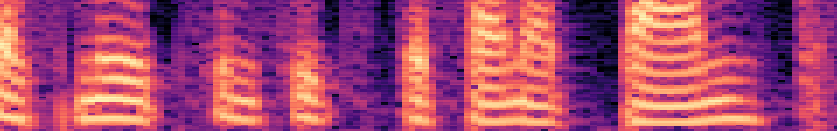

- 梅尔频谱对比(图4):清晰显示EL输入的恒定F0和谐波结构,而转换后语音(+WavLM+HF)成功去除了机械噪声,恢复了自然的谐波结构和共振峰,与健康语音真值高度相似。但句末的强音高变化被“压平”,提示韵律建模仍有改进空间。

(a) EL输入,(b) 健康语音真值 (GT),(c) 使用+WavLM+HF模型转换后的语音。

(a) EL输入,(b) 健康语音真值 (GT),(c) 使用+WavLM+HF模型转换后的语音。

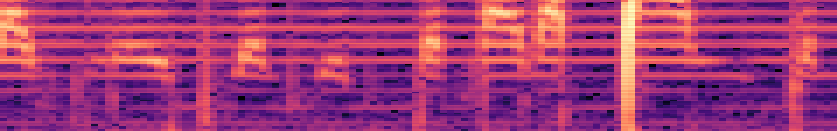

- 噪声鲁棒性(图5):在准平稳和非平稳噪声下,转换后语音的CER随SNR降低而上升。非平稳噪声(如警报声)影响更大。在SNR高于约5dB时,转换后的语音比原始EL语音可懂度更高;但在SNR低于5dB时,性能会恶化至低于未转换的EL语音。

在准平稳和非平稳噪声条件下,转换语音的CER随信噪比(SNR)变化曲线。红线表示无噪声的原始EL语音CER。

在准平稳和非平稳噪声条件下,转换语音的CER随信噪比(SNR)变化曲线。红线表示无噪声的原始EL语音CER。

⚖️ 评分理由

学术质量:5.5/7

- 创新性(3/3):创新是扎实的工程适配和系统性的损失函数研究,而非提出全新模型。在“StreamVC + EL语音适配 + 感知损失组合”这一具体组合上有明确贡献。

- 技术正确性(2.5/3):方法设计合理,针对EL语音特性做了有效简化,训练流程(两阶段预训练+微调)清晰,损失函数设计有据可依(引用FINALLY等)。

- 实验充分性与证据可信度(2/3):实验非常全面,包含多种损失组合的消融研究、与多个基线的对比、主客观评估、频谱分析和噪声鲁棒性测试。证据链完整,结果可信。扣分点在于未与更多、更专门的EL-VC基线直接对比(论文解释无公开基线),且最佳模型性能与GT仍有差距(尤其CER)。

选题价值:1.5/2

- 前沿性与潜在影响(0.8/1):将先进的流式语音转换技术应用于医疗康复(喉切除患者)是一个有价值且有社会意义的交叉方向。虽然不是最热门的大模型前沿,但属于重要且有实际需求的垂直应用。

- 实际应用空间与读者相关性(0.7/1):对于关注语音增强、语音转换、医疗AI的读者有直接参考价值。轻量化、流式的设计指向了未来在嵌入式设备上实现实时辅助的可能性,应用空间明确。

开源与复现加成:0.5/1

- 代码:提供了论文专属的GitHub仓库链接(

https://spsc-tugraz.github.io/lw-elvc-icassp26/)。 - 模型与数据:论文提供了数据集的详细引用信息,但未明确说明预训练模型和微调后权重的公开计划(仅从代码链接推测可能部分公开)。复现材料:训练细节(学习率、批大小、步数、损失权重等)、超参数(模型大小)在论文中描述得相当充分。主要扣分点:未提及具体的模型权重下载链接或开源仓库是否包含完整训练脚本和配置,存在一定的复现不确定性。

- 代码:提供了论文专属的GitHub仓库链接(