📄 LETPAV: Lexicon-Enhanced Text with Progressive Audio-Visual Fusion for Multimodal Sentiment Analysis

#多模态模型 #语音情感识别 #跨模态 #对比学习

✅ 7.5/10 | 前25% | #语音情感识别 | #多模态模型 | #跨模态 #对比学习

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Jiaxun Li(浙江大学)

- 通讯作者:Yuehai Wang(浙江大学)

- 作者列表:Jiaxun Li(浙江大学)、Yuanpeng Wang(未说明)、Wei Li(未说明)、Jiale Chen(未说明)、Yuehai Wang*(浙江大学)

💡 毒舌点评

这篇论文清晰地瞄准了多模态情感分析中“文本强势、音视频弱势”的经典痛点,提出的渐进式音视频融合策略思路直接且有效,消融实验也扎实地证明了每个模块的贡献。然而,其创新更多是现有模块(如词典增强、交叉注意力、对比学习损失)的巧妙组合与针对性调优,缺乏根本性的架构突破,且在处理更复杂的模态交互或缺失场景时未见讨论。

🔗 开源详情

- 代码:论文中提及“使用作者发布的官方代码在相同条件下复现”,表明代码已开源,但未在提供的文本中给出具体链接。

- 模型权重:未提及是否公开预训练模型权重。

- 数据集:使用CMU-MOSI和CMU-MOSEI公开数据集,未提及需额外获取。

- Demo:未提供在线演示。

- 复现材料:论文提供了详细的实验设置,包括优化器类型、各模块学习率、批大小、权重衰减、Dropout率、训练硬件(4x RTX 4090 D GPU),以及评估指标。但未说明总训练步数、调度策略等细节。

- 论文中引用的开源项目:使用了SenticNet词典、BERT预训练模型、FACET和COVAREP特征提取工具包。

📌 核心摘要

本文针对多模态情感分析(MSA)中不同模态(文本、音频、视觉)信息密度不平衡导致的融合难题,提出了一种名为LETPAV的轻量化框架。其核心方法是:1) 设计了一个词典增强与上下文门控的文本编码器(LECT),通过引入外部情感词典的极性先验和同义词扩展,并结合上下文门控机制,来增强文本特征的情感敏感度,使其作为语义锚点;2) 提出了渐进式音视频融合策略(PAVF),通过多层跨模态注意力逐步对齐并融合音频和视觉特征,形成一个紧凑的联合表征,再与增强文本进行通道注意力融合。训练时还引入了方向一致性损失和跨模态对齐损失以稳定模型。在CMU-MOSI和CMU-MOSEI两个主流基准数据集上的实验表明,LETPAV在多个指标上(如CMU-MOSI上MAE降至0.692,Corr提升至0.840)取得了优于或可比于当前最先进方法(SOTA)的成绩。该工作的实际意义在于为多模态融合中的信息不平衡问题提供了一种简单有效的解决方案,潜在可用于情感计算、人机交互等领域。其主要局限性可能在于未探索模型在更复杂场景(如模态缺失、长序列)下的鲁棒性,且词典的引入可能带来外部知识偏差。

🏗️ 模型架构

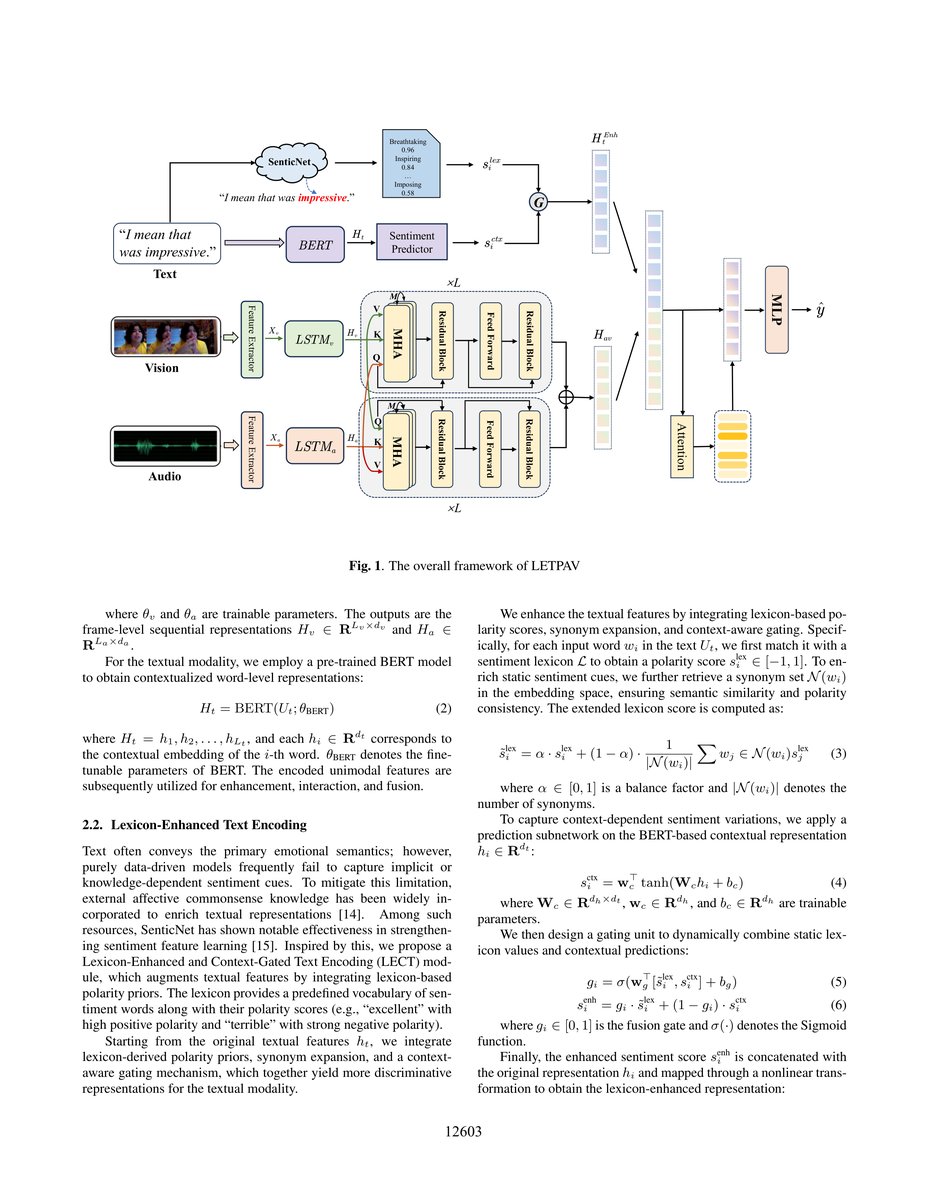

LETPAV模型的整体框架如图1所示,其处理流程和主要组件如下:

输入与特征提取:

- 输入为三元组

U = (Ut, Ua, Uv),分别代表文本、音频和视觉的原始输入。 - 视觉和音频:分别使用FACET和COVAREP工具包提取帧级特征

Xv和Xa,然后输入单向LSTM编码器,捕获时序依赖关系,得到序列表示Hv和Ha。 - 文本:使用预训练BERT模型对原始文本

Ut进行编码,得到上下文化的词级表示Ht。

- 输入为三元组

词典增强文本编码(LECT)模块:

- 目标:为文本特征注入更明确的情感极性信息。

- 流程:

a. 对每个词

wi,通过匹配情感词典L获得极性分数slex_i。 b. 在嵌入空间中检索同义词集N(wi),并计算扩展后的极性分数~slex_i(原始分数与同义词平均分数的加权混合)。 c. 设计一个预测子网络,基于BERT的上下文表示hi预测一个上下文相关的极性分数sctx_i。 d. 设计一个融合门gi,动态决定采用多少静态词典信息~slex_i和多少动态上下文信息sctx_i,生成增强的情感分数senh_i。 e. 将增强分数senh_i与原始BERT表示hi拼接,并通过非线性变换得到每个词的增强表示ˆhi。 f. 对所有词的增强表示进行平均池化,得到句子级别的增强文本表示HE_t。

渐进式音视频融合(PAVF)模块:

- 目标:先将音频和视觉特征对齐融合成一个高质量的联合表征,再与文本交互。

- 流程:

a. 设计

L层交叉注意力。每一层中,视觉特征Hv作为查询,音频特征Ha作为键和值,计算视觉对音频的注意力Yv;反之亦然,计算音频对视觉的注意力Ya。 b. 每一层的结果通过一个带残差连接和层归一化的前馈网络(FFN)进行更新,得到本层融合后的视觉和音频表示H(l)_v和H(l)_a。 c. 最终的音视频联合表示Hva是所有层特征的加权聚合,权重γl是通过一个小型网络根据各层平均特征计算得到的(并经过softmax归一化)。

特征级注意力融合:

- 目标:将增强的文本表示

HE_t和音视频联合表示Hva进行最终融合,并自适应加权。 - 流程:

a. 将两个模态的向量拼接成一个联合表示

z。 b. 通过一个两层感知机估计通道级别的注意力权重向量α。 c. 使用α对z进行逐元素乘法,得到通道细化的表示˜z。 d. 最终将˜z输入一个预测头(线性层)得到情感预测分数ŷ。

- 目标:将增强的文本表示

损失函数:模型总损失由三部分加权组成:

Ltask:情感回归的均方误差。Ldir:方向一致性损失,约束上下文预测分数sctx_i的方向与词典极性分数~slex_i保持一致。Lva-align:对比学习损失(NT-Xent),用于对齐音频和视觉的模态内表示。

图1展示了LETPAV的完整流程:输入经过各自的特征提取后,文本流通过LECT模块增强;视觉和音频流通过PAVF模块(包含多层交叉注意力和加权聚合)融合;增强的文本特征与音视频融合特征在最后通过通道注意力进行整合并预测。

图1展示了LETPAV的完整流程:输入经过各自的特征提取后,文本流通过LECT模块增强;视觉和音频流通过PAVF模块(包含多层交叉注意力和加权聚合)融合;增强的文本特征与音视频融合特征在最后通过通道注意力进行整合并预测。

💡 核心创新点

词典增强与上下文门控文本编码(LECT):

- 是什么:一个将静态情感词典知识与动态BERT上下文表示相融合的轻量化模块。

- 之前局限:现有基于知识增强的方法常将全局先验粗粒度注入,缺乏对每个词的细粒度控制,且可能引入噪声。

- 如何起作用:为每个词计算词典极性分数,并通过一个可学习的门控单元,根据当前上下文动态决定依赖词典知识还是上下文预测,实现了“细粒度、自适应”的情感特征增强。

- 收益:消融实验显示,去除LECT后,模型在回归指标(MAE, Corr)上下降明显,表明其有效提升了文本模态的情感表征能力。

渐进式音视频融合(PAVF):

- 是什么:一种先内部融合音频和视觉,再与文本交互的策略,使用多层跨模态注意力实现逐步对齐。

- 之前局限:直接将文本与原始音视频特征融合,容易因信息密度差异导致音视频特征被忽视或引入噪声。

- 如何起作用:通过

L层双向跨模态注意力,让音频和视觉特征在多层级上相互参考、对齐和增强,先形成一个高密度的“音视频联合语义”,再作为整体与文本锚点交互。 - 收益:消融实验表明,去除PAVF后,分类指标(Acc-2, F1, Acc-7)下降更显著,说明该策略有效利用了音视频的互补信息,提升了分类性能。

方向一致性损失与跨模态对齐损失:

- 是什么:两个辅助训练目标。

- 之前局限:主任务损失难以直接约束中间表示的语义一致性和模态对齐性。

- 如何起作用:

Ldir确保模型对有情感倾向的词的上下文预测与词典先验方向一致,稳定了极性判断;Lva-align通过对比学习拉近同一话语内音频和视觉表示的距离,增强了音视频的语义一致性。 - 收益:实验表明,同时移除这两个损失会导致性能大幅下降,验证了它们在稳定训练和增强模态协同方面的互补作用。

🔬 细节详述

- 训练数据:使用CMU-MOSI和CMU-MOSEI基准数据集。论文未提及具体数据预处理和数据增强细节。

- 损失函数:

Ltask(Eq. 19):均方误差损失,用于情感回归。Ldir(Eq. 20):方向一致性损失,仅对极性非零的词生效,当上下文预测分数与词典分数符号相反时产生惩罚。Lva-align(Eq. 21):NT-Xent对比损失,用于对齐同一样本内的音频和视觉表示。- 总损失

Ltotal(Eq. 22):三项加权和,权重λ1, λ2, λ3的具体数值未在正文提供。

- 训练策略:

- 优化器:Adam。

- 学习率:BERT参数为5e-5,其他参数为5e-3。

- 批大小:32。

- 权重衰减:BERT参数为1e-3,其他参数为1e-2。

- Dropout率:0.1。

- 训练轮数/步数:未说明。

- 调度策略:未说明(是否使用warmup等)。

- 关键超参数:

α:同义词扩展中的平衡因子(Eq. 3),具体值未说明。τ:对比损失中的温度因子(Eq. 21),具体值未说明。L:渐进式音���频融合的层数,具体值未说明。- 模型中各层隐藏维度(如

dh,d′):未说明。

- 训练硬件:四块NVIDIA RTX 4090 D GPU。

- 推理细节:未说明,可能直接输出回归分数

ŷ。 - 正则化技巧:使用了Dropout(0.1)和权重衰减。

📊 实验结果

论文在CMU-MOSI和CMU-MOSEI数据集上进行了全面的评估和对比。

表1:在CMU-MOSI和CMU-MOSEI数据集上的主要实验结果

| 模型 | CMU-MOSI | CMU-MOSEI | ||||||||

|---|---|---|---|---|---|---|---|---|---|---|

| MAE↓ | Corr↑ | Acc-2↑ | Acc-7↑ | F1↑ | MAE↓ | Corr↑ | Acc-2↑ | Acc-7↑ | F1↑ | |

| TFN | 0.901 | 0.698 | 80.23 | 46.18 | 80.04 | 0.706 | 0.690 | 82.06 | 50.01 | 81.84 |

| LMF | 0.892 | 0.708 | 81.12 | 46.42 | 80.87 | 0.683 | 0.701 | 82.49 | 49.88 | 82.30 |

| MFN | 0.874 | 0.719 | 81.39 | 47.21 | 81.24 | 0.635 | 0.712 | 82.91 | 50.43 | 82.69 |

| MISA | 0.803 | 0.752 | 82.54 | 47.80 | 82.39 | 0.568 | 0.752 | 84.18 | 51.17 | 83.98 |

| MulT | 0.858 | 0.704 | 81.97 | 46.91 | 82.01 | 0.586 | 0.694 | 83.07 | 50.22 | 82.88 |

| MVCL | 0.764 | 0.776 | 83.12 | 48.36 | 83.01 | 0.542 | 0.771 | 84.02 | 51.02 | 84.09 |

| Self-MM | 0.752 | 0.786 | 83.84 | 48.12 | 83.72 | 0.538 | 0.779 | 84.96 | 51.46 | 84.70 |

| SKE-MSA | 0.743 | 0.785 | 83.41 | 49.07 | 83.66 | 0.535 | 0.781 | 85.06 | 52.01 | 84.79 |

| SKEAFN | 0.731 | 0.801 | 84.27 | 48.93 | 84.19 | 0.527 | 0.792 | 85.28 | 52.14 | 85.06 |

| KuDA | 0.715 | 0.809 | 83.96 | 48.38 | 84.01 | 0.518 | 0.794 | 85.12 | 51.87 | 85.12 |

| ALMT | 0.707 | 0.818 | 84.55 | 49.21 | 84.37 | 0.517 | 0.802 | 85.53 | 52.29 | 85.42 |

| Ours | 0.692 | 0.840 | 85.55 | 50.47 | 85.72 | 0.510 | 0.820 | 85.88 | 52.56 | 85.93 |

关键结论:LETPAV在两个数据集的所有指标上均达到了最优(表中加粗所示)。与之前最强的基线ALMT相比,在CMU-MOSI上,MAE降低了约2.1%,相关系数Corr提升了约2.7%;在CMU-MOSEI上,MAE降低了约1.4%,二分类准确率(Acc-2)和F1值均有提升。

表2:在CMU-MOSEI数据集上的消融实验结果

| 方法 | MAE ↓ | Corr ↑ | Acc-2 ↑ | F1 ↑ | Acc-7 ↑ |

|---|---|---|---|---|---|

| w/o LECT | 0.536 | 0.801 | 84.72 | 84.55 | 51.38 |

| w/o PAVF | 0.542 | 0.796 | 84.10 | 83.97 | 50.82 |

| w/o Ldir | 0.528 | 0.809 | 85.10 | 85.02 | 51.93 |

| w/o Lva-align | 0.533 | 0.804 | 84.65 | 84.41 | 51.47 |

| w/o (Ldir & Lva-align) | 0.562 | 0.781 | 83.12 | 83.01 | 49.88 |

| Full Model | 0.510 | 0.820 | 85.88 | 85.93 | 52.56 |

关键结论:

- 移除LECT或PAVF都会导致性能下降,但影响侧重点不同:LECT移除主要影响回归指标(MAE, Corr),PAVF移除主要影响分类指标(Acc-2, F1, Acc-7)。

- 移除任何一个辅助损失(

Ldir或Lva-align)都会造成性能下降,而同时移除两者则导致最显著的性能退化,证实了它们的互补性和必要性。 - 完整模型在所有指标上达到最优。

⚖️ 评分理由

- 学术质量:6.0/7 - 论文针对一个明确的、公认的技术痛点(模态信息不平衡)进行研究,提出的LECT和PAVF模块设计合理、针对性强,技术实现正确。实验部分在两个标准benchmark上与大量基线进行了公平对比(使用官方代码复现),并提供了详尽的消融研究,数据支撑充分。主要扣分点在于创新性属于对现有模块(词典、注意力、对比学习)的整合与优化,而非根本性的新架构或新范式;论文未深入探讨模型的局限性和适用边界。

- 选题价值:1.5/2 - 多模态情感分析是自然语言处理与信号处理交叉领域的热点,其技术进步对人机交互、心理健康监测、内容审核等应用有直接价值。论文聚焦的“信息不平衡”问题具有普遍性。然而,该领域论文众多,本文的贡献虽扎实但属渐进式改进,其影响力更多体现在特定任务性能的提升上,而非开辟新方向。

- 开源与复现加成:0.5/1 - 论文明确指出结果是基于“官方代码”复现的,表明代码开源或已公开,这是重大利好。同时,论文详细列出了训练超参数(优化器、学习率、批大小、权重衰减、Dropout率)和硬件环境,为复现提供了良好基础。扣0.5分是因为在提供的文本中未给出具体的代码仓库链接(可能需在IEEE Xplore全文中查找),且未提供预训练模型权重。