📄 Learning What to Hear: Boosting Sound-Source Association for Robust Audiovisual Instance Segmentation

#音视频实例分割 #查询学习 #多模态模型 #注意力机制 #损失函数设计

✅ 7.5/10 | 前25% | #音视频实例分割 | #查询学习 | #多模态模型 #注意力机制

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Jinbae Seo(Yonsei University)

- 通讯作者:Jiyoung Lee(School of AI and Software, Ewha Womans University),Kwanghoon Sohn(Yonsei University, Korea Institute of Science and Technology (KIST))

- 作者列表:Jinbae Seo(Yonsei University)、Hyeongjun Kwon(Yonsei University)、Kwonyoung Kim(Yonsei University)、Jiyoung Lee(Ewha Womans University)、Kwanghoon Sohn(Yonsei University & KIST)

💡 毒舌点评

这篇论文精准地指出了现有音视频实例分割(AVIS)方法中“视觉偏见”的核心痛点(均匀加法融合和纯视觉训练目标),并用两个直观且有效的模块(交叉注意力的查询生成与序数回归的计数监督)予以解决,实验增益明确。然而,其创新性相对局部,本质上是AVISM框架的“插件式”改进,且最大性能提升(Swin-L骨干)仍依赖于更强的预训练视觉模型,未能完全摆脱对视觉主导性的依赖。

🔗 开源详情

- 代码:提供代码仓库链接:https://github.com/jinbae-s/ACVIS。

- 模型权重:论文中未提及是否公开预训练模型权重。

- 数据集:使用AVISeg基准数据集,论文中未提及该数据集是否为公开数据集或如何获取。

- Demo:论文中未提供在线演示链接。

- 复现材料:论文提供了部分训练细节(如分辨率、查询数量、窗口大小、损失权重),但缺少关键的超参数(学习率、优化器、批量大小、训练轮数、

λ_SAOC)和完整的配置文件。 - 论文中引用的开源项目:论文引用的开源工具/模型包括:

- 基线模型:AVISM [1]

- 视觉骨干:ResNet-50 [18], Swin Transformer [22]

- 音频骨干:VGGish [19]

- 匈牙利匹配算法 [15]

- 预训练数据集:ImageNet [20], COCO [21]

- 段匹配与目标检测框架:DETR [12], Mask2Former [13]

- 序数回归参考方法 [14]

📌 核心摘要

- 问题:现有音视频实例分割方法存在“视觉偏见”,因为音频特征被均匀地加到所有查询上,导致查询无法特化于不同声源;同时,纯视觉的监督目标(掩码和分类损失)会使查询收敛于任意显著视觉对象,而非发声对象。

- 方法核心:提出音视频实例分割框架ACVIS,包含两个关键组件:(1)音频中心查询生成器:用交叉注意力替代简单的加法融合,使每个查询能选择性关注音频信号中的不同模式,生成带有声源特异性先验的查询;(2)声音感知序数计数损失:通过一个可学习的计数令牌,以序数回归的方式显式监督模型预测发声对象的数量,强制单调一致性,防止训练过程中退化为仅依赖视觉信息。

- 创新点:相较于基线方法AVISM,ACVIS用音频条件化的查询生成取代均匀融合,并引入了额外的、显式的音频中心约束(计数监督),以更好地保持音视频平衡。

- 实验结果:在AVISeg基准测试上,使用ResNet-50骨干和IN+COCO预训练时,相比基线AVISM,ACVIS在mAP上提升1.64(45.04→46.68),HOTA上提升0.60(64.52→65.12),FSLA上提升2.06(44.42→46.48)。消融实验证明音频中心查询生成器和SAOC损失是互补的,且SAOC损失优于标准交叉熵损失。在多发声源帧(FSLAm)上提升尤为显著(+3.82)。

- 实际意义:提升了模型在复杂、多声源场景(如拥挤房间、乐器合奏)中准确分割和跟踪发声对象的能力,减少了掩码粘连和身份互换。

- 主要局限性:论文未深入探讨当发声对象数量超过预设的最大计数(K_max)或静默对象数量极大时的性能边界;其改进高度依赖于基线框架AVISM,且最强性能依赖于更强大的视觉骨干(如Swin-L)。

🏗️ 模型架构

论文以AVISM [1] 为基线架构,ACVIS提出了针对性改进。整体架构为两阶段:音频中心物体定位器 和 物体跟踪器。

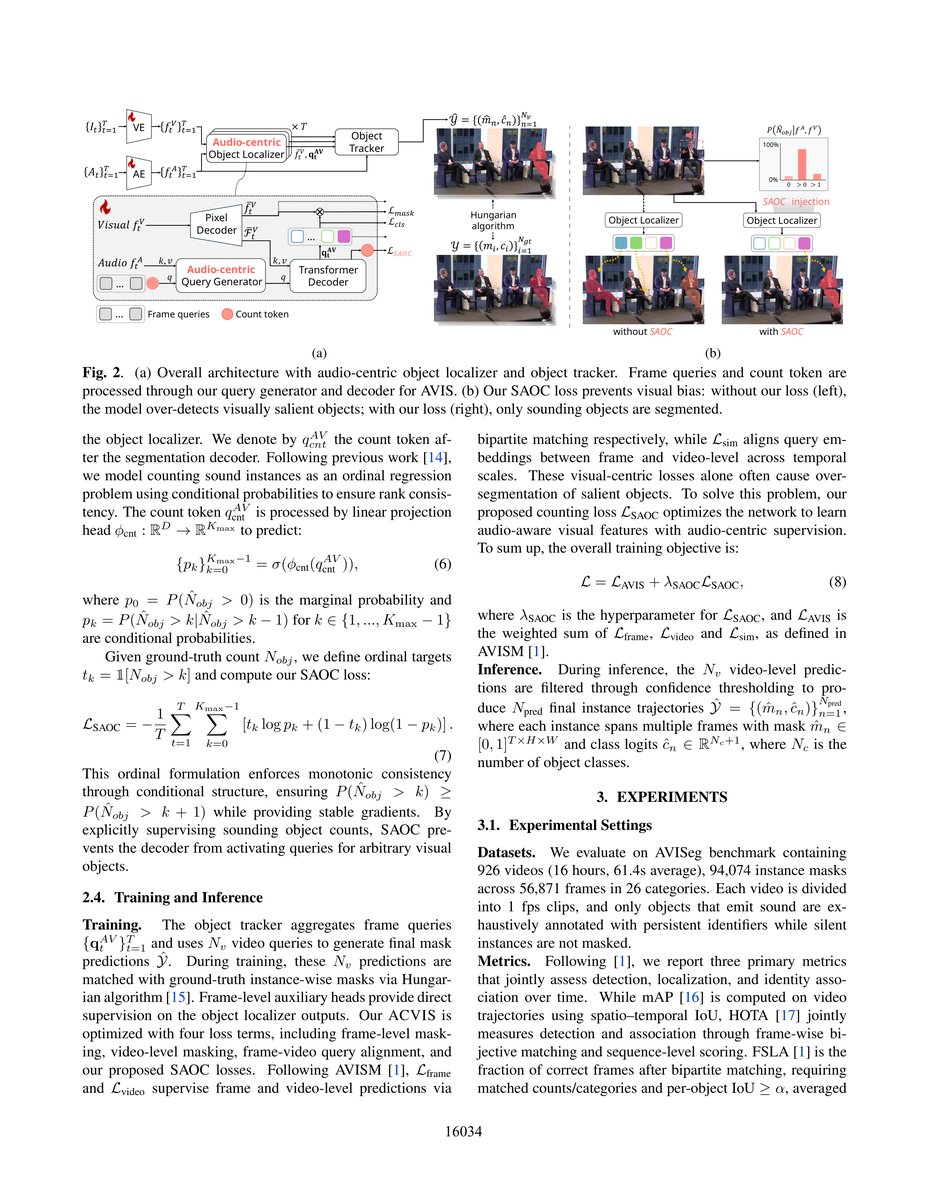

- 整体架构图 (a):清晰展示了数据流。

- 输入:视频帧和对应的音频片段。

- 编码器:视觉编码器(如ResNet-50)提取视觉特征

f_V_t,音频编码器(如VGGish)提取音频特征f_A_t。 - 像素解码器:处理视觉特征,生成增强的多尺度视觉特征

F_V_t。 - 音频中心查询生成器:这是核心改进之一。它接收可学习的帧查询

q_t和音频特征f_A_t。内部由三层交叉注意力构成,其中q_t作为Query,f_A_t同时作为Key和Value。这使得每个查询q_t能够选择性地关注音频信号中的不同模式,输出音频中心帧查询q_A_t。 - 分割解码器:处理

q_A_t和多尺度视觉特征F_V_t,通过交叉注意力生成视听帧查询q_AV_t。同时,一个可学习的计数令牌q_cnt与帧查询一起输入解码器,并经过单独的线性投影头预测发声对象数量的条件概率分布。 - 物体跟踪器:聚合所有帧的视听帧查询

{q_AV_t},通过匈牙利匹配算法与视频级查询关联,生成最终的实例掩码和类别预测。

- SAOC损失作用示意图 (b):展示了没有SAOC损失时,模型会过度分割视觉显著对象(如图中左侧的两人);加入SAOC损失后,模型能正确只分割出发声对象(右侧单人)。

💡 核心创新点

音频中心查询生成器:

- 之前局限:基线AVISM使用简单加法(

q_A_t = q + 1/N_f ⊗ f_A_t),将同一音频特征均匀地加到所有查询上,导致所有查询共享相同的音频表示,无法区分不同声源。 - 如何起作用:使用交叉注意力机制,使每个可学习的查询能独立地、有选择地关注音频特征中的不同部分(如不同说话人的语音特征、不同乐器的频谱模式)。

- 收益:生成了“特化”的查询,每个查询都携带特定声源的先验信息,为后续视觉解码提供了更精准的音频引导。

- 之前局限:基线AVISM使用简单加法(

声音感知序数计数损失:

- 之前局限:纯视觉的掩码和分类损失无法保证查询会收敛到发声对象,可能导致模型分割任何视觉显著目标。

- 如何起作用:引入一个可学习的计数令牌,聚合关于场景中发声对象数量的信息。将其预测建模为序数回归问题,输出条件概率

pk = P(N_obj > k | N_obj > k-1)。通过计算与真实计数的二元交叉熵损失(SAOC损失),显式地监督模型预测正确的发声对象数量。 - 收益:提供了关键的音频中心约束,防止模型忽略音频信息而退化。序数回归的单调性假设(

P(N_obj > k) ≥ P(N_obj > k+1))带来了更稳定的梯度和更好的排序性能。

互补的框架设计与验证:

- 之前局限:单独改进查询融合或单独引入计数监督可能效果有限。

- 如何起作用:ACVIS将音频中心查询生成与显式计数监督紧密结合。前者让查询“能听清”,后者告诉模型“该听到几个声音源”。消融实验(表3)证明两者结合带来最大性能提升。

- 收益:在多发声源场景下表现显著提升(FSLAm +3.82),验证了该组合的有效性。

🔬 细节详述

- 训练数据:使用AVISeg基准数据集。包含926个视频(约16小时,平均每段61.4秒),56,871帧,94,074个实例掩码,覆盖26个类别。视频被划分为1fps的片段,仅对发声物体进行穷举标注,并带有持久标识符。

- 损失函数:

- L_frame & L_video:基线AVISM定义的帧级和视频级匹配损失(通过匈牙利匹配计算)。

- L_sim:对齐帧级和视频级查询嵌入的相似性损失。

- L_SAOC:本文提出的声音感知序数计数损失。公式为

L_SAOC = -1/T Σ_t Σ_{k=0}^{K_max-1} [tk log pk + (1-tk) log(1-pk)],其中tk = 1[N_obj > k]是序数目标,pk是由计数令牌预测的条件概率。 总损失:L = LAVIS + λ_SAOC L_SAOC,其中LAVIS是L_frame、L_video、L_sim的加权和,权重分别为1.0,1.0,0.5(L_sim权重为0.5)。λ_SAOC是SAOC损失的权重超参数(论文中未给出具体值)。

- 训练策略:

- 优化器/学习率/调度:论文中未说明。

- Batch Size:论文中未说明。

- 训练时长/轮数:论文中未说明。

- 其他细节:遵循AVISM协议。帧查询数量

N_f=100,视频查询数量N_v=100,跟踪器窗口大小W=6。

- 关键超参数:

- 最大计数上限

K_max:消融实验(表5)表明K_max=2效果最佳,这与数据集典型的发声对象数量分布一致。

- 最大计数上限

- 训练硬件:论文中未说明。

- 推理细节:推理时,对

N_v个视频级预测进行置信度阈值筛选,得到最终的实例轨迹。论文未提及具体的阈值设置。 - 数据增强:训练时将图像短边调整为360像素,推理时调整为448像素,保持宽高比。未提及其他增强。

📊 实验结果

论文在AVISeg基准上进行了评估。

主要性能对比 (表1)

| 方法 | mAP | HOTA | FSLA | FSLAn (静默帧) | FSLAs (单声源帧) | FSLAm (多声源帧) |

|---|---|---|---|---|---|---|

| AVISM [1] (基线) | 45.04 | 64.52 | 44.42 | 20.62 | 32.62 | 54.99 |

| ACVIS | 46.68 | 65.12 | 46.48 | 10.74 | 34.45 | 58.81 |

- 结论:ACVIS在整体检测和跟踪指标(mAP, HOTA)上均优于基线。值得注意的是,FSLA指标提升显著(+2.06),其中在多发声源帧(FSLAm)上提升最大(+3.82),表明ACVIS在复杂声源场景下优势明显。然而,在静默帧(FSLAn)上性能下降,这可能是因为ACVIS更专注于发声对象,对静默物体的分割能力减弱。

骨干网络与预训练数据集的影响 (表2)

| Backbone | Pre-trained dataset | mAP | HOTA | FSLA |

|---|---|---|---|---|

| ResNet-50 | IN | 42.14 | 62.09 | 42.87 |

| ResNet-50 | IN+COCO | 46.68 | 65.12 | 46.48 |

| Swin-L | IN+COCO | 54.16 | 72.96 | 54.17 |

- 结论:使用更强的视觉骨干(Swin-L)和在更大规模数据集(COCO)上预训练能大幅提升性能,说明视觉特征质量对该任务至关重要。

消融实验:核心组件贡献 (表3)

| ACQG | L_SAOC | mAP | HOTA | FSLA |

|---|---|---|---|---|

| 45.04 (基线) | 64.52 | 44.42 | ||

| ✓ | 45.17 | 63.27 | 45.45 | |

| ✓ | 45.13 | 64.98 | 45.30 | |

| ✓ | ✓ | 46.68 | 65.12 | 46.48 |

- 结论:单独使用音频中心查询生成器(ACQG)或SAOC损失都能带来一定提升(尤其在HOTA和FSLA上),但二者结合时所有指标达到最佳,证明了设计的互补性。

消融实验:损失函数对比 (表4)

| Loss type | mAP | HOTA | FSLA |

|---|---|---|---|

| L_CE (标准交叉熵) | 44.45 | 63.95 | 44.00 |

| L_SAOC | 46.68 | 65.12 | 46.48 |

- 结论:使用SAOC损失替代标准交叉熵损失在所有指标上均有显著提升,验证了序数回归公式在监督计数任务上的优越性。

消融实验:K_max敏感性 (表5)

| K_max | mAP | HOTA | FSLA |

|---|---|---|---|

| 2 | 46.68 | 65.12 | 46.48 |

| 3 | 45.23 | 64.67 | 44.90 |

| 4 | 44.94 | 64.01 | 44.06 |

- 结论:

K_max=2性能最佳,更大的值会导致性能下降。这符合数据集中发声对象数量通常较少(1或2个)的特点。

定性结果

- 图3说明:展示了在不同音频场景下的定性比较。左列为基线AVISM的结果,右列为ACVIS的结果。可以观察到,在多人场景(如第一行)中,AVISM错误地分割了两个静默的人,而ACVIS正确地只分割出那个发声(说话)的人。在多声源场景(如第二行的吉他和单簧管)中,ACVIS能更好地分离和跟踪不同的发声对象,掩码粘连和身份互换现象减少。

⚖️ 评分理由

- 学术质量:5.5/7。论文清晰定义并解决了音视频实例分割中的具体技术问题(视觉偏见),提出的两个技术组件(交叉注意力查询、序数计数损失)逻辑自洽,并通过充分的消融实验证明了其有效性。实验设计合理,指标全面,结果具有说服力。扣分点在于:创新属于对现有框架的针对性改进,而非开辟新范式;论文对模型在更复杂声源场景(>2个声源)下的潜在局限性讨论不足;部分训练细节(如优化器、学习率)未公开,影响完全复现。

- 选题价值:1.5/2。音视频实例分割是多模态感知中的前沿和重要任务,对机器人交互、视频理解等应用有潜在价值。本文聚焦于该任务中的一个具体痛点并取得进展,具有较好的研究意义和针对性。扣分点在于该任务相对小众,受众和直接工业应用场景的广度目前有限。

- 开源与复现加成:0.5/1。论文明确提供了代码仓库链接(https://github.com/jinbae-s/ACVIS),这是一个重要的复现资源。然而,论文中未提及是否公开预训练模型权重,也未提供详细的超参数配置或训练脚本说明,这降低了即刻复现的便利性。因此给予部分加成。