📄 LAMB: LLM-Based Audio Captioning with Modality Gap Bridging Via Cauchy-Schwarz Divergence

#音频描述 #跨模态对齐 #大语言模型 #音频场景理解

✅ 7.0/10 | 前25% | #音频描述 | #跨模态对齐 | #大语言模型 #音频场景理解

学术质量 5.0/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 中

👥 作者与机构

请基于当前提供的论文内容尽量完整提取作者与机构信息,要求:

- 明确标注第一作者(如论文可判断),否则写“未说明”

- 明确标注通讯作者(如论文可判断),否则写“未说明”

- 列出能确认的作者姓名及其所属机构(大学、实验室、公司)

- 机构信息尽量具体到实验室或部门;如果文本里没有,就写到能确认的层级

- 禁止猜测机构信息;无法确认时明确写“未说明”

输出格式示例:

第一作者:张三(清华大学计算机系)

通讯作者:李四(Google DeepMind)

作者列表:张三(清华大学计算机系)、李四(Google DeepMind)、王五(未说明)

第一作者:Hyeongkeun Lee(韩国科学技术院, KAIST)

通讯作者:未说明

作者列表:Hyeongkeun Lee(韩国科学技术院, KAIST), Jongmin Choi(韩国科学技术院, KAIST), KiHyun Nam(韩国科学技术院, KAIST), Joon Son Chung(韩国科学技术院, KAIST)

💡 毒舌点评

这篇论文在技术上做得扎实,首次将柯西-散度引入音频-文本对齐并取得了SOTA,证明了其有效性。但整体框架更像是现有“音频编码器+LLM解码器”范式的一个精细化升级,而非颠覆性创新,且主要验证集中在AudioCaps一个数据集上,泛化性的说服力略显不足。

🔗 开源详情

- 代码:是。论文在摘要和结论部分均提供了代码仓库链接:https://github.com/Hyeongkeun/LAMB。

- 模型权重:未提及。

- 数据集:使用了公开数据集(AudioCaps, Clotho, WavCaps),论文中说明了数据获取来源(如链接),但未提及是否有额外处理过的版本发布。

- Demo:未提及。

- 复现材料:提供了基本的实现细节,如音频编码器、LLM型号、LoRA、查询数量、优化器、学习率、批大小、训练轮数等,但未提供详细的训练脚本、配置文件或检查点。

- 论文中引用的开源项目:音频编码器采用“Consistent Ensemble Distillation”模型;文本解码器采用LLaMA 2;使用LoRA进行微调;使用InfoNCE损失和UMAP进行可视化。

📌 核心摘要

这篇论文旨在解决基于大语言模型的自动音频描述(AAC)任务中存在的模态差距问题,即音频特征被简单投影到LLM嵌入空间后,与文本嵌入空间对齐不佳,限制了LLM的推理能力。方法核心是提出LAMB框架,其创新之处在于首次将柯西-散度引入AAC任务,设计了一个跨模态对齐器(Cross-Modal Aligner)来最小化音频与文本分布的距离,同时最大化互信息。此外,通过双流适配器(Two-Stream Adapter)提取更丰富的语义和时序音频特征,并利用令牌引导(Token Guide)在LLM词表空间内直接引导解码。在AudioCaps数据集上,LAMB在CIDEr、SPIDEr等指标上取得了显著提升(如CIDEr从SOTA的84.1提升到91.1),达到了新的技术水平。其实际意义在于证明了显式跨模态对齐对于释放LLM在音频理解任务中潜力的关键作用。主要局限性在于,尽���在AudioCaps上表现突出,但在更复杂、标注更多样的Clotho数据集上,性能提升相对有限,且其泛化性在其他音频任务上尚未得到验证。

🏗️ 模型架构

LAMB的整体架构是一个端到端的系统,由音频编码器、双流适配器、跨模态对齐器和基于LLM的解码器四个核心部分组成。

图1 展示了LAMB的总体架构。输入音频经过音频编码器(Consistent Ensemble Distillation)提取原始嵌入

图1 展示了LAMB的总体架构。输入音频经过音频编码器(Consistent Ensemble Distillation)提取原始嵌入ha,然后通过双流适配器(Two-Stream Adapter) 进行处理。双流适配器包含两个并行的分支:语义模块 使用可学习查询Qs通过多头自注意力从ha中提取语义特征ˆhs;时序模块 则使用卷积、双向GRU和可学习查询Qt从ha中提取时序依赖特征ˆht。两个模块的输出被拼接,再由一组全局查询Qg通过交叉注意力进行融合,并投影到LLM的文本嵌入维度,得到对齐后的音频嵌入za。

跨模态对齐器(Cross-Modal Aligner) 在训练阶段生效,利用za和文本标题的嵌入zt来计算损失。它包含全局级和令牌级的柯西-散度损失以及InfoNCE损失,旨在拉近音频和文本的分布距离。在推理阶段,za与指令提示嵌入zp拼接后,送入LLM解码器(LLaMA 2, 使用LoRA微调)生成文本。生成的每个令牌的logits还会被令牌引导(Token Guide) 模块修正,该模块计算za与LLM词表中所有令牌嵌入的L2距离(Guide Scores),并将其作为偏置项加到原始logits上,从而在解码过程中引导模型选择与音频语义更相关的词汇。

💡 核心创新点

- 首次将柯西-散度引入音频-文本对齐:这是论文最核心的创新。之前的方法(如线性投影、Q-Former)缺乏明确的对齐目标。柯西-散度是一个对称且稳健的分布距离度量,结合InfoNCE损失,能够同时在全局分布和令牌级别上实现更紧密的跨模态对齐(如Tab. 2所示,CMA使L2距离从111.8降至10.9,余弦相似度从0.04升至0.58)。

- 双流适配器增强音频表示:设计了一个专门模块来从原始音频嵌入中同时提取语义(通过注意力查询)和时序(通过CNN-GRU-注意力)两方面信息。这确保了输入到对齐器的音频特征

za是高质量、信息丰富的,而不是简单的线性变换结果,为实现有效对齐奠定了基础。 - 令牌引导解码:提出了一种新颖的、无需外部模块的解码引导机制。它直接利用LLM自身的词表嵌入空间,通过计算对齐后音频嵌入与所有词嵌入的距离,为每个解码步骤生成一个偏置(Guide Scores),从而“导航”LLM生成更准确的文本。消融实验(Tab. 3)证明,使用L2距离的Guide Scores能带来显著性能提升。

- 系统性的框架设计:LAMB并非单一技巧的堆砌,而是将上述组件有机整合,形成了一个从特征提取、跨模态对齐到生成引导的完整流程。实验证明各组件互补,共同贡献于最终性能(Tab. 4)。

🔬 细节详述

- 训练数据:预训练阶段使用AudioCaps、Clotho和WavCaps三个数据集的组合。微调阶段分别在AudioCaps(48, 595训练样本, 10秒)和Clotho(3, 839开发集, 15-30秒)上进行。WavCaps数据集规模最大,包含约40万片段,来源多样。论文未提及具体的数据预处理或增强细节。

- 损失函数:最终损失为多任务加权和:

L_total = λ1L_cma + λ2L_tg + λ3L_dec。其中L_cma包含三项:α1L_CS-global(全局分布对齐)、α2L_CS-token(令牌级对齐)和α3L_InfoNCE(互信息最大化)。L_tg是基于引导后logits的交叉熵损失。L_dec是基于原始logits的交叉熵损失。论文未明确给出α和λ的具体权重值。 - 训练策略:使用AdamW优化器(weight decay=1e-6)。预训练学习率为5e-5,批大小32;微调学习率为3e-6,批大小8。采用余弦退火学习率调度,训练30个epoch,其中前2个epoch为warmup。未提及具体训练硬件和时长。

- 关键超参数:音频编码器为Consistent Ensemble Distillation模型,文本解码器为LLaMA 2(7B参数),使用LoRA进行参数高效微调。适配器中的查询数量设置为:语义模块

Ns=8,时序模块Nt=8,融合层Ng=32。引导强度系数β是可学习的。柯西-散度计算中使用了高斯核,其宽度σ未说明具体值。 - 推理细节:论文未明确说明解码策略(如beam search的束宽)、温度等参数。核心推理流程是:音频嵌入与提示嵌入拼接后送入LLM进行自回归生成,并在每一步用Guide Scores修正logits。

📊 实验结果

论文在AudioCaps和Clotho两个主要基准上进行了评估。

主要结果对比(表1:AAC结果)

| 模型 | 预训练数据集 | AudioCaps MT | AudioCaps CD | AudioCaps SC | AudioCaps SD | AudioCaps SF | AudioCaps FS | Clotho MT | Clotho CD | Clotho SC | Clotho SD | Clotho SF | Clotho FS |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| SLAM-AAC [7] | AC+CLP+WC+MA | 26.8 | 84.1 | 19.4 | 51.8 | 51.5 | 66.8 | 19.7 | 51.5 | 14.8 | 33.2 | 33.0 | 54.0 |

| LAMB (Ours) | AC+CL+WC | 27.1 | 91.1 | 19.7 | 55.4 | 55.3 | 67.7 | 19.8 | 52.3 | 14.7 | 33.4 | 33.1 | 53.4 |

在AudioCaps上,LAMB在所有指标上全面超越之前的SOTA(SLAM-AAC),尤其在CIDEr(91.1 vs 84.1)和SPIDEr(55.4 vs 51.8)上提升显著。在Clotho上,LAMB在多数指标上也达到或略微超过SOTA。

消融实验

- 对齐方法消融(表2):与Q-Former和线性层相比,跨模态对齐器(CMA)在所有指标上大幅领先,证明了其有效性。

- 引导度量消融(表3):在令牌引导中,使用L2距离(平方)作为Guide Scores的效果最佳(SD: 55.4),优于L1距离和余弦相似度。

- 组件消融(表4):移除任何模块(双流适配器TSA、CS散度损失、跨模态对齐器CMA整体、令牌引导TG)都会导致性能下降,其中移除CMA或TG的下降尤为明显,证实了各组件的贡献。

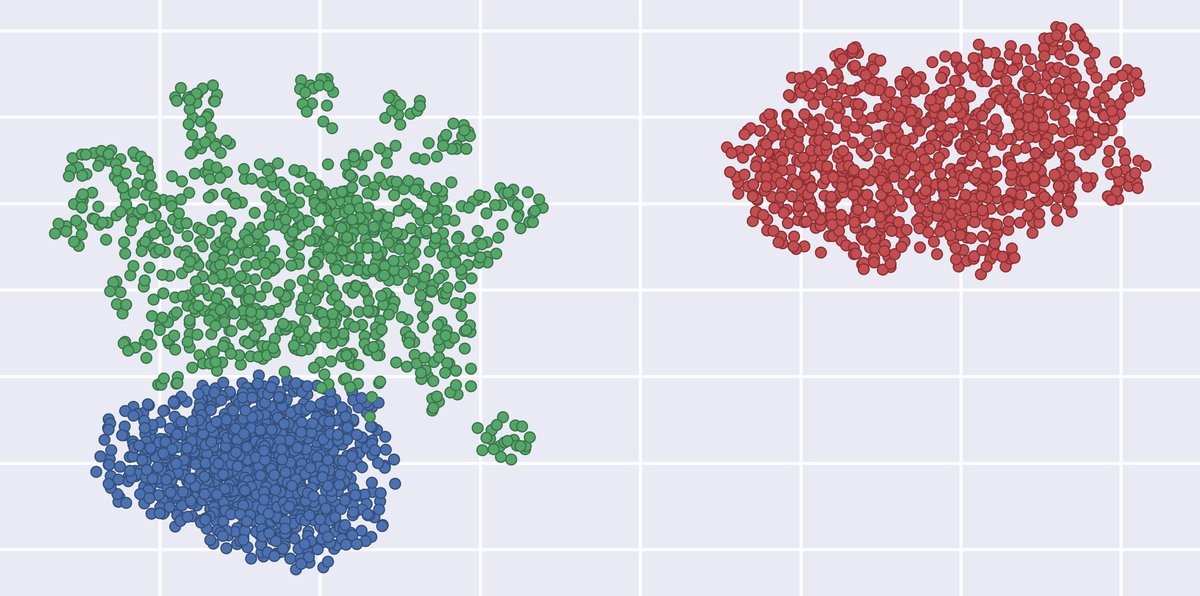

图2 展示了使用跨模态对齐器(CMA)前后,音频嵌入与文本嵌入在二维空间的分布情况。可以清晰地看到,应用CMA后(蓝色点簇),音频嵌入与文本嵌入(绿色点簇)的分布从几乎完全分离变得紧密重合,直观验证了对齐效果。

图2 展示了使用跨模态对齐器(CMA)前后,音频嵌入与文本嵌入在二维空间的分布情况。可以清晰地看到,应用CMA后(蓝色点簇),音频嵌入与文本嵌入(绿色点簇)的分布从几乎完全分离变得紧密重合,直观验证了对齐效果。

图3和图4(应为表5的对应可视化)展示了使用与不使用令牌引导(TG)生成的描述对比。使用TG后,模型能捕捉到更细微的声音线索(如“hard surface”, “a group of people talk in the background”),生成的描述在细节和准确性上均有所提升。

图3和图4(应为表5的对应可视化)展示了使用与不使用令牌引导(TG)生成的描述对比。使用TG后,模型能捕捉到更细微的声音线索(如“hard surface”, “a group of people talk in the background”),生成的描述在细节和准确性上均有所提升。

⚖️ 评分理由

- 学术质量:5.0/7 - 论文在现有“��码器-解码器”框架内进行了扎实且有道理的改进。核心创新(CS散度对齐、令牌引导)设计合理,实验充分(包括主实验和全面的消融),数据支撑有力。但创新程度属于渐进式改进,未提出全新的范式。

- 选题价值:1.5/2 - 音频描述是一个重要且持续发展的多模态任务,将LLM与之结合是当前热点。论文直接针对该结合点中的一个关键瓶颈(模态差距)进行优化,具有明确的实际意义和应用潜力。

- 开源与复现加成:0.5/1 - 论文提供了代码仓库链接(https://github.com/Hyeongkeun/LAMB),这是重大加分项。论文中也给出了较为详细的实现细节(如模型配置、训练超参数)。但未提及是否公开模型权重,也没有提供完整的复现指南或配置文件说明,因此复现门槛仍存。