📄 LAFUFU: Latent Acoustic Features For Ultra-Fast Utterance Restoration

#语音增强 #扩散模型 #实时处理 #潜在空间

🔥 8.0/10 | 前25% | #语音增强 | #扩散模型 | #实时处理 #潜在空间

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 中

👥 作者与机构

- 第一作者:Łazarz Radosław Wosik(论文作者列表首位,但未明确标注为第一作者)

- 通讯作者:论文中未明确标注

- 作者列表:Łazarz Radosław Wosik (Samsung R&D Institute Poland), Mateusz Pudo (Samsung R&D Institute Poland), Urszula Krywalska (Samsung R&D Institute Poland), Adam Cie´slak (Samsung R&D Institute Poland), († AGH University of Krak´ow) — 论文开头列出作者姓名及主要所属机构为Samsung R&D Institute Poland,其中一位作者带有†标记,表示其同时隶属于AGH University of Krak´ow。

💡 毒舌点评

亮点在于它非常务实且有效:通过将扩散过程搬到一个更小、更高效的潜在空间里,直接戳破了生成式语音恢复“效果好但算力吃不消”的泡沫,实现了显著的加速(RTF降低约40%)而不牺牲质量。短板是其创新本质是“缝合”了图像领域的Latent Diffusion思想和语音领域的SGMSE+模型,属于应用创新而非理论突破,且双模型架构无形中增加了部署时的内存管理复杂度。

🔗 开源详情

- 代码:论文明确提供了代码页面链接:https://samsunglabs.github.io/LAFUFU/。

- 模型权重:论文中提及了“公开可用的SGMSE+检查点”,但未说明LAFUFU自身的模型权重是否或如何公开。

- 数据集:使用的是公开的EARS-WHAM和EARS-Reverb基准数据集。

- Demo:论文提及了演示页面,即上述代码链接。

- 复现材料:提供了关键的模型架构描述(如AE的U-Net块数、损失函数组合)和部分训练设置(如损失权重、MRSTFT窗口配置),但未给出完整的超参数列表、优化器配置等。

📌 核心摘要

- 解决的问题:现有的基于扩散模型的语音恢复(如去噪、去混响)方法虽然生成质量高,但计算开销巨大,难以部署在边缘设备或实时场景中。

- 方法核心:提出LAFUFU,一个在潜在空间中操作的生成式框架。其核心是先使用一个定制的、轻量级的自编码器(AE)将高维的语音STFT谱图压缩到一个紧凑的潜在空间,然后在该空间内执行扩散模型的迭代去噪过程,最后通过解码器恢复出干净语音。

- 与已有方法的新颖之处:

- 将专为图像修复设计的Refusion自编码器思想适配到语音STFT域(将时间和频率视为空间维度)。

- 针对语音STFT的稀疏性和多尺度特性,采用多分辨率STFT损失(MRSTFT)替代常规L1损失,提升感知质量。

- 通过潜在替换机制,使编码器专注于编码必要的修改信息而非完整信号。

- 通过在压缩后的潜在空间操作,大幅降低了单次得分模型调用的计算成本,使得在相同实时因子(RTF)预算下,可以使用更大、更强的得分模型。

- 主要实验结果:

- EARS-WHAM (去噪):LAFUFU256与SGMSE+(N=60)在SI-SDR, PESQ, ESTOI等指标上基本持平,但RTF从1.74降低到1.07(提速约38%)。LAFUFU128在RTF=0.45时仍能达到接近的性能。

- EARS-Reverb (去混响):LAFUFU256(RTF=1.07)的SI-SDR(9.46)超过了SGMSE+(RTF=1.74, SI-SDR=6.16),PESQ(3.17)和ESTOI(0.87)也优于或持平于SGMSE+,同时速度更快。

- 消融研究:移除自编码器中的隐藏连接导致性能轻微下降;移除正则化损失(Reg-Loss)导致模型性能急剧恶化(SI-SDR降至负值),证明其对维持潜在空间结构至关重要。

- (关键数据见下文实验结果表格)。

- 实际意义:证明了在潜在空间进行扩散操作是加速生成式语音恢复的可行且高效的技术路径,为将高质量生成模型应用于实时音频处理(如会议系统、助听器、游戏语音)铺平了道路。

- 主要局限性:采用双模型(编码器-解码器 + 扩散模型)架构,增加了系统的整体内存占用和参数量。模型性能的上限受限于自编码器的重建质量。

🏗️ 模型架构

LAFUFU采用两阶段架构:一个任务专用的自编码器(AE)和一个在潜在空间操作的扩散得分模型。其整体流程如下:原始失真语音谱图Y被输入自编码器,编码为紧凑的潜在表示Z_Y。然后,扩散模型在这个低维潜在空间Z_Y上进行迭代去噪,生成目标潜在表示Z_X。最后,自编码器的解码器将Z_X解码回谱图域,得到恢复的语音X’。

自编码器(AE)组件:

- 功能:将高维、稀疏的语音STFT谱图(实部和虚部视为两个通道)压缩到一个信息密集的潜在空间,并能从该空间解码恢复出谱图。

- 结构:基于Refusion架构简化,采用U-Net,但仅使用两个下采样/上采样块(而非三个),因为语音谱图的分辨率低于高清图像。这减少了参数量。

- 关键设计:

- 损失函数:采用多分辨率STFT损失(MRSTFT)和正则化损失(Reg-Loss)的加权组合。MRSTFT在多个窗口长度和分辨率上计算重建损失,更符合听觉感知。Reg-Loss约束潜在编码Z_Y的均值和方差与输入Y的接近,防止潜在空间出现不连续的碎片化编码,对扩散模型的稳定生成至关重要。

- 潜在替换机制:解码器不仅接收潜在编码Z,还接收原始失真谱图Y的多级特征作为输入。这使得潜在编码Z只需关注编码“修改信号”(即从失真到干净的差异),而非重建整个干净语音,提高了AE的效率和鲁棒性。

- 数据流:

输入Y -> 编码器 -> 潜在Z_Y -> (扩散过程) -> 潜在Z_X -> 解码器(同时结合Y的多级特征) -> 输出X'

扩散得分模型组件:

- 功能:在潜在空间执行条件生成,将失真语音的潜在表示Z_Y逐步去噪为目标干净语音的潜在表示Z_X。

- 结构:紧密遵循SGMSE+的架构,这是一个噪声条件得分网络(通常为多分辨率U-Net)。但移除了其原始的第一层和最后一层,因为这些层的原始特征预处理工作现在由AE的编码器和解码器承担。

- 过程:遵循反向随机微分方程(SDE)进行迭代采样。在每次迭代中,得分模型s_θ会根据当前潜在状态、失真条件Y和时间步t,预测得分(梯度),从而更新状态。

架构图说明:

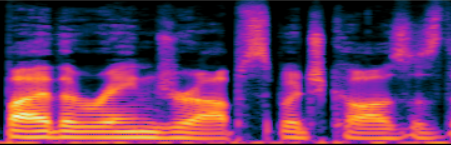

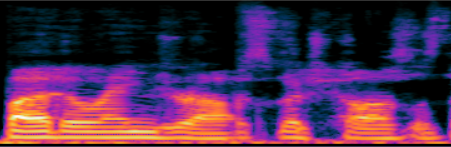

论文提供了图2(pdf-image-page1-idx1)对比了传统SGMSE+(a)和LAFUFU(b)的流程,清晰地展示了LAFUFU如何通过引入AE将扩散过程“嵌入”到潜在空间中。图3(pdf-image-page1-idx2)详细展示了所用自编码器的架构,包括其损失计算(MRSTFT-Loss + Reg-Loss)和特征连接方式。

图2: (a) 传统SGMSE+在谱图空间直接操作;(b) LAFUFU先用AE编码到潜在空间,在潜在空间扩散,再解码回谱图。

图2: (a) 传统SGMSE+在谱图空间直接操作;(b) LAFUFU先用AE编码到潜在空间,在潜在空间扩散,再解码回谱图。

图3: LAFUFU所用的自编码器架构示意图,展示了编码、潜在空间、解码以及多分辨率STFT损失和正则化损失的计算位置。解码器同时接收来自失真输入的多级特征。

图3: LAFUFU所用的自编码器架构示意图,展示了编码、潜在空间、解码以及多分辨率STFT损失和正则化损失的计算位置。解码器同时接收来自失真输入的多级特征。

💡 核心创新点

- 潜在空间扩散范式适配于语音恢复:首次系统地将专为图像生成设计的潜在扩散模型(Latent Diffusion Models)思想,适配并应用于语音恢复任务,并证明了其在加速方面的显著效果。这填补了相关研究中对实时性权衡关注的空白。

- 针对语音特性的自编码器优化:

- 架构轻量化:将U-Net的下采样块从3个减少到2个,以适应语音谱图的较低分辨率。

- 感知损失改进:用多分辨率STFT损失替代L1/L2损失,更好地优化了语音的感知质量。

- 潜在替换机制:使编码器专注于学习“修改”而非“重建”,提升了效率。

- 在固定计算预算下实现更高质量:通过将扩散过程转移到潜在空间,大幅降低了单步推理成本。这使得在相同的实时因子(RTF)限制下,可以部署参数量更大、性能更强的得分模型,从而在速度和质量之间取得更优的平衡点(如EARS-Reverb实验所示)。

🔬 细节详述

- 训练数据:使用EARS-WHAM和EARS-Reverb基准数据集。具体规模、预处理和数据增强方法论文中未详细说明,但提及与[4]中一致。

- 损失函数:

- 自编码器损失:

L_AE = 1.0 MRSTFT + 0.1 Reg-Loss。 - MRSTFT:覆盖8个窗口长度(32, 64, 128, 256, 512, 1024, 1534, 2048),每个窗口的步长为窗口长度的1/4。

- Reg-Loss:

Reg-Loss(ZY, Y) = |μ_ZY - μ_Y| + |σ_ZY - 1/(2σ_Y)|,其中μ和σ是张量元素的均值和标准差。 - 扩散模型损失:论文中未具体说明,但明确提到其训练recipe与[4]一致,即遵循SGMSE+的训练目标(分数匹配)。

- 自编码器损失:

- 训练策略:论文未提供具体的学习率、优化器、batch size、训练步数等超参数。

- 关键超参数:

- 模型大小:通过每个块的通道数(128×, 192×, 256×)来控制扩散得分模型的大小,分别对应LAFUFU128, 192, 256。同时训练了通道数为64×和96×的轻量化SGMSE+作为基线。

- 自编码器结构:2个下采样/上采样块的U-Net。

- 训练硬件:所有训练和实验均在单张NVIDIA A100 GPU上进行。

- 推理细节:使用预测器-校正器(predictor-corrector)采样设置,继承自[4]。采样步数N在对比实验中通常设为60。

- 正则化/稳定训练技巧:Reg-Loss是确保自编码器潜在空间结构良好、使扩散模型能够稳定工作的关键技巧。

📊 实验结果

论文在EARS-WHAM(去噪)和EARS-Reverb(去混响)两个48kHz基准上进行了评估,使用SI-SDR、PESQ、ESTOI、SIGMOS、DNSMOS/MOS Reverb等质量指标和RTF作为效率指标。为消除随机性,每个条件训练了三次并报告均值和标准差。

EARS-WHAM 基准测试结果

| 方法 | N (采样步数) | SI-SDR | PESQ | ESTOI | SIGMOS | DNSMOS | RTF |

|---|---|---|---|---|---|---|---|

| Noisy | N/A | 5.92 ±6.11 | 1.24 ±0.22 | 0.49 ±0.16 | 1.95 ±0.39 | 2.72 ±0.30 | N/A |

| SGMSE+ [2] | 60 | 16.33 ±4.53 | 2.47 ±0.62 | 0.73 ±0.13 | 3.37 ±0.40 | 3.88 ±0.26 | 1.74 ±0.02 |

| SB [13] | 50 | 17.9 | 2.32 | 0.73 | 3.44 | 3.87 | N/A |

| SB-UFOGen [14] | 1 | 17.9 | 2.56 | 0.74 | 3.48 | 3.88 | N/A |

| LAFUFU128 | 60 | 16.21 ±4.46 | 2.42 ±0.64 | 0.72 ±0.13 | 3.44 ±0.41 | 3.85 ±0.27 | 0.45 ±0.01 |

| LAFUFU192 | 60 | 16.50 ±4.40 | 2.46 ±0.64 | 0.73 ±0.13 | 3.45 ±0.41 | 3.85 ±0.26 | 0.78 ±0.01 |

| LAFUFU256 | 60 | 16.57 ±4.44 | 2.47 ±0.64 | 0.72 ±0.13 | 3.46 ±0.41 | 3.86 ±0.26 | 1.07 ±0.01 |

EARS-Reverb 基准测试结果

| 方法 | N | SI-SDR | PESQ | ESTOI | SIGMOS | MOS Reverb | RTF |

|---|---|---|---|---|---|---|---|

| Reverberant | N/A | -16.14 ±9.28 | 1.47 ±0.36 | 0.52 ±0.17 | 2.77 ±0.43 | 2.99 ±0.74 | N/A |

| SGMSE+ [2] | 60 | 6.16 ±7.77 | 3.04 ±0.65 | 0.85 ±0.09 | 3.49 ±0.43 | 4.73 ±0.21 | 1.74 ±0.02 |

| SB [13] | 50 | 6.65 | 3.41 | 0.88 | 3.37 | 4.73 | N/A |

| SB-UFOGen [14] | 1 | 8.73 | 3.36 | 0.88 | 3.33 | 4.71 | N/A |

| LAFUFU128 | 60 | 6.72 ±5.66 | 2.84 ±0.64 | 0.83 ±0.09 | 3.42 ±0.44 | 4.68 ±0.23 | 0.45 ±0.01 |

| LAFUFU192 | 60 | 8.25 ±5.94 | 3.03 ±0.64 | 0.85 ±0.09 | 3.44 ±0.43 | 4.70 ±0.22 | 0.78 ±0.01 |

| LAFUFU256 | 60 | 9.46 ±5.59 | 3.17 ±0.63 | 0.87 ±0.09 | 3.45 ±0.44 | 4.71 ±0.21 | 1.07 ±0.01 |

消融研究结果 (EARS-Reverb基准)

| 变体 | SI-SDR | PESQ | ESTOI | SIGMOS | MOS Reverb | RTF |

|---|---|---|---|---|---|---|

| LAFUFU128 (完整) | 6.72 ±5.66 | 2.84 ±0.64 | 0.83 ±0.09 | 3.42 ±0.44 | 4.68 ±0.23 | 0.45 ±0.01 |

| No hidden connections | 5.93 ±5.97 | 2.74 ±0.63 | 0.82 ±0.10 | 3.42 ±0.44 | 4.68 ±0.23 | 0.45 ±0.01 |

| No RegLoss | -19.36 ±9.78 | 1.45 ±0.32 | 0.52 ±0.16 | 2.76 ±0.43 | 3.23 ±0.79 | 0.45 ±0.01 |

图表分析:

- 图1 (pdf-image-page1-idx0) 和 图4 (pdf-image-page1-idx3)、图5 (pdf-image-page2-idx4):这些图表直观地展示了LAFUFU在速度(RTF)与质量(ESTOI)权衡上的优势。LAFUFU曲线位于SGMSE+曲线的左上方,意味着在相同ESTOI分数下RTF更低,或在相同RTF下ESTOI更高。图1中的谱图对比显示了LAFUFU的恢复��果与地面真值接近,优于扭曲输入。

- 图4、图5:进一步将这一趋势扩展到PESQ、SI-SDR、DNSMOS等多个指标,一致性地证实了LAFUFU在EARS-WHAM和EARS-Reverb两个任务上的效率优势。

⚖️ 评分理由

- 学术质量:6.0/7:技术路线正确且工程实现扎实。创新性体现在对现有技术(Latent Diffusion, SGMSE+, Refusion AE)的创造性组合与针对语音领域的适配优化上,而非提出全新的基础理论。实验设计全面,对比了不同模型规模,并进行了必要的消融研究(Reg-Loss),结论可靠。扣分点在于原创性幅度有限,且部分训练细节未公开。

- 选题价值:1.5/2:聚焦于生成式语音恢复的核心部署瓶颈(速度),提出了一个有效且可直接落地的解决方案。对于追求实时、高质量语音处理的工业界和学术界应用,此工作具有很高的实用价值和启发意义。

- 开源与复现加成:0.5/1:提供了代码仓库和演示页面的链接,这是一个重要的加分项。但缺乏完整的模型权重、训练配置、数据预处理脚本等关键复现材料,使得独立复现存在一定门槛。