📄 Interval-Aware Retrieval Framework For Speech-Based Automatic Alzheimer’s Detection

#语音生物标志物 #检索增强生成 #多模态模型 #迁移学习

🔥 8.5/10 | 前25% | #语音生物标志物 | #检索增强生成 | #多模态模型 #迁移学习

学术质量 7.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Mingyang Gu(天津大学智能与计算学院;中国科学院深圳先进技术研究院)

- 通讯作者:Gaoyan Zhang(天津大学智能与计算学院)、Jianwu Dang(中国科学院深圳先进技术研究院)

- 作者列表:

- Mingyang Gu(天津大学智能与计算学院, 中国科学院深圳先进技术研究院)

- Zunsheng Tan(中国科学院深圳先进技术研究院)

- Kai Li(中国科学院深圳先进技术研究院)

- Xiaobao Wang(天津大学智能与计算学院)

- Bin Wen(天津大学智能与计算学院)

- Tianrui Wang(天津大学智能与计算学院)

- Gaoyan Zhang(天津大学智能与计算学院, 通讯作者)

- Jianwu Dang(中国科学院深圳先进技术研究院, 通讯作者)

💡 毒舌点评

亮点:本文的核心思想“用健康人的说话时序作为参考标尺来衡量患者语音的异常程度”非常巧妙且符合临床直觉,RAG与CTC的结合为实现这一思想提供了有效且工程化的路径,实验也证明了其有效性。短板:论文未提供代码,对于一个依赖特定预训练模型(Whisper, HuBERT)和外部构建的健康语音时序记忆库的框架,这在一定程度上削弱了其可复现性和即时可用性,对于想快速验证或应用的读者不太友好。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及是否公开模型权重。

- 数据集:评估使用了公开的ADReSS和ADReSSo数据集。记忆库构建使用了LibriSpeech-100h,其获取方式可参考原数据集论文,但本论文未说明具体处理和索引后的版本是否发布。

- Demo:未提供在线演示。

- 复现材料:论文提供了模型架构、主要训练超参数(优化器、学习率等)和评估协议,但缺少具体的训练脚本、配置文件、检查点或附录中更细致的说明。

- 引用的开源项目:论文中引用的开源工具/模型主要包括:Whisper(用于转录和时间戳)、HuBERT(语音编码器)、RoBERTa(文本编码器)。

- 开源计划:论文中未提及开源计划。

📌 核心摘要

本文旨在解决基于自发语音的阿尔茨海默病(AD)自动检测中,现有方法未能充分建模和利用患者语音中特有的“时间节律异常”(如停顿、拖音、不流畅)的问题。论文提出了一种区间感知的检索增强框架,其核心包含三个部分:1)一个RAG模块,从健康人的语音数据中检索词级别的时序先验,作为判断异常与否的“归一化参考”;2)一个CTC引导的跨模态对齐模块,在无需语音-文本精确对齐标注的情况下,实现文本表示与语音帧的软对齐;3)一个区间感知增强器,通过对比当前语音的实际时序与检索到的健康先验,将偏差转化为残差权重,以突出异常的语音片段。与已有方法相比,该框架的新颖之处在于引入外部健康时序知识作为基准、采用无监督对齐技术、以及显式地将时序偏差融入特征表示。在ADReSS和ADReSSo两个基准测试集上,本文方法分别取得了94.79%和88.73%的准确率,相比此前最优方法错误率降低了13.4%和11.1%,并在所有评估指标上均达到最佳。该工作的实际意义在于提供了一种可扩展、非侵入的AD早期筛查工具,其可解释的权重可视化也能辅助临床医生进行审查。主要局限性是其性能依赖于所构建的健康语音时序记忆库的覆盖度和质量,且可能存在跨数据集、录音条件的领域偏移。

🏗️ 模型架构

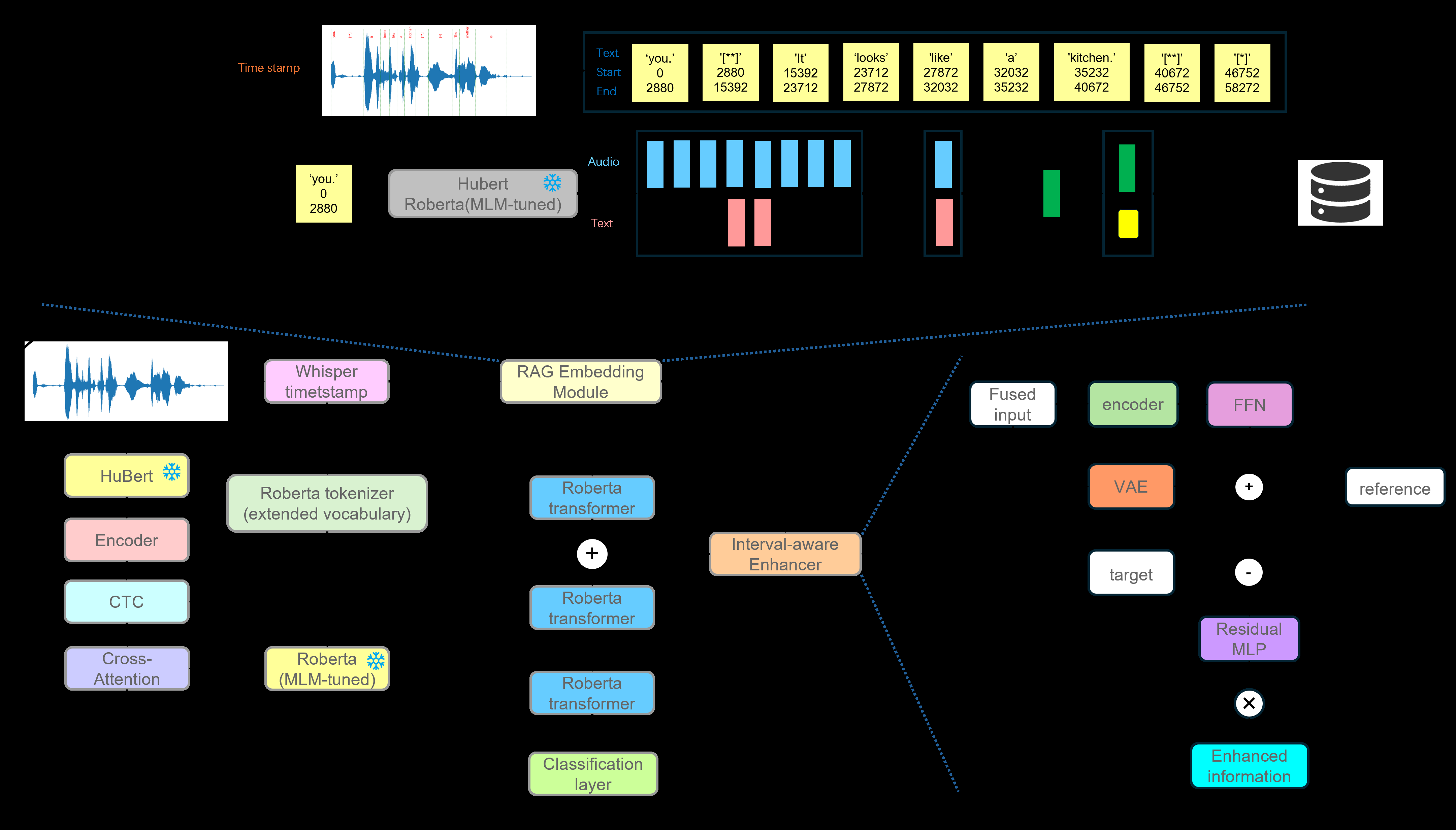

本论文提出的“区间感知检索框架”是一个端到端的多模态系统,其整体架构如图1所示。它主要分为三个阶段,旨在将语音和文本信息进行深度整合,并显式建模时序偏差。

本论文提出的“区间感知检索框架”是一个端到端的多模态系统,其整体架构如图1所示。它主要分为三个阶段,旨在将语音和文本信息进行深度整合,并显式建模时序偏差。

- 输入与编码阶段

- 输入:语音波形和对应的文本转录。

- 处理:使用Whisper模型对语音进行转录并提取词级别的时间戳。文本中的停顿(间隔>0.2秒)被替换为一个特殊的

[*]标记,不流畅片段标记为[]。 - 编码器:使用冻结的预训练模型对原始输入进行编码。

- 语音编码器:冻结的HuBERT-large,输出帧级别的语音特征

S ∈ R^{B×Ls×ds}。 - 文本编码器:冻结的、经过简短微调以适配

[]和[*]标记的RoBERTa-base,输出词级别的文本特征T ∈ R^{B×Lt×dt}。

- 语音编码器:冻结的HuBERT-large,输出帧级别的语音特征

- RAG嵌入模块 此模块的核心是构建并利用一个“健康语音时序记忆库”。

- 记忆库构建:在LibriSpeech-100h(健康人语音)上进行。对于每个词/停顿片段,提取其起止时间戳(计算区间

I),并用冻结的RoBERTa和HuBERT分别编码对应的文本和音频,拼接后作为键(key)e,存储(e, I)对。 - 检索:对于当前输入的AD样本,用其文本-音频编码作为查询(query)

eq,从记忆库中检索出余弦相似度最高的K个条目,取其区间的平均值作为健康时序参考Iref。这为后续模块提供了一个判断当前语音片段时长是否异常的基准。

- CTC驱动的跨模态对齐与融合 此阶段旨在将语音信息精准地注入到文本表示中。

- 软对齐:在冻结的HuBERT输出

S之上,添加一个CTC头(使用文本token序列作为目标进行训练)。训练后,利用CTC的输出获得语音帧到文本token的软对齐矩阵,将语音特征S重新加权求和,得到与文本token长度对齐的语音特征Saligned ∈ R^{B×Lt×ds}。 - 跨模态融合:使用交叉注意力机制,其中对齐后的语音特征作为查询(Query),原始文本特征作为键(Key)和值(Value)。公式为:

Tfused = CrossAttn(q=Saligned, k=T, v=T)。这生成了融合了语音指导的文本上下文表示Tfused。

- 区间感知增强器 这是本框架的核心创新组件,用于显式利用时序偏差。

- 区间预测与偏差建模:接收融合特征

Tfused。一个轻量级回归器预测每个token的持续时间估计Î;一个变分自编码器(VAE)头预测分布的均值和方差,用于采样噪声ε。最终预测为Ipred = Î + ε + Iref。与从Whisper时间戳获得的真实区间Igt比较,得到偏差ΔI = Igt - Ipred。 - 残差特征增强:将偏差

ΔI输入一个权重网络,生成一个稀疏的、强调异常位置的权重向量w。增强后的特征Hout = RoBERTa1(Tfused) + (Tfused ⊙ w),这是一个残差结构,将强调异常时序的权重乘以融合特征,然后加回原特征中,作为后续RoBERTa层和分类器的输入。 - 训练目标:总损失

Ltotal = α Lctc + β Lcls,其中Lctc用于训练对齐头,Lcls用于AD分类。

💡 核心创新点

- 引入健康人时序先验(RAG):这是本文最核心的贡献。以往方法缺乏一个客观的“正常”标准来判断语音片段的异常程度。本文通过RAG机制,从健康人语音库中动态检索与当前语境最相似的词级时序统计,作为一个归一化的参考基准,使得模型可以显式地计算和利用“偏离正常节律的程度”。

- 无需语音标注的CTC引导对齐:现有的跨模态融合常因语音帧与文本token长度不匹配导致信息模糊。本文使用CTC损失训练一个对齐头,利用文本序列作为监督,实现了无需精确语音-文本对齐标注(Oracle Durations)的软对齐,为后续融合提供了高质量的、长度对齐的跨模态特征。

- 区间感知的显式偏差建模:不同于以往简单拼接或加权融合特征,本文设计了一个“增强器”模块,其核心是显式地计算当前语音时序与检索到的健康先验之间的偏差,并利用这个偏差生成一个可学习的残差权重,直接用于调制融合后的特征表示。这使得模型能动态地、有针对性地“高亮”那些与正常节奏差异最大的语音片段(如长停顿、不流畅)。

🔬 细节详述

- 训练数据:评估数据集为ADReSS(156段访谈,分为AD vs NC)和ADReSSo(更嘈杂的扩展版)。健康语音记忆库构建使用LibriSpeech-100h数据集(未明确说明具体子集,论文中仅提及)。

- 预处理与数据增强:使用Whisper-medium模型进行语音转录和时间戳提取(含VAD)。文本中插入

[](不流畅)和[*](停顿)标记。未提及使用其他数据增强技术。 - 损失函数:总损失为加权和

Ltotal = α Lctc + β Lcls。Lctc是连接主义时序分类损失,用于监督语音-文本对齐;Lcls是用于AD分类的交叉熵损失。超参数α和β未说明具体取值。 - 训练策略:优化器为AdamW(学习率1e-4);学习率调度为ReduceLROnPlateau(因子0.5,耐心3,最小1e-7);使用早停法;批大小为4,梯度累积步长为4;训练精度为fp16;在单张NVIDIA A6000 GPU上训练。未说明总训练轮数或步数。

- 关键超参数:RAG检索的近邻数

K未说明;记忆库构建时,停顿插入阈值为0.2秒。文本编码器为RoBERTa-base,语音编码器为HuBERT-large。 - 训练硬件:单张NVIDIA A6000 GPU。

- 推理细节:未提及特殊解码策略或流式处理设置。模型输出为AD/NC的二分类概率。

- 正则化技巧:未明确提及Dropout等,但提到了早停法和学习率衰减策略。

📊 实验结果

本文在两个标准基准上进行了全面的对比实验和消融研究。

表1. ADReSS测试集结果

| 方法 | Acc | F1 | Pre | Rec |

|---|---|---|---|---|

| Zhang et al.[7] | 89.58 | 89.80 | 88.00 | 91.67 |

| Wang et al.[13] | 93.75 | 93.90 | 95.80 | 91.80 |

| Yuan et al.[5] | 89.58 | 88.90 | 83.30 | 95.20 |

| Liu et al.[14] | 87.50 | 87.00 | 88.00 | 88.00 |

| 本文方法 | 94.79 | 94.78 | 95.28 | 94.79 |

表2. ADReSSo测试集结果

| 方法 | Acc | F1 | Pre | Rec |

|---|---|---|---|---|

| Pan et al.[15] | 87.32 | 87.36 | 87.32 | 87.32 |

| Pan et al.[16] | 78.87 | 79.09 | 78.81 | 78.81 |

| Pappagari et al.[17] | 84.51 | 84.00 | 85.50 | 84.50 |

| Luz et al.[11] | 78.87 | 78.90 | 78.90 | 78.87 |

| 本文方法 | 88.73 | 88.71 | 88.88 | 88.69 |

- 主要对比:如表1和表2所示,本文方法在两个数据集的所有指标上均超越了所有列出的先前方法。在ADReSS上,相比最强的先前融合系统(Wang et al.[13]),准确率提升了1.04个百分点。在ADReSSo上,超越了Swin-BERT(Pan et al.[15])1.41个百分点。错误率降低率分别达到了13.4%和11.1%。

- 消融实验:表3展示了在ADReSS上的消融结果,这是验证各组件有效性的关键证据。

- 移除CTC头(w/o CTC):准确率从94.79%骤降至87.50%,表明精确的跨模态对齐至关重要。

- 移除区间感知增强器(w/o Interval-aware Enh.):准确率降至85.42%,表明显式偏差建模贡献显著。

- 移除停顿与不流畅标记(w/o Pause & Disfl.):性能崩溃至64.58%,这几乎是随机猜测的水平,说明时序线索(停顿、不流畅)是AD检测的核心特征。

- 单模态变体(Text only / Audio only)性能均远低于多模态融合(分别为81.25%和72.92%),证实了融合两种模态的必要性。

- 可视化分析:

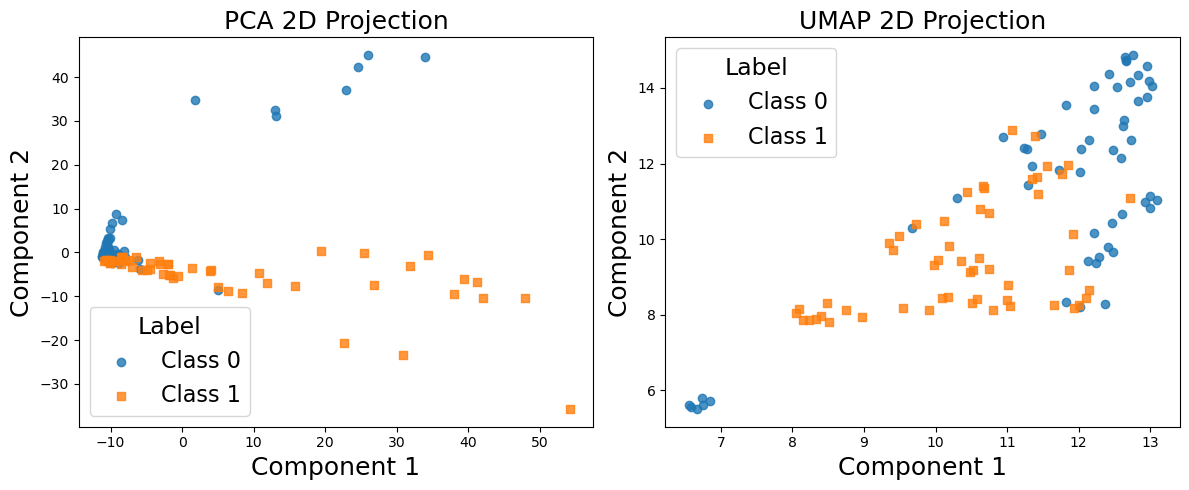

图2展示了模型最终输出的话语级表示的降维可视化。PCA投影(左)显示两类有一定分离但存在重叠。UMAP投影(右)则显示出更清晰的分离,NC(0)和AD(1)形成了较为紧凑的簇,仅有少量边界混合。这直观地证明了模型学习到的表示具有判别性。

图2展示了模型最终输出的话语级表示的降维可视化。PCA投影(左)显示两类有一定分离但存在重叠。UMAP投影(右)则显示出更清晰的分离,NC(0)和AD(1)形成了较为紧凑的簇,仅有少量边界混合。这直观地证明了模型学习到的表示具有判别性。

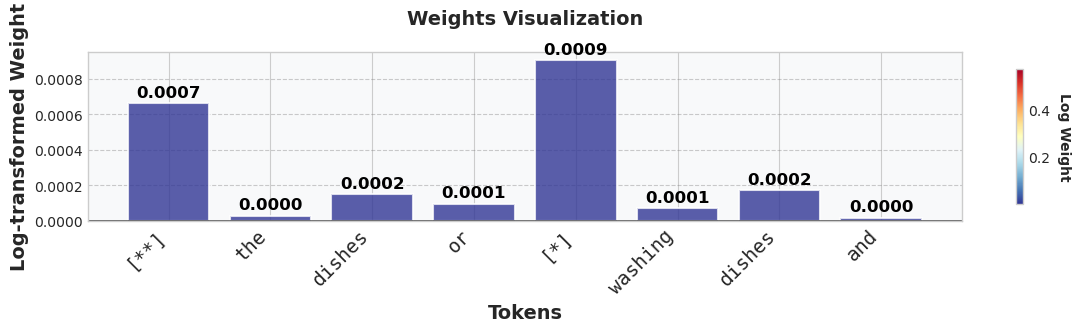

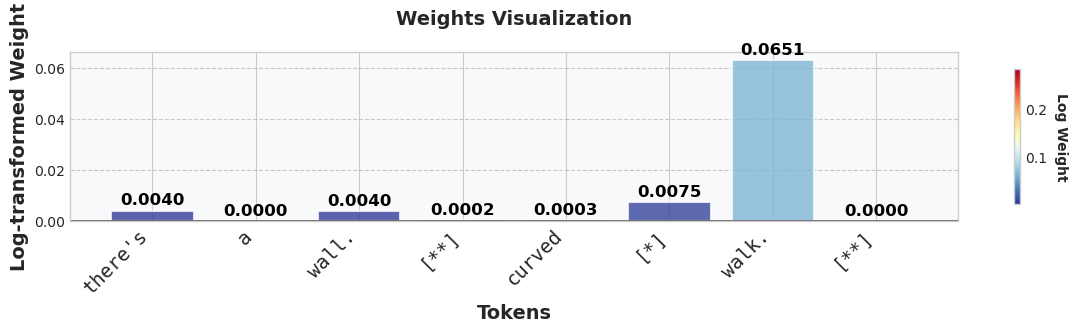

图3和图4展示了区间感知增强器生成的token权重

图3和图4展示了区间感知增强器生成的token权重w。权重分布稀疏且峰值明显。图3(a)显示最高权重落在[*](停顿)和[](不流畅)标记上。图3(b)则显示一个内容词(如“walk”)因其前后伴随不流畅和停顿而获得高峰值权重。这些可视化提供了模型关注时序异常区域的可解释性证据。

⚖️ 评分理由

学术质量:7.0/7

- 创新性(2.5/3):将RAG引入AD检测的时序建模是一个新颖的视角,CTC无监督对齐和基于偏差的残差增强器设计也具有独到之处。创新主要体现在概念整合和针对性模块设计上。

- 技术正确性(2.0/2):框架各组件设计合理,数学表述清晰(如RAG检索、偏差计算、残差增强),实验设计(包括消融)有力地验证了每个组件的有效性,技术上可靠。

- 实验充分性与证据可信度(2.5/2):实验在两个公认基准上进行,并提供了最全面的指标对比。消融实验彻底,验证了所有核心假设。可视化分析提供了定性证据,增强了说服力。实验部分非常扎实。

选题价值:1.5/2

- 前沿性与潜在影响(1.0/1):AD的语音检测是AI医疗的前沿交叉领域,早期、无创筛查具有重大的公共卫生意义。本文的思路可能推动该领域向更精细化、更可解释的方向发展。

- 实际应用空间与读者相关性(0.5/1):该技术有明确的临床应用潜力(辅助筛查、监测)。对于从事语音分析、生物医学工程和计算语言学的读者,本文提供了如何将通用AI技术(RAG, 对齐)应用于垂直医疗问题的优秀范例。

开源与复现加成:0.0/1

- 论文未提供代码仓库、模型权重或详细的复现配置。虽然方法描述详细,但依赖多个预训练模型和特定的记忆库构建流程,完整复现存在门槛。因此,未给予加成。