📄 HergNet: A Fast Neural Surrogate Model for Sound Field Predictions Via Superposition of Plane Waves

#空间音频 #物理信息神经网络 #声学模拟

✅ 7.0/10 | 前25% | #空间音频 | #物理信息神经网络 | #声学模拟

学术质量 5.5/7 | 选题价值 1.0/2 | 复现加成 0.5 | 置信度 中

👥 作者与机构

- 第一作者:Matteo Calafà(丹麦技术大学,电气与光子工程系,声学技术部门)

- 通讯作者:论文中未明确标注通讯作者

- 作者列表:Matteo Calafà(丹麦技术大学,电气与光子工程系,声学技术部门)、Yuanxin Xia(丹麦技术大学,电气与光子工程系,声学技术部门)、Cheol-Ho Jeong(丹麦技术大学,电气与光子工程系,声学技术部门)

💡 毒舌点评

这篇论文最聪明的地方在于把“物理定律”硬编码进了网络架构,让神经网络生来就是“正确”的,省去了经典PINNs在内部点计算损失的苦工,在中高频段算得又快又准。不过,为了追求“快速”和“物理正确”,它默认了声场就是平面波的叠加,导致在低频段(更像扩散问题时)表现拉胯,而且对比的主要是自己实现的解析解,没能和工业界常用的FEM、BEM等“老大哥”直接掰手腕,显得有点“偏科”。

🔗 开源详情

- 代码:论文中未提及代码仓库链接。

- 模型权重:未提及公开权重。

- 数据集:不适用,论文使用数值模拟和解析解进行验证,未使用公开声学数据集。

- Demo:未提及在线演示。

- 复现材料:论文提供了详细的超参数、训练策略和硬件环境,复现信息较充分。

- 论文中引用的开源项目:主要依赖JAX(v0.7.0)深度学习框架。

📌 核心摘要

- 要解决什么问题:传统数值方法(如FEM)和经典物理信息神经网络(PINNs)在模拟中高频声场时计算成本高、收敛困难。本文旨在提出一种更高效、物理上精确的神经网络代理模型。

- 方法核心是什么:提出HergNet架构。其核心思想是基于Herglotz表示定理,将声场显式表示为可训练平面波(带方向

s_j、相位d_j)的叠加。其中,每个平面波的复振幅由一个共享的、以入射方向为输入的神经网络˜h来预测。损失函数仅基于边界条件计算,网络输出自动满足齐次Helmholtz方程。 - 与已有方法相比新在哪里:与传统PINNs将物理定律作为软约束(损失函数项)不同,HergNet通过网络结构本身(平面波叠加)实现了物理定律的硬约束,使输出自动满足波动方程。因此,训练仅需边界数据,无需在计算域内部采样,极大提升了计算效率和内存优势。同时,通过神经网络学习

˜h函数,保证了物理量在方向空间上的连续性。 - 主要实验结果如何:

- 在6000 Hz的3D鞋盒房间声场预测中,HergNet预测结果与解析解在实部、虚部上吻合良好,最大边界误差0.16 Pa,相对误差<10%。

- 训练时间仅124秒(RTX 5090),但内存消耗是瓶颈(24.07 GB)。

- 频率扫描(100 Hz - 6000 Hz)显示,在中高频段,预测的声压级(SPL)和相位与解析解匹配完美,SPL偏差低于1 dB的听觉差异阈值。但在低频段(<500 Hz)误差相对增大。

- 计算成本随频率平方增长(

Nquad,Ntrain ∝ f^2),优于体积类方法(如PINNs、FEM)的立方增长。

- 实际意义是什么:为房间声学、电磁学、光学等领域的波场预测提供了一种快速、可扩展的深度学习工具,特别适合需要反复进行参数化仿真(如改变频率、边界条件)的场景,有望在虚拟现实、建筑声学设计中得到应用。

- 主要局限性是什么:

- 低频性能下降:在低频段(波动问题接近扩散问题时),平面波叠加表示变得低效,导致误差增大。

- 内存瓶颈:训练时,所有训练点需要与所有平面波参数交互,导致内存消耗以

O(f^4)增长,成为高频下的主要限制。 - 对比基线有限:实验主要与自实现的解析解对比,未与其他主流数值方法(如FEM、BEM)或最新神经网络方法进行直接性能(速度、精度)对比。

🏗️ 模型架构

HergNet的整体架构如图1所示,其设计核心是将数学表示(Herglotz波函数)直接转化为神经网络结构。

完整输入输出流程:

- 输入:目标空间点的坐标

x(以及给定的波数k、声速c等物理参数)。 - 输出:该点处的复声压

˜p(x)。

核心组件与数据流:

- 平面波生成层:

- 输入:空间点坐标

x。 - 操作:与一组预设的(可训练)方向向量

s_j和相位偏移d_j进行点积,生成N_quad个平面波的相位e^{i k (x·s_j + d_j)}。 - 参数:

s_j ∈ ∂B1(单位球面)和d_j ∈ R。初始化时s_j和d_j从均匀分布中采样。这些参数在训练中被优化。

- 输入:空间点坐标

- 神经网络

˜h模块:- 输入:平面波的方向

s_j。 - 结构:一个复数值全连接前馈神经网络(CVNN)。论文实例中使用两个隐含层,每层10个神经元。使用ReLU激活函数(无需对输入可微),权重采用He初始化。

- 输出:复振幅

˜h(s_j)。 - 作用:学习Herglotz密度函数,其输出作为每个平面波的复权重。使用神经网络而非独立标量是为了保证

˜h在方向空间上的连续性。

- 输入:平面波的方向

- 叠加与归一化:

- 操作:将所有平面波分量按其复振幅

˜h(s_j)加权求和,并除以N_quad进行归一化。 - 公式:

˜p(x) = (1/N_quad) * Σ_{j=1}^{N_quad} e^{i k (x·s_j + d_j)} ˜h(s_j)。

- 操作:将所有平面波分量按其复振幅

- 非齐次项修正:

- 对于包含声源项(

g ≠ 0)的问题,输出被修正为˜p + p_g,其中p_g是已知的非齐次解(如点源的格林函数)。

- 对于包含声源项(

关键设计选择与动机:

- 硬约束Helmholtz方程:任何平面波都是Helmholtz方程的解,其线性叠加仍是解。此架构从结构上保证了输出

˜p自动满足齐次Helmholtz方程,这是相较于传统PINNs的根本创新点。 - 仅边界训练:损失函数

L(p)仅计算边界点上的Robin条件误差(p - Z v_n)。由于内部解已物理正确,模型无需在体积内采样,极大减少了计算量。 - 复数值网络

˜h:声压是复量,使用CVNN能自然处理振幅和相位。 - 参数

s_j,d_j的可训练性:让平面波的方向和相位偏移在训练中优化,使网络能自适应地构建最能表示目标声场的波束组合,提升逼近能力。

💡 核心创新点

- 基于Herglotz表示的物理硬约束架构:将偏微分方程的解空间结构(平面波叠加)直接编码为神经网络的前向计算流程。这从根本上确保了输出物理有效,避免了PINNs中物理损失项与其他数据损失项之间的优化冲突,简化了训练。

- 仅依赖边界数据的训练范式:由于内部解自动满足方程,训练点只需布置在边界∂Ω上。这比需要在内部体积采样以约束PDE残差的经典PINNs,以及在体积上离散求解的FEM等方法,在采样复杂度和内存消耗上具有潜在优势(尽管当前实现中内存因展开平面波项而成为瓶颈)。

- 用于学习连续函数

˜h的神经网络:用神经网络˜h(s)来参数化Herglotz密度函数,而不是为每个平面波分配独立标量。这引入了方向空间上的归纳偏置,使模型能更稳定、高效地学习连续变化的声场分布,避免了独立参数回归可能导致的收敛困难。

🔬 细节详述

- 训练数据:论文中未使用外部数据集。训练数据是在边界∂Ω上随机均匀采样的点

x ∈ ∂Ω。对于给定的问题(鞋盒房间),边界是已知的。采样点数量N_train根据每个波长6个点(6 PPW)的原则确定,并随频率f的平方增长。 - 损失函数:

L(p) = MSE( p(x) - Z(x) v_{nx}(x) ),其中x ~ U(∂Ω)。这是边界上的Robin阻抗条件误差的均方损失。对于包含声源的问题,p为˜p + p_g。 - 训练策略:

- 优化器:Adam。

- 学习率:

2 × 10^{-3}。 - 训练轮数:1000个epochs。

- 批次处理:若

N_train < 5×10^4,使用单批次;否则使用两个批次。 - 无验证集:作者认为6 PPW的约束足以防止过拟合,因此未划分验证集。

- 关键超参数:

N_quad(平面波数量):f^2 / 2000,随频率平方增长。N_train(边界训练点数):按6 PPW确定,随f^2增长。- 神经网络

˜h结构:2个隐含层,每层10个神经元。 - 激活函数:ReLU。

- 权重初始化:He初始化,方差减半(因复数)。

- 训练硬件:单块NVIDIA GeForce RTX 5090 GPU(32 GB内存),CUDA 12.8。

- 推理细节:模型训练完成后,给定任意空间点

x,即可前向传播计算其声压˜p(x)。在频率扫描实验中,对每个频率单独训练一个模型,然后在固定接收点评估传递函数。 - 正则化或稳定训练技巧:论文未提及使用Dropout、权重衰减等常规正则化技巧。稳定性可能主要来源于物理硬约束架构和对平面波参数的良好初始化。

📊 实验结果

主要实验在6000 Hz频率下的3D鞋盒房间(Louden比例)中进行,点源位于[0.2, 0.4, 0.3] m,边界阻抗均匀Z = (10-10i)ρc。

- 声场预测精度(与解析解对比)

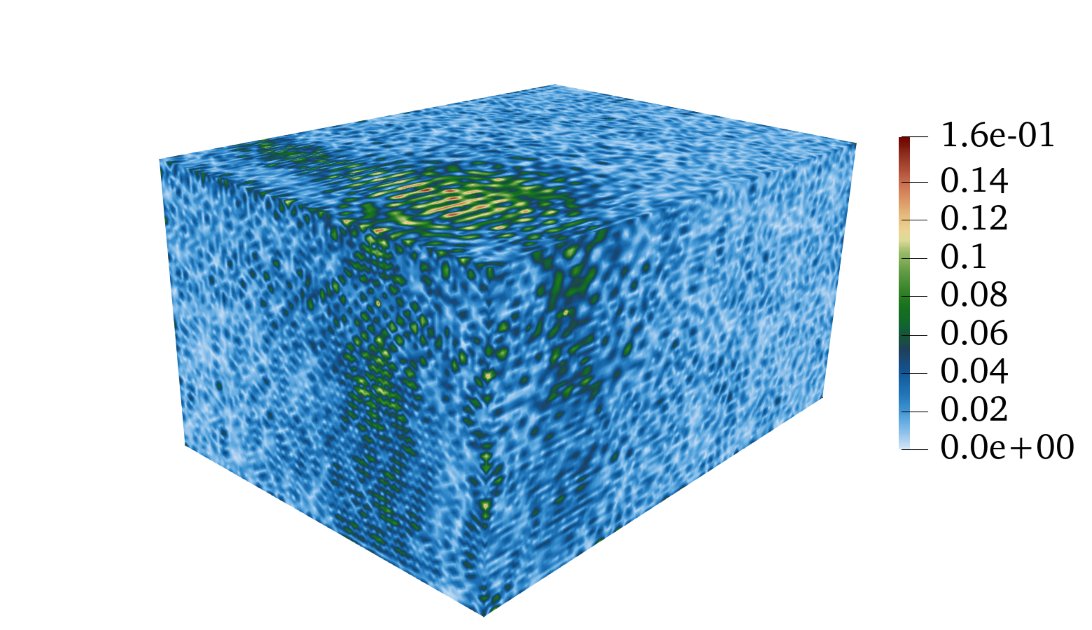

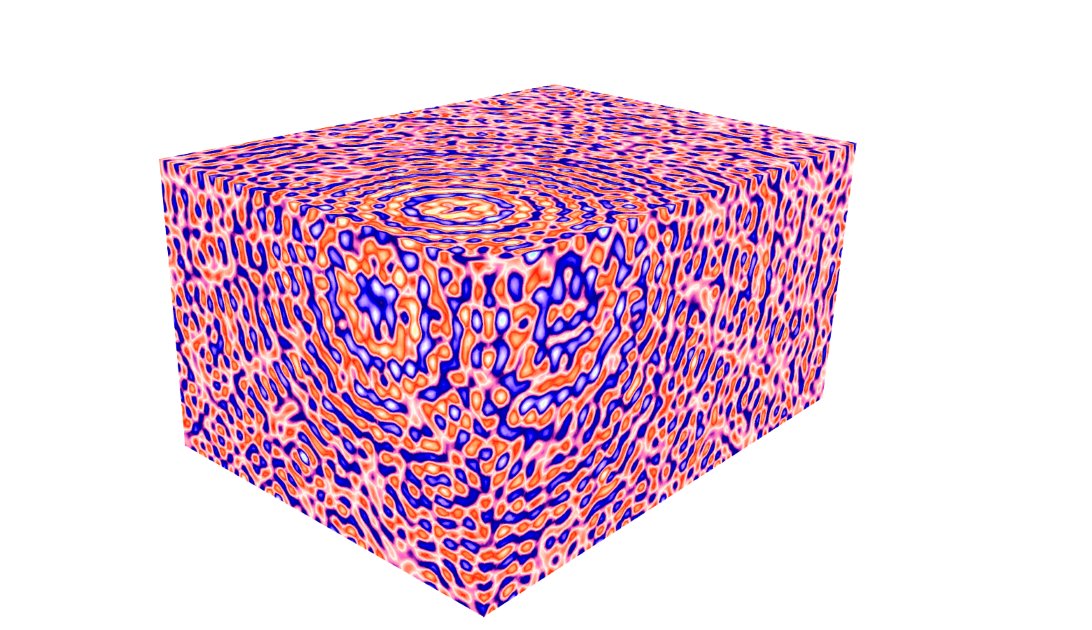

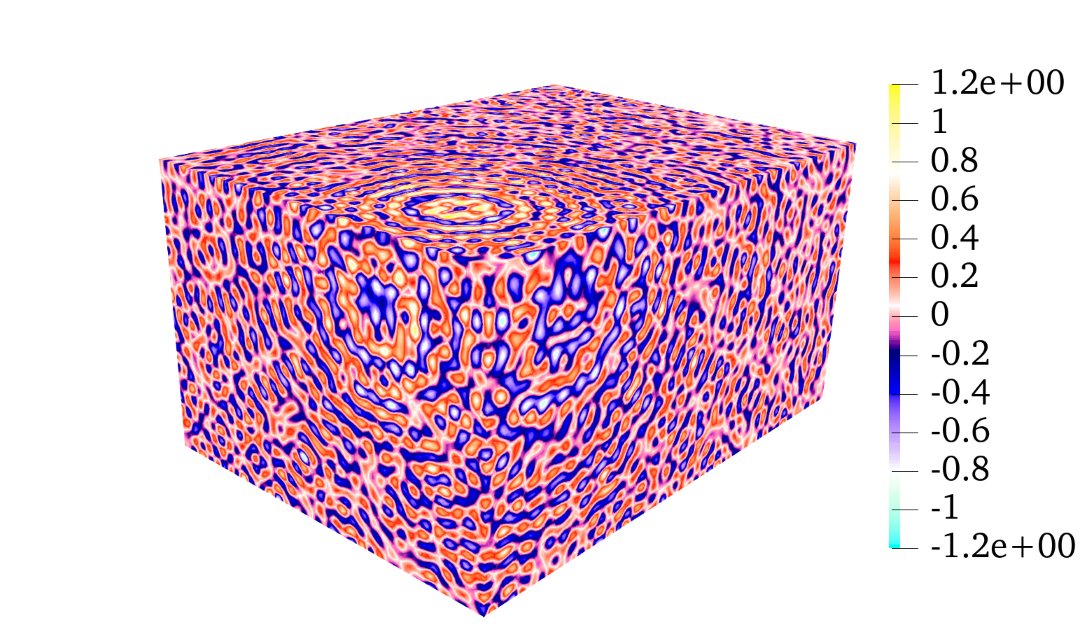

- 图2展示了在z=1.5 m平面上6000 Hz声场的实部、虚部及绝对误差分布。HergNet预测与解析解视觉上高度吻合。

- 定量结果:最大边界误差为0.16 Pa,最大相对误差约为10%。作者指出,该误差部分也源于解析解自身因牛顿法调整和级数截断带来的近似。

计算成本 表1详细列出了6000 Hz仿真的资源消耗:

指标 数值 时间 (s) 124 内存 (GB) 24.07 N_quad 18000 N_param 54322 N_train 131308 表1:HergNet在6000 Hz下的计算成本 频率扫描性能(100 Hz - 6000 Hz) 图3展示了接收点[0.7, 1.2, 1.5] m处的全频段性能:

- 声压级(SPL):在中高频段(>500 Hz)与解析解匹配良好,偏差远小于1 dB的听觉差异阈值(JND)。在低频段(<500 Hz),曲线出现更多波动,表明误差相对较大。

- 相位:解包裹后的相位在全频段与解析解完美匹配。

- 脉冲响应:通过IFFT得到的预测脉冲响应与解析解吻合良好,相对误差大部分低于10%。

与最强基线的差距: 论文未直接与FEM、BEM等传统数值方法或最新神经网络基线进行速度、精度的定量对比。文中定性指出,FEM在6 PPW下需超过3百万单元,成本远高于HergNet;经典PINNs在类似问题上训练时间更长(数分钟至数小时)且难以收敛。

关键消融实验: 论文未进行独立的消融实验。但通过观察低频性能下降,间接验证了其核心假设:平面波叠加表示在低频(波动行为弱)时逼近能力受限。

⚖️ 评分理由

- 学术质量:5.5/7:创新性明确,将Herglotz表示与NN结合实现物理硬约束,方法有扎实的数学和物理基础。实验上验证了其在中高频段的精度和效率优势。扣分点在于:1)对比基线较单一(仅解析解),缺乏与行业标准方法和SOTA神经方法的横向对比;2)对低频性能下降的理论解释虽合理,但未尝试改进,限制了方法的普适性。

- 选题价值:1.0/2:问题聚焦于中高频声场预测,在计算声学领域有明确需求。但该子领域相对垂直,与更广泛的音频AI任务(如语音处理、音频生成)关联度不高,潜在影响范围受限。

- 开源与复现加成:0.5/1:论文未提供代码链接。但提供了非常详细的实现信息:框架(JAX, Flax)、模型架构(CVNN, 层和神经元数)、优化器(Adam)、学习率、训练轮数、超参数设置逻辑(

N_quad,N_train与频率关系)、硬件环境。这为复现提供了极高指引,故给予部分加成。