📄 Hair Noise Analysis and Mitigation for Smart Glasses Audio Captures

#语音增强 #信号处理 #麦克风阵列 #音频分类 #数据集

✅ 7.5/10 | 前25% | #语音增强 | #信号处理 | #麦克风阵列 #音频分类

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Subrata Biswas(Worcester Polytechnic Institute, MA, USA 及 Meta Reality Labs, WA, USA)

- 通讯作者:未明确说明(根据邮箱排列,可能是Daniel Wong)

- 作者列表:

- Subrata Biswas(Worcester Polytechnic Institute 及 Meta Reality Labs)

- Daniel Wong(Meta Reality Labs)

- Bashima Islam(Worcester Polytechnic Institute)

- Sanjeel Parekh(Meta Reality Labs)

- Vladimir Tourbabin(Meta Reality Labs)

💡 毒舌点评

亮点:论文开创性地将“头发噪音”这个长期困扰智能眼镜用户却鲜少被学界系统研究的“房间里的大象”定义为明确的学术问题,其用户研究和数据集构建工作扎实且具有长远价值。短板:提出的NMF基准方法略显保守,虽然有效,但在深度学习大行其道的今天,缺乏与基于深度学习的降噪/分离方法(如论文引用但未深入对比的[6][7][8])的直接较量,使得“基准”的标杆高度受限。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:论文明确提供数据集获取地址:https://subrata132.github.io/hnm-project/。数据集名为HNM (Hair Noise Mitigation Dataset),包含多通道录音,已说明将在项目页面提供。

- Demo:未提及。

- 复现材料:论文提供了关键的超参数选择(如

ks=20,kn=5,delay=8)和实验设置(STFT参数、训练/测试划分比例),但未提供详细的配置文件或训练脚本。 - 论文中引用的开源项目:主要引用了NMF的原始论文和算法细节([4], [12], [13]),未提及使用其他特定的开源工具或模型库。

- 总结:论文的核心开源贡献是HNM数据集,这为后���研究提供了关键基础。但算法实现和模型本身未开源。

📌 核心摘要

- 问题:论文首次系统研究了头戴式设备(如AR/智能眼镜)特有的音频退化源——头发噪音,即头发摩擦设备框架和麦克风产生的噪声,该噪音会严重降低语音质量和用户体验。

- 方法核心:提出采用半监督非负矩阵分解(NMF)作为基准抑制方法。该方法在离线模式下利用头发噪音数据训练噪声字典矩阵(W_n),在推理时固定W_n,并与同时学习的语音字典矩阵(W_s)和激活矩阵(H_s, H_n)共同分解含噪信号的频谱,最后通过掩码恢复干净语音。

- 创新点:与之前工作相比,本文新在:(1) 首次提出并定义“头发噪音”这一问题;(2) 提供了首个包含多种头发噪音类型(玩头发、摇头)的多通道公开数据集(HNM);(3) 进行了系统的感知用户研究,量化了其主观烦恼度。

- 主要实验结果:

- 感知研究表明,当信噪比(SNR)低于5 dB时,头发噪音变得令人烦恼(评分≈2/5),高于15 dB时基本可接受(评分>4/5)。

- HNM数据集分析发现,头发噪音是非平稳的,且麦克风位置(如太阳穴 vs. 鼻梁)对其影响显著。

- 定量评估显示,半监督NMF(KL散度)在离线模式下,将自身语音的SI-SDR从10.62 dB提升至11.48 dB,外部语音从2.51 dB提升至3.17 dB。在线模式性能略有下降但接近离线水平。

- 主观听力测试证实,经NMF增强后的音频在低SNR条件下烦恼度显著降低(见图8)。

- 实际意义:为智能眼镜、助听器等可穿戴设备的音频采集系统设计、降噪算法开发和用户体验优化提供了重要的理论依据、基准数据集和基线方法。

- 主要局限性:(1) 所提出的基准算法(NMF)相对传统,未探索更先进的端到端深度学习方法的潜力;(2) 数据集规模(约10.5小时)和参与者数量(17人)虽属首次,但相对于通用语音数据集仍较小,可能影响泛化性研究;(3) 研究聚焦于语音信号,未处理音乐等其他音频类型。

🏗️ 模型架构

本文并未提出复杂的神经网络模型架构,其核心“模型”是经典的非负矩阵分解(NMF) 信号处理框架,并采用了半监督设置。

- 完整输入输出流程:输入为单通道含噪语音信号

x(t),经STFT变换为频谱图V。输出为增强后的干净语音时域信号S_hat(t),由估计的语音频谱WsHs经逆STFT得到。 - 主要组件与数据流:

- 预处理:对输入语音进行STFT,得到幅度谱

V。 - 半监督NMF分解:将

V近似分解为V ≈ WH,其中字典矩阵W被强制分为预训练的噪声部分Wn(固定)和待学习的语音部分Ws。激活矩阵H相应分为Hn和Hs。该分解通过最小化KL散度或IS散度等损失函数迭代更新Ws,Hs,Hn。 - 掩码增强:利用分解结果构建频谱掩码

Mask = (WsHs) / (WsHs + WnHn),并应用于含噪信号的STFT系数X,得到增强语音的频谱S_hat = Mask ⊙ X。 - 后处理:对

S_hat进行逆STFT,重构出时域增强语音信号。

- 预处理:对输入语音进行STFT,得到幅度谱

- 关键设计选择:半监督设置是核心,利用预先收集的头发噪音数据训练

Wn,为后续分离提供了强有力的先验知识,迫使模型将观测到的噪声成分映射到已知的噪音谱上,从而更有效地分离出语音。离线模式对整个信号进行分解;在线模式采用滑动窗(历史帧数由delay参数控制),实现低延迟处理。

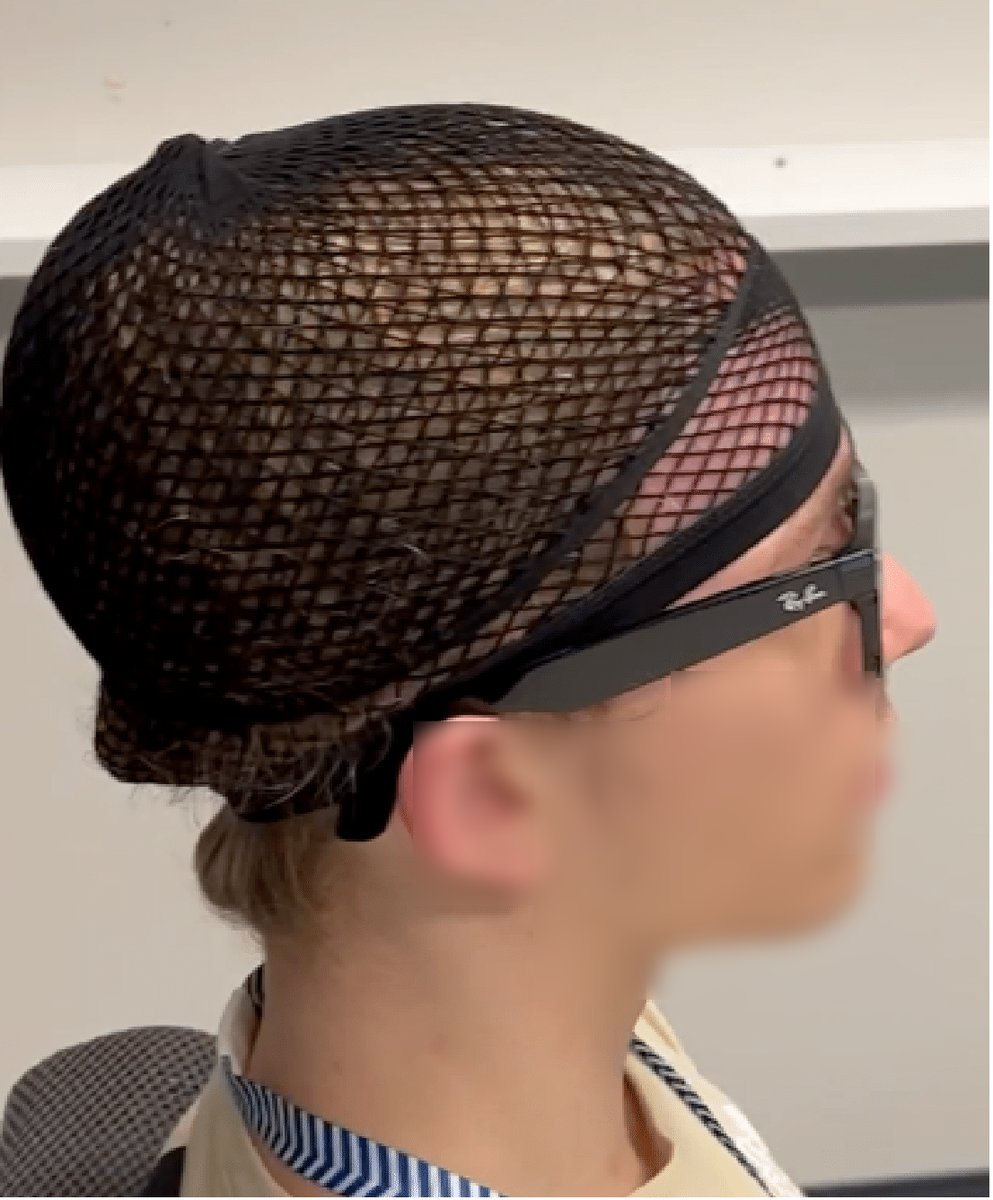

图3展示了数据采集分层协议,用于分别获取干净语音和头发噪音,这是构建半监督NMF训练数据(

图3展示了数据采集分层协议,用于分别获取干净语音和头发噪音,这是构建半监督NMF训练数据(Wn)的关键。

💡 核心创新点

- 问题定义与首次系统性研究:首次在学术层面明确、系统地研究了智能眼镜音频采集中的“头发噪音”问题,通过用户研究证实其不可忽视的感知影响,将其从“用户抱怨”提升为明确的科研课题。

- 首个专项数据集构建(HNM):创建并开源了第一个针对头发噪音的多通道数据集,涵盖不同噪音类型(玩头发、摇头)和场景(自身语音、外部语音),为后续研究提供了不可或缺的基准资源。

- 噪音特性深入分析:通过数据分析,揭示了头发噪音的非平稳性、方向依赖性(与麦克风位置强相关)以及两种典型噪音(持续性 vs. 脉冲性)的时频特征差异,为设计针对性抑制算法提供了关键洞见。

- 基准抑制方法的建立:将半监督NMF框架应用于该特定噪音的抑制,并提供了离线和在线两种模式的基准结果,证明了其有效性(尤其在低SNR下),并探索了超参数的影响,为未来更先进方法(如深度学习)的研究设立了对比基线。

🔬 细节详述

- 训练数据:使用论文发布的HNM数据集。头发噪音数据(

Wn的训练来源)分为“玩头发”和“摇头”两类,共102个60秒片段,来自17位参与者。语音数据包括自身语音和外部语音。数据在多种混响条件下采集。 - 损失函数:使用可分离散度

D(V|WH),具体比较了KL散度(强调大幅值)和Itakura-Saito (IS) 散度(尺度不变)。实验结果显示KL散度总体性能更优。 - 训练策略:对于

Wn的训练,使用乘性更新规则迭代优化。对于推理时的在线/离线分解,同样使用乘性更新,但迭代次数受限(离线200次,在线16次)以控制计算量。未提及学习率、优化器(非基于梯度下降)等深度学习常见训练策略。 - 关键超参数:

- 离线NMF:语音成分维度

ks = 20,噪声成分维度kn = 5。通过消融实验(图10a, 10b)确定。 - 在线NMF:STFT窗长1024点(约21ms),帧移32ms。滑动窗的“延迟”参数

delay = 8(即使用8个过去帧,约32ms*8=256ms历史)。迭代次数N=16。

- 离线NMF:语音成分维度

- 训练硬件:未说明。

- 推理细节:在线NMF采用滑动窗,每新来一帧进行一次分解和更新。STFT参数固定为1024点。

- 正则化技巧:NMF的非负约束本身是一种正则化。半监督设置中固定

Wn也可视为一种正则化。

📊 实验结果

论文评估了单通道(麦克风#3)增强性能,主要使用自身语音(Own-Voice) 和外部语音(External-Voice) 两个场景。

主要定量结果(表2):

| 信号条件 | 方法 | SI-SDR (dB) ↑ | SI-SIR (dB) ↑ |

|---|---|---|---|

| 离线 | 在线 | ||

| Own-Voice | Noisy | 10.62 | - |

| Spectral Subtraction | 6.46 | - | |

| NMF Itakura-Saito | 11.16 | 11.10 | |

| NMF Kullback-Leibler | 11.48 | 11.29 | |

| Ext-Voice | Noisy | 2.51 | - |

| Spectral Subtraction | -0.75 | - | |

| NMF Itakura-Saito | 2.43 | 1.99 | |

| NMF Kullback-Leibler | 3.17 | 3.01 |

关键结论:

- NMF有效:NMF(尤其是KL散度)在两种语音条件下均提升了客观指标(SI-SDR, SI-SIR),特别是SI-SIR的大幅提升表明其有效分离了头发噪音。

- 在线可行性:在线NMF性能接近离线模式(例如,Own-Voice KL散度下SI-SDR仅下降0.19 dB),证明其适用于实时设备。

- 低SNR增益更大:图7显示,NMF在低SNR(≤5 dB)条件下带来的SI-SDR增益远大于高SNR条件,这与感知研究结论(低SNR更烦人)相契合,凸显了方法在最需要场景下的价值。

- 主观改善:图8(主观评测)显示,增强后的音频在低SNR区间(<0 dB, 0-5 dB)的烦恼度评分从“烦人”(2-3)提升至“中性至不可感知”(3-5)。

- 泛化性:图9显示,留一法交叉验证表明该方法对未见过的用户也有稳定的性能,标准差较小。

消融实验(图10):

ks=20,kn=5是离线模型的最优组合。- 在线模型帧长32ms,

delay=8帧时性能最优。

⚖️ 评分理由

- 学术质量(5.5/7):论文工作完整,从问题发现、用户研究、数据集构建到算法验证,形成了一个扎实的研究闭环。实验设计合理,有定量/定性评估和消融分析。扣分点在于核心算法(NMF)创新性不足,属于成熟技术的特定场景应用,未能引领方法论的突破。

- 选题价值(1.5/2):选题精准且及时。随着AR/智能眼镜普及,音频采集质量成为关键体验短板,头发噪音是其中尚未被学术界正式攻克的典型问题。该研究填补了重要空白,为工业界和学术界提供了明确的研究方向和基础资源,应用潜力大。

- 开源与复现加成(0.5/1):承诺开源首个专项数据集(HNM)是重要贡献,极大地增强了研究的可信度和可扩展性,这是加0.5分的主要原因。未提供算法代码是主要扣分项。