📄 Generating Moving 3d Soundscapes with Latent Diffusion Models

#空间音频 #扩散模型 #音频生成 #数据增强 #多通道

✅ 7.5/10 | 前25% | #空间音频 | #扩散模型 | #音频生成 #数据增强

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Christian Templin (Stevens Institute of Technology, Hoboken, NJ, USA)

- 通讯作者:未说明

- 作者列表:Christian Templin(Stevens Institute of Technology)、Yanda Zhu(Hunan Normal University, Changsha, China)、Hao Wang(Stevens Institute of Technology)

💡 毒舌点评

亮点:首次将潜在扩散模型用于生成带动态声源轨迹控制的一阶Ambisonics音频,并构建了首个大规模带标注的动态空间音频数据集,填补了明确的空白。短板:虽然引入了参数化模型以提高空间精度,但对“动态”这一核心特性的评估主要停留在起止点的角度误差上,对声源在运动过程中轨迹的平滑度、连续性以及听感上的真实性缺乏更细致的量化分析和主观评估。

🔗 开源详情

- 代码:论文中未提及代码仓库链接。

- 模型权重:未提及公开预训练模型权重。

- 数据集:论文明确表示将发布新构建的包含超过100万样本的数据集(训练/验证/测试划分),可通过项目网站获取(https://intellisys.haow.us/spatial-audio-project/)。

- Demo:提供了在线演示网站(同上链接)。

- 复现材料:论文给出了较详细的训练数据构建方法、模型架构描述、损失函数公式和主要超参数(学习率、批大小、优化器、训练步数等),但未提供具体的训练代码、环境配置或最终检查点。

- 论文中���用的开源项目:Descript Audio Codec (DAC) [11]、T5编码器 [12]、CLAP模型 [13]、AuraLoss [14]、VGGish [15]。

📌 核心摘要

- 问题:现有文本到音频生成模型大多局限于单声道或立体声,无法生成完整的三维空间音频。少数能生成一阶Ambisonics(FOA)音频的模型仅支持静态声源,无法处理用户指定的动态声源轨迹,且缺乏相关训练数据集。

- 方法核心:提出SonicMotion框架,这是一个端到端的潜在扩散模型,专为生成FOA音频设计。其核心创新在于引入了两种条件化方式:1)描述式模型,仅使用文本提示;2)参数式模型,额外使用一个“状态矩阵”作为条件,该矩阵显式编码了声源在时间上的方位角和仰角轨迹。

- 新意:这是首个能够生成带有用户可控运动轨迹的FOA音频的潜在扩散模型。同时,为解决数据匮乏问题,作者构建了一个超过100万对模拟的FOA-文本数据对的新数据集,包含静态和动态声源及详细运动元数据。

- 主要结果:实验表明,SonicMotion在语义对齐(CLAP分数)和感知质量(FD, FAD)上与领先的文本到音频模型(如AudioLDM 2)相当。在空间精度上,参数式模型(SM-P)显著优于描述式模型(SM-D),其方位角误差降至13.17°,仰角误差降至4.01°,空间总角度误差降至14.32°,相比SM-D有约51%的整体性能提升。自编码器的重建保真度极高,空间角度误差仅为3.72°。

- 实际意义:为VR/AR、电影和音乐制作提供了自动化创建沉浸式动态声景的新工具,有望降低专业空间音频内容的制作门槛和成本。

- 主要局限性:模型基于模拟数据训练和评估,其在真实录音或复杂声学场景下的泛化能力有待验证。评估指标主要关注声源起止点的定位精度,对整个运动轨迹的保真度评估不足。此外,仅支持一阶Ambisonics,更高阶的空间分辨率有待探索。

🏗️ 模型架构

SonicMotion是一个端到端的框架,整体流程分为数据准备、自编码器训练和扩散模型生成三个主要阶段。

整体架构图:

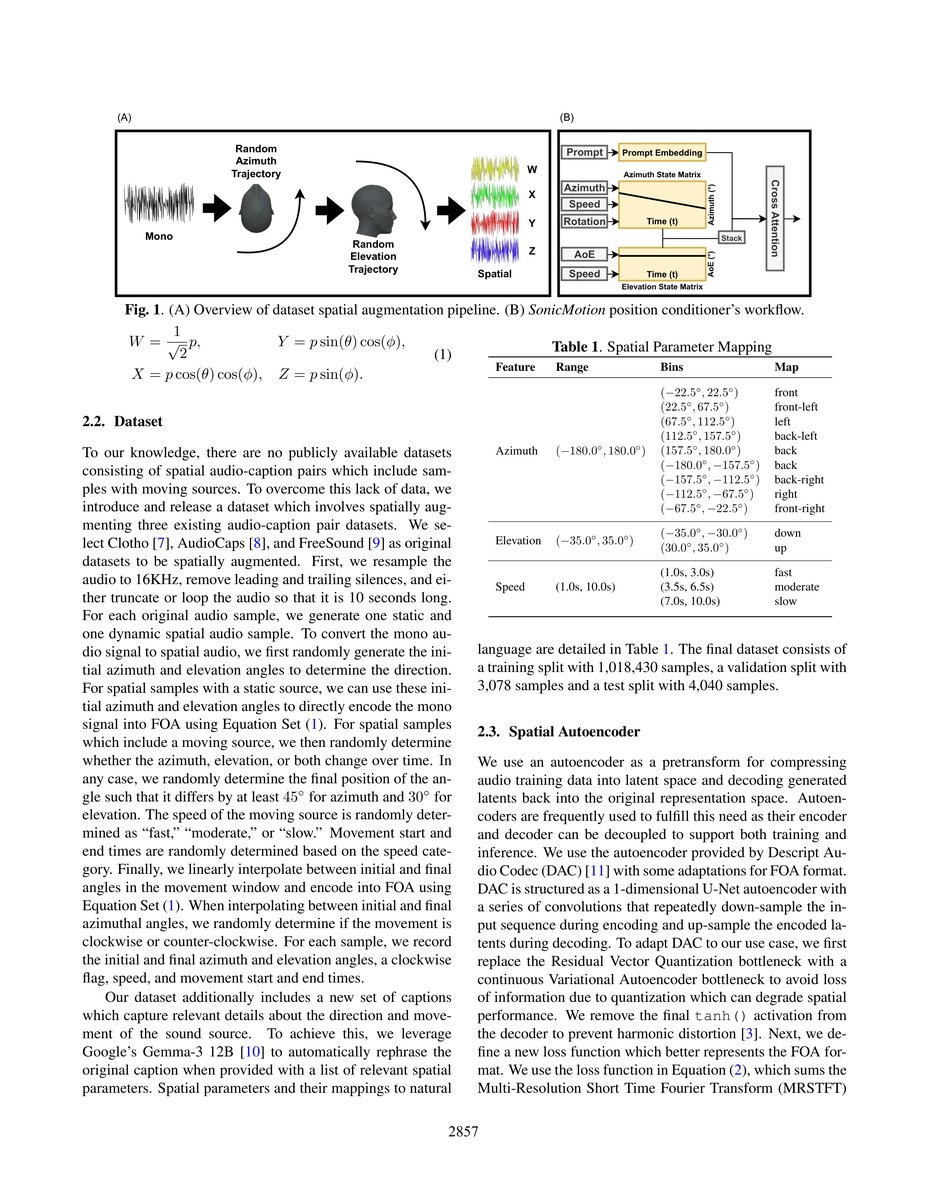

- 数据集构建(图1左侧):输入为单声道音频和文本提示。对每个样本,随机生成静态或动态的方位角/仰角轨迹。对于动态轨迹,线性插值生成随时间变化的角度,并编码为FOA格式(使用公式1)。同时,利用LLM(Gemma-3)将原始文本提示重写为包含空间信息的描述性文本。

- 空间自编码器(预训练组件):

- 功能:将4通道的FOA音频压缩到连续的潜在空间,并解码回音频。

- 结构:基于Descript Audio Codec(DAC)的1D U-Net架构,但进行关键修改:将残差向量量化(RVQ)瓶颈替换为连续变分自编码器(VAE)瓶颈,以避免量化带来的信息损失;移除解码器最后的tanh激活函数以防止谐波失真。

- 损失函数(公式2):综合了多分辨率短时傅里叶变换(MRSTFT)损失(应用于W,X,Y,Z四个通道)、KL散度损失、对抗损失和特征匹配损失。

- 数据流:FOA音频 -> 编码器 -> 潜在表示(压缩比128)-> 解码器 -> 重建的FOA音频。

- 扩散模型(核心生成模型):

- 类型:采用连续扩散变换器(DiT),基于Evans等人([3])的工作。

- 条件化(图1右侧):这��模型的核心创新。有两种变体:

- 描述式(SM-D):仅由预训练T5编码器生成的文本提示嵌入进行条件化。

- 参数式(SM-P):除了文本嵌入外,还由一个位置状态矩阵进行条件化。该矩阵通过以下方式构建:给定初始/最终方位角、仰角、速度(快/中/慢)和运动时长,利用公式(3)计算任意时刻t的期望角度μ(t)。然后构建一个零矩阵,在对应时间t的位置Bin处设为1(公式4)。分别构建方位角和仰角的矩阵,并拼接。最终,该矩阵通过一个4层4头的交叉注意力模块与文本嵌入融合。此外,运动的起始时间和总时长也作为额外的交叉注意力条件。

- 训练目标:最小化给定条件和时间步下,预测的潜在表示与真实潜在表示之间的均方误差(MSE)。

- 数据流:文本嵌入(+位置状态矩阵)作为条件 -> 扩散Transformer在潜在空间去噪 -> 生成的潜在表示。

- 解码:将扩散模型生成的潜在表示输入到训练好的自编码器解码器中,得到最终的4通道FOA音频输出。

关键设计选择与动机:

- 使用FOA:因其是广泛应用的空间音频格式,但现有生成模型支持有限。

- 连续VAE瓶颈:避免量化噪声,这对于保持精细的空间信息至关重要。

- 状态矩阵与交叉注意力:提供对声源轨迹的显式、时序化的精细控制,弥补了纯文本描述的模糊性(例如,“前面”可能对应±22.5°范围)。

💡 核心创新点

- 首个生成动态轨迹FOA音频的扩散模型:区别于以往仅支持静态声源或仅支持立体声轨迹的模型,SonicMotion首次实现了对一阶Ambisonics格式音频中声源三维运动轨迹的生成与控制。

- 创新的参数化条件化机制(状态矩阵):设计了一个将时空轨迹信息编码为矩阵并通过交叉注意力融合到生成模型中的方法。这为模型提供了高精度的、用户可控的运动先验,有效解决了自然语言描述空间运动的歧义性问题,实验显示其空间精度显著优于纯文本条件。

- 大规模动态空间音频数据集的构建与发布:针对领域内缺乏动态空间音频-文本配对数据的空白,论文通过对现有音频-文本数据集(Clotho, AudioCaps, FreeSound)进行空间增强,构建并发布了首个超过百万样本的、包含静态与动态声源及详细运动元数据的FOA训练集,为该领域后续研究奠定了基础。

- 双模式模型设计:同时提供了“描述式”和“参数式”两种模型变体,分别适用于快速基于文本生成的场景和需要精确轨迹控制的场景,增加了框架的灵活性和适用性。

🔬 细节详述

- 训练数据:新构建的数据集,包含1,018,430个训练样本。原始数据来自Clotho、AudioCaps、FreeSound,重采样至16kHz,截取或循环为10秒长。对每个原始音频,生成一个静态和一个动态空间样本。动态样本中,方位角/仰角变化至少45°/30°,速度分为快(1-3s)、中(3.5-6.5s)、慢(7-10s)三档。文本提示由Gemma-3 12B模型根据空间参数自动重写。

- 损失函数:

- 自编码器损失(公式2):

Lcodec = (λ_mrstft/4) (L_mrstft_W + L_mrstft_X + L_mrstft_Y + L_mrstft_Z) + β_kl L_kl + β_adv L_adv + β_fm L_fm。其中λ通过感知更新,β为常数。 - 扩散模型损失:目标潜在表示与预测潜在表示之间的均方误差(MSE)。

- 自编码器损失(公式2):

- 训练策略:

- 自编码器:在4×H100 GPU上,使用随机裁剪的2秒片段训练400K步。批大小128。生成器学习率1e-4,判别器2e-4。均使用AdamW优化器(动量0.8/0.99,权重衰减1e-3)。

- 扩散模型:在4×H100 GPU上,使用完整10秒音频训练100K步。批大小1024。冻结自编码器和T5编码器权重。学习率1e-4(状态矩阵交叉注意力模块为2e-4)。使用逆学习率调度器(逆gamma 10^6,幂0.5,预热0.99)。描述式模型仅用空间文本训练;参数式模型先用非空间文本训练50k步,再用空间文本训练50k步。

- 关键超参数:自编码器下采样比2048,压缩因子128。扩散模型条件化标记维度768。状态矩阵的位置Bin数量由角度范围决定(例如方位角每22.5°一个Bin,共16个)。交叉注意力为4层4头。

- 训练硬件:自编码器和扩散模型均使用4×NVIDIA H100 GPU集群。

- 推理细节:论文未详细说明解码策略(如采样步数、调度器类型)。

- 正则化/稳定训练技巧:自编码器使用感知更新λ的损失权重;扩散模型使用逆学习率调度器和预热。

📊 实验结果

主要评估分为两部分:自编码器重建质量和端到端模型生成质量。

表2:与现有模型在文本到音频生成任务上的对比

| 模型 | CLAP↑ | FD↓ | FAD↓ | KL↓ | L1(θ)↓ | L1(ϕ)↓ | ∆angle↓ |

|---|---|---|---|---|---|---|---|

| AudioLDM 2 | 0.22 | 0.55 | 1.78 | 0.27 | - | - | - |

| SAO (Stable Audio Open) | 0.19 | 1.18 | 7.90 | 0.59 | - | - | - |

| SM-D (SonicMotion-描述式) | 0.23 | 0.52 | 2.97 | 0.26 | 21.20° | 16.04° | 29.22° |

| SM-P (SonicMotion-参数式) | 0.23 | 0.57 | 3.00 | 0.28 | 13.17° | 4.01° | 14.32° |

| 结论:SonicMotion的两个变体在语义对齐(CLAP)和分布相似度(FD, KL)上与专为单声道/立体声设计的SOTA模型(AudioLDM 2)持平或略优,表明其在不牺牲音频质量的前提下成功扩展到了空间音频领域。参数式模型(SM-P)在空间精度指标(L1角度误差)上远优于描述式模型(SM-D)和基线模型(基线无空间指标),证明了显式轨迹条件的有效性。 |

表3:自编码器评估结果

| 模型 | STFT↓ | MEL↓ | L1(θ)↓ | L1(ϕ)↓ | ∆angle↓ |

|---|---|---|---|---|---|

| SonicMotion (自编码器) | 1.35 | 0.95 | 3.32° | 1.43° | 3.72° |

| 结论:自编码器重建误差极小,空间角度误差(∆angle)仅3.72°,证明其能近乎完美地保留空间信息,为扩散模型提供了高质量的训练目标。 |

消融与分析:

- 参数式模型 vs. 描述式模型:SM-P相比SM-D,方位角误差降低38%(21.2°->13.17°),仰角误差降低75%(16.04°->4.01°),总角度误差降低51%(29.22°->14.32°)。论文指出,这是因为自然语言描述(如“front”)本身存在歧义,而参数化条件提供了精确锚点。

- 与SOTA对比的局限:对比主要集中在语义和感知质量指标(W通道),因为SOTA模型不输出FOA。空间精度是本模型独有的优势。

⚖️ 评分理由

- 学术质量(5.5/7):论文提出了一个清晰且具有实际意义的问题,并设计了合理的解决方案。技术实现上,对现有组件(DiT, DAC, T5)进行了有效的适配和改进(状态矩阵条件化)。构建大规模数据集是重要贡献。实验充分,与SOTA进行了公平���比。主要不足在于对“动态生成”这一核心主张的评估深度不够,缺乏轨迹跟踪连续性、多声源交互等更复杂的评估。

- 选题价值(1.5/2):选题精准对接VR/AR等沉浸式媒体的核心需求,是空间音频内容生成领域的一个关键缺口。虽然领域相对垂直,但论文的工作提供了重要的基础设施(数据集)和方法范式,对后续研究有推动作用。

- 开源与复现加成(0.5/1):承诺公开百万级数据集(核心贡献)和提供演示网站是重要的加分项。但论文未提及开源代码和预训练模型权重,使得完全复现存在门槛。训练细节虽详尽但未提供配置文件或脚本。因此给予中等正向加成。