📄 Gen-SER: When the Generative Model Meets Speech Emotion Recognition

#语音情感识别 #流匹配 #预训练 #生成模型

✅ 6.5/10 | 前50% | #语音情感识别 | #流匹配 | #预训练 #生成模型

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 -0.5 | 置信度 中

👥 作者与机构

- 第一作者:Taihui Wang(腾讯多模态模型部门、腾讯AI Lab)

- 通讯作者:未说明

- 作者列表:Taihui Wang(腾讯多模态模型部门、腾讯AI Lab),Jinzheng Zhao(腾讯多模态模型部门、腾讯AI Lab),Rilin Chen(腾讯多模态模型部门、腾讯AI Lab),Tong Lei(腾讯AI Lab),Wenwu Wang(萨里大学视觉、语音和信号处理中心),Dong Yu(腾讯AI Lab)

💡 毒舌点评

亮点在于创造性地将分类任务转化为生成模型的分布传输问题,并设计了“正弦分类编码”来规避传统自编码器的缺陷。然而,论文的实验说服力严重不足,不仅未与文中明确提出的最强基线(SenseVoice-L)进行公平、深入的对比分析,而且只在有限的任务上验证了有效性,缺少对核心设计选择的必要消融实验,让人对结论的普适性打上问号。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:使用了多个公开英文情感语音数据集(如MELD, RAVDESS等)和一个内部数据集。公开数据集可自行获取,内部数据集未公开。

- Demo:未提及。

- 复现材料:论文提供了主要的超参数(学习率、batch size、训练步数、模型结构尺寸),但缺失关键生成模型的调度参数(k, σ)、优化器类型、硬件信息等,不足以完成复现。

- 引用的开源项目:依赖HuBERT(chinese-hubert-large模型)。

📌 核心摘要

- 问题:本文旨在为语音情感识别提供一种区别于传统分类器和大语言模型的新范式。

- 方法核心:将SER重新定义为一个“分布传输”问题。具体为:使用预训练HuBERT提取语音特征(初始分布),用提出的“正弦分类编码”将离散情感标签映射为连续的目标嵌入向量(终端分布),然后训练一个基于“目标匹配”的生成模型,学习将初始分布传输到终端分布。

- 创新点:与已有方法相比,1) 首次将生成模型用于SER的分布传输而非密度估计或条件生成;2) 提出无需训练的“正弦分类编码”方法,将标签映射为正交连续向量;3) 采用具有logistic均值和桥方差调度的目标匹配模型,提升生成效率与稳定性。

- 主要实验结果:在MELD测试集上,本方法(Ours)达到56.5%的准确率,优于多数基于分类和LLM的基线(如Qwen-audio 55.7%),但低于SenseVoice-L(63.1%)。在性别分类任务(Air-Bench)上,本方法(90.5%)超越了所有对比基线。图表显示生成向量随时间步从语音特征平滑变化到目标向量。

- 实际意义:为语音理解任务(如SER)提供了一种基于生成模型的新思路,其方法可能扩展到其他分类任务。

- 主要局限性:1) 实验对比不充分,未深入分析与最强基线的差距原因;2) 验证任务和数据集有限;3) 缺少对正弦编码、生成调度等核心组件的消融研究;4) 论文未开源代码和模型,复现困难。

🏗️ 模型架构

模型架构(Gen-SER)包含特征提取、目标生成和生成传输三个核心部分,整体流程如下图所示:

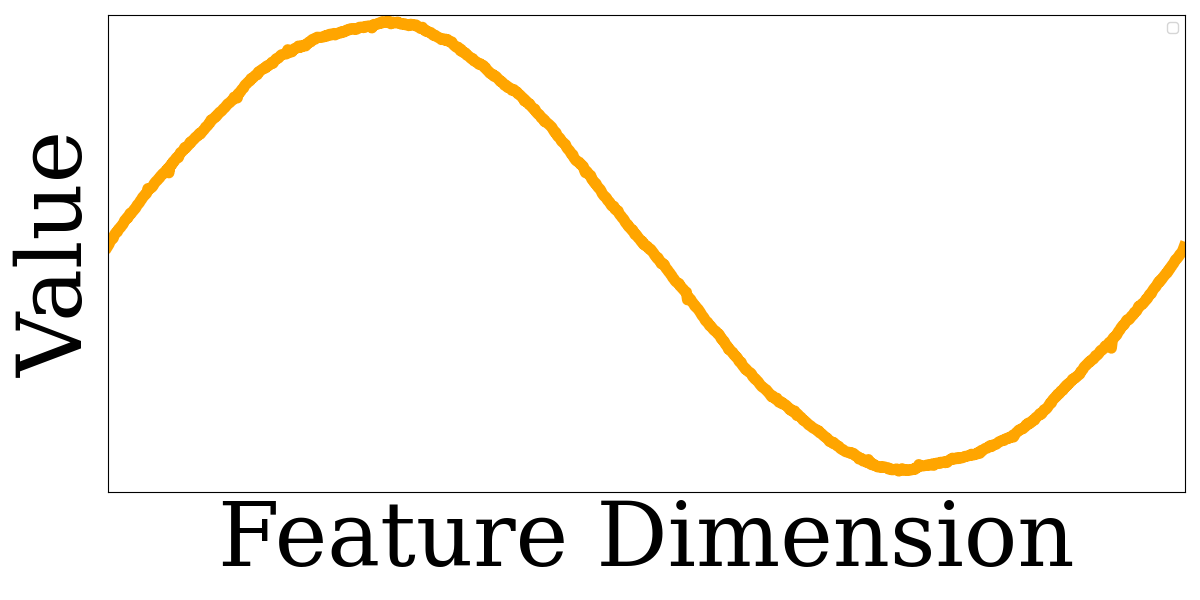

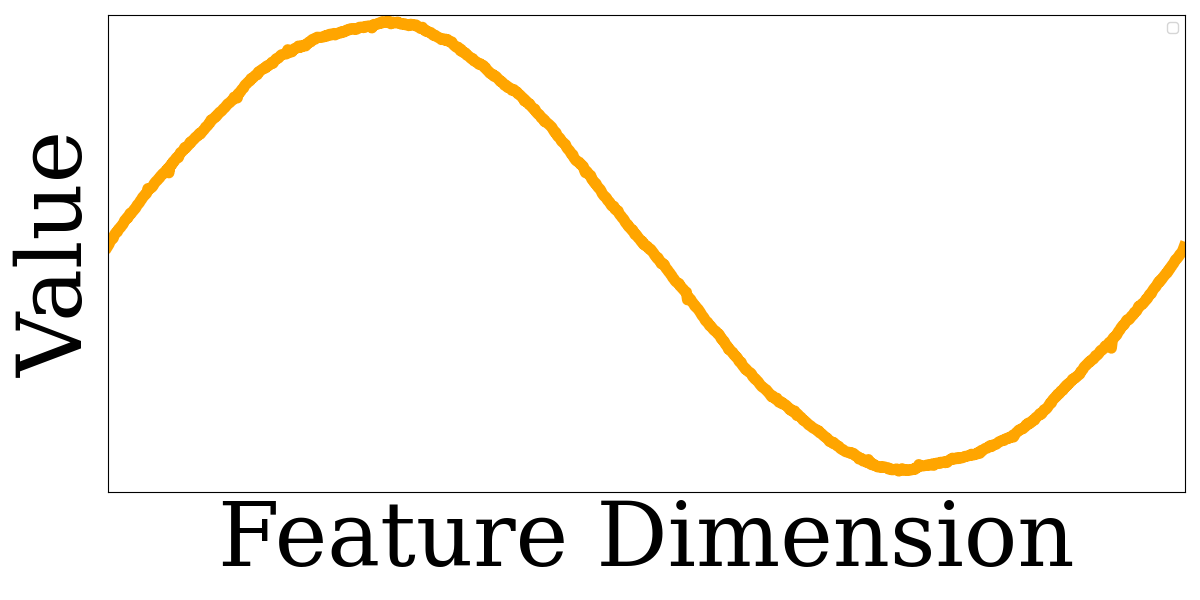

图1展示了不同时间步(t)下,从初始语音特征向量x1((a))逐步演变为目标类别向量x0((f))的平均过程,验证了分布传输的有效性。

图1展示了不同时间步(t)下,从初始语音特征向量x1((a))逐步演变为目标类别向量x0((f))的平均过程,验证了分布传输的有效性。

- 输入与特征提取:输入语音信号s,通过预训练的HuBERT模型提取特征。具体地,取最后一层的输出经时间轴平均后作为初始数据样本x1(代表语音的情感分布),取前面若干层的输出经平均后作为条件变量Xc。

- 目标生成(正弦分类编码):对于给定的类别标签b,计算其整数索引ib。目标嵌入向量x0(b)通过以下正弦函数生成:

x0(b) = sin(2πl / L * (ib + 1))其中L是向量长度,l是[0, L-1]的整数向量。此设计确保不同类别的目标向量在连续空间中是正交且连续的。 - 生成模型(目标匹配网络):核心是一个神经网络xθ(xt, Xc, t),其目标是预测目标向量x0,而非估计向量场。网络结构分为三阶段:

- 阶段一(条件融合):将条件变量Xc通过可学习参数加权求和,得到融合条件xc。

- 阶段二(输入拼接):将当前时刻的扰动向量xt与xc拼接,再通过一个线性层投影到L维空间,完成信息融合。

- 阶段三(目标预测):使用一个4层、1024维度、16头的Transformer结构,通过自适应RMS-Norm注入时间步信息,最终输出对x0的预测。

- 训练与推理:

- 训练:目标是最小化预测目标与真实目标x0的欧氏距离(目标匹配损失)。通过ODE定义分布路径,其均值μt遵循logistic调度(公式6),方差σt遵循桥调度(公式7)。在时间步t采样得到扰动信号xt。

- 推理(分布传输):从语音特征x1(t=T)开始,通过Euler ODE求解器(公式10)迭代N步,估计出终端向量x̂0。最终分类通过计算x̂0与所有类别目标向量x0(b)的余弦相似度,选择相似度最高的类别作为预测结果(公式12)。

💡 核心创新点

- 将分类问题重构为分布传输问题:

- 之前局限:传统方法(分类器或LLM)将情感识别视为一个端到端的映射或序列生成问题。

- 如何起作用:将语音特征视为来自“情感分布”的样本,将类别标签映射为“目标分布”,用生成模型学习两个分布间的转换。

- 收益:提供了一种全新的视角来理解和解决分类任务,可能更本质地捕捉数据分布特性。

- 提出正弦分类编码:

- 之前局限:使用自编码器(如论文引用[12])将离散标签映射到连续空间,但需要训练多个自编码器,且存在重建误差。

- 如何起作用:通过解析公式,直接生成类别相关、相互正交的连续向量,无需训练。

- 收益:避免了标签编码器的训练难题,保证了目标向量的规范性,简化了流程。

- 采用目标匹配生成模型:

- 之前局限:扩散模型常用于条件生成或分类(如引用[11]),但需估计向量场或分数函数,训练和采样可能不稳定或低效。

- 如何起作用:模型直接预测目标向量x0(而非向量场),并采用更稳定的logistic均值和桥方差调度。

- 收益:论文称其比基于分数匹配或流匹配的模型更稳定、高效,实验显示单步推理已能达到接近最终的准确率(表3)。

🔬 细节详述

- 训练数据:英文语音情感语料库,包括crema-d、emodb、TESS、savee、RAVDESS、MELD以及一个内部数据集,总计超过52k样本,48小时。

- 损失函数:目标匹配损失

Ltm(θ) = E[||xθ(xt, Xc, t) - x0||^2],即预测向量与真实目标向量的均方误差。 - 训练策略:

- 学习率:5e-4

- Batch Size:128

- 训练步数:400k步

- 优化器:未说明(推测为Adam或AdamW)

- Warmup/调度策略:未说明

- 关键超参数:

- 特征提取:chinese-hubert-large(24层Transformer)。

- 目标预测网络:Transformer,4层,隐藏维度1024,16头注意力。总参数量71.4M。

- 生成路径:logistic均值调度的k值、桥方差调度的σ值,均未说明具体数值。

- 推理步数N:实验测试了1, 2, 4, 10, 20步(表3)。

- 训练硬件:未说明。

- 推理细节:使用Euler ODE求解器。分类方法为计算余弦相似度。未说明是否涉及流式处理。

- 正则化技巧:未说明。

📊 实验结果

表1:MELD测试集语音情感识别准确率

| 模型 | 模型类型 | 准确率(%) |

|---|---|---|

| WavLM + CLS | 分类 | 50.6 |

| Hubert + CLS | 分类 | 53.4 |

| emotion2vec | 分类 | 51.9 |

| Qwen-audio | LLM | 55.7 |

| Qwen2-audio | LLM | 55.3 |

| OSUM | LLM | 53.4 |

| SenseVoice-L | LLM | 63.1 |

| Ours | Diffusion | 56.5 |

结论:本方法优于大部分对比基线,但显著低于SenseVoice-L。论文未解释此差距原因(如训练数据规模差异)。

表2:Air-Bench性别分类准确率

| 模型 | 类型 | 准确率(%) |

|---|---|---|

| Fbank + CLS | 分类 | 86.6 |

| WavLM + CLS | 分类 | 87.5 |

| Qwen2-audio | LLM | 79.3 |

| Qwen-audio Turbo | LLM | 82.5 |

| Soundwave | LLM | 90.3 |

| Ours | Diffusion | 90.5 |

结论:本方法在性别分类任务上取得了最佳性能。

表3:不同推理步数(N)对MELD准确率的影响

| N | 1 | 2 | 4 | 10 | 20 |

|---|---|---|---|---|---|

| 准确率 | 0.5613 | 0.5617 | 0.5625 | 0.5628 | 0.5644 |

结论:推理步数增加能稳步提升准确率,但即使单步推理(N=1)也能达到0.5613,与最终结果0.5644相差无几,说明模型生成效率高。

图1分析:

如图1所示,从(a)初始语音特征x1,经过(b) t=0.75, (c) t=0.5, (d) t=0.25, (e) t=0.03等中间时刻的估计向量,最终平滑过渡到(f)目标类别向量x0。这直观展示了模型学习的分布传输轨迹是连续且符合预期的。

如图1所示,从(a)初始语音特征x1,经过(b) t=0.75, (c) t=0.5, (d) t=0.25, (e) t=0.03等中间时刻的估计向量,最终平滑过渡到(f)目标类别向量x0。这直观展示了模型学习的分布传输轨迹是连续且符合预期的。

⚖️ 评分理由

- 学术质量:5.5/7:创新性明确(新问题表述+新编码方法+新生成范式)。技术实现逻辑自洽。但实验部分存在严重缺陷:1) 在关键的SER任务上未与最强基线SenseVoice-L进行充分对比和归因分析;2) 消融实验缺失,未验证正弦编码、logistic调度等模块的贡献;3) 仅在两个任务上验证,泛化性证据薄弱。这些不足显著降低了论文的说服力。

- 选题价值:1.5/2:语音情感识别是稳定的研究方向,使用生成模型解决分类问题是一个有趣且有潜力的视角。但该问题本身并非最前沿(相比多模态大模型对通用语音理解),且本文方法的相对优势不明显。

- 开源与复现加成:-0.5/1:论文未提供代码、模型权重、训练数据(引用的公开数据集外)以及完整的超参数配置(如logistic调度的k值,σ值等)。这使得其他研究者几乎无法复现其工作,严重扣分。