📄 FlowSE-GRPO: Training Flow Matching Speech Enhancement via Online Reinforcement Learning

#语音增强 #强化学习 #流匹配 #迁移学习 #基准测试

✅ 7.5/10 | 前25% | #语音增强 | #强化学习 | #流匹配 #迁移学习

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 中

👥 作者与机构

- 第一作者:未说明(论文作者列表按顺序给出,但未明确标注第一作者)

- 通讯作者:未说明(论文中未提供邮箱或通讯作者标识)

- 作者列表:Haoxu Wang, Biao Tian, Yiheng Jiang, Zexu Pan, Shengkui Zhao, Bin Ma, Daren Chen, Xiangang Li(均隶属于 Tongyi Lab, Alibaba Group, China)

💡 毒舌点评

亮点:作为将在线强化学习(GRPO)成功应用于流匹配语音增强的开创性工作,其提出的多指标奖励优化策略巧妙地缓解了“奖励黑客”问题,且仅需少量微调步数(5k步)即获得显著提升。短板:尽管技术细节详尽,但论文对代码和模型开源的完全沉默,大大削弱了其结果的可验证性和社区快速跟进的可能性;同时,多指标权重需精细调优也暴露了当前策略的脆弱性。

🔗 开源详情

根据论文内容,总结开源情况如下:

- 代码:论文中未提及任何代码仓库链接或开源计划。

- 模型权重:未提及是否公开预训练或后训练的模型权重。

- 数据集:使用了多个公开数据集(DNS2020, LibriTTS, WHAM!等),但论文未提供整合后的训练集获取方式。

- Demo:未提及在线演示。

- 复现材料:论文提供了非常详细的训练配置、模型结构、超参数设置(如DiT维度、层数、LoRA参数、学习率、窗口训练设置等)以及消融实验设置,这些信息对复现至关重要。

- 论文中引用的开源项目:明确提到了使用预训练的HiFi-GAN声码器(来自CosyVoice2)和DiT架构。

📌 核心摘要

本文旨在解决将在线强化学习(RL)有效应用于生成式语音增强(SE)模型后训练的难题。其方法核心是首次将组相对策略优化(GRPO)成功集成到基于流匹配(Flow Matching)的语音增强框架中,通过将确定性常微分方程(ODE)采样转换为随机微分方程(SDE)采样来引入RL所需的随机性,并设计了针对连续语音信号的损失函数。与以往使用离线方法(如DPO)或仅应用于离散Token的方法相比,本文创新性地实现了在线、无需修改原始架构的GRPO训练。主要实验结果表明,在DNS2020测试集上,与基线模型相比,所提多指标优化模型在无回声测试集上将整体质量(OVRL)从3.373提升至3.549(+0.176),说话人相似度从88.88%提升至90.43%,并显著减少了奖励黑客现象。该研究的实际意义在于为生成式音频模型的后训练提供了高效、实用的在线RL对齐方案。主要局限性在于多指标权重需人工调整,且论文未提供开源代码。

关键实验结果(DNS2020测试集):

| 数据 | 模型 | RL | SIG | BAK | OVRL | SPK[%] | SBS[%] |

|---|---|---|---|---|---|---|---|

| No Reverb | FlowSE (FM) | ✗ | 3.598 | 4.172 | 3.373 | 88.88 | 86.35 |

| FlowSE-GRPO (Ours) | GRPO | 3.753 | 4.248 | 3.549 | 90.43 | 86.72 | |

| With Reverb | FlowSE (FM) | ✗ | 3.511 | 4.105 | 3.254 | 73.72 | 73.62 |

| FlowSE-GRPO (Ours) | GRPO | 3.740 | 4.251 | 3.530 | 77.75 | 75.89 | |

| Real Recording | FlowSE (FM) | ✗ | 3.397 | 4.035 | 3.115 | - | - |

| FlowSE-GRPO (Ours) | GRPO | 3.604 | 4.161 | 3.356 | - | - |

(注:SPK代表Speaker Similarity,SBS代表SpeechBERTScore)

🏗️ 模型架构

论文提出的FlowSE-GRPO系统包含两个核心部分:Flow-Matching SE模型与GRPO后训练流程。

- Flow-Matching SE模型:

- 整体流程:输入带噪梅尔谱图(c),经过流匹配模型估计出干净梅尔谱图(x1),再通过预训练的声码器(HiFi-GAN)转换为最终波形。

- 核心组件:

- 流匹配骨干网络:采用DiT(Diffusion Transformer)架构,预测将标准高斯分布(x0)传输至干净梅尔谱分布(x1)的速度场(v)。模型输入是噪声状态(xt = (1-t)x0 + t x1)和带噪梅尔(c)在通道维度的拼接,输出为预测的速度场。训练目标是让预测速度vθ逼近真实速度v = x1 - x0(公式1)。

- 声码器:使用预训练的HiFi-GAN,负责将估计的干净梅尔谱转换为波形。该部分在GRPO后训练阶段冻结。

- 设计动机:流匹配方法在生成质量和效率上具有优势,但其确定性解码过程不适用于在线RL。GRPO的引入旨在通过引入随机性来优化后训练过程。

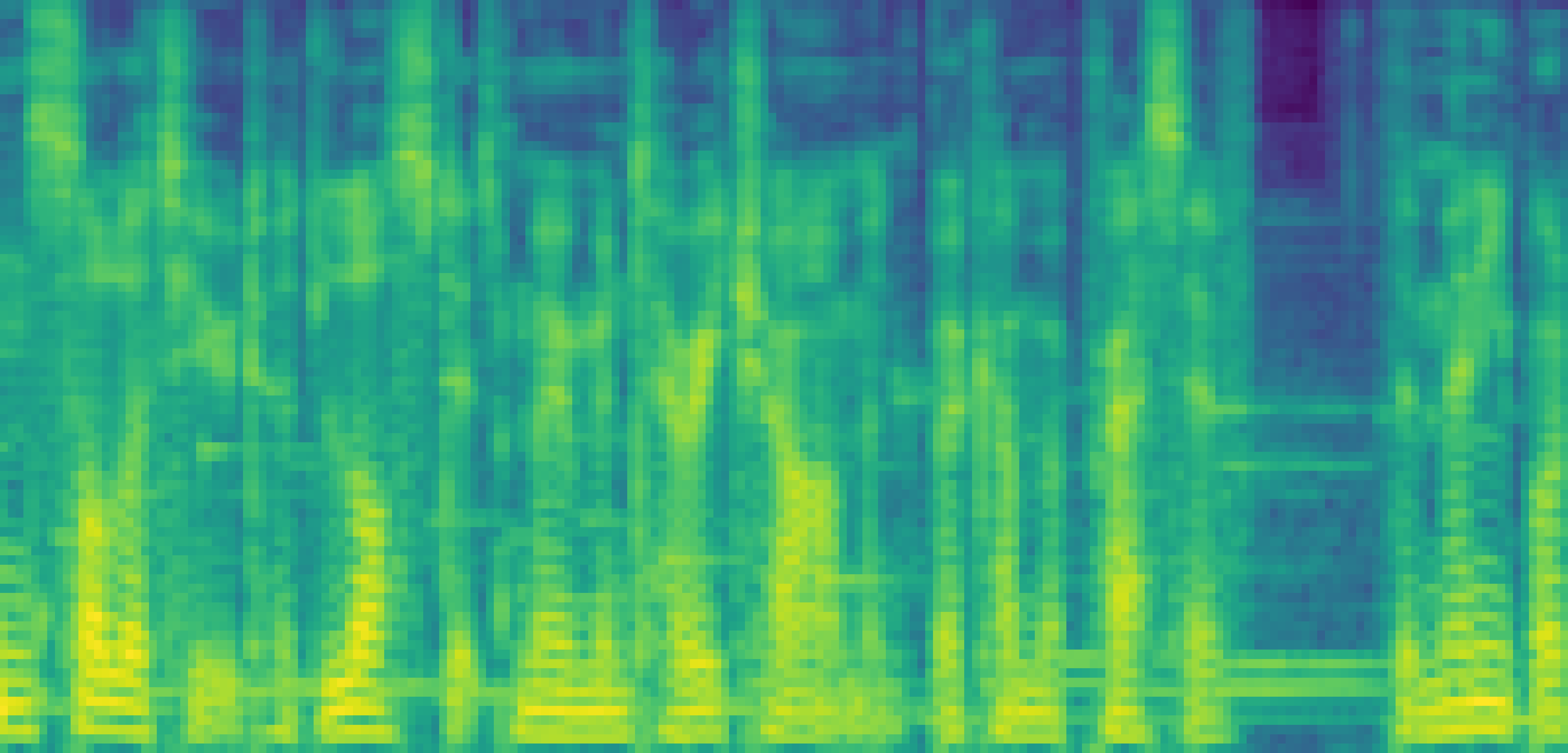

图1(a) 展示了Flow-Matching SE模型的结构。带噪梅尔谱c与噪声状态xt被输入DiT模块,预测出流(速度场),进而更新状态,最终得到估计的干净梅尔谱,再通过HiFi-GAN转换为波形。

图1(a) 展示了Flow-Matching SE模型的结构。带噪梅尔谱c与噪声状态xt被输入DiT模块,预测出流(速度场),进而更新状态,最终得到估计的干净梅尔谱,再通过HiFi-GAN转换为波形。

- GRPO后训练流程:

- 马尔可夫决策过程(MDP)建模:将解码过程(时间t从0到1)建模为MDP。状态s_t = (c, t, x_t),动作a_t = x_{t-1}(由模型预测的速度生成)。奖励仅在最终解码后(t=0时)给出,基于增强后的波形计算。 ODE到SDE的转换:为在线RL引入随机性,将原始确定性ODE采样(公式2)转换为等效的SDE采样(公式3-5)。SDE采样通过添加噪声(σ_t)实现,其中σ_t = a sqrt((1-t)/t),超参数a控制随机性大小。为加速训练,采用窗口训练策略,仅在早期去噪步骤(t∈S)应用SDE采样,其余步骤使用确定性ODE。

- GRPO优化:对于每个带噪提示c,生成G=10个候选增强语音样本,并��算各自的奖励。优势(Â_i)通过组内奖励的相对排名计算(公式8)。策略通过最大化一个带有裁剪和KL散度惩罚的GRPO目标函数(公式9)进行更新。

图1(b) 展示了GRPO后训练流程。对于一个带噪提示c,模型采样生成一组G个候选增强语音及其轨迹,由奖励模型打分后,通过组内相对优势计算和策略优化来更新模型参数。

图1(b) 展示了GRPO后训练流程。对于一个带噪提示c,模型采样生成一组G个候选增强语音及其轨迹,由奖励模型打分后,通过组内相对优势计算和策略优化来更新模型参数。

💡 核心创新点

- 首次在流匹配语音增强中集成在线GRPO:这是核心创新。不同于之前仅在离散Token模型或使用离线RL(DPO)的工作,本文成功将在线、策略梯度型的GRPO应用于连续、时序的流匹配SE模型,实现了更高效的后训练对齐。

- 提出多指标奖励优化策略:针对在线RL容易导致的“奖励黑客”问题(即过度优化单一指标而损害其他指标),本文创新性地将DNSMOS、说话人相似度和SpeechBERTScore三个指标归一化并加权组合作为最终奖励(R)。实验证明,该策略能有效缓解奖励黑客,在多个指标上取得平衡提升。

- 适应性改进与训练效率提升:

- 调整Flow-GRPO的时间方向(t: 0→1)以适配语音增强任务。

- 采用窗口训练(Window Training)策略:仅在去噪过程的早期步骤应用SDE采样和GRPO优化。实验表明,这比在所有步骤上训练(Non-Fast)能更快地提升奖励指标,加速收敛。

🔬 细节详述

- 训练数据:

- 预训练数据:包含多种干净语音(DNS2020-clean, LibriTTS-960, VCTK等)和噪声(DNS2020-noise, WHAM!, DEMAND等),以及混响数据(OpenSLR26/28)。

- 后训练(GRPO)数据:仅使用LibriTTS-960作为干净语音,噪声来源同上。评估使用DNS2020挑战赛提供的测试集(No Reverb, With Reverb, Real Recording)。

- 损失函数:

- 预训练:流匹配损失(MSE loss,公式1)。

- 后训练:GRPO目标函数(公式9),包含策略损失、裁剪机制和KL散度惩罚(权重β)。奖励R由归一化的多指标加权和构成(公式未完全显示,但文本描述了结构)。

- 训练策略:

- 预训练:初始学习率1e-4,10k步warmup,线性衰减。训练100k步,4 GPU,动态批处理(每GPU 100秒音频)。

- 后训练(GRPO):使用LoRA(rank=32, α=64)进行参数高效微调,仅训练1.57M参数。学习率2e-4,无warmup,线性衰减。每次迭代:收集720个候选样本(72提示 x 10样本),丢弃组内方差为0的组,剩余样本按batch size=12重组,进行4次参数更新。

- 关键超参数:

- 模型:DiT骨干,隐藏维度512,12层,8头,FFN 1024,共46.18M参数。

- GRPO:G=10(组大小),窗口训练步骤ws=2,去噪步数10(推理),SDE噪声水平a(消融研究0.2, 0.3, 0.4),多指标奖励权重λ1=0.6(DNSMOS),λ2=λ3=1。

- 训练硬件:论文中未明确说明GRPO训练使用的GPU型号和数量,仅提及预训练使用4 GPU。

- 推理细节:推理时使用10步确定性ODE采样,应用分类器自由引导(Classifier-Free Guidance)。

- 正则化技巧:使用LoRA进行参数高效微调;GRPO损失中包含KL散度惩罚以约束策略不偏离参考模型太远;丢弃组内奖励方差为0的样本。

📊 实验结果

论文在DNS2020挑战赛测试集上进行了全面的实验验证。

主要对比结果(表1): 将FlowSE-GRPO与多种基线方法(包括判别式、生成式)在DNSMOS指标上进行对比。

| 数据 | 方法 | 类型 | RL | SIG | BAK | OVRL |

|---|---|---|---|---|---|---|

| No Reverb | AnyEnhance | MGM | ✗ | 3.640 | 4.179 | 3.418 |

| AnyEnhance | MGM | DPO | 3.684 | 4.203 | 3.476 | |

| Flow-SR | FM | ✗ | 3.581 | 4.133 | 3.355 | |

| Flow-SR | FM | DPO | 3.632 | 4.173 | 3.420 | |

| FlowSE-GRPO (Ours) | FM | GRPO | 3.753 | 4.248 | 3.549 | |

| With Reverb | AnyEnhance | MGM | ✗ | 3.500 | 4.040 | 3.204 |

| AnyEnhance | MGM | DPO | 3.670 | 4.178 | 3.438 | |

| Flow-SR | FM | ✗ | 3.539 | 4.019 | 3.255 | |

| Flow-SR | FM | DPO | 3.629 | 4.163 | 3.399 | |

| FlowSE-GRPO (Ours) | FM | GRPO | 3.740 | 4.251 | 3.530 |

关键发现:FlowSE-GRPO在DNSMOS OVRL指标上显著超越了包括Flow-SR+DPO在内的所有基线方法。例如,在“With Reverb”数据上,OVRL比Flow-SR+DPO高0.131,比AnyEnhance+DPO高0.092。

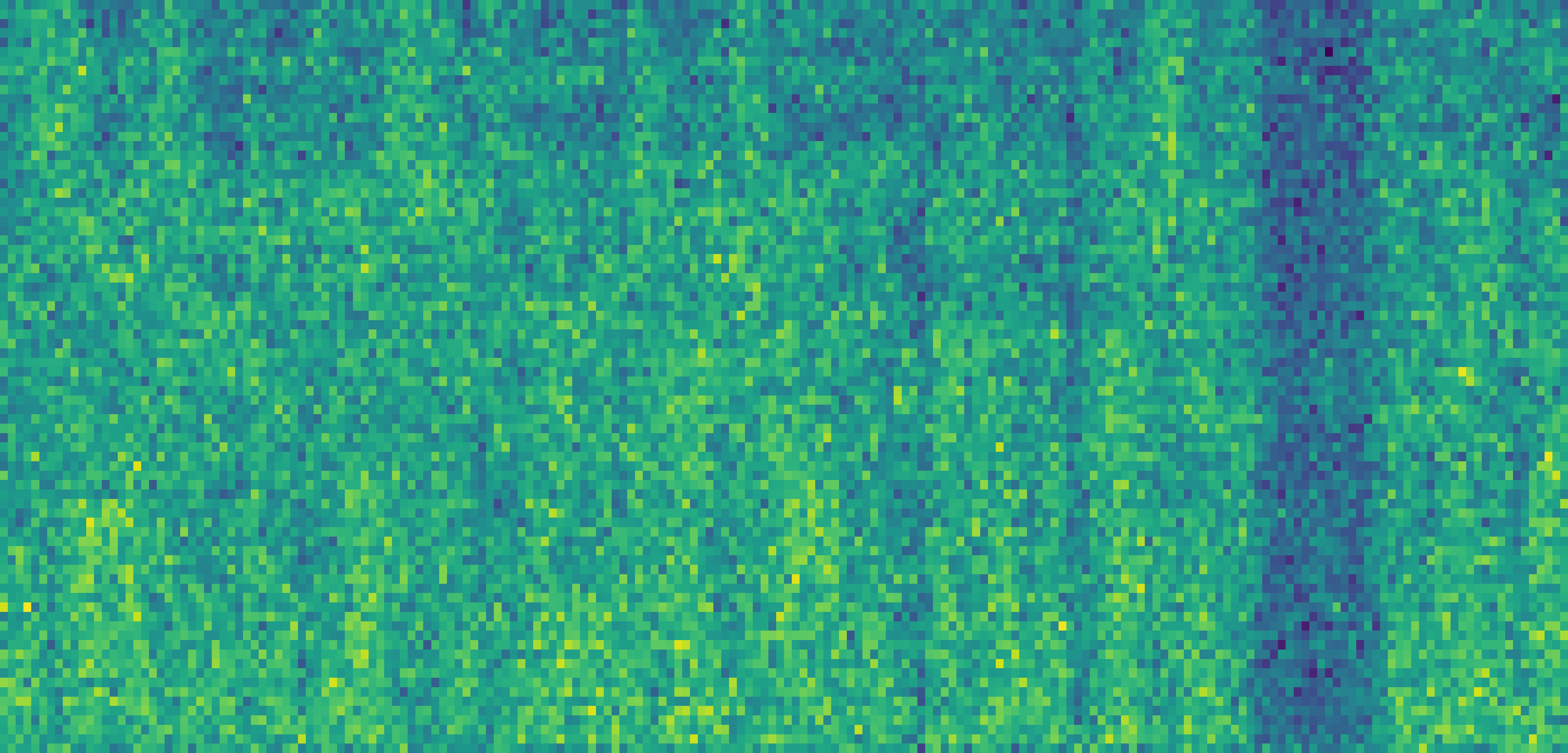

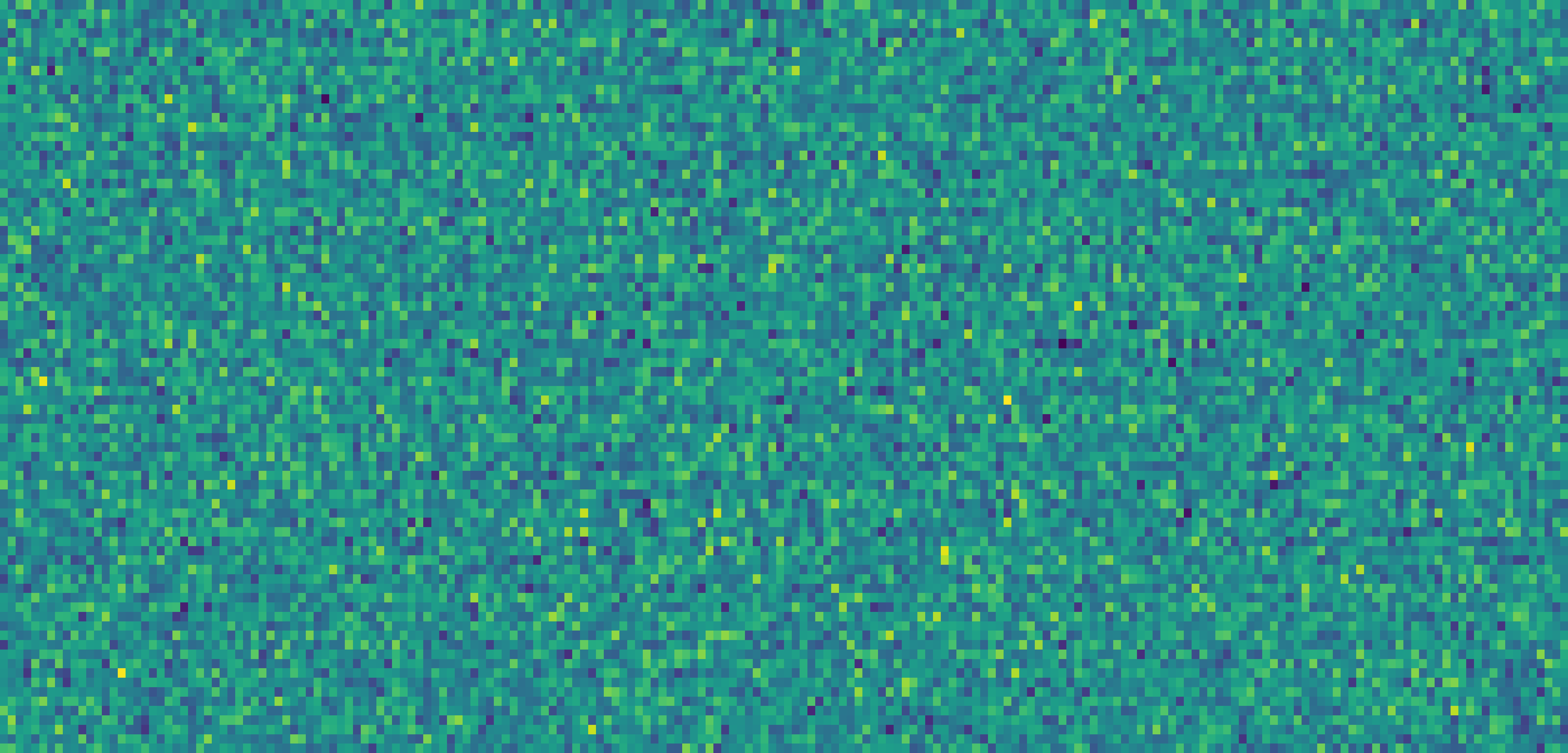

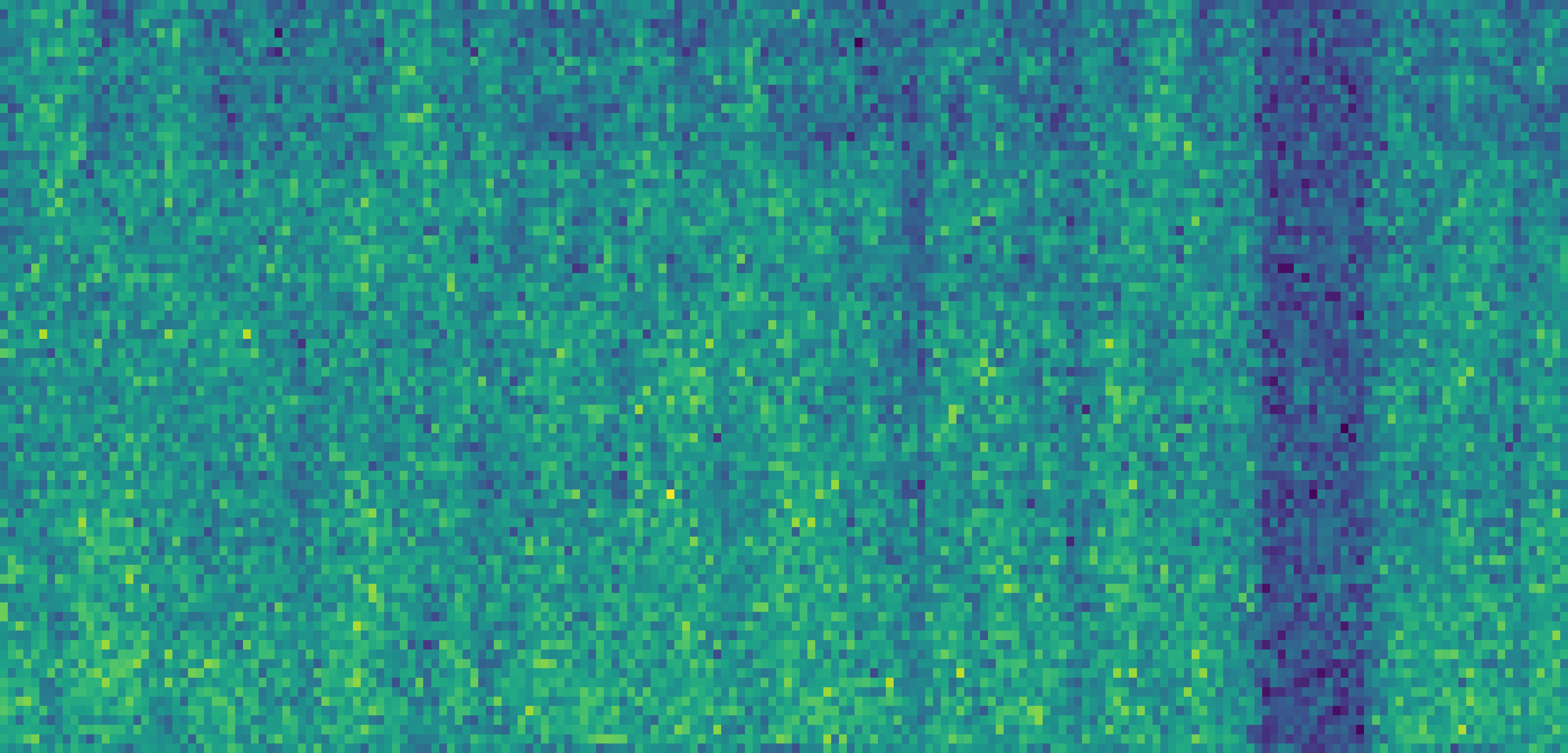

奖励黑客与多指标优化(表2 & 图2): 论文发现,单独优化DNSMOS(图2a蓝色曲线)虽快速提升该指标,但可能损害其他指标。使用多指标奖励(图2a红色曲线)后,在OVRL、说话人相似度和SpeechBERTScore上均获得稳定提升,验证了策略的有效性。

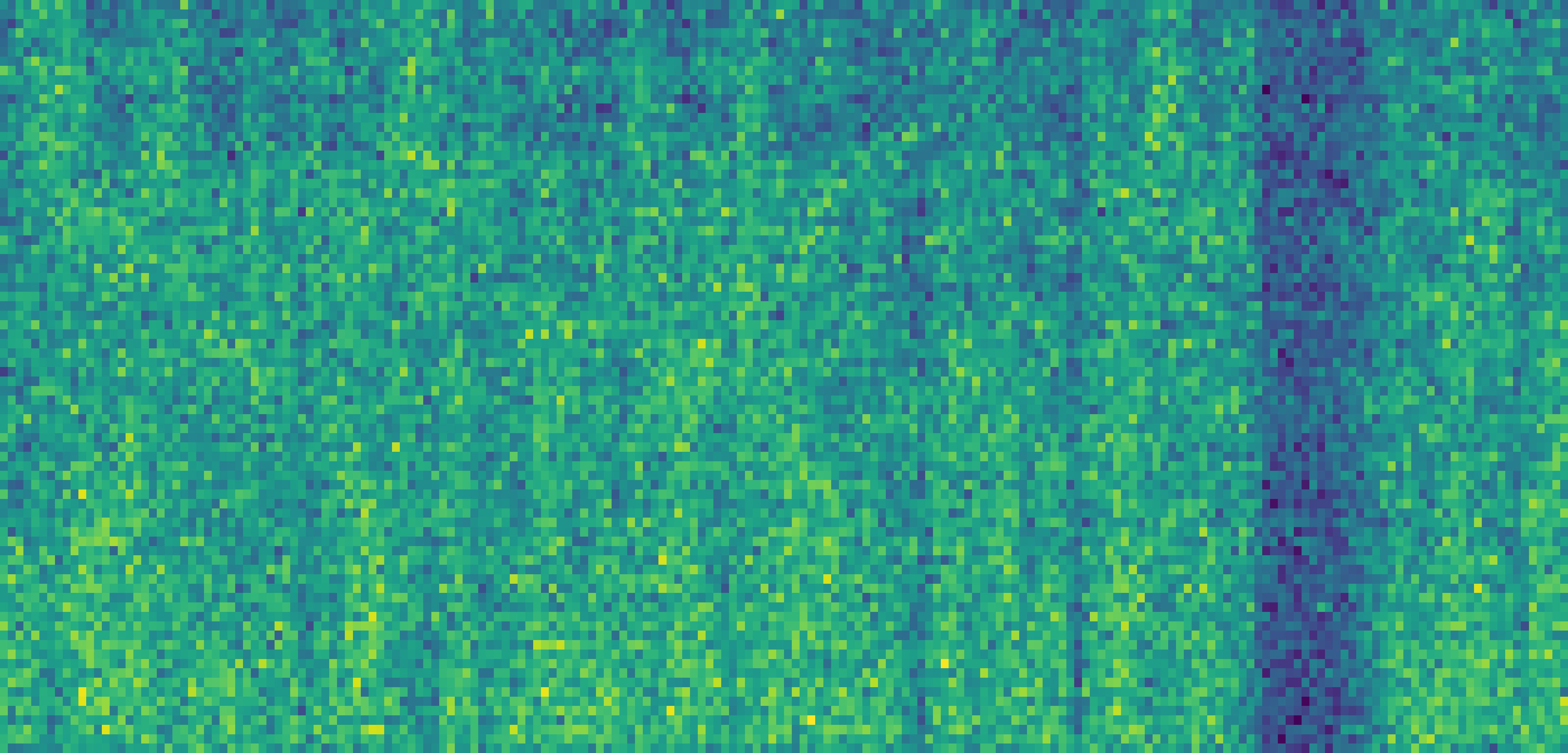

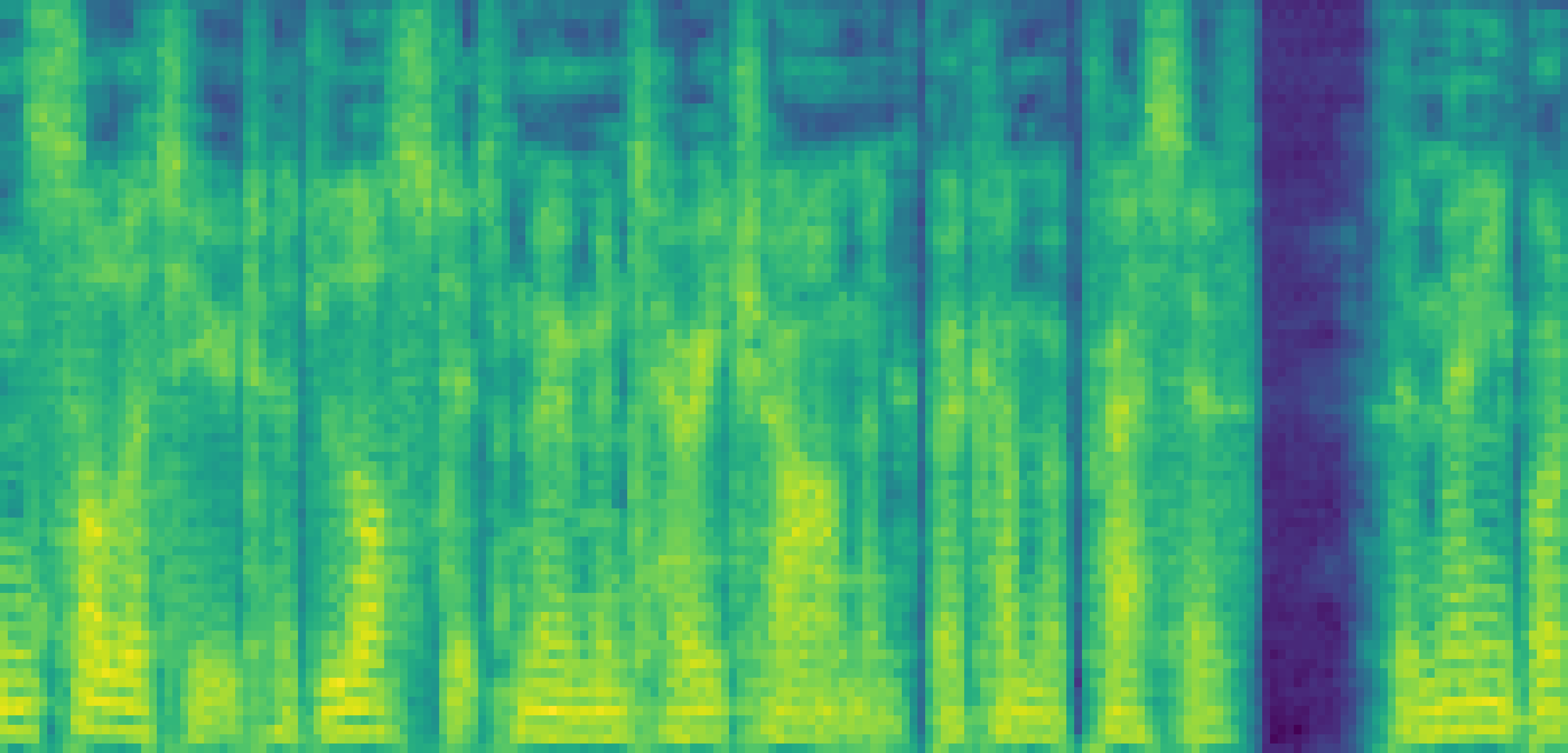

图2(a) 展示了不同噪声水平(a)下,DNSMOS分数随训练步数的变化。可见a=0.4(绿色)提升更快,但可能不稳定。

图2(a) 展示了不同噪声水平(a)下,DNSMOS分数随训练步数的变化。可见a=0.4(绿色)提升更快,但可能不稳定。

图2(b) 展示了不同噪声水平下,说话人相似度随训练步数的变化。

图2(b) 展示了不同噪声水平下,说话人相似度随训练步数的变化。

图2(c) 消融了窗口训练策略,显示仅在早期步骤(Fast)训练比全流程训练(Non-Fast)能更快提升奖励。

图2(c) 消融了窗口训练策略,显示仅在早期步骤(Fast)训练比全流程训练(Non-Fast)能更快提升奖励。

图2(d) 展示了不同噪声水平下,SpeechBERTScore随训练步数的变化。

图2(d) 展示了不同噪声水平下,SpeechBERTScore随训练步数的变化。

消融研究:

- 噪声水平(a):更大的a(如0.4)能加速训练(图2a),但也可能加剧奖励黑客,需要权衡。

- 窗口训练:窗口训练策略(Fast)相比全流程训练(Non-Fast)能显著加速奖励提升(图2c)。

⚖️ 评分理由

- 学术质量:5.5/7:创新点清晰(首次在线GRPO用于流匹配SE,多指标奖励),技术路线正确且细节完备(ODE转SDE,GRPO损失设计)。实验充分,在标准测试集上对比了多种强基线,并进行了系统的消融研究。证据可信,数据具体。

- 选题价值:1.5/2:将强化学习用于提升生成模型的下游任务性能是当前AI领域的前沿方向(如RLHF)。本文将其具体应用于语音增强这一重要且有挑战性的实际问题,具有明确的理论意义和应用潜力。

- 开源与复现加成:0.5/1:论文对模型架构、训练数据、超参数、训练流程的描述非常详细,这为复现奠定了基础。然而,论文完全没有提及代码、模型权重、或具体的数据集下载链接等开源信息,这严重影响了社区快速验证和基于此工作的能力,因此得分较低。