📄 Exploring SSL Discrete Tokens for Multilingual Automatic Speech Recognition

#语音识别 #自监督学习 #多语言 #端到端

✅ 7.5/10 | 前25% | #语音识别 | #自监督学习 | #多语言 #端到端

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Mingyu Cui(香港中文大学;腾讯实习生)

- 通讯作者:未明确标注(根据常见习惯,推测为Xunying Liu或论文中列出的通讯作者标识,但本文未明确标注“Corresponding Author”)

- 作者列表:Mingyu Cui(香港中文大学,腾讯实习生)、Mengzhe Geng(加拿大国家研究委员会)、Yiwen Shao(腾讯)、Jiawen Kang(香港中文大学)、Lingwei Meng(香港中文大学)、Dingdong Wang(香港中文大学)、Chenxing Li(腾讯)、Meng Yu(腾讯)、Xunying Liu(香港中文大学)

💡 毒舌点评

亮点在于,论文用令人信服的实验证明了离散token在训练效率上的碾压优势(加速6.67倍且损失有限性能),并将研究从英语拓展到了7种非英语语言,填补了领域空白。但短板在于,其核心“创新”——用离散token做ASR——在语音社区已非新鲜事,且与最新基线(如Whisper)的对比略显保守,多语言潜力部分的消融实验(表2)也未能给出更优的配置方案,使得贡献停留在“有效验证”而非“范式突破”。

🔗 开源详情

- 代码:论文中未提及代码仓库链接。

- 模型权重:未提及公开权重。

- 数据集:使用Multilingual Librispeech语料库,为公开数据集(论文引用[35]),但论文未说明其处理版本或获取方式。

- Demo:未提供在线演示。

- 复现材料:论文给出了主要模型架构(Zipformer)、关键超参数(如K-means单元数、BPE词表大小、学习率公式)和部分训练设置。但缺少完整的训练脚本、配置文件、数据预处理流程和检查点,复现仍不充分。

- 论文中引用的开源项目:论文中引用的开源项目包括:XLSR-53模型[33](来自Hugging Face)、WavLM-Large模型[5](来自Hugging Face)、EnCodec模型[16](来自Hugging Face)、Zipformer-Transducer代码[34](来自icefall库)。

📌 核心摘要

要解决什么问题:现有研究将自监督学习(SSL)离散token应用于自动语音识别(ASR)时,主要局限于英语任务,且忽略了跨语句上下文信息的建模。本文旨在系统性地探索离散token在多语言ASR中的有效性,并利用其建模跨语句语音上下文。

方法核心:提出使用三种SSL/编解码模型(XLSR-53, WavLM-Large, EnCodec)生成离散token,替代传统FBank特征,输入到Zipformer-Transducer (Z-T) 端到端ASR系统中。进一步,在Z-T编码器中通过拼接或池化投影的方式,融入前序、当前及未来语句的编码器嵌入作为上下文特征。

与已有方法相比新在哪里:据作者所知,这是首次系统研究将离散token用于多语言且包含跨语句上下文建模的ASR任务。对比了SSL离散token、SSL连续特征和传统FBank特征,并分析了不同token生成源、上下文融合方式及多语言训练策略的影响。

主要实验结果:在Multilingual Librispeech (MLS) 语料库的7种语言上,基于XLSR-53的离散token Z-T系统平均WER相比FBank基线在开发集和测试集上分别降低0.45%和1.86%绝对值。离散token系统比连续SSL特征系统训练时间减少超过80%,采用上下文池化投影的离散token系统能以6.67倍的平均加速比,保留连续特征上下文系统70% 的WER改进。关键数据见下表:

ID 模型/输入特征 上下文 平均WER (dev/test) 3 Z-T (FBank) 当前 10.85% / 11.21% 4 Z-T (连续SSL) 当前 10.40% / 9.21% 7 Z-T (XLSR-53离散) 当前 10.54% / 9.45% 10 Z-T+拼接 (离散) 前+当+后 10.19% / 9.11% 13 Z-T+池化 (离散) 前+当+后 10.26% / 9.19% 实际意义:为开发高效且高性能的多语言ASR系统提供了新思路。离散token表示紧凑,能极大降低计算和存储开销,同时保持与复杂连续特征相当的识别性能,有助于多语言ASR模型的实际部署与扩展。

主要局限性:1) 探索深度有限:多语言训练潜力消融实验中,最优配置(混合数据+共享K-means+4000聚类)仅达到单语训练水平,未展示出明显的跨语言增益;2) 缺乏与更新、更强的基线(如Whisper的多语言版本)的系统对比;3) 未公开代码,限制了可复现性。

🏗️ 模型架构

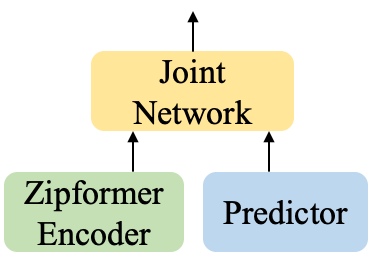

论文采用的主要架构是Zipformer-Transducer (Z-T),这是一个端到端的语音识别模型,包含三个核心组件:

- 编码器(Encoder):基于Zipformer架构,负责处理离散语音token序列 $x^i_{1:T_i}$,生成声学表示 $h^i_{1:T_i}$。Zipformer本身是Transformer的变体,集成了多头自注意力(MHSA)、卷积和前馈网络(FFN)模块。

- 预测器(Predictor):一个无状态(Stateless)的模块,处理历史输出标签序列 $y^i_{1:u-1}$,生成文本表示 $f^i_{u-1}$。

- 联合网络(Joint Network):通过非线性函数(如ReLU)将编码器输出 $h^i_{1:T_i}$ 和预测器输出 $f^i_{u-1}$ 结合,得到隐藏状态 $g^i_{t,u-1}$,最后经Softmax层输出下一个符号的概率 $P(y^i_t|…)$。

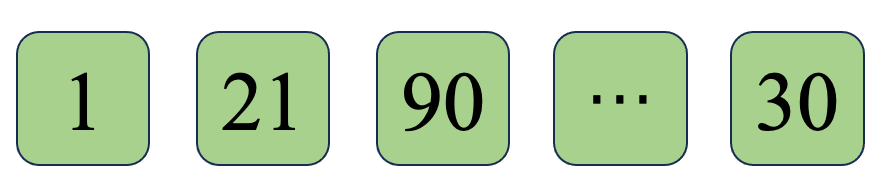

离散token生成流程(见图1):

- SSL-based方法 (XLSR-53, WavLM-Large):首先,从预训练SSL模型的第21层Transformer编码器提取隐藏嵌入。然后,对这些连续嵌入进行K-means聚类,将其映射为离散整数索引(即离散token),聚类单元数(Units)通常为2000。XLSR-53因其在53种语言上预训练,被选为主要模型。

- Neural Codec方法 (EnCodec-24kHz):EnCodec模型直接将音频波形量化为离散token,使用8个码本,每个码本1024个条目。最终token通过跨码本求和得到一个特征向量。

跨语句上下文建模(见图2): 论文在Z-T编码器中引入了对前序($i-1$)和未来($i+1$)语句上下文的建模,有两种方式:

- 编码器嵌入拼接(Concatenation):将前序/未来语句的完整编码器输出序列,与当前语句的输入在每个MHSA层之前进行拼接,作为长程上下文信息(图2中黑色虚线①)。

- 编码器嵌入池化投影(Pooling Projection):通过一个设计的紧凑模块(Compact Module),对前序/未来语句的完整编码器输出进行注意力池化,投影为固定长度 $L \times D$ 的低维表示,再与当前语句结合(图2中黑色实线②)。这种方法更高效。

图1展示了两种生成离散token的路径:一种是对XLSR-53或WavLM-Large的中间层输出进行K-means聚类;另一种是通过EnCodec直接进行量化。

图1展示了两种生成离散token的路径:一种是对XLSR-53或WavLM-Large的中间层输出进行K-means聚类;另一种是通过EnCodec直接进行量化。

图2展示了Z-T模型如何利用前序(蓝色虚线框)和未来(红色虚线框)语句的上下文。①代表拼接方式,②代表通过紧凑模块进行池化投影的方式。

图2展示了Z-T模型如何利用前序(蓝色虚线框)和未来(红色虚线框)语句的上下文。①代表拼接方式,②代表通过紧凑模块进行池化投影的方式。

💡 核心创新点

- 首次系统性研究离散Token在多语言ASR中的应用:填补了此前离散token ASR研究主要集中在英语领域的空白,在7种非英语语言上验证了其有效性和优势。

- 将离散Token应用于跨语句上下文ASR建模:不仅替换了输入特征,还将离散表征用于建模前序、当前和未来语句的复杂上下文依赖关系,这是离散token应用场景的拓展。

- 全面对比了多种离散化源与特征类型:系统对比了基于SSL(XLSR-53, WavLM-Large)和神经编解码器(EnCodec)的离散token,以及与传统FBank、SSL连续特征在性能与效率上的差异。

- 揭示了离散Token在训练效率上的巨大优势:通过详尽的实验(如图3),量化证明了使用离散token作为输入(即使建模复杂上下文)能比使用连续SSL特征减少超过80%的训练时间,同时保持有竞争力的识别性能。

- 探索了多语言训练中离散Token的生成策略:通过消融实验(表2),分析了数据混合、共享K-means聚类以及聚类单元数对多语言ASR性能的影响,为未来更优的多语言离散token系统设计提供了参考。

图3展示了在不同语言上,基于离散token和连续SSL特征的非上下文与上下文系统每轮(epoch)的训练时间(分钟)。离散token系统训练速度显著更快。

图3展示了在不同语言上,基于离散token和连续SSL特征的非上下文与上下文系统每轮(epoch)的训练时间(分钟)。离散token系统训练速度显著更快。

🔬 细节详述

- 训练数据:使用Multilingual Librispeech (MLS) 6000小时语料库,涵盖7种语言:德语(1966小时)、荷兰语(1544小时)、法语(1076小时)、西班牙语(917小时)、意大利语(247小时)、葡萄牙语(160小时)、波兰语(103小时)。

- 数据增强:FBank实验使用SpecAugment;离散token实验在训练时应用了数据增强(具体方式未详细说明);连续SSL特征实验在线提取。

- 模型细节:Z-T系统参数量为65.5M。单语训练时,BPE词表大小为500;多语言训练时为3500。

- 关键超参数:

- FBank:80通道,窗长25ms,帧移10ms。

- 离散token:XLSR-53和WavLM-Large提取自第21层,聚类单元数2000;EnCodec为24kHz,8个码本,总单元数1024^8(论文表格显示为1024^8,但注释中说明为“summed across codebooks”,实际应为每个token是一个求和后的向量,而非一个超大索引)。

- 训练轮数:数据量≥1000小时的语言训练40轮;<1000小时的语言训练150轮。

- 学习率:

10000 / (数据集时长)。

- 训练硬件:论文中未提供具体GPU/TPU型号和训练总时长。

- 推理细节:论文中未详细说明解码策略(如Beam Search的beam size)、温度设置等。

- 正则化:FBank使用SpecAugment;离散token和连续SSL实验的具体正则化技巧未详细说明。

📊 实验结果

主要基准测试:Multilingual Librispeech (MLS) 语料库,7种语言。评价指标为词错误率 (WER, %)。

表1:单语ASR性能对比(关键结果摘录)

| ID | 模型/输入特征 | 前序特征 | 当前特征 | 未来特征 | 聚类单元数 | 德语 | 荷兰语 | 法语 | 西班牙语 | 意大利语 | 葡萄牙语 | 波兰语 | 平均WER |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 1 | Whisper-Large | - | 波形 | - | - | 8.39/8.58 | 16.73/11.83 | 10.65/8.95 | 6.32/5.72 | 12.85/12.36 | 13.26/12.29 | 10.11/7.38 | 11.18/9.59 |

| 3 | Z-T | - | FBank | - | - | 4.00/5.06 | 16.21/15.80 | 7.00/5.80 | 5.16/5.57 | 12.87/11.30 | 19.50/18.58 | 11.24/16.36 | 10.85/11.21 |

| 7 | Z-T | - | XLSR-53离散 | - | 2000 | 4.00/5.03 | 15.06/11.71 | 7.20/6.06 | 4.34/5.54 | 12.85/11.10 | 19.15/17.21 | 11.21/9.54 | 10.54/9.45 |

| 10 | Z-T+拼接 | 离散 | 离散 | 离散 | 2000 | 3.88/4.83 | 14.51/11.28 | 6.97/5.83 | 4.19/5.34 | 12.41/10.69 | 18.52/16.57 | 10.85/9.20 | 10.19/9.11 |

| 13 | Z-T+池化 | 离散 | 离散 | 离散 | 2000 | 3.89/4.89 | 14.64/11.37 | 7.00/5.89 | 4.22/5.39 | 12.51/10.80 | 18.64/16.75 | 10.90/9.27 | 10.26/9.19 |

关键结论:

- 性能对比:基于XLSR-53离散token的Z-T系统(Sys.7)在平均WER上优于FBank基线(Sys.3),测试集绝对降低1.76%。同时,其性能与连续SSL特征(Sys.4)相当(Sys.7 vs. Sys.4)。

- 上下文建模:引入跨语句上下文(无论拼接或池化,Sys.10/13)能进一步降低WER,其性能优于非上下文基线(Sys.7),甚至可以达到或接近使用连续特征的上下文系统(Sys.9)的水平。

- 效率分析(图3):在所有7种语言上,离散token系统的训练时间均远低于连续SSL特征系统。采用池化投影的上下文离散token系统(Sys.13)比对应的连续特征上下文系统(Sys.9)平均训练速度快6.67倍,同时保留了后者约70%的WER改进。

- Token来源对比:XLSR-53离散token(Sys.7)优于WavLM-Large离散token(Sys.6),因其多语言预训练数据的优势。EnCodec离散token(Sys.5)性能最差,可能因其声学token编码了更多细节但缺乏高层语义信息。

表2:多语言训练消融研究

| ID | 混合数据 | 共享K-means | 单元数 | 平均WER (dev/test) |

|---|---|---|---|---|

| 1 | 否 | 否 (单语K-means) | 2000 | 10.54/9.45 |

| 2 | 否 | 是 | 2000 | 11.92/11.14 |

| 3 | 否 | 是 | 4000 | 11.03/10.34 |

| 4 | 是 | 是 | 4000 | 10.76/9.95 |

结论:简单的共享K-means聚类会降低性能(Sys.2, 3 < Sys.1)。增加聚类单元数(2000->4000)能改善性能(Sys.3 > Sys.2)。最终,混合数据+共享K-means+4000单元的配置(Sys.4)能达到接近单语训练(Sys.1)的水平,但未显示明显优势。论文脚注8提到,该配置下2000单元无法收敛。

⚖️ 评分理由

- 学术质量:6.0/7:论文在技术实现和实验设计上严谨、全面,结论有充分的数据支撑。创新性在于将离散token与多语言、跨语句上下文这两个维度进行了首次系统结合,是一个有价值的工程和研究验证。然而,核心方法(离散token用于ASR)并非全新,其创新更多是应用层面的拓展和整合,而非底层方法的突破。

- 选题价值:1.5/2:研究的多语言ASR是重要且活跃的方向。论文明确证明了离散表征在效率上的巨大优势,这对实际应用(尤其是资源受限环境)有明确价值。但“离散token用于语音任务”本身已是成熟方向,本文的增量贡献使得其潜在影响力相对有限。

- 开源与复现加成:0.0/1:论文未提供任何开源代码、模型或详细复现指南。虽然文中描述了模型架构和部分超参数,但完整的训练流程(如数据预处理脚本、离散token提取代码、多语言训练策略)不可得,这严重影响了工作的可复现性和社区的快速跟进。