📄 EuleroDec: A Complex-Valued RVQ-VAE for Efficient and Robust Audio Coding

#音频生成 #自编码器 #复数值 #音频编码

🔥 8.0/10 | 前25% | #音频生成 | #自编码器 | #复数值 #音频编码

学术质量 8.0/7 | 选题价值 1.5/2 | 复现加成 0 | 置信度 高

👥 作者与机构

- 第一作者:Luca Cerovaz (Sapienza University of Rome)

- 通讯作者:Emanuele Rodolà (Sapienza University of Rome, Paradigma)

- 作者列表:Luca Cerovaz (Sapienza University of Rome), Michele Mancusi (Moises Systems Inc.), Emanuele Rodolà (Sapienza University of Rome, Paradigma)

💡 毒舌点评

亮点在于其优雅的理论动机——完全在复数域操作以自然地保留音频的相位-幅度耦合,这直接消除了对复杂且不稳定的GAN训练的依赖,实现了令人印象深刻的训练效率提升(仅需5万步,减少了约95%的计算)。短板是其评估完全局限于LibriTTS一个数据集,尽管分了域内/域外,但应用场景相对狭窄,且论文未提供代码或模型,极大地影响了社区验证和实际应用。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:使用公开的LibriTTS数据集(train.clean.100子集),未提及该数据集的修改或私有部分。

- Demo:未提及。

- 复现材料:提供了非常详细的训练细节(数据集、预处理、损失函数、优化器、学习率调度、批大小、训练步数、硬件)和模型架构参数(表1),这些信息对于复现论文结果至关重要。

- 论文中引用的开源项目:引用了多个开源项目/模型作为基线或相关工作,包括:Encodec[1]、APCodec[8]、AudioDec[23]、HiFi-GAN[24]、FunCodec[9]、SoundStorm[15]、FlowDec[3]、ScoreDec[4]等。这些引用表明论文建立在现有的开源生态之上,但其自身并未承诺开源。

📌 核心摘要

- 要解决什么问题:现有频域神经音频编解码器在相位建模上存在困难,通常将其视为独立的实值通道处理,或依赖不稳定的对抗训练/扩散后处理来补偿,导致训练复杂且泛化性不佳。

- 方法核心是什么:提出EuleroDec,一个端到端的完全复数值(Complex-Valued)的RVQ-VAE编解码器。它从波形输入到重建的整个分析-量化-合成流水线均在复数域操作,使用复数卷积、注意力、归一化(2x2白化)和modReLU激活,从而天然保持幅度-相位的耦合关系。

- 与已有方法相比新在哪里:这是第一个完全端到端、无GAN/无扩散的复数值神经音频编解码器。它摒弃了将复谱拆分为实/虚部或幅度/相位独立处理的范式,也避免了对抗训练带来的不稳定性和计算开销。

- 主要实验结果如何:在LibriTTS数据集上,以6 kbps和12 kbps为目标码率进行评估。EuleroDec在域外(test-other)性能上,在SI-SDR(波形保真度)和GDD(相位精度)指标上显著优于或媲美训练步数多一个数量级的基线模型(APCodec, Encodec, AudioDec)。例如,在6 kbps域外测试中,EuleroDec的SI-SDR为7.58,GDD为270,而训练了70万步的APCodec分别为0.35和596。同时,其训练收敛极快,仅需约3.5-4.1万步。

模型 迭代次数 SI-SDR ↑ PESQ ↑ GDD ↓ ESTOI ↑ 域外 24 kHz (6 kbps) EuleroDec 35k 7.58 2.16 270 0.742 APCodec 700k 0.35 1.91 596 0.769 Encodec 500k 5.59 2.69 604 0.861 域内 24 kHz (6 kbps) EuleroDec 35k 10.5 2.47 264 0.842 APCodec 700k 7.902 3.01 554 0.908 Encodec 500k 7.47 2.76 590 0.905 域外 24 kHz (12 kbps) EuleroDec 41k 11.20 2.57 257 0.819 Encodec 500k 8.27 3.63 591 0.925 - 实际意义是什么:该工作为神经音频编解码提供了一个更简单、更稳定、训练效率更高的架构范式。它证明了复数域一致性对于音频信号建模的重要性,可能推动未来音频编解码器向更自然、更高效的复数值模型发展。

- 主要局限性是什么:模型目前仅支持非因果架构,无法用于实时流式传输;评估仅在单语种、单采样率(24 kHz)的语音数据集(LibriTTS)上进行,其在音乐、多语言或其他采样率上的性能未验证;论文未开源代码和模型。

🏗️ 模型架构

EuleroDec 是一个完全基于复数值的 VQ-VAE 架构,用于音频编解码。整体流程为:原始音频 → STFT → 编码器 → RVQ量化器 → 解码器 → ISTFT → 重建音频。所有模块均在复数域(complex64类型)操作。

EuleroDec 是一个完全基于复数值的 VQ-VAE 架构,用于音频编解码。整体流程为:原始音频 → STFT → 编码器 → RVQ量化器 → 解码器 → ISTFT → 重建音频。所有模块均在复数域(complex64类型)操作。

编码器(Encoder):

- 输入:复数STFT谱图(形状为

B×C×F×T,B为batch size,C为通道数,F为频率bin数,T为帧数)。 - 处理流程:首先经过5个使用不同扩张率((1,1), (3,3), (3,5), (3,7), (1,1))的复数残差层,以扩大感受野并保持复数统计稳定。然后通过一个3x7复数卷积为特征压缩做准备。

- 下采样阶段:由四个阶段组成,每个阶段逐步降低时间和频率维度(非对称步长,如第一阶段(2,2),第二阶段(2,1))。每个阶段包含一个门控跳跃分支(自适应复数平均池化 + 1x1投影)和一个主路径(复数下采样 → 复数归一化 → 复数激活 → 3x3复数卷积 → 时间轴向自注意力 → 3x3复数卷积 → 1x1投影)。跳跃分支与主路径输出相加。drop-path(概率p=0.05)用于稳定训练。

- 后处理:在空间维度压缩后,应用频率轴向注意力和一个复数前馈网络,准备进入量化器。关键设计是保持2D谱图结构,使频率bin在早期阶段保留空间关系。

- 输入:复数STFT谱图(形状为

向量量化器(Vector Quantizer):

- 输入:编码器输出

ze(B×C×F×T)。将频率维度F合并到通道维度,得到z♭e(B×(C·F)×T)。 - 量化:通过一个复数线性投影将维度映射到代码维度D,然后使用残差向量量化(RVQ)。量化在复数域进行,距离度量为基于Hermitian内积的欧氏距离。码本在初始化30步优化后,从当前连续嵌入中采样并添加复数高斯噪声初始化。使用承诺损失(commitment loss)稳定编码器。

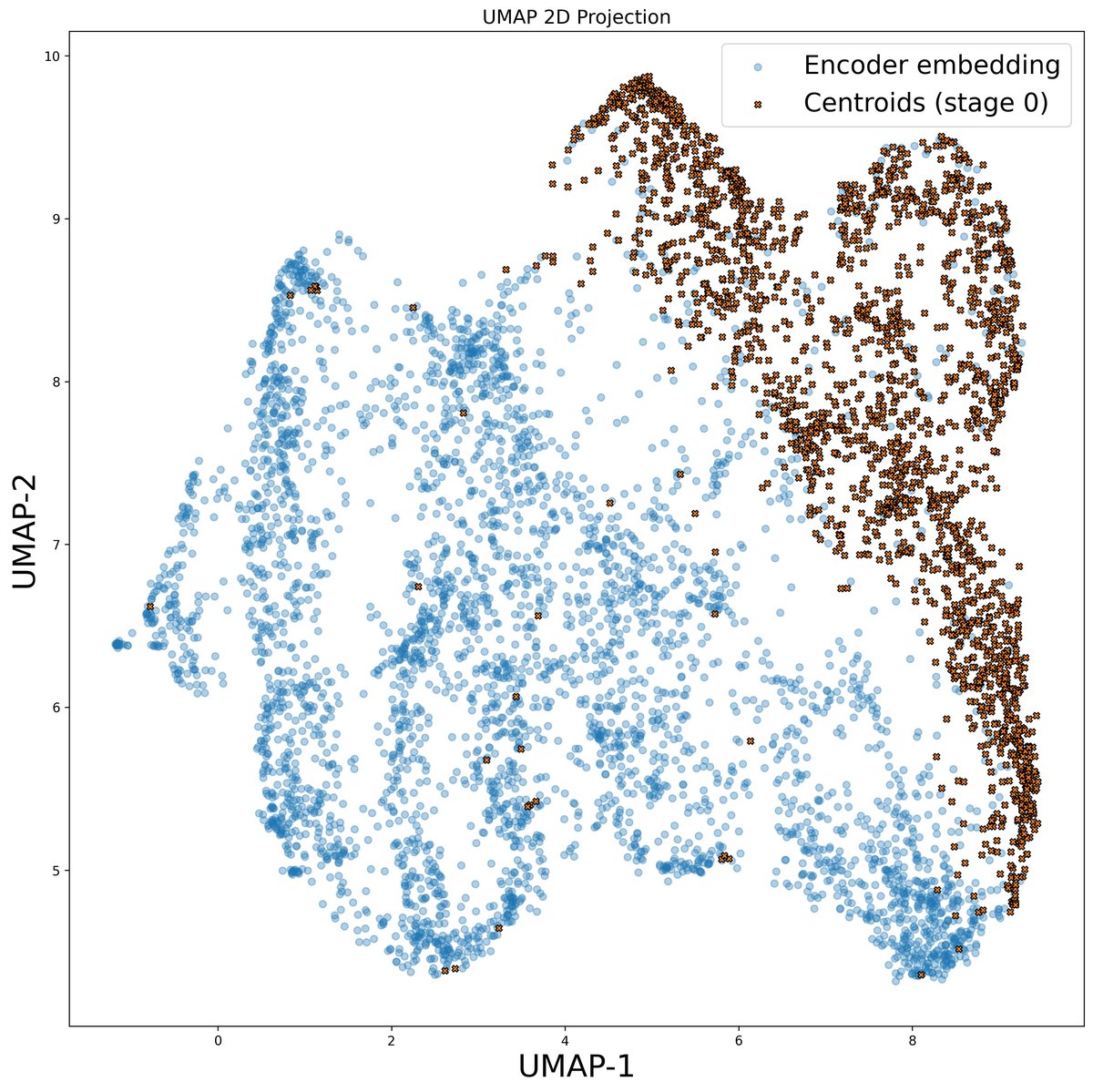

- 码本更新:采用指数移动平均(EMA)更新码本,并设计了EMA衰减率预热策略和死代码刷新机制(概率

prefresh=0.015),以实现100%的代码利用率(如图3所示,有效困惑度为73.2%)。 - 输出:通过一个复数线性投影和维度还原,得到量化后的复数表示

zq(B×C×F×T)。

- 输入:编码器输出

解码器(Decoder):镜像编码器结构,但不使用门控跳跃分支。从频率轴向注意力+复数前馈网络开始,然后通过四个上采样阶段(使用复数转置卷积),恢复全分辨率的复数谱图。所有层均为复数。

关键组件解释:

- 轴向注意力:分别沿时间轴和频率轴进行自注意力计算,以捕获长程依赖,同时比全尺寸2D注意力计算量更低。

- 复数归一化:使用2x2协方差矩阵对实部和虚部进行联合白化,而非分别归一化,以保持复数的几何结构。

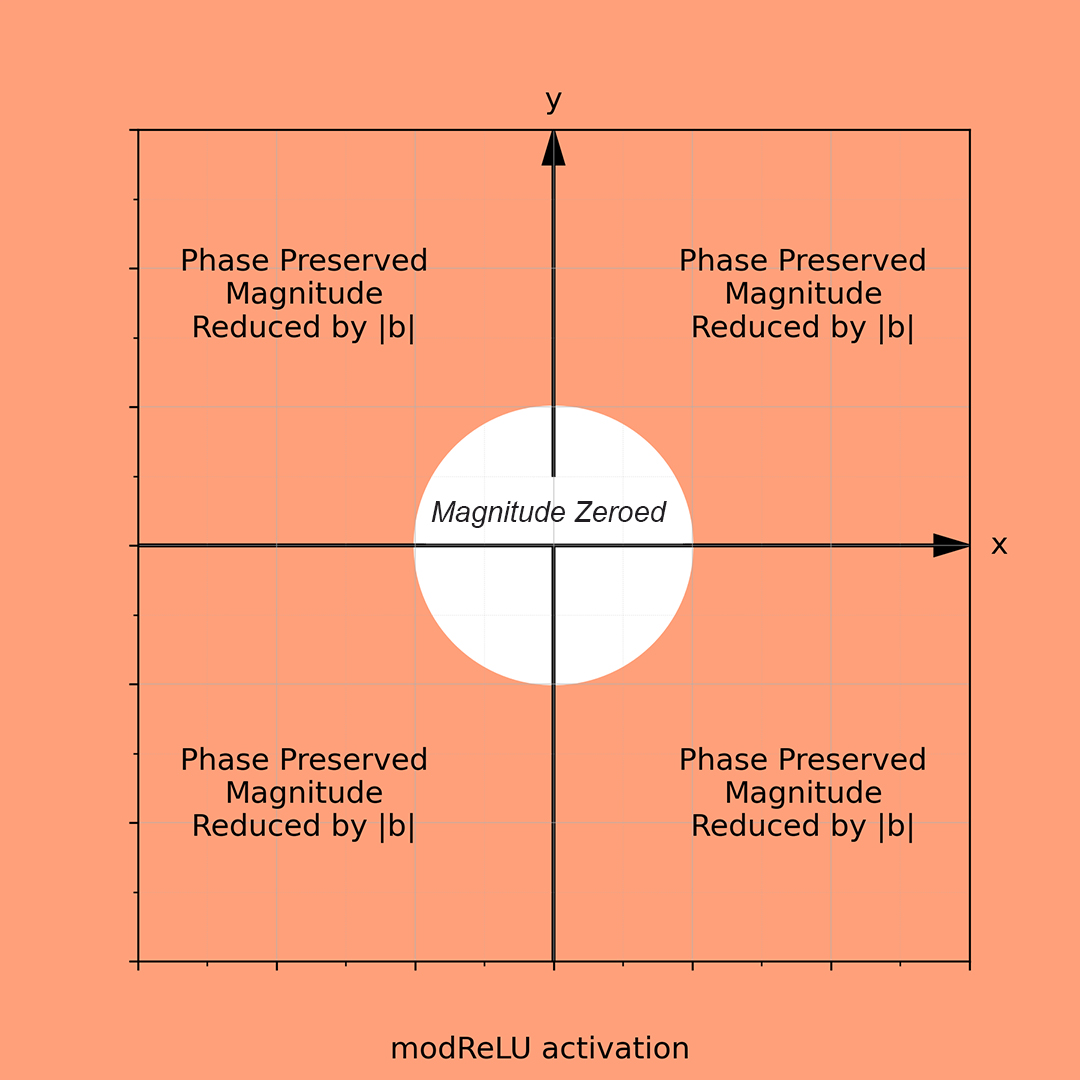

modReLU激活:

modReLU(z) = ReLU(|z| + b) z/|z|。它仅对模值进行阈值处理,相位保持不变,尊重复数的相位等变性。

💡 核心创新点

- 完全端到端的复数值处理流水线:从波形输入(经STFT)到波形重建(经ISTFT)的所有阶段(编码、量化、解码)均在复数域实现。这是首次在神经音频编解码器中实现。此前的工作要么将复谱拆分为实/虚部或幅度/相位独立处理(忽略耦合),要么部分使用实值网络(破坏相位一致性)。

- 无需对抗训练和扩散后处理的高质量编解码:由于复数域表示能更自然、更完整地建模音频信号(尤其是相位),模型仅通过重建损失(mel谱图损失、复数谱图损失)和量化损失就能达到或超越依赖GAN和扩散模型的基线的性能。这极大地简化了训练过程,提升了稳定性。

- 显著的训练效率和样本效率提升:论文报告仅需约3.5万至4.1万步训练即可达到竞争性能,相比基线模型(APCodec 70万步,Encodec/AudioDec 50万步)减少了约95%的计算预算。这得益于复数域表示的紧凑性和对信号内在结构的更好建模。

- 卓越的域外鲁棒性和相位保真度:在存在麦克风失配、混响和背景噪声的“域外”测试集(LibriTTS other)上,EuleroDec在SI-SDR(波形保真度)和GDD(相位精度)等指标上表现尤为突出,显著优于其他基线。这归功于其设计强制模型学习尊重音频相位几何的表示,避免了对训练集统计特性的过拟合。

🔬 细节详述

- 训练数据:LibriTTS train.clean.100 子集(约100小时语音)。随机裁剪0.680秒片段,确保填充不超过5%。对波形进行归一化,使用线性复数谱图(而非对数幅度谱图,后者性能下降)。

- 损失函数:总损失

L_total = 80w_melL_mel + 80w_cplxL_gen + 50w_mrsL_mrs + 0.1*L_q。L_mel:多分辨率mel谱图L1损失。L_gen:多分辨率复数谱图损失(包含谱图收敛和复数L1损失)。L_mrs:多分辨率谱图损失(具体构成未详细说明)。L_q:量化承诺损失,L_q = β * L_commit,其中β=0.05。L_commit惩罚编码器输出与分配质心之间的偏差。

- 训练策略:优化器AdamW(β1=0.9,β2=0.99,权重衰减=7e-4),batch size=16,学习率=3e-4。采用线性warmup后接余弦衰减(衰减至1/100)。训练至收敛(连续三个epoch损失无改善)。

- 关键超参数:

- 模型大小:2,347,621参数(全模型)。

- 量化:RVQ,2048条目的码本,6 kbps时使用12个阶段,12 kbps时使用相同的12个阶段但时间步长减半(token率加倍)。

- 比特率:6 kbps(时间步长8,约46.9 tokens/s,11 bits/symbol)和12 kbps(时间步长4,约93.8 tokens/s)。

- STFT参数:采样率24kHz,NFFT=512,窗口长度=512,跳数=64,汉宁窗,处理256帧。

- 训练硬件:NVIDIA RTX 3090 GPU。

- 推理细节:非因果架构。使用标准重叠相加法进行跨片段重建。实时因子(RTF)为0.344(在RTX 3090上)。

- 正则化或稳定训练技巧:drop-path(p=0.05);码本EMA衰减率预热;死代码刷新机制;使用承诺损失稳定编码器。

📊 实验结果

论文在LibriTTS测试集(test-clean为域内,test-other为域外)上评估了6 kbps和12 kbps两个目标码率下的性能。基线模型包括APCodec(70万步)、Encodec(50万步)和AudioDec(50万步,仅6 kbps有公开检查点)。所有基线均使用对抗性判别器。

主要结果表格(复现论文Table 1的关键数据):

| 场景 | 模型 | 迭代次数 | SI-SDR ↑ | PESQ ↑ | GDD ↓ | ESTOI ↑ |

|---|---|---|---|---|---|---|

| 域外 24 kHz (6 kbps) | EuleroDec | 35k | 7.58 | 2.16 | 270 | 0.742 |

| APCodec | 700k | 0.35 | 1.91 | 596 | 0.769 | |

| AudioDec | 500k | -19.57 | 1.968 | 196 | 0.698 | |

| Encodec | 500k | 5.59 | 2.69 | 604 | 0.861 | |

| 域内 24 kHz (6 kbps) | EuleroDec | 35k | 10.5 | 2.47 | 264 | 0.842 |

| APCodec | 700k | 7.902 | 3.01 | 554 | 0.908 | |

| AudioDec | 500k | -14.48 | 2.05 | 197 | 0.771 | |

| Encodec | 500k | 7.47 | 2.76 | 590 | 0.905 | |

| 域外 24 kHz (12 kbps) | EuleroDec | 41k | 11.20 | 2.57 | 257 | 0.819 |

| Encodec | 500k | 8.27 | 3.63 | 591 | 0.925 | |

| APCodec | 700k | 5.63 | 2.84 | 579 | 0.880 | |

| 域内 24 kHz (12 kbps) | EuleroDec | 41k | 13.67 | 2.91 | 249 | 0.901 |

| Encodec | 500k | 10.32 | 3.77 | 578 | 0.953 | |

| APCodec | 700k | 5.93 | 3.17 | 568 | 0.922 |

关键结论:

- 训练效率:EuleroDec仅需3.5万-4.1万步,远少于基线的50万-70万步。

- 域外鲁棒性:在6 kbps域外测试中,EuleroDec的SI-SDR(7.58)远超APCodec(0.35)和Encodec(5.59),GDD(270)远优于它们。在12 kbps域外测试中,其SI-SDR(11.20)也优于Encodec(8.27)和APCodec(5.63)。

- 相位精度(GDD):在所有设置下,EuleroDec的GDD指标均为最佳,证明了其出色的相位保持能力。

- 感知质量(PESQ/ESTOI):在域内测试中,EuleroDec的PESQ和ESTOI略低于最佳基线(如APCodec或Encodec),但差距不大,且远优于AudioDec。这可能表明对抗训练在拟合训练集分布上略有优势,但EuleroDec的泛化能力更强。

- 消融实验:

- 时间轴向注意力(Table 2):移除时间轴向注意力后,SI-SDR、PESQ、STOI均有下降,证明了其对时序一致性的贡献。

- 复数值vs实数值自编码器(Table 3):复数值AE(cplx AE)在LSD(更低)和PESQ(更高)上均显著优于将实/虚部分开处理的split AE和容量匹配的extra cplx AE,验证了复数域操作的优势。

图2说明:此图可视化了modReLU激活函数。它显示了一个复平面上的变换,横轴可能是输入模值。函数在输入模值小于某个阈值(-b)时输出0;当模值大于阈值时,输出为

图2说明:此图可视化了modReLU激活函数。它显示了一个复平面上的变换,横轴可能是输入模值。函数在输入模值小于某个阈值(-b)时输出0;当模值大于阈值时,输出为 ReLU(|z|+b) * (z/|z|),即仅将输入的模值减去阈值后再应用ReLU缩放,但完全保留输入的相位角。这直观地解释了modReLU如何“尊重相位”。

⚖️ 评分理由

- 学术质量:6.5/7:创新性高,首次实现完全端到端复数域音频编解码,思路清晰且有理论依据(复数代数保持相位耦合)。技术实现严谨,从复数卷积、归一化到量化距离度量都进行了正确扩展。实验充分,在多个指标、多个码率、域内/域外场景与多个强基线对比,并进行了必要的消融研究。证据可信,尤其训练效率的提升和域外性能的优势有具体数字支撑。

- 选题价值:1.5/2:音频编解码是语音/音频处理的基础且核心任务,直接影响流媒体、语音合成、语音增强等多个下游应用。该工作提出的更高效、更稳定的训练范式具有潜在的广泛影响力。对关注音频质量和编码效率的研究者和工程师有高相关性。

- 开源与复现加成:0/1:这是主要的扣分点。论文未提供代码仓库链接,未提及模型权重的公开计划,也未提及训练数据的独立公开方式(尽管使用了公开数据集LibriTTS)。虽然给出了极其详细的训练配置(损失函数、优化器、学习率、步数、硬件等),理论上可以复现,但缺少官方实现和预训练模型,使得快速验证和应用变得困难,降低了实际可复现性。