📄 Estimating Respiratory Effort from Nocturnal Breathing Sounds for Obstructive Sleep Apnoea Screening

#音频分类 #CNN-LSTM #多任务学习 #医疗声学 #生物声学

✅ 6.5/10 | 前25% | #音频分类 | #多任务学习 | #CNN-LSTM #医疗声学

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 中

👥 作者与机构

- 第一作者:Xiaolei Xu(谢菲尔德大学计算机科学学院)

- 通讯作者:未说明

- 作者列表:Xiaolei Xu(谢菲尔德大学计算机科学学院)、Chaoyue Niu(谢菲尔德大学计算机科学学院)、Guy J. Brown(谢菲尔德大学计算机科学学院)、Hector Romero(Passion for Life Healthcare)、Ning Ma(谢菲尔德大学计算机科学学院)

💡 毒舌点评

这篇论文的亮点在于其开创性思路:首次尝试从夜间呼吸声这一单一模态中,直接估计出通常需要接触式传感器才能获取的“呼吸努力”生理信号,从而为无感的睡眠监测扫清了一个关键障碍。然而,其短板也相当明显:呼吸努力的估计精度(CCC 0.48)仅达到中等相关性,这直接导致了后续融合策略带来的性能提升幅度有限,甚至在某些关键阈值(如AHI≥30)上不如直接使用音频特征,让人对“估计信号”的实际增益打个问号。

🔗 开源详情

论文中未提及任何代码、模型权重、数据集的公开链接或在线演示。也未说明是否有公开计划。复现所需的训练细节(如优化器、学习率、超参数搜索范围)和检查点信息均未提供。论文中引用的开源项目主要为前序工作[9, 12]的数据集和基线方法。

📌 核心摘要

本文针对阻塞性睡眠呼吸暂停症(OSA)诊断依赖复杂多导睡眠图(PSG)且普及困难的问题,提出一种仅需智能手机音频即可进行OSA筛查的新方法。其核心是设计了一个两阶段框架:首先训练一个模型从夜间呼吸/打鼾声中估计腹部呼吸努力信号,然后冻结该模型,提取其潜在表征作为“呼吸努力嵌入”,与另一个音频编码器提取的声学嵌入在潜在空间进行融合,最终用于OSA事件检测和严重程度分类。与已有方法相比,其新意在于首次实现了从音频直接推断呼吸努力,摆脱了对额外传感器的依赖,维持了纯声学方法的可扩展性。实验在157晚、103名参与者的家庭录音数据集上进行,结果显示:呼吸努力估计器达到0.48的平均CCC;融合估计的呼吸努力后,在AHI阈值5(检测轻度OSA)时,敏感性达到0.88,优于音频基线(0.86)和使用真实努力信号的“Oracle”系统(0.81),AUC为0.86。该方法的实际意义在于为低成本、无感、长期的OSA家庭监测提供了可行的技术路径。其主要局限性包括:呼吸努力的估计精度受限于复杂家庭环境噪声,导致融合收益有限;缺乏充分的消融实验以证明性能提升完全来自呼吸努力表征而非模型容量增加。

🏗️ 模型架构

论文提出一个两步走的潜在空间融合框架,用于从夜间音频检测OSA。

第一步:音频到呼吸努力的估计器(图1蓝色部分)

- 输入:30秒的音频片段,表示为64维对数梅尔滤波器组特征(1500帧 x 64频段)。

- 组件:

- CNN特征提取器:使用比音频基线更小的池化核以保留时间分辨率,将输入从1500x64转换为187x128的特征图。

- LSTM编码器:处理CNN输出的187帧时序特征,捕获呼吸动力学,产生隐藏状态序列。

- 解码器与插值:一个线性解码器将每个LSTM隐藏状态投影为一个值,生成187点的预测序列。由于参考呼吸努力信号(32Hz采样)在30秒内有960个点,预测序列通过插值上采样至960点,以对齐标签并进行损失计算。

- 输出:预测的归一化呼吸努力信号序列。

- 关键设计:采用“先预测低分辨率序列再插值”的策略,平衡了LSTM训练复杂性和最终信号保真度。优化目标使用一致性相关系数(CCC)损失,以同时优化相关性与偏差。

第二步:融合OSA检测(图1橙色部分)

- 输入:同样为30秒音频片段的梅尔特征。

- 组件:

- 冻结的呼吸努力编码器:使用第一步训练好的CNN-LSTM估计器(参数冻结),提取其LSTM最终隐藏状态,并通过时间平均得到一个固定维度的“呼吸努力嵌入”。

- 音频编码器:一个独立的CNN网络,提取音频嵌入。

- 潜空间融合:将呼吸努力嵌入与音频嵌入在向量层面进行拼接。

- 分类头:融合后的向量通过一个融合层和一个全连接层(MLP),预测该30秒片段内发生OSA事件(呼吸暂停/低通气)的概率。

- 输出:片段级的OSA事件概率。后续通过合并连续阳性片段计算夜间AHI。

- 整体数据流:音频特征 → [呼吸努力估计器] → 呼吸努力嵌入 → [与音频嵌入拼接] → 分类头 → OSA事件预测。

图1:所提潜在融合方法的系统示意图。CNN-LSTM编码器分别从夜间音频中提取通用声学嵌入和面向呼吸努力的潜在表示。这些表示被融合后输入分类器,用于预测呼吸暂停/低通气事件。

图1:所提潜在融合方法的系统示意图。CNN-LSTM编码器分别从夜间音频中提取通用声学嵌入和面向呼吸努力的潜在表示。这些表示被融合后输入分类器,用于预测呼吸暂停/低通气事件。

💡 核心创新点

- 首次从夜间音频估计呼吸努力信号:之前的OSA声学筛查要么仅用音频,要么需要额外的接触式传感器(如胸腹绑带)来测量呼吸努力。本文首次探索直接从打鼾和呼吸声中推断这一关键生理信号,核心假设是呼吸动态会在声学信号中留下微妙印记。

- 基于潜在表征的融合策略:提出的框架不是简单地将估计的波形与音频特征融合,而是将估计器的中间LSTM隐藏状态作为“呼吸努力嵌入”。这提供了一种更抽象、与下游任务更相关的生理上下文表示,并通过冻结估计器参数来规范音频表示的学习。

- 无传感器、可扩展的OSA筛查方案:在推理阶段,仅需要智能手机录音,无需任何接触式生理传感器。这显著提升了方法的可扩展性、患者舒适度和长期监测的可行性,直接回应了临床需求中对低成本、非侵入性筛查工具的迫切需求。

🔬 细节详述

- 训练数据:使用自采集数据集,包含103名参与者在家庭环境中记录的157晚数据。设备包括家用睡眠呼吸暂停测试仪(SOMNOtouch RESP,提供呼吸努力参考信号)和智能手机。数据划分采用10折交叉验证(按参与者划分),训练/验证/测试比例为8:1:1。

- 损失函数:

- 呼吸努力估计:使用一致性相关系数(CCC)的损失函数 \( L = 1 - \rho_c \)。CCC衡量预测信号与真实信号在相关性和均值/方差偏差上的一致性,范围[-1, 1]。

- OSA事件检测:使用加权二元交叉熵损失,权重 \( w_i = \frac{N}{2 \times N_c} \) 以处理正负样本不平衡问题。

- 训练策略:论文提及了10折交叉验证方案,但未说明具体的学习率、优化器、批量大小、训练轮数等关键超参数和训练技巧。

- 关键超参数:

- 输入音频特征:30秒窗口,10秒移位,64维对数梅尔滤波器组(50ms窗,20ms帧移),产生1500x64矩阵。

- 呼吸努力估计器:CNN输出特征图维度187x128,LSTM输出序列长度187点,最终插值到960点。

- 分类嵌入维度:音频嵌入维度为512(见4.1节基线描述),呼吸努力嵌入维度由LSTM隐藏状态维度决定,论文未明确说明。

- 训练硬件:未说明。

- 推理细节:使用30秒滑动窗口(10秒移位)生成片段级预测,相邻阳性片段合并为OSA事件,最终计算夜间AHI。

- 数据对齐:使用HSAT设备的打鼾通道(500Hz)通过互相关估计延迟,将16kHz音频与之对齐,以同步音频和生理信号。

📊 实验结果

主要实验对比了音频基线、使用真实呼吸努力信号的“Oracle”系统(引自[12])和本文提出的潜在空间融合(LSF)模型。

表1:OSA严重程度分类结果(AHI切点:5, 15, 30事件/小时)

| AHI切点 | 5 | 15 | 30 | ||||||

|---|---|---|---|---|---|---|---|---|---|

| 模型 | 灵敏度 | 特异性 | AUC | 灵敏度 | 特异性 | AUC | 灵敏度 | 特异性 | AUC |

| 仅音频 | 0.86 | 0.62 | 0.75 | 0.81 | 0.84 | 0.84 | 0.78 | 0.93 | 0.92 |

| Oracle系统 [12] | 0.81 | 0.82 | 0.87 | 0.81 | 0.74 | 0.86 | 0.88 | 0.87 | 0.93 |

| 本文 LSF 模型 | 0.88 | 0.69 | 0.86 | 0.83 | 0.78 | 0.88 | 0.78 | 0.93 | 0.91 |

关键结论:

- 在检测轻度OSA(AHI≥5)时,LSF模型敏感性最高(0.88),且AUC(0.86)接近Oracle系统(0.87),表明估计的呼吸努力确实提供了补充信息。

- 在中度阈值(AHI≥15)时,LSF模型在敏感性(0.83)和AUC(0.88)上均表现最佳。

- 在重度阈值(AHI≥30)时,所有模型AUC趋同(0.91-0.93),音频基线和LSF模型的特异性更高(0.93),表明严重OSA的声学特征已足够强。

呼吸努力估计性能(表2)

| 指标 | 数值(均值±标准差) |

|---|---|

| CCC ↑ | 0.478 ± 0.133 |

| RMSE ↓ | 1.053 ± 0.123 |

| MAE ↓ | 0.793 ± 0.092 |

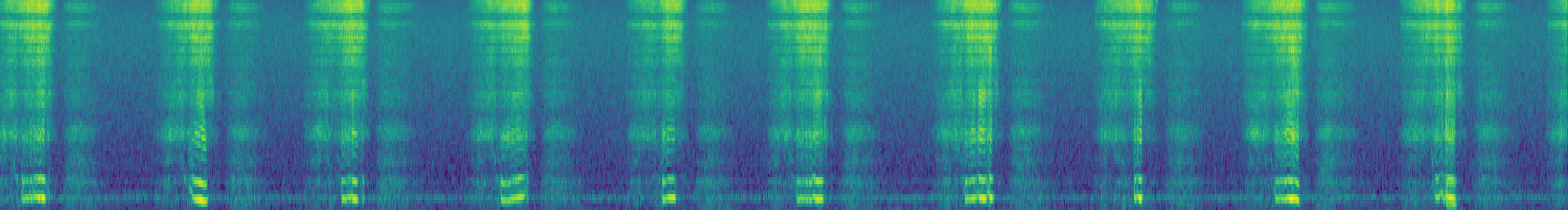

图2:预测呼吸努力信号(虚线)与测量真实信号(实线)的典型示例。第一个例子显示模型能捕捉整体趋势;第二个例子时间对齐良好;第三个例子出现相位偏移。

关键结论:估计信号能捕捉呼吸动态的基本模式和幅度,但精度有限,且存在时间对齐问题,这解释了其作为补充特征的收益并非压倒性。

图2:预测呼吸努力信号(虚线)与测量真实信号(实线)的典型示例。第一个例子显示模型能捕捉整体趋势;第二个例子时间对齐良好;第三个例子出现相位偏移。

关键结论:估计信号能捕捉呼吸动态的基本模式和幅度,但精度有限,且存在时间对齐问题,这解释了其作为补充特征的收益并非压倒性。

⚖️ 评分理由

- 学术质量:5.5/7。创新点明确且有实际意义,技术框架完整。但在核心模块(呼吸努力估计器)的性能上仅达到中等水平(CCC 0.48),限制了最终增益。实验设计合理,但缺少关键的消融实验(如证明性能提升来自呼吸嵌入而非模型容量)、学习曲线分析以及对时间错位问题的定量评估。部分关键训练细节(如超参数)缺失,影响结论的可复现性和说服力。

- 选题价值:1.5/2。选题切中临床痛点,探索音频作为“数字生物标志物”的潜力,具有明确的应用前景和跨学科价值。将生理信号估计融入音频处理是重要且前沿的方向。

- 开源与复现加成:0.0/1。论文完全未提供代码、模型、数据或详细的复现实操指南。