📄 Enhancing Dialogue-Related Speech Tasks with Generated Spoken Dialogues

#语音对话系统 #数据增强 #语音大模型 #说话人分离 #语音活动检测

✅ 6.5/10 | 前25% | #语音对话系统 | #数据增强 | #语音大模型 #说话人分离

学术质量 6.5/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 中

👥 作者与机构

- 第一作者:Haitian Lu(中国科学院声学研究所语音声学与内容理解重点实验室;中国科学院大学)

- 通讯作者:Gaofeng Cheng(中国科学院声学研究所语音声学与内容理解重点实验室;中国科学院大学)

- 作者列表:Haitian Lu(中国科学院声学研究所语音声学与内容理解重点实验室;中国科学院大学)、Zhihao Bai(中国科学院声学研究所语音声学与内容理解重点实验室;中国科学院大学)、Yukun Liu(中国科学院声学研究所语音声学与内容理解重点实验室;中国科学院大学)、Xuyang Wang(中国科学院声学研究所语音声学与内容理解重点实验室;中国科学院大学)、Gaofeng Cheng(中国科学院声学研究所语音声学与内容理解重点实验室;中国科学院大学)、Yonghong Yan(中国科学院声学研究所语音声学与内容理解重点实验室;中国科学院大学)

💡 毒舌点评

这篇论文的亮点在于思路清晰,将“生成可控对话数据”这一上游能力与多个下游具体任务紧密结合,并系统验证了其作为数据增强工具的实用价值,尤其是在改善VAD的对话级错误率(CDER)上效果显著。短板在于,其“增强”的根基——生成模型SLIDE是前作,本文的增量贡献更多是应用层面的实验验证;同时,生成数据的说话人多样性不足(仅120人)导致EEND的说话人错误率居高不下���暴露了当前生成对话数据用于复杂说话人场景时的核心瓶颈。

🔗 开源详情

- 代码:论文中未提及任何代码仓库链接。

- 模型权重:未提及任何已公开的模型权重(包括生成模型SLIDE或下游任务模型)。

- 数据集:论文中使用的Fisher和CALLHOME是标准公开数据集。但本文生成的对话数据集未公开,也未说明获取方式。

- Demo:未提供在线演示。

- 复现材料:论文描述了下游任务的模型架构(如CRDNN, ResNet-LSTM)和使用的工具包(SpeechBrain, EEND官方工具),但未提供训练超参数配置、检查点或详细的复现说明。对于核心的生成对话部分,未提供任何复现材料。

- 论文中引用的开源项目:SpeechBrain, wav2vec2, EEND官方工具包, pyannote.audio, Silero VAD, CDER_Metric toolkit。

- 开源计划:论文中未提及任何开源计划。

📌 核心摘要

- 解决的问题:大语言模型(LLM)和语音语言模型(SLM)能生成自然的对话语音,但生成的语音在文本-语音一致性、精确的时间戳获取以及保持自然对话动态(如韵律、重叠)方面存在挑战,限制了其作为高质量数据增强资源在下游任务中的应用。

- 方法核心:基于SLIDE框架,扩展生成带有精确转录和话语时间戳的双通道语音对话。通过从模型预测的音素时长中解析出连续的语音片段边界,获得精确的监督信号。随后,将这些生成的对话数据以多种策略(单独使用、与真实数据混合、预训练后微调)应用于四个下游任务:自动语音识别(ASR)、端到端神经说话人分离(EEND)、语音活动检测(VAD)和重叠语音检测(OSD)。

- 创新点:相比于直接使用真实数据或传统仿真数据,本文提出的方法生成的对话兼具自然对话动态和准确的标注(文本与时间戳)。它不是提出一个新的生成模型,而是系统地探索和验证了可控生成对话数据作为通用数据增强方案的潜力和具体应用方法。

- 主要实验结果:在Fisher和CALLHOME数据集上的实验表明:

- ASR:使用100小时真实数据+1600小时生成数据进行预训练-微调后,WER为14.31%,优于仅使用1600小时真实数据的15.20%。

- VAD:仅用400小时生成数据训练的模型,CDER(对话级错误率)为34.4%,相比仅用真实数据的最佳结果48.1%有28.5%的相对改进。

- OSD:结合1600小时真实数据与1600小时生成数据,F1分数达到65.4%,优于仅用1600小时真实数据的62.0%。

- EEND:生成数据在MS+FA(漏检与误检)指标上表现良好,但由于生成对话仅包含120位说话人,导致说话人错误率较高,整体DER提升有限。 具体实验结果表格如下:

表1:ASR性能(Fisher数据集)

| 模型 | 训练数据规模 | WER ↓ |

|---|---|---|

| Wav2vec2 (真实数据) | 100h | 26.98% |

| Wav2vec2 (真实数据) | 1600h | 15.20% |

| Wav2vec2 (真实+生成数据) | 100h+1600h (预训练+微调) | 23.78% |

| Wav2vec2 (真实+生成数据) | 1600h+1600h (预训练+微调) | 14.31% |

表2:EEND性能(CALLHOME数据集)

| 模型 | 训练数据规模 | MS ↓ | FA ↓ | ERROR ↓ | DER ↓ |

|---|---|---|---|---|---|

| BLSTM-EEND (真实数据) | 1600h | 9.6% | 3.7% | 8.4% | 21.7% |

| BLSTM-EEND (生成数据) | 1600h | 11.2% | 8.3% | 27.6% | 47.1% |

表3:VAD性能(CALLHOME数据集)

| 模型 | 训练数据规模 | CDER ↓ | MS+FA ↓ (collar=0.25) | MS+FA ↓ (collar=0) |

|---|---|---|---|---|

| CRDNN (真实数据) | 200h | 48.1% | 2.80% | 9.64% |

| CRDNN (生成数据) | 400h | 34.4% | 3.92% | 9.27% |

| pyannote2.1 | - | 76.3% | 5.54% | 9.29% |

| Silero | - | 98.5% | 9.07% | 12.37% |

表4:OSD性能(CALLHOME数据集)

| 模型 | 训练数据规模 | Precision ↑ | Recall ↑ | F1 ↑ |

|---|---|---|---|---|

| ResNet-LSTM (真实数据) | 1600h | 61.4% | 62.6% | 62.0% |

| ResNet-LSTM (生成数据) | 1600h | 60.6% | 61.2% | 60.9% |

| ResNet-LSTM (真实+生成数据) | 1600h+1600h | 65.3% | 65.5% | 65.4% |

| Sincnet | - | 72.7% | 34.6% | 46.9% |

- 实际意义:该方法为解决标注对话数据稀缺、昂贵的问题提供了一条可扩展的路径。生成的对话数据可作为现有真实数据的有效补充,尤其对于VAD、ASR等任务,在低资源场景下能显著提升模型性能。

- 主要局限性:生成对话的说话人多样性有限(仅120人),严重制约了其在说话人分离(EEND)等说话人相关任务上的效果。此外,生成对话是否完全捕获了真实对话中复杂的声学场景(如复杂背景噪声、远场效应)仍需进一步验证。

🏗️ 模型架构

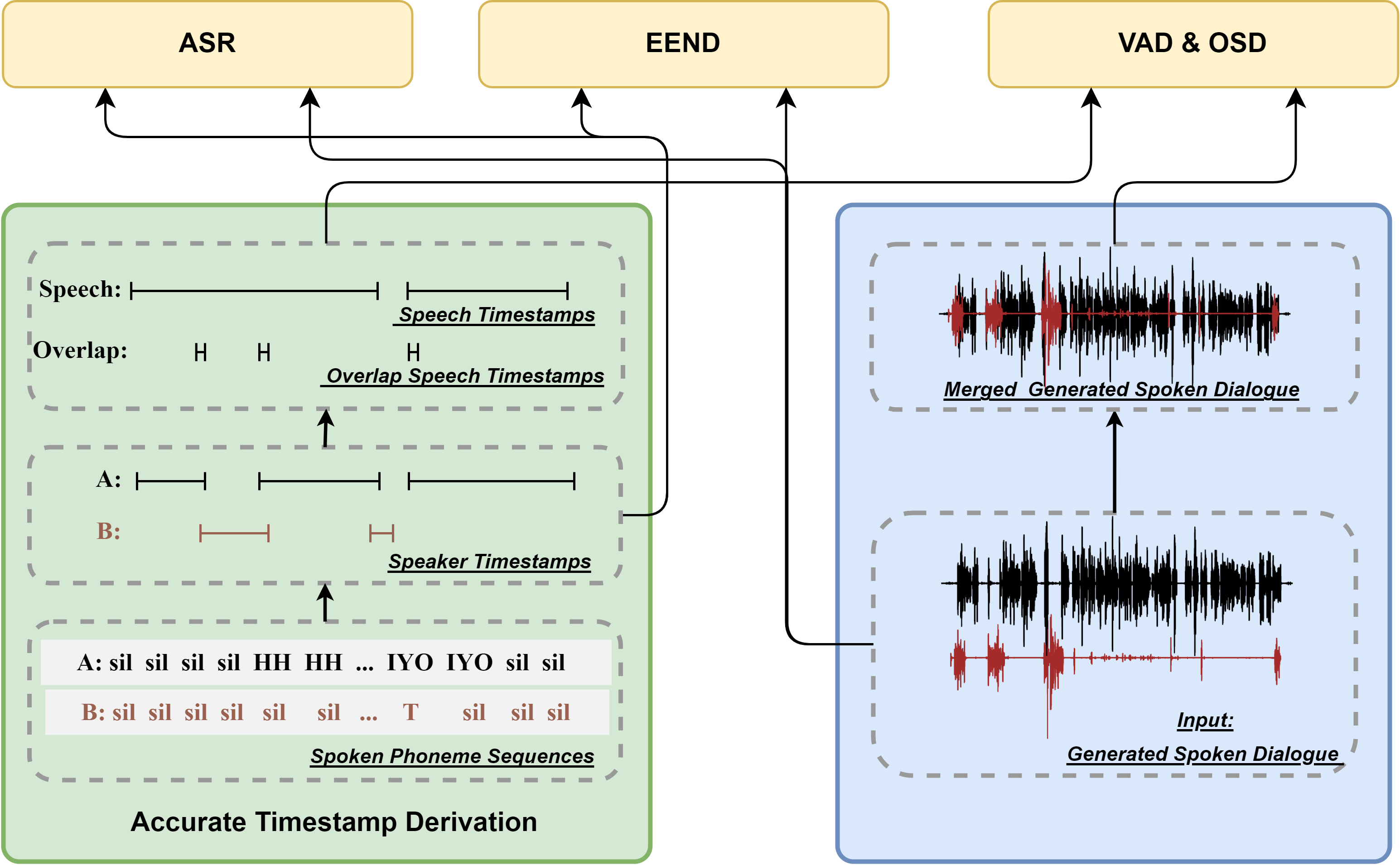

本文的“模型”是一个三阶段的流水线(Pipeline),如图1所示:

- 对话语音生成(SLIDE模型):输入为文本对话内容(音素序列),输出为双通道(对应两个说话人)的合成语音波形。SLIDE模型通过预测每个音素的持续时间,并将音素token重复相应次数,来控制语速和停顿,从而生成语音。此步骤保证了生成语音与输入文本的一致性。

- 精确时间戳推导:这是本文的关键创新模块(图中绿色框)。SLIDE模型在生成时会预测每个音素的持续时长

d_i。该模块利用这些时长信息,将原始音素序列Φ扩展为一个包含重复音素token和静音token的序列P。然后,通过分组连续的非静音token,推导出每个语音片段(t_s, t_e)的精确起止时间。这为下游任务提供了无需人工标注的、精确的片段级监督信号。 - 下游任务应用:将上一步得到的“音频-文本-时间戳”三元组,根据不同的下游任务需求进行适配和模型训练:

- ASR:使用片段音频

x(t_s: t_e)作为输入,对应文本y作为目标,训练标准CTC损失。 - EEND:利用时间戳

A为每个片段生成逐帧的二值说话人活动标签Y(t),作为监督信号训练具有置换不变性损失的EEND模型。 - VAD & OSD:将双声道合并为单声道,利用时间戳

A生成帧级的语音活动(VAD)和重叠语音(OSD)二值标签,训练相应的序列标注模型(CRDNN for VAD, ResNet-LSTM for OSD)。

- ASR:使用片段音频

整个架构的核心思想是利用生成模型固有的时间控制能力,自动产出高质量的、带标注的训练数据,其价值在于标注的精确性和数据的可扩展性。

💡 核心创新点

- 可控生成对话数据的下游任务适配框架:提出了一套系统的方法,将基于SLIDE生成的、带有精确时间戳的对话语音,转化为适用于ASR、EEND、VAD、OSD等多种不同任务的训练数据。明确了“预训练-微调”、“混合训练”等多种数据利用策略,解决了“如何用”的问题。

- 基于生成模型内部状态的时间戳推导:区别于传统方法依赖外部强制对齐工具或启发式规则,本文直接利用SLIDE模型在生成时预测的音素时长,推导出话语级的精确时间戳。这种方法无需外部依赖,且与生成过程紧密耦合,保证了时间戳的准确性。

- 验证了生成对话作为通用增强资源的有效性:通过大规模、多任务的实验,证明了自动生成的对话数据不仅能提升任务性能,而且在某些指标(如VAD的CDER)上能超越仅使用真实数据训练的模型,验证了其作为“清洁”且具有挑战性训练数据的价值。

🔬 细节详述

- 训练数据:

- 下游任务评估使用标准Fisher(约1600小时,用于ASR)和CALLHOME数据集。

- 生成对话数据由SLIDE模型合成。论文未明确说明用于合成SLIDE模型本身或生成目标对话的文本来源和规模,但提到生成对话包含120位唯一说话人。

- 数据预处理:所有音频重采样至16kHz。

- 损失函数:

- ASR:标准CTC损失。

- EEND:置换不变性(Permutation Invariant Training, PIT)损失,基于帧级的交叉熵。

- VAD & OSD:二元交叉熵损失。

- 训练策略:

- ASR (wav2vec2):在Librispeech-960h上预训练,然后在生成或真实数据上微调。使用SpeechBrain实现。

- EEND:采用BLSTM架构,使用Hitachi官方工具包实现。实验对比了200h至1600h不同规模数据的影响。

- VAD (CRDNN):使用SpeechBrain实现,输入40维Fbank特征。

- OSD (ResNet-LSTM):使用ResNet34骨干网络加SE模块,后接BLSTM和前馈层,输入80维Fbank特征。

- 具体学习率、优化器、batch size等超参数论文中未提供。

- 关键超参数:

- ASR模型:基于wav2vec2。

- VAD模型:CRDNN(CNN, GRU, DNN)。

- OSD模型:ResNet34-SE + BLSTM。

- 生成对话的说话人数量:120。

- 训练硬件:论文中未提供。

- 推理细节:ASR解码使用贪心搜索。

- 正则化或稳定训练技巧:论文中未提及。

📊 实验结果

论文在四个任务上进行了详尽的实验,核心结果已��“核心摘要”部分用表格列出。关键发现总结如下:

- ASR:生成数据作为预训练数据或混合数据,能持续降低WER。尤其在低资源(100h真实数据)场景下增强效果明显。

- EEND:生成数据在检测“活动”(MS+FA)上有效,但由于说话人多样性不足,整体DER反而上升,说明生成数据在说话人建模方面存在短板。

- VAD:生成数据训练的模型在对话级错误率(CDER)上全面、显著优于真实数据模型和开源基线(pyannote, Silero),证明了其精确时间戳监督的优势。

- OSD:最佳效果来自真实与生成数据的混合训练(F1=65.4%),优于仅用任一数据源,表明二者具有互补性。 论文未直接与当前最新的生成式数据增强方法(如基于扩散的语音生成)进行对比,主要对比基线是“仅使用真实数据”和部分开源工具。

⚖️ 评分理由

- 学术质量:6.0/7:论文工作扎实,逻辑清晰,实验设计系统且覆盖多任务。其价值在于系统验证和方法整合,而非提出颠覆性的新生成模型或理论。技术正确性高,证据(实验数据)较为可信。主要扣分点在于核心生成模型非本文原创,且实验对比的广度(未与最新生成模型对比)和部分训练细节的缺失。

- 选题价值:1.5/2:选题具有明确的实用导向,针对语音对话处理中数据稀缺的痛点,提出的解决方案(生成带标注数据)思路直接且有效,对从事相关任务的研究者和工程师有较高的参考价值。

- 开源与复现加成:0.0/1:论文完全未提供代码、预训练模型、生成脚本或数据的获取方式。虽然描述了下游任务的实现工具,但上游数据生成部分的复现依赖未公开的SLIDE模型扩展,复现难度大。因此无加成,但因未提供材料也不扣分。