📄 Encoding Emotion Through Self-Supervised Eye Movement Reconstruction

#语音情感识别 #自监督学习 #眼动分析 #情感计算

✅ 7.5/10 | 前25% | #语音情感识别 | #自监督学习 | #眼动分析 #情感计算

学术质量 7.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Marcus Ma(南加州大学)

- 通讯作者:未说明

- 作者列表:Marcus Ma(南加州大学),Jordan Prescott(南加州大学),Emily Zhou(南加州大学),Tiantian Feng(南加州大学),Kleanthis Avramidis(南加州大学),Gabor Mihaly Toth(卢森堡大学),Shrikanth Narayanan(南加州大学)

💡 毒舌点评

这篇论文巧妙地将NLP领域的自监督预训练思路移植到眼动序列分析上,成功证明了即使是低分辨率视频中“不完美”的眼动数据也蕴含着丰富的情感信息,这种“化腐朽为神奇”的特征挖掘能力是其最大亮点。然而,其情感“真值”标签严重依赖于另一个语音情感识别模型的输出,相当于用一个“黑盒”去标注数据来训练另一个模型,这种“以模型训模型”的范式在引入系统性偏差方面存在潜在风险,让最终结论的纯粹性打了个问号。

🔗 开源详情

- 代码:论文提供了代码仓库链接:github.com/mamarcus64/GLASS。

- 模型权重:论文中未提及公开发布预训练或微调后的模型权重。

- 数据集:核心数据集(USC Shoah Foundation视觉历史档案)为私有数据集,论文中描述了数据获取和处理的途径,但未提供公开下载或获取方式。

- Demo:论文中未提及提供在线演示。

- 复现材料:论文详细描述了模型架构(Transformer编码器-解码器)、训练策略(计划采样、Huber损失、AdamW优化器、余弦退火学习率)以及关键超参数(默认输入/输出5秒、模型尺寸分类),并提供了训练的总计算量(~200 petaFLOPs)和时长(~6小时 on A40),复现材料较为充分。

- 论文中引用的开源项目:OpenFace 2.0(用于眼动提取),Whisper和WavLM(用于生成VAD标签),RoPE(旋转位置编码)。

📌 核心摘要

- 要解决什么问题:传统眼动情感识别依赖于昂贵、受限于实验室环境的高精度眼动仪。本文旨在探索能否从自然场景下、低成本的低分辨率视频(30 FPS,320p)中提取眼动信息,并有效预测情感。

- 方法核心是什么:提出了一种名为GLASS的自监督学习框架。首先,利用海量无标签眼动序列数据,通过编码器-解码器Transformer模型,以自回归方式预训练“预测未来眼动”的任务。然后,冻结或微调预训练好的编码器,接上不同的时间建模头(MLP、TCN、GRU、Transformer),在有标签的小规模数据上进行下游情感预测任务的微调。

- 与已有方法相比新在哪里:a) 范式创新:首次将针对语言的自监督预训练思想应用于原始眼动序列的特征学习。b) 数据利用创新:有效利用了大量易于获取但质量较低的视频数据进行预训练,摆脱了对高质量标注眼动数据的依赖。c) 模型设计:通过修改预训练任务的目标(预测未来2秒、5秒、10秒眼动),发现预测时间越长,编码的情感信号越强。

- 主要实验结果如何:在两个下游任务上,GLASS均优于统计特征和CNN基线。实验一(VAD回归):在5秒输入下,GLASS(预测10秒)取得最优的皮尔逊相关系数r=0.294±0.03。实验二(行为分类:哭、笑、叹气):在5秒输入下,GLASS(预测5秒)取得最优的宏F1分数0.361±0.02。消融实验表明,预训练时的眼动预测性能与下游情感任务性能呈正相关。

- 实际意义是什么:证明了低质量、自然状态下的视频眼动数据可作为可靠的情感预测源,为情感计算走向大规模、低成本、非侵入式的真实世界应用提供了新的技术路径。

- 主要局限性是什么:a) 标签噪声:实验一的情感VAD标签并非人工标注,而是由基于语音的ASR+情感模型生成,其准确性直接影响模型训练上限。b) 场景特定性:研究数据集为大屠杀幸存者访谈,情感强烈且单一,模型在更普遍、平淡的日常情感场景中的泛化能力未知。c) 数据私有:使用的核心数据集非公开,限制了完全复现与直接比较。

🏗️ 模型架构

论文的核心模型GLASS采用经典的两阶段“预训练-微调”范式,其整体架构如图2所示。

阶段一:自监督预训练(左图)

- 输入:连续

Ti帧(默认150帧,即5秒)的6通道(左眼XYZ、右眼XYZ)眼动时间序列数据。 - 处理流程:

- 分块嵌入:将时间序列分割成不重叠的

P帧大小的块,通过一个线性层将每个块(P * D维)映射为一个d维的嵌入向量。 - 位置编码:对嵌入向量应用旋转位置编码(RoPE)以注入时序信息。

- 编码器(Encoder):由L_s个标准的Transformer自注意力块组成,处理输入序列的嵌入向量,输出上下文感知的序列表示。

- 解码器(Decoder):由L_d个Transformer块组成,每个块包含对编码器输出的交叉注意力。它以自回归方式工作,每次根据编码器表示和已生成的历史块,预测下一个块的嵌入。

- 输出重建:解码器输出的每个块嵌入通过另一个线性层映射回原始

P * D维度的块空间,然后拼接得到预测的未来To帧(默认150帧,即5秒)眼动序列。

- 分块嵌入:将时间序列分割成不重叠的

- 训练技巧:采用计划采样(Scheduled Sampling)策略,训练初期对解码器输入进行教师强制(使用真实值),后期逐渐转为完全自回归。损失函数为坐标损失和速度损失(一阶差分)的加权Huber损失之和:

L = Lc + 0.2 * Lv。

阶段二:下游微调(右图)

- 移除预训练的解码器,保留编码器。

- 从编码器最后一层的输出序列中提取特征(包括原始嵌入、其一阶和二阶导数估计)。

- 将这些特征按固定的时间块(如1秒)分割。

- 将每个块输入一个情感预测头(Emotion Head),论文测试了四种时间模型:MLP(时间平均)、时序卷积网络(TCN)、门控循环单元(GRU)和Transformer。

- 最终输出情绪预测值(实验一为VAD三元组,实验二为三类行为的分类概率)。

💡 核心创新点

- 将自监督预训练范式引入眼动时序建模:以往眼动情感识别多为监督学习。本文创新性地将NLP中“预测下一个词”的自监督思想转化为“预测下一段眼动”的任务,利用海量无标签眼动数据学习通用的时空特征表示,这是方法论上的核心创新。

- 证明低质量自然视频眼动数据的情感价值:在数据分辨率(320p)和帧率(30Hz)远低于专业设备(如EyeLink 1000,2000Hz)的情况下,通过自监督学习有效提取了情感相关信号,打破了情感识别对高质量采集设备的依赖。

- 发现预训练任务与下游任务性能的强关联:消融实验(图5)表明,自监督预训练任务(眼动预测)的性能(皮尔逊r)与下游情感预测任务(VAD回归的r、行为分类的F1)的性能呈正相关。这直接验证了“更好的眼动预测编码了更丰富的情感信息”这一核心假设。

- 通过调整预训练目标提升下游性能:在相同模型架构和数据下,将预训练的预测时间范围从2秒增加到10秒,可以提升下游情感任务的性能(表2),表明更长期的眼动预测任务迫使模型捕捉更宏观、更稳定的情感相关模式。

🔬 细节详述

- 训练数据:

- 预训练:使用USC Shoah Foundation视觉历史档案中3997段视频(来自978名大屠杀幸存者)。由OpenFace 2.0提取6通道(左右眼XYZ)逐帧眼动数据。

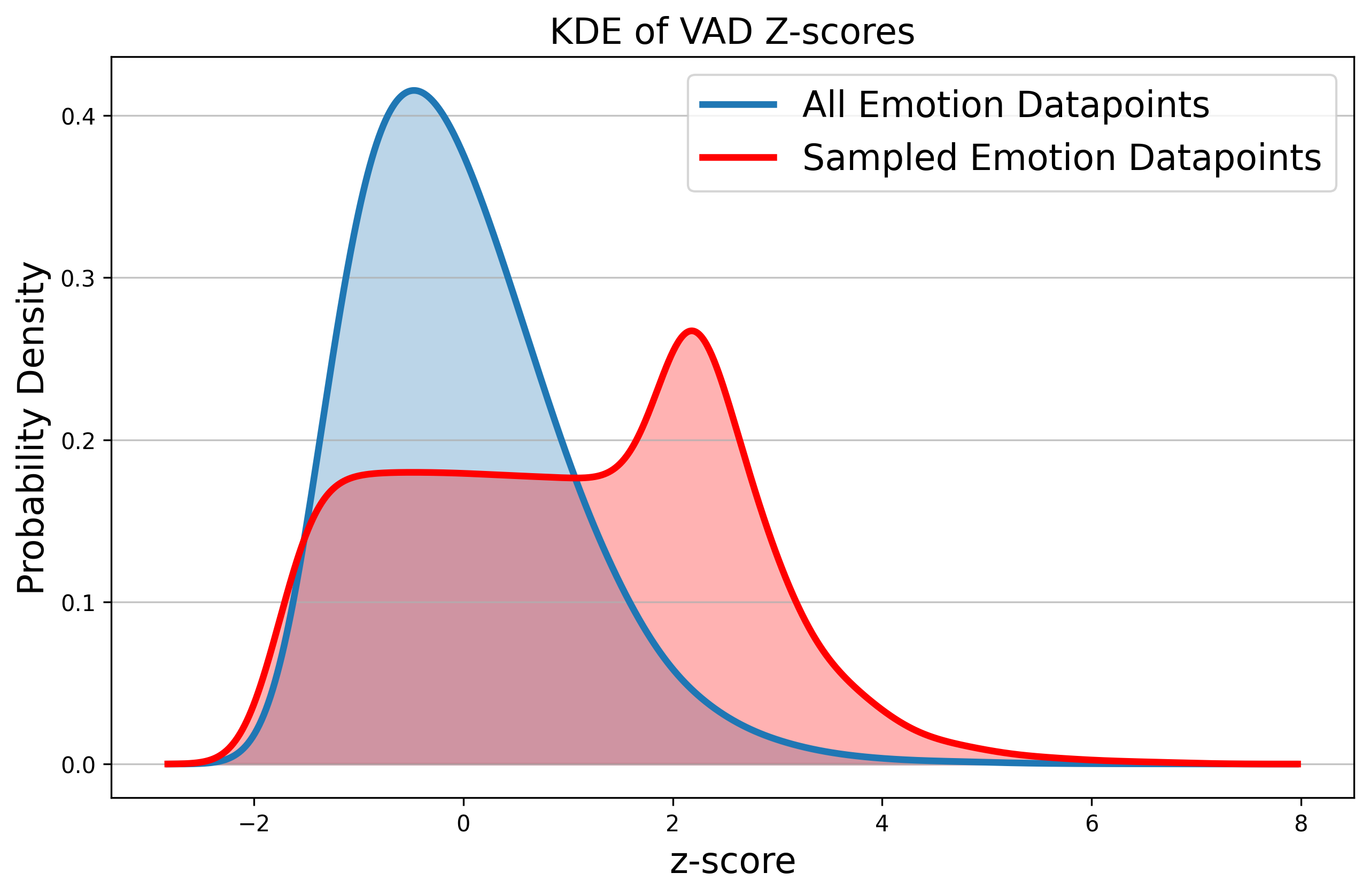

- 实验一(VAD回归):3979段视频,54,374个样本窗口。标签由集成的Whisper和WavLM情感模型在语音段上预测的VAD值(0-1)提供。为平衡分布,对远离均值(2σ外)的标签进行了上采样。

- 实验二(行为分类):1926段视频,标签来自人工标注的非言语行为标记(笑:4866,叹气:1952,哭泣/啜泣:1478)。

- 损失函数:预训练使用Huber损失,公式为

L = Lc + λ * Lv,其中λ=0.2,Lc和Lv分别是预测与真实序列在坐标和速度(一阶差分)上的Huber损失。 - 训练策略:

- 优化器:AdamW。

- 学习率:3e-4,使用余弦退火,并设置3000步预热(warmup)。

- 权重衰减:1e-4。

- 训练步数:预训练进行3000步。

- 计划采样:训练前60%的步数内,解码器输入使用真实值的概率从100%线性下降到0%。

- 批次大小:未明确说明。

- 关键超参数:

- 模型大小:测试了small, base, large三种尺寸,具体层数、隐藏维度未详细给出。

- 输入/输出窗口:预训练默认输入5秒(150帧@30Hz),预测5秒。

- 分块大小P:未明确说明。

- 嵌入维度d:未明确说明。

- 训练硬件:所有模型在单张NVIDIA A40 GPU上训练约6小时,总计算量约200 petaFLOPs。

- 推理细节:自监督预训练验证和下游任务推理均为完全自回归,无教师强制。下游微调时,情感头输入的块大小(chunk size)在0.5到4秒之间选择。

- 正则化:模型中使用了Dropout(在TCN和Transformer情感头中)和BatchNorm(在TCN和CNN基线中)。

📊 实验结果

论文主要对比了基线方法(统计特征、时序CNN)和不同配置的GLASS模型在两个下游任务上的表现。

实验一:VAD回归任务结果(与ASR生成标签对比)

| 模型 (GLASS Small) | 输入长度 | MAE ↓ | Pearson’s r ↑ |

|---|---|---|---|

| Statistical Features (eyes only) | 2 sec | 0.110±0.01 | 0.157±0.05 |

| 5 sec | 0.110±0.01 | 0.226±0.03 | |

| 10 sec | 0.110±0.01 | 0.223±0.03 | |

| Statistical Features (eyes + face) | 2 sec | 0.110±0.01 | 0.167±0.05 |

| 5 sec | 0.110±0.01 | 0.228±0.03 | |

| 10 sec | 0.110±0.01 | 0.225±0.03 | |

| Eye-Gaze Temporal CNN | 2 sec | 0.105±0.01 | 0.166±0.05 |

| 5 sec | 0.106±0.01 | 0.157±0.06 | |

| 10 sec | 0.108±0.01 | 0.148±0.05 | |

| GLASS (预测2秒) | 2 sec | 0.152±0.03 | 0.230±0.04 |

| 5 sec | 0.161±0.04 | 0.228±0.05 | |

| 10 sec | 0.154±0.02 | 0.167±0.05 | |

| GLASS (预测5秒) | 2 sec | 0.123±0.01 | 0.283±0.04 |

| 5 sec | 0.122±0.00 | 0.284±0.03 | |

| 10 sec | 0.125±0.00 | 0.285±0.04 | |

| GLASS (预测10秒) | 2 sec | 0.119±0.01 | 0.285±0.04 |

| 5 sec | 0.122±0.00 | 0.294±0.03 | |

| 10 sec | 0.122±0.00 | 0.297±0.03 |

实验二:行为分类任务结果(宏F1分数)

| 模型 (GLASS Small) | 输入长度 | F1 ↑ |

|---|---|---|

| Statistical Features (eyes only) | 2 sec | 0.271±0.01 |

| 5 sec | 0.284±0.02 | |

| 10 sec | 0.290±0.02 | |

| Statistical Features (eyes + face) | 2 sec | 0.272±0.02 |

| 5 sec | 0.294±0.02 | |

| 10 sec | 0.303±0.03 | |

| Eye-Gaze Temporal CNN | 2 sec | 0.267±0.02 |

| 5 sec | 0.285±0.02 | |

| 10 sec | 0.293±0.02 | |

| GLASS (预测2秒) | 2 sec | 0.332±0.02 |

| 5 sec | 0.341±0.02 | |

| 10 sec | 0.326±0.01 | |

| GLASS (预测5秒) | 2 sec | 0.367±0.02 |

| 5 sec | 0.361±0.02 | |

| 10 sec | 0.352±0.02 | |

| GLASS (预测10秒) | 2 sec | 0.356±0.01 |

| 5 sec | 0.348±0.01 | |

| 10 sec | 0.347±0.02 |

关键结论:

- 所有GLASS变体在两个任务上基本都优于基线,尤其在行为分类任务(F1)上提升显著。

- 在VAD回归中,预测10秒的GLASS在长输入(10秒)下取得最优r=0.297。在行为分类中,预测5秒的GLASS在5秒输入下取得最优F1=0.361。

- 更长的预训练预测范围(5秒、10秒)通常比短预测范围(2秒)带来更好的下游性能。

消融实验���图表分析

- 图4 展示了GLASS在自监督任务(预测后续眼动)上的验证集性能。所有GLASS模型都显著优于“预测前一帧”(predict-previous)的强基线(相关系数0.767)。更大的模型、更长的输入以及更长的预测范围都能提升自监督性能。

- 图5 是核心消融实验图,横轴为预训练眼动预测的皮尔逊相关系数,纵轴为下游任务指标(负MAE、r、F1)。图中清晰显示出正相关关系(MAE的r=0.28,Exp1的r的r=0.42,Exp2的F1的r=0.48),直接证明了自监督预训练任务的有效性。

- 表3 是针对GLASS Small的消融实验,比较了不同情感预测头(MLP, TCN, GRU, Transformer)在不同输入块大小下的Exp1皮尔逊r。结果显示,1-2秒的块大小通常表现最佳,且TCN/GRU/Transformer等显式建模时序的头优于MLP。

⚖️ 评分理由

- 学术质量:5.5/7:创新性地将自监督学习应用于原始眼动序列,方法设计新颖且合理。技术实现严谨,有详尽的训练细节和消融实验(预测范围、模型大小、情感头类型、预训练性能关联)。主要弱点是下游情感标签的“间接性”和可能的噪声,以及未在更广泛的情感数据集上进行对比验证。

- 选题价值:1.5/2:课题聚焦于利用廉价、易得但质量低的视频数据进行情感计算,方向具有前瞻性和实用价值,对推动情感识别在真实、非受控环境中的应用有重要意义。与音频/语音情感识别领域有很强的相关性和互补性。

- 开源与复现加成:0.5/1:提供了代码仓库链接,论文中对模型架构、训练过程和超参数的描述足够清晰,有助于复现模型主体部分。主要减分项在于核心数据集未公开,无法让其他研究者在相同数据上验证和扩展。