📄 Enabling Multi-Species Bird Classification on Low-Power Bioacoustic Loggers

#生物声学 #知识蒸馏 #时频分析 #边缘计算 #数据集

🔥 8.0/10 | 前25% | #生物声学 | #知识蒸馏 | #时频分析 #边缘计算

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Stefano Ciapponi(Fondazione Bruno Kessler, University of Trento)

- 通讯作者:未说明

- 作者列表:Stefano Ciapponi(Fondazione Bruno Kessler, University of Trento),Leonardo Mannini(Fondazione Bruno Kessler),Jarek Scanferla(Eurac Research),Matteo Anderle(Eurac Research),Elisabetta Farella(Fondazione Bruno Kessler, University of Trento)

💡 毒舌点评

亮点:论文首次在AudioMoth这类极低功耗微控制器上实现了多物种鸟类分类,将理论创新(半可学习滤波器组)与严格的硬件约束验证(77mJ/推理)紧密结合,工程实用性很强。短板:70种鸟类的全景分类准确率(70.1%)与BirdNET在特定子集上的表现相比仍有差距,对于生物声学实际应用而言,高难度物种的识别鲁棒性可能是更关键的瓶颈。

🔗 开源详情

- 代码:论文提供了公开代码仓库链接:

https://github.com/wren-framework/wrennet,包含数据集创建、训练、蒸馏和模型导出脚本。 - 模型权重:论文中未提及是否公开预训练模型权重。

- 数据集:论文中未明确说明该70种鸟类数据集是否公开,但提及了音频来源(Xeno-Canto)和预处理方法,部分数据可能需要根据方法自行构建。

- Demo:论文中未提及在线演示。

- 复现材料:论文提供了详细的训练配置、损失函数权重、优化器设置、数据增强方法以及模型架构参数,复现信息较为充分。

- 论文中引用的开源项目:引用了AudioMoth(硬件平台)、BirdNET(教师模型)、ESC-50(环境声数据集)、CMSIS-NN(推理库)等开源项目或标准工具。

📌 核心摘要

这篇论文旨在解决在资源极度受限的低功耗边缘设备(如AudioMoth,内存≤1MB)上实现连续、实时的多物种鸟类声音分类的难题。其核心方法是提出了WrenNet神经网络架构,该架构采用流式兼容的因果卷积和GRU进行高效时序建模,并创新性地设计了一种半可学习(Semi-learnable)频谱特征提取器,通过可微的参数化频率映射自适应优化鸟类叫声的频谱分辨率。与固定梅尔尺度的特征提取相比,该设计能自动学习适合不同物种的频率过渡点。在由鸟类学家策划的70种阿尔卑斯鸟类数据集上,WrenNet对声学特征明显的物种准确率达90.8%,全任务准确率为70.1%。在AudioMoth设备上部署时,单次3秒推理仅消耗77mJ,比BirdNET在树莓派上运行能效高出16倍以上。这标志着首个在微控制器硬件上实现多物种鸟类分类的实用框架。主要局限性在于对声学相似的复杂物种组(如莺类、雀类)识别准确率(约77%)仍有提升空间。

🏗️ 模型架构

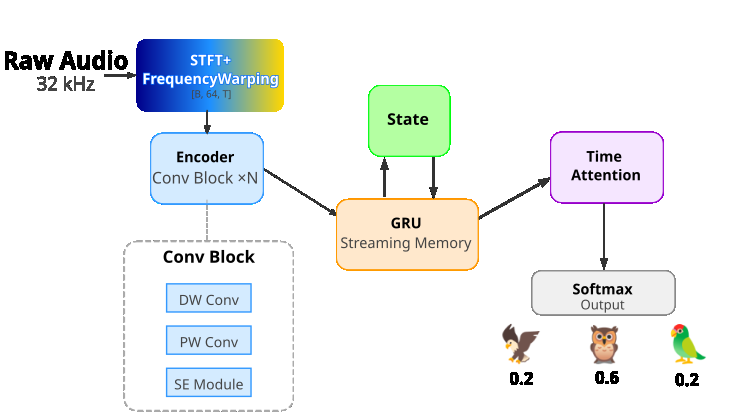

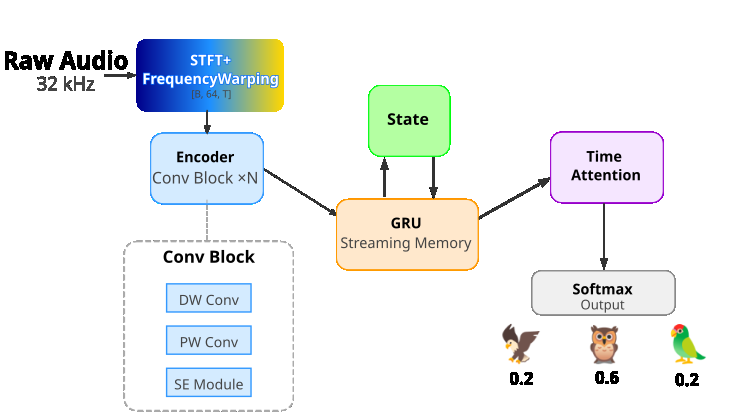

WrenNet是一个为边缘设备流式处理设计的端到端神经网络,其整体流程如论文图1所示,处理一段3秒的音频信号,输出物种分类概率。

- 输入:原始音频波形(32kHz采样率,3秒)。

- 前端(频谱特征提取):

- 首先进行512点FFT和320样本的帧移,得到频谱图。

- 关键创新:半可学习频率映射。它不直接使用固定的梅尔尺度,而是通过两个可学习参数(转折频率

b和过渡宽度w)控制的参数化Sigmoid函数,对数频率映射和线性频率映射进行凸组合。这使得滤波器组在低频区倾向于对数分辨率(符合传统语音处理),在高频区可自适应地过渡到线性分辨率,以更好地捕获鸟类叫声的特征。最终生成64个自适应滤波器的三角滤波器组。

- 卷积编码器:

- 使用3层MatchboxNet风格的因果一维卷积块,每层包含深度可分离卷积和挤压-激励(Squeeze-and-Excitation)通道注意力。

- 所有卷积使用膨胀卷积以扩大感受野,步长为1以保持时间信息密度,且设计为因果性(不依赖未来帧),支持流式处理。

- 层间采用层次跳跃连接,融合局部细节与长程结构。

- 时序建模:

- 使用一个单向GRU(64维隐藏状态)对卷积编码器输出的特征序列进行建模。GRU顺序处理每个时间步的特征,并维护一个紧凑的隐藏状态来表示历史上下文,从而避免了存储整个频谱图,大幅降低内存需求。

- GRU的输出经过基于注意力的时序聚合,自动学习并加权不同时间帧对分类的重要性,得到一个固定长度的上下文向量。

- 分类头:

- 上下文向量通过全连接层映射到71个类别(70种鸟 + “无鸟”类)的概率分布。

设计动机:整个架构在创新性和效率间取得平衡。因果卷积与GRU确保了流式处理的可能性和低内存占用(固定内存开销)。半可学习滤波器组旨在克服梅尔尺度对鸟类声学任务的次优性,同时保持端到端可微分。轻量化的卷积块(如深度可分离)和SE注意力则是在有限算力下提升模型表达能力的关键。

💡 核心创新点

- 半可学习(Semi-learnable)光谱特征提取器:

- 是什么:一个可微的、参数化的频率映射函数,通过Sigmoid函数平滑地混合对数和线性映射。

- 先前局限:梅尔滤波器组基于人类听觉设计,固定强调低频,压缩高频,不适合频谱特征分布多样的鸟类叫声。全可学习滤波器组则训练不稳定且难以解释。

- 如何起作用:通过梯度下降学习转折点

b和过渡宽度w,自动优化频率分辨率分布,为不同鸟类组合定制最佳的频谱表示。 - 收益:在多个实验子集上,其性能(87.2%)优于固定梅尔(79.6%)和全可学习(83.8%)滤波器组。且学习到的参数具有生物声学可解释性(如,高频物种的转折点很低,接近纯线性映射)。

- 流式兼容的轻量级神经架构(WrenNet):

- 是什么:结合因果膨胀卷积、轻量级卷积块(PhiNet/MatchboxNet灵感)、单向GRU和注意力聚合的混合架构。

- 先前局限:BirdNET等模型使用双向网络,需处理完整频谱图,内存消耗大,无法实时流式处理。现有嵌入式方案只支持单物种检测或二分类。

- 如何起作用:因果设计确保仅依赖当前和过去信息;GRU用固定大小的隐藏状态替代频谱图缓存;深度可分离卷积和SE注意力在低算力下最大化特征提取效率。

- 收益:首次在≤1MB RAM的微控制器上实现了多物种分类,单次推理能耗仅77mJ,证明了技术可行性。

- 在严格边缘约束下的系统级验证与基准:

- 是什么:在AudioMoth(ARM Cortex-M4, 80MHz)和树莓派3B+上进行了详尽的实测,对比了BirdNET基线。

- 先前局限:多数研究仅停留在模型准确率对比,缺乏在目标低功耗硬件上的端到端能耗、时延和功耗数据。

- 如何起作用:通过模型量化(TF Lite)、硬件特定优化(CMSIS-NN for AudioMoth)和系统集成,提供了从算法到部署的完整参考。

- 收益:提供了具有说服力的实际部署数据(见下文实验结果表),为该领域的研究者和实践者设立了效率标杆。

🔬 细节详述

- 训练数据:

- 数据集:70种阿尔卑斯山区鸟类,来源于Xeno-Canto,通过自动化管道获取。

- 规模:下载150,645个音频文件,预处理后得到150,557个3秒片段。预处理包括重采样(32kHz)、带通滤波(150Hz-16kHz)、基于振幅包络的自适应峰值检测以定位鸣叫段。

- “无鸟”类构建:从鸟类录音的低能量段和ESC-50环境声音中选取(如雨声、风声、车辆声等),并排除所有鸟类和城市相关类别。

- 训练策略:

- 知识蒸馏:使用BirdNET-Analyzer作为教师网络,提供置信度>0.05的预测作为软标签。

- 损失函数:

L = 0.6 L_focal + 0.4 L_soft。L_focal是焦点损失(γ=4.0),用于处理类别不平衡。L_soft是带温度(T=3.0)的KL散度,用于拟合教师输出。 - 优化器与调度:AdamW优化器(学习率1e-3,权重衰减0.01),余弦退火调度,训练150轮。关键:滤波器参数(

b,w)使用更高的学习率(分别为15倍和5倍),并采用交替训练策略(联合训练、主网络优化、滤波器参数优化循环),辅以梯度噪声和周期性扰动,以帮助其逃离局部最优。 - 数据增强:加性噪声注入、时频掩蔽、时间平移、速度扰动。

- 关键超参数:

- 输入:32kHz, 3秒。

- FFT:512点, 帧移320样本。

- 滤波器组:64个(半可学习配置)。

- 模型大小:论文测试了57k参数和136k参数两种版本。

- 卷积前端:3层, 基础滤波器数32。

- GRU:隐藏状态维度64。

- 训练硬件:论文中未说明。

- 推理细节:在设备上以200ms为块处理3秒音频。AudioMoth使用CMSIS-NN库进行推理优化。

📊 实验结果

论文提供了在定制的70种鸟类数据集上的性能对比,以及在真实硬件上的能效基准。

表1:不同物种子集和配置下的分类性能(部分关键行)

| 配置 | 物种数 | 训练轮数 | 测试准确率(%) | F1(%) | 学生准确率(%) | BirdNET准确率(%) | 学习到的转折点(Hz) |

|---|---|---|---|---|---|---|---|

| 单类 (渡鸦) | 1 | 94 | 92.37 | 92.62 | 90.15 | 91.16 | 1955 |

| 单类 (戴胜) | 1 | 45 | 94.71 | 94.67 | 86.35 | 89.45 | 5269 |

| 容易物种 (半可学习) | 8 | 116 | 90.76 | 90.90 | 89.85 | 91.04 | 1.5 |

| 困难物种 | 13 | 134 | 77.47 | 77.97 | 73.90 | 82.86 | 1224 |

| 高频子集 | 5 | 93 | 91.49 | 91.55 | 90.23 | 92.74 | 164 |

| 低频子集 | 4 | 126 | 91.63 | 91.67 | 85.15 | 91.01 | 237 |

| 全数据集 (136k参数) | 70 | 75 | 70.14 | 70.81 | - | - | 1390 |

关键结论:WrenNet在声学特征明显的物种上达到90%以上准确率,但在全70类任务上准确率为70.1%。学习到的转折点随物种和任务复杂度变化,显示出自适应性。

表2:不同滤波器组方法在8种鸟类上的对比

| 滤波器组类型 | 学习模式 | 最佳验证准确率(%) | 测试准确率(%) |

|---|---|---|---|

| 梅尔 | 固定 | 82.49 | 79.61 |

| 线性三角 | 固定 | 82.10 | 81.45 |

| 对数-线性组合 | 半可学习 | 85.74 | 87.22 |

| 全可学习 | 全可学习 | 84.26 | 83.83 |

关键结论:在同等条件下,半可学习特征提取器优于梅尔和全可学习方法。

表3:设备上基准测试结果

| 设备 | 单次推理能耗 (J) | 推理时间 (s) | 功率 (W) |

|---|---|---|---|

| AudioMoth (本文CMSIS-NN) | 0.077 | 1.69 | 0.046 |

| RPi 3B+ (本文TF Lite) | 0.172 | 0.061 | 2.80 |

| RPi 3B+ (BirdNET, 8bit) | 2.79 | 0.978 | 2.84 |

关键结论:WrenNet在AudioMoth上能耗极低(77mJ),在树莓派上相比BirdNET实现16倍能耗和速度提升。

此图实际为图1(架构图),论文中图2(频率映射对比图)未提供URL,故根据描述说明:该图展示了在固定转折点b=4000Hz下,不同过渡宽度w的Sigmoid映射与纯对数、纯线性、梅尔映射的频率曲线对比,直观显示了半可学习方法的灵活性。

此图实际为图1(架构图),论文中图2(频率映射对比图)未提供URL,故根据描述说明:该图展示了在固定转折点b=4000Hz下,不同过渡宽度w的Sigmoid映射与纯对数、纯线性、梅尔映射的频率曲线对比,直观显示了半可学习方法的灵活性。

⚖️ 评分理由

- 学术质量:6.0/7。论文提出了清晰的技术问题(边缘多物种分类),并给出了系统性的解决方案(半可学习特征提取 + 流式轻量架构)。创新点明确,技术实现合理。实验设计较为充分,包含了多个物种子集的消融研究、不同滤波器组的对比、以及关键的边缘硬件实测数据。扣分点在于,对于提出的70类全任务,其70.1%的准确率与该领域当前最强的云端模型(如BirdNET在特定子集上更高)相比,并未达到显著突破,且缺乏与其他边缘部署方案(如TinyChirp)的直接准确率对比。

- 选题价值:1.5/2。边缘计算与生物声学监测的交叉是一个重要且活跃的应用方向,具有明显的实际环境监测价值。论文成果为低成本、大范围、长期生态监测提供了可行的技术路径,对相关领域的研究者和工程师有较高参考价值。

- 开源与复现加成:0.5/1。论文明确提供了代码仓库链接(

https://github.com/wren-framework/wrennet),并详细描述了训练策略、超参数和数据预处理流程。这为复现工作提供了良好基础。但未明确提及是否开源预训练模型权重,也未说明所用数据集的公开获取方式(仅说明了来源),因此加分有限。