📄 EmoTri-RL: Emotion- and Cause-Aware Reinforcement Learning for Multi-Modal Empathetic Dialogue

#语音情感识别 #强化学习 #多模态模型 #生成模型 #多任务学习

✅ 7.0/10 | 前25% | #语音情感识别 | #强化学习 | #多模态模型 #生成模型

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Zhongtian Hu(Northwestern Polytechnical University)

- 通讯作者:Changhong Jiang(Northwestern Polytechnical University, Email: chjiang@nwpu.edu.cn)

- 作者列表:Zhongtian Hu(Northwestern Polytechnical University)、Changhong Jiang*(Northwestern Polytechnical University)、Mingting Yu(未说明)、Wei Zhang(未说明)、Jiashi Lin(未说明)

💡 毒舌点评

本文的亮点在于系统性地将共情对话生成分解为三个明确任务(生成、情感识别、情感原因识别)并通过多模态融合与强化学习统一解决,这种“解耦再融合”的框架设计清晰且具有启发性。然而,论文的短板也相当明显:开源信息完全缺失,且消融实验虽多,但未提供人工评估的消融结果,使得“每个组件都必要”的结论在用户最终关心的“共情质量”上证据稍显单薄。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及公开的模型权重。

- 数据集:论文使用了IEMOCAP和MELD公共数据集,并提及按照REC-CON协议扩展了情感原因标注,但未提供扩展后的数据集或获取方式。

- Demo:未提及在线演示。

- 复现材料:给出了PPO阶段的学习率、裁剪范围等部分超参数,但缺少监督预热阶段的完整配置、优化器、batch size、训练硬件与总时长、最终模型检查点等信息。

- 论文中引用的开源项目:引用了并可能使用了以下预训练模型:BART (文本编码/解码), Wave2Vec 2.0 (语音编码), ViT (视觉编码), OpenFace (用于提取视觉特征), BERT (用于计算奖励中的语义保真度)。

📌 核心摘要

- 要解决什么问题:现有的共情对话生成系统主要依赖文本,忽略了语音、视觉等模态的情感线索(问题一);忽视了情感产生的原因,导致生成回复缺乏可解释性(问题二);以及普遍采用最大似然估计训练,其优化目标与共情所需的主观、微妙质量不匹配(问题三)。

- 方法核心是什么:本文提出了EmoTri-RL框架,一个“三模态三任务”的强化学习模型。它首先利用预训练模型提取文本、语音、视觉特征并进行融合,然后在一个统一的解码器中联合执行响应生成、情感识别和情感原因识别三个任务,最后采用带有包含语义保真度、情感对齐和原因一致性三项奖励信号的近端策略优化进行训练。

- 与已有方法相比新在哪里:与大多数仅使用文本或简单融合多模态信息的方法相比,其新意在于:a) 引入情感原因识别任务作为显式监督,为生成的共情回复提供可解释的因果依据;b) 设计了多信号强化学习奖励,直接优化共情相关的多个维度,而非仅模仿参考文本。

- 主要实验结果如何:在IEMOCAP和MELD数据集上,EmoTri-RL在几乎所有自动评估指标上均优于强基线。在IEMOCAP数据集上,与最强基线(IAMM)相比,困惑度(PPL)从38.40降至29.90(提升约22.1%), Dist-2从5.09飙升至11.50(提升125.7%),情感识别准确率从69.72%提升至72.80%,BERTScore从81.69提升至85.10。人工评估和LLM评估(GPT-4o)显示,在共情、连贯性、流畅性方面,本模型对CASE和IAMM的胜率均超过65%。消融实验表明,移除强化学习或多模态输入会导致性能显著下降。

- 实际意义是什么:该工作为构建更可信、更具可解释性的情感支持对话系统(如心理健康咨询、教育辅导)提供了一个有效的技术框架,其核心思路(融合原因识别与多模态强化学习)可推广至其他需要高度情境理解和情感智能的交互场景。

- 主要局限性是什么:论文的局限性包括:a) 实验仅在英文数据集(IEMOCAP, MELD)上进行,其在多语言环境下的泛化能力未知;b) 所提框架依赖大量标注数据(情感标签和原因跨度标注),数据获取成本高;c) 论文未提供代码或模型,复现门槛较高。

🏗️ 模型架构

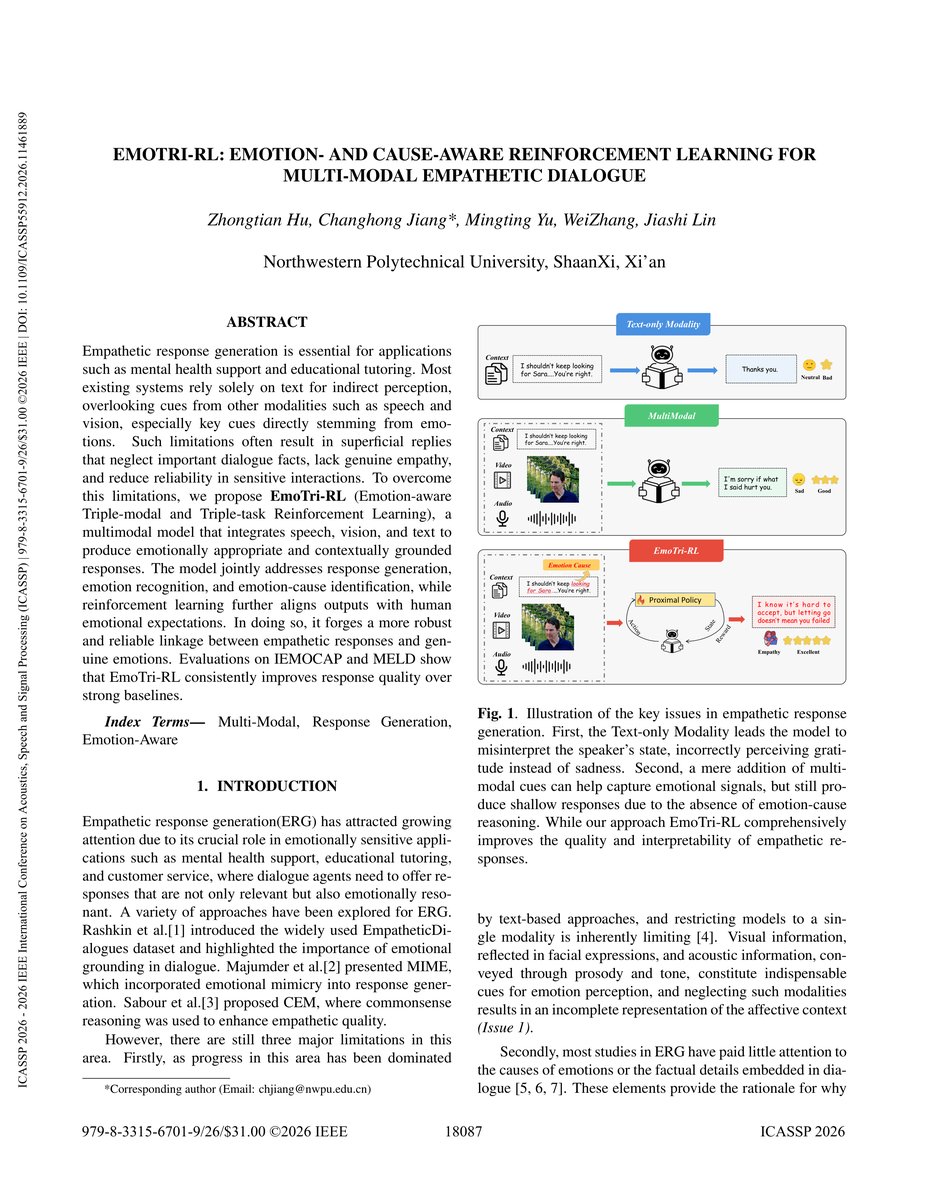

图1 阐述了本工作的核心动机:仅用文本模态(Text-only Modality)可能误判情感(如将悲伤误解为感激);即使加入多模态线索(MultiModal),若不进行情感原因推理,生成的回复仍可能肤浅。本文的EmoTri-RL旨在通过多模态融合与原因感知来生成高质量、可解释的共情回复。

图1 阐述了本工作的核心动机:仅用文本模态(Text-only Modality)可能误判情感(如将悲伤误解为感激);即使加入多模态线索(MultiModal),若不进行情感原因推理,生成的回复仍可能肤浅。本文的EmoTri-RL旨在通过多模态融合与原因感知来生成高质量、可解释的共情回复。

图2 展示了EmoTri-RL的完整架构,主要包含三个模块:

图2 展示了EmoTri-RL的完整架构,主要包含三个模块:

- 多模态特征提取 (Multi-Modalities Feature Extraction):使用三个预训练的骨干网络分别处理三种输入模态:BART 编码器处理文本,Wave2Vec 2.0 处理语音,ViT (Vision Transformer) 处理视频帧的视觉特征。这些模态特定的表示(Htext, Hspeech, Hvision)被送入下一个模块。

- 文本中心的多模态融合:该模块使用一个以文本为中心的融合策略。它通过交叉注意力机制,将语音和视觉特征投影并整合到文本特征的表示空间中,生成一个统一的多模态隐藏状态序列H。这种设计保留了文本的序列结构,同时为每个文本token注入了跨模态线索。

- 情感与因果感知的共情响应生成 (Emotion- and Cause-aware ERG):这是模型的核心任务部分,基于融合后的表示H,联合执行三个任务:

- 情感原因跨度预测:受REC-CON协议启发,模型使用两个分类器(预测起始位置和结束位置)来预测对话中触发情感的文本片段(span)。这为情感提供了显式的、可追溯的文本依据。

- 情感识别:对融合后的隐藏状态进行池化,通过一个分类器预测对话整体的情感类别。

- 响应生成:条件化于多模态表示H,BART解码器自回归地生成共情回复。

- 三任务优化 (Tri-task Optimization):训练采用近端策略优化 (PPO) 强化学习算法。策略(即整个模型)生成响应、情感预测和原因跨度预测。其奖励函数R是三个信号的加权组合:语义保真度 (Rsem)(生成回复与参考回复的BERTScore相似度)、情感对齐度 (Remo)(对正确情感标签的置信度)、原因一致性 (Rcause)(预测的原因跨度与真实跨度的token级重叠)。这个复合奖励引导模型同时优化回复的相关性、情感恰当性和可解释性。

💡 核心创新点

- 引入情感原因识别作为辅助任务:这是本文最显著的创新。之前工作多停留在识别“是什么”情感,而忽略了“为什么”产生该情感。EmoTri-RL显式地建模情感原因,将因果推理注入响应生成过程,使得最终回复不仅能表达共情,还能体现对引发情感的事实的理解,从而提升可解释性和深度。

- 设计多信号强化学习奖励函数:针对传统MLE训练目标(如困惑度)无法直接优化共情质量的问题,本文设计了一个包含语义、情感、因果三个维度的奖励函数。这种多目标奖励机制能更直接地引导模型生成符合人类对共情期望的回复。

- 文本中心的跨模态融合策略:在多模态融合上,采用以文本序列为中心的交叉注意力机制,将语音和视觉信息“注入”到文本表征中。这种方法在保留文本上下文流的同时,丰富了每个词的模态上下文,为后续的生成和预测任务提供了信息更密集的表示。

- 三任务联合学习框架:将响应生成、情感识别、原因识别三个任务耦合在一个编码器-解码器框架中联合训练。情感和因果识别任务作为显式的监督信号,能促使编码器学习到更具情感区分度和因果相关性的特征,从而反哺主任务(响应生成)的质量。

🔬 细节详述

- 训练数据:在两个公开数据集上进行实验:IEMOCAP(约12小时,包含对齐的音视频和文本,标注有情感类别)和MELD(源自《老友记》,大规模多模态多角色对话数据集,标注有情感标签)。数据预处理:论文指出,两个数据集的标注均按照REC-CON协议进行了情感原因跨度的标注扩展。未提及具体数据增强方法。

- 损失函数:训练采用两阶段策略。第一阶段为监督学习预热,使用交叉熵损失分别优化三个任务(情感识别、原因跨度预测、响应生成)。第二阶段为强化学习,使用PPO算法,其损失函数为标准的PPO代理目标函数(

L_PPO(θ) = Et[min(rt(θ)At, clip(rt(θ), 1−ϵ, 1+ϵ)At)]),其中At是优势函数估计。奖励函数:R(ŷ, ê, ŝ) = α·Rsem + β·Remo + γ·Rcause。其中α=1.0, β=0.5, γ=0.5,各分项归一化并缩放至[-5, 5]范围后聚合。 - 训练策略:两阶段训练。第一阶段(监督预热):使用交叉熵损失,学习率等参数未说明。第二阶段(强化学习):采用PPO,学习率

1×10−5,裁剪范围ϵ=0.2,价值损失系数0.5,熵系数0.01。优化器:未明确说明,通常为Adam或AdamW。 - 关键超参数:预训练编码器:BART (文本), Wave2Vec 2.0 (语音), ViT-base (视觉)。融合后的隐藏维度

d=1024。用于多模态对齐的交叉注意力层数为2层。BART解码器用于生成。 - 训练硬件:论文中未提及GPU型号、数量及训练时长。

- 推理细节:论文未明确说明解码策略(如贪心、束搜索)、温度参数或流式处理设置。PPO策略本身在推理时即为生成回复的模型。

- 正则化或稳定训练技巧:PPO本身通过裁剪范围

ϵ和熵系数来稳定训练和防止策略崩溃。

📊 实验结果

主要基准测试结果 论文在IEMOCAP和MELD数据集上,与多个强基线(MIME, CEM, SEEK, CASE, IAMM)进行了自动评估对比。下表列出了关键指标(数据来自论文表1):

| 数据集 | 方法 | PPL↓ | Dist-1 | Dist-2↑ | Acc.↑ | BERTScore↑ |

|---|---|---|---|---|---|---|

| MELD | MIME | 52.42 | 0.62 | 2.78 | 53.60 | 74.19 |

| CEM | 53.68 | 0.91 | 4.28 | 58.40 | 76.59 | |

| SEEK | 51.44 | 1.12 | 5.38 | 59.45 | 81.01 | |

| CASE | 41.30 | 1.16 | 5.81 | 62.35 | 80.73 | |

| IAMM | 39.02 | 1.42 | 6.55 | 61.74 | 82.99 | |

| Ours | 30.50 | 2.83 | 9.97 | 67.10 | 84.90 | |

| IEMOCAP | MIME | 49.63 | 0.88 | 2.81 | 61.49 | 77.34 |

| CEM | 49.03 | 0.97 | 3.62 | 61.87 | 76.21 | |

| SEEK | 44.81 | 0.97 | 3.81 | 63.25 | 79.43 | |

| CASE | 37.48 | 1.11 | 4.11 | 65.00 | 81.38 | |

| IAMM | 38.40 | 1.31 | 5.09 | 69.72 | 81.69 | |

| Ours | 29.90 | 3.25 | 11.50 | 72.80 | 85.10 |

与最强基线差距:在IEMOCAP上,相比IAMM,PPL降低8.5(相对提升22.1%),Dist-2提升6.41(相对提升125.7%),准确率提升3.08个百分点,BERTScore提升3.41。在MELD上,相比IAMM,PPL降低8.52(相对提升21.8%),Dist-2提升3.42(相对提升52.2%),准确率提升5.36个百分点,BERTScore提升1.91。

人工评估与LLM评估结果(来自论文表2)

| 比较 | 人类评估胜率(%) | LLM (GPT-4o) 评估胜率(%) |

|---|---|---|

| Emp. | Coh. | |

| Ours vs. CASE | 68.5 | 70.2 |

| Ours vs. IAMM | 65.3 | 67.8 |

结论:EmoTri-RL在共情、连贯性、流畅性三个维度上均优于强基线。

关键消融实验(在IEMOCAP数据集上,来自论文表3)

| 变体 | PPL↓ | Dist-2↑ | Acc.↑ | BERTScore↑ |

|---|---|---|---|---|

| Full Model (Ours) | 29.90 | 11.50 | 72.80 | 85.10 |

| w/o RL | 32.41 | 9.87 | 70.25 | 83.73 |

| w/o ERC (情感识别) | 31.68 | 10.06 | 71.27 | 84.02 |

| w/o ECR (原因识别) | 31.22 | 10.25 | 71.64 | 84.26 |

| w/o Multi-modal | 33.13 | 8.97 | 69.50 | 83.19 |

结论:移除任何一个组件都会导致性能下降。移除多模态信息(w/o Multi-modal)造成整体性能下降最大,证实了语音视觉线索的重要性。移除强化学习(w/o RL)对PPL和BERTScore影响显著,说明RL对优化生成质量至关重要。

⚖️ 评分理由

- 学术质量:5.5/7:论文具有清晰的“问题-方法-实验”逻辑链,创新点明确(原因识别+多信号RL),技术路线合理。实验在两个标准数据集上充分展开,并与多个强基线对比,消融实验也验证了各模块的有效性。然而,其创新更多是在已有框架上的组合优化(引入原因任务、设计复合奖励),而非提出全新的基础架构或算法,属于扎实的改进型工作。部分关键细节(如完整的训练超参数、硬件环境)缺失。

- 选题价值:1.5/2:共情对话生成是情感计算和人机交互的前沿方向,具有重要的社会应用价值(如心理健康支持)。本文聚焦于“多模态”和“可解释性”两个关键痛点,选题精准且重要,与语音/多模态处理读者高度相关。但其具体应用场景可能受限于数据标注的高成本和特定文化语境。

- 开源与复现加成:0.0/1:论文未提供代码仓库、预训练模型或扩展后的数据集。虽然给出了部分训练细节(如PPO参数、奖励权重),但缺少优化器、batch size、训练轮数、具体硬件等信息,完整复现存在较大障碍。因此,开源与复现加成为0。