📄 EMG-to-Speech with Fewer Channels

#语音合成 #多任务学习 #少样本 #数据增强 #生物声学

✅ 7.5/10 | 前25% | #语音合成 | #多任务学习 | #少样本 #数据增强

学术质量 5.5/7 | 选题价值 1.5/2 | 复现加成 0.5 | 置信度 高

👥 作者与机构

- 第一作者:Injune Hwang (首尔大学 智能与信息学系)

- 通讯作者:Kyogu Lee (首尔大学 智能与信息学系 / 人工智能研究所 / 人工智能跨学科项目)

- 作者列表:Injune Hwang (首尔大学 智能与信息学系), Jaejun Lee (首尔大学 智能与信息学系), Kyogu Lee (首尔大学 智能与信息学系 / 人工智能研究所 / 人工智能跨学科项目)

💡 毒舌点评

论文最大的亮点在于实验设计的系统性,通过贪心消除、穷举子集和音素分析三管齐下,将“哪些通道更重要”这个问题从工程选择上升到了对肌肉运动互补性的理解层面,其提出的“通道dropout微调”方案也切实有效。然而,所有结论和实验均局限于单说话人公开数据集,这使得其“推动实用化”的宣称在迈向真实、多变的用户场景时显得说服力不足,且模型架构本身并未跳出Gaddy et al. [13] 的框架。

🔗 开源详情

- 代码:论文中提供了开源代码仓库链接:

https://github.com/SPJune/SS_by_Channel。 - 模型权重:论文中未提及是否公开预训练模型权重。

- 数据集:实验使用的数据集(Gaddy et al. [5])为公开数据集。

- Demo:论文中未提及提供在线演示。

- 复现材料:论文说明了遵循官方预处理流程,并给出了通道dropout的具体概率设置。但未提供完整的训练超参数(如优化器、学习率、批大小)。

- 论文中引用的开源项目:

- 模型架构基于Gaddy et al. [13] 的开源代码库:

https://github.com/dgaddy/silent_speech - 声码器使用了HiFi-GAN [16]���

- 语音识别使用了OpenAI的Whisper模型 [17]。

- 模型架构基于Gaddy et al. [13] 的开源代码库:

📌 核心摘要

- 解决问题:表面肌电图(EMG)驱动的无声语音接口性能高度依赖传感器通道数量和位置,但减少通道会导致性能下降。本文旨在系统研究通道重要性,并缓解通道减少带来的性能损失。

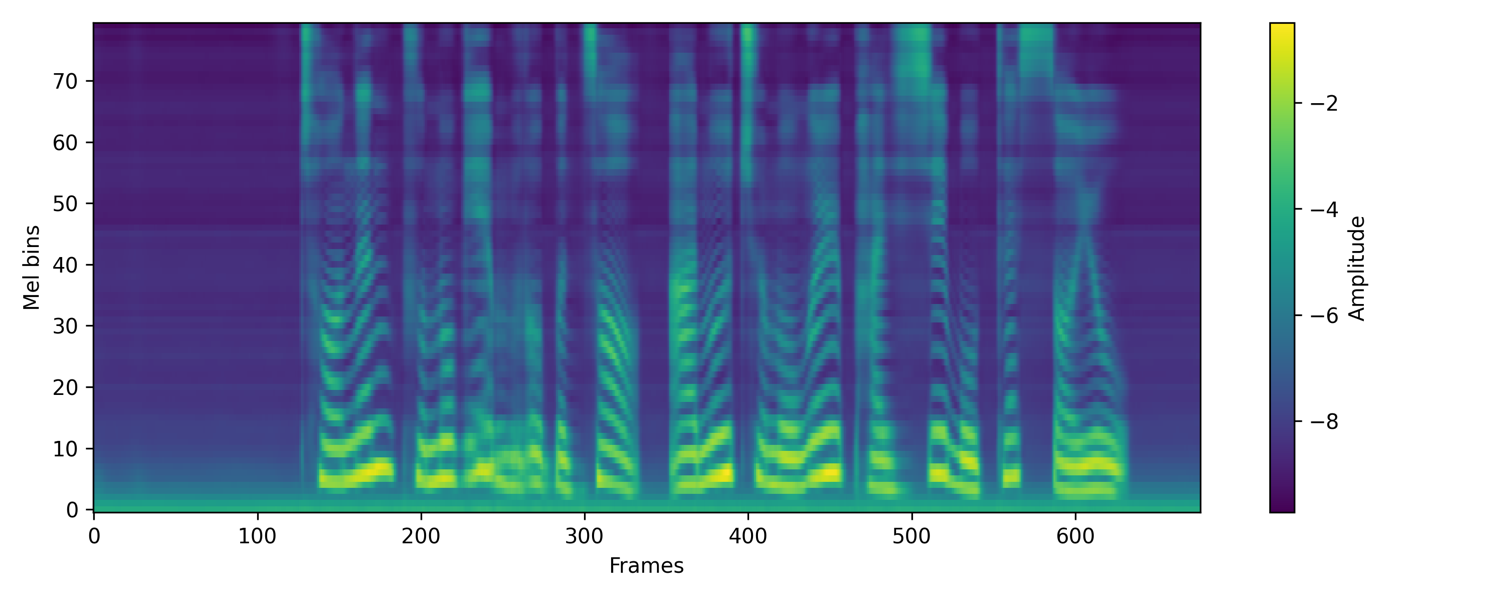

- 方法核心:采用基于卷积和Transformer的EMG编码器模型,通过预测梅尔谱图(语音合成)和音素标签(多任务学习)进行预训练。核心策略是在预训练时引入通道dropout(随机屏蔽部分通道),然后在减少通道的子集上进行微调。

- 新意:(1) 通过贪心消除和穷举评估所有4通道组合(70种),系统量化了单个通道及通道组合的重要性,揭示了通道间的互补性;(2) 进行了音素级别的消融分析,将通道作用与具体语音学范畴(如擦音、塞音)关联;(3) 提出并验证了基于通道dropout的预训练-微调策略优于从头训练。

- 主要结果:

- 4通道子集的最佳WER为47.2%(通道{1,3,5,6}),优于贪心选择的{1,2,3,4}(48.1%)。各通道在所有4通道子集中出现的平均WER排名为:3(51.4) < 2(52.3) < 1(52.6) < 5(52.8) < 6(53.1) < 4(53.7) < 7(53.8) < 8(54.8)。

- 音素分析表明,去除不同通道对不同类别音素影响显著(如去除通道8对双唇音影响最大,去除通道7对高前元音影响最大)。

- 在4-6通道设置下,微调模型(基于8通道预训练权重)的WER一致性地低于从头训练的模型。例如,对于4通道最佳子集,微调(dropout p=0)WER为47.2%,而从头训练约为49.5%(根据图3估算)。

- 实际意义:证明了通过智能的训练策略(预训练+通道dropout+微调),可以在使用更少、更少侵入性传感器时,保持可接受的语音重建性能,有助于开发更轻便、实用的无声语音设备。

- 主要局限性:(1) 实验仅在单一说话人、单一数据集(Gaddy et al. [5])上验证,结论对其他说话人或场景的泛化能力未知;(2) 最佳通道子集和dropout概率对具体数据集和任务敏感,缺乏普适性指导;(3) 未与近期其他先进的EMG-to-speech模型(如基于扩散的模型)进行对比。

🏗️ 模型架构

论文沿用了Gaddy et al. [13] 提出的EMG-to-speech框架(如图1所示),其核心是一个结合了卷积层和Transformer层的序列模型。

- 输入:8通道的表面肌电图(EMG)信号,经预处理后形成时序特征。每个通道对应面部/颈部特定肌肉位置的电活动。

- EMG编码器:主体为卷积层(用于局部特征提取)与Transformer层(用于建模长程时序依赖)的混合架构。编码器输出一个高维的上下文表示。

- 输出头与多任务学习:

- 梅尔谱图预测头:一个线性投影层,将编码器输出映射为梅尔谱图。训练目标是最小化预测梅尔谱图与真实语音梅尔谱图之间的重建损失(如L1/L2损失)。

- 音素分类头:另一个线性投影层,将编码器输出映射为音素概率分布。训练目标是最小化音素分类的交叉熵损失。

- 推理流程:在推理时,模型输入EMG信号,输出预测的梅尔谱图。该梅尔谱图再输入一个预训练的HiFi-GAN声码器,最终合成出可听的语音波形。论文还使用Whisper ASR模型将合成语音转录为文本,以计算词错误率(WER)作为最终评估指标。

- 关键设计:论文的核心改动在于通道dropout模块(仅在预训练的微调变体中使用)。这是一个在训练时应用的随机掩码层,以一定概率独立地屏蔽输入EMG的各个通道,迫使模型学习更鲁棒的、不依赖于特定通道组合的特征表示。在推理时不使用此模块。

💡 核心创新点

- 系统性的EMG通道重要性分析框架:超越了以往研究中零散的、基于随机子集或启发式选择的方法,设计了贪心消除、穷举评估(所有4通道组合)和音素级别消融三组互补实验,全面揭示了通道的独立贡献、互补关系及对特定语音学范畴的作用。

- 通道间互补性的实证发现:实验证明,单个重要的通道(如通道2、3)在组合中不一定是最优解,而一些单独看来不那么重要的通道(如通道6)可能在特定组合中提供关键信息。这强调了“整体大于部分之和”,为通道选择提供了组合优化的视角。

- 基于通道Dropout的预训练-微调策略:提出了一种简单有效的训练流程来缓解通道减少的性能损失。在8通道数据上预训练时引入通道随机丢弃,使模型“见过”各种通道缺失的情况,从而在微调至特定少通道子集时能更快收敛并获得更好的性能,尤其是在4-5通道的设置下。

🔬 细节详述

- 训练数据:使用Gaddy et al. [5] 的公开数据集。数据包含约16小时的开放词汇EMG录音(单说话人),8通道表面EMG与同步音频波形配对,并带有音素和单词级转录。论文未使用其中4小时的闭集词汇数据。遵循了官方GitHub仓库的标准预处理流程。

- 损失函数:多任务损失,结合了:

- 梅尔谱图重建损失:用于语音合成任务,论文未明确指定损失类型,但根据前作[13],通常是L1或L2损失。

- 音素分类损失:用于音素识别任务,为标准的交叉熵损失。

- 论文未明确说明这两个损失的权重分配。

- 训练策略:论文未在正文中明确给出学习率、优化器、批大小、训练步数/轮数等关键超参数。模型架构直接采用Gaddy et al. [13]的设置,仅调整了第一层卷积的输入通道数以匹配不同的输入通道数量。

- 通道Dropout细节:在预训练阶段应用。对于每个训练样本的每个通道,以概率

p将其置零。论文测试了p = {0, 0.125, 0.25},分别对应平均保留8、7、6个通道。掩码在时间维度上广播应用。推理时不使用。 - 训练硬件:论文中未说明。

- 推理细节:使用预训练的HiFi-GAN声码器将梅尔谱图转换为波形,并使用Whisper(medium)模型进行转录以计算WER。

📊 实验结果

主要评估:使用Gaddy数据集,指标为词错误率(WER)和音素错误率(PER)。

- 通道重要性分析结果

表1:性能最优的10个4通道子集 (WER%)

| 子集 | 通道1 | 通道2 | 通道3 | 通道4 | 通道5 | 通道6 | 通道7 | 通道8 | WER |

|---|---|---|---|---|---|---|---|---|---|

| 1 | 1 | 0 | 1 | 0 | 1 | 1 | 0 | 0 | 47.2 |

| 2 | 0 | 1 | 1 | 0 | 1 | 0 | 1 | 0 | 47.3 |

| 3 | 1 | 0 | 1 | 1 | 0 | 1 | 0 | 0 | 47.7 |

| 4 | 1 | 1 | 1 | 0 | 0 | 0 | 0 | 1 | 48.3 |

| 5 | 1 | 1 | 1 | 0 | 1 | 0 | 0 | 0 | 48.4 |

| 6 | 0 | 1 | 1 | 1 | 0 | 0 | 1 | 0 | 48.6 |

| 7 | 1 | 1 | 1 | 0 | 0 | 1 | 0 | 0 | 48.8 |

| 8 | 1 | 0 | 1 | 1 | 1 | 0 | 0 | 0 | 49.0 |

| 9 | 1 | 1 | 0 | 1 | 1 | 0 | 0 | 0 | 49.6 |

| 10 | 0 | 1 | 1 | 0 | 0 | 1 | 1 | 0 | 49.6 |

注:“1”表示该通道被包含在子集中,“0”表示被排除。

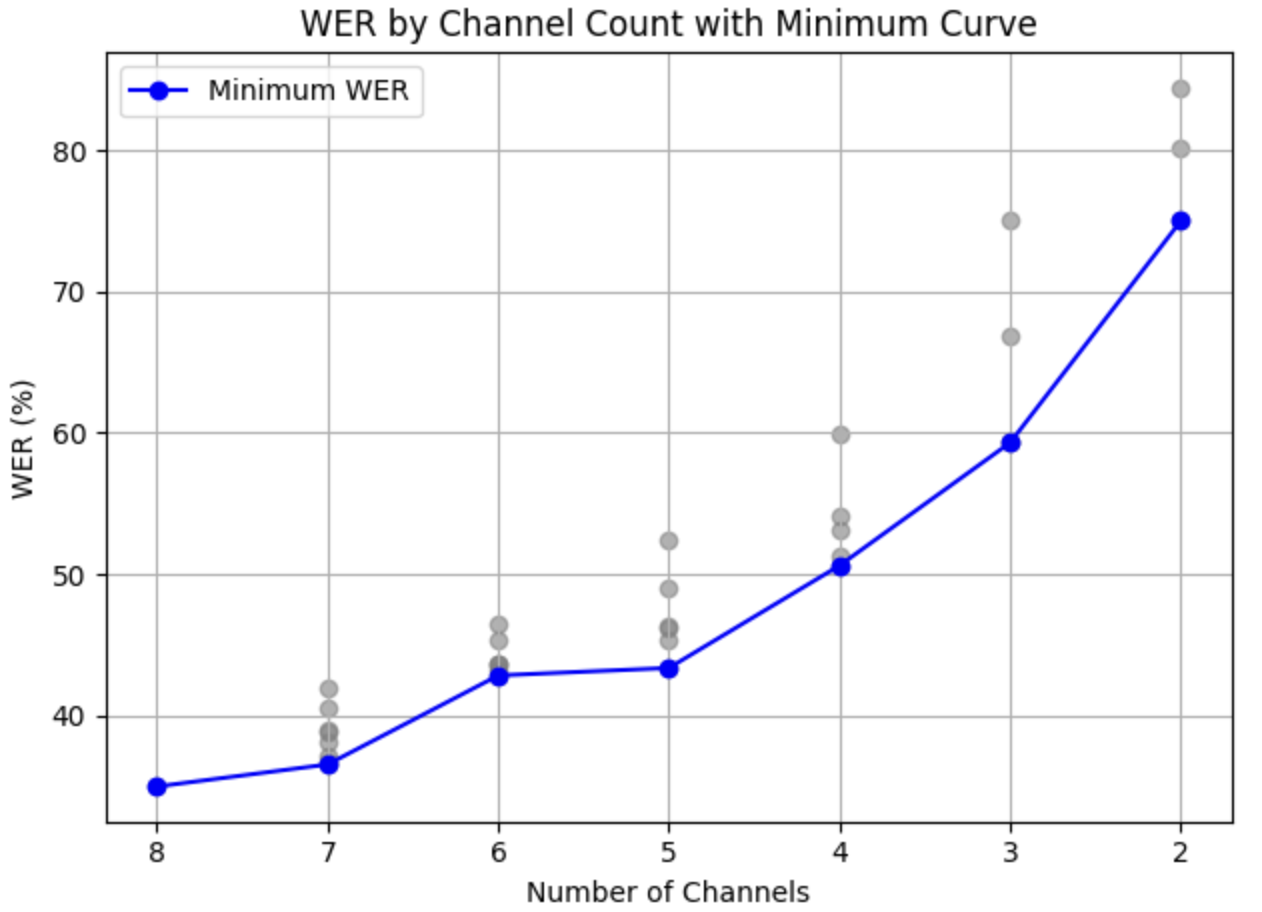

图2展示了贪心消除法得到的不同通道数量下的最佳WER(蓝色连线)。随着通道减少,WER整体上升,但存在波动(如某些更少通道的子集性能优于更多通道的子集),说明了通道冗余或噪声的存在。

图2展示了贪心消除法得到的不同通道数量下的最佳WER(蓝色连线)。随着通道减少,WER整体上升,但存在波动(如某些更少通道的子集性能优于更多通道的子集),说明了通道冗余或噪声的存在。

表2:基于所有4通道子集的通道平均WER排名

| 排名 | 通道 | 平均WER(%) |

|---|---|---|

| 1 | 3 | 51.4 |

| 2 | 2 | 52.3 |

| 3 | 1 | 52.6 |

| 4 | 5 | 52.8 |

| 5 | 6 | 53.1 |

| 6 | 4 | 53.7 |

| 7 | 7 | 53.8 |

| 8 | 8 | 54.8 |

- 音素错误率分析结果 论文给出了去除每个通道后(7通道设置),各类别音素PER相对于8通道基线的增加情况。关键发现如下表所示(仅列出部分关键类别):

| 音素类别 | 8通道 PER(%) | 最差PER(%) | 最关键通道 |

|---|---|---|---|

| 总PER | 16.0 | 17.1 | 8 |

| 辅音 | 20.9 | 22.7 | 3 |

| 清音 | 22.4 | 25.3 | 3 |

| 擦音 | 19.4 | 23.2 | 3 |

| 塞音 | 26.4 | 27.6 | 7 |

| 双唇音 | 21.6 | 25.2 | 8 |

| 舌尖音 | 21.4 | 23.0 | 3 |

| 高元音 | 21.7 | 28.8 | 7 |

| 前元音 | 24.4 | 28.8 | 7 |

- 微调策略结果

图3是本文最核心的结果图,展示了在不同通道数量(7,6,5,4)和不同预训练通道dropout概率(p=0, 0.125, 0.25)下,微调模型(Fine-tune)与从头训练(Scratch)模型的WER对比。蓝色虚线为8通道基线性能。

关键结论:

图3是本文最核心的结果图,展示了在不同通道数量(7,6,5,4)和不同预训练通道dropout概率(p=0, 0.125, 0.25)下,微调模型(Fine-tune)与从头训练(Scratch)模型的WER对比。蓝色虚线为8通道基线性能。

关键结论:

- 在4, 5, 6通道设置下,微调模型(所有p值)的WER均低于从头训练的模型,验证了预训练策略的有效性。

- 最佳dropout概率因通道数而异:6通道和4通道时,p=0(无dropout) 效果最好;5通道时,p=0.125或0.25 有提升。

- 一个有趣现象:从头训练时,5通道模型(最佳子集)性能比6通道模型差;但经过微调后,5通道模型性能反超6通道模型。这表明性能并非单纯由通道数决定,预训练动态和特定通道组合的交互作用也很重要。

⚖️ 评分理由

- 学术质量:5.5/7:论文工作扎实,实验设计系统且充分(三种分析角度),数据呈现详实(WER表格、音素表格、对比图),技术路径正确,结论有依据。主要创新在于系统性分析和训练策略的改进,而非模型架构的根本突破。仅使用单数据集是主要局限。

- 选题价值:1.5/2:选题直击EMG-to-Speech实用化的核心痛点——如何在减少传感器(更便携、舒适)的同时保持性能。这是一个具有明确应用前景和持续研究价值的课题。

- 开源与复现加成:0.5/1:提供了代码库链接(https://github.com/SPJune/SS_by_Channel),使用公开数据集和公认模型框架,复现基础好。扣分点在于未公开预训练权重,且训练超参数细节不全。