📄 Directly Trained Spiking Neural Networks with Adaptive Phase Coding

#音频分类 #时间编码 #脉冲神经网络

✅ 7.0/10 | 前25% | #音频分类 | #时间编码 | #脉冲神经网络

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 -0.5 | 置信度 高

👥 作者与机构

- 第一作者:Huaxu He(广东智能科学技术研究院,河南大学)

- 通讯作者:Yang Liu(河南大学计算机与信息工程学院),Chio-In IEONG(广东智能科学技术研究院)

- 作者列表:Huaxu He(广东智能科学技术研究院,河南大学)、Zhixing Hou(广东智能科学技术研究院)、Mingkun Xu(广东智能科学技术研究院)、Yongsheng Huang(广东智能科学技术研究院)、Yang Liu(河南大学计算机与信息工程学院)、Chio-In IEONG(广东智能科学技术研究院)

💡 毒舌点评

亮点:论文提出的“自适应相位编码”机制概念清晰、实现简洁,且巧妙地通过“层间时间打乱”消融实验,为“网络是否真的在利用时间信息”这一核心假设提供了直接证据,这在SNN可解释性研究中很有价值。

短板:创新深度有限,本质上是给LIF神经元的输入电流项增加了时间维度的缩放因子;实验部分未能与近年来涌现的多种直接训练SNN方法(如SLTT、GLIF等)进行公平、全面的对比,削弱了其宣称的“改进”的说服力。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:未提及。论文使用的数据集(CIFAR10/100, DVS-Gesture, SHD)均为公开标准数据集。

- Demo:未提及。

- 复现材料:论文提供了一些关键设置(骨干网络名称、时间步数、APC参数初始化及约束策略),但缺少完整的训练脚本、配置文件和详细参数。

- 论文中引用的开源项目:论文引用了QKFormer [19]作为骨干网络,这是构建在其上的一个开源SNN模型。其他引用多为通用SNN研究。

📌 核心摘要

本文旨在解决直接训练的脉冲神经网络(SNN)在利用脉冲时间信息方面的不足,现有方法大多退化为等效的速率编码,限制了SNN处理时序信息和实现低功耗的潜力。为此,论文提出了“自适应相位编码”(APC)机制,其核心是在标准LIF神经元模型中引入与时间步相关的可学习参数(β_t, λ_t),用于对不同时间步的输入电流和膜电位衰减进行加权。与预先定义固定规则的相位编码不同,APC使网络能在端到端训练中自主学习每个时间步的重要性,并且该参数被扩展至每个层的每个通道,以实现更精细的时序调制。实验结果表明,在静态数据集CIFAR-10/100上,APC能将脉冲发放率降低约20%,同时精度仅下降约0.85%;在时序数据集DVS-Gesture和SHD上,APC显著提升了分类精度,分别提高了1.73%和17.76%,其中SHD数据集的提升尤为显著。论文通过层间时间打乱消融实验证明,APC确实促使网络从依赖速率编码转向利用脉冲的时序结构。该工作的实际意义在于为直接训练的SNN提供了一种即插即用的时间编码增强模块,能提升其在时序任务上的性能。主要局限性在于,在静态数据集上精度略有下降,且实验验证的骨干网络和任务类型相对单一。

🏗️ 模型架构

本文并未提出一个新的整体网络架构,而是提出了一种对标准漏积放电(LIF)神经元模型的增强方法,该方法可以作为一种通用模块嵌入到现有的SNN架构中。

基础组件:LIF神经元模型

- 功能:模拟生物神经元的积分-发放过程。

- 结构:其动力学由三个公式描述(对应论文公式(1)-(3))。核心是膜电位

H[t]的累积:它由上一时刻的膜电位V[t-1]衰减后,加上当前时刻的输入电流I[t]构成。当H[t]超过阈值Vth时,神经元发放脉冲S[t]=1,随后膜电位重置。 - 数据流:输入电流

I[t]由上一层在t时刻的输出脉冲S[t]经过权重w变换得到。

核心创新:自适应相位编码(APC)机制

- 功能:在不改变LIF基本结构的前提下,为网络注入学习时序编码的能力。

- 结构与数据流:APC对LIF公式进行了一项关键修改(对应公式(7)):

H[t] = λ_learn^t V[t-1] + β_learn^t I[t]这里,λ_learn^t和β_learn^t是可学习参数,且下标t表示它们是时间步相关的。这意味着网络可以为每个时间步分配不同的权重:β_learn^t控制当前时刻输入电流I[t]的重要性(即该时间步脉冲的权重),λ_learn^t控制上一时刻膜电位记忆的衰减程度。 - 关键设计选择与动机:

- 解耦:论文首先指出标准LIF中

(1-λ)与λ强相关,通过解耦(公式(5))使输入电流权重独立可调。 - 时间步依赖:进一步引入时间步索引

t到参数中(公式(7)),灵感来自固定规则的相位编码,但将其变为可学习的,使网络能自适应地发现最优的时序编码策略。 - 通道维度扩展:为了更精细的控制,这些时间步相关的参数被扩展到每一层的每个通道(即每个特征图有自己的一套

λ_learn^t和β_learn^t)。对于没有通道维度的1D输入,会先折叠为2D以适用。

- 解耦:论文首先指出标准LIF中

- 收益:该机制使网络能够自主决定在哪个时间步赋予脉冲更大的“重要性”,从而摆脱对速率编码的依赖,主动利用时间信息。实验证明,这在时序数据上能大幅提升性能。

💡 核心创新点

- 自适应时间步权重学习:提出APC机制,将相位编码中固定的时间步脉冲权重(如

2^{-t})替换为可学习参数β_learn^t。这是与以往编码方案的根本区别,将时间编码从“人工设计”转变为“端到端学习”。 - 细粒度的通道级时间调制:将可学习的时间步参数从神经元级扩展到网络层的每个通道。这允许网络在不同的特征通道上学习不同的时序编码策略,提供了远比神经元级参数更丰富的时序表示能力,是提升性能的关键(消融实验已证明)。

- 提出“层间时间打乱”分析方法:为验证SNN是否真正在利用时间信息,提出了一个有效的分析工具:在层与层之间打乱脉冲的时间顺序。如果网络依赖速率编码,打乱影响小;如果依赖时间编码,打乱性能会显著下降。这为评估直接训练SNN的内部表征提供了新视角。

🔬 细节详述

- 训练数据:

- 静态图像:CIFAR-10, CIFAR-100。未说明预处理和数据增强,可能沿用QKFormer设置。

- 时序事件:DVS-Gesture(手势识别), SHD(Heidelberg Spiking Dataset, 语音数字识别)。未说明具体预处理。

- 损失函数:未说明,可能使用标准的交叉熵损失,与QKFormer一致。

- 训练策略:

- 骨干网络:对于图像和DVS数据集,使用QKFormer架构(一种基于注意力机制的SNN)。对于SHD数据集,使用5层MLP。

- 时间步设置:静态图像:4步; DVS-Gesture:16步; SHD:250步。

- 优化器/学习率:未说明,应与QKFormer原始设置一致。

- 训练轮数/批次大小:未说明。

- 关键超参数:

- APC参数初始化:所有

λ_learn^t和β_learn^t初始化为1。 - 参数约束:在训练时序数据集(DVS, SHD)时,将APC参数约束在

[-1, 1]范围内以确保稳定。静态数据集上无此约束。

- APC参数初始化:所有

- 训练硬件:未提供。

- 推理细节:未提供。

- 正则化/稳定技巧:上述APC参数约束是保证稳定训练的关键技巧。

📊 实验结果

主要基准结果: 论文报告了APC相对于基线(标准LIF神经元)的性能变化。

| 数据集 | 架构 | 方法 | 准确率 (%) | 相对脉冲率 (Rel. Firing Rate) |

|---|---|---|---|---|

| DVS-Gesture | QKFormer-4-256 | LIF (基线) | 96.18 | 1.00 |

| APC (本文) | 97.91 | ~0.60 | ||

| SHD | MLP-5 | LIF (基线) | 65.37 | 1.00 |

| APC (本文) | 83.13 | ~1.20 | ||

| CIFAR10 | QKFormer-4-256 | LIF (基线) | 95.81 | 1.00 |

| APC (本文) | 94.96 | ~0.80 | ||

| CIFAR100 | QKFormer-4-256 | LIF (基线) | 79.94 | 1.00 |

| APC (本文) | 78.36 | ~0.80 |

关键结论:

- 在时序数据集(DVS-Gesture, SHD)上,APC显著提高精度(SHD提升+17.76%),并在DVS-Gesture上同时降低脉冲率。

- 在静态数据集(CIFAR10/100)上,APC以轻微的精度损失(-0.85% ~ -1.58%)为代价,大幅降低脉冲率(~20%),验证了其在无时序信息任务中的能效提升潜力。

关键消融实验: 为验证APC是否促使网络利用时间信息,进行了“层间时间打乱”实验。

- 基线SNN的消融(表2):在CIFAR-10上打乱脉冲时间顺序,精度从95.81%降至95.14%,变化很小,证明标准直接训练SNN主要依赖速率编码。在DVS-Gesture上,打乱第一层脉冲导致精度从96.18%大幅降至92.70%,说明原始数据中的时序信息在输入层被部分利用。

- APC的消融:

- 仅使用层级时间步参数时,打乱对CIFAR10影响小,对DVS-Gesture影响中等(96.52% → 83.00%)。

- 引入通道级时间步参数后,网络对打乱变得高度敏感:在CIFAR10上精度从94.96%降至92.36%,在DVS-Gesture上从97.91%剧降至70.13%。这直接证明了通道级APC是网络成功学习并依赖时间编码的关键。

实验结果图表:

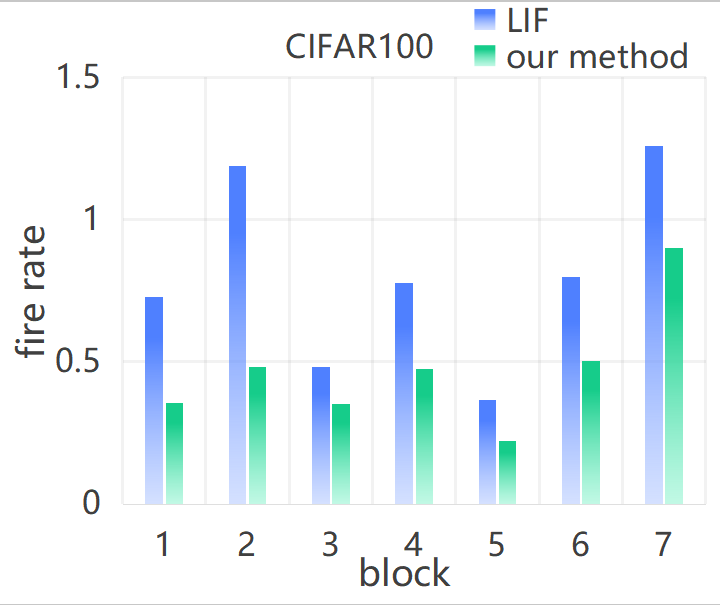

- 图2:展示了APC在CIFAR数据集上显著降低各层脉冲发放率的效果。

(描述:两个子图分别显示CIFAR10和CIFAR100中,使用APC后各模块(block)的相对脉冲率(蓝色线)均显著低于基线(1.00,橙色虚线),直观展示了能效提升。)

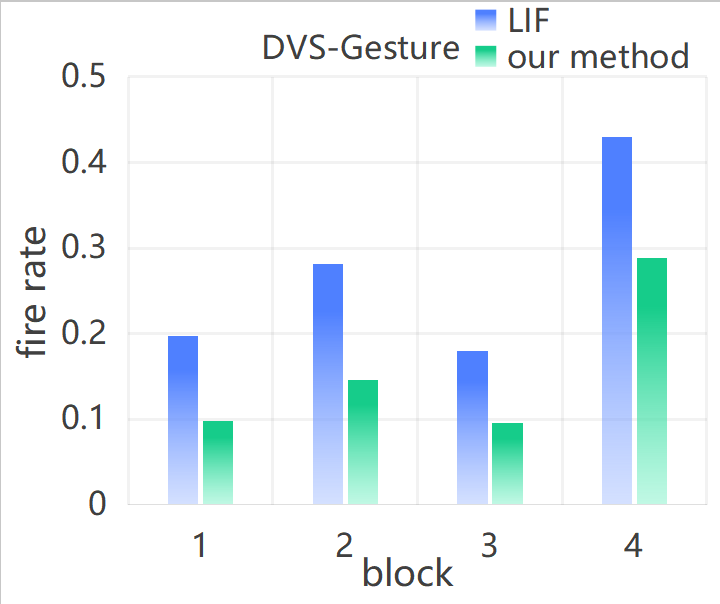

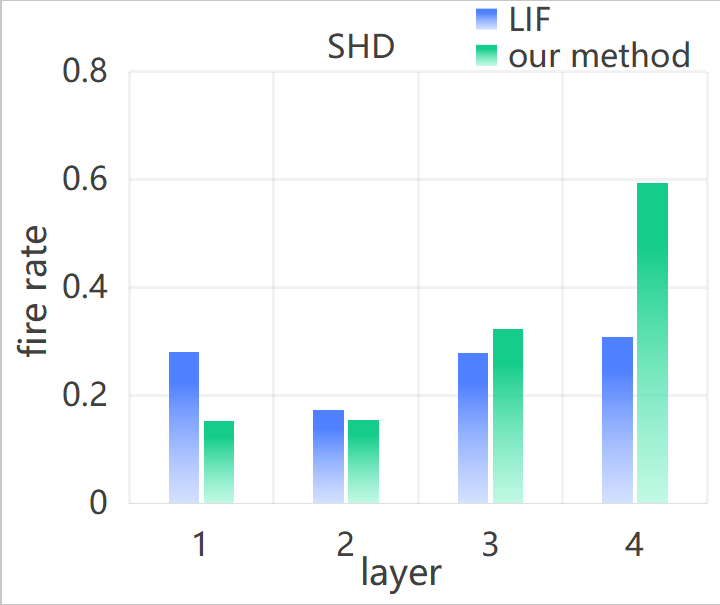

(描述:两个子图分别显示CIFAR10和CIFAR100中,使用APC后各模块(block)的相对脉冲率(蓝色线)均显著低于基线(1.00,橙色虚线),直观展示了能效提升。) - 图3:展示了APC在DVS-Gesture和SHD数据集上对脉冲率的影响。

(描述:(a) DVS-Gesture:APC在大多数层降低了脉冲率。(b) SHD:APC在不同层对脉冲率的影响不一,有增有减,但整体精度大幅提升,表明网络更智能地分配了脉冲。)

(描述:(a) DVS-Gesture:APC在大多数层降低了脉冲率。(b) SHD:APC在不同层对脉冲率的影响不一,有增有减,但整体精度大幅提升,表明网络更智能地分配了脉冲。) - 图1:说明了速率编码、相位编码和TTFS编码的区别,有助于理解APC的动机。

⚖️ 评分理由

- 学术质量:6.0/7:创新性良好,APC机制概念清晰,实现简洁,且“层间时间打乱”消融实验设计得非常巧妙,有力支持了核心论点。技术路线正确。实验充分性中等,验证了方法在代表性数据集上的有效性,但缺乏与更多SOTA直接训练SNN方法(如TTFS、SLTT等)的全面对比,且仅在一个骨干网络上验证,泛化性证据稍弱。

- 选题价值:1.5/2:选题处于SNN训练与神经形态计算的前沿,直击现有直接训练方法的痛点。APC作为一个即插即用模块,具有较好的应用潜力,尤其在时序信号处理(如音频、事件相机数据)方面。1.5分是因为其应用场景目前仍局限于分类任务,且影响范围更多在SNN社区内部。

- 开源与复现加成:-0.5/1:论文未提供任何代码、预训练模型或详细复现配置。虽然描述了核心思想和部分超参数,但实现细节(如具体网络层参数、优化器设置)不充分,使得独立复现存在困难。