📄 Diffusion Timbre Transfer via Mutual Information Guided Inpainting

#音乐生成 #音频生成 #扩散模型 #零样本

✅ 7.5/10 | 前25% | #音乐生成 | #扩散模型 | #音频生成 #零样本

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Ching Ho Lee(Queen Mary University of London)

- 通讯作者:未说明

- 作者列表:Ching Ho Lee(Queen Mary University of London)、Javier Nistal(Sony Computer Science Laboratories, Paris, France)、Stefan Lattner(Sony Computer Science Laboratories, Paris, France)、Marco Pasini(Queen Mary University of London;Sony Computer Science Laboratories, Paris, France)、George Fazekas(Queen Mary University of London)

💡 毒舌点评

亮点:该方法巧妙地将“免训练”和“推理时控制”结合,通过互信息分析“外科手术式”地定位音色通道,再用扩散模型的采样特性来“手术”,在保持旋律节奏和改变音色之间找到了一个精巧的平衡点。短板:这种基于统计的通道解缠在实际复杂音频上可能不够完美(论文中k值仍需调优),且极度依赖底层编码器M2L2和扩散模型DaR的特定性质,方法的普适性和鲁棒性有待更广泛验证。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及。

- 数据集:评估使用了NSynth(公开)和DaR的测试集(未公开)。

- Demo:提供了音频演示页面链接(anon-audio-demo-25.github.io/audio demo)。

- 复现材料:论文中给出了方法的关键步骤和超参数选择逻辑,但未提供完整复现所需的所有配置文件或脚本。

- 论文中引用的开源项目:引用了NSynth数据集[29]、Music2Latent2[26]、Diff-A-Riff[15, 16]、CLAP[27]、DDIM[28]、PESTO音高估计[34]等。

📌 核心摘要

- 解决的问题:如何利用一个预训练的、通用的潜在扩散模型(如Diff-A-Riff),在无需额外训练或架构修改的情况下,实现音乐音���的音色迁移(改变乐器音色,同时保持旋律、节奏等结构内容)。

- 方法核心:提出一种基于互信息引导的“修复式”推理时控制方法。首先,通过互信息分析识别出潜空间中与乐器身份(音色)最相关的通道(维度);然后在扩散采样过程中,仅对这些“音色通道”注入噪声以进行重新生成,同时“夹紧”(即恢复)代表结构(旋律、节奏)的通道,以强制保持原始内容。

- 与已有方法相比新在哪里:区别于需要为每个目标乐器单独训练或添加控制模块的方法,也区别于需要在推理时进行逐样本优化的方法。本文方法是无训练、无优化的,直接在预训练模型的采样过程中施加轻量级干预,成本与标准采样相当。

- 主要实验结果:在客观指标上,该方法在音色相似度(CLAP)与内容保持(动态音高距离DPD、音符起始点F1)之间取得了优于简单部分噪声注入(PnI)和DDIM部分噪声注入的平衡。与DDIM反转(DDIM-inversion)基线相比,它能显著改善内容保持(DPD更低,F1更高),但音色相似度(CLAP)略低。消融实验表明,通过调整掩模比例k和夹紧步长比例f,可以控制这种权衡。主观听测(MUSHRA)表明,该方法在音频质量上显著优于对比基线(WaveTransfer-BDDM19),在内容保持上与之无显著差异,但在音色相似度上略逊。其生成的音频真实度MOS评分(3.52)也远高于对比系统(2.10)。

| 方法 | k | f | FAD ↓ | DPD (¢) ↓ | CLAP ↑ | F1 Onset ↑ |

|---|---|---|---|---|---|---|

| PnI | - | - | 3.74 | 110.79 | 0.63 | 0.37 |

| DDIM-PnI | - | - | 1.48 | 29.71 | 0.52 | 0.78 |

| DDIM-inversion | - | - | 1.333 | 196.93 | 0.76 | 0.14 |

| MI-Guided (Setting 4) | 0.50 | 0.45 | 1.75 | 97.96 | 0.59 | 0.59 |

| (low-k, long-f) | 0.4 | 0.5 | 1.81 | 56.04 | 0.54 | 0.71 |

(表格展示了部分关键结果,其中MI-Guided方法为论文提出的最佳平衡点之一) 5. 实际意义:为音乐制作人提供了一种灵活的、无需训练的音色变换工具,可以快速探索编曲中的音色可能性,加速创意迭代。方法架构无关,理论上可适配于其他基于潜在扩散的生成模型。 6. 主要局限性:通道的音色与结构解缠依赖于互信息分析,并非完美分离(尤其是中间通道),因此需要权衡超参数k和f。方法的性能受限于所使用的预训练模型(Diff-A-Riff)的能力。论文未提供代码和模型权重。

🏗️ 模型架构

该论文并非提出一个新的生成模型架构,而是为已有的预训练模型(Diff-A-Riff, DaR)设计一个无需训练的推理时控制方案。因此,其“架构”主要体现在控制逻辑上:

- 核心组件:

- 预训练潜在扩散模型(DaR):基于Transformer架构(DiT),在Music2Latent2(M2L2)编码的潜在空间上进行训练,支持文本(CLAP嵌入)条件生成。它是执行生成的“引擎”。

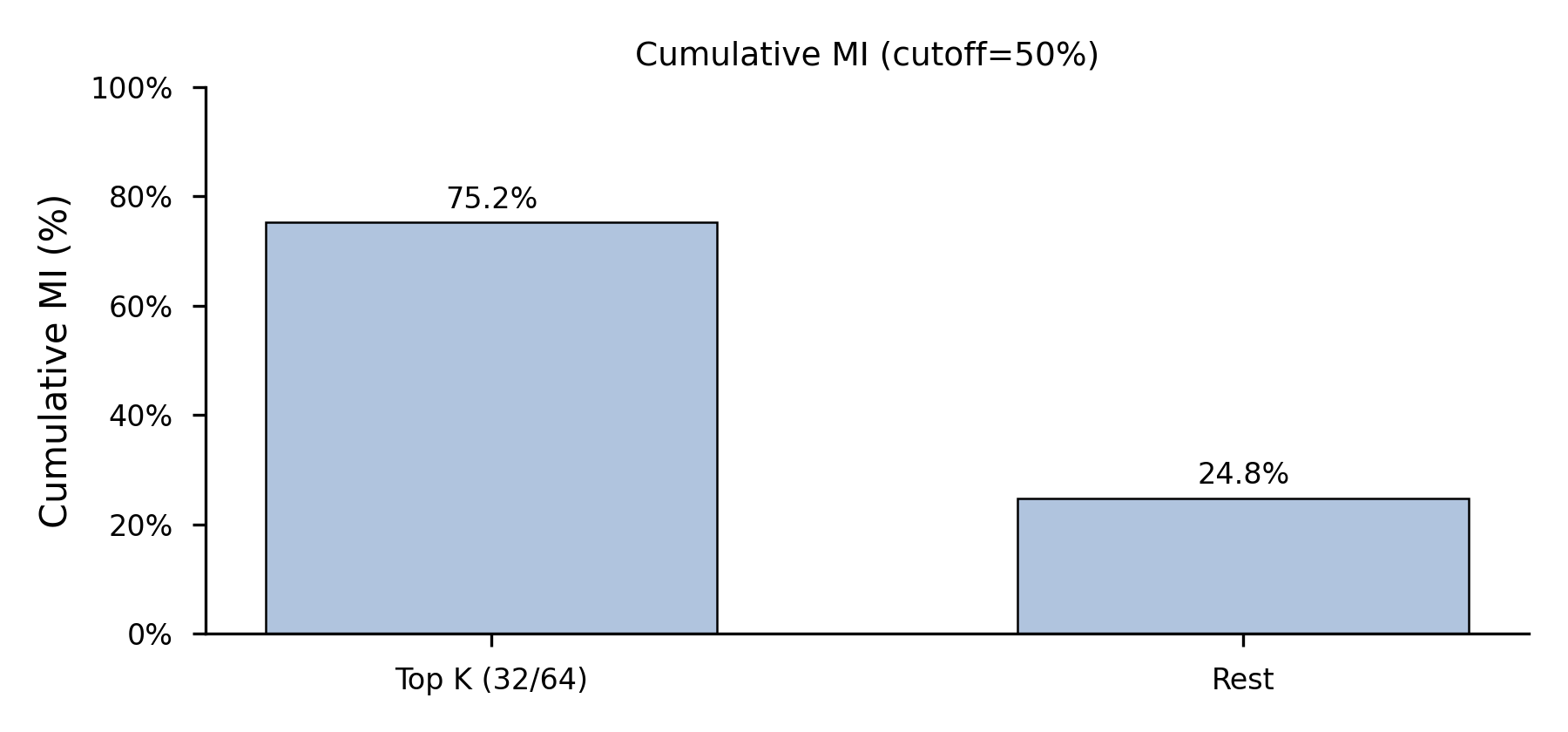

- 互信息分析模块(推理前预处理):使用带标签的数据(如NSynth),计算M2L2潜在向量每个维度(共64维)与乐器类别标签的互信息,生成一个二进制掩码

Mtimbre(Top-k%维度)和其补掩码Mstruct,用于后续干预。 - 维度噪声注入与夹紧控制器(推理时核心):在扩散采样过程中,操作潜在向量

z_t:- 初始状态构造:不对原始音频直接加噪,而是通过DDIM反转将源音频

xctx转换到最高噪声步T的潜在表示z_ctx_T,然后与新噪声组合:z_dim-wise_T = (σ_T * ε) ⊙ Mtimbre + (z_ctx_T) ⊙ Mstruct。 - 早期夹紧:在采样过程的前

tc步(高噪声阶段),将当前潜在表示z_t中的结构维度强制替换为DDIM反转的对应维度:z_t ← z_t ⊙ Mtimbre + z_ctx_t ⊙ Mstruct。

- 初始状态构造:不对原始音频直接加噪,而是通过DDIM反转将源音频

- 数据流:源音频

x_ctx→ M2L2编码器 → 潜在表示 → DDIM反转至步T → 与新噪声按通道混合 → DaR逆扩散采样(前tc步进行结构维度夹紧) → 潜在表示序列 → M2L2解码器 → 输出波形。 - 关键设计选择:在推理时而非训练时进行控制,避免了昂贵的微调或优化;利用互信息分析进行维度级的精准干预;利用扩散模型早期步决定全局结构的特性进行早期夹紧。

💡 核心创新点

- 基于互信息的维度级通道选择:之前工作(如DDSP)使用固定的瓶颈层分离结构与音色。本文通过监督互信息分析,在现有编码器的潜在维度中自动发现哪些维度携带更多乐器身份信息,实现了数据驱动的特征解缠指导,为干预提供了依据。

- 免训练的“选择性噪声注入+早期夹紧”控制范式:区别于通过添加控制模块(如ControlNet)或进行逐样本优化来实现控制。本文提出了一种轻量级的推理时干预流程,仅通过修改扩散模型的初始噪声状态和采样中间步骤的潜在值,在不改变模型参数的情况下实现控制,计算开销极小。

- 系统化的音色-结构权衡分析框架:论文不仅提出方法,还通过消融实验(调整k和f)和多指标评估(FAD, DPD, CLAP, F1 Onset),系统地刻画了音色改变强度与结构保持程度之间的权衡关系,为使用者提供了清晰的调节依据。

🔬 细节详述

- 训练数据:

- 互信息分析与基线调优:使用NSynth数据集。

- 主实验评估:使用DaR的测试语料,从不同歌曲中配对上下文音频和参考音频,每段10秒,不超过5秒静音。参数搜索使用了7000对数据,最终评估使用了14000对。

- 损失函数:未说明(因为本方法无需训练)。

- 训练策略:未说明(因为本方法无需训练)。所依赖的DaR和M2L2模型的训练细节请参考原文献[15, 16, 26]。

- 关键超参数:

- k:

Mtimbre掩码中通道的百分比(如0.5代表前50%),通过网格搜索确定。 - fclamp:夹紧操作结束的步骤比例(

σ_tc ≈ fclamp * σ_T),通过网格搜索确定。 - fpar:基线方法中的噪声分数参数。

- 扩散步数N:固定为30步。

- CFG强度:固定为1.25。

- k:

- 训练硬件:未说明。

- 推理细节:

- 采样器:使用EDM求解器进行主实验,也测试了DDIM作为基线。

- 初始状态:通过DDIM反转(从t=0到T,CFG=0)获得源音频在最大噪声水平下的潜在表示,然后与新噪声混合。

- 采样过程:共30步,前

tc步(由fclamp决定)执行结构维度夹紧,后续步骤自由去噪。

- 正则化或稳定训练技巧:未说明(因为本方法无需训练)。

📊 实验结果

- 主要Benchmark与指标:

- 数据集:基于DaR测试集构建的7000/14000对音频配对。

- 指标:

- 音色/质量:Fréchet Audio Distance (FAD) ↓,CLAP相似度 ↑。

- 内容保持:Dynamic Pitch Distance (DPD, 单位:音分¢) ↓(越低音高保持越好),Note-onset F1 ↑(越高节奏/起音保持越好)。

- 与最强基线对比:与DDIM-inversion基线相比,MI-Guided方法(Setting 4: k=0.5, f=0.45)在内容保持上表现更优:DPD从196.93¢降至97.96¢,F1 Onset从0.14升至0.59。但音色相似度CLAP从0.76降至0.59,FAD从1.333升至1.75。这体现了方法在控制音色时对结构的显著改善,代价是音色改变幅度相对基线略小。

- 消融实验:通过3×2网格搜索k∈{0.45, 0.50, 0.55}和fclamp∈{0.40, 0.45},结果(Table 1下半部分)显示:随着k减小(扰动更少的音色通道)和fclamp增大(夹紧更长),DPD显著下降(108.70→56.04),F1 Onset上升(0.49→0.71),同时CLAP从0.61微降至0.54。这证实了超参数对权衡的控制作用。

- 主观实验:

- MUSHRA听测(29人,60段音频):与BDDM19(WaveTransfer)对比,本文方法在“内容保持”上无显著差异(p=0.568),在“音频质量”上显著更好(p<0.001),但在“音色相似度”上显著更低(p<0.001)。

- MOS真实度评分:本文方法MOS=3.52,显著高于BDDM19的2.10,表明其生成结果更自然真实。

(图1:展示了M2L2潜在维度与乐器类别和音高之间的归一化互信息分数。可以明显看出,不同维度对音色(Timbre MI)和音高(Pitch MI)的信息携带量存在差异,这为选择性干预提供了依据。)

(图1:展示了M2L2潜在维度与乐器类别和音高之间的归一化互信息分数。可以明显看出,不同维度对音色(Timbre MI)和音高(Pitch MI)的信息携带量存在差异,这为选择性干预提供了依据。)

⚖️ 评分理由

- 学术质量:6.0/7:创新性在于将互信息分析与扩散模型采样控制巧妙结合,提出了一套完整、可操作的免训练方案。技术实现逻辑正确,实验设计(消融、多指标、主客观)充分,证据链完整,支撑了方法的有效性。扣分点在于创新属于应用层面的组合优化,而非基础理论的突破;且部分核心指标(CLAP)未超越最强基线。

- 选题价值:1.5/2:音色迁移是音乐AI中一个具体、实用且尚未完全解决的问题,该方法降低了技术门槛,对音乐制作领域有直接的实用价值。潜在影响中等,因为是针对特定模型(DaR)的控制方案。

- 开源与复现加成:0.0/1:提供了在线演示,但未开源代码、模型权重或训练配置。方法高度依赖未开源的预训练模型(DaR, M2L2),严重影响了独立复现的可能性。