📄 Diffemotalk: Audio-Driven Facial Animation with Fine-Grained Emotion Control via Diffusion Models

#语音情感识别 #扩散模型 #对比学习 #跨模态

✅ 7.5/10 | 前25% | #语音情感识别 | #扩散模型 | #对比学习 #跨模态

学术质量 6.5/7 | 选题价值 1.0/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Kexin Gao (中国海洋大学计算机科学与技术学院)

- 通讯作者:Xinjie Wang (中国海洋大学计算机科学与技术学院, 邮箱:wangxinjie@ouc.edu.cn)

- 作者列表:Kexin Gao (中国海洋大学计算机科学与技术学院), Yuyu Zhu (中国海洋大学计算机科学与技术学院), Jian Liu (中国海洋大学计算机科学与技术学院), Xinjie Wang* (中国海洋大学计算机科学与技术学院), Xiaogang Jin (浙江大学CAD&CG国家重点实验室), Jie Nie (中国海洋大学计算机科学与技术学院)

💡 毒舌点评

亮点:在情感表征上,摒弃了传统的离散标签,转而使用连续的VA值和文本描述进行层次化对比学习,这一设计巧妙地缓解了细粒度情感标注数据稀缺的问题。短板:尽管号称“细粒度情感控制”,但实验主要基于离散情绪类别的MEAD/RAVDESS数据集,对情感粒度的提升主要体现在强度和类间区分上,对更微妙、混合情感的生成能力验证不足,跨数据集的泛化能力也仅在一个小型数据集上得到初步验证。

🔗 开源详情

- 代码:论文中未提及代码链接或开源计划。

- 模型权重:未提及。

- 数据集:使用了公开数据集MEAD、RAVDESS和TA-MEAD。论文中未说明其提取的AU和FLAME数据是否公开。

- Demo:未提及。

- 复现材料:论文提供了部分训练超参数(学习率、批大小、训练轮数、损失权重、GPU型号等),但未提供完整的训练脚本、配置文件或预训练检查点。

- 引用的开源项目/模型:HuBERT(用于特征提取)、CLIP(用于文本编码)、FLAME(面部模型)、SpeechEmotionAVLearning(用于提取VA值)。

📌 核心摘要

- 要解决的问题:现有音频驱动的3D说话头部生成技术虽然在唇形同步方面表现良好,但在生成生动、可控且情感细腻的面部动画方面存在瓶颈,具体表现为情感解耦粒度粗糙、生成稳定性差以及难以建模细微的情感差异。

- 方法核心:提出DiffEmoTalk框架,其核心是三个专门编码器:唇动编码器、韵律编码器和情感感知语音编码器(EASE),用于从语音中解耦不同粒度的特征。EASE通过层次化多级对比学习(HMLC),利用连续的效价-唤醒值(VA)和文本描述进行优化。解耦后的特征通过一个“情感引导的多特征AU预测器”融合,并以面部动作单元(AU)作为中间监督,最终输入一个基于Transformer的扩散模型解码器生成FLAME参数动画。

- 创新点:与已有方法相比,新在:(1) 提出EASE模块,通过对比学习从语音中提取更丰富、更具区分度的情感表征;(2) 引入AU作为中间监督和桥接模态的桥梁,改善了跨模态融合的稳定性与可解释性;(3) 将扩散模型与细粒度情感解耦相结合,实现了在情感准确性与生成多样性之间的更好平衡。

- 主要实验结果:在MEAD和RAVDESS数据集上,DiffEmoTalk在情感准确度(MEE)和情感强度误差(EIE)上取得了最佳成绩(例如,在MEAD上,MEE为0.00936,低于MEDTalk的0.01215)。唇音同步(MLE)略逊于MEDTalk(0.00695 vs 0.00657),但优于EmoTalk和DiffPoseTalk。在用户研究中,其在情感准确性和生动性评分上也领先。关键消融实验证明了三编码器解耦、AU监督和EASE模块的必要性。

- 实际意义:该工作推动了更具表现力和可控性的数字人生成技术,在虚拟助手、数字人交互、远程协作和内容创作等领域有应用潜力。

- 主要局限性:情感控制目前高度依赖语音内容,未能整合文本、视觉等上下文线索来处理“相同话语不同情感”的情况。此外,模型在跨数据集泛化能力上的验证较为有限。

🏗️ 模型架构

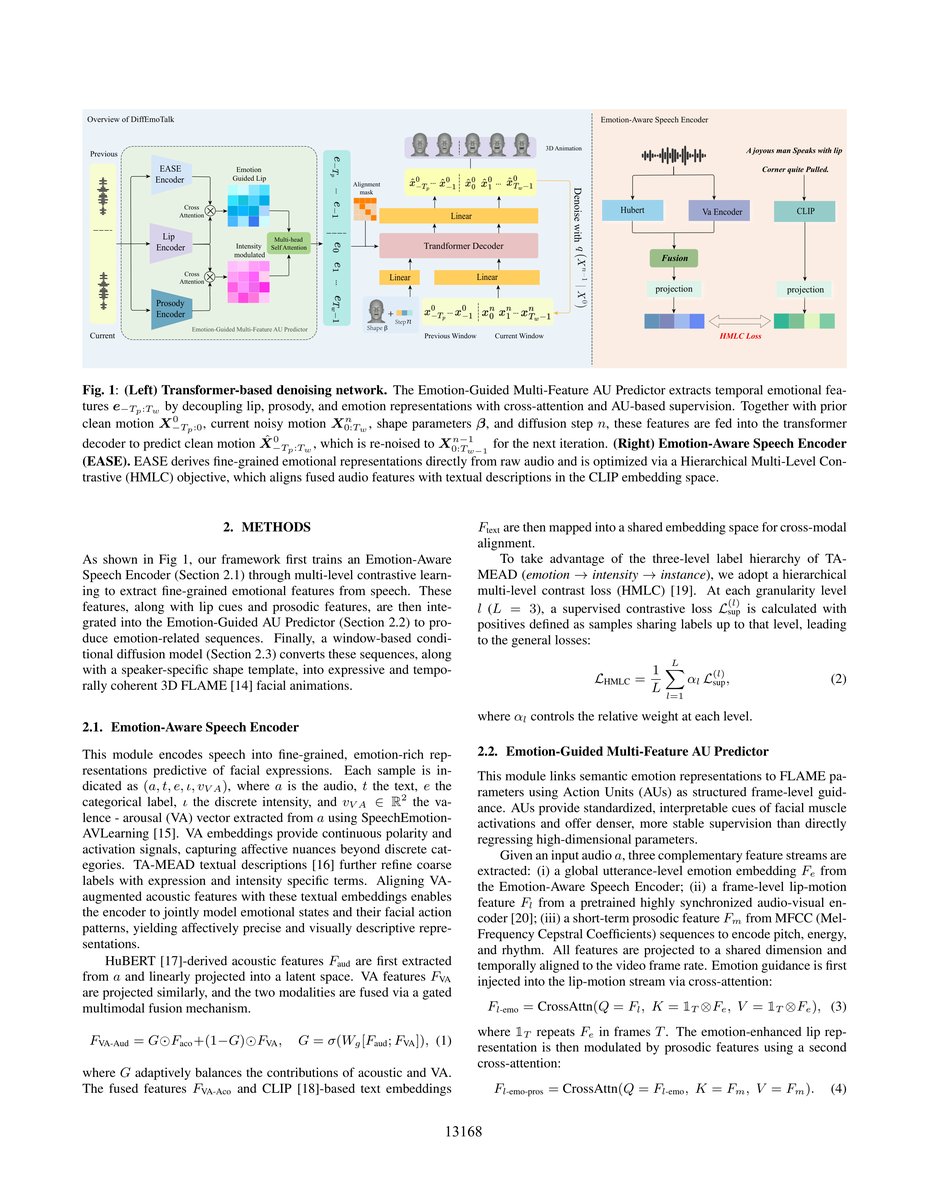

DiffEmoTalk的整体框架(见图1)是一个多阶段的生成系统,目标是将输入语音转换为3D面部动画(FLAME参数)。其架构可分为三个主要阶段:特征解耦与提取、AU预测与融合、以及扩散模型生成。

- 输入与预处理:输入为原始语音波形,输出为时间序列的3D FLAME面部参数。数据预处理包括从视频中提取每帧的AU真值和FLAME系数作为监督信号。

- 情感感知语音编码器(EASE):这是情感表征的核心。它接收原始音频,利用预训练的HuBERT提取声学特征

Faud,并同时提取由SpeechEmotionAVLearning模型得到的连续VA特征FVA。两种特征通过一个门控融合机制(公式1)自适应结合。融合后的音频特征FVA-Aco与基于CLIP的文本特征Ftext(来自TA-MEAD数据集的文本描述)在共享嵌入空间中进行层次化多级对比学习(HMLC)。HMLC利用TA-MEAD标签的三层层次结构(情绪→强度→实例),在不同粒度上定义正样本对,计算监督对比损失(公式2),从而让编码器学习到既符合情感状态又具备视觉描述性的表征。 - 情感引导的多特征AU预测器:该模块将全局情感嵌入(来自EASE)、帧级唇动特征(来自预训练的音频-视觉编码器)和短期韵律特征(来自MFCC)进行融合。

- 首先,通过交叉注意力(公式3)将全局情感特征

Fe注入唇动特征Fl,得到情感增强的唇特征Fl-emo。 - 然后,再次通过交叉注意力(公式4)用韵律特征

Fm对Fl-emo进行调制。 - 将三个特征流拼接后,通过多头自注意力(MHA)层(公式5)捕获它们之间的相互依赖关系。

- 最后,通过一个Transformer解码器建模长期时间依赖,并投影为帧级的AU激活序列

FAU。该模块使用L2回归损失(公式6)和时序平滑正则化(公式7)进行训练。

- 首先,通过交叉注意力(公式3)将全局情感特征

- 基于扩散模型的FLAME运动解码器:该模块以AU序列

FAU为条件,生成连续的3D面部动画。它采用Transformer去噪网络(如图1左侧所示)。- 输入:当前噪声运动窗口

Xn、过去干净运动上下文、说话人身份模板Sid、扩散时间步n以及条件C(包含FAU、Sid、上下文尾部)。 - 去噪过程:模型在Transformer解码器中使用交叉注意力来融合条件

C,并预测干净运动X0。该过程是迭代的,从Xn预测Xn-1。 - 训练目标:标准的扩散损失

Ldiff(公式10)负责去噪。此外,为提高几何和时序真实性,加入了多个FLAME一致性正则项(Lvert,Lvel,Lsmooth等)。为增强情感表现力,引入了情感一致性损失Lemo:使用一个预训练的情感预测器对生成的动画特征进行预测,使其与目标情感分类一致。 - 窗口化处理:为处理任意长序列,采用带重叠上下文的窗口化条件方案,确保生成的平滑过渡。

- 输入:当前噪声运动窗口

图1说明:该图完整展示了模型的架构。左侧是Transformer去噪网络,显示了输入(噪声运动、上下文、条件等)如何通过包含多头自注意力和交叉注意力的Transformer解码器预测干净运动。右侧是情感感知语音编码器(EASE)的细节,展示了音频和VA特征的融合,以及与文本特征进行HMLC对比学习的过程。

图1说明:该图完整展示了模型的架构。左侧是Transformer去噪网络,显示了输入(噪声运动、上下文、条件等)如何通过包含多头自注意力和交叉注意力的Transformer解码器预测干净运动。右侧是情感感知语音编码器(EASE)的细节,展示了音频和VA特征的融合,以及与文本特征进行HMLC对比学习的过程。

💡 核心创新点

- 基于连续值与文本的层次化对比情感编码器(EASE):

- 之前局限:现有方法(如EmoTalk)多使用离散情感标签进行监督,表征能力有限,难以建模情感细微差别。

- 如何起作用:EASE利用连续的VA值提供极性和激活度的细腻信号,并利用丰富的文本描述进行跨模态对齐。通过HMLC损失,在情感层次结构的不同粒度上优化表征学习。

- 收益:学习到的表征更具区分度和描述性,如图3所示,融合VA和文本后,模型能更好地区分不同情感和强度。

- 以动作单元(AU)为桥梁的异构特征融合:

- 之前局限:直接回归高维FLAME参数会导致模态差距大、生成不稳定。

- 如何起作用:将抽象的情感、唇动、韵律特征先转化为结构化、可解释的AU序列。AU作为面部肌肉激活的标准化描述,提供了更稳定、更密集的中间监督。

- 收益:为扩散模型提供了有意义的运动先验,提高了生成动画的几何精度和时序连贯性,同时增强了可解释性。

- 多粒度特征解耦与渐进式融合:

- 之前局限:单一编码器难以同时精确处理唇动、情感等不同方面的信息。

- 如何起作用:设计三个专用编码器分别处理唇动、韵律和情感,并在AU预测器中通过级联的交叉注意力机制逐步融合,先注入情感,再结合韵律。

- 收益:实现了更精细的控制,避免了特征之间的干扰,使得生成的动画在保持唇形同步的同时,能准确反映预期的情感状态和韵律节奏。

- 情感感知的扩散生成:

- 之前局限:扩散模型应用于该任务时,往往缺乏对情感内容的显式建模。

- 如何起作用:在扩散解码器的训练损失中,加入了基于预训练情感预测器的

Lemo损失,直接约束生成结果的情感表达。 - 收益:确保了最终生成的动画在视觉上与目标情感一致,增强了情感控制的闭环。

🔬 细节详述

- 训练数据:主要使用MEAD数据集,包含60位演员,8种情绪,3种强度。用于EASE编码器训练时,使用了其增强版TA-MEAD(包含文本描述)。从视频中提取了约1,008,000帧的FLAME系数和AU数据。音频转换为16kHz,视频为25fps。按说话人划分:44人训练,8人验证,8人测试。

- 损失函数:

- EASE训练:层次化多级对比损失

LHMLC(公式2),温度系数τ=0.07。 - AU预测器训练:

LAU-Rec(L2回归损失,公式6)+λs * LAU-Smooth(时序平滑损失,公式7),其中λAU-Smooth=0.1。 - 扩散解码器训练:

Ldiff(扩散损失,公式10)+ FLAME一致性正则项集合ΣλkLk(顶点重建、速度、平滑、头部角度等)+λemo Lemo(情感一致性损失)。权重为:λvert=2e6,λvel=1e7,λsmooth=1e5,λemo=6。

- EASE训练:层次化多级对比损失

- 训练策略:

- 优化器:所有模型使用Adam优化器。

- EASE:学习率

5e-4,批大小256,训练100 epochs,使用层次化批次采样。 - AU预测器:学习率未明确说明。

- 扩散解码器:学习率

1e-4,500步扩散过程,使用余弦噪声调度。 - 整体训练:在单块NVIDIA RTX 3090 GPU上训练约12小时。

- 关键超参数:特征维度

256,扩散窗口长度25帧。 - 推理细节:未说明具体解码策略、温度或beam size。采用基于窗口的生成,窗口有重叠以保证平滑。

- 正则化技巧:AU预测器中的时序平滑损失;扩散解码器中的多种几何与运动正则项(顶点速度、平滑度等)。

📊 实验结果

- 主要定量对比(表1):

- 数据集:MEAD 和 RAVDESS。

- 指标:MLE(唇音同步误差,↓),MEE(情感误差,↓),EIE(情感强度误差,↓),FRD(上脸运动多样性,↓)。

| 方法 | MLE↓ (MEAD) | MEE↓ (MEAD) | EIE↓ (MEAD) | FRD↓ (MEAD) | MLE↓ (RAVDESS) | MEE↓ (RAVDESS) | EIE↓ (RAVDESS) | FRD↓ (RAVDESS) |

|---|---|---|---|---|---|---|---|---|

| EmoTalk | 0.00819 | 0.02677 | 0.92316 | 0.01823 | 0.01027 | 0.03516 | 0.98742 | 0.02391 |

| DiffPoseTalk | 0.01034 | 0.02384 | 0.84081 | 0.00092 | 0.01284 | 0.03106 | 0.93214 | 0.00127 |

| MEDTalk | 0.00657 | 0.01215 | 0.72303 | 0.00275 | 0.00812 | 0.01592 | 0.81463 | 0.00364 |

| Ours | 0.00695 | 0.00936 | 0.68137 | 0.00141 | 0.00806 | 0.01118 | 0.73892 | 0.00172 |

结论:DiffEmoTalk在情感相关指标(MEE, EIE)上达到最优。唇音同步(MLE)与最优基线MEDTalk非常接近但略差。在RAVDESS数据集上的跨数据集评估趋势一致。

- 定性评估(图2):展示了不同方法(EmoTalk, DiffPoseTalk, MEDTalk, Ours)在生气、开心、悲伤、厌恶、惊讶五种情绪下的生成结果。DiffEmoTalk在保持嘴型清晰的同时,面部表情(尤其是上脸区域)更丰富、更符合情绪。

- 情感编码器效果验证(图3):对比了使用标准学习(仅音频)与VA引导学习(音频+VA+文本)在情感-强度二维空间中的特征可视化。VA引导学习产生的特征簇分离更清晰,证明其能捕捉更细粒度的情感表征。

- 用户研究(表2):20名参与者对10个音频片段的生成结果进行五点量表评分(唇同步、情感准确度、生动性)。

| 方法 | Lip-sync | Emotion Acc | Vividness |

|---|---|---|---|

| EmoTalk | 3.27 ± 0.08 | 3.89 ± 0.06 | 3.13 ± 0.23 |

| DiffPoseTalk | 3.65 ± 0.15 | 3.63 ± 0.08 | 3.68 ± 0.25 |

| MEDTalk | 4.21 ± 0.09 | 4.13 ± 0.06 | 4.01 ± 0.21 |

| Ours | 4.14 ± 0.09 | 4.39 ± 0.05 | 4.46 ± 0.09 |

结论:DiffEmoTalk在情感准确度和生动性上得分最高,唇同步得分与MEDTalk接近。

消融实验(表3):

方法 MLE↓ MEE↓ EIE↓ FRD↓ w/o disentangle 0.01462 0.02523 0.92046 0.00214 w/o LAU-Rec 0.00752 0.01158 0.78574 0.00116 w/o EASE 0.00913 0.02064 0.83151 0.00293 Full Model 0.00695 0.00936 0.68137 0.00141 结论:移除任何关键组件都会导致性能下降。移除解耦(w/o disentangle)导致所有指标严重恶化,证明了多编码器解耦的必要性。移除AU回归损失(w/o LAU-Rec)虽略微增加了多样性(FRD降低),但损害了稳定性和准确性。移除EASE(w/o EASE)显著损害了情感指标(MEE, EIE)。

⚖️ 评分理由

- 学术质量:6.5/7:论文提出了一个技术路线完整且创新的框架,将细粒度情感学习、AU引导的跨模态融合与扩散生成相结合。实验设计全面,定量、定性、用户研究和消融实验俱全,提供了强有力的证据。技术细节描述清晰。扣分点在于:(1) 情感“细粒度”的验证主要体现在类间和强度上,对更复杂混合情感的验证不足;(2) 跨数据集泛化实验仅在小规模RAVDESS上进行,说服力有限。

- 选题价值:1.0/2:音频驱动情感动画是元宇宙、虚拟人等领域的基础技术,研究价值明确。但该细分方向相对垂直,且论文的应用探索部分较少。

- 开源与复现加成:0.0/1:论文未提供任何代码、预训练模型、详细数据集获取方式或可一键复现的脚本。仅描述了训练时长、硬件、部分超参数,但不足以独立复现。因此此项无加成。