📄 Contrastive Timbre Representations for Musical Instrument And Synthesizer Retrieval

#音频检索 #对比学习 #预训练 #数据增强

✅ 7.5/10 | 前25% | #音频检索 | #对比学习 | #预训练 #数据增强

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 0.0 | 置信度 高

👥 作者与机构

- 第一作者:Gwendal Le Vaillant (Haute-École Bruxelles-Brabant, ISIB)

- 通讯作者:Yannick Molle (University of Mons, ISIA Lab, Impulsia)

- 作者列表:Gwendal Le Vaillant (Haute-École Bruxelles-Brabant, ISIB), Yannick Molle (University of Mons, ISIA Lab, Impulsia)

💡 毒舌点评

亮点:为虚拟乐器对比学习设计了“乐器自身生成正样本”的策略,巧妙规避了传统音频增强对音色本质的破坏;提出的单一模型同时处理单源和混合音源的检索框架,显著优于先分离再检索的复杂流水线。 短板:实验验证的混合场景局限于三种特定家族乐器的组合,对于更复杂、更真实的多乐器混合(如交响乐、摇滚乐队)缺乏探索;论文声称代码和模型将开源,但当前缺乏具体承诺,对于依赖该工作的后续研究是种障碍。

🔗 开源详情

- 代码:论文中提供了一个网站链接(https://gwendal-lv.github.io/CIR),推测未来会在此发布代码,但当前未明确提供GitHub仓库链接。

- 模型权重:未提及是否公开预训练或微调后的模型权重。

- 数据集:使用了公开的NSynth和Slakh数据集,但Surge合成器生成的音频数据是否公开、如何获取未说明。

- Demo:提供了在线演示网站。

- 复现材料:给出了部分训练超参数(如批大小、损失类型),但学习率、优化器、训练轮次等关键细节未说明。论文引用了开源的AST模型和Demucs工具。

- 论文中引用的开源项目:AST [21], Demucs [15, 22], NSynth [16], Slakh [20], Surge [19]。

📌 核心摘要

- 问题:在数字音乐制作中,从包含多种乐器的音频混合中快速、准确地检索出特定乐器的音色是一个挑战。传统的文本描述不充分,而单独聆听大量音色库效率低下。

- 方法核心:提出一个基于对比学习的框架,训练一个统一的Audio Spectrogram Transformer (AST) 模型。该模型能为单个乐器声音和混合声音生成音色嵌入,通过比较嵌入的余弦相似度来检索数据库中的乐器。

- 创新点:1) 针对性的正负样本构建:不使用传统的声音增强,而是利用虚拟乐器(采样器和合成器)本身生成同一乐器的不同音符/演奏作为正样本对,不同乐器的声音作为负样本。2) 统一的单/混合检索模型:使用一个模型计算所有嵌入,无需先进行声源分离,避免了分离引入的误差。

- 主要实验结果:

- 单音源检索:在包含3884个乐器的测试集上,对比学习方法(InfoNCE损失,Top-1: 80.4%)性能与基于分类预训练的SOTA(Top-1: 83.2%)具有竞争力。

- 多音源(三乐器混合)检索:这是论文的核心贡献。所提的“全三元组损失”对比学习模型(N=48)取得了84.2%的Top-1准确率和96.4%的Top-5准确率,远超基线模型(Demucs+单编码器: 14.5% Top-1;多编码器模型: 17.32% Top-1)。

| 方法 | Top-1 准确率 (%) | Top-5 准确率 (%) |

|---|---|---|

| Demucs [15, 22] + 单编码器 | 14.5 | 25.8 |

| 多编码器 [1] | 17.32 | 62.6 |

| 对比学习:三元组损失 (N=24) | 64.8 | 85.0 |

| 对比学习:全三元组损失 (N=24) | 81.7 | 95.7 |

| 对比学习:全三元组损失 (N=48) | 84.2 | 96.4 |

| 对比学习:InfoNCE损失 (N=48) | 75.0 | 94.2 |

- 实际意义:为音乐人提供了高效的音色检索工具,可以直接用混合音频片段作为查询,在个人音色库中找到最匹配的乐器,提升创作效率。生成的音色嵌入也可用于其他音乐理解任务。

- 主要局限性:实验主要限于从NSynth和Surge虚拟乐器生成的数据,且混合检索实验仅针对“打击乐+贝斯+合成器主音”这一特定场景,模型在更复杂、声部更多的真实音乐混合上的表现有待验证。

🏗️ 模型架构

论文的核心模型是一个Audio Spectrogram Transformer (AST)。其架构和工作流程如下:

- 输入:梅尔频谱图(Mel-spectrogram)。

- 编码器:采用预训练于AudioSet的AST模型作为骨干网络,用于从频谱图中提取全局嵌入向量。AST基于Transformer编码器架构,擅长捕捉长程时频依赖关系。

- 训练目标:在对比学习框架下进行微调。模型接收一个小批量数据,包含N/2个不同乐器的声音对(正样本)。训练目标是通过对比损失(三元组损失或InfoNCE损失),拉近同一乐器不同声音嵌入间的距离(正对),推远不同乐器声音嵌入间的距离(负对)。

- 输出与应用:训练完成后,同一个AST模型用于计算单乐器声音和混合声音的嵌入。检索时,计算混合声音嵌入与数据库中所有单乐器声音嵌入的余弦相似度,返回最相似的结果。

图1展示了整体流程:左侧是混合声音输入,通过统一的模型计算嵌入;右侧是乐器数据库,其嵌入也是由同一模型预先计算好的。通过比较嵌入间的相似度来检索最佳匹配乐器。

图1展示了整体流程:左侧是混合声音输入,通过统一的模型计算嵌入;右侧是乐器数据库,其嵌入也是由同一模型预先计算好的。通过比较嵌入间的相似度来检索最佳匹配乐器。

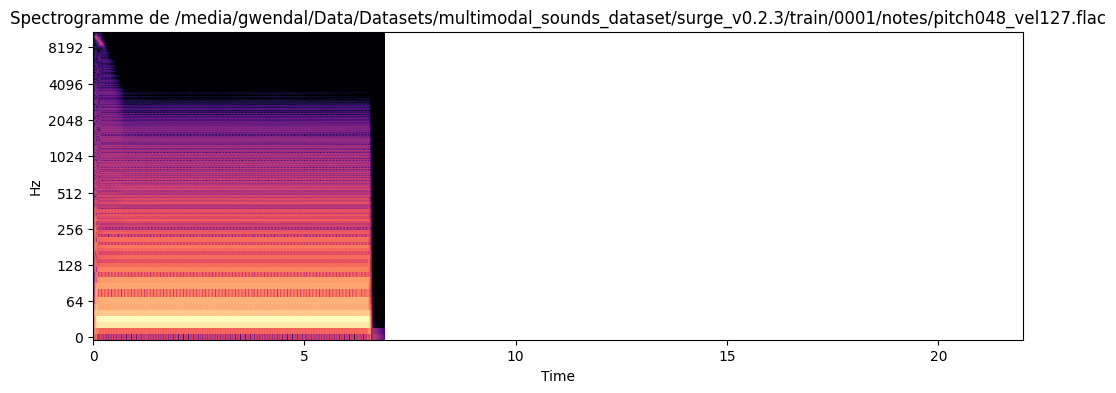

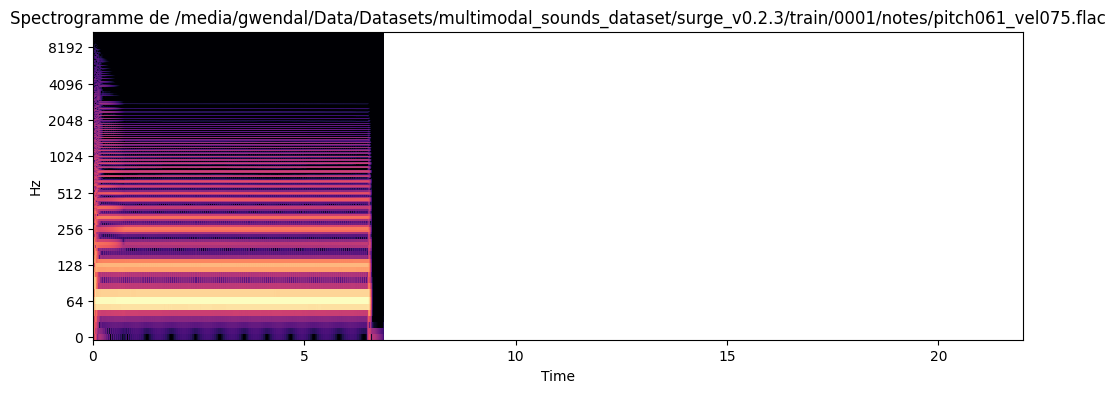

图2详细展示了单乐器正样本对的生成策略。利用虚拟乐器和其家族特定的MIDI音高/力度分布(源自Slakh数据集),可以生成同一个乐器的不同单音符或多音符乐句。这些由同一乐器产生的不同声音构成正样本对。

图2详细展示了单乐器正样本对的生成策略。利用虚拟乐器和其家族特定的MIDI音高/力度分布(源自Slakh数据集),可以生成同一个乐器的不同单音符或多音符乐句。这些由同一乐器产生的不同声音构成正样本对。

图3展示了多音源对比训练的正负样本构建。在一个训练小批量中,混合声音(由不同乐器的声音混合而成)作为锚点,其包含的各个单乐器声音作为正样本。而来自其他混合或乐器的声音作为负样本。

图3展示了多音源对比训练的正负样本构建。在一个训练小批量中,混合声音(由不同乐器的声音混合而成)作为锚点,其包含的各个单乐器声音作为正样本。而来自其他混合或乐器的声音作为负样本。

💡 核心创新点

- 针对音色的虚拟乐器正负对构建:传统对比学习的增强(裁剪、频移、加噪)会破坏音色的完整性(如攻击部分)。本文创新性地利用虚拟乐器本身生成声音对(图2),确保了正样本对共享“乐器音色”这一核心属性,同时保持了声音的完整性和真实性。

- 单一模型处理单/混合源检索:先前方法[1]需要两个模型(一个单源编码器,一个多源解码器)协同工作。本文提出单一AST模型同时为单源和混合源生成嵌入,简化了架构,避免了嵌入空间不匹配的问题,并使检索流程更直接(图1)。

- 针对混合检索的对比目标设计:提出了“全三元组损失”(Full Triplet Loss),即不仅将混合声音与其成分作为正对,也将单乐器声音与包含它的混合声音作为正对(图3)。这更全面地建模了“部分-整体”的音色关系,显著提升了混合检索性能。

🔬 细节详述

- 训练数据:结合了NSynth(1000个乐器,约30万音频文件)和Surge合成器(2884个音色patch)。Surge的音频通过Slakh数据集的MIDI乐谱生成,并模拟了真实的音高和力度分布。最终数据集包含约200,000个音频文件(300小时)。数据增强:通过关闭Surge patch的音频效果(如混响、延迟)来生成额外的增强乐器样本(2123个),并用于训练。

- 损失函数:主要使用了两种对比损失:

- 三元组损失 (Triplet Loss):最小化锚点与正样本间的距离,最大化锚点与负样本间的距离。

- 全三元组损失 (Full Triplet Loss):扩展的三元组损失,允许小批量内的所有声音(无论是单源还是混合源)轮流作为锚点、正样本和负样本。

- InfoNCE损失:最大化正样本对间的相似度,同时最小化与其他所有负样本的相似度。

- 训练策略:

- 模型:预训练的AST作为基础。

- 批大小:默认为N=24,消融实验中使用了N=48。

- 优化器与学习率:未在提供的文本中明确说明。

- 训练时长:未说明。

- 关键超参数:核心是对比学习的批大小N。AST的具体层数、隐藏维度等未在提供的文本中详述。

- 训练硬件:未说明。

- 推理细节:使用余弦相似度计算距离。为降低评估成本,数据库中每个乐器仅使用其中位音高和力度生成的单个音频进行嵌入计算。

- 正则化:未明确说明,但对比学习框架本身具有一定的正则化效果。

📊 实验结果

主要任务:乐器检索 (QbE)

- 单音源检索结果 (测试集: 336个乐器,13000个测试声音)

| 方法 | Top-1 准确率 (%) | Top-5 准确率 (%) |

|---|---|---|

| Timbre Toolbox [18] (基线) | 29.7 | 40.1 |

| AST: 乐器家族分类 (预训练) | 62.9 | 75.2 |

| AST: 乐器分类 (预训练) [1] | 83.2 | 95.0 |

| 对比学习: 三元组损失 | 79.0 | 91.2 |

| 对比学习: InfoNCE损失 | 80.4 | 93.1 |

结论:对比学习方法在单音源任务上具有竞争力,但略逊于基于大规模乐器分类预训练的模型[1]。

- 多音源(三乐器混合)检索结果 (数据集缩减为1463个乐器: 贝斯、合成器主音、打击乐;测试集: 5000个混合)

| 方法 | Top-1 准确率 (%) | Top-5 准确率 (%) |

|---|---|---|

| Demucs [15, 22] 分离 + 单编码器 | 14.5 | 25.8 |

| 多编码器模型 [1] | 17.32 | 62.6 |

| 对比学习: 三元组损失 (N=24) | 64.8 | 85.0 |

| 对比学习: 全三元组损失 (N=24) | 81.7 | 95.7 |

| 对比学习: 全三元组损失 (N=48) | 84.2 | 96.4 |

| 对比学习: InfoNCE损失 (N=48) | 75.0 | 94.2 |

结论:这是论文最突出的结果。所提的对比学习框架,特别是使用“全三元组损失”和较大批大小时,大幅超越了所有基线(包括使用声源分离和先前最优的多编码器模型)。这证明了统一模型直接处理混合信号的优越性。

图4(对应论文中的图3)直观展示了多源对比训练的正负样本关系,这是实现高性能检索的关键设计之一。

图4(对应论文中的图3)直观展示了多源对比训练的正负样本关系,这是实现高性能检索的关键设计之一。

⚖️ 评分理由

- 学术质量:6.0/7。论文问题定义清晰,方法创新(尤其是数据构建策略和统一模型)有实质性贡献,实验对比充分且结果令人信服。扣分点在于:1) 核心的多乐器检索实验限制在较简单的三种乐器混合场景;2) 训练细节(如优化器、学习率调度)不够完整,可能影响完全复现;3) 未深入分析模型在不同乐器家族、不同混合复杂度下的性能变化。

- 选题价值:1.5/2。选题切中音乐制作的实际需求,具有明确的应用前景。虽然任务相对垂直,但“从混合中学习音色表征”的思想有更广泛的潜在应用价值。对音频检索和音乐信息检索领域的研究者有较强吸引力。

- 开源与复现加成:0.0/1。论文仅提供了一个演示网站链接(https://gwendal-lv.github.io/CIR),承诺了代码和模型的未来开源,但当前未提供可用资源。关键实验数据集(特别是包含完整Surge部分)的获取方式也未明确说明。这严重影响了当前的复现便利性。