📄 Bimodal Fusion Framework for Dynamic Facial Expression Recognition In-The-Wild

#语音情感识别 #多模态模型 #跨模态 #音视频 #预训练

✅ 7.0/10 | 前25% | #语音情感识别 | #多模态模型 | #跨模态 #音视频

学术质量 6.0/7 | 选题价值 1.5/2 | 复现加成 -0.5 | 置信度 高

👥 作者与机构

- 第一作者:Bohui Yang(东南大学计算机科学与工程学院)

- 通讯作者:Chunfeng Yang(东南大学计算机科学与工程学院), Wentao Xiang(南京医科大学生物医学工程与信息学院)

- 作者列表:Bohui Yang(东南大学计算机科学与工程学院), Luo Lilin(未说明具体单位,仅在作者列表中), Xiaojia Wang(未说明具体单位,仅在作者列表中), Chunfeng Yang(东南大学计算机科学与工程学院), Wentao Xiang(南京医科大学生物医学工程与信息学院)

💡 毒舌点评

这篇论文的框架设计精巧,将视觉Transformer的参数高效微调(PEFT)思想成功移植到音频-视觉双模态动态表情识别任务中,三个模块(MSA、BFA、CMTM)分工明确,消融实验设计得当,有力支撑了其有效性。然而,其核心创新——在预训练模型中插入适配器(Adapter)进行轻量微调——并非全新概念,论文在探索更深层或更具解释性的跨模态交互机制上着墨不多,主要贡献是工程上的有效整合与验证。

🔗 开源详情

- 代码:论文中未提及代码链接。

- 模型权重:未提及公开的预训练或微调后模型权重。

- 数据集:提供了DFEW和MAFW数据集的官方主页链接,表明数据集是公开可获取的。

- Demo:未提及。

- 复现材料:论文给出了主要的训练设置(优化器、调度器、轮数、采样率),但缺少超参数的具体数值(如学习率、批次大小、适配器维度)和训练硬件信息。

- 引用的开源项目:论文中引用的预训练模型(MAE-Face [18], MAE-AST [19])本身是开源的项目。

📌 核心摘要

该论文针对野外动态表情识别(DFER)中单模态方法难以捕捉跨模态关联的问题,提出了一个名为BFF-DFER的双模态融合框架。该框架的核心思想是利用预训练的音视频Transformer模型作为骨干网络,冻结其大部分参数,仅通过训练三个轻量级模块来实现高效适配:1) 模态特定适配(MSA)用于增强单模态特征;2) 双模态融合适配器(BFA)用于融合跨模态特征;3) 跨模态时序建模(CMTM)用于建模时间动态。与先前单模态微调或直接融合的方法相比,本工作强调在保持预训练模型完整性的前提下,设计专门的模块来显式建模模态内与时序/跨模态关系。在DFEW和MAFW两个大规模野外基准数据集上,BFF-DFER取得了具有竞争力的性能(DFEW: 67.52% UAR, 78.28% WAR; MAFW: 44.46% UAR, 58.41% WAR),超越了多数现有方法。消融实验证实了各模块的贡献,可视化显示其学习的特征具有更好的类内紧凑性和类间可分性。该工作展示了在资源受限条件下,通过参数高效方法整合多模态预训练知识的有效路径。其主要局限性可能在于框架的复杂性(多个适配器模块)以及未探讨更极端的数据或计算受限场景。

🏗️ 模型架构

BFF-DFER的整体架构如图1(a)所示,是一个端到端的双模态融合框架。

BFF-DFER的整体架构如图1(a)所示,是一个端到端的双模态融合框架。

- 输入:接收视频(M帧RGB图像)和音频(梅尔频谱图)作为输入。

- 骨干网络:使用两个独立的预训练Transformer编码器(L=12层),分别处理视频和音频。论文引用的骨干模型是MAE-Face和MAE-AST。

- 冻结与微调:骨干网络的所有Transformer层参数被冻结。仅对新引入的模块(MSA、BFA、CMTM)和最终分类头进行微调。

- 核心组件与数据流:

- 模态特定适配(MSA):如图1(b),在每个Transformer层对的自注意力(MHSA)和多层感知机(MLP)阶段分别插入S-Adapter和G-Adapter。S-Adapter在MHSA之后、MLP之前工作,其结构为

全连接降维 -> GELU -> 全连接升维的瓶颈结构,用于精炼空间/局部表示。G-Adapter在MLP之后工作,结构类似,用于增强全局上下文。适配器的输出以残差连接的方式与主干特征相加。 - 双模态融合适配器(BFA):如图1(c),位于每个MSA模块之后。它由四个适配器组成:视频分支的

V-Adapter1和V-Adapter2,音频分支的A-Adapter1和A-Adapter2。流程是:V-Adapter1/A-Adapter1处理MSA输出 -> 通过可学习门控(tanh(α/β))与原始特征残差融合 ->V-Adapter2/A-Adapter2进一步精炼 -> 通过跨模态门控(tanh(γ/δ))进行融合,其中视频特征复制帧维度以匹配音频,音频特征通过平均池化以匹配视频,最终实现双向的跨模态信息注入。 - 跨模态时序建模(CMTM):如图1(d),在处理完所有L层后,提取视频和音频的分类token(

Vcls,Acls)。将音频分类token与视频的逐帧分类token拼接,构成一个包含(M+1)个token的序列,加入时序位置编码(Pe)和模态类型编码(Te),输入一个独立的Transformer编码器进行最终的时序与跨模态交互建模,其输出的分类token送入线性分类器。

- 模态特定适配(MSA):如图1(b),在每个Transformer层对的自注意力(MHSA)和多层感知机(MLP)阶段分别插入S-Adapter和G-Adapter。S-Adapter在MHSA之后、MLP之前工作,其结构为

💡 核心创新点

- 针对双模态DFER的轻量级PEFT框架:提出BFF-DFER,一个统一框架,允许将预训练的单模态音视频模型无缝扩展到双模态DFER任务,而无需全参数微调。这解决了现有方法多为单模态微调、难以捕捉跨模态关系的局限。

- 双流适配器协同的跨模态融合机制(BFA):设计BFA模块,通过双层适配器和多个可学习门控,实现了对跨模态特征的精细化、双向融合。它既保留了模态特有信息,又动态调节跨模态贡献,比简单的特征拼接或求和更灵活。

- 显式建模模态内与跨模态时序动态(CMTM):引入独立的CMTM模块,在特征提取后专门建模时间序列,并通过拼接模态类型编码来显式区分音视频token,增强了模型对时间演化和模态交互的理解。

🔬 细节详述

- 训练数据:

- 数据集:DFEW(约16,000个片段,7类情绪,官方五折划分), MAFW(10,045个音视频片段,11类,官方五折划分)。

- 预处理/数据增强:未详细说明。视频以每片段16帧(

M=16)采样,分辨率224x224。音频转换为梅尔频谱图。

- 损失函数:论文中未明确说明。通常为标准的交叉熵损失,但未提及具体细节。

- 训练策略:

- 优化器:AdamW。

- 学习率调度:余弦退火(cosine annealing)。

- 训练轮数:25个epoch。

- 其他:单片段推理(single-clip inference)。

- 关键超参数:

- 骨干层数

L=12。 - 视频帧数

M=16, 分辨率224x224。 - 适配器瓶颈维度

Dr:未明确给出具体数值,仅说明为降维-激活-升维结构。

- 骨干层数

- 训练硬件:未说明。

- 推理细节:未说明。

- 正则化/稳定训练技巧:未说明。使用

tanh门控可能有助于稳定训练。

📊 实验结果

表1. 在DFEW和MAFW数据集上与最先进方法的比较

| 方法 | DFEW UAR | DFEW WAR | MAFW UAR | MAFW WAR |

|---|---|---|---|---|

| 3D ResNet-18 (CVPR’16) | 46.52 | 58.27 | - | - |

| Former-DFER (MM’21) | 53.69 | 65.70 | - | - |

| AMH (ICASSP’20) | 54.48 | 66.51 | 32.98 | 48.83 |

| IAL (AAAI’23) | 55.71 | 69.24 | - | - |

| M3DFEL (CVPR’23) | 56.10 | 69.25 | - | - |

| CLIPER (ArXiv’24) | 57.56 | 70.84 | - | - |

| DFER-CLIP (ArXiv’23) | 59.61 | 71.25 | 38.89 | 52.55 |

| SVFAP (TAFFC’24) | 62.83 | 74.27 | 41.19 | 54.28 |

| MAE-DFER (MM’23) | 63.41 | 74.43 | 41.62 | 54.31 |

| HiCMAE (InfFus’24) | 63.76 | 75.01 | 42.65 | 56.17 |

| S2D (TAFFC’24) | 65.45 | 76.03 | 43.40 | 57.37 |

| FineCLIPER (MM’24) | 65.98 | 76.21 | 45.01 | 56.91 |

| FTET-DFER (SPL’24) | 66.43 | 77.02 | - | - |

| MMA-DFER (CVPR’24) | 67.01 | 77.51 | 44.11 | 58.52 |

| BFF-DFER (ours) | 67.52 | 78.28 | 44.46 | 58.41 |

| 注:BFF-DFER在DFEW数据集上取得了最佳的UAR和WAR,在MAFW数据集上UAR最佳,WAR略低于MMA-DFER(差距0.11%)。 |

表2. DFEW数据集上精度-效率权衡对比

| 方法 | WAR (%) | 可调参数 (M) | 比例 (%) |

|---|---|---|---|

| S2D (TAFFC’24) | 76.03 | 9.0 | 9.5 |

| MMA-DFER (CVPR’24) | 77.51 | 7.5 | 4.2 |

| BFF-DFER (Ours) | 78.28 | 17.0 | 8.9 |

| 结论:BFF-DFER以约8.9%的参数比例达到了最高的WAR,展示了良好的精度-效率权衡。 |

表3. DFEW和MAFW数据集上的消融实验

| MSA | BFA | CMTM | DFEW UAR | DFEW WAR | MAFW UAR | MAFW WAR |

|---|---|---|---|---|---|---|

| 55.84 | 67.74 | 32.14 | 46.42 | |||

| ✓ | 64.33 | 75.69 | 42.52 | 56.30 | ||

| ✓ | ✓ | 65.73 | 76.99 | 43.25 | 56.90 | |

| ✓ | ✓ | 66.30 | 77.24 | 43.50 | 57.38 | |

| ✓ | ✓ | ✓ | 67.52 | 78.28 | 44.46 | 58.41 |

| 结论:每个模块都带来性能增益,三者结合达到最优。MSA贡献最大,BFA和CMTM分别在跨模态融合和时序建模上提供补充提升。 |

图2显示了在DFEW和MAFW数据集上,仅使用音频、仅使用视频以及音视频融合(本框架)的性能对比。音视频融合(红色柱)在所有指标上均优于单模态,证实了模态互补性。

图2显示了在DFEW和MAFW数据集上,仅使用音频、仅使用视频以及音视频融合(本框架)的性能对比。音视频融合(红色柱)在所有指标上均优于单模态,证实了模态互补性。

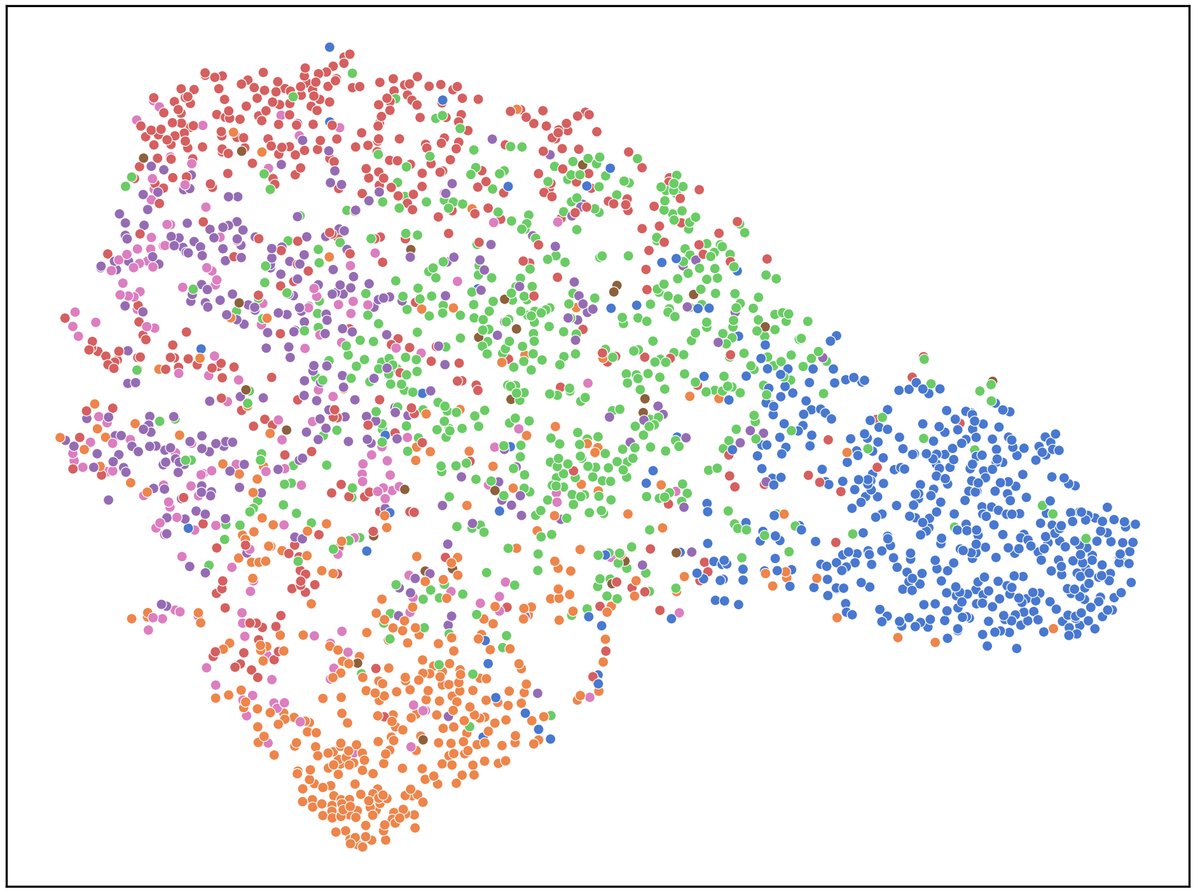

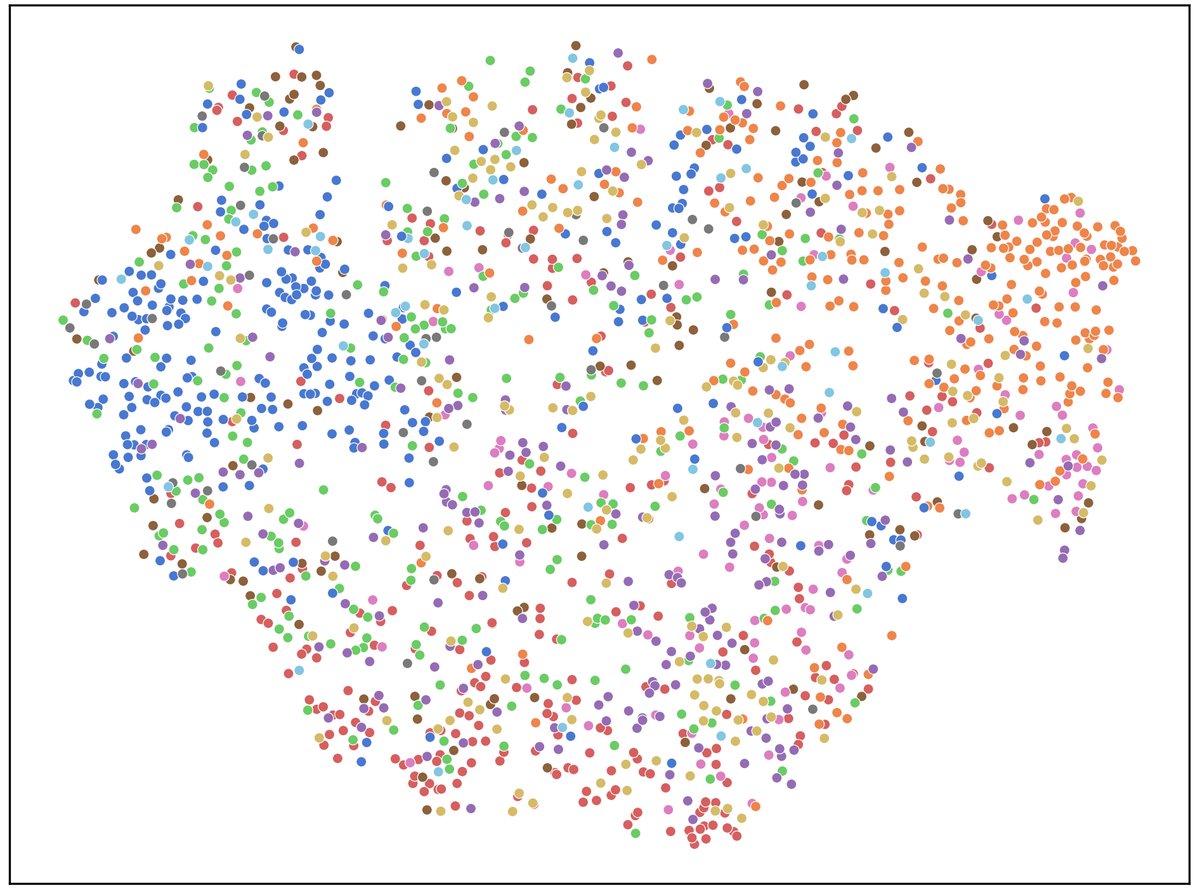

图3展示了BFF-DFER与基线模型在DFEW和MAFW测试集首折(fd1)上的特征t-SNE可视化。BFF-DFER(上)的特征聚类更紧凑、类间分离度更高,其类间/类内距离比(Dist. Ratio)显著高于基线(下),直观证明了其学习到更具判别性的特征表示。

图3展示了BFF-DFER与基线模型在DFEW和MAFW测试集首折(fd1)上的特征t-SNE可视化。BFF-DFER(上)的特征聚类更紧凑、类间分离度更高,其类间/类内距离比(Dist. Ratio)显著高于基线(下),直观证明了其学习到更具判别性的特征表示。

⚖️ 评分理由

- 学术质量:6.0/7 - 论文技术路线清晰,架构设计合理,模块分工明确。实验在多个主流基准上进行,包含充分的对比实验和消融实验,数据可信。创新性主要体现在将PEFT思想系统化地应用于双模态DFER任务,并设计了针对性的融合模块(BFA),属于扎实的整合性创新而非基础理论突破。

- 选题价值:1.5/2 - 动态表情识别是情感计算的重要任务,具有明确的应用前景(如人机交互、心理健康)。采用音视频多模态融合是当前提升性能的关键趋势,与音频领域的语音情感识别研究高度相关。但该任务本身相对垂直,受众面有限。

- 开源与复现加成:-0.5/1 - 论文明确指出了使用的预训练模型(MAE-Face, MAE-AST)和数据集(DFEW, MAFW),并提供了数据集获取链接。然而,论文中未提及代码、模型权重或详细的训练配置(如学习率具体值、适配器维度

Dr),这增加了完整复现的难度。